ในยุคที่การแข่งขันด้านการผลิตขับเคลื่อนด้วยความรวดเร็วและความแม่นยำ โรงงานไทยหลายแห่งกำลังก้าวสู่การปรับเปลี่ยนกระบวนการบำรุงรักษาด้วยเทคโนโลยีใหม่ ๆ ไม่น้อยหน้าเทคโนโลยีโลก ด้วยการผสาน Neural Radiance Fields (NeRF) กับ Large Language Models (LLM) และเทคโนโลยี Augmented Reality (AR) เกิดเป็นคู่มือซ่อมบำรุงแบบ 3 มิติอินเทอร์แอคทีฟที่ไม่เพียงแค่แสดงภาพ แต่ยังช่วยช่างวิเคราะห์ชิ้นส่วนแบบเรียลไทม์ ช่วยให้การวินิจฉัยและการซ่อมแซมรวดเร็วขึ้น—ลดเวลาหยุดเดินเครื่องได้ถึง 40% ในตัวอย่างการใช้งานจริงในโรงงานไทย

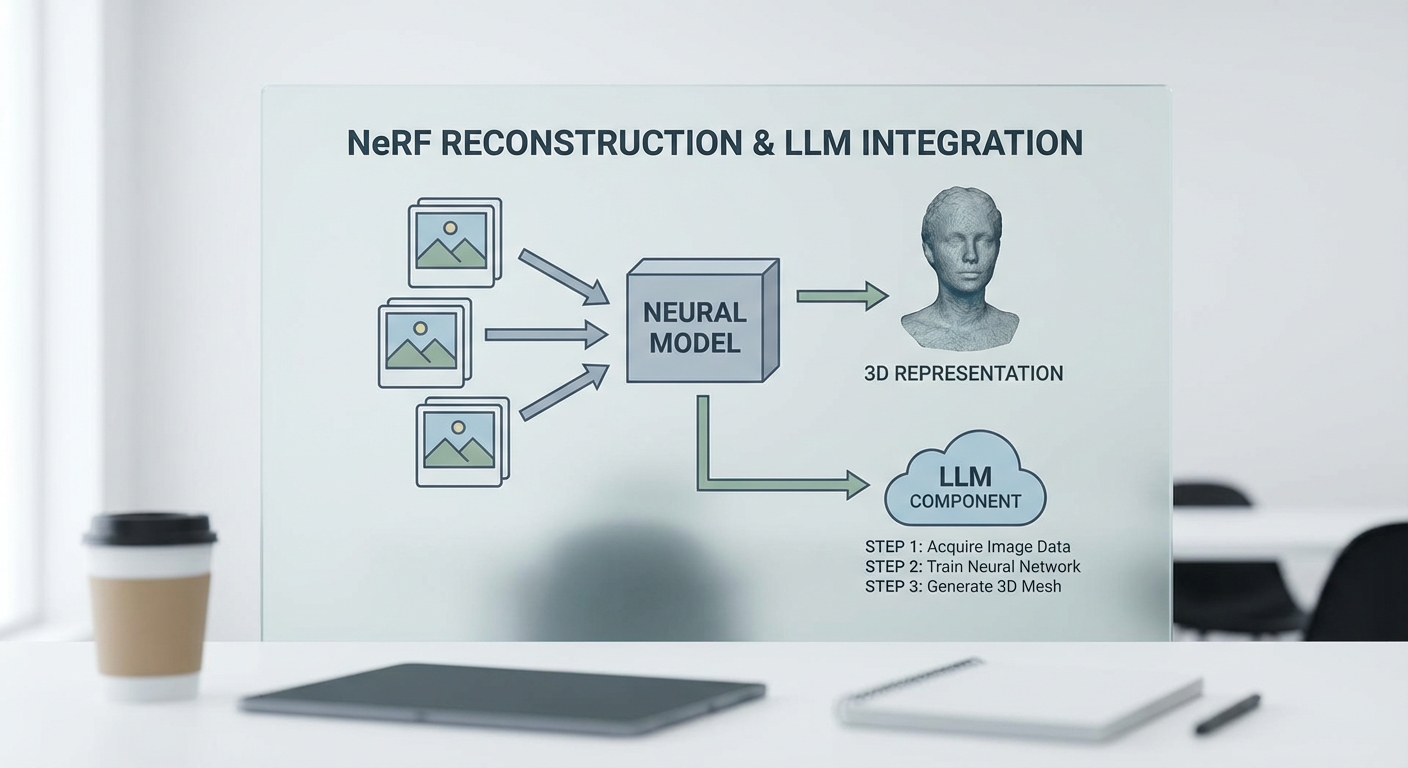

บทนำนี้จะพาผู้อ่านเข้าใจภาพรวมของระบบตั้งแต่กระบวนการเก็บภาพหลายมุมเพื่อสร้างโมเดล NeRF, การใช้ LLM สร้างคำอธิบายขั้นตอนและตอบคำถามเชิงเทคนิคแบบธรรมชาติ จนถึงการนำภาพ 3 มิติเหล่านั้นไปแสดงผลผ่าน AR เพื่อซ้อนทับคู่มือและวัดสภาพชิ้นส่วนแบบเรียลไทม์ ในบทความฉบับเต็มเราจะนำเสนอกรณีศึกษาจากโรงงานไทยที่ใช้งานจริง ตัวเลขผลลัพธ์เชิงประสิทธิภาพ และแนวทางปฏิบัติสำหรับการนำไปใช้จริง ตั้งแต่การเตรียมข้อมูล งบประมาณที่ต้องคาดการณ์ จนถึงความท้าทายทางเทคนิคและการฝึกอบรมทีมช่าง

สรุปข่าวและความสำคัญของโซลูชัน

สรุปข่าวและความสำคัญของโซลูชัน

โรงงานไทยได้ทดลองใช้โซลูชันผสมผสานเทคโนโลยีภาพ 3 มิติและปัญญาประดิษฐ์ โดยใช้ NeRF (Neural Radiance Fields) ร่วมกับ LLM (Large Language Models) และอินเทอร์เฟซการแสดงผลแบบ AR/3D viewer ที่ทำงานบนสถาปัตยกรรม edge compute ผลลัพธ์ที่สำคัญและชัดเจนคือการลดเวลาหยุดเดินเครื่องเฉลี่ยถึง 40% ซึ่งเป็นตัวชี้วัดเชิงปฏิบัติการที่ส่งผลโดยตรงต่อความต่อเนื่องของการผลิตและต้นทุนการดำเนินงาน

ในเชิงเทคนิค โซลูชันนี้ใช้ NeRF ในการสร้างโมเดล 3 มิติที่มีความสมจริงจากภาพถ่ายหลายมุม ทำให้ช่างสามารถมองเห็นชิ้นส่วนในมุมมองจริงแบบ photorealistic จากนั้น LLM จะทำหน้าที่วิเคราะห์คำอธิบายอาการ ความสัมพันธ์ของชิ้นส่วน และให้คำแนะนำการวินิจฉัยเป็นภาษาธรรมชาติ เมื่อรวมกับ AR/3D viewer ที่รันบนอุปกรณ์ edge (เช่น แว่น AR หรือแท็บเล็ตที่มีการประมวลผลด้านหน้า) ระบบสามารถให้การวิเคราะห์ชิ้นส่วนแบบเรียลไทม์ ลดความหน่วง (latency) ในการตอบกลับ และช่วยให้การตัดสินใจซ่อมบำรุงเกิดขึ้นทันที

ผลประโยชน์เชิงธุรกิจมีหลายมิติที่จับต้องได้ เช่น การลดค่าใช้จ่ายการซ่อมบำรุง จากการลดการหยุดเครื่องและลดจำนวนการส่งช่างซ้ำซ้อน, เพิ่มความพร้อมใช้งานของเครื่องจักร (uptime) ซึ่งส่งผลต่อปริมาณการผลิตและคุณภาพการส่งมอบ รวมถึงการลดค่าใช้จ่ายที่เกี่ยวข้องกับการสูญเสียผลผลิต ตัวชี้วัดเพิ่มเติมที่ได้รับการปรับปรุงได้แก่ MTTR (Mean Time To Repair) ที่ลดลง และอัตราการเรียกใช้ชิ้นส่วนอะไหล่ที่ผิดพลาดลดลงจากการวินิจฉัยที่แม่นยำขึ้น

สำหรับผู้เกี่ยวข้องและขอบเขตการทดลอง ในโครงการนำร่องนี้มีผู้เกี่ยวข้องหลักได้แก่:

- ทีมวิศวกรรมบำรุงรักษา — ผู้ใช้หลักที่ได้รับประโยชน์จากคู่มือ 3 มิติแบบอินเทอร์แอคทีฟ

- ทีมไอที/OT (Operational Technology) — รับผิดชอบการผสานระบบ edge compute และการจัดการข้อมูล

- ผู้ให้บริการโซลูชัน AI และพาร์ทเนอร์ฮาร์ดแวร์ — ผู้พัฒนาโมเดล NeRF, ปรับจูน LLM และจัดหาอุปกรณ์ AR

- ฝ่ายบริหารและการเงิน — วัดผลเชิงเศรษฐศาสตร์เพื่อตัดสินใจขยายการใช้งาน

ขอบเขตของการทดลองนำร่องครอบคลุมสายการผลิตหลักหลายแผนก โดยทดสอบกับกลุ่มเครื่องจักรจำนวนจำกัด (ตัวอย่างเช่น 10–15 ชุด) เป็นระยะเวลาไม่กี่เดือน เพื่อเก็บข้อมูลเชิงปริมาณและเชิงคุณภาพก่อนการขยายผล หากผลลัพธ์คงอยู่เมื่อขยายสเกล คาดว่าองค์กรจะได้รับทั้งการลดต้นทุนการบำรุงรักษาและการเพิ่มผลิตภาพอย่างมีนัยสำคัญ ทำให้โซลูชันนี้เป็นกรณีศึกษาเชิงกลยุทธ์สำหรับการทรานส์ฟอร์มกระบวนการซ่อมบำรุงในอุตสาหกรรมไทย

พื้นฐานเทคนิค: NeRF, LLM และการผสานงาน

พื้นฐานเทคนิค: NeRF, LLM และการผสานงาน

NeRF (Neural Radiance Fields) เป็นเทคนิคการสร้างฉากสามมิติแบบเวทีย์ภาพซึ่งเรียนรู้ฟังก์ชันความหนาแน่นและสีที่ขึ้นกับมุมมอง (view-dependent color and density) จากชุดภาพถ่ายหลายมุมที่มีตำแหน่งกล้อง (camera poses) กำกับไว้โดยตรง กระบวนการหลักคือการเรียนรู้พารามิเตอร์ของเครือข่ายนิวรอล (มักเป็น MLP พร้อม positional encoding) ให้สามารถประเมินค่าความหนาแน่นและสีของจุดในเวกเตอร์สถานที่ (3D coordinate + view direction) แล้วใช้ตัวเรนเดอร์แบบดิฟเฟอเรนเชียลเพื่อเทียบกับภาพจริงและอัปเดตพารามิเตอร์ของโมเดล

ในบริบทโรงงานที่ต้องการสร้างคู่มือซ่อมบำรุง 3 มิติแบบอินเทอร์แอคทีฟ จุดสำคัญคือ NeRF สามารถจำลองการตอบสนองของแสงต่อพื้นผิว (รวมถึงเงาสะท้อนแบบ view-dependent ซึ่งสำคัญกับโลหะแบบเงาในชิ้นส่วนเครื่องจักร) ทำให้ภาพเรนเดอร์ที่ได้มีความเรลิสติกสูงและช่วยให้ช่างสามารถซูม ดูมุม และสังเกตรายละเอียดการประกอบได้อย่างแม่นยำ สถิติทั่วไปสำหรับการทำงานจริงคือการเก็บภาพจากหลายมุมตั้งแต่ 50–500 ภาพ ขึ้นกับความซับซ้อนของชิ้นงาน และระยะเวลาการเทรน NeRF แบบเดิมอาจใช้เวลาเป็นชั่วโมงถึงหลายชั่วโมง แต่เทคนิคสมัยใหม่ (เช่น Instant-NGP และการใช้ sparse voxel grids) ลดเวลาในการเรนเดอร์ต่อเฟรมลงสู่ระดับสิบมิลลิวินาทีบน GPU ชั้นสูง ทำให้สามารถรองรับการโต้ตอบแบบ near-real-time ได้มากขึ้น

บทบาทของ LLM (Large Language Models) ในระบบนี้คือการแปลงผลการวิเคราะห์เชิงภาพและข้อมูลเทคนิคเป็นคำแนะนำการปฏิบัติที่ช่างสามารถเข้าใจและปฏิบัติตามได้จริง ๆ LLM จะรับข้อมูลอินพุตจากโมดูลการจดจำชิ้นส่วน (component recognition), ผลการวัดจากเซนเซอร์, และสถานะของเครื่องจักร แล้วแปลงเป็นขั้นตอนเชิงภาษาธรรมชาติที่มีลำดับชัดเจน เช่น รายการเครื่องมือที่ต้องใช้, ลำดับการถอดประกอบ, คำเตือนด้านความปลอดภัย และข้อสังเกตเชิงช่าง นอกจากการสร้างเอกสาร LLM ยังรองรับการโต้ตอบแบบเรียลไทม์ — ช่างสามารถถามคำถามเชิงสถานการณ์ (“ถ้าพบรอยรั่วตรงข้อต่อ B ต้องทำอย่างไร”) และรับคำตอบที่เป็นขั้นตอนพร้อมภาพประกอบหรือลิงก์ไปยังตำแหน่งในโมเดล 3 มิติ

การแปลข้อมูลเชิงเทคนิคเป็นคำแนะนำ โดย LLM ต้องอาศัยการเชื่อมโยงกับฐานความรู้โรงงาน (BOM, maintenance logs, SAP/CMMS) เพื่อให้คำแนะนำสอดคล้องกับมาตรฐานการบำรุงรักษาและประวัติการซ่อมก่อนหน้า การผนวกข้อมูลเชิงสาเหตุ เช่น ค่า vibration หรือ temperature anomalies เข้ากับคำแนะนำจะช่วยให้ LLM สามารถเสนอแนวทางแก้ไขแบบมีบริบทและลดการตัดสินใจที่ผิดพลาดได้

การผสานงานระหว่างโมดูล (capture → NeRF reconstruction → component recognition → LLM-guided instructions → AR rendering) เป็นหัวใจของระบบดังนี้

- Capture: กล้องหลายมุม (มือถือ, rig, หรือโดรนภายในโรงงาน) ร่วมกับข้อมูลตำแหน่งและเวลา เก็บภาพความละเอียดสูงและเมตาดาต้าเซนเซอร์ (เช่น depth, thermal) เพื่อป้อนเข้าสู่ไพป์ไลน์

- NeRF reconstruction: สร้างโมเดลเวทีย์ภาพที่สามารถเรนเดอร์มุมมองใด ๆ ได้อย่างแม่นยำ — ผลลัพธ์ใช้เป็นฐานภาพสามมิติที่มีความเรลิสติกสำหรับการสำรวจและการเทียบเคียง

- Component recognition & pose estimation: ใช้โครงข่ายตรวจจับและแบ่งส่วน (CNN/Transformers/3D-detectors) บนภาพจริงหรือภาพเรนเดอร์จาก NeRF เพื่อระบุชิ้นส่วน, ตำแหน่งเชิงมุม และความเสียหาย (เช่น รอยแตก หรือการสึกหรอ)

- LLM-guided instructions: ข้อมูลเชิงวัตถุและสถานะถูกแมปไปยังเทมเพลตการปฏิบัติงาน แล้ว LLM สร้างขั้นตอนปฏิบัติ, แจกแจงเครื่องมือ, และเสนอวิธีตรวจสอบความสำเร็จ พร้อมรองรับการโต้ตอบแบบถามตอบ

- AR rendering & feedback: ส่งภาพหรือสติกเกอร์/ไกด์บนมุมมอง AR ของช่าง (HMD หรือแท็บเล็ต) เพื่อชี้ตำแหน่งจริงในชิ้นงานและแสดงขั้นตอนแบบเรียลไทม์

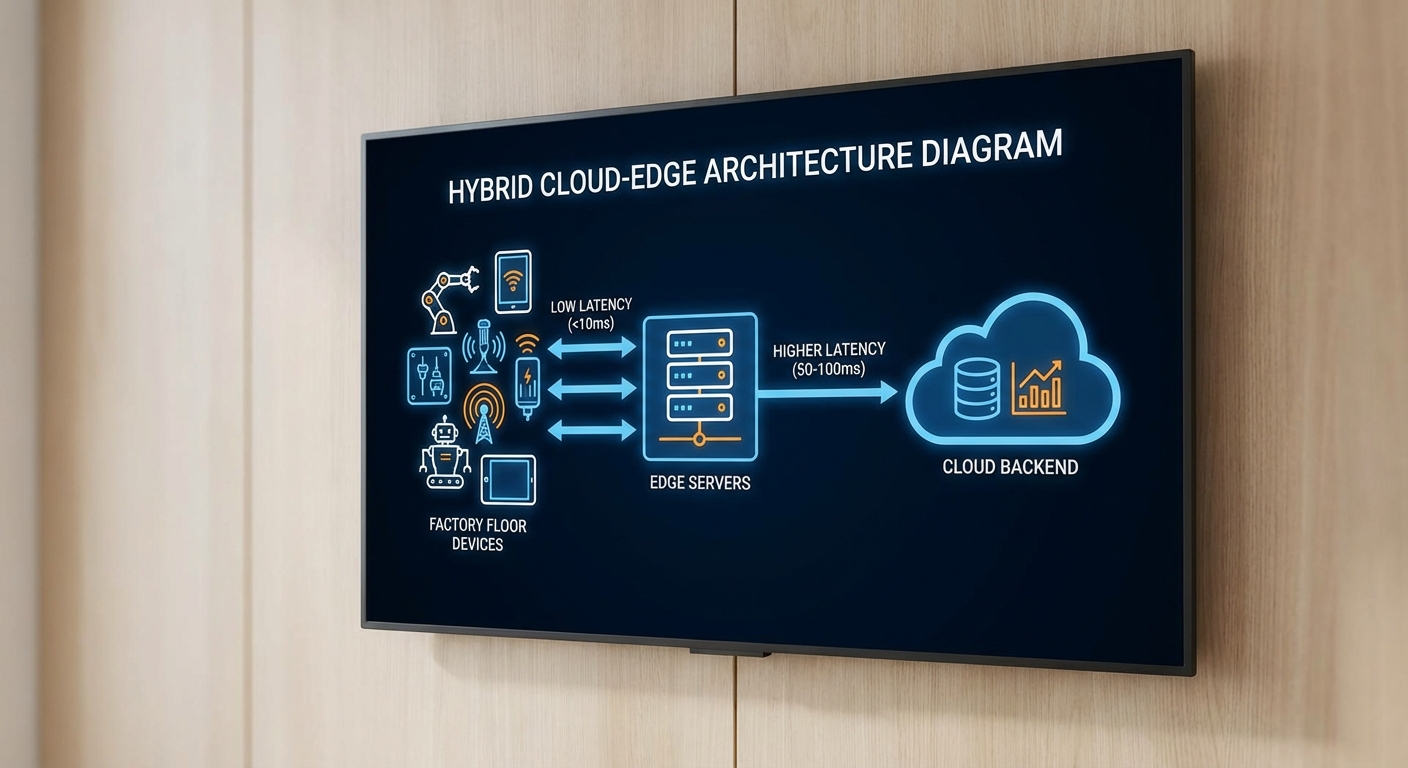

ในการเชื่อมต่อระหว่างโมดูลต้องคำนึงถึง inference latency และการตัดสินใจระหว่าง edge vs cloud — สำหรับประสบการณ์ AR ที่โต้ตอบได้แบบทันที (interactive) ค่า latency เป้าหมายมักอยู่ที่ ต่ำกว่า 100–300 มิลลิวินาที สำหรับการตอบสนองของ UI เช่น การแสดงคำแนะนำหรือการอัปเดตตำแหน่งชิ้นส่วน ในขณะที่งานหนักเช่นการเทรน NeRF ใหม่หรือการวิเคราะห์เชิงลึกของภาพหลายร้อยมุมสามารถผลักขึ้นสู่ cloud เพื่อใช้ทรัพยากรคำนวณขนาดใหญ่และเก็บเป็นดิจิทัลทวิน

แนวปฏิบัติที่ใช้กันในอุตสาหกรรมคือการผสมผสาน: ทำ coarse NeRF หรือ proxy geometry และ inference ของ component recognition บน edge เพื่อให้ตอบสนองเร็ว แต่อัปโหลด batch ของภาพและปรับปรุง NeRF แบบเต็มได้บน cloud เมื่อมีเครือข่ายและทรัพยากรเพียงพอ นอกจากนี้ยังใช้เทคนิคการบีบอัดโมเดล (quantization, pruning), การสตรีมเนื้อหา (progressive streaming) และ caching ของมุมมองสำคัญเพื่อลดแบนด์วิดท์และ latency

สรุป: การรวม NeRF กับ LLM ในโรงงานให้ทั้งมิติภาพที่เที่ยงตรงและการสื่อสารเชิงปฏิบัติการที่ช่างเข้าใจได้ง่าย โดยการจัดสรรงานให้เหมาะสมระหว่าง edge และ cloud ร่วมกับการออกแบบ latency budget ที่ชัดเจน จะเป็นกุญแจสำคัญในการทำให้ระบบช่วยลดเวลาหยุดเดินเครื่องได้จริง (ตัวอย่างเช่น โครงการนำร่องที่ลด downtime ได้ประมาณ 40%) และเพิ่มประสิทธิภาพการซ่อมบำรุงเชิงรุกของโรงงาน

การเก็บข้อมูลและการสร้างโมเดล 3 มิติ (Data Capture & Reconstruction)

การเก็บข้อมูลในสถานที่จริง: หลักการและมาตรฐานการถ่ายภาพ

การเริ่มต้นโครงการ NeRF ในโรงงานต้องเริ่มจากการเก็บภาพที่มีคุณภาพสูงและมีการครอบคลุมมุมมองอย่างเพียงพอ เพื่อให้โมเดลสามารถเรียนรู้ลักษณะความหนาแน่นของฉาก (volume density) และฟังก์ชันการกระเจิงของแสงได้อย่างสมบูรณ์ หลักปฏิบัติที่ควรยึดถือได้แก่ มุมมองที่หลากหลาย (รอบตัวเครื่องจักร 360 องศา รวมมุมมองบน-ล่างเมื่อเป็นไปได้), การซ้อนทับของภาพอย่างน้อย 60–80% ระหว่างภาพเพื่อให้การจับคู่ฟีเจอร์ทำได้ดี และการถ่ายจากระยะที่หลากหลาย (ระยะใกล้สำหรับรายละเอียดชิ้นส่วน 0.5–2 เมตร และระยะกลาง/ไกลสำหรับบริบท 2–5 เมตร ขึ้นอยู่กับขนาดเครื่องจักร) นอกจากนี้การควบคุมแสงเป็นสิ่งสำคัญ: ใช้แสงนุ่มและกระจาย (diffuse lighting) เพื่อลดแสงสะท้อนบนผิวโลหะ ถ้าหลีกเลี่ยงมิได้ให้ใช้ polarizing filter หรือลดความเข้มของแสงจ้าและถ่ายภาพซ้ำในสภาวะแสงที่ต่างกันเพื่อรองรับการเปลี่ยนแปลงจริงในโรงงาน

อุปกรณ์และเทคนิคการเก็บภาพ: มือถือ สแกนเนอร์ และ photogrammetry เบื้องต้น

ในงานภาคสนามมักเลือกใช้อุปกรณ์ผสมผสานระหว่างกล้องมือถือความละเอียดสูง (เช่น สมาร์ทโฟนที่มี LiDAR) กับสแกนเนอร์แบบ handheld (เช่น Artec, Faro) เพื่อเก็บทั้งสีและข้อมูลเชิงเรขาคณิต หากใช้วิธี photogrammetry เบื้องต้น กระบวนการทั่วไปประกอบด้วย:

- การถ่ายภาพแบบมีแผน: วาดเส้นทางการถ่ายรอบเครื่องจักรและกำหนดจุดหยุดถ่ายให้ครอบคลุมทุกมุม

- ติดเครื่องหมายจุดอ้างอิง (targets) หากฉากมีพื้นที่เรียบหรือพื้นผิวที่ซ้ำซ้อน เพื่อช่วยให้การจับคู่ฟีเจอร์ (feature matching) แม่นยำขึ้น

- ใช้ซอฟต์แวร์ Structure-from-Motion (เช่น COLMAP) เพื่อคำนวณ camera poses และ sparse point cloud ก่อนจะไปสู่ dense reconstruction

- เมื่อใช้ LiDAR หรือ structured light scanning จะได้ point cloud ที่แม่นยำสูง สามารถนำมาผสานกับภาพสี (texture mapping) เพื่อเพิ่มรายละเอียดให้ NeRF

การเตรียมข้อมูลฝึก (Data Preparation) และการทำ Annotation

ก่อนป้อนข้อมูลเข้าสู่ pipeline ของ NeRF จำเป็นต้องจัดเตรียมชุดข้อมูลให้เป็นมาตรฐาน รวมถึง:

- คัดเลือกภาพ: ตัดภาพที่เบลอหรือมีการเปิดรับแสงผิดปกติออก และยืนยันว่าแต่ละภาพมี metadata ของตำแหน่งกล้อง (pose) ที่คำนวณได้

- จัดเก็บข้อมูลแบบมีโครงสร้าง: รูปภาพ, camera intrinsics/extrinsics, depth priors (ถ้ามี), และไฟล์ manifest ที่เชื่อมโยงรหัสชิ้นส่วน (part IDs) กับมุม/ภาพที่เกี่ยวข้อง

- Annotation: สร้าง segmentation masks หรือ 2D/3D bounding boxes สำหรับชิ้นส่วนสำคัญ เพื่อให้ LLM สามารถอ้างอิงชิ้นส่วนได้เป็นตัวตน เช่น กำหนด label “มอเตอร์_ชุดที่3” พร้อมรหัสอะไหล่และเอกสารคู่มือ

- จับคู่ชิ้นส่วนกับข้อมูลเมตา: mapping ระหว่างรหัสที่ปรากฏในภาพ/โมเดล กับฐานข้อมูล ERP/CMMS เพื่อให้ LLM สามารถดึงขั้นตอนซ่อมบำรุงหรือสต็อกอะไหล่ได้แบบเรียลไทม์

กระบวนการฟื้นฟู (Reconstruction) ด้วย NeRF: พารามิเตอร์และเวลาประมวลผลตัวอย่าง

การฝึก NeRF เพื่อสร้างโมเดล 3 มิติเชิงเนื้อหาจากชุดภาพจริง ประกอบด้วยขั้นตอนสำคัญคือการ preload camera poses (จาก COLMAP), กำหนด sampling strategy (coarse/fine hierarchical sampling), และใช้ optimizer (เช่น Adam) ในการอัปเดตพารามิเตอร์ของ MLP ต่อไปนี้คือตัวอย่างพารามิเตอร์ที่ใช้จริงในงานภาคสนามและช่วงเวลาประมวลผลโดยประมาณ (ขึ้นอยู่กับฮาร์ดแวร์และความซับซ้อนของฉาก):

- ตัวอย่าง A — NeRF แบบดั้งเดิม (high-fidelity):

- จำนวนภาพ: 800–1,500

- rays per batch (batch size): 4,096

- iterations / training steps: 100k–200k

- learning rate (Adam): 5e-4 (with decay)

- เวลาฝึก: โดยเฉลี่ย 8–30 ชั่วโมง บน GPU ระดับ RTX 3090/RTX A5000

- ตัวอย่าง B — Fast NeRF (instant-ngp / hash encoding):

- จำนวนภาพ: 300–600

- training steps: 10k–50k

- learning rate: เริ่ม 1e-2 แล้วลดลง

- เวลาฝึก: ระหว่าง 5–30 นาที บน RTX 3090 (สำหรับสภาพแวดล้อมที่มีขนาดจำกัด)

- การประมวลผลหลังการฝึก: การสกัดเมช (mesh extraction) หรือการสร้าง depth maps เพิ่มเติมด้วย NeuS/VolSDF อาจใช้เวลาเพิ่มเติม 30 นาที–4 ชั่วโมง ขึ้นกับความละเอียดที่ต้องการ

การจับคู่ชิ้นส่วนและการทำให้ LLM เข้าใจโครงสร้าง

เพื่อให้ LLM สามารถตอบคำถามเชิงโครงสร้างและให้คำแนะนำซ่อมได้อย่างถูกต้อง จำเป็นต้องมีการเชื่อมโยงข้อมูลภาพ/โมเดลกับข้อมูลเชิงสัญลักษณ์ (symbolic data) ซึ่งรวมถึง:

- การระบุ part IDs ในภาพหรือเมช (ใช้ segmentation/instance segmentation) และเก็บเป็นไฟล์ JSON ที่อธิบายความสัมพันธ์เชิงลำดับชิ้นส่วน (parent-child) และความเชื่อมโยงทางกายภาพ

- แนบเมตาเชิงเทคนิค: ชื่อชิ้นส่วน, เบอร์อะไหล่, ตารางความทนทาน, ขั้นตอนการถอดประกอบแบบทีละสเต็ปพร้อมรูปภาพประกอบ และข้อมูลความเสี่ยงหรือข้อควรระวัง

- สร้างตัวแทนข้อมูล (embeddings) ของชิ้นส่วนทั้งในมิติภาพและข้อความ เพื่อให้ LLM สามารถ map คำถามเชิงภาษาธรรมชาติกับตำแหน่งบนโมเดล 3 มิติได้ เช่น “ชิ้นส่วนที่มีรอยสึกด้านซ้ายของมอเตอร์” จะถูกแมปไปยัง segmentation mask และตำแหน่งสามมิติ

- ทดสอบการแมปในสถานการณ์จริง: ตัวอย่างเช่น ให้ช่างใช้กล้องมือถือสแกนตำแหน่งและให้ระบบตอบว่า “ต้องถอดน็อต 4 ตัว ตามขั้นตอน B” พร้อมแสดงภาพ/แอนิเมชันการถอด

สรุปแล้ว การได้มาซึ่งข้อมูลที่มีมาตรฐานสูง ทั้งในเชิงภาพและเมตาเป็นหัวใจของระบบ NeRF+LLM ที่เชื่อถือได้ การออกแบบ pipeline ให้สามารถทำงานได้ทั้งแบบ high-fidelity (เพื่อการวิเคราะห์เชิงลึก) และแบบเร่งด่วน (เพื่อการให้คำแนะนำเรียลไทม์) จะช่วยให้โรงงานสามารถลดเวลาหยุดเดินเครื่องและเพิ่มประสิทธิภาพการบำรุงรักษาในภาคปฏิบัติได้อย่างเป็นรูปธรรม

การออกแบบ pipeline แบบเรียลไทม์และการประมวลผลที่ขอบ (Edge)

การออกแบบ pipeline แบบเรียลไทม์และการประมวลผลที่ขอบ (Edge)

สำหรับระบบคู่มือซ่อมบำรุง 3 มิติที่ผสาน NeRF กับ LLM เพื่อช่วยช่างในโรงงาน แนวทางสถาปัตยกรรมต้องแยกงานตามลักษณะงานและความหน่วง (latency) ระหว่าง edge กับ cloud อย่างชัดเจน: rendering ของมุมมอง 3 มิติแบบอินเทอร์แอคทีฟ, การทำ recognition/local inference และการตอบสนองแบบทันทีต้องอยู่บนอุปกรณ์ขอบ (แท็บเล็ตหรือ edge box) ส่วนการฝึกซ้ำ (retraining) ของ NeRF ขนาดใหญ่ การปรับโครงข่าย LLM/embedding indexing และงาน batch-heavy จะรันบน cloud หรือคลัสเตอร์ GPU/TPU เพื่อให้ใช้ทรัพยากรอย่างมีประสิทธิภาพและรักษาความหน่วงต่ำสำหรับผู้ปฏิบัติงานในสนาม

ตัวอย่างการแบ่งงานเช่น:

- Edge: real-time rendering (progressive NeRF / mesh proxy rendering), lightweight recognition (defect detection, part classification), sensor fusion (กล้อง RGB + depth), local interaction with LLM client (cache ของ response templates) และการแสดงผล UI แบบอินเทอร์แอคทีฟ

- Cloud: full NeRF retraining หรือ fine-tuning ด้วยชุดข้อมูลจากโรงงาน, สร้าง embedding สำหรับเอกสารและคู่มือ, บริการ LLM ขนาดใหญ่สำหรับคำอธิบายเชิงลึกและการสืบค้นความรู้, การจัดเก็บแบบเวอร์ชันและการเผยแพร่โมเดลไปยัง edge

Latency targets และข้อพิจารณาด้านเครือข่าย — เพื่อตอบสนองต่อการใช้งานจริงในพื้นที่ผลิต ควรกำหนดเป้าหมายค่าความหน่วงดังนี้เป็นแนวทาง:

- Interactive rendering latency (frame-to-frame) : เป้าหมาย 30–60 ms สำหรับความรู้สึกลื่นไหล (ตอบสนองคล้าย 15–30 FPS) — ถ้าต้องการความลื่นมากขึ้นให้มุ่ง ≤33 ms.

- Local recognition/inference: <100–200 ms ต่อคำขอ เพื่อให้การตรวจจับชิ้นส่วนและคำแนะนำเกิดขึ้นโดยไม่รบกวนการทำงานของช่าง

- Cloud round-trip for heavy queries (retrieval / long-form LLM): <150–300 ms ในกรณีเครือข่ายภายในโรงงานหรือเครือข่าย 5G; หากอยู่บนเครือข่ายยุ่งยากอาจต้องออกแบบ fallback เป็น LLM บน edge ที่ถูกย่อขนาด

- Model/asset sync window: การอัปเดตโมเดล NeRF ที่มีการเปลี่ยนแปลงไม่จำเป็นต้องเป็น real-time เสมอ — กำหนดเป็น minutes–hours ขึ้นอยู่กับความเสี่ยงของการใช้ข้อมูลเก่า

สำหรับ bandwidth ให้คำนึงถึงปริมาณข้อมูลของ NeRF และการสตรีมชิ้นส่วน 3 มิติ: โมเดล NeRF ฉบับเต็มอาจมีขนาดตั้งแต่หลายสิบถึงหลายร้อยเมกะไบต์ แต่การออกแบบ pipeline ที่ดีจะลดสิ่งที่ต้องส่งผ่านเครือข่ายโดยใช้เทคนิคต่อไปนี้

- Partitioning & LOD (Level-of-Detail): แบ่ง NeRF เป็นชาร์ดตามตำแหน่ง/ชิ้นส่วน (spatial tiles) และส่งเฉพาะชาร์ดที่จำเป็นตามมุมกล้องและบริบทของงาน โดยใช้ LOD ต่ำสำหรับภาพรวมและ LOD สูงสำหรับพื้นที่ที่ช่างโฟกัส

- Progressive streaming & delta updates: ส่งข้อมูลแบบ progressive (coarse → fine) เพื่อให้มีภาพตอบสนองเร็ว จากนั้นเติมรายละเอียดเป็นขั้นตอนเมื่อแบนด์วิธว่าง และส่งเฉพาะ delta ของการอัปเดตเมื่อมีการเปลี่ยนแปลงชิ้นส่วน

- Caching at edge: เก็บชุดของชาร์ดที่ใช้บ่อย (hot-parts) บนอุปกรณ์ด้วยกลยุทธ์ LRU/TTL และ prefetch ตามเคสการใช้งานที่คาดการณ์ได้ เช่น ส่วนที่เสื่อมสภาพบ่อยหรือแผงควบคุมที่ช่างมักตรวจสอบ

เทคนิคลด latency สำหรับโมเดลและ inference — เพื่อให้การตอบสนองอยู่ในช่วงเป้าหมาย ควรผสานหลายวิธีการปรับแต่งโมเดล:

- Model pruning & sparsification: ตัดพารามิเตอร์ที่ไม่จำเป็นออกจากโมเดล NeRF/recognition networks เพื่อลดขนาดและคำนวน

- Quantization: แปลงน้ำหนักเป็น 8-bit หรือแม้แต่ 4-bit เมื่อความแม่นยำยังเป็นที่ยอมรับ เพื่อให้ inference เร็วขึ้นบน NPU/GPU ของอุปกรณ์

- Knowledge distillation: เทรนโมเดลขนาดเล็กบนผลลัพธ์ของโมเดลขนาดใหญ่ (teacher → student) เพื่อให้ได้ความแม่นยำระดับใกล้เคียง แต่รันบน edge ได้

- Operator fusion & optimized runtimes: ใช้ runtime ที่รองรับการเร่งด้วยฮาร์ดแวร์ (เช่น ONNX Runtime, TFLite, CoreML) และรวม operator เพื่อหลีกเลี่ยง overhead

- Mesh proxies & hybrid rendering: ใช้ mesh/voxel proxy สำหรับมุมไกลและเปลี่ยนเป็น NeRF เมื่อซูมเข้า — ลดภาระการคำนวณเต็มรูปแบบ

การจัดการ cache ของโมเดล 3 มิติและชิ้นส่วนที่ใช้บ่อย — แนวปฏิบัติที่แนะนำได้แก่:

- สร้าง content-addressable cache บน edge โดยระบุแต่ละชาร์ดด้วย hash เพื่อให้ sync แบบ incremental ระหว่าง cloud และ edge ง่ายขึ้น

- เก็บ metadata เล็กๆ เช่น bounding box, LOD footprint และความถี่การใช้งาน เพื่อให้ระบบตัดสินใจ prefetch แบบชาญฉลาด

- ใช้ adaptive eviction ที่พิจารณาทั้งความถี่และค่าใช้จ่ายในการดาวน์โหลดซ้ำ (cost-based LRU)

- สำรองข้อมูลหลัก (master copy) บน cloud/CDN ใกล้ edge เพื่อให้การดึงรายการขนาดใหญ่ทำได้รวดเร็ว

ข้อเสนอฮาร์ดแวร์แนะนำสำหรับแท็บเล็ต/edge device — เพื่อให้ pipeline ดำเนินงานตามเป้าหมาย latency และความเชื่อถือได้ ควรพิจารณาสเป็กขั้นต่ำกับสเป็กที่แนะนำตามนี้:

- สเป็กขั้นต่ำ: SoC ที่มี NPU หรือ dedicated accelerator (~≥1 TOPS), CPU quad-core (หรือ equivalent), GPU รองรับ OpenGL ES 3.x/Metal/Vulkan, RAM ≥ 4 GB, storage ≥ 32 GB (eMMC/SSD), กล้อง RGB 8 MP หรือ depth sensor พื้นฐาน, การเชื่อมต่อ Wi‑Fi 5/LTE, แบตเตอรี่ใช้งานจริง 6–8 ชั่วโมง, มาตรฐานความทนทานเบื้องต้นสำหรับสภาพโรงงาน

- สเป็กที่แนะนำ (production-ready): SoC ที่มี NPU ≥ 5 TOPS และ GPU ที่รองรับการเรนเดอร์เร่งฮาร์ดแวร์, CPU 6–8 cores, RAM ≥ 8–12 GB, storage NVMe ≥ 128 GB เพื่อเก็บ cache โมเดลและ assets, Wi‑Fi 6/6E และโมดูล 5G (สำหรับการเชื่อมต่อ low-latency), กล้อง RGB+depth/TOF, พอร์ต USB-C สำหรับการเชื่อมต่อภายนอก และตัวเครื่องแบบ rugged/ป้องกันฝุ่นน้ำ (IP54 ขึ้นไป)

สุดท้าย การออกแบบ pipeline ต้องคำนึงถึงการสื่อสารระหว่างทีมงาน: กำหนด SLA สำหรับการอัปเดตโมเดล, นโยบาย fallback เมื่อมีเครือข่ายไม่เสถียร (เช่น ใช้ local distilled LLM + cached NeRF proxies) และระบบมอนิเตอร์เพื่อตรวจสอบ latency/ความสำเร็จของ inference แบบเรียลไทม์ เพื่อให้ประสิทธิภาพที่รายงานจริงช่วยลดเวลาหยุดเดินเครื่องได้ตามเป้าหมาย — ตัวอย่างเช่น การนำวิธีการเหล่านี้ไปใช้เชิงปฏิบัติสามารถช่วยให้เวลาหยุดเดินเครื่องลดลงได้มากสุดตามกรณีศึกษา ~40% เมื่อผสานกับกระบวนการบำรุงรักษาที่ดีกว่า

การใช้งานจริง: อินเทอร์เฟซ 3 มิติอินเทอร์แอคทีฟสำหรับช่าง

ภาพรวมการใช้งานระบบคู่มือซ่อมบำรุงแบบ 3 มิติที่ผสาน NeRF (Neural Radiance Fields) กับ LLM บนแท็บเล็ตหรือแว่น AR ออกแบบมาเพื่อให้ช่างโรงงานสามารถชี้ไปยังชิ้นส่วนจริงแล้วเรียกข้อมูลเชิงบริบทแบบเรียลไทม์ ระบบจะใช้โมเดล 3 มิติที่สร้างจาก NeRF ในการแมปสภาพแวดล้อมจริง (spatial anchoring) จากนั้นแสดงเลเยอร์ข้อมูลและคำแนะนำจาก LLM ทับบนชิ้นส่วนที่ช่างชี้ ทำให้การทำงานมีความแม่นยำ ลดความเข้าใจคลาดเคลื่อน และลดเวลาหยุดเดินเครื่องได้อย่างชัดเจน

Workflow ของช่าง: scan → identify → instruct → verify

กระบวนการปฏิบัติงานถูกออกแบบให้สอดคล้องกับการทำงานจริงบนชั้นผลิต โดยแบ่งเป็น 4 ขั้นตอนหลัก:

- Scan: ช่างใช้กล้องบนแท็บเล็ต/แว่น AR สแกนบริเวณอุปกรณ์ ระบบ NeRF จะปรับรูปทรงแสงและตำแหน่งแบบเรียลไทม์เพื่อสร้างแผนที่ 3 มิติของชิ้นส่วน

- Identify: อัลกอริทึมจับคู่โมเดลระบุชิ้นส่วนและหมายเลขชิ้นส่วน (part number) พร้อมดึงประวัติจากฐานข้อมูลโรงงานและ CMMS เพื่อแสดงสถานะและประวัติการซ่อม

- Instruct: LLM ให้คำแนะนำทีละขั้นตอน (step-by-step) แบบอินเทอร์แอคทีฟ โดยแสดงข้อความ, รูปภาพ, และไฮไลท์ในมุมมอง 3 มิติ — ช่างสามารถขอคำอธิบายเพิ่มเติมหรือขอสแกนเฉพาะส่วนได้

- Verify: หลังปฏิบัติงาน ช่างยืนยันผลผ่าน UI โดยถ่ายภาพการซ่อม อัปโหลดเซนเซอร์รีดดิ้ง และบันทึกสถานะ ซึ่งจะถูกส่งกลับไปยัง CMMS เพื่ออัปเดต work order และสต็อกอะไหลี

ตัวอย่างข้อความคำสั่งที่ LLM ส่งออกและวิธียืนยันโดยช่าง

ระบบ LLM สร้างคำสั่งที่เป็นภาษาธรรมชาติแบบมีโครงสร้าง เพื่อให้ช่างเข้าใจง่ายและสามารถปฏิบัติตามได้ทันที ตัวอย่างข้อความและการยืนยัน:

- คำสั่งตัวอย่างจาก LLM: "1) ปิดวาล์วหลัก (Valve A) และยืนยันว่าแรงดันลดลงต่ำกว่า 0.2 bar; 2) คลายน็อต M10 สองตัวตามภาพ; 3) เปลี่ยนซีลด้วยชิ้นส่วน P/N 1234-AB; 4) เปิดระบบและตรวจสอบการรั่วซึมเป็นเวลา 5 นาที"

- การยืนยันโดยช่าง: ช่างแตะปุ่ม ยืนยันแต่ละขั้นตอน บนอินเทอร์เฟซ หรือถ่ายวิดีโอ/ภาพช็อตของงาน ระบบจะตรวจสอบข้อมูลเซนเซอร์ (pressure, temperature) ที่อ่านได้แบบเรียลไทม์และแสดงเครื่องหมายถูกเมื่อเงื่อนไขสำเร็จ

- การโต้ตอบเชิงวินิจฉัย: หากค่าที่อ่านไม่เป็นไปตามเงื่อนไข LLM จะเสนอทางเลือก เช่น "หากแรงดันคงที่ >0.2 bar ให้ตรวจสอบวาล์วสำรองหรือท่อเชื่อมต่อ" พร้อมปุ่มให้ช่างสั่งตรวจเช็คเพิ่มเติม หรือส่งคำขอช่างเฉพาะทาง (escalation)

นอกจากข้อความขั้นตอน LLM ยังสร้างคำสั่งย่อยที่ช่างสามารถเรียกใช้งานได้ทันที เช่นปุ่ม ซ่อมชั่วคราว (Temporary Fix), สั่งอะไหล่, หรือ ขอผู้เชี่ยวชาญ ซึ่งทุกการกระทำจะถูกบันทึกเป็นเหตุการณ์ (event log) พร้อมพิกัดเวลาและรูปถ่ายประกอบ

UI/UX ตัวอย่างบนแท็บเล็ต/แว่น AR

อินเทอร์เฟซออกแบบเพื่อความชัดเจนและความรวดเร็วในการตัดสินใจ ประกอบด้วยแผงข้อมูลหลัก เช่น ชื่อชิ้นส่วน, หมายเลขชิ้นส่วน, ระดับความเสี่ยง (Risk Level) ที่แสดงด้วยสี และปุ่มคำสั่งสำคัญ (เช่น เรียกคำสั่งซ่อม, สร้าง Work Order, ถ่ายภาพ, ดาวน์โหลดคู่มือ PDF)

ตัวอย่างองค์ประกอบ UI ที่สำคัญ:

- Panel ข้อมูลชิ้นส่วน: สรุปสเปค, ประวัติซ่อม, รอบเวลา MTTR/MTBF

- Badge ระดับความเสี่ยง: สีเขียว/เหลือง/แดง แสดงความเร่งด่วนและผลกระทบต่อการผลิต

- ปุ่มการกระทำด่วน: "สร้าง WO" เพื่อเปิดคำสั่งซ่อมใน CMMS, "เรียกคำสั่งซ่อม" เพื่อให้ LLM ส่งขั้นตอนฉุกเฉิน, "บันทึกหลักฐาน" เพื่อแนบรูป/วิดีโอ

- แถบสถานะการดำเนินงาน: แสดงขั้นตอนที่ทำแล้ว, รอดำเนินการ, หรือที่ต้องการ escalation

การบูรณาการกับระบบ CMMS

การเชื่อมต่อกับ CMMS เป็นส่วนสำคัญที่ทำให้ข้อมูลการซ่อมบำรุงเป็นระบบและวิเคราะห์ได้ ระบบจะส่งข้อมูลสองทาง (bi-directional integration):

- จาก CMMS → อินเทอร์เฟซ AR: ดึงข้อมูล Work Order, ประวัติการซ่อม, สต็อกอะไหล่ และแผนบำรุงรักษาตามรอบ (PM schedule)

- จากอินเทอร์เฟซ AR → CMMS: สร้าง/อัปเดต Work Order, แนบหลักฐานภาพถ่ายและวิดีโอ, บันทึกเวลาหยุดเครื่อง (downtime) และอัปเดตสถานะสต็อกอะไหล่แบบทันที

ผลลัพธ์เชิงธุรกิจได้แก่การปรับปรุง KPI ของการบำรุงรักษา — ตัวอย่างจากโครงการนำร่องในโรงงานไทยที่นำเสนอในบทความหลัก พบว่าระบบลดเวลาหยุดเดินเครื่องได้ถึง 40% เนื่องจากการวินิจฉัยแม่นยำขึ้น การส่งคำสั่งซ่อมที่รวดเร็ว และการเชื่อมต่อกับ CMMS ทำให้การจัดการ WO มีความต่อเนื่อง

สรุปแล้ว อินเทอร์เฟซ 3 มิติผสาน LLM ช่วยให้ช่างปฏิบัติงานได้อย่างมีประสิทธิภาพและมีหลักฐานยืนยันที่ชัดเจน ทุกขั้นตอนที่ช่างทำจะถูกติดตามและเชื่อมโยงกับระบบ CMMS เพื่อให้เกิดการพัฒนากระบวนการบำรุงรักษาอย่างต่อเนื่องและเป็นไปตามมาตรฐานองค์กร

ผลลัพธ์เชิงตัวเลข: ลดเวลาหยุดเดินเครื่อง 40% และ KPI ที่ติดตาม

ผลลัพธ์เชิงตัวเลข: ลดเวลาหยุดเดินเครื่อง 40% และ KPI ที่ติดตาม

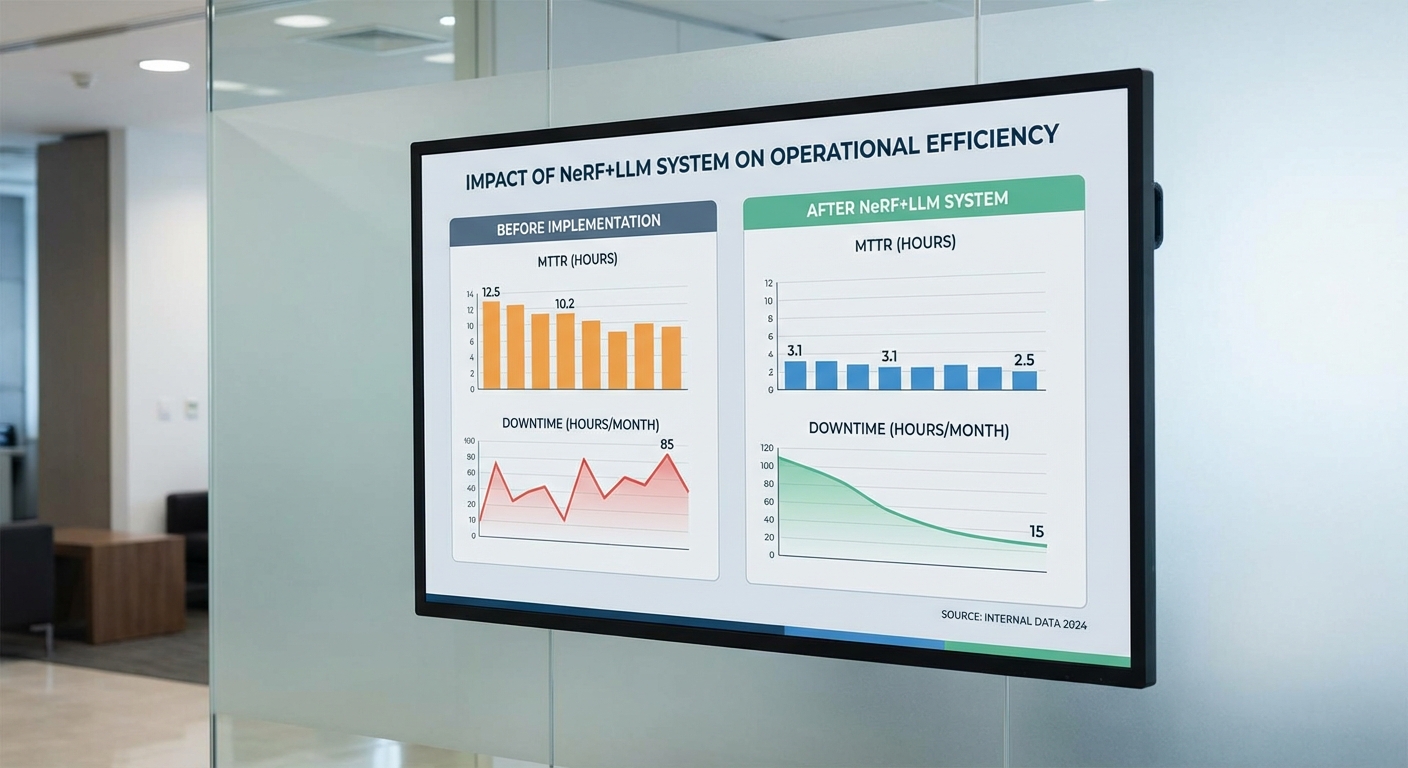

ผลการทดลองใช้งาน NeRF + LLM ในโรงงานตัวอย่างเป็นระยะเวลา 6 เดือนแสดงให้เห็นถึงการปรับปรุงเชิงตัวเลขที่ชัดเจน โดยค่าเฉลี่ยของการลดเวลาหยุดเดินเครื่อง (downtime) อยู่ที่ ประมาณ 40% เมื่อเทียบกับช่วงก่อนติดตั้งระบบ คู่มือนำทาง 3 มิติแบบอินเทอร์แอคทีฟช่วยให้ช่างสามารถระบุสาเหตุและวิเคราะห์ชิ้นส่วนแบบเรียลไทม์ ทำให้ MTTR (Mean Time To Repair) ลดลงอย่างมีนัยสำคัญ และ MTBF (Mean Time Between Failures) เพิ่มขึ้น ตัวอย่างตัวเลขจากโรงงานตัวอย่าง (ผลจริงจากการทดลอง 6 เดือน) โดยสรุปดังนี้:

- MTTR (จริง): ลดจาก 5.8 ชั่วโมง ก่อนหน้า เหลือ 3.5 ชั่วโมง หลังใช้งาน (~40% ลดลง)

- MTBF (จริง): เพิ่มจาก 420 ชั่วโมง เป็น 560 ชั่วโมง (~33% เพิ่มขึ้น)

- ชั่วโมง downtime ต่อเดือน (จริง): ลดจาก 150 ชั่วโมง เป็น 90 ชั่วโมง (40% ลดลง)

- จำนวนการเข้าเครื่องซ่อม/เดือน (จริง): ลดจาก 45 ครั้ง เป็น 28 ครั้ง (~38% ลดลง)

เพื่อให้เห็นภาพการประหยัดเชิงเศรษฐศาสตร์ เรานำเสนอการคำนวณ ROI แบบตัวอย่าง (สมมติฐาน) สองกรณี — กรณีอนุรักษ์นิยม และ กรณีมุมมองบวก โดยสมมติว่าชั่วโมง downtime ที่ลดได้ต่อเดือนเท่ากับ 60 ชั่วโมง (150 → 90 ชั่วโมง) และมีการลดค่าแรงและชิ้นส่วนจากกระบวนการวินิจฉัยที่แม่นยำขึ้น ดังนี้:

- สมมติฐานการประหยัดต่อเดือน (ทั้งสองกรณี):

- ค่าลดค่าแรงและชิ้นส่วนต่อเดือนรวม = 299,100 บาท (ประกอบด้วยค่าแรงลดลง ~95,900 บาท และชิ้นส่วนลดลง ~203,200 บาท)

- ชั่วโมง downtime ที่ลดได้ = 60 ชั่วโมง/เดือน

- กรณีอนุรักษ์นิยม: ค่าความเสียหายจาก downtime = 7,000 บาท/ชั่วโมง → ประหยัด downtime = 420,000 บาท/เดือน → รวมประหยัดต่อเดือน = 719,100 บาท

- กรณีมุมมองบวก: ค่าความเสียหายจาก downtime = 15,000 บาท/ชั่วโมง → ประหยัด downtime = 900,000 บาท/เดือน → รวมประหยัดต่อเดือน = 1,199,100 บาท

- ต้นทุนการลงทุนเริ่มต้น (ตัวอย่างสมมติ): ฮาร์ดแวร์, สแกน NeRF, พัฒนา LLM, ฝึกอบรม และติดตั้ง = 3,500,000 บาท

จากตัวเลขข้างต้น คำนวณระยะเวลาคืนทุน (Payback Period) และ ROI ย่อดังนี้:

- กรณีมุมมองบวก: Payback = 3,500,000 / 1,199,100 ≈ 2.9 เดือน. ผลประหยัดสุทธิใน 1 ปี (สมมติ OPEX สนับสนุน/ลิขสิทธิ์ต่อปี 1,200,000 บาท) ≈ 12.9 ล้านบาท ส่วน ROI สะสม 3 ปีหลังค่าลงทุน ≈ ราว 1,030%* (ตัวอย่างเชิงประมาณค่า)

- กรณีอนุรักษ์นิยม: Payback = 3,500,000 / 719,100 ≈ 4.9 เดือน. ผลประหยัดสุทธิใน 1 ปี (หลังหัก OPEX 1.2 ล้านบาท) ≈ 7.4 ล้านบาท; ROI สะสม 3 ปี ≈ ราว 537%

หมายเหตุ: ตัวเลขข้างต้นเป็นการยกตัวอย่างการคำนวณเพื่อสื่อให้เห็นศักยภาพเชิงเศรษฐกิจจริงในสถานการณ์ที่มีค่าเสียหายจาก downtime สูง — ผู้ประกอบการควรปรับสมมติฐาน (ค่า downtime ต่อชั่วโมง, ต้นทุนเริ่มต้น, ค่าบริการต่อปี ฯลฯ) ให้สอดคล้องกับโรงงานของตนเมื่อประเมิน ROI จริง

นอกจากประหยัดเชิงต้นทุนแล้ว การติดตาม KPI ด้านปฏิบัติการและการยอมรับจากพนักงานเป็นสิ่งสำคัญ ผลการสำรวจภายในโรงงานตัวอย่างระบุว่า:

- อัตราการยอมรับของช่าง (adoption): ≈ 85% ของช่างใช้ระบบเป็นเครื่องมือหลักในการวินิจฉัย

- ความพึงพอใจและความมั่นใจของช่าง: 72% รายงานว่าใช้เวลาในการวินิจฉัยน้อยลงอย่างมีนัยสำคัญ และ 64% รู้สึกมั่นใจขึ้นเมื่อซ่อมครั้งแรก

- ประสิทธิภาพการทำงาน (productivity): งานต่อกะเพิ่มขึ้นโดยเฉลี่ย ≈ 18% และอัตราการซ่อมครั้งแรกสำเร็จ (first-time-fix rate) ดีขึ้นจาก 62% → 85%

- การลดเวลาในการฝึกช่างใหม่: ระยะเวลาที่ต้องใช้จนกว่าจะทำงานได้เองลดจาก ~6 สัปดาห์เหลือ ~3 สัปดาห์ (ลดลง 50%)

สรุป: ข้อมูลเชิงตัวเลขจากโรงงานตัวอย่างชี้ให้เห็นว่าเทคโนโลยี NeRF + LLM สำหรับคู่มือซ่อมบำรุง 3 มิติอินเทอร์แอคทีฟ สามารถลดเวลาหยุดเดินเครื่องเฉลี่ยได้ ประมาณ 40% พร้อมผลพลอยได้ด้าน MTTR, MTBF, ค่าแรง, ค่าชิ้นส่วน และ productivity ของช่างที่ดีขึ้นอย่างมีนัยสำคัญ เมื่อพิจารณาในมุมมอง ROI แม้ในกรณีอนุรักษ์นิยม ระบบสามารถคืนทุนได้ภายในไม่กี่เดือนและให้ผลตอบแทนสะสมสูงในระยะกลางถึงระยะยาว

อุปสรรค ปัญหาเชิงปฏิบัติ และบทเรียนที่ได้

อุปสรรค ปัญหาเชิงปฏิบัติ และบทเรียนที่ได้

การนำเทคโนโลยี NeRF (Neural Radiance Fields) ร่วมกับ LLM มาใช้ในการสร้างคู่มือซ่อมบำรุง 3 มิติแบบอินเทอร์แอคทีฟในโรงงานจริง เผชิญความท้าทายในหลายมิติ ทั้งด้านเทคนิค ด้านข้อมูล และด้านการปฏิบัติการ ถึงแม้โครงการนำร่องในโรงงานไทยที่อ้างอิงจะรายงานการลดเวลาหยุดเดินเครื่องถึง 40% แต่การทำให้ระบบทำงานอย่างเสถียรในสภาพแวดล้อมการผลิตที่หลากหลายต้องการการวางแผนและการปรับแต่งอย่างรอบคอบ

ข้อจำกัดทางเทคนิคของ NeRF — NeRF ให้ภาพโฟโตเรียลิสติกและประเมินการมองเห็นจากมุมต่าง ๆ ได้ดี แต่มีข้อจำกัดสำคัญ เช่น ความยากในการจับภาพพื้นผิวที่สะท้อนหรือโปร่งใส (specular / translucent surfaces), ส่วนที่บางและมีรายละเอียดสูง (thin structures), และวัตถุที่เคลื่อนไหวระหว่างการจับภาพ นอกจากนี้ NeRF แบบดั้งเดิมมักต้องใช้ข้อมูลมุมมองจำนวนมากและทรัพยากรคอมพิวติ้งสูงสำหรับการเทรนและเรนเดอร์ ในการบรรเทาปัญหา ควรนำแนวทางปฏิบัติดังนี้ไปใช้เป็นมาตรฐาน:

- โปรโตคอลการถ่ายภาพ (capture protocol) — กำหนดจำนวนมุมและความครอบคลุมขั้นต่ำ เช่น 200–1,000 ภาพต่อชิ้นส่วนตามความซับซ้อน พร้อมภาพระยะใกล้/ไกล และภาพแบบ exposure-bracketing เพื่อจัดการช่วงความสว่าง

- ควบคุมการจัดแสง — ใช้แหล่งกำเนิดแสงคงที่ หลีกเลี่ยงแสงกระพริบและสะท้อนโดยตรง ใช้ softbox หรือ polarizing filter กับกล้องเพื่อลดการสะท้อน

- ผสานเซนเซอร์หลายรูปแบบ — ผสมข้อมูล depth (LiDAR/ToF) หรือ photogrammetry กับ NeRF เพื่อลดความคลาดเคลื่อนของเรขาคณิต และใช้ depth supervision ในการเทรน

- เตรียมมาส์กและการตัดแบ็กกราวด์ — สร้างมาส์ก per-view เพื่อลดผลกระทบจากฉากหลัง และช่วยให้โมเดลโฟกัสที่ชิ้นส่วน

- เลือกสถาปัตยกรรมและพารามิเตอร์ที่เหมาะสม — ใช้เวอร์ชัน NeRF ที่รองรับฉากไม่คงที่หรือที่เพิ่มประสิทธิภาพการประมวลผล (เช่น multi-scale / sparse voxel approaches) เพื่อลดเวลาเทรนและหน่วยความจำ

ความถูกต้องของการจดจำชิ้นส่วนโดย LLM/ระบบวิชวล — LLM ที่ใช้ร่วมกับภาพ 3 มิติมักพึ่งพาการจับคู่ภาพกับฐานข้อมูลชิ้นส่วน (BOM, CAD metadata, รหัสซีเรียล) ความเสี่ยงคือการรู้จำผิดหรือให้คำแนะนำไม่ตรงกับบริบทการผลิตจริง ตัวแก้มีได้ทั้งการเสริมฐานความรู้เชิงโครงสร้าง (ontology/BOM linkage), การทำ fine-tune ของโมเดลบนข้อมูลองค์กร, และการใช้กลไก human-in-the-loop สำหรับการยืนยันผลลัพธ์ในระดับความเชื่อมั่นต่ำ ตัวอย่างปฏิบัติการที่ได้ผลคือการตั้งเกณฑ์ความเชื่อมั่น (confidence threshold) 0.9: หากผลต่ำกว่านี้ ระบบจะส่งสัญญาณให้ผู้ช่างยืนยันก่อนดำเนินการต่อ

ความเสี่ยงด้านข้อมูลและแนวปฏิบัติด้านความปลอดภัย — รูปภาพและโมเดล 3 มิติที่บันทึกจากโรงงานอาจรั่วไหลความลับทางการผลิต เช่น รูปแบบชิ้นส่วน, หมายเลขซีเรียล หรือกระบวนการภายใน การป้องกันต้องประกอบด้วยนโยบายและเทคนิคดังนี้:

- ใช้งานระบบบน on-premises หรือ private cloud เมื่อต้องปกป้อง IP สูง และหลีกเลี่ยงการอัปโหลดข้อมูลดิบสู่บริการสาธารณะ

- เข้ารหัสข้อมูลทั้งขณะเก็บ (at rest) และขณะส่ง (in transit) ด้วยมาตรฐานที่เหมาะสม เช่น AES-256/TLS

- จำกัดการเข้าถึงตามบทบาท (role-based access control) และรักษา audit log เพื่อตรวจสอบการเข้าถึงและการใช้งาน

- ดำเนินการ redaction อัตโนมัติสำหรับข้อมูลส่วนบุคคลหรือข้อมูลที่เป็นความลับ เช่น การเบลอหน้าพนักงาน หมายเลขซีเรียล หรือป้ายภายในภาพ

- กำหนดนโยบายอายุข้อมูล (data retention) และเวิร์กโฟลว์การอนุญาตก่อนเผยแพร่โมเดลในระบบสนับสนุน

คำแนะนำเชิงขั้นตอนสำหรับการทดลองเชิงพilot — แนะนำให้ดำเนินการเป็นโครงการนำร่องแบบก้าวต่อก้าว ดังนี้

- กำหนดขอบเขตที่ชัดเจน — เลือกเครื่องจักรหรือไลน์การผลิตเดียวที่สำคัญต่อปัญหาหยุดเดินเครื่อง เช่น หุ่นยนต์เชื่อมชิ้นส่วนหรือปั้มแรงดัน สูงสุด 1–3 หน่วย เพื่อควบคุมขอบเขตและความเสี่ยง

- ตั้ง KPI ที่จับต้องได้ — เช่น ลด MTTR (Mean Time To Repair) ในชุดทดสอบลง 20–40%, อัตราการรู้จำชิ้นส่วน >95%, latency การตอบสนองแบบเรียลไทม์ <200–500 ms

- ออกแบบโปรโตคอลการจับภาพ — ระบุจำนวนภาพเป้าหมาย (ตัวอย่าง: 500 ภาพต่อชิ้นซับซ้อน, 200 ภาพต่อชิ้นเรียบ), รูปแบบมุมกล้อง, ระยะโฟกัส และการจัดแสง ควบคุมสภาพแวดล้อมให้นิ่งที่สุดเท่าที่จะทำได้

- ผสานข้อมูลจากระบบเดิม — ต่อเชื่อม BOM, CAD, และระบบ CMMS (Computerized Maintenance Management System) เพื่อให้ LLM สามารถดึงข้อกำหนดชิ้นส่วนและประวัติซ่อมได้อย่างแม่นยำ

- ทดสอบความปลอดภัยและความเป็นส่วนตัว — ดำเนินการ risk assessment ก่อนถ่ายภาพจริง และตั้งกลไกการอนุมัติสำหรับการเผยแพร่โมเดลภายนอกทีม

- วัดผลและปรับปรุงแบบวงปิด — รันรอบทดลองที่มีการเก็บ feedback จากช่างจริง และปรับ dataset / model / UX เป็นรอบ ๆ (iterative) โดยกำหนดรอบสั้น ๆ เช่น 4–8 สัปดาห์ต่อ iteration

บทเรียนปฏิบัติและข้อเสนอเชิงกลยุทธ์ — ประสบการณ์จากโครงการนำร่องแสดงว่า: การลงทุนในขั้นตอนจับภาพและการเตรียมข้อมูลที่ดีขึ้น (upfront) จะลดเวลาปรับจูนโมเดลในระยะยาวได้มาก, การมีทีมผสม (วิศวกร AI, วิศวกรเครื่องจักร, เจ้าหน้าที่ความปลอดภัยข้อมูล และช่างภาคสนาม) ช่วยให้การยอมรับใช้งานสูงขึ้น และการออกแบบ UI ที่ช่างใช้ได้จริงมีความสำคัญเท่ากับความแม่นยำของโมเดล กล่าวคือ ROI ที่แท้จริงมาจากการลด MTTR และการปรับปรุงประสิทธิภาพในการทำงาน ประเมินเบื้องต้นควรตั้งงบประมาณสำหรับงานถ่ายภาพและ pre-processing ประมาณ 10–25% ของงบโครงการทั้งหมด และวางแผนทรัพยากรคอมพิวต์สำหรับการเทรน (เช่น GPU ระดับ data-center เป็นระยะเวลาเป็นสัปดาห์ ขึ้นกับขนาด dataset)

สรุปคือ โรงงานที่พิจารณานำ NeRF + LLM ไปใช้ควรมองเป็นโครงการเชิงวิศวกรรมข้อมูลและการเปลี่ยนแปลงกระบวนการ มากกว่าการติดตั้งซอฟต์แวร์เพียงอย่างเดียว การทำ pilot ขนาดเล็กที่ออกแบบมาอย่างรอบคอบ จะช่วยระบุจุดอ่อนเชิงปฏิบัติ แก้ไขปัญหาทางเทคนิค และสร้างแนวทางปฏิบัติที่สามารถขยายผลไปยังหน่วยงานอื่นได้อย่างยั่งยืน

อนาคตและแนวทางขยายผล

อนาคตและแนวทางขยายผล

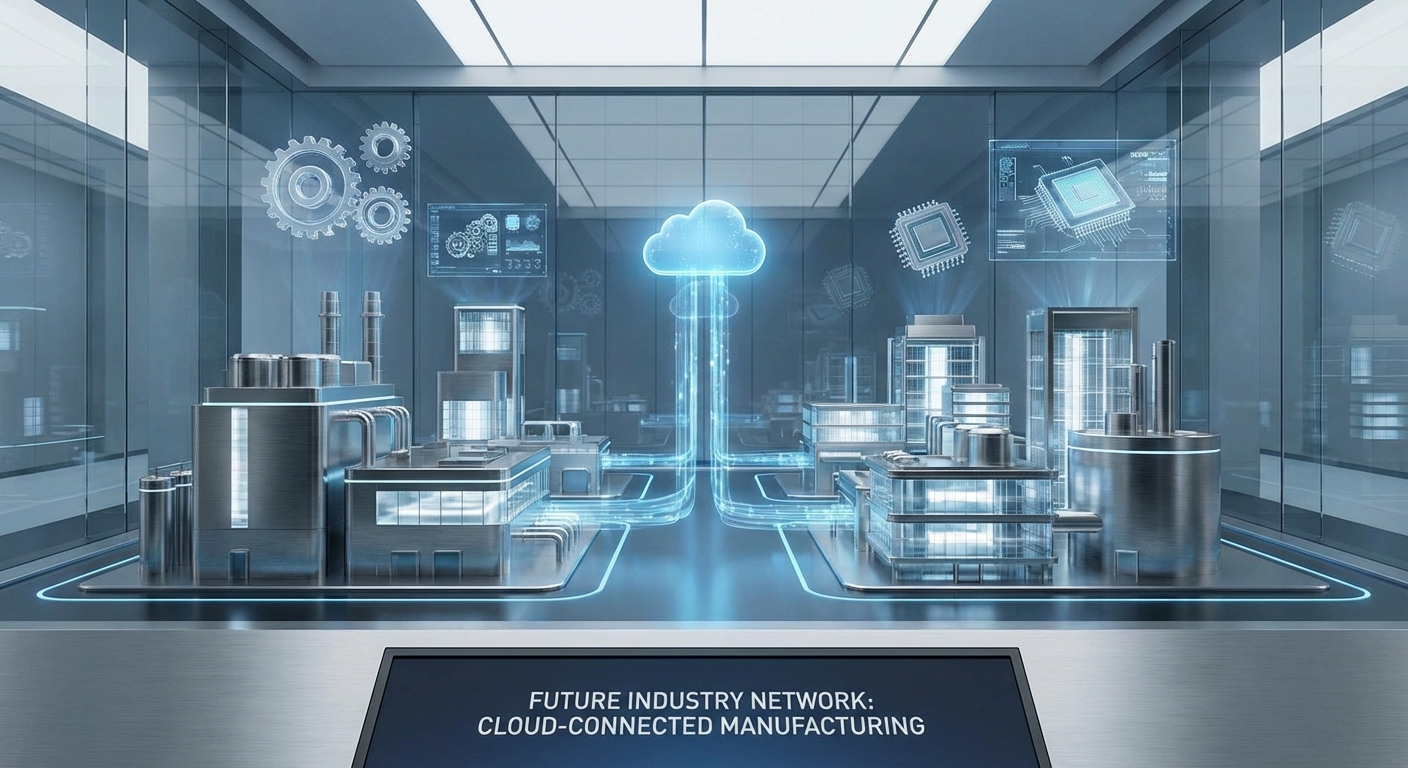

การผสาน NeRF กับ LLM ในการสร้างคู่มือซ่อมบำรุง 3 มิติอินเทอร์แอคทีฟถือเป็นจุดเริ่มต้นของระบบสนับสนุนการตัดสินใจเชิงภาพ (visual decision support) สำหรับงานบำรุงรักษาในโรงงานอุตสาหกรรม ในระยะถัดไป แนวทางพัฒนาสำคัญจะมุ่งไปที่การรวม sensor fusion เช่น LiDAR, กล้องความร้อน (thermal imaging), และเซ็นเซอร์สั่นสะเทือน เข้ากับโมเดล NeRF/LLM เพื่อให้ได้ภาพ 3 มิติที่ไม่เพียงแต่สมจริงทางสายตาแต่ยังมีชั้นข้อมูลสถานะเชิงฟิสิกส์ประกอบ (e.g. อุณหภูมิ, การสั่น, ระยะห่าง) ซึ่งจะช่วยให้การวิเคราะห์สภาพชิ้นส่วนเป็นแบบเรียลไทม์และแม่นยำมากขึ้น นั่นหมายถึงความเป็นไปได้ในการลดเวลาหยุดเดินเครื่องได้เกินกว่าที่ระบบภาพเท่านั้นทำได้ — จากตัวเลขนำร่องเดิมที่ลด downtime ได้ราว 40% หากเพิ่มการตรวจจับเชิงลึกจากเซ็นเซอร์หลายชนิดอาจเห็นการปรับปรุงตัวชี้วัดการบำรุงรักษา (เช่น MTTR, MTBF) เพิ่มเติมอีก

ในเชิงการประยุกต์ใช้งานเชิงปฏิบัติ ระบบจะเชื่อมต่อกับเครือข่าย IoT ของโรงงาน เพื่อให้ข้อมูลเซ็นเซอร์แบบเรียลไทม์ไหลเข้าสู่ pipeline ของ LLM และโมเดลอนาไลติกส์สำหรับการ predictive maintenance การทำงานร่วมของข้อมูลล็อกจาก PLC, สตรีมจาก LiDAR/thermal และข้อมูลงานซ่อมจริง จะช่วยให้โมเดลสามารถทำนายความล้มเหลวก่อนเกิดเหตุ (anomaly detection & remaining useful life estimation) และสั่งการให้คู่มือ 3 มิติแนะนำขั้นตอนซ่อมที่เหมาะสมตามบริบท พื้นที่ที่ต้องให้ความสำคัญคือการประมวลผลที่ขอบเครือข่าย (edge computing) เพื่อลดความหน่วงและจำกัดปริมาณข้อมูลที่ต้องส่งขึ้นคลาวด์

อีกแนวทางสำคัญคือการฝึก LLM ด้วยข้อมูลเฉพาะโรงงานผ่านการ fine-tuning และการปรับปรุงด้วยข้อมูลการซ่อมจริง (maintenance logs, SOPs, parts catalogues) ซึ่งจะทำให้การตอบคำถามเชิงเทคนิคจากช่างแม่นยำและสอดคล้องกับนโยบายความปลอดภัยของโรงงานมากขึ้น สำหรับการขยายผลในเชิงเครือข่ายโรงงานที่มีข้อจำกัดด้านความเป็นส่วนตัวและความลับทางการผลิต กระบวนการ federated learning จะเป็นกุญแจสำคัญ—ช่วยให้โรงงานหลายแห่งสามารถร่วมกันปรับปรุงโมเดลโดยไม่ต้องแลกเปลี่ยนข้อมูลดิบ ช่วยปกป้องทรัพย์สินทางปัญญาและข้อมูลการผลิตที่ละเอียดอ่อน

ในมุมมองธุรกิจ มีรูปแบบบริการหลายแบบที่เหมาะสมกับการขยายสู่ตลาดทั้งในและต่างประเทศ ตัวอย่างโมเดลธุรกิจที่เป็นไปได้ได้แก่:

- SaaS สำหรับคู่มือ 3 มิติ — บริการสมัครสมาชิกให้เข้าถึงแพลตฟอร์มสร้างและอัปเดตคู่มือ เชื่อมต่อกับ IoT/CMMS ของลูกค้า มีแผนให้บริการตามขนาดโรงงานและระดับฟีเจอร์ (basic visualization, predictive analytics, on-site edge instances)

- Managed Services / Integration — บริการติดตั้งเซ็นเซอร์ การเชื่อมต่อกับระบบเดิม การสอนใช้งาน และการบริหารโมเดลแบบครบวงจร เหมาะกับลูกค้าที่ต้องการลดความเสี่ยงทางเทคนิค

- Marketplace for Digital Parts & Procedures — แพลตฟอร์มแลกเปลี่ยนคู่มือเฉพาะชิ้นส่วน ซอฟต์แวร์ปรับแต่งโมเดล และโมดูลการตรวจจับความผิดปกติที่ผ่านการรับรอง

- Federated Model Subscription — โมเดลร่วมที่อัปเดตจากเครือข่ายลูกค้าระดับอุตสาหกรรม โดยโรงงานรับประโยชน์จากความรู้ร่วมกันโดยที่ข้อมูลดิบยังคงอยู่ภายในองค์กร

แผนการขยายสู่โรงงานอื่น ๆ ควรใช้กลยุทธ์แบบชั้น (phased rollout): เริ่มจากโครงการนำร่อง (pilot) กับโรงงานที่มีความพร้อมด้าน IoT และทีมบำรุงรักษาที่เปิดรับเทคโนโลยี ต่อด้วยการปรับแต่งโมเดล (fine-tune) บนข้อมูลจริง แล้วขยายเป็นเชนของโรงงานในภูมิภาคโดยคำนึงถึงการแปลภาษา, การทำมาตรฐานตามกฎระเบียบ (เช่น มาตรฐานความปลอดภัยไฟฟ้าและเครื่องจักรของประเทศต่าง ๆ) และการออกแบบ UX ให้เหมาะกับระดับทักษะของช่างในแต่ละพื้นที่ ในระดับนานาชาติ การใช้ federated learning ร่วมกับแผนการจัดการข้อมูล (data governance) และการให้บริการ edge appliances จะช่วยลดแรงเสียดทานด้านข้อมูลและกฎข้อบังคับครอบคลุมหลายประเทศ

สรุปคือ การรวม NeRF, LLM, sensor fusion และ IoT ไปสู่ระบบ predictive maintenance เชิงปฏิบัติการ สามารถเปลี่ยนการบำรุงรักษาจากเชิงปฏิบัติการเชิงรับเป็นเชิงรุกได้จริง การปกป้องข้อมูลผ่าน federated learning และการนำเสนอในรูปแบบ SaaS/Managed Services จะเป็นโมเดลทางธุรกิจที่สมเหตุสมผลสำหรับการขยายผลในอุตสาหกรรม ซึ่งจะนำไปสู่การลดต้นทุนการผลิตและเพิ่มความต่อเนื่องในการดำเนินงานของโรงงานอย่างเป็นรูปธรรม

บทสรุป

การผสานเทคโนโลยี Neural Radiance Fields (NeRF) กับ Large Language Models (LLM) เพื่อสร้างคู่มือซ่อมบำรุง 3 มิติอินเทอร์แอคทีฟในโรงงานไทยให้ผลลัพธ์เชิงปฏิบัติที่ชัดเจน: การนำไปใช้ในโครงการนำร่องช่วยลดเวลาหยุดเดินเครื่อง (downtime) ได้อย่างมีนัยสำคัญถึงประมาณ 40% พร้อมทั้งเพิ่มประสิทธิภาพของทีมช่างในการวิเคราะห์ชิ้นส่วนแบบเรียลไทม์และทำงานร่วมกันได้เร็วขึ้นผ่านมุมมอง 3 มิติและคำแนะนำเชิงภาษาที่เข้าใจง่าย ตัวอย่างการใช้งานรวมถึงการระบุตำแหน่งความเสียหายด้วยภาพ 3 มิติ การแสดงลำดับขั้นตอนการซ่อมบนชิ้นส่วนจริง และการให้คำแนะนำเชิงบริบทเมื่อช่างถามเป็นภาษาธรรมชาติ ซึ่งช่วยลดเวลาการตรวจสอบและข้อผิดพลาดจากการตีความคู่มือฉบับข้อความเพียงอย่างเดียว

เพื่อให้ผลลัพธ์เป็นไปอย่างยั่งยืนและสามารถขยายผลได้ จำเป็นต้องให้ความสำคัญกับ 1) คุณภาพการเก็บข้อมูล—ภาพและสแกนความละเอียดสูง ครอบคลุมมุมมองหลายมุม แสงและสภาพแวดล้อมที่หลากหลาย เพื่อให้ NeRF สร้างโมเดล 3 มิติแม่นยำ 2) การออกแบบสถาปัตยกรรม edge/cloud ที่สมดุล—ใช้ edge inference เพื่อตอบสนองแบบเรียลไทม์และลดแลตเทนซี ขณะที่ cloud ใช้สำหรับฝึกปรับปรุงโมเดลและเก็บรุ่นข้อมูล และ 3) การจัดการความปลอดภัยและธรรมาภิบาลข้อมูล—การเข้ารหัส การควบคุมการเข้าถึง การจัดการสิทธิ์ และการปฏิบัติตามข้อบังคับด้านข้อมูล เพื่อป้องกันความเสี่ยงและสร้างความเชื่อมั่นระยะยาว มองไปข้างหน้า เทคโนโลยีนี้มีศักยภาพขยายสู่ AR glasses, การผสมข้อมูลเซนเซอร์ (sensor fusion) เพื่อคาดการณ์การล้มเหลวเชิงรุก และการวางมาตรฐานอุตสาหกรรม ซึ่งจะยิ่งผลักดัน ROI ให้สูงขึ้นหากองค์กรลงทุนในท่อข้อมูลคุณภาพสูง สถาปัตยกรรม edge/cloud ที่เหมาะสม และกรอบการบริหารจัดการข้อมูลที่รัดกุม