เหตุการณ์ที่หญิงชาวอิลลินอยส์อ้างว่า “คำพูดจาก ChatGPT” เป็นสาเหตุให้เธอเลิกจ้างทนายความมนุษย์ กลายเป็นเรื่องที่สะเทือนวงการกฎหมายและเทคโนโลยีในทันที — เพราะไม่ใช่เพียงเรื่องความสัมพันธ์ระหว่างคนกับเครื่องจักร แต่ยังเปิดคำถามเชิงลึกเกี่ยวกับความน่าเชื่อถือของโมเดลภาษาขนาดใหญ่ (LLMs) ความรับผิดชอบทางกฎหมาย และความเสี่ยงเมื่อนำระบบอัตโนมัติไปใช้ในการตัดสินใจที่มีผลกระทบสูง เช่น คดีความ การเรียกร้องสิทธิ หรือคำแนะนำด้านกฎหมายที่อาจเปลี่ยนชะตาชีวิตของบุคคลหนึ่งได้.

บทนำนี้จะพาอ่านers สำรวจประเด็นสำคัญของคดีตัวอย่างนี้: ลักษณะเนื้อหาที่ ChatGPT ให้ การตัดสินใจของผู้ใช้ที่จะยกเลิกการว่าจ้างทนาย ความเป็นไปได้ของ “hallucination” หรือข้อมูลผิดพลาดในโมเดลภาษา ความทับซ้อนระหว่างการให้ข้อมูลเชิงคำปรึกษาและการประกอบวิชาชีพทางกฎหมาย โดยเสนอกรอบคิดสำหรับแนวทางปฏิบัติที่ปลอดภัย เช่น การยืนยันข้อมูลโดยผู้เชี่ยวชาญ การเก็บบันทึกการติดต่อกับ AI และขอบเขตความรับผิดชอบของผู้พัฒนาและผู้ใช้ เพื่อมิให้การเข้าถึงเทคโนโลยีช่วยเพิ่มความไม่แน่นอนหรือความเสียหายมากกว่าประโยชน์.

นำเสนอเหตุการณ์ (Lead): สรุปข่าวและผลลัพธ์เบื้องต้น

นำเสนอเหตุการณ์ (Lead): สรุปข่าวและผลลัพธ์เบื้องต้น

สรุปสถานการณ์ — เมื่อเร็ว ๆ นี้ หญิงจากรัฐอิลลินอยส์รายหนึ่งแจ้งต่อสาธารณะว่าได้ใช้บริการโมเดลภาษา AI ของ ChatGPT เพื่อสอบถามข้อมูลเกี่ยวกับคดีความของตน และอ้างว่าเนื้อหาที่ได้รับจาก ChatGPT เป็นปัจจัยสำคัญที่ทำให้เธอตัดสินใจ เลิกจ้างทนายความมนุษย์ ที่ทำคดีให้ โดยผู้เสียหายระบุว่าได้เผยแพร่ข้อความสนทนา (เช่น สกรีนช็อตหรือคำคัดลอก) บนช่องทางโซเชียลมีเดียเพื่อเป็นหลักฐานและอธิบายเหตุผลของการเลิกว่าจ้าง

ผลลัพธ์เบื้องต้น — ผลโดยตรงที่เกิดขึ้นคือทนายความที่รับทำคดีได้รับแจ้งเลิกจ้างจากผู้ว่าจ้าง และผู้เสียหายเผยแพร่ข้อมูลบางส่วนของการสนทนากับ ChatGPT ต่อสาธารณะ ในระดับคดี ณ ปัจจุบันยังไม่มีคำพิพากษาออกมาเป็นผลสุดท้าย: คดีอยู่ในสถานะที่รอดำเนินการต่อไปหรือยังไม่ถูกนำเข้าสู่ขั้นตอนการพิจารณาที่มีผลกระทบโดยตรงต่อคำตัดสิน ซึ่งฝ่ายที่เกี่ยวข้องทั้งผู้เสียหายและทนายความต่างให้ข้อมูลที่ขัดแย้งกันเกี่ยวกับเหตุจูงใจและความเหมาะสมของการตัดสินใจดังกล่าว

แหล่งข่าวและคำแถลง — ข้อมูลเบื้องต้นที่เผยแพร่ประกอบด้วยคำให้สัมภาษณ์จาก ผู้เสียหาย ที่อธิบายว่าคำตอบจาก ChatGPTทำให้เธอเชื่อมั่นในแนวทางดำเนินคดีของตน และประกาศเลิกจ้างทนาย ขณะที่ ทนายความผู้ถูกเลิกจ้าง ออกแถลงการณ์ตอบโต้ในบางกรณีโดยปฏิเสธข้อกล่าวหาเรื่องการให้คำปรึกษาที่ไม่เหมาะสมหรือการละเลยหน้าที่ อย่างไรก็ตาม ณ เวลานี้ยังไม่ปรากฏแถลงการณ์อย่างเป็นทางการจากบริษัทผู้พัฒนา AI (เช่น OpenAI) ในเรื่องนี้ต่อสาธารณะ หากมีการออกแถลงการณ์ บริษัทดังกล่าวอาจให้ข้อมูลเพิ่มเติมเกี่ยวกับการเก็บบันทึกการสนทนา นโยบายการให้คำตอบเชิงกฎหมาย และข้อจำกัดของโมเดล

ช่องว่างข้อมูลที่ต้องตรวจสอบเพิ่มเติม — ถึงแม้เหตุการณ์จะมีผลทันทีต่อความสัมพันธ์ระหว่างผู้เสียหายและทนาย แต่ยังมีประเด็นสำคัญหลายด้านที่ต้องได้รับการยืนยันและตรวจสอบต่อไป ทั้งในเชิงเทคนิคและกฎหมาย เพื่อประเมินผลกระทบอย่างรอบด้าน

- ยืนยันรายละเอียดของบทสนทนา: เวอร์ชันของโมเดล ChatGPT, เวลา-วันที่ของการสนทนา, ข้อความเต็มที่แลกเปลี่ยน และการปรากฏหลักฐาน (สกรีนช็อต/ไฟล์)

- ตรวจสอบว่าเนื้อหาที่ AI ให้เป็นการให้คำปรึกษาทางกฎหมายหรือเพียงข้อมูลทั่วไป และมีการชี้แจงข้อจำกัด (disclaimer) ไว้อย่างไร

- สถานะทางกฎหมายของคดี: เอกสารทางศาลใดที่ยื่นแล้ว ผลกระทบจากการเปลี่ยนทนายความต่อไทม์ไลน์คดี

- มุมมองจากทนายผู้ถูกเลิกจ้าง: เหตุผลการทำงาน ความสื่อสารระหว่างลูกค้ากับทนาย และการรักษาสิทธิของทนายความ

- การตอบสนองจากบริษัทผู้พัฒนา AI: การยืนยันการมีอยู่ของบันทึกการสนทนา นโยบายการให้คำปรึกษาด้านกฎหมาย และความพร้อมให้ความร่วมมือกับการสืบสวน

- ประเด็นด้านความเป็นส่วนตัวและความลับระหว่างทนายกับลูกค้า (attorney–client privilege) รวมถึงความเป็นไปได้ของความรับผิดทางแพ่งหรือระเบียบวิชาชีพ

ไทม์ไลน์และหลักฐาน: การไล่เรียงเหตุการณ์อย่างละเอียด

ไทม์ไลน์และหลักฐาน: การไล่เรียงเหตุการณ์อย่างละเอียด

ด้านล่างเป็นการเรียงลำดับเหตุการณ์เชิงเวลา (timeline) อย่างละเอียดตั้งแต่การสนทนาเริ่มต้นกับ ChatGPT จนถึงการเลิกจ้างทนายความมนุษย์ รวมทั้งตัวอย่างข้อความที่ถูกอ้างอิงและรายการหลักฐานที่ควรเก็บรักษาอย่างเป็นระบบ ข้อมูลแต่ละรายการระบุ วัน-เวลา (timestamp) ในรูปแบบที่ชัดเจน พร้อมเขตเวลา (เช่น CST — Central Standard Time สำหรับรัฐอิลลินอยส์) เพื่อให้สามารถตรวจสอบความต่อเนื่องของเหตุการณ์ได้ทางกฎหมายหรือฝ่ายทรัพยากรบุคคล

ตัวอย่างไทม์ไลน์เชิงเวลา (ตัวอย่างจำลอง):

- 2026-01-10 08:42 CST — ผู้เสียหายเริ่มการสนทนากับ ChatGPT ผ่านเว็บอินเทอร์เฟซของผู้ให้บริการ บันทึกการเริ่มต้นการสนทนามี message ID: msg_20260110_0842.

- 2026-01-10 08:45 CST — ChatGPT ตอบข้อความแรกที่ผู้เสียหายขอคำแนะนำทางกฎหมาย โดยข้อความที่ผู้เสียหายนำไปอ้างอิงต่อมามีเนื้อหาเช่น:

-

"หากโจทย์คดีของคุณมีลักษณะเช่นนี้ คุณอาจพิจารณายุติความร่วมมือกับทนายความมนุษย์ได้โดยไม่กระทบสิทธิขั้นพื้นฐานของคุณ — ให้ดำเนินการแจ้งเป็นลายลักษณ์อักษรและจัดเตรียมเอกสารสรุปเหตุผลที่ไม่สอดคล้องกับกลยุทธ์ทางกฎหมายของทนาย" หรือตัวอย่างที่คล้ายกันซึ่งตีความว่าเป็นการชี้นำให้เลิกจ้าง"

- 2026-01-10 09:10 CST — ผู้เสียหายบันทึกสกรีนช็อตของบทสนทนา (ไฟล์: chat_20260110_0845.png) และส่งต่อสกรีนช็อตให้เพื่อนร่วมงานเพื่อขอความเห็น (อีเมลส่งเมื่อ 09:12 CST แนบไฟล์ต้นฉบับ)

- 2026-01-11 14:30 CST — ผู้เสียหายส่งอีเมลแจ้งทนายความมนุษย์ว่า "ขอยุติสัญญา" พร้อมแนบสรุปเหตุผลที่อ้างอิงจากคำตอบของ ChatGPT (อีเมล: sent_20260111_1430.eml; หัวข้อ: Termination of Retainer Agreement)

- 2026-01-11 15:05 CST — ทนายความรับทราบอีเมลและมีการประชุมทางโทรศัพท์บันทึกเป็นบันทึกการสนทนา (meeting_note_20260111_1505.txt)

- 2026-01-12 10:00 CST — ทนายความได้รับหนังสือยกเลิกสัญญาอย่างเป็นทางการ และทางสำนักงานออกหนังสือยืนยันการสิ้นสุดความสัมพันธ์ (termination_letter_20260112_1000.pdf)

- 2026-01-15 09:20 CST — ผู้เสียหายเก็บรวบรวมหลักฐานเพิ่มเติม เช่น การส่งต่ออีเมลถึงบุคคลที่สาม, สำเนาบัญชีการเข้าถึงแอคเคาน์ ChatGPT (access_log_20260110.csv) และสรุปรายงานการสนทนาที่ส่งออกจากระบบ (export_chat_20260110.json)

ตัวอย่างข้อความ/คำตอบจาก ChatGPT ที่ถูกนำมาอ้างอิง (ตัวอย่างจำลองเพื่อแสดงลักษณะข้อความที่มีผลกระทบ):

- ข้อความที่ 1: "ถ้าคุณเชื่อว่าทนายของคุณไม่สามารถปกป้องผลประโยชน์ของคุณได้ การยุติการว่าจ้างและเลือกที่ปรึกษาใหม่เป็นทางเลือกที่เป็นเหตุผลได้ — ควรทำเป็นลายลักษณ์อักษรและจัดเตรียมหลักฐานที่ชัดเจน"

- ข้อความที่ 2: "ในสถานการณ์เช่นนี้ ไม่มีความจำเป็นต้องมีการดำเนินการทางกฎหมายเพิ่มเติมก่อนยกเลิกสัญญา หากเงื่อนไขในสัญญาอนุญาต"

- ข้อความที่ 3: "หากคุณต้องการ ผมสามารถร่างจดหมายยกเลิกให้โดยอ้างอิงเหตุผลทางกลยุทธ์"

รายการหลักฐานที่ควรเก็บรักษาอย่างเป็นระบบและวิธีจัดเก็บเพื่อรักษา ความน่าเชื่อถือทางกฎหมาย:

- สกรีนช็อตของบทสนทนา — เก็บไฟล์ต้นฉบับ (PNG/TIFF) ที่มีความละเอียดสูง พร้อมบันทึกเวลาที่ถ่าย (system timestamp) และห้ามแก้ไขภาพ หากต้องการทำสำเนาให้เก็บสำเนาที่มี hash (เช่น SHA-256) ของไฟล์แต่ละไฟล์

- การส่งออกบทสนทนา (chat export) — ดาวน์โหลดข้อมูลจากแพลตฟอร์มในรูปแบบ JSON/CSV ที่รวม message ID, timestamp, user ID และ response ID เพื่อยืนยันความต่อเนื่องของข้อความ

- เมตาดาต้าและล็อกการเข้าถึง — เก็บ access logs, server logs หรือ activity logs จากบัญชีผู้ใช้ (ประกอบด้วย IP address, device, session timestamps) เพื่อยืนยันต้นทางและลำดับการเข้าถึง

- อีเมลและ header — เก็บอีเมลที่ส่ง/รับทั้งหมดในรูปแบบ .eml หรือ .msg รวม header เพื่อแสดงเส้นทางการส่ง (รวมถึงเวลา, เซิร์ฟเวอร์ที่ผ่าน, และผู้รับ)

- บันทึกการประชุมและการโทร — หากมีการประชุมกับทนายความหรือ HR ให้บันทึก minutes, record audio (หากกฎหมายอนุญาต) และไฟล์ที่เกี่ยวข้อง

- เอกสารแนบท้ายและจดหมายเป็นลายลักษณ์อักษร — เก็บสำเนาหนังสือยกเลิกสัญญา, อีเมลยืนยันการสิ้นสุด และเอกสารที่สำนักงานทนายออก

- หลักฐานพยานบุคคล — คำยืนยันจากพยานที่เห็นข้อความหรือถูกแจ้งถึงการตัดสินใจ รวมทั้งบันทึกเวลาที่ได้รับแจ้ง

- การรักษาหลักฐาน (chain of custody) — บันทึกผู้เก็บหลักฐาน, เวลา, วิธีการจัดเก็บ, และการเข้าถึงต่อเนื่องเพื่อยืนยันว่าไฟล์ไม่ถูกปลอมแปลง

ข้อเสนอเชิงปฏิบัติการสำหรับการนำเสนอต่อ HR หรือที่ปรึกษากฎหมาย: เก็บชุดหลักฐานให้ครบถ้วนตามรายการข้างต้น พร้อมสรุปไทม์ไลน์ที่มีการอ้างอิงไฟล์ชื่อและตำแหน่งของหลักฐานแต่ละชิ้น (เช่น "ดู chat_20260110_0845.png; export_chat_20260110.json; sent_20260111_1430.eml") ระบุชัดเจนว่า ใครส่งถึงใคร เวลาใด และด้วยเหตุผลอะไร เพื่อให้กระบวนการตรวจสอบภายในหรือกระบวนการทางกฎหมายสามารถยืนยันเหตุการณ์ได้อย่างมีประสิทธิภาพ

วิเคราะห์เชิงเทคนิค: ทำไมคำตอบของ ChatGPT จึงก่อให้เกิดความเข้าใจผิดได้

วิเคราะห์เชิงเทคนิค: ทำไมคำตอบของ ChatGPT จึงก่อให้เกิดความเข้าใจผิดได้

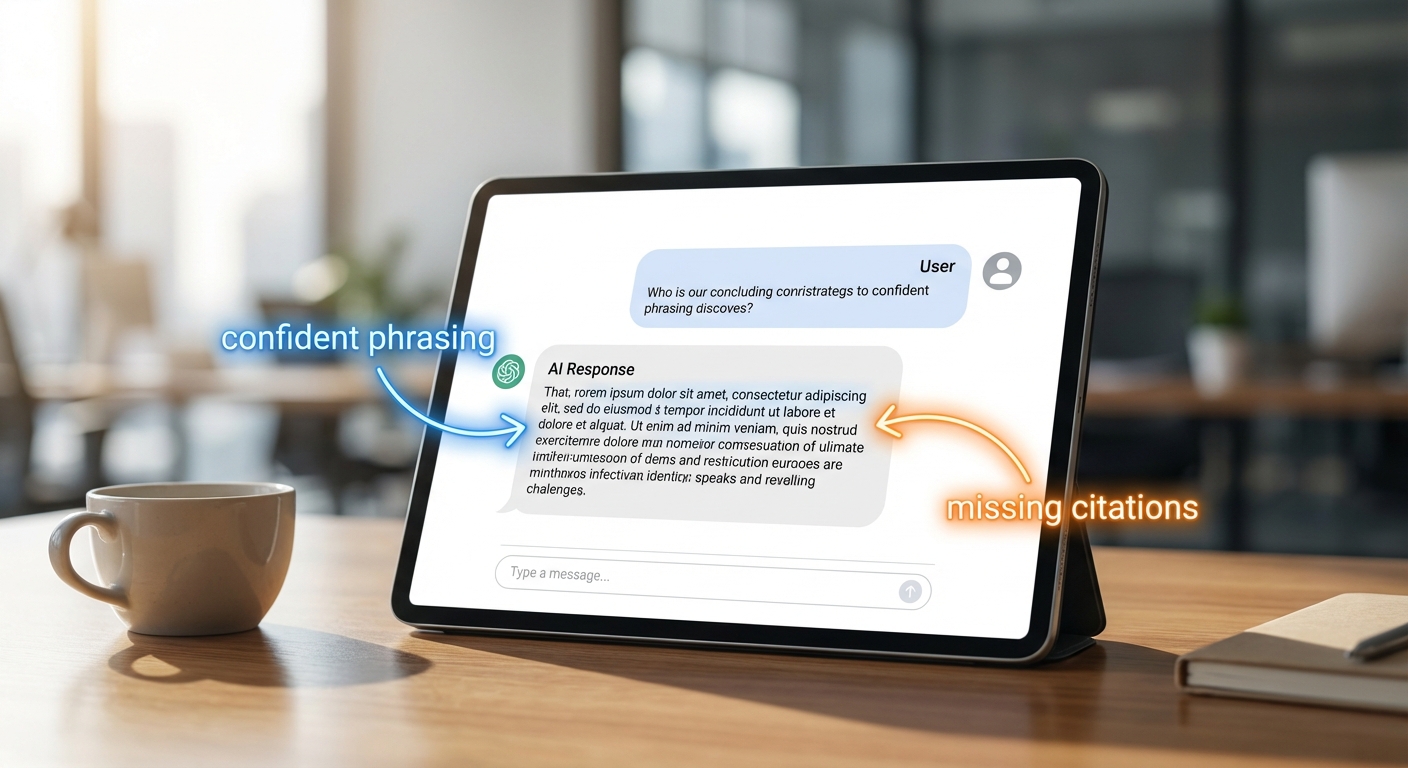

โมเดลภาษาเช่น ChatGPT ถูกออกแบบมาเพื่อทำนายคำถัดไปบนพื้นฐานของความน่าจะเป็นเชิงสถิติ ไม่ใช่การประเมินทางกฎหมายหรือการให้คำปรึกษาที่ผ่านการรับรอง จากมุมมองทางเทคนิค โมเดลเหล่านี้คำนวณ P(token | context) — ความน่าจะเป็นของคำหนึ่งคำเมื่อรู้บริบทก่อนหน้า — และสร้างข้อความโดยการเลือกรูปแบบคำที่มีความน่าจะเป็นสูงสุดหรือสุ่มตามการตั้งค่า (เช่น temperature, top-k, beam search) การทำงานเชิงสถิตินี้ทำให้ผลลัพธ์มักดูสมเหตุสมผลเชิงภาษาและมีน้ำเสียงมั่นใจ แม้ว่าเนื้อหาที่ให้มาจะไม่ถูกต้องหรือไม่มีหลักฐานรองรับก็ตาม

ปัจจัยหลายประการทำให้คำตอบจาก LLM อาจก่อให้เกิดความเข้าใจผิด โดยเฉพาะในบริบทกฎหมายที่ต้องการความแม่นยำและความรับผิดชอบสูง:

- ข้อมูลฝึก (Training data): โมเดลถูกฝึกจากข้อความจำนวนมากที่มาจากแหล่งต่าง ๆ ซึ่งรวมทั้งข้อมูลที่ถูกต้องและไม่ถูกต้อง เมื่อคำตอบอาศัยความถี่และรูปแบบในข้อมูลฝึก ก็ย่อมอาจสะท้อนความผิดพลาดหรือความเอนเอียงของแหล่งข้อมูลเหล่านั้น

- ขอบเขตความรู้และการตัดความทันสมัย (Knowledge cutoff): โมเดลมีวันที่ตัดข้อมูลฝึก (knowledge cutoff) ดังนั้นข้อมูลหลังช่วงเวลานั้นจะไม่ถูกบันทึก การอ้างอิงกฎหมายหรือคดีล่าสุดจึงอาจล้าสมัยหรือผิดพลาด

- การตั้งค่าและ prompt: คำถามที่กำกับหรือออกแบบไม่ดีอาจกระตุ้นให้โมเดล "เติมเต็ม" คำตอบด้วยข้อมูลสมมุติ ตัวอย่างเช่น คำสั่งที่ต้องการคำตอบแน่นอนจะทำให้โมเดลผลิตน้ำเสียงมั่นใจแทนที่จะระบุความไม่แน่นอน

- สถาปัตยกรรมของโมเดลและฮัลลูซิเนชัน (Hallucination): LLM ไม่มีการยืนยันความจริงภายในตัวเอง จึงอาจสร้างข้อเท็จจริง รูปคำพิพากษา หรือการอ้างอิงทางกฎหมายที่ไม่มีอยู่จริงได้อย่างแนบเนียน

- ปัญหาการปรับเทียบความมั่นใจ (Confidence calibration): ความเชื่อมั่นที่แสดงออกผ่านถ้อยคำของโมเดลไม่ได้เท่ากับความเชื่อมั่นทางสถิติหรือความถูกต้องทางข้อเท็จจริง — โมเดลอาจพูดด้วยน้ำเสียงมั่นใจแม้ความน่าจะเป็นของความถูกต้องจะต่ำ

ตัวอย่างเชิงเทคนิคสั้น ๆ ที่ช่วยให้เห็นภาพ: โมเดลประเมินความน่าจะเป็นของคำแต่ละคำ เช่น P("ตาม" | บริบท), P("กฎหมาย" | บริบท, "ตาม") และต่อคำไปเรื่อย ๆ หากคำชุดที่มีลักษณะเป็นถ้อยคำทางกฎหมายปรากฏบ่อยในข้อมูลฝึก โมเดลจะเลือกคำเหล่านั้นแม้ว่าการเรียงความจริงที่ได้จะไม่สอดคล้องกับข้อกฎหมายของรัฐหรือคำนิยามสากล การตั้งค่า temperature ต่ำจะให้ผลลัพธ์ที่นิ่งและแน่นอนมากขึ้น ในขณะที่ temperature สูงจะเพิ่มโอกาสเกิดฮัลลูซิเนชัน แต่ทั้งสองกรณีอาจก่อให้เกิดเนื้อหาที่ดูเชื่อถือได้แต่ผิดพลาด

รูปแบบคำตอบที่มักทำให้ผู้ใช้หลงเชื่อได้มีลักษณะร่วมกัน ได้แก่:

- ประโยคเชิงสรุปที่หนักแน่น เช่น "ตามกฎหมายรัฐอิลลินอยส์ ผู้ถูกกล่าวหาจะต้อง..." — รูปแบบนี้ให้ความรู้สึกของคำตัดสินหรือข้อเท็จจริงในขณะที่ไม่ได้อธิบายข้อยกเว้นหรือแหล่งอ้างอิง

- การอ้างอิงหรือการอ้างคดีที่ดูเป็นทางการแต่ไม่มีอยู่จริง โมเดลอาจสร้างชื่อคดี หมายเลขมาตรา หรือย่อหน้ากฎหมายขึ้นมาเองเพื่อเสริมความน่าเชื่อถือ

- การละเลยการระบุความไม่แน่นอน ข้อความที่ไม่ใช้คำว่า "ขึ้นอยู่กับ" "ควรปรึกษาทนาย" หรือ "ต้องตรวจสอบเอกสาร" มักถูกตีความว่าเป็นคำแนะนำที่ชัดเจน

ตัวอย่างสั้น ๆ ของคำตอบที่ดูแน่นอนแต่อาจผิด: "การโพสต์ข้อความดังกล่าวเข้าข่ายหมิ่นประมาทตามมาตรา X ของกฎหมายรัฐอิลลินอยส์ และคู่ความมีสิทธิยื่นฟ้องโดยทันที" — ข้อความนี้ใช้ภาษาชัดเจนและมีความเป็นทางการ แต่ไม่มีการอ้างอิงบทบัญญัติจริง และไม่ได้พิจารณาเงื่อนไขข้อยกเว้น เช่น ความจริงเป็นข้อแก้ต่าง หรือการคุ้มครองเสรีภาพในการแสดงออก

สรุปสั้น ๆ สำหรับผู้นำธุรกิจและหน่วยงานที่เกี่ยวข้อง: แม้ LLM จะเป็นเครื่องมือที่ทรงพลังในการสรุปข้อมูลและช่วยงานงานด้านเอกสาร แต่ธรรมชาติการทำงานแบบทำนายคำเชิงสถิติและปัจจัยแวดล้อมหลายประการสามารถสร้างคำตอบที่ "มั่นใจแต่ผิด" ได้ในบริบทที่มีความเสี่ยงสูง เช่น กฎหมาย การแพทย์ หรือการเงิน การใช้งานเชิงปฏิบัติควรรวมการตรวจสอบโดยผู้เชี่ยวชาญ, การอ้างอิงแหล่งที่มาที่ตรวจสอบได้ และการออกแบบ prompt พร้อม disclaimer เพื่อหลีกเลี่ยงผลกระทบเชิงปฏิบัติที่ร้ายแรง

ผลกระทบทางกฎหมายและจริยธรรม: ความรับผิดชอบของ AI, ผู้ให้บริการ และทนาย

ผลกระทบเชิงกฎหมายของการใช้คำแนะนำจาก AI: ภาพรวมและสถานการณ์ปัจจุบัน

การที่คำพูดของระบบปัญญาประดิษฐ์เช่น ChatGPT นำไปสู่การตัดสินใจเลิกจ้างทนายความมนุษย์ ยกประเด็นทางกฎหมายและจริยธรรมหลายด้าน ตั้งแต่การปฏิบัติด้านกฎหมายโดยไม่ได้รับอนุญาต (unauthorized practice of law - UPL) ไปจนถึงความรับผิดทางละเมิด (malpractice) และหน้าที่ในการดูแล (duty of care) ของทนายความ นอกจากนี้ยังเกี่ยวพันกับความรับผิดชอบของผู้ให้บริการ AI ต่อความเสียหายที่เกิดขึ้นกับผู้ใช้งานทั่วไปและลูกค้าองค์กร

การปฏิบัติด้านกฎหมายโดยไม่ได้รับอนุญาต (UPL)

UPL เป็นข้อห้ามพื้นฐานในหลายรัฐของสหรัฐฯ ที่ห้ามการให้คำปรึกษาทางกฎหมายหรือการชำระคดีโดยผู้ไม่มีใบอนุญาต หากระบบ AI ให้คำแนะนำเชิงเฉพาะแก่บุคคลที่ควรได้รับการให้คำปรึกษาจากทนายผู้มีใบอนุญาต อาจเกิดข้อถกเถียงว่าการกระทำนั้นเข้าข่าย UPL หรือไม่ ตัวอย่างเช่น บริการเอกสารออนไลน์เชิงพาณิชย์ (เช่น LegalZoom ในอดีต) เคยเผชิญความท้าทายทางกฎหมายเรื่องขอบเขตการให้บริการและการตีความ UPL

- หลายบาร์ของรัฐได้ออกแนวทางหรือคำเตือนเกี่ยวกับการใช้เทคโนโลยี: บาร์ในบางรัฐเตือนว่าการให้คำแนะนำเฉพาะคดีโดย AI อาจเท่ากับการกระทำที่ต้องได้รับใบอนุญาต

- การพิจารณาว่า AI เป็น “ผู้ให้บริการด้านกฎหมาย” ขึ้นอยู่กับข้อความที่ให้ คำแนะนำที่เฉพาะเจาะจงเช่น “ทำแบบฟอร์ม X ในลักษณะนี้เพื่อหลีกเลี่ยงหนี้” มีความเสี่ยงสูงที่จะถูกมองว่าเป็น UPL

ความเป็นไปได้ของคดี malpractice และหน้าที่ในการดูแลของทนาย

เมื่อทนายใช้ AI ในการเตรียมคำแนะนำหรือร่างเอกสาร พวกเขายังอยู่ภายใต้กฎจรรยาบรรณด้านความเชี่ยวชาญ (เช่น Model Rules ของ ABA: competence และ supervision) ซึ่งกำหนดให้ทนายต้องมีหน้าที่ตรวจสอบผลงานของผู้ช่วยไม่ว่าผู้นั้นจะเป็นมนุษย์หรือระบบอัตโนมัติ หากคำแนะนำของ AI ผิดพลาดจนเป็นเหตุให้ลูกค้าเสียหาย ลูกค้าอาจยื่นฟ้องข้อหา malpractice ต่อทนายที่พึ่งพา AI โดยไม่ตรวจสอบอย่างเพียงพอ

- หน้าที่ในการดูแล (duty of care): ทนายต้องแสดงความรอบคอบและความสามารถในการใช้เทคโนโลยีอย่างเหมาะสม รวมถึงการตรวจสอบผลลัพธ์ของ AI

- ความเสี่ยงของคดี malpractice: หากการใช้ AI ทำให้เกิดการพลาดกำหนดเวลา สิทธิพิเศษทางกฎหมายถูกยอมแพ้ หรือคำแนะนำผิดพลาดที่นำไปสู่ความเสียหายทางการเงิน ทนายอาจถูกฟ้องร้อง

- ความรับผิดชอบร่วมกัน: ในหลายกรณี ศาลอาจพิจารณาว่าทนายเป็นผู้รับผิดชอบหลักต่อการตัดสินใจของลูกค้าที่อิงจากคำแนะนำของ AI หากไม่ได้ให้คำเตือนหรือกำกับดูแลอย่างเหมาะสม

ความรับผิดชอบของผู้ให้บริการ AI และกรอบกฎหมายที่เกี่ยวข้อง

ผู้ให้บริการ AI อาจเผชิญการฟ้องร้องตามกฎหมายทั่วไป เช่น ความประมาท (negligence), การละเมิดข้อสัญญา หรือการละเมิดกฎหมายคุ้มครองผู้บริโภค (consumer protection statutes) หากแพลตฟอร์มโฆษณาว่าสามารถให้คำปรึกษาทางกฎหมายได้โดยตรง ผู้กำกับดูแลอย่าง Federal Trade Commission (FTC) ก็มีอำนาจดำเนินการเมื่อมีการโฆษณาหลอกลวงหรือการปฏิบัติที่เป็นการเอาเปรียบ

- กฎหมายของรัฐ: บางรัฐมีกฎเฉพาะเกี่ยวกับ UPL และการประกอบวิชาชีพทางกฎหมาย ในขณะที่รัฐอื่นๆ อาจออกแนวปฏิบัติให้ทนายต้องเปิดเผยการใช้ AI ต่อผู้ว่าจ้าง

- ข้อจำกัดอื่นๆ: กฎหมายความเป็นส่วนตัว (เช่น HIPAA สำหรับข้อมูลสุขภาพ) หรือกฎหมายข้อมูลชีวมาตร (เช่น Illinois BIPA) อาจจำกัดการใช้ข้อมูลบางประเภทโดย AI

- กรอบนานาชาติ: แม้โฟกัสจะอยู่ที่สหรัฐฯ แต่แนวทางเช่น EU AI Act หรือมาตรฐานระหว่างประเทศอาจมีอิทธิพลต่อการออกนโยบายของบริษัทข้ามชาติ

ตัวอย่างการบังคับใช้ แนวทางปฏิบัติ และความเสี่ยงสำหรับผู้ใช้งานทั่วไป

มีตัวอย่างของการบังคับใช้ที่เกี่ยวข้องกับบริการด้านกฎหมายออนไลน์และการใช้เทคโนโลยี เช่น การท้าทายของบริการเตรียมเอกสารเชิงพาณิชย์ที่เคยเผชิญข้อกล่าวหา UPL ขณะเดียวกันหน่วยงานคุ้มครองผู้บริโภคระดับรัฐและสหพันธรัฐออกคำเตือนเกี่ยวกับการอ้างสรรพคุณของ AI ที่เกินจริง โดยทั่วไปความเสี่ยงสำหรับผู้ใช้งานทั่วไปประกอบด้วย:

- การสูญเสียสิทธิ์หรือโอกาสทางกฎหมาย (เช่น ตกหล่นกำหนดเวลา) จากคำแนะนำที่ไม่ถูกต้อง

- การชดใช้ค่าเสียหายที่ตามมา หากคำแนะนำของ AI ถูกใช้แทนคำปรึกษาของทนายที่ได้รับอนุญาต

- ปัญหาความเป็นส่วนตัวและการเปิดเผยข้อมูลที่อาจผิดกฎหมายหรือทำให้ข้อมูลสำคัญรั่วไหล

แนวทางปฏิบัติที่ควรมีเพื่อลดความเสี่ยง

เพื่อบริหารความเสี่ยงทั้งฝั่งทนาย ผู้ให้บริการ และผู้ใช้ ควรมีกรอบมาตรการเชิงปฏิบัติ ดังนี้

- การเปิดเผยข้อจำกัด (disclaimer): ผู้ให้บริการ AI และทนายต้องระบุอย่างชัดเจนว่า AI เป็นเครื่องมือช่วยเหลือ ไม่ใช่ทนายความ และระบุขอบเขตความรับผิดชอบ

- การได้รับความยินยอมจากลูกค้า (informed consent): หากทนายใช้ AI ในกรณีของลูกค้า ควรแจ้งและได้รับความยินยอมเป็นลายลักษณ์อักษร

- การตรวจสอบและบันทึก: เก็บบันทึกผลลัพธ์จาก AI, การตัดสินใจของมนุษย์ และกระบวนการทบทวน เพื่อเป็นหลักฐานในการตรวจสอบย้อนหลัง

- นโยบายความเป็นส่วนตัวและการคุ้มครองข้อมูล: ประเมินว่า AI ปฏิบัติตามกฎหมายความเป็นส่วนตัวที่เกี่ยวข้อง และจำกัดการส่งข้อมูลสำคัญไปยังผู้ให้บริการภายนอก

- การอบรมและการประกันภัย: ทนายต้องได้รับการอบรมเกี่ยวกับข้อจำกัดของ AI และพิจารณาการขยายความคุ้มครองในกรมธรรม์ความรับผิดวิชาชีพ

สรุปคือ เหตุการณ์ที่คำพูดของ ChatGPT ส่งผลให้ลูกค้าปรับความสัมพันธ์กับทนายความสะท้อนปัญหาเชิงโครงสร้าง: กฎหมายยังพัฒนาตามเทคโนโลยีไม่ทัน การปฏิบัติที่ดีที่สุดคือการเน้นการกำกับดูแลโดยมนุษย์ ข้อจำกัดของ AI ที่ชัดเจน และกรอบกฎหมายหรือแนวปฏิบัติที่สอดคล้องกันระหว่างรัฐและระดับสหพันธรัฐ เพื่อปกป้องผู้บริโภคและรักษามาตรฐานการให้บริการทางกฎหมาย

ปฏิกิริยาและคำชี้แจงจากฝ่ายต่าง ๆ

ปฏิกิริยาและคำชี้แจงจากฝ่ายต่าง ๆ

เหตุการณ์ที่หญิงชาวอิลลินอยส์อ้างว่าได้รับผลกระทบจากคำตอบของ ChatGPT ซึ่งนำไปสู่การเลิกจ้างทนายความมนุษย์ ส่งผลให้ฝ่ายต่าง ๆ ที่เกี่ยวข้องออกคำชี้แจงอย่างเป็นทางการและแสดงมุมมองที่หลากหลาย ทั้งในเชิงข้อเทคนิค จริยธรรม และกฎหมาย โดยภาพรวมสะท้อนความกังวลต่อความโปร่งใส ความรับผิดชอบ และการคุ้มครองข้อมูลส่วนบุคคลของผู้ใช้บริการด้านกฎหมาย

- คำแถลงจากผู้เสียหาย – ผู้เสียหายให้สัมภาษณ์และออกคำแถลงว่าเธอรู้สึกถูกหลอกหลวงและสูญเสียความเชื่อมั่นต่อกระบวนการทางกฎหมายที่อาศัยข้อมูลจากโมเดลภาษาที่ไม่ได้ถูกตรวจสอบอย่างเพียงพอ โดยระบุว่า "ฉันคาดหวังให้ทนายความมนุษย์เป็นผู้รับผิดชอบและยืนยันความถูกต้องของเอกสาร ไม่ใช่การพึ่งพาผลลัพธ์ที่อาจมีข้อผิดพลาดจากระบบ AI" เธอเรียกร้องให้มีการสอบสวนอย่างเป็นอิสระและการเยียวยาความเสียหายหากพบความบกพร่องในการปฏิบัติหน้าที่

- คำชี้แจงจากทนายความที่ถูกเลิกจ้าง – ทนายความผู้ถูกเลิกจ้างออกแถลงการณ์ว่าตนได้ใช้เครื่องมือช่วยร่างเอกสารจากโมเดลภาษาเป็นส่วนหนึ่งของกระบวนการทำงาน แต่ยืนยันว่าได้มีการตรวจสอบและปรับแก้ก่อนส่งมอบ อย่างไรก็ตาม เขายอมรับว่ากระบวนการตรวจสอบอาจไม่ครอบคลุมเพียงพอและยืนยันว่ายินดีให้ความร่วมมือในการสอบสวนเพื่อชี้แจงข้อเท็จจริงและปรับปรุงขั้นตอนการทำงาน

- คำแถลงจากบริษัทผู้พัฒนา AI – หากมีความเกี่ยวข้องโดยตรง บริษัทผู้พัฒนาโมเดลภาษาได้ออกคำชี้แจงเชิงกว้าง ๆ เกี่ยวกับขีดจำกัดของเทคโนโลยี เช่น ความเป็นไปได้ของ hallucination หรือการสร้างคำตอบที่ไม่ถูกต้อง และเน้นย้ำถึงแนวทางการใช้งานอย่างรับผิดชอบ โดยเรียกร้องให้ผู้ใช้ตรวจสอบและยืนยันข้อมูลก่อนนำไปใช้ในบริบทที่มีความเสี่ยงทางกฎหมายหรือผลกระทบต่อชีวิตของบุคคล อีกทั้งบางผู้พัฒนายังประกาศความพร้อมในการร่วมมือกับผู้กำกับดูแลเพื่อชี้แจงเทคนิคและช่วยในกระบวนการสอบสวน

- คำแถลงจากบริษัทรักษาความปลอดภัยข้อมูล/ผู้ตรวจสอบอิสระ – ผู้ให้บริการด้านความปลอดภัยไซเบอร์ที่ได้รับมอบหมายให้ตรวจสอบเหตุการณ์ระบุว่ากำลังวิเคราะห์บันทึกการใช้งาน การถ่ายโอนข้อมูล และการตั้งค่าความเป็นส่วนตัวของเครื่องมือ AI เพื่อประเมินว่ามีการรั่วไหลของข้อมูลลูกค้า เกิดการเปิดเผยข้อมูลส่วนบุคคล หรือมีช่องโหว่ในการจัดการข้อมูลภายในสำนักงานกฎหมายหรือไม่ โดยชี้ว่าแม้ระบบ AI เองอาจไม่มีเจตนาทำร้าย แต่การผสานรวมอย่างไม่รัดกุมกับกระบวนการทางธุรกิจอาจสร้างความเสี่ยงที่จับต้องได้

- คำแถลงจากสมาคมทนายความและหน่วยงานกำกับดูแล – สมาคมทนายความระดับรัฐและหน่วยงานกำกับดูแลได้ออกแถลงเตือนสมาชิกและผู้ให้บริการว่า การใช้ AI ในงานกฎหมายต้องสอดคล้องกับหน้าที่ด้านจริยธรรม โดยเฉพาะบทบัญญัติเรื่องความลับของลูกความ (attorney–client privilege) และหน้าที่ในการให้คำปรึกษาที่มีความสามารถ (duty of competence) หลายองค์กรเรียกร้องให้มีการเปิดเผยต่อผู้ว่าจ้างเมื่อมีการใช้ AI ในการร่างเอกสาร และเสนอแนวทางเบื้องต้น เช่น การบันทึกการตรวจสอบ (audit trail) และการรับรองความเหมาะสมของกระบวนการก่อนนำไปใช้จริง

ผู้เชี่ยวชาญด้านกฎหมายและเทคโนโลยีแสดงความเห็นอย่างละเอียดหลายด้าน ทั้งในเชิงวิชาการและเชิงปฏิบัติ โดยนักกฎหมายเทคโนโลยีชี้ว่าปัญหาที่เกิดขึ้นสะท้อนถึงช่องว่างของกฎเกณฑ์ควบคุมการใช้ AI ในงานที่มีความเสี่ยงสูง เช่น การให้คำปรึกษาทางกฎหมายและการร่างเอกสารเชิงสัญญา ผู้เชี่ยวชาญด้าน AI ระบุว่าเทคโนโลยีปัจจุบันยังมีแนวโน้มสร้างข้อมูลที่ฟังดูสมเหตุสมผลแต่ผิดพลาดได้ จึงควรมีการทดสอบความถูกต้อง (validation) และการอธิบายที่เพียงพอก่อนนำผลลัพธ์มาใช้ในเชิงพาณิชย์

ในระดับสาธารณะ เหตุการณ์ดังกล่าวก่อให้เกิดการถกเถียงอย่างกว้างขวางบนสื่อสังคมออนไลน์และสำนักข่าว โดยความคิดเห็นสาธารณะมีทั้งฝ่ายที่เรียกร้องให้ยกเลิกการพึ่งพา AI ในงานสำคัญและฝ่ายที่มองว่า AI สามารถเพิ่มประสิทธิภาพได้หากมีกรอบการกำกับดูแลที่เหมาะสม บางการสำรวจชี้ว่าเหตุการณ์ความไม่แน่นอนเช่นนี้ส่งผลให้ความเชื่อมั่นในบริการกฎหมายแบบผสมระหว่างมนุษย์กับ AI ลดลง และผู้บริโภคจำนวนหนึ่งแสดงความต้องการให้มีการรับประกันจากสำนักงานกฎหมายเกี่ยวกับการตรวจสอบความถูกต้องของเอกสารก่อนส่งมอบ

สรุปได้ว่า การตอบสนองจากฝ่ายต่าง ๆ สะท้อนความจำเป็นในการกำหนดมาตรฐานปฏิบัติ การเปิดเผยการใช้เทคโนโลยีต่อผู้รับบริการ และการเสริมระบบตรวจสอบภายในสำนักงานกฎหมายเพื่อป้องกันผลกระทบต่อความเชื่อมั่นของตลาดบริการกฎหมายในระยะยาว ทั้งยังเป็นสัญญาณให้หน่วยงานกำกับดูแล พัฒนาแนวปฏิบัติและบทบัญญัติที่ชัดเจนมากขึ้นเพื่อสร้างสมดุลระหว่างนวัตกรรมและการคุ้มครองผู้บริโภค

Tutorial: วิธีใช้ AI อย่างปลอดภัยเมื่อมีประเด็นทางกฎหมาย

Tutorial: วิธีใช้ AI อย่างปลอดภัยเมื่อมีประเด็นทางกฎหมาย

บทแนะนำนี้จัดทำเพื่อให้ผู้ใช้ ChatGPT และเครื่องมือ AI อื่นๆ สามารถใช้เป็นแหล่งข้อมูลเบื้องต้นด้านกฎหมายได้อย่างรอบคอบและลดความเสี่ยงทางกฎหมายและการตีความผิดพลาด โดยเฉพาะในบริบทธุรกิจที่ผลลัพธ์อาจมีผลกระทบรุนแรงต่อการตัดสินใจการจ้างงาน สัญญา หรือการดำเนินคดี ไม่ควรถือคำตอบจาก AI เป็นคำแนะนำทางกฎหมาย และควรบันทึก ตรวจกับแหล่งข้อมูลต้นทาง และปรึกษาทนายมนุษย์เมื่อจำเป็น

1) แนวทางการตั้งคำถาม (Step-by-step)

การตั้งคำถามที่ชัดเจนช่วยลดความเสี่ยงของคำตอบที่คลุมเครือหรือทำให้เข้าใจผิด ให้ปฏิบัติตามขั้นตอนต่อไปนี้เมื่อสอบถามเรื่องกฎหมายกับ AI:

- ระบุข้อเท็จจริงให้ชัดเจน: ระบุสถานที่ (jurisdiction) เช่น “รัฐอิลลินอยส์” วันที่หรือช่วงเวลาที่เกี่ยวข้อง และสถานะของผู้เกี่ยวข้อง เช่น “พนักงานเต็มเวลา” หรือ “สัญญาที่ลงวันที่ 1 ม.ค. 2024”

- ขอแหล่งอ้างอิง: ระบุว่า “โปรดให้แหล่งอ้างอิง เช่น รหัสกฎหมาย คำพิพากษา หรือลิงก์ไปยังเว็บไซต์รัฐ” เพื่อให้สามารถตรวจสอบได้

- ขอการชี้แจงขอบเขต: ระบุว่า “ขอคำตอบในเชิงข้อมูล ไม่ใช่คำแนะนำทางกฎหมาย” หรือใช้ข้อความ “This is not legal advice” (ในภาษาไทย: “ไม่ใช่คำแนะนำทางกฎหมาย”) เพื่อให้ AI ปฏิบัติตามขอบเขตการให้ข้อมูล

- แยกคำถามเชิงข้อเท็จจริงและคำถามเชิงกลยุทธ์: ถามข้อเท็จจริงก่อน เช่น “กฎหมายกำหนดระยะเวลาการยื่นฟ้องภายในกี่วันในรัฐนี้?” จากนั้นจึงถามเชิงกลยุทธ์เช่น “ทางเลือกเบื้องต้นมีอะไรบ้าง” แต่หากเป็นเชิงกลยุทธ์ ให้เตือนว่าเป็นข้อเสนอแนะแนวคิด ไม่ใช่คำแนะนำผูกพัน

- ขอความชัดเจนเกี่ยวกับความไม่แน่นอน: ระบุให้ AI แจ้งระดับความมั่นใจหรือระบุว่า “ข้อมูลอาจไม่สมบูรณ์หรือเปลี่ยนแปลงได้”

2) การบันทึกและตรวจสอบคำตอบ (Preserve and Verify)

การบันทึกและตรวจสอบเป็นขั้นตอนสำคัญเมื่อใช้ AI เพื่อให้สามารถย้อนกลับหรือใช้เป็นหลักฐานในอนาคตได้ ทำตามแนวทางต่อไปนี้:

- เก็บสำเนาบทสนทนา: บันทึกการสนทนาเป็นไฟล์ข้อความหรือ PDF และเก็บสกรีนช็อต (screenshot) ที่แสดงวันที่ เวลา และรุ่นของโมเดล (ถ้ามี) เพื่อแสดงบริบท

- จด prompt ที่ใช้: บันทึกคำถามต้นฉบับ (prompt) พร้อมพารามิเตอร์ที่ตั้งค่า เช่น ภาษาที่ใช้ วันที่ และคำสั่งพิเศษ เพื่อให้เข้าใจว่าคำตอบเกิดจากคำถามใด

- ตรวจสอบวันที่ข้อมูล: ตรวจสอบว่าข้อมูลที่ AI อ้างอิงมีการอัพเดตถึงเมื่อไร และเปรียบเทียบกับข้อกฎหมายหรือคำพิพากษาล่าสุด (กฎหมายเปลี่ยนแปลงได้บ่อย — โดยเฉพาะประเด็นแรงงาน ภาษี และทรัพย์สินทางปัญญา)

- เปรียบเทียบกับแหล่งข้อมูลหลัก: เมื่อต้องการยืนยัน ให้ค้นหาข้อกฎหมาย คำพิพากษา หรือเอกสารราชการต้นฉบับ เช่น เว็บไซต์ศาล รัฐบาล หรือหน่วยงานกำกับดูแล และตรวจสอบความสอดคล้องกับคำตอบของ AI

- ใช้การยืนยันแบบหลายแหล่ง (cross-check): หากคำตอบมีความสำคัญ เช่น เกี่ยวกับสิทธิ หนี้สิน หรือการฟ้องร้อง ให้ตรวจสอบอย่างน้อยสองแหล่งอิสระก่อนนำไปใช้

3) เมื่อใดควรหยุดใช้ AI และปรึกษาทนายมนุษย์

AI เหมาะสำหรับการค้นหาข้อมูลพื้นฐานหรือเตรียมความพร้อม แต่มีสถานการณ์ที่ต้องปรึกษาทนายจริงทันที ซึ่งรวมถึง:

- มีความเสี่ยงทางอาญาหรือโทษจำคุก — หยุดใช้ AI เพื่อการตัดสินใจและขอคำปรึกษาทนายทันที

- ข้อพิพาทที่มีผลกระทบทางการเงินสูง เช่น สัญญามูลค่าหลักแสนดอลลาร์ หรือการเรียกร้องค่าเสียหายจำนวนมาก

- ระยะเวลาทางกฎหมายเร่งด่วน เช่น กำหนดเวลายื่นฟ้องหรือยื่นคำร้อง (statute of limitations, filing deadlines)

- ต้องการคำแปล/ตีความสัญญาที่มีผลผูกพันทางกฎหมาย หรือการเจรจาต่อรองสัญญา

- กรณีที่คำตอบจาก AI ขัดแย้งกันหรือไม่ชัดเจน — หาก AI ให้ข้อมูลที่ขัดกัน ให้หยุดและนำหลักฐานไปให้ทนายตรวจสอบ

การปรึกษาทนายมนุษย์ควรเตรียมเอกสารและข้อมูลล่วงหน้า เช่น สรุปเหตุการณ์เป็นไทม์ไลน์ สำเนาสัญญา อีเมล พยานหลักฐาน และสำเนาบทสนทนากับ AI (ที่บันทึกไว้) เพื่อให้ทนายสามารถวิเคราะห์ความเสี่ยงได้รวดเร็วและแม่นยำ

4) วิธีเตรียมข้อมูลให้ทนายมนุษย์

เมื่อถึงเวลาต้องปรึกษาทนาย ให้เตรียมข้อมูลต่อไปนี้เพื่อเพิ่มประสิทธิภาพการให้คำปรึกษา:

- ไทม์ไลน์เหตุการณ์: ระบุวันที่ เหตุการณ์สำคัญ และการสื่อสารที่เกี่ยวข้องอย่างเป็นลำดับ

- เอกสารที่เกี่ยวข้อง: สัญญา นโยบายบริษัท อีเมล ข้อความ และหลักฐานอื่นๆ ในรูปแบบที่ทนายสามารถอ่านได้ (PDF/ภาพชัดเจน)

- บทสนทนากับ AI: ส่งสำเนา prompt และ response พร้อมสกรีนช็อตและวันที่ เพื่อให้ทนายเห็นบริบทและแหล่งข้อมูลที่คุณอ้างอิง

- เป้าหมายและงบประมาณ: อธิบายผลลัพธ์ที่ต้องการ (เช่น หยุดการเลิกจ้าง เรียกร้องค่าเสียหาย หรือต่อรองสัญญา) และงบประมาณที่จะใช้ในการดำเนินการ

- คำถามเฉพาะเจาะจง: รวบรวมคำถามที่ต้องการคำตอบจากทนาย เช่น “ความเสี่ยงทางกฎหมายในกรณีนี้คืออะไร?” หรือ “ควรดำเนินการทันทีอย่างไรเพื่อปกป้องสิทธิ?”

5) ตัวอย่าง Prompt ที่ปลอดภัยและใช้งานได้จริง

ด้านล่างเป็นตัวอย่าง prompt ที่ออกแบบมาเพื่อลดความเสี่ยงของการเข้าใจผิดหรือการเอาไปใช้เป็นคำแนะนำผูกพัน:

- Prompt แบบขอข้อมูลทั่วไป: “ขอข้อมูลสรุปเกี่ยวกับกฎหมายการเลิกจ้างในรัฐอิลลินอยส์ (ไม่ใช่คำแนะนำทางกฎหมาย) ให้ระบุแหล่งอ้างอิง เช่น รหัสกฎหมายหรือคำพิพากษาที่เกี่ยวข้อง และบอกวันที่ของแหล่งข้อมูล”

- Prompt แบบขอแหล่งอ้างอิง: “ช่วยชี้แหล่งอ้างอิงเชิงกฎหมายที่เกี่ยวข้องกับสิทธิแรงงานสำหรับพนักงานเต็มเวลาที่ถูกปลดในรัฐอิลลินอยส์ พร้อมลิงก์หรือชื่อเอกสารต้นทาง (ไม่ใช่คำแนะนำทางกฎหมาย)”

- Prompt แบบเตรียมประชุมกับทนาย: “สรุปประเด็นที่ควรถามทนายในกรณีเลิกจ้างโดยไม่ให้คำแนะนำทางกฎหมาย โดยให้รายการคำถาม 10 ข้อ และเอกสารที่ควรเตรียม”

- Prompt แบบตรวจสอบความไม่แน่นอน: “วิเคราะห์จุดที่ข้อมูลอาจไม่แน่นอนหรือขาดแคลนเกี่ยวกับกฎหมายเลิกจ้างในรัฐนี้ และแนะนำแหล่งข้อมูลหลักเพื่อตรวจสอบต่อ (เน้นว่าเป็นข้อมูลเพื่อการศึกษานเท่านั้น)”

สรุปสั้นๆ: ใช้ AI เป็นเครื่องมือค้นหาข้อมูลเบื้องต้นและเตรียมความพร้อม แต่ต้องบันทึกบทสนทนา ตรวจสอบแหล่งข้อมูลต้นทาง และเมื่อมีความเสี่ยงหรือผลกระทบทางกฎหมายจริงจัง ให้หยุดและปรึกษาทนายมนุษย์พร้อมเอกสารครบถ้วน การปฏิบัติตามแนวทางเหล่านี้จะช่วยลดความเสี่ยงจากความเข้าใจผิด และปกป้องสิทธิ์ของท่านในบริบทธุรกิจและกฎหมาย

แนวนโยบายและข้อเสนอแนะสำหรับอนาคต

แนวนโยบายและข้อเสนอแนะสำหรับอนาคต

เหตุการณ์ที่หญิงอิลลินอยส์ตกเป็นเหยื่อจากคำตอบของ ChatGPT แสดงให้เห็นช่องว่างด้านการกำกับดูแลและการปฏิบัติที่ชัดเจนในการนำ AI มาใช้ในบริบทที่มีความเสี่ยงสูง เช่น การให้คำปรึกษาทางกฎหมาย เพื่อป้องกันเหตุซ้ำ จำเป็นต้องมีแนวนโยบายเชิงรุกที่ผสมผสานมาตรการด้านความโปร่งใส ความรับผิดชอบ และการเตรียมความพร้อมของสถาบันกฎหมาย โดยมาตรการเหล่านี้ควรถูกออกแบบให้สมดุลระหว่างการส่งเสริมนวัตกรรมและการคุ้มครองผู้บริโภค

มาตรฐานความโปร่งใสของโมเดล: ผู้พัฒนา AI ควรถูกกำกับให้เผยแพร่ model card และ risk assessment ในรูปแบบที่เข้าใจได้สำหรับผู้ใช้ทั่วไป ระบุขอบเขตการใช้งานที่เหมาะสม ข้อมูลแหล่งฝึกสอนในระดับสรุป (data provenance) และการประเมินความเสี่ยงต่อการให้ข้อมูลที่ผิดพลาดหรือชี้นำผิด ผู้ให้บริการต้องติดป้ายประกาศข้อจำกัดการใช้ (usage disclaimer) เมื่อระบบถูกนำไปใช้ในบริบทที่เกี่ยวข้องกับการตัดสินใจทางกฎหมาย โดยควรมีข้อความชัดเจนเช่น “ระบบนี้ให้ข้อมูลเชิงข้อมูล ไม่ใช่คำปรึกษาทางกฎหมายจากทนายความ” และต้องเสนอช่องทางให้ผู้ใช้เข้าถึงทนายความมนุษย์ได้อย่างชัดเจน

มาตรฐานการเก็บบันทึกและการตรวจสอบย้อนหลัง: ควรกำหนดข้อบังคับให้ผู้ให้บริการ AI และผู้ใช้งานที่เป็นสถาบันต้องเก็บบันทึกการสนทนา (interaction logs) อย่างปลอดภัย โดยมีการเข้ารหัส การควบคุมสิทธิ์การเข้าถึง และการเก็บรักษา metadata ที่เพียงพอสำหรับการตรวจสอบต้นตอคำแนะนำ (provenance trail) ข้อเสนอแนะเชิงนโยบายควรกำหนดกรอบเวลาการเก็บรักษา การอนุญาตให้เข้าถึงข้อมูลเพื่อการตรวจสอบอย่างเป็นอิสระ และกระบวนการรายงานเหตุการณ์ผิดพลาดหรือความเสียหายต่อหน่วยกำกับดูแลภายในระยะเวลาที่เหมาะสม (เช่น ภายใน 72 ชั่วโมงสำหรับเหตุการณ์ร้ายแรง)

แนวทางปฏิบัติสำหรับสำนักงานกฎหมาย: สำนักงานกฎหมายควรออกนโยบายการใช้ AI ภายในองค์กรที่ชัดเจน รวมถึงการกำหนดบทบาทผู้รับผิดชอบ (AI steward) สำหรับการอนุมัติเครื่องมือ มีการตรวจสอบคุณภาพผลลัพธ์ (QA) ก่อนส่งต่อให้ลูกค้า และกำหนดให้มี human-in-the-loop ในการตัดสินใจสำคัญ นอกจากนี้ควรมีการอบรมทนายความเรื่องขีดจำกัดและความเสี่ยงของ AI ปรับกรมธรรม์ประกันความรับผิด (malpractice insurance) ให้ครอบคลุมการใช้เครื่องมือดิจิทัล และจัดทำคำยินยอมที่ชัดเจนเมื่อใช้ AI ในการจัดทำเอกสารหรือให้คำปรึกษา

- ความรับผิดชอบของผู้พัฒนา AI: จัดให้มีการทดสอบความน่าเชื่อถือ (robustness testing) และการประเมินทางจริยธรรมก่อนปล่อยใช้งาน สร้างช่องทางรับเรื่องร้องเรียนและการตอบสนองต่อเหตุการณ์ รวมทั้งสนับสนุนการตรวจสอบจากบุคคลที่สาม (third-party audits)

- การกำกับดูแลเชิงสถาบัน: หน่วยงานกำกับดูแลควรกำหนดกรอบข้อกำหนดสำหรับแอปพลิเคชันที่ให้คำปรึกษาเชิงวิชาชีพ โดยอาจจัดระดับความเสี่ยงและข้อกำหนดแตกต่างกันตามบริบท เช่น การให้คำปรึกษาทางกฎหมาย การเงิน หรือการแพทย์

- การรับประกันคุณภาพและการรับรอง: พัฒนาเกณฑ์การรับรอง (certification) สำหรับเครื่องมือ legal-AI ที่ผ่านการทดสอบตามมาตรฐาน และให้ใบรับรองรวมถึงข้อกำหนดสำหรับการอัปเดตต่อเนื่อง

- การคุ้มครองผู้บริโภค: กำหนดมาตรการให้ผู้ใช้ได้รับข้อมูลชัดเจนเกี่ยวกับการมีส่วนร่วมของ AI ในบริการ และสิทธิในการเข้าถึงบันทึกการสนทนา รวมถึงช่องทางการชดเชยความเสียหายเมื่อเกิดความผิดพลาดจากระบบ

ความร่วมมือระหว่างภาครัฐ ภาคเอกชน และสมาคมวิชาชีพ: การป้องกันเหตุการณ์ซ้ำจำเป็นต้องอาศัยความร่วมมือแบบองค์รวม รัฐควรสนับสนุนการจัดตั้งเวทีมาตรฐาน (standards body) ที่มีตัวแทนจากผู้พัฒนา AI สถาบันกฎหมาย สมาคมทนายความ และผู้บริโภค เพื่อพัฒนาแนวทางปฏิบัติที่เหมาะสมและสอดคล้องกัน ทั้งนี้ควรส่งเสริมโครงการ regulatory sandbox สำหรับการทดสอบเครื่องมือภายใต้การกำกับดูแลก่อนการนำสู่ตลาดอย่างเต็มรูปแบบ

สรุปแล้ว การป้องกันการบ่อนทำลายความเชื่อมั่นของระบบกฎหมายด้วย AI จำเป็นต้องผสมผสานมาตรการทางนโยบาย เทคนิค และการสร้างความตระหนักในระดับสถาบัน โดยให้ความสำคัญกับ ความโปร่งใส ความรับผิดชอบ และ การร่วมมือแบบมีผู้มีส่วนได้เสียหลายภาคส่วน เพื่อให้เทคโนโลยี AI สามารถเสริมประสิทธิภาพของงานกฎหมายได้โดยไม่สร้างความเสี่ยงต่อสิทธิและความปลอดภัยของประชาชน

บทสรุป

กรณีหญิงอิลลินอยส์ที่เลิกจ้างทนายความมนุษย์หลังรับคำพูดจาก ChatGPT เป็นตัวอย่างเตือนใจว่า AI ในปัจจุบันยังไม่สามารถทดแทนบทบาทของทนายความในประเด็นที่ต้องการความรับผิดชอบและการตีความทางกฎหมายอย่างเป็นทางการ ระบบภาษาใหญ่อาจให้ข้อมูลที่ชวนเชื่อแต่ไม่ถูกต้องหรือขาดบริบทสำคัญ — การศึกษาทดสอบอิสระชี้ว่ามีอัตราการเกิด “hallucination” ในผลลัพธ์ของโมเดลหลายตัวอยู่ในระดับที่มีนัยสำคัญ (รายงานต่าง ๆ ระบุช่วงหลายเปอร์เซ็นต์ถึงสองหลัก) ดังนั้นผู้ใช้ควรถือว่า AI เป็นเครื่องมือช่วยค้นคว้าและร่างความคิดเบื้องต้นเท่านั้น และต้องตรวจสอบผลลัพธ์กับผู้เชี่ยวชาญทางกฎหมายก่อนใช้เพื่อการตัดสินใจหรือการปฏิบัติที่มีผลผูกพันทางกฎหมาย

นอกเหนือจากการเน้นบทบาทของมนุษย์ในห่วงโซ่การตรวจสอบแล้ว กรณีนี้ยังสะท้อนความจำเป็นของการกำกับดูแลและแนวปฏิบัติที่ชัดเจน ทั้งจากผู้พัฒนาเทคโนโลยีและวงการกฎหมาย เช่น มาตรฐานการเปิดเผยข้อจำกัดของโมเดล ข้อกำหนดด้านความรับผิดชอบ การออกแบบระบบ human-in-the-loop การเก็บประวัติการตัดสินใจ (audit trail) และหลักจรรยาบรรณในการใช้ AI ในงานกฎหมาย หากมีกรอบกำกับที่เข้มแข็งและการอบรมผู้ใช้งานร่วมกัน เราจะสามารถลดความเสี่ยงของความเสียหายจากคำตอบที่ไม่ถูกต้องและสร้างสภาพแวดล้อมที่ผสานประสิทธิภาพของ AI เข้ากับความรับผิดชอบของมนุษย์ได้อย่างปลอดภัย

📰 แหล่งอ้างอิง: NewsNation