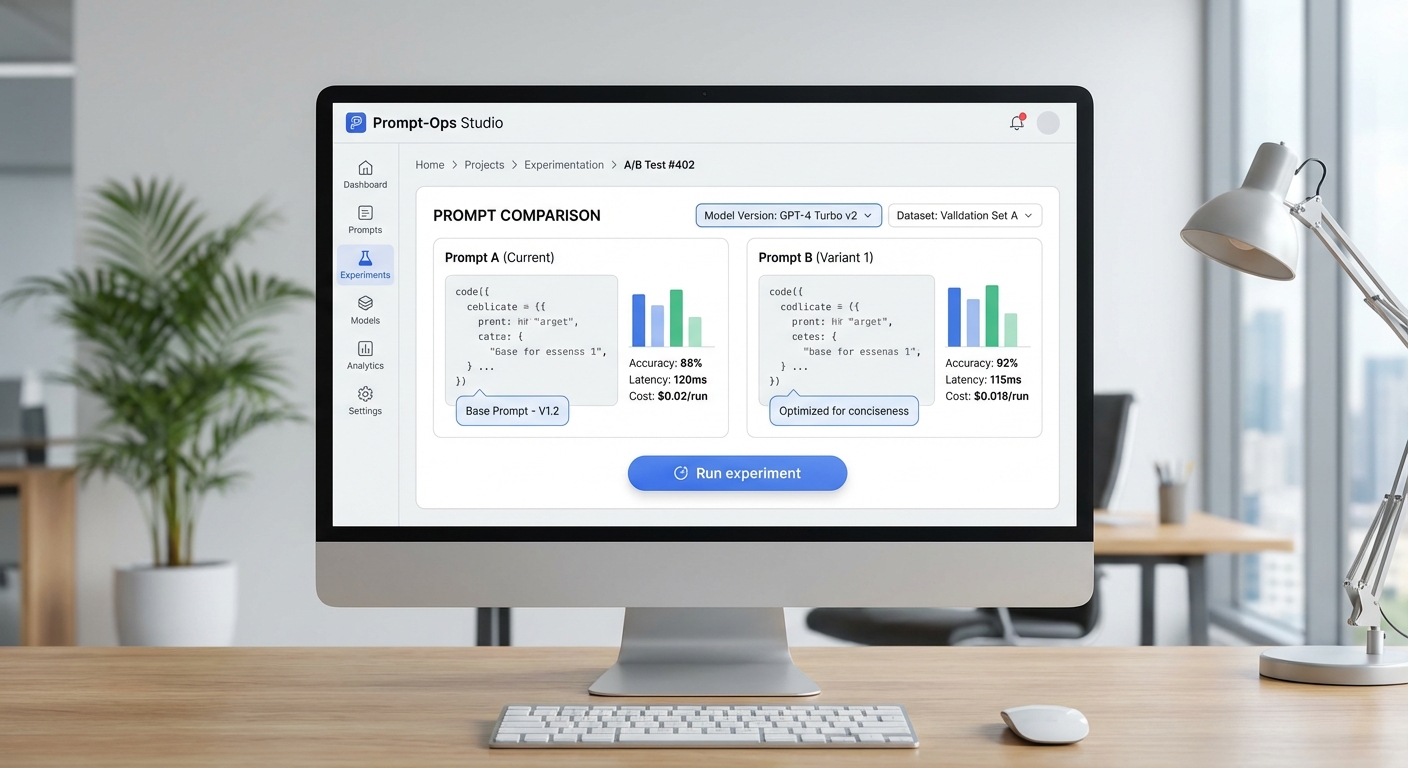

สตาร์ทอัพไทยเปิดตัว Prompt‑Ops Studio แพลตฟอร์มใหม่ที่ออกแบบมาเฉพาะสำหรับทีมการตลาดที่ใช้โมเดลภาษาขนาดใหญ่เพื่อสร้างคอนเทนต์และแคมเปญโฆษณา โดยชูจุดเด่นการทดสอบพรอมต์แบบ A/B อย่างเป็นระบบ ให้ผู้ใช้สามารถเปรียบเทียบเวอร์ชันพรอมต์และเลือกเวอร์ชันโมเดลที่ให้ผลลัพธ์ดีที่สุด พร้อมฟีเจอร์วิเคราะห์เชิงสถิติและแดชบอร์ดติดตามค่า Token‑Cost แบบเรียลไทม์ — ซึ่งบริษัทผู้พัฒนาอ้างว่าสามารถลดต้นทุนต่อแคมเปญได้สูงสุดถึง 30% จากการปรับแต่งพรอมต์และเลือกใช้โมเดลที่คุ้มค่าที่สุด

บทความนี้จะพาผู้อ่านสำรวจภาพรวมของ Prompt‑Ops Studio ทั้งการทำงานเบื้องต้น วิธีการตั้งทดสอบ A/B สำหรับอีเมลโฆษณา คอนเทนต์โซเชียล และหน้าแลนดิ้งเพจ รวมถึงตัวอย่างการวัดผลจริง (เช่น อัตราการคลิก ค่า Conversion และค่าใช้จ่ายต่อผลลัพธ์) และสถิติที่สนับสนุนการลดค่าใช้จ่าย เพื่อช่วยให้ทีมการตลาดเห็นความแตกต่างระหว่างเวิร์กโฟลว์เดิมกับการนำระบบ Prompt‑Ops มาใช้ในเชิงปฏิบัติ

บทนำ: ทำไมทีมการตลาดควรให้ความสนใจกับ Prompt‑Ops Studio

บทนำ: ทำไมทีมการตลาดควรให้ความสนใจกับ Prompt‑Ops Studio

Prompt‑Ops Studio เป็นแพลตฟอร์มที่พัฒนาขึ้นโดยสตาร์ทอัพไทย เพื่อแก้ปัญหาที่ทีมการตลาดและเอเจนซี่กำลังเผชิญเมื่อนำโมเดลภาษาขนาดใหญ่ไปใช้ในการทำคอนเทนต์และแคมเปญโฆษณาโดยตรง ตัวผลิตภัณฑ์นี้ออกแบบมาให้รองรับการทดสอบพรอมต์แบบ A/B ระหว่างเวอร์ชันโมเดลหลายตัว พร้อมระบบติดตาม ค่า Token‑Cost แบบเรียลไทม์ จึงช่วยให้ผู้จัดการแคมเปญสามารถตัดสินใจเชิงข้อมูล (data‑driven) ได้อย่างชัดเจนและรวดเร็ว แทนการพึ่งพาการทดลองแบบเดี่ยวหรือการคาดการณ์ค่าใช้จ่ายที่ไม่แน่นอน

สำหรับทีมการตลาด, เอเจนซี่ และผู้จัดการแคมเปญที่ต้องบริหารงบประมาณและผลลัพธ์ของคอนเทนต์ในระดับสเกลสูง ความท้าทายหลักประกอบด้วยความซับซ้อนในการปรับพรอมต์ให้ได้ผลลัพธ์ที่ต้องการ การบริหารและเปรียบเทียบโมเดลหลายเวอร์ชัน และการควบคุมค่าใช้จ่าย API ที่มักเกิดค่าใช้จ่ายไม่คาดคิด Prompt‑Ops Studio เชื่อมช่องว่างเหล่านี้ด้วยฟังก์ชันที่ช่วยให้ทีมสามารถรันการทดสอบ A/B หลายเวอร์ชันพร้อมกัน เปรียบเทียบผลลัพธ์เชิงประสิทธิภาพ (เช่น CTR, CVR) และติดตามค่าใช้จ่ายเชิงโทเค็นต่อคำขอได้แบบเรียลไทม์

ผลลัพธ์เชิงธุรกิจที่คาดหวังจากการนำ Prompt‑Ops Studio มาใช้ ได้แก่การเพิ่มประสิทธิภาพของครีเอทีฟและข้อความโฆษณา ซึ่งอาจแปลเป็นการเพิ่มอัตราการคลิก (CTR) ได้ในระดับตัวอย่างเช่น 10–25% จากการทดสอบ A/B ที่เป็นระบบ และการลดต้นทุนต่อการแปลง (CPA) รวมถึงการลดต้นทุนต่อแคมเปญได้สูงสุดถึง 30% โดยมาจากการเลือกเวอร์ชันโมเดลที่คุ้มค่าที่สุดและการควบคุม Token‑Cost ที่แม่นยำมากขึ้น ในทางปฏิบัติ ทีมที่ใช้งานสามารถคาดการณ์งบประมาณได้ใกล้เคียงกับผลลัพธ์จริงมากขึ้น ลดการใช้งานโมเดลที่เกินความจำเป็น และตัดสินใจสเกลแคมเปญอย่างมีประสิทธิภาพ

โดยสรุป Prompt‑Ops Studio ไม่เพียงแต่เป็นเครื่องมือทางเทคนิคสำหรับนักพัฒนาเท่านั้น แต่ยังเป็นแพลตฟอร์มเชิงกลยุทธ์สำหรับทีมการตลาดที่ต้องการเปลี่ยนการทดลองพรอมต์ให้เป็นกระบวนการที่วัดผลได้และคุ้มค่า เมื่อผสานการทดสอบ A/B แบบอัตโนมัติ การจัดการเวอร์ชันโมเดล และการติดตามค่าใช้จ่ายแบบเรียลไทม์ ทีมการตลาดจะได้รับทั้งความเร็วในการทดลองและความมั่นคงด้านงบประมาณ ซึ่งส่งผลโดยตรงต่อประสิทธิภาพของแคมเปญและตัวชี้วัดธุรกิจที่สำคัญ

- กลุ่มเป้าหมาย: ทีมการตลาด, เอเจนซี่โฆษณา, ผู้จัดการแคมเปญ

- ปัญหาที่แก้ได้: การทดสอบพรอมต์ไม่เป็นระบบ, การบริหารโมเดลหลายเวอร์ชัน, การติดตามค่าใช้จ่าย API ยาก

- ผลลัพธ์เชิงธุรกิจ: เพิ่ม CTR และ CVR, ลด CPA และลดต้นทุนต่อแคมเปญได้ถึง 30% พร้อมความแม่นยำในการคาดการณ์งบประมาณ

ฟีเจอร์หลักของ Prompt‑Ops Studio ที่ทีมการตลาดต้องรู้

ฟีเจอร์หลักของ Prompt‑Ops Studio ที่ทีมการตลาดต้องรู้

Prompt‑Ops Studio ถูกออกแบบมาเพื่อตอบโจทย์ทีมการตลาดที่ต้องการทดสอบข้อความ (prompts) และโมเดลภาษาในสภาพแวดล้อมที่มีการควบคุมและวัดผลได้อย่างชัดเจน โดยมีเป้าหมายลดต้นทุนการใช้โมเดลและเพิ่มประสิทธิผลของแคมเปญ ตัวอย่างการใช้งานที่เห็นผลคือการลดต้นทุนต่อแคมเปญได้ถึง 30% เมื่อใช้ฟีเจอร์การทดสอบแบบ A/B ร่วมกับการติดตามค่า Token‑Cost แบบเรียลไทม์

หนึ่งในฟีเจอร์เด่นคือ A/B Prompt Testing ที่ไม่เพียงแต่ทดสอบเวอร์ชันของพรอมต์เท่านั้น แต่ยังรองรับการทดสอบระหว่าง model variants (เช่น GPT‑4 vs GPT‑4o หรือโมเดลเฉพาะอุตสาหกรรม) โดยระบบจะทำการ สุ่มแจกกลุ่มผู้ใช้ แบบอัตโนมัติ (random assignment) สามารถตั้งขนาดกลุ่มตัวอย่าง (sample size) และระยะเวลาการทดลองได้ ทีมการตลาดจึงสามารถเปรียบเทียบ CTR และ conversion ระหว่างเวอร์ชัน A/B ได้อย่างเป็นกลาง ตัวอย่างเช่น การทดสอบภายในพบว่า เวอร์ชัน B ให้ CTR 3.8% เทียบกับ A ที่ 2.4% ภายใน 2 สัปดาห์ เมื่อมีการสุ่มผู้ใช้ 10,000 ราย

เพื่อควบคุมค่าใช้จ่ายอย่างใกล้ชิด Prompt‑Ops Studio มี Token‑Cost dashboard แบบเรียลไทม์ ที่แสดงค่าใช้จ่ายต่อคำขอ, การใช้โทเคนสะสม และการคาดการณ์ค่าใช้จ่ายต่อวัน/ต่อแคมเปญ ผู้ใช้สามารถตั้ง budget thresholds และรับการแจ้งเตือน (email/Slack/webhook) เมื่อค่าใช้จ่ายเกินงบ ตัวอย่างการตั้งค่า: แจ้งเตือนเมื่อเกิน 80% ของงบประมาณรายวัน หรือเมื่อค่าใช้จ่ายต่อการตอบกลับสูงกว่าระดับที่กำหนด ระบบยังมีการวิเคราะห์ต้นทุนต่อ conversion เพื่อช่วยตัดสินใจว่าจะสลับไปใช้โมเดลต้นทุนต่ำกว่า (model switching) หรือปรับขนาดการใช้งาน

การเก็บและรายงานข้อมูลเป็นหัวใจสำคัญของการทดลองเชิงปริมาณ โดย Prompt‑Ops Studio จะบันทึก เมตริกหลัก เช่น CTR, conversion rate, token usage พร้อมการแยกย่อยตาม cohort (ช่องทาง, กลุ่มประชากร, เวลา) ผู้ใช้งานสามารถเรียกดู experiment history แบบละเอียดในรูปแบบ timeline ที่เก็บทั้งการตั้งค่า (prompts, model variants, traffic split) และผลลัพธ์เชิงตัวเลข ระบบรองรับการเปรียบเทียบแบบเป๊ะ (exact comparison) ระหว่างการทดลองหลายชุด เช่น การเทียบผล A/B ที่มีเงื่อนไขต่างกันเพื่อตรวจสอบความแตกต่างอย่างมีนัยสำคัญทางสถิติ

- รองรับการสลับเวอร์ชันและการปล่อยแบบ Canary: สามารถกำหนดกฎในการสลับโมเดล (rollout rules) เช่น ปล่อยเวอร์ชันใหม่ให้ 5% ของผู้ใช้ก่อน แล้วค่อยขยายหากผลลัพธ์ดีกว่า

- แดชบอร์ดค่าโทเคนเรียลไทม์: แยกแสดงโทเคนต่อคำขอ, ค่าใช้จ่ายสะสม, และการคาดการณ์งบ รวมการแจ้งเตือนเมื่อเกินงบ

- เก็บประวัติการทดลองอย่างละเอียด: ทุกการเปลี่ยนแปลงถูกล็อกไว้ (audit log) ช่วยให้การรีวิวผลย้อนหลังและการทำรีพอร์ตมีความแม่นยำ

- การรวมเข้ากับ workflow ของทีม: ส่งออกข้อมูลเป็น CSV/JSON, ตั้ง webhook เพื่อเชื่อมต่อกับระบบ CRM/analytics, และมี integrations กับเครื่องมือยอดนิยม (เช่น Slack, Data Warehouse, BI tools)

ฟีเจอร์การรวมงาน (collaboration) ยังสนับสนุนการทำงานเป็นทีม—กำหนดสิทธิ์การเข้าถึง, ใส่คอมเมนต์ในแต่ละ experiment, และสร้างรายงานสรุปที่สามารถส่งให้ผู้บริหารหรือเอเจนซีภายนอกได้ทันที ตัวอย่างเวิร์กโฟลว์: ทีมการตลาดสร้าง A/B test → ระบบแจกผู้ใช้แบบสุ่ม → รวบรวม CTR/Conversion/Token usage → แจ้งเตือนเมื่อค่าใช้จ่ายเกิน → ส่งผลลัพธ์ผ่าน webhook ไปยัง BI เพื่อทำการวิเคราะห์เชิงลึกต่อไป

โดยสรุป Prompt‑Ops Studio ให้เครื่องมือครบวงจรสำหรับการทดสอบพรอมต์และโมเดลในระดับองค์กร ทั้งการจัดการทราฟฟิกแบบสุ่ม การสลับเวอร์ชันอย่างปลอดภัย การติดตามค่าโทเคนแบบเรียลไทม์ พร้อมระบบเก็บประวัติทดลองและการเชื่อมต่อกับ workflow ของทีม ซึ่งทั้งหมดนี้ช่วยให้ทีมการตลาดตัดสินใจเชิงข้อมูลได้รวดเร็วขึ้นและลดต้นทุนต่อแคมเปญอย่างเป็นรูปธรรม

สถาปัตยกรรมเชิงเทคนิค: การเชื่อมต่อกับโมเดลและระบบขององค์กร

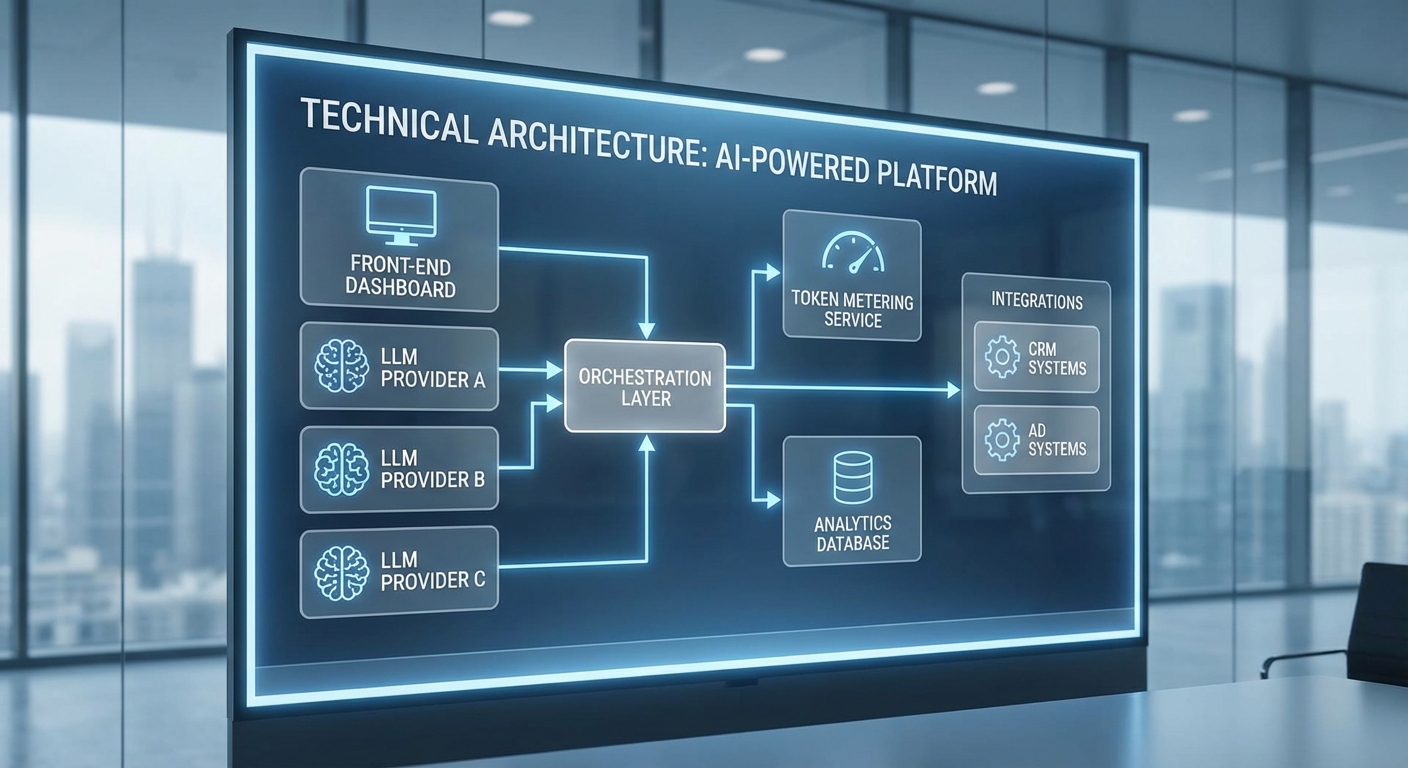

สถาปัตยกรรมของ Prompt‑Ops Studio ออกแบบมาเพื่อรองรับการทดลองพรอมต์แบบ A/B อย่างมีประสิทธิภาพ โดยเชื่อมต่อระหว่าง front‑end dashboard กับชุดบริการเบื้องหลังที่ทำหน้าที่ orchestration, การเชื่อมต่อกับผู้ให้บริการ LLM, การวัดค่า token‑cost แบบเรียลไทม์ และการจัดเก็บเหตุการณ์เพื่อการวิเคราะห์เชิงลึก ในภาพรวมข้อมูลจะไหลจาก UI → orchestration layer → model connectors → token metering service → analytics DB และย้อนกลับมายัง dashboard สำหรับการแสดงผลผลลัพธ์และค่าใช้จ่ายตามแคมเปญ

องค์ประกอบหลักและการทำงานร่วมกัน

- UI / Front‑end Dashboard: ให้ผู้ใช้สร้างทดลอง (experiments), กำหนดเวอร์ชันโมเดล, กำหนดแคมเปญและงบประมาณ ตลอดจนแสดงค่า Token‑Cost, KPI แบบเรียลไทม์ และผล A/B

- Orchestration Layer: ตัวกลางสำคัญที่ทำ routing ของพรอมต์ไปยังโมเดลที่กำหนด (เช่น model A หรือ model B), ทำ sampling policy (เช่น 50/50 split), retry/backoff, และบันทึกเมตริกของคำขอ (request metadata) ก่อนส่งไปยัง connectors

- Model Connectors: ตัวเชื่อมไปยัง OpenAI/other LLM providers ซึ่งรองรับหลาย endpoint, credential management, และ adapter สำหรับรูปแบบ API ที่แตกต่างกัน เพื่อให้สามารถสลับหรือเทียบโมเดลได้อย่างราบรื่น

- Token Metering Service: บริการที่นับจำนวน token ต่อคำขอ (ทั้ง prompt และ completion) โดยใช้ข้อมูลจากผู้ให้บริการ (usage fields) และ/หรือการนับภายในกับ tokenizer ที่แมตช์กับโมเดล เพื่อคำนวณ ค่าใช้จ่ายต่อคำขอ และส่งเข้า analytics DB

- Analytics DB / Event Store: เก็บเหตุการณ์ดิบ (event log), เมตริก latency/throughput, และข้อมูลเชิงธุรกิจ เช่น campaign_id, variant, และผลลัพธ์ ทั้งนี้ระบบควรใช้ storage ที่รองรับการ aggregate แบบเวลาจริง (time‑series) และการคิวรีเชิงวิเคราะห์ (OLAP)

วิธีคำนวณ Token‑Cost และการเก็บรวมตามแคมเปญ

การคำนวณค่า Token‑Cost ทำได้โดยการนับ prompt_tokens และ completion_tokens ต่อคำขอ แล้วคูณด้วยอัตราค่าใช้จ่ายของโมเดลนั้น ๆ (unit price ต่อ token หรือ ต่อ 1K tokens) ดังสมการพื้นฐาน:

- cost_per_request = (prompt_tokens + completion_tokens) * unit_price_per_token

- unit_price_per_token = price_per_1000_tokens / 1000

ตัวอย่างเชิงตัวเลข: หากโมเดล A คิดราคา $0.02 ต่อ 1,000 tokens → unit_price_per_token = $0.00002; คำขอหนึ่งมี prompt 1,000 tokens และ completion 500 tokens → cost = 1,500 * $0.00002 = $0.03 ต่อคำขอ

เชิงการปฏิบัติ ระบบจะบันทึกแต่ละคำขอเป็น record ที่ผูกกับ campaign_id และ variant_id จากนั้นทำการ aggregate ระดับแคมเปญ (sum cost, avg cost per conversion, cost per 1k impressions ฯลฯ) และแสดงผลแบบเรียลไทม์บน dashboard เพื่อติดตามงบประมาณและคาดการณ์การใช้จ่าย ณ เวลาใดเวลาหนึ่ง

การวัดและข้อพิจารณาด้านประสิทธิภาพ (latency, throughput) และการจัดการเวอร์ชันของโมเดล

ประเด็นสำคัญเชิงปฏิบัติคือการควบคุม latency และรองรับ throughput เพื่อให้ประสบการณ์ทดสอบ A/B เป็นไปอย่างราบรื่น:

- Latency: การเพิ่มชั้น orchestration และ meter อาจเพิ่ม latency เล็กน้อย—เป้าหมายเชิงตัวเลขที่เหมาะสมคือ P95 latency ภายใน 200–500 ms สำหรับกรณีที่มี caching และ 500–1,500 ms สำหรับคำขอที่ต้องรอการตอบจากโมเดลขนาดใหญ่ ในการออกแบบต้องรองรับ asynchronous processing และ streaming responses เมื่อต้องการลด perceived latency

- Throughput: ระบบ orchestration ควรรองรับการสเกลแบบ horizontal (stateless workers + load balancer) โดยตัวเลขเป้าหมายอาจเริ่มจาก 100–1,000 req/s ต่อ cluster แล้วปรับตามปริมาณแคมเปญ ตัวเก็บเหตุการณ์ (event bus เช่น Kafka) และ DB ที่รองรับการเขียนหนัก (ClickHouse, BigQuery, หรือ data lake) จะช่วยให้ aggregate metric เป็นไปได้รวดเร็ว

- Versioning ของโมเดล: แต่ละคำขอต้องบันทึก model_id, model_version และ config ของพรอมต์ (temperature, max_tokens ฯลฯ) เพื่อให้สามารถทำ re‑run, rollback หรือเปรียบเทียบผลย้อนหลังได้ ระบบควรมี registry ที่เก็บ metadata ของโมเดลและนโยบายทดลอง (experiment config) ให้เป็นแหล่งอ้างอิงเดียว

Integration กับ CRM/Ad Platforms และแนวทางการ Deploy (Cloud / On‑Prem)

การผสานรวมกับระบบขององค์กรเป็นหัวใจสำคัญ ทางสถาปัตยกรรมควรมีจุดเชื่อม (integration points) ดังนี้:

- Webhook / API connectors กับ CRM (เช่นการผูกผลลัพธ์ต่อ lead_id) เพื่อให้ attribution และ conversion ถูกบันทึกตามแต่ละแคมเปญ

- Connector กับ Ad Platforms เพื่อดึงข้อมูล impression/click/metadata กลับมายัง analytics DB และอาจใช้เพื่อสั่งหยุดแคมเปญเมื่อค่า Token‑Cost เกินงบประมาณ

- Event publishing เพื่อส่ง signal ไปยังระบบภายใน เช่นการแจ้งเตือนทีมการตลาดหรือปรับ bid ในระบบโฆษณาแบบอัตโนมัติ

สำหรับการ deploy มี 2 แนวทางหลัก:

- Cloud (SaaS/Managed): เหมาะสำหรับความเร็วในการใช้งานและการสเกล โดยใช้ VPC peering, private endpoints และ encryption in transit/at rest เพื่อรักษาความปลอดภัยและปฏิบัติตามข้อกำหนดด้านข้อมูล (data residency)

- On‑Prem / Hybrid: สำหรับองค์กรที่ต้องการเก็บข้อมูลภายในหรือมีข้อกำหนดการคอมไพลอันซ์ ตัว orchestration และ analytics DB สามารถรันภายในเครือข่ายองค์กร ขณะที่ model connectors อาจใช้ proxy หรือ gateway เพื่อเรียก LLM ภายนอกอย่างปลอดภัย (หรือเชื่อมต่อกับ private LLM ในองค์กร)

สุดท้าย ควรมีมาตรการด้านความปลอดภัย เช่น credential vaulting, per‑tenant rate limiting, และ auditing trail สำหรับทุกคำขอ เพื่อให้การทดลองพรอมต์แบบ A/B สามารถขยายผล เชื่อถือได้ และลดต้นทุนต่อแคมเปญได้ตามเป้าหมาย (รายงานภายในพบว่าการปรับเวิร์กโฟลว์และการเลือกโมเดลที่เหมาะสมสามารถลดต้นทุนต่อแคมเปญได้ถึง 30%)

คู่มือทีละขั้นตอน: ตั้งค่า A/B Prompt Test สำหรับแคมเปญ

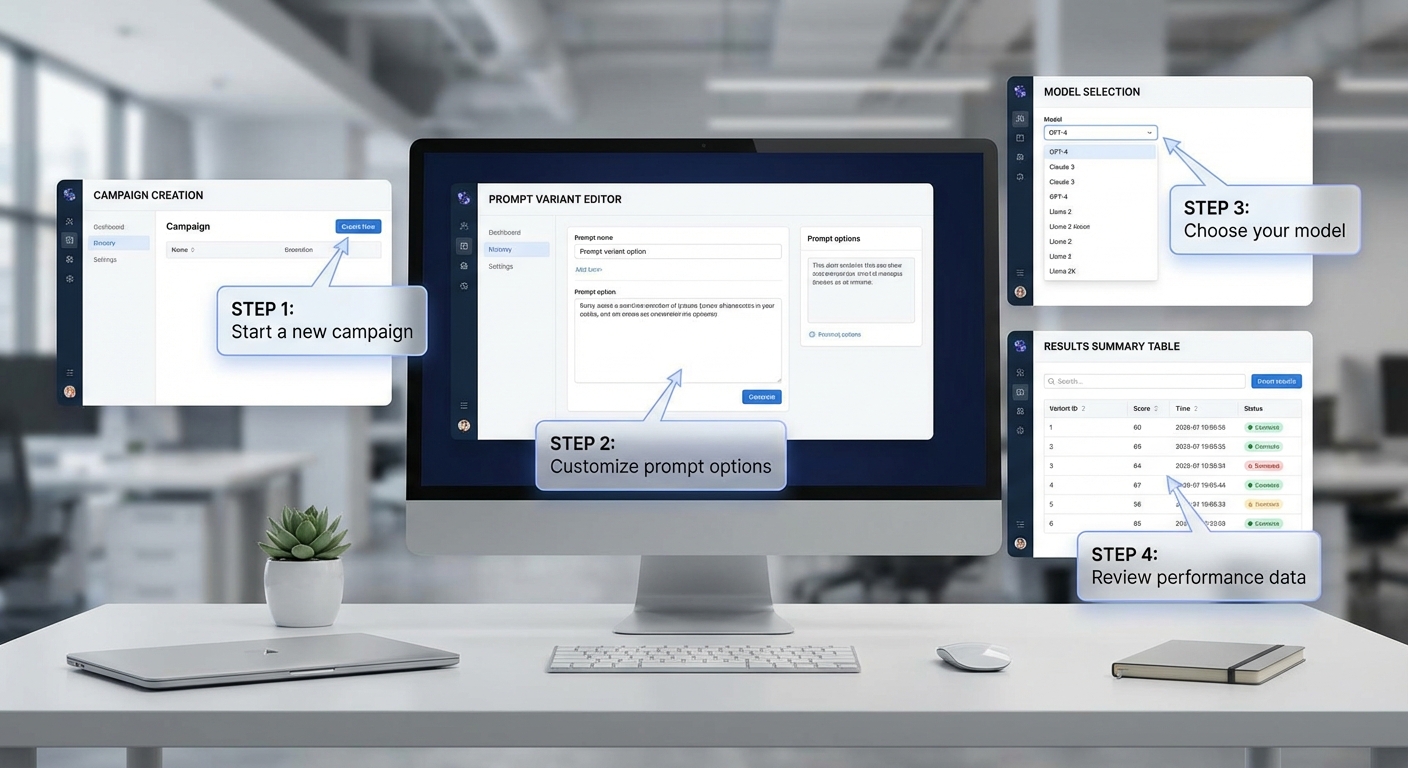

บทความนี้เป็นคู่มือเชิงปฏิบัติสำหรับการตั้งค่า A/B Prompt Test บน Prompt‑Ops Studio โดยมุ่งเน้นให้ทีมการตลาดสามารถทดสอบเวอร์ชันพรอมต์และเลือก model version พร้อมติดตามค่า Token‑Cost แบบเรียลไทม์ เพื่อให้ตัดสินใจได้ทั้งจากผลลัพธ์เชิงประสิทธิภาพ (เช่น CTR, conversion) และเชิงต้นทุน (เช่น token‑cost ต่อ conversion) — โดยขั้นตอนต่อไปนี้เป็นแนวทางปฏิบัติที่ใช้ได้จริงกับแคมเปญโฆษณา อีเมล หรือข้อความตอบกลับอัตโนมัติ

ภาพรวมขั้นตอนหลัก

- สร้างแคมเปญ ใน Prompt‑Ops Studio และตั้งเป้าหมาย (objective)

- สร้าง variants ของพรอมต์ (A/B หรือมากกว่า) พร้อมเลือก model version และขนาดโมเดล

- ตั้งกลุ่มตัวอย่าง (segmentation & sampling) ระบุขนาดตัวอย่างและวิธีสุ่ม

- กำหนด KPI และงบประมาณ token limit ตั้งค่า thresholds สำหรับการตัดสิน

- เริ่มรันทดสอบ และติดตามผลแบบเรียลไทม์ จากนั้นวิเคราะห์เพื่อเลือกผู้ชนะ

ขั้นตอนที่ 1 — สร้างแคมเปญใหม่

ในหน้า Dashboard เลือกเมนู Create Campaign ตั้งชื่อแคมเปญ ระบุช่องทาง (เช่น Email / Landing Page / Chatbot) และวัตถุประสงค์เชิงธุรกิจ เช่น "เพิ่ม CTR บนหน้าโปรโมชั่น 20%" หรือ "ลด CPA ลง 15%". กำหนดระยะเวลาทดสอบ (เช่น 7–14 วัน) และตั้งค่า timezone/ภาษาให้ตรงกับกลุ่มเป้าหมาย.

ขั้นตอนที่ 2 — สร้าง Variants ของพรอมต์และเลือก Model Version

สร้างอย่างน้อย 2 variant (A และ B) ในแคมเปญเดียวกัน โดยแต่ละ variant จะประกอบด้วย:

- พรอมต์ (Prompt) — ข้อความที่ส่งให้โมเดล

- Model version — ตัวอย่างเช่น gpt-4o (ใหญ่) กับ gpt-3.5-turbo (ขนาดกลาง) หรือเวอร์ชันภายใน Prompt‑Ops Studio เช่น v1.2 / v2.0

- การตั้งค่าทางเทคนิค — เช่น temperature, max_tokens และ stop sequences

ตัวอย่างการตั้งชื่อ variant: "A — Concise / small model", "B — Contextualized / large model".

ตัวอย่างพรอมต์จริง (Concise vs Contextualized)

ด้านล่างเป็นตัวอย่างพรอมต์สองแบบที่ควรทดสอบ เพื่อดูผลลัพธ์เชิงประสิทธิภาพและต้นทุน:

-

Variant A — Concise Prompt (ประหยัด token)

Prompt: "Write a 20‑word promotional headline for a 20% off sale on wireless earbuds. Include call-to-action." -

Variant B — Contextualized Prompt (มีบริบทเพิ่ม)

Prompt: "Customer profile: 25–34, tech‑savvy, urban. Product: wireless noise‑cancelling earbuds with 24‑hour battery life. Write a persuasive 40–60 word promotional headline and one sentence CTA that highlights 20% off and free shipping." -

Variant C (ตัวเลือก) — Personalization Prompt

Prompt: "Given customer data {first_name, recent_category_viewed='headphones'}, generate a personalized subject line and 25‑word preview text emphasizing 20% discount on wireless earbuds."

การเลือก model size: หากต้องการประหยัดต้นทุนลองใช้โมเดลขนาดกลางสำหรับ Variant A (fewer tokens/cheaper per 1K tokens) และโมเดลขนาดใหญ่สำหรับ Variant B เพื่อวัดผล trade‑off ระหว่างคุณภาพและค่าใช้จ่าย

ขั้นตอนที่ 3 — ตั้งกลุ่มตัวอย่าง (Sampling & Allocation)

กำหนดขนาดตัวอย่างโดยอิงจากเป้าหมายความแม่นยำทางสถิติและอัตรา Conversion ที่คาดการณ์ ตัวอย่างเช่น:

- คาด CTR ประมาณ 5% → หากต้องการความน่าเชื่อถือระดับ 95% อาจต้องใช้ตัวอย่าง ~3,000–5,000 impressions ต่อ variant (ค่าประมาณ)

- สำหรับ conversion ที่หายากกว่า (เช่น 1%) อาจต้องตัวอย่างมากขึ้น — >10,000 ต่อ variant

ใน Prompt‑Ops Studio เลือกวิธีสุ่ม (random allocation) หรือ stratified sampling (แบ่งตามกลุ่มอายุ/ภูมิภาค) และกำหนดสัดส่วนการแจกจ่าย (เช่น 50/50 หรือ 40/40/20 สำหรับ 3 variants).

ขั้นตอนที่ 4 — กำหนด KPI และตั้งงบประมาณ Token Limit

ตั้ง KPI หลักและรอง เช่น:

- Primary KPI: CTR หรือ Conversion Rate

- Secondary KPI: Engagement Time, Reply Rate, Click‑to‑Conversion

- Cost KPI: Token‑Cost ต่อ 1,000 impressions หรือ Token‑Cost ต่อ Conversion

ตั้ง token budget ทั้งระดับแคมเปญและต่อ‑variant เช่น: จำกัดที่ 500,000 tokens ต่อ variant หรือกำหนดค่าใช้จ่ายสูงสุดเช่นไม่เกิน $200 ต่อ variant (แปลงจากราคา token ต่อ 1K ที่บริษัทใช้). Prompt‑Ops Studio จะหยุดเรียกโมเดลอัตโนมัติเมื่อถึงขีดจำกัดเพื่อป้องกันค่าใช้จ่ายบานปลาย.

ขั้นตอนที่ 5 — เริ่มรัน (Run) และติดตามผลแบบเรียลไทม์

เมื่อทุกอย่างพร้อม ให้กด Start Test ระบบจะเริ่มส่งแต่ละ variant ไปยังกลุ่มตัวอย่างที่กำหนด และรวบรวมข้อมูล KPI รวมถึงการใช้ token แบบเรียลไทม์ ผู้ใช้สามารถดูแดชบอร์ดที่แสดง:

- CTR / conversion ต่อ variant แบบ real‑time

- Token usage / second และค่าใช้จ่ายสะสม (token‑cost)

- Estimated cost per conversion และการเปรียบเทียบ ROI ระหว่าง variants

การอ่านผลลัพธ์เบื้องต้นและการตัดสินใจ

เมื่อได้ข้อมูลเพียงพอ ให้ตรวจสอบองค์ประกอบดังนี้:

- ความแตกต่างทางสถิติ: ดูค่า p‑value หรือ confidence interval — ควรตั้งเกณฑ์เช่น p < 0.05 เพื่อยืนยันผล

- ความคุ้มค่า: แม้ variant B อาจมี CTR สูงกว่า แต่ถ้าค่า token‑cost ต่อ conversion สูงกว่า variant A มากกว่า 20–30% อาจไม่คุ้มค่าที่จะเลือกใช้

- เวลาและความต่อเนื่อง: ตรวจสอบว่าผลไม่เปลี่ยนแปลงตามช่วงเวลา (time decay) หรือตามเซ็กเมนต์ลูกค้าที่ต่างกัน

กฎปฏิบัติ: เลือก variant ที่ชนะเมื่อมีทั้งความแตกต่างทางสถิติและความคุ้มค่าทางการเงิน (เช่นลด token‑cost ต่อ conversion อย่างน้อย 10–15% ขึ้นไป) — หากต้องการลดต้นทุนต่อแคมเปญให้ได้ตามเป้า (เช่น 30%) ให้สังเกต token‑cost เป็นตัวชี้วัดหลักควบคู่กับ KPI การตลาด

ตัวอย่างผลลัพธ์ที่คาดหวัง (Illustrative)

- Variant A (Concise / small model): CTR 4.8%, token usage 120 tokens/call, token‑cost ต่อ conversion = $1.20

- Variant B (Contextualized / large model): CTR 5.6%, token usage 300 tokens/call, token‑cost ต่อ conversion = $1.80

- สรุป: แม้ Variant B เพิ่ม CTR 0.8pp แต่มี token‑cost ต่อ conversion สูงกว่า 50% → หากงบจำกัด เลือก Variant A หรือทดลอง hybrid (concise + selective large model สำหรับ high‑value users)

บทสรุป: กระบวนการ A/B Prompt Test บน Prompt‑Ops Studio ควรผสานการวัดผลเชิงคุณภาพ (CTR/Conversion) กับเชิงต้นทุน (token‑cost) เพื่อให้การตัดสินใจมีเหตุผลทางธุรกิจจริง การตั้งค่า sample size, KPI และ token limits ที่รัดกุมจะช่วยลดความเสี่ยงของค่าใช้จ่ายที่ไม่จำเป็น และเพิ่มโอกาสลดต้นทุนต่อแคมเปญได้ตามเป้า เช่น เครื่องมือของสตาร์ทอัพไทยรายนี้ช่วยให้ลูกค้าบางรายลดต้นทุนต่อแคมเปญได้ถึง 30% เมื่อเทียบกับการเรียกใช้โมเดลขนาดใหญ่อย่างไม่คัดกรอง

การติดตาม Token‑Cost แบบเรียลไทม์และการวิเคราะห์ค่าใช้จ่าย

การติดตาม Token‑Cost แบบเรียลไทม์: แนวทางการเก็บข้อมูลและการวัดผล

การติดตามการใช้ Token และต้นทุนในแบบเรียลไทม์เริ่มต้นจากการ Instrumentation ที่ฝังอยู่ในชั้น API Gateway หรือใน SDK ของระบบ Prompt‑Ops Studio โดยทุกคำขอ (request) ต้องบันทึกข้อมูลสำคัญ ได้แก่ token_used (รวมทั้ง input และ output), model_id, price_per_token_by_model, timestamp, และ campaign_id การเก็บข้อมูลแบบนี้ช่วยให้เราคำนวณต้นทุนต่อคำขอและรวบรวมเป็นต้นทุนต่อแคมเปญได้ทันทีเมื่อต้องการ

สำหรับการอัปเดตแบบเรียลไทม์ สามารถใช้สถาปัตยกรรมที่รองรับ streaming เช่น WebSocket หรือ event bus (Kafka, Kinesis) เพื่อส่ง metric ไปยัง timeseries DB / monitoring system (เช่น Prometheus/InfluxDB) และแสดงผลบน dashboard ที่รีเฟรชแบบ streaming การแสดงผลควรแยกเป็นมุมมองทั้งระดับคำขอ (per‑request), ระดับโมเดล (per‑model) และระดับแคมเปญ (per‑campaign) เพื่อให้ทีมการตลาดสามารถติดตาม burn‑rate ได้ตลอดเวลา

สูตรคำนวณต้นทุนและตัวอย่างตัวเลข

สูตรพื้นฐานที่ใช้คำนวณต้นทุนของการเรียกใช้โมเดลคือ:

- Total Token Cost = Σ(token_used_per_request * price_per_token_by_model)

ตัวอย่างเชิงตัวเลข: สมมติแคมเปญหนึ่งมีคำขอ 3 แบบ ดังนี้

- Request A: token_used = 3,000; model_small price = $0.00002/token → cost = 3,000 * 0.00002 = $0.06

- Request B: token_used = 1,200; model_large price = $0.00020/token → cost = 1,200 * 0.00020 = $0.24

- Request C: token_used = 800; model_small price = $0.00002/token → cost = 800 * 0.00002 = $0.016

ดังนั้น Total Token Cost (แคมเปญ) = $0.06 + $0.24 + $0.016 = $0.316

หากแคมเปญมี 10,000 คำขอแบบ A, 2,000 แบบ B และ 5,000 แบบ C คำนวณแบบรวม:

- Cost_A = 10,000 * 3,000 * 0.00002 = $600 (โปรดสังเกตว่าต้องรวม token ต่อคำขอกับจำนวนคำขอ)

- Cost_B = 2,000 * 1,200 * 0.00020 = $480

- Cost_C = 5,000 * 800 * 0.00002 = $80

รวมทั้งหมด = $1,160 ต่อแคมเปญ (ตัวอย่างนี้ใช้เพื่ออธิบายการคูณเชิงปริมาณและสรุปต้นทุนแบบรวม)

กลยุทธ์ลดค่าใช้จ่ายที่ได้ผล

การลดค่า Token‑Cost มีหลายแนวทางที่สามารถนำมาปรับใช้ร่วมกันเพื่อให้ได้ผลลัพธ์สูงสุด ตัวอย่างสำคัญได้แก่:

- Model selection: ใช้โมเดลขนาดเล็กสำหรับงานที่ไม่ต้องการความซับซ้อนสูง เช่น persuasive copy หรือการสร้างหัวข้อโฆษณา ในขณะที่สำรองโมเดลขนาดใหญ่ไว้สำหรับงานที่ต้องการความเข้าใจเชิงลึกหรือการวิเคราะห์เชิงซับซ้อน

- Prompt compacting / Prompt engineering: ย่อ prompt ให้กระชับขึ้นโดยเก็บบริบทสำคัญไว้เป็น template หรือ reference แยกต่างหาก ใช้ placeholders แทนการใส่ข้อมูลซ้ำซ้อน และจำกัดค่า max_tokens ของผลลัพธ์ให้เหมาะสม เพื่อลด token waste

- Batch processing: รวมหลายคำขอที่ลักษณะคล้ายกันเข้าเป็น batch เดียว เพื่อลด overhead เช่น หากมีการขอ copy 1,000 เวอร์ชันที่ต่างกันเล็กน้อย อาจส่งเป็น batch request หรือใช้ multi‑input endpoint ช่วยลดจำนวน prompt overhead

- Caching ผลลัพธ์: เก็บผลลัพธ์ของ prompt ที่ซ้ำกันหรือคล้ายกันไว้ใน cache (พร้อม TTL และ cache key ที่ออกแบบดี) เพื่อหลีกเลี่ยงการเรียกโมเดลซ้ำสำหรับคำถามเดิม เช่น ผลลัพธ์สำหรับ headline template ที่มีการใช้งานซ้ำ

- Token budgeting per campaign: ตั้งค่า default limits เช่น ห้ามใช้เกิน X tokens/วัน/แคมเปญ และบังคับให้คำขอที่เกินต้องผ่านการอนุมัติ

การตั้งค่า Alert และ Dashboard KPI เพื่อควบคุมงบแบบเรียลไทม์

การตั้งค่า alert ควรทำในหลายชั้นเพื่อป้องกันการ overspend: ตั้งค่า threshold แบบ step‑up เช่น 60% (inform), 80% (warning), 100% (critical) ของงบประมาณแคมเปญ นอกจากนี้ควรกำหนดกฎการตอบสนองเมื่อถึงแต่ละ threshold เช่น ส่ง Slack/Email, เปิด ticket อัตโนมัติ หรือสั่งลดความละเอียดของโมเดล/หยุดการรันแคมเปญชั่วคราว

องค์ประกอบสำคัญของ dashboard KPI ที่ควรแสดงแบบเรียลไทม์ ได้แก่:

- Current Burn Rate: tokens หรือ USD ต่อชั่วโมง/วัน

- Estimated End‑of‑Period Cost: การพยากรณ์ต้นทุนจนสิ้นแคมเปญโดยใช้ burn trajectory ปัจจุบัน

- Cost per Conversion / Cost per Lead: ต้นทุน Token ต่อ KPI ทางธุรกิจ เช่น ค่าใช้จ่ายต่อลูกค้าที่แปลง

- Top Token Consumers: รายการคำขอหรือโมเดลที่ใช้ token มากที่สุด (ช่วยระบุจุดปรับปรุง)

- Requests per Model & Avg Tokens per Request: เพื่อการตัดสินใจเรื่อง model selection

เชื่อมต่อ alerts กับระบบ orchestration เพื่อให้สามารถทำ action อัตโนมัติได้ เช่น ลดโมเดลลงเป็นรุ่นประหยัด, ลด max_tokens, หรือ pause แคมเปญ เมื่อถึงค่า critical ทั้งนี้ควรกำหนด cooldown และ manual override เพื่อป้องกัน false positive

ตัวอย่างการลดค่าใช้จ่ายเชิงปฏิบัติ: ก่อน/หลัง

สมมติแคมเปญเดิมมีค่าใช้จ่าย $2,500 ต่อเดือน โดยใช้โมเดลขนาดใหญ่กับ prompt ที่ยาวและไม่มี caching หลังจากปรับใช้กลยุทธ์ 4 ข้อ (model selection, prompt compacting, batching, caching) ค่าใช้จ่ายลดลงเป็น $1,750 ต่อเดือน

- การเลือกโมเดล: ลดการเรียกโมเดลขนาดใหญ่ลง 50% → ประหยัด $400

- Prompt compacting: ลด avg tokens/req ลง 30% → ประหยัด $250

- Caching + Batching: ลดการเรียกซ้ำและ overhead → ประหยัด $100

สรุปผลลด = ($2,500 − $1,750) / $2,500 = 30% ซึ่งสอดคล้องกับเป้าหมายการลดต้นทุนต่อแคมเปญ

โดยสรุป การติดตาม Token‑Cost แบบเรียลไทม์ต้องอาศัยการเก็บ metric ที่ละเอียด การแสดงผลบน dashboard ที่ชัดเจน และกลไก alert‑to‑action ที่ตอบสนองได้ทันที พร้อมกับการออกแบบ prompt และ workflow ที่คำนึงถึงประสิทธิภาพของ token ตั้งแต่ต้นทางถึงปลายทาง เพื่อให้ต้นทุนถูกควบคุมโดยไม่กระทบต่อผลลัพธ์ทางธุรกิจ

กรณีศึกษา: ตัวอย่างจริงที่ลดต้นทุนต่อแคมเปญได้ถึง 30%

กรณีศึกษา: ตัวอย่างจริงที่ลดต้นทุนต่อแคมเปญได้ถึง 30%

ในกรณีศึกษานี้ เรานำเสนอผลลัพธ์จากสตาร์ทอัพการตลาดดิจิทัลในประเทศไทย (ขอยกตัวอย่างชื่อสมมติว่า AdNova) ซึ่งใช้ Prompt‑Ops Studio เพื่อทดสอบพรอมต์แบบ A/B ปรับเลือกโมเดล และติดตามค่า Token‑Cost แบบเรียลไทม์ ผลการเปลี่ยนแปลงถูกติดตามในแคมเปญโฆษณาช่วงโปรโมชันเดือนเดียว ตัวชี้วัดสำคัญก่อนและหลังใช้เครื่องมือถูกวัดเทียบกันอย่างชัดเจนเพื่อประเมินผลกระทบเชิงธุรกิจ

ข้อมูลก่อนใช้ Prompt‑Ops Studio (ฐานข้อมูลตัวอย่าง) — แคมเปญทดลองมีจำนวนการแสดงผล 100,000 ครั้ง ผลลัพธ์สำคัญคือ CTR = 1.8% (คลิก 1,800 ครั้ง), Conversion rate = 2.0% (36 รายการแปลง), การใช้โทเค็นรวม = 2,500,000 tokens, ค่าใช้จ่ายด้านโทเค็น = 12,500 บาท, ค่าใช้จ่ายโฆษณาอื่นๆ = 187,500 บาท รวมเป็น ต้นทุนต่อแคมเปญรวม 200,000 บาท ซึ่งให้ผลลัพธ์เป็น Revenue สมมติ 288,000 บาท (สมมติ AOV = 8,000 บาท) ทำให้ ROAS = 1.44 และค่าใช้จ่ายด้านโทเค็นต่อ Conversion ≈ 347 บาท

มาตรการปรับปรุงที่นำมาใช้ผ่าน Prompt‑Ops Studio — ทีมใช้ฟีเจอร์ A/B testing เพื่อเปรียบเทียบสองชุดพรอมต์ (Creative‑A กับ Creative‑B) พร้อมกันทั้งในระดับคำสั่งและพารามิเตอร์โมเดล (เช่นขนาดโมเดล, max_tokens, temperature) ผลการทดสอบชี้ชัดว่า Creative‑B ให้ CTR สูงกว่าและมี Conversion Rate ดีขึ้น นอกจากนี้ทีมได้เปลี่ยนมาใช้โมเดลที่มีต้นทุนโทเค็นต่อคำตอบต่ำกว่า (lighter model) สำหรับ workflow บางส่วน และนำแนวทาง prompt engineering เช่นการย่อความ (truncation), templating, และ caching ของผลคำตอบที่ซ้ำซ้อนไปใช้ เพื่อลดการใช้โทเค็นที่ไม่จำเป็น (token wastage)

ผลลัพธ์หลังใช้งาน (ตัวเลขเปรียบเทียบ) — หลังปรับปรุงโดยรวม ตัวชี้วัดเปลี่ยนไปดังนี้: CTR เพิ่มจาก 1.8% → 2.2% (เพิ่ม 22%), Conversion rate เพิ่มจาก 2.0% → 2.6% (เพิ่ม 30%) ส่งผลให้จำนวน conversions เพิ่มจาก 36 → 57 ราย; การใช้โทเค็นลดจาก 2,500,000 → 1,600,000 tokens (ลด 36%), ค่าใช้จ่ายด้านโทเค็นลดจาก 12,500 → 8,000 บาท (ลด 36%); ค่าใช้จ่ายโฆษณาอื่นๆ ลดเล็กน้อยจากการปรับประสิทธิภาพ (จาก 187,500 → 132,000 บาท) ทำให้ ต้นทุนต่อแคมเปญรวมลดจาก 200,000 → 140,000 บาท หรือคิดเป็นการลดลงประมาณ 30%

คำนวณเชิงตัวเลขเพิ่มเติม: ค่าใช้จ่ายโทเค็นต่อ Conversion ลดจาก ≈347 บาท → ≈140 บาท (ลดราว 60%), ต้นทุนต่อ Conversion ทั้งหมดลดจาก ≈5,556 บาท → ≈2,456 บาท (ลดราว 56%). ในเชิงรายได้โดยสมมติ (AOV = 8,000 บาท) รายได้รวมเพิ่มจาก 288,000 → 456,000 บาท ทำให้ ROAS เพิ่มจาก 1.44 → 3.26 และอัตราผลตอบแทนโดยรวม (ROI) เพิ่มขึ้นอย่างมีนัยสำคัญ

การแจกแจงผลประหยัด — ทีมวิเคราะห์ว่าเหตุผลหลักที่ทำให้ต้นทุนต่อแคมเปญลดลงประมาณ 25–30% มาจาก 1) การลดการใช้โทเค็นโดยตรงจากการปรับโมเดลและการ optimize พรอมต์ (คิดเป็นสัดส่วนประหยัดประมาณ 55% ของการประหยัดทั้งหมด), 2) การเพิ่มประสิทธิภาพด้านคอนเวอร์ชันจาก A/B testing ของครีเอทีฟ (คิดเป็นสัดส่วนประมาณ 35%), และ 3) การลดค่าใช้จ่ายปลีกย่อยจาก caching และลดการเรียก API ซ้ำ (ประมาณ 10%)

บทเรียนที่ได้

- วัดค่าโทเค็นเป็น KPI เชิงต้นทุน: การติดตาม token‑cost แบบเรียลไทม์ทำให้ทีมตัดสินใจเปลี่ยนโมเดลและปรับพรอมต์ได้รวดเร็ว ลดการรั่วไหลของต้นทุนอย่างมีนัยสำคัญ

- A/B testing ต้องรวมทั้งครีเอทีฟและพารามิเตอร์โมเดล: การแยกทดสอบเฉพาะครีเอทีฟหรือเฉพาะโมเดลเพียงอย่างเดียวมักมองไม่เห็นผลร่วมกัน — Prompt‑Ops Studio ช่วยผสานการทดสอบทั้งสองมิติได้อย่างเป็นระบบ

- การออกแบบพรอมต์มีผลต่อทั้งคุณภาพและต้นทุน: การย่อคำสั่ง การ reuse template และการตั้ง max_tokens ให้เหมาะสมลด token wastage ได้โดยไม่ลดคุณภาพของคำตอบ

- ควรตั้ง baseline และวัดผลเป็นอัตราส่วน: การเปรียบเทียบก่อน/หลังด้วยตัวชี้วัดเช่น CTR, Conversion rate, token per response และ token cost per conversion ช่วยประเมินผลเชิงธุรกิจได้ชัดเจน

สรุป: กรณีศึกษาของ AdNova แสดงให้เห็นว่าเมื่อนำ Prompt‑Ops Studio มาใช้ร่วมกับกระบวนการ A/B testing แบบครบวงจร การเลือกโมเดลให้เหมาะสม และการลด token wastage จะสามารถลดต้นทุนต่อแคมเปญได้ถึงประมาณ 25–30% พร้อมทั้งเพิ่มประสิทธิภาพการแปลงผู้ใช้และ ROAS อย่างมีนัยสำคัญ — ผลลัพธ์ที่เกิดขึ้นสามารถนำไปใช้เป็นแนวทางปฏิบัติที่แนะนำสำหรับสตาร์ทอัพหรือทีมมาร์เก็ตติ้งที่ต้องการควบคุมค่าใช้จ่ายจากการใช้โมเดลภาษาในแคมเปญเชิงพาณิชย์

แนวทางปฏิบัติที่ดีที่สุด ความปลอดภัย และการวัดผลผลลัพธ์

แนวทางปฏิบัติที่ดีที่สุด: Governance ของพรอมต์และการจัดการเวอร์ชัน

การบริหารจัดการพรอมต์ (prompt governance) เป็นหัวใจสำคัญของระบบ Prompt‑Ops Studio ที่ต้องการความโปร่งใสและสามารถย้อนกลับได้เมื่อเกิดผลลัพธ์ที่ไม่คาดคิด โดยควรนำหลักการ prompt versioning มาใช้เป็นมาตรฐาน เช่น การตั้งเลขเวอร์ชันแบบ Semantic (v1.0.0), การบันทึกเมตาดาต้า (author, date, model-config, temperature, max_tokens) และไฟล์ changelog ที่เชื่อมกับระบบทดลอง A/B อัตโนมัติ เพื่อให้ทีมการตลาดและทีมเทคนิคสามารถตรวจสอบว่าแคมเปญใดใช้พรอมต์เวอร์ชันใดในการวัดผล

นอกจากนี้ควรบังคับใช้ access control แบบ Role‑Based Access Control (RBAC) และนโยบาย least privilege: นักการตลาดอาจมีสิทธิสร้างและรันทดลอง แต่การอนุมัติการปล่อยสู่ production และการแก้ไขพรอมต์หลักต้องผ่านผู้ตรวจสอบทางเทคนิคหรือ Data Governance Lead อย่างน้อยหนึ่งคน ควรผนวก multi‑factor authentication (MFA) และการแยก environment (dev/stage/prod) เพื่อจำกัดการเข้าถึงข้อมูลที่มีความเสี่ยง

ระบบต้องรักษา audit log ที่ไม่สามารถแก้ไขย้อนหลังได้ (immutable audit trail) เพื่อเก็บประวัติการเปลี่ยนแปลงพรอมต์ การรันทดลอง การเข้าถึงข้อมูล และการแก้ไขค่า configuration รายการ log ควรมี retention policy ที่สอดคล้องกับข้อกำหนดทางกฎหมาย เช่น อย่างน้อย 1–3 ปี และต้องสามารถดึงรายงานสำหรับการตรวจสอบภายในหรือการสอบสวนเหตุการณ์ได้โดยรวดเร็ว

ความปลอดภัยของข้อมูล: การปกป้อง PII และการปฏิบัติตาม PDPA

เมื่อระบบทำงานกับข้อมูลลูกค้า ต้องออกแบบการจัดการข้อมูลที่เป็นความลับตั้งแต่ต้นทางถึงปลายทาง (end‑to‑end). ใช้แนวทาง data masking และ tokenization สำหรับข้อมูลระบุตัวบุคคล (PII) เช่น ชื่อ หมายเลขบัตร ประวัติการซื้อ โดยพรอมต์ที่ส่งไปยังโมเดลไม่ควรประกอบด้วยข้อมูล PII ที่สามารถย้อนกลับได้โดยตรง

การปฏิบัติตาม PDPA ควรรวมถึง: การเก็บหลักฐานการยินยอม (consent records), การจำกัดการใช้เพื่อวัตถุประสงค์ที่ชัดเจน, การกำหนดระยะเวลาเก็บข้อมูล (data retention) และการประเมินผลกระทบด้านข้อมูลส่วนบุคคล (DPIA) เมื่อเปิดตัวฟีเจอร์ใหม่ ตัวอย่างเช่น หากระบบต้องการใช้ประวัติการซื้อเพื่อปรับพรอมต์ ต้องมี consent เฉพาะและแจ้งให้ผู้ใช้ทราบว่าข้อมูลถูกนำไปใช้เพื่อลักษณะใด

เทคนิคเพิ่มเติมที่แนะนำได้แก่การใช้ differential privacy สำหรับการวิเคราะห์เชิง aggregate, การเข้ารหัสข้อมูลขณะพักและขณะส่ง (encryption at rest/in transit), และการจำกัดการส่งข้อมูลไปยัง third‑party APIs โดยการกรอง/มาสก์ค่าที่เป็น sensitive ก่อนส่ง รวมถึงการตรวจสอบว่าผู้ให้บริการโมเดลภายนอกมีมาตรการคุ้มครองข้อมูลสอดคล้องกับ PDPA

วงจรการทดลอง (Experiment Lifecycle) และ checklist สำหรับการ deployment

กำหนด lifecycle ของการทดลองอย่างชัดเจน: Define → Instrument → Run → Analyze → Decide → Rollout/Abort. ในขั้นตอน Define ให้ระบุ hypothesis, primary/secondary metrics, และเกณฑ์ความสำเร็จ (เช่น uplift ≥ 5% และ p‑value < 0.05). ระหว่าง Instrument ต้องใส่ telemetry เพียงพอเพื่อจับ token‑cost, response latency, conversion funnel และ error rate

- Pre‑deployment checklist:

- Code & prompt review ผ่าน peer review และ security review

- Unit/integration test สำหรับ pipeline และ mocking ของโมเดล

- ตรวจสอบการมาสก์ PII และการไหลของข้อมูล (data flow audit)

- กำหนด rollback plan และ feature flag เพื่อปล่อยแบบ canary

- ตั้ง error budget และ SLO สำหรับ latency และ success rate

- During experiment checklist:

- ตรวจสอบ sample size และ randomization เพื่อหลีกเลี่ยง bias

- monitor real‑time token‑cost และ budget burn rate

- ตั้ง alert หากค่า token‑cost เกิน threshold หรือ error rate สูง

- Post‑experiment checklist:

- การวิเคราะห์ผลแบบมีนัยสำคัญทางสถิติและการวิเคราะห์ segment

- บันทึก lessons learned และอัปเดต prompt changelog

- อัปเดต governance records และการอนุมัติสำหรับ rollout

การวัดผลและ KPI ระยะยาวที่ควรติดตาม

การวัดผลควรครอบคลุมทั้งมิติการเงิน ประสิทธิภาพธุรกิจ และความเสถียรของระบบ โดยแนะนำ KPI ระยะยาวหลักดังนี้:

- Cost per Acquisition (CPA): ติดตามต้นทุนต่อการได้มาซึ่งลูกค้าโดยรวมที่รวมค่า token‑cost ของการใช้งานโมเดลในแคมเปญ ตัวอย่างเป้าหมายคือการลด CPA ลง 10–30% เทียบกับ baseline หลังปรับใช้พรอมต์ใหม่

- Lifetime Value (LTV): ประเมินผลกระทบของการปรับพรอมต์ต่อมูลค่าลูกค้าในระยะยาว เพื่อให้แน่ใจว่าการลดค่าใช้จ่ายระยะสั้นไม่กระทบต่อ LTV

- Experiment Velocity: จำนวนทดลองที่สามารถรันและวิเคราะห์ได้ต่อสัปดาห์/ต่อเดือน — ทีมที่มีประสิทธิภาพมักตั้งเป้า 2–8 experiments ต่อสัปดาห์ ขึ้นกับขนาดข้อมูลและความซับซ้อนของการทดลอง

- Uptime และ SLO: เป้าหมาย uptime ของ Prompt‑Ops Studio ควรเป็นอย่างน้อย 99.9% สำหรับ production endpoints และต้องมีการตรวจวัด latency median/95th percentile เพื่อรักษาประสบการณ์ผู้ใช้งาน

- Token‑Cost per Response และ Budget Burn Rate: ติดตามแบบเรียลไทม์เพื่อให้สามารถปรับ temperature, max_tokens หรือเลือกโมเดลที่เหมาะสมเพื่อลดค่าใช้จ่ายโดยไม่ลดคุณภาพผลลัพธ์

- Conversion Rate Uplift และ ROI: วัด uplift ที่เกิดจากแต่ละเวอร์ชันพรอมต์และคำนวณ ROI ของการทดลองเพื่อเลือกการลงทุนในสเกลถัดไป

ตัวอย่างเชิงตัวเลข: หากระบบรายงานว่าการปรับพรอมต์และเลือกโมเดลที่เหมาะสมสามารถลด token‑cost per campaign ลง 30% และทำให้ CPA ลดลง 15% ในขณะที่ LTV เพิ่มขึ้น 8% ถือว่าเป็นสัญญาณเชิงบวกในการขยายการใช้งานไปยังแคมเปญอื่น ๆ อย่างไรก็ตาม ควรติดตามผลในมุมมอง cohort และระยะยาวเพื่อป้องกันผลลัพธ์ที่เป็น transient หรือเกิดจากการสุ่ม

สรุปคือการควบคุม governance ที่เข้มแข็ง การปกป้องข้อมูลตาม PDPA การออกแบบวงจรการทดลองที่มีมาตรฐาน และการเลือก KPI ระยะยาวที่ชัดเจน จะช่วยให้ Prompt‑Ops Studio ให้ผลลัพธ์เชิงธุรกิจที่ยั่งยืน ลดความเสี่ยงด้านความปลอดภัย และขับเคลื่อนนวัตกรรมในทีมการตลาดได้อย่างมั่นคง

บทสรุป

Prompt‑Ops Studio ช่วยเติมช่องว่างระหว่างทีมการตลาดและทีมเทคนิคโดยทำให้การทดสอบพรอมต์เป็นระบบ ชัดเจน และสามารถจัดการค่าใช้จ่ายได้อย่างมีประสิทธิภาพ แพลตฟอร์มออกแบบกระบวนการทดลองแบบ A/B ที่รองรับการเปรียบเทียบทั้งเวอร์ชันพรอมต์และเวอร์ชันของโมเดล พร้อมฟีเจอร์ติดตาม Token‑Cost แบบเรียลไทม์ ทำให้ทีมการตลาดที่ไม่มีพื้นฐานด้านวิศวกรรมสามารถรันการทดลอง วัดผลเชิงธุรกิจ และปรับกลยุทธ์ตามข้อมูลจริงได้ทันที ผลลัพธ์จากแนวทางนี้ชี้ให้เห็นว่าทีมการตลาดสามารถลดต้นทุนต่อแคมเปญได้สูงสุดราว 30% เมื่อปฏิบัติตามการออกแบบ A/B ที่เหมาะสมและเฝ้าติดตามค่า Token‑Cost ตามแนวทางที่เสนอ (ตัวอย่างเช่น การเลือกพรอมต์ที่ให้ผลลัพธ์ชัดเจนแต่ใช้ Token น้อยกว่า หรือลดการเรียกใช้โมเดลเวอร์ชันสูงในช่วงทดลองที่ไม่จำเป็น)

มองไปข้างหน้า Prompt‑Ops Studio มีศักยภาพที่จะขยายบทบาทเป็นส่วนหนึ่งของสแต็กการปฏิบัติการ AI (AI/MLOps) สำหรับการตลาด โดยรวมถึงการเชื่อมต่อกับระบบข้อมูลลูกค้า การวางนโยบายการใช้โมเดล และการทำงานร่วมกับหลายผู้ให้บริการโมเดลเพื่อปรับสมดุลระหว่างประสิทธิภาพและต้นทุน ในแง่การนำไปใช้จริง องค์กรควรให้ความสำคัญกับการกำหนดเกณฑ์การวัดผลที่ชัดเจน การตั้งค่าการทดลอง A/B ที่มีสมมติฐานชัดเจน และการใช้ข้อมูล Token‑Cost เป็นหนึ่งในตัวชี้วัดสำคัญ สิ่งเหล่านี้จะช่วยให้การตัดสินใจเชิงยุทธศาสตร์มีความแม่นยำมากขึ้น ลดความเสี่ยงด้านงบประมาณ และเพิ่มโอกาสในการขยายผลลัพธ์เชิงบวกจากแคมเปญในระยะยาว