เมื่อตัวอย่างคำถามจาก Smith ถูกยกขึ้นมาในวงสนทนา "AI กำลังทำให้โลกของเราแปลกไป" คำว่าแปลกไม่ได้หมายถึงเทคโนโลยีที่ฉลาดขึ้นเพียงอย่างเดียว แต่หมายรวมถึงการเปลี่ยนโครงสร้างทางความคิด วิธีการทำงาน และระดับความเชื่อมั่นของผู้คน—จนทำให้นิยามของสิ่งที่เราเห็นว่าเป็นธรรมดาเปลี่ยนไปอย่างรวดเร็ว ตัวอย่างเช่น ปรากฏการณ์ deepfake ที่ท้าทายความน่าเชื่อถือของข้อมูล, ปัญญาประดิษฐ์สร้างสรรค์ที่เบียดเสียดงานด้านครีเอทีฟ และระบบสรรหาพนักงานที่อาศัยอัลกอริทึมซึ่งมีผลต่อการตัดสินใจเรื่องอนาคตของคนจำนวนมาก งานวิจัยและการสำรวจหลายชุดชี้ว่าในทศวรรษข้างหน้า AI อาจส่งผลต่อการทำงานของบุคคลถึงราว 30–40% ของกิจกรรมที่ทำเป็นประจำ และผู้ใช้บริการกว่า 50% เริ่มมีความกังวลเกี่ยวกับความเชื่อถือได้ของระบบอัตโนมัติ ซึ่งล้วนสะท้อนภาพของความ "แปลก" ที่จับต้องได้มากขึ้น

บทนำของบทความนี้จะพาผู้อ่านเจาะลึกทัศนะของ Smith ในมิติต่าง ๆ — จากการเปลี่ยนแปลงวิธีคิด (cognitive shifts) ไปจนถึงการเปลี่ยนรูปแบบการทำงานและการสถาปนาความเชื่อมั่นต่อเทคโนโลยี เราจะรวบรวมข้อมูลเชิงสถิติ กรณีศึกษาเชิงปฏิบัติ และตัวอย่างจากภาคธุรกิจและสังคม เพื่อถอดรหัสว่าความแปลกใหม่นั้นมีรูปร่างอย่างไร และสรุปแนวทางการเตรียมตัวทั้งในระดับนโยบาย ทักษะส่วนบุคคล และการออกแบบระบบที่โปร่งใส เพื่อให้สังคมสามารถรับมือกับโลกที่เปลี่ยนไปได้อย่างมีเหตุผลและยั่งยืน

บทนำ: ใครคือ Smith และคำถามหลักของบทความนี้

บทนำ: ใครคือ Smith และคำถามหลักของบทความนี้

Smith ในบทความนี้ถูกนิยามเป็นนักคิดร่วมสมัยที่อยู่ตรงจุดตัดของปรัชญา เทคโนโลยี และนโยบายสาธารณะ — เขาอาจเป็นนักปรัชญาภาควิชาหรือผู้วิจัยสมมติที่สะท้อนความกังวลของนักปฏิบัติและผู้นำองค์กรในยุคดิจิทัล ชื่อของเขาเป็นตัวแทนของเสียงวิพากษ์ที่ชี้ให้เห็นว่าไม่เพียงแต่ AI จะเปลี่ยนรูปแบบการทำงานหรือเพิ่มผลผลิตเท่านั้น แต่ยังกำลังเปลี่ยนแปลงพื้นฐานการรับรู้และความสัมพันธ์ทางสังคมอย่างเป็นรูปธรรม Smith เรียกร้องให้ผู้บริหารและผู้กำหนดนโยบายพิจารณาว่าเทคโนโลยีที่เราออกแบบและปรับใช้ได้สร้างโลกที่ แปลก ขึ้นหรือไม่ และความแปลกนั้นมีความหมายต่อองค์กรและสังคมอย่างไร

แก่นความคิดหลักของ Smith คือการตั้งกรอบใหม่: แทนที่จะมอง AI เป็นเพียงเครื่องมือเพิ่มประสิทธิภาพหรือความเสี่ยงด้านจริยธรรม เขาย้ำว่า AI ทำให้โลก "แปลก" ในหลายมิติ ทั้งในแง่การเบลอขอบเขตของมนุษย์และเครื่องจักร การเปลี่ยนแปลงในโครงสร้างอำนาจทางเศรษฐกิจ และการสร้างผลลัพธ์ที่ยากจะคาดเดาในระดับระบบ ตัวอย่างเช่น การตัดสินใจที่ก่อนหน้านี้เป็นหน้าที่ของผู้เชี่ยวชาญถูกแทนที่ด้วยโมเดลเชิงสถิติ หรือสัญญาณตลาดที่เคยชัดเจนกลับถูกเบลอเมื่อข้อมูลสร้างการรับรู้ใหม่ ซึ่งตามการศึกษาที่เป็นที่อ้างอิง เช่น รายงานของ McKinsey และ PwC ชี้ว่า AI อาจเพิ่มมูลค่าทางเศรษฐกิจระดับหลายล้านล้านดอลลาร์ภายในทศวรรษหน้า—แต่ผลประโยชน์และความเสี่ยงจะกระจายตัวไม่เท่ากัน

เมื่อกล่าวถึงคำว่า "แปลก" ในบริบทของ Smith เราจำเป็นต้องนิยามมันอย่างเคร่งครัด: ไม่ใช่เพียงความรู้สึกหวาดกลัวต่อสิ่งใหม่ แต่หมายถึงการเปลี่ยนแปลงเชิงโครงสร้างที่ทำให้ระบบสังคม เศรษฐกิจ และการกำกับดูแลไม่สามารถใช้นิยามเก่าอธิบายผลลัพธ์ใหม่ได้ — ได้แก่ ความไม่แน่นอนเชิงพฤติกรรมของระบบ อาการผิดปกติของสัญญาณตลาด ความไม่โปร่งใสของการตัดสินใจ และการย้ายถ่ายอำนาจจากมนุษย์สู่การออกแบบอัลกอริทึม การนิยามนี้ช่วยเปิดมุมมองว่า "แปลก" เป็นสถานะเชิงระบบมากกว่าความรู้สึกส่วนบุคคล

บทความนี้จะตั้งคำถามเชิงวิพากษ์เพื่อตอบว่า: โลกแปลก ตามกรอบของ Smith หมายถึงอะไรในทางปฏิบัติ ใครบ้างที่จะได้ประโยชน์จากการแปลกนี้ และใครจะตกเป็นผู้เสี่ยง? องค์กรควรปรับกลยุทธ์การบริหารความเสี่ยงและการกำกับดูแลอย่างไรเมื่อเผชิญกับผลลัพธ์ที่ไม่สามารถคาดเดาได้? อีกคำถามสำคัญคือเหตุใดมุมมองของ Smith จึงมีความสำคัญสำหรับผู้นำธุรกิจและนักนโยบายในปัจจุบัน ที่ซึ่งการตัดสินใจเรื่องการลงทุน การปฏิบัติตามกฎระเบียบ และความรับผิดชอบต่อสังคมต้องสอดคล้องกับโลกที่กำลังเปลี่ยนไป

- คำถามเชิงนิยาม: เราจะนิยามความ "แปลก" ในเชิงระบบได้อย่างไร และสัญญาณใดที่บ่งชี้ว่าเรากำลังเข้าสู่สภาวะแปลก?

- คำถามเชิงผลกระทบ: กลุ่มใดได้ประโยชน์และกลุ่มใดเสี่ยงเมื่อ AI สร้างความแปลกในตลาดแรงงาน ข้อมูล และการกำกับดูแล?

- คำถามเชิงการจัดการ: ภาคธุรกิจและผู้กำหนดนโยบายควรออกแบบกลไกการกำกับดูแลและกลยุทธ์องค์กรอย่างไร เพื่อรับมือกับความไม่แน่นอนเชิงระบบที่เกิดจาก AI?

บริบทประวัติศาสตร์: การเปลี่ยนผ่านทางเทคโนโลยีที่นำมาซึ่งความแปลก

บริบทประวัติศาสตร์: การเปลี่ยนผ่านทางเทคโนโลยีที่นำมาซึ่งความแปลก

ประวัติศาสตร์การเปลี่ยนผ่านทางเทคโนโลยีสอนให้เราทราบว่า “ความรู้สึกแปลก” ต่อสิ่งใหม่ไม่ใช่ปรากฏการณ์เฉพาะยุคสมัยใดสมัยหนึ่ง แต่เป็นรอบการปรับตัวทางวัฒนธรรมและเศรษฐกิจที่เกิดขึ้นซ้ำแล้วซ้ำเล่า เมื่อเทคโนโลยีใหม่ยกระดับการผลิต การสื่อสาร หรือรูปแบบการทำงาน ชุมชน คนงาน และสถาบันต่างๆ จำเป็นต้องตั้งคำถาม ปรับโครงสร้าง และสร้างกฎเกณฑ์ใหม่ ตัวอย่างจากอดีตช่วยให้เห็นรูปแบบที่ทำให้ความแปลกกลายเป็นส่วนหนึ่งของการเปลี่ยนผ่านที่ใหญ่กว่า

ตัวอย่างเชิงประวัติศาสตร์ที่ชัดเจน ได้แก่:

- การปฏิวัติอุตสาหกรรม (ศตวรรษที่ 18–19) — การเปลี่ยนจากแรงงานคนเป็นเครื่องจักรเปลี่ยนโครงสร้างการผลิต ทำให้เกิดการย้ายถิ่นฐานเข้าสู่เมือง การพัฒนาระบบทางรถไฟ รวมถึงข้อกังวลทางสังคมเกี่ยวกับการจ้างงานและสภาพแรงงาน

- การใช้ไฟฟ้าและระบบจ่ายพลังงาน (ปลายศตวรรษที่ 19–20) — การกระจายไฟฟ้าทั่วระบบเศรษฐกิจไม่เพียงเปลี่ยนเครื่องจักร แต่เปลี่ยนวิถีชีวิตประจำวัน เช่น แสงสว่าง การขนส่ง และการผลิตแบบอัตโนมัติบางส่วน

- การมาของอินเทอร์เน็ตและดิจิทัล (ปลายศตวรรษที่ 20–21) — อินเทอร์เน็ตเปลี่ยนรูปแบบการสื่อสาร การค้า และข้อมูล ทำให้เกิดโมเดลธุรกิจใหม่ เช่น อีคอมเมิร์ซ แพลตฟอร์มโซเชียล และเศรษฐกิจแพลตฟอร์ม พร้อมทั้งสร้างความไม่แน่นอนต่อบทบาทของสื่อดั้งเดิม

จากตัวอย่างข้างต้น มีความเหมือนกันที่สำคัญคือการเปลี่ยนผ่านทุกครั้งสร้างความไม่แน่นอนและความรู้สึกแปลกใหม่ แต่เทคโนโลยีปัญญาประดิษฐ์ (AI) ต่างออกไปในหลายมิติสำคัญที่ทำให้ความแปลกครั้งนี้มีลักษณะเฉพาะตัว:

- ความสามารถในการเรียนรู้ — ปกติเทคโนโลยีอื่นๆ ทำหน้าที่ตามกฎที่เขียนไว้ แต่ AI โดยเฉพาะโมเดลเรียนรู้เชิงลึกสามารถปรับพฤติกรรมจากข้อมูลใหม่ได้ด้วยตนเอง ผลคือระบบสามารถพัฒนาทักษะหรือปรับการตัดสินใจโดยไม่ต้องเขียนโปรแกรมใหม่ทั้งหมด

- ความสามารถในการสร้างเนื้อหา — AI สร้างข้อความ รูปภาพ เสียง และโค้ดได้ในระดับที่เคยเป็นงานของมนุษย์ ซึ่งเปลี่ยนขอบเขตของงานสร้างสรรค์และการสื่อสาร ทำให้เกิดคำถามใหม่ทั้งด้านสิทธิบัตร ลิขสิทธิ์ และความน่าเชื่อถือของข้อมูล

นอกเหนือจากคุณสมบัติพื้นฐานแล้ว ลักษณะการเปลี่ยนผ่านของ AI ยังแตกต่างในด้านความเร็วและขอบเขตการแพร่กระจาย เมื่อเทียบกับอดีต:

- ความเร็ว — บริการ AI บางตัว เช่น ChatGPT ถูกนำไปใช้งานอย่างรวดเร็วและแพร่หลาย: ChatGPT รายงานผู้ใช้ระดับเดือนละ 100 ล้านคนภายในไม่กี่เดือนหลังเปิดตัว ซึ่งเป็นการยอมรับของผู้ใช้ที่เร็วที่สุดรูปแบบหนึ่งในประวัติศาสตร์ซอฟต์แวร์

- ขอบเขต — AI ไม่จำกัดอยู่เพียงภาคอุตสาหกรรมใดอุตสาหกรรมหนึ่ง แต่ข้ามขอบเขตตั้งแต่การผลิต การแพทย์ การเงิน การศึกษา ไปจนถึงการสื่อสารส่วนบุคคล ทำให้ผลกระทบเป็นวงกว้างทั้งในระดับสถาบันและระดับบุคคล

- ปัจจัยเสริม — การเพิ่มขึ้นของกำลังการคำนวณ ค่าใช้จ่ายในการเก็บและประมวลผลข้อมูลที่ลดลง และเครือข่ายอินเทอร์เน็ตความเร็วสูง ทำให้การพัฒนาและปรับใช้ AI เป็นไปได้รวดเร็วกว่าที่เคย

สำหรับนักธุรกิจและผู้นำองค์กร ความเข้าใจบริบททางประวัติศาสตร์ช่วยให้มองเห็นว่า “ความรู้สึกแปลก” ต่อ AI ไม่ใช่สัญญาณของความผิดปกติ แต่เป็นสัญญาณของการเปลี่ยนผ่านที่ต้องการกลยุทธ์การปรับตัว ต่างจากอดีตที่การเปลี่ยนผ่านมักเป็นการแทนที่เครื่องมือที่คงที่ AI เป็นตัวเร่งที่ปรับพฤติกรรมของระบบงานอย่างต่อเนื่อง ดังนั้นการเตรียมความพร้อมจึงต้องรวมทั้งการพัฒนาทักษะ การออกแบบนโยบายที่ยืดหยุ่น และการลงทุนในโครงสร้างพื้นฐานข้อมูลและการวัดผลผลกระทบอย่างเป็นระบบ

ผลกระทบทางเศรษฐกิจและแรงงาน: เมื่องานและรายได้เปลี่ยนรูป

ผลกระทบทางเศรษฐกิจและแรงงาน: เมื่องานและรายได้เปลี่ยนรูป

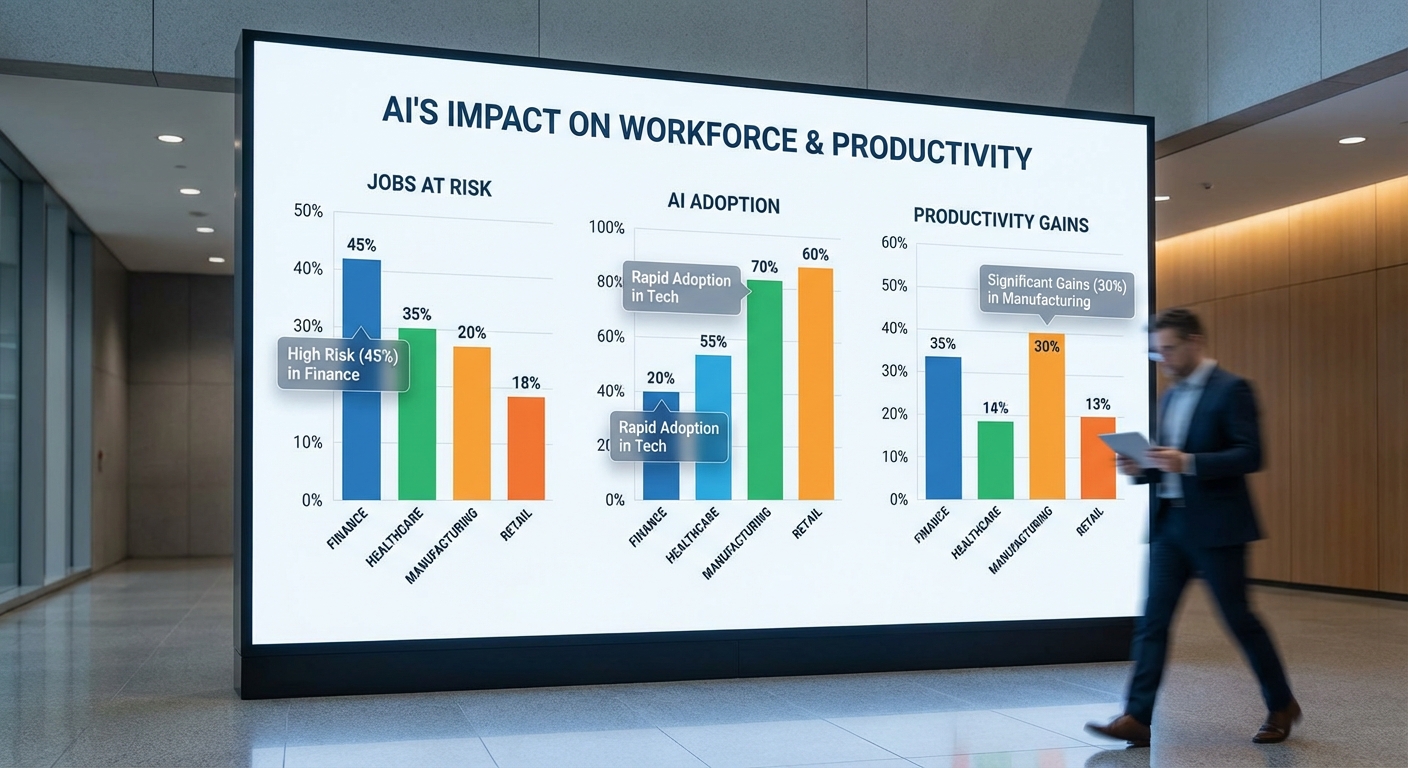

การแพร่หลายของปัญญาประดิษฐ์ (AI) และระบบอัตโนมัติกำลังเร่งให้เกิดการเปลี่ยนแปลงเชิงโครงสร้างในตลาดแรงงานอย่างมีนัยสำคัญ รายงานชิ้นสำคัญหลายฉบับชี้ตรงกันว่าไม่เพียงแต่จำนวนงานจะเปลี่ยนไป แต่ลักษณะของงาน ภาระหน้าที่ และรูปแบบรายได้จะถูกปรับใหม่ด้วย ตัวอย่างเช่น รายงานของ McKinsey Global Institute ระบุว่า อาจมีตำแหน่งงานสูงถึงราว 800 ล้านตำแหน่งที่อาจถูกอัตโนมัติหรือเปลี่ยนแปลงภายในปี 2030 ขณะที่องค์การเพื่อความร่วมมือและการพัฒนาทางเศรษฐกิจ (OECD) ประเมินว่าโดยเฉลี่ยประมาณ ร้อยละ 14 ของงานมีความเสี่ยงสูงต่อการถูกอัตโนมัติ และอีกประมาณ ร้อยละ 32 จะต้องเผชิญการเปลี่ยนแปลงที่สำคัญในทักษะการทำงาน นอกจากนี้ รายงาน Future of Jobs ของ World Economic Forum ประเมินว่าในปี 2025 อาจมีการเลิกจ้าง 85 ล้านตำแหน่งงานในขณะที่เกิดตำแหน่งใหม่กว่า 97 ล้านตำแหน่ง ซึ่งสะท้อนให้เห็นทั้งความเสี่ยงและโอกาสที่เกิดขึ้นพร้อมกัน

ผลกระทบต่ออาชีพจะไม่เท่าเทียมกัน ระหว่างภาคส่วนและทักษะบางประเภทจะได้ประโยชน์ ขณะที่งานที่ประกอบด้วยกิจกรรมที่เป็นระบบและทำซ้ำได้จะเผชิญแรงกดดันมากกว่า ตัวอย่างที่ชัดเจนได้แก่:

- อาชีพที่เสี่ยงจากอัตโนมัติ: งานในสายการผลิตที่เป็นงานซ้ำ เช่น พนักงานประกอบ, งานธุรการที่มีการป้อนข้อมูลซ้ำๆ, พนักงานบริการลูกค้าที่ตอบข้อซักถามพื้นฐาน (เช่น call center แบบเดิม) และบางส่วนของงานขับเคลื่อนและโลจิสติกส์

- อาชีพที่ได้ประโยชน์จาก AI: งานที่เกี่ยวข้องกับการออกแบบ พัฒนา และบำรุงรักษาเทคโนโลยี เช่น วิศวกรซอฟต์แวร์, นักวิทยาศาสตร์ข้อมูล, นักวิเคราะห์ไซเบอร์, รวมถึงงานที่ต้องใช้ความคิดสร้างสรรค์และมนุษยสัมพันธ์ขั้นสูง เช่น ที่ปรึกษาทางธุรกิจ, นักออกแบบประสบการณ์ลูกค้า และบุคลากรด้านสุขภาพที่ใช้เทคโนโลยีช่วยตัดสินใจ

ในด้านเศรษฐกิจมหภาค AI มีศักยภาพเพิ่ม productivity และเติบโตทาง GDP อย่างชัดเจน — ตัวเลขประมาณการของ PwC ระบุว่า AI อาจเพิ่มมูลค่าต่อระบบเศรษฐกิจโลกได้สูงถึง ประมาณ 15.7 ล้านล้านดอลลาร์สหรัฐภายในปี 2030 ทั้งนี้การเพิ่มขึ้นของผลผลิตไม่จำเป็นต้องกระจายไปยังแรงงานทุกกลุ่ม ซึ่งอาจทำให้ ความเหลื่อมล้ำด้านรายได้และโอกาส ทวีความรุนแรงขึ้น หากไม่มีมาตรการนโยบายที่เหมาะสม สถิติแรงงานยังชี้ว่าผู้ที่มีทักษะสูงและผู้ลงทุนในเทคโนโลยีจะได้รับผลประโยชน์มากกว่าผู้ที่ทำงานในตำแหน่งที่เสี่ยงจะถูกแทนที่

เพื่อบรรเทาผลกระทบและเพิ่มโอกาสในการปรับตัว ควรมีการออกแบบนโยบายทั้งในระดับองค์กรและรัฐอย่างเป็นระบบ โดยมาตรการสำคัญที่ควรพิจารณามีดังนี้

- Reskilling และ upskilling: ทั้งภาครัฐและเอกชนต้องร่วมลงทุนในโปรแกรมฝึกอบรมที่มุ่งเป้าไปยังทักษะดิจิทัล การวิเคราะห์ข้อมูล และทักษะเชิงพฤติกรรม รายงาน WEF ระบุว่า ร้อยละ 50 ของพนักงานจะต้องได้รับการปรับทักษะภายในปี 2025 ซึ่งสะท้อนความจำเป็นในการฝึกอบรมเชิงระบบ

- นโยบายความมั่นคงรายได้: Universal Basic Income (UBI) และมาตรการชั่วคราว การทดลอง UBI ในฟินแลนด์และเมืองต่างๆ เช่น Stockton (สหรัฐฯ) ให้ข้อมูลเชิงนโยบายเกี่ยวกับผลกระทบต่อความเป็นอยู่และการค้นหางาน อย่างไรก็ตาม การนำ UBI มาใช้ในระดับประเทศต้องพิจารณาด้านงบประมาณและการออกแบบให้สอดคล้องกับเป้าหมายการจ้างงาน

- ระบบประกันรายได้และการฟื้นฟูอาชีพ: นโยบายประกันว่างงานเชิงรุก การให้เงินช่วยเหลือระหว่างเปลี่ยนอาชีพ และโปรแกรมเชื่อมโยงการฝึกอบรมกับนายจ้าง จะช่วยให้แรงงานเปลี่ยนงานได้เร็วขึ้น

- มาตรการสำหรับองค์กร: บริษัทควรจัดสรรงบประมาณฝึกอบรม ปรับโครงสร้างงานเพื่อนำ AI มาใช้ร่วมกับแรงงานมนุษย์ (augmented work) และออกแบบเส้นทางอาชีพใหม่เพื่อลดการเลิกจ้างเชิงโครงสร้าง

- นโยบายแรงงานและกฎระเบียบ: ปรับปรุงกฎหมายแรงงานให้ครอบคลุมรูปแบบการจ้างงานใหม่ๆ สนับสนุนการเจรจาระดับกลุ่มและการคุ้มครองผู้รับจ้างอิสระ รวมทั้งพิจารณาแรงจูงใจทางภาษีเพื่อการลงทุนในการฝึกอบรม

สรุปได้ว่า การเปลี่ยนรูปของงานและรายได้จาก AI เป็นทั้งความท้าทายและโอกาส การตอบสนองที่มีประสิทธิผลต้องอาศัยการร่วมมือระหว่างภาครัฐ ภาคธุรกิจ และสถาบันการศึกษา เพื่อออกแบบนโยบายการเรียนรู้ตลอดชีวิต ระบบคุ้มครองทางสังคมที่ยืดหยุ่น และการลงทุนในเทคโนโลยีที่ส่งเสริมงานที่มีคุณค่าและไม่เพียงแต่ลดต้นทุนการผลิต แต่ยังเพิ่มโอกาสในการสร้างรายได้ที่เป็นธรรมสำหรับสังคมโดยรวม

ผลกระทบทางสังคมและจิตวิทยา: ความไว้วางใจ ตัวตน และการรับรู้ความจริง

การแพร่หลายของปัญญาประดิษฐ์ (AI) ไม่เพียงเปลี่ยนเครื่องมือทางเทคนิคที่เราใช้ แต่ยังเปลี่ยนบริบททางสังคมที่ข้อมูลถูกสร้างและบริโภคอย่างลึกซึ้ง ในมิติของ ความไว้วางใจ ต่อข่าวสารและสื่อสารมวลชน ปรากฏการณ์ เช่น deepfake และการผลิตเนื้อหาเชิงเทียม (synthetic media) สร้างความท้าทายเชิงโครงสร้าง: เมื่อใบหน้าหรือเสียงที่ถูกปลอมแปลงสามารถเล่าเรื่องได้อย่างน่าเชื่อถือ ผู้รับสารย่อมสงสัยและระแวงมากขึ้น ผลลัพธ์คือการลดทอนความแน่นอน (epistemic certainty) ในข้อมูลที่เคยเป็นรากฐานของการตัดสินใจทั้งในภาคธุรกิจและการเมือง

การเพิ่มขึ้นของ deepfake และผลต่อความเชื่อถือของข้อมูล

หลายปีที่ผ่านมา เทคโนโลยีสร้างภาพ/เสียงปลอมพัฒนาอย่างรวดเร็ว รายงานจากกลุ่มวิจัยด้านความปลอดภัยสื่อดิจิทัลระบุว่า deepfake ในอินเทอร์เน็ตมีการเติบโตอย่างมีนัยสำคัญ โดยเนื้อหาส่วนใหญ่ในช่วงเริ่มแรกเป็นสื่อทางเพศ (รายงานคลาสสิกระบุว่าประมาณ 96% ของวิดีโอ deepfake ที่ถูกค้นพบในบางช่วงเป็นเนื้อหาทางเพศ) แต่เทคนิคเดียวกันนี้ถูกนำไปใช้ในบริบททางการเมือง การตลาด และการหลอกลวงเชิงพาณิชย์ การมีอยู่ของ deepfake ทำให้เกิดผลสะท้อนดังนี้:

- ความเสี่ยงต่อภาพลักษณ์และชื่อเสียง: บุคคลหรือองค์กรอาจถูกใส่ร้ายด้วยคลิปหรือข้อความที่ถูกปรับแต่ง

- การกัดกร่อนของความเชื่อมั่นสถาบัน: เมื่อสื่อมวลชนและช่องทางดั้งเดิมถูกตั้งคำถาม ความไว้วางใจในแหล่งข้อมูลหลักลดลง

- ค่าใช้จ่ายในการตรวจพิสูจน์: องค์กรต้องลงทุนในเครื่องมือการตรวจจับ การตรวจสอบแหล่งที่มา และการให้ความรู้แก่สาธารณะ

ผลต่ออัตลักษณ์: AI-generated personas และ virtual influencers

นอกจากการปลอมแปลงแล้ว AI ยังสร้างตัวตนใหม่ในโลกดิจิทัล เช่น virtual influencers (ตัวแทนเสมือนในโซเชียลมีเดีย) และ AI-generated personas ที่มีพฤติกรรมโต้ตอบกับผู้ใช้ เหตุการณ์นี้ส่งผลต่ออัตลักษณ์ส่วนบุคคลและการรับรู้สังคมในหลายด้าน:

- การเปลี่ยนกรอบอ้างอิงของ "คนดัง": ตัวตนที่ถูกออกแบบให้สมบูรณ์แบบอาจเปลี่ยนมาตรฐานความงามและความสำเร็จ ส่งผลให้ผู้บริโภครู้สึกเปรียบเทียบและมีความคาดหวังที่สูงขึ้น

- การเบลอเส้นแบ่งระหว่างมนุษย์กับเครื่องจักร: เมื่อผู้บริโภคไม่สามารถแยกแยะได้ว่ากำลังรับสื่อจากมนุษย์จริงหรืออัลกอริทึม ความสัมพันธ์เชิงสังคมและการไว้วางใจระหว่างบุคคลก็เปลี่ยนไป

- การใช้ตัวตนเทียมเพื่อจุดประสงค์ทางธุรกิจและการเมือง: องค์กรอาจสร้าง personas เพื่อสื่อสารกับกลุ่มเป้าหมายอย่างมีประสิทธิภาพ แต่การใช้ persona เหล่านี้โดยไม่ชัดเจนอาจสร้างปัญหาทางจริยธรรมและความโปร่งใส

ผลกระทบทางจิตวิทยา: isolation, anxiety และ cognitive overload

ในระดับบุคคล ผลกระทบทางจิตวิทยาจากการอยู่ในสภาพแวดล้อมข้อมูลที่ถูกกำหนดโดย AI มีความหลากหลายและซับซ้อน ผู้คนรายงานว่ารู้สึก เหินห่าง (isolation) มากขึ้นเมื่อการสื่อสารถูกแทนที่ด้วยแชตบอทหรือระบบตอบรับอัตโนมัติ อีกทั้งความไม่แน่นอนของข้อมูลก่อให้เกิด ความวิตกกังวล (anxiety) เกี่ยวกับการตัดสินใจและการติดต่อสัมพันธ์ ตัวอย่างผลกระทบที่สังเกตได้คือ:

- Isolation: ผู้ใช้บางกลุ่มหันไปพึ่งแชตบอทเพื่อการปลอบประโลมหรือสนทนา ทำให้ความสัมพันธ์กับมนุษย์จริงลดลง และส่งผลต่อการพัฒนาเครือข่ายสังคมที่มีคุณภาพ

- Anxiety: การเผชิญกับข้อมูลขัดแย้งหรือสื่อที่น่าเชื่อถือไม่ได้ ทำให้เกิดความกลัวการถูกหลอก และลดความกล้าหาญในการแชร์ความคิดเห็นหรือมีส่วนร่วมในสาธารณะ

- Cognitive overload: ปริมาณข้อมูลที่มากและการต้องตรวจสอบความถูกต้องของเนื้อหาเพิ่มภาระทางปัญญา ผู้บริหารและพนักงานต้องใช้เวลาและพลังงานมากขึ้นในการคัดกรองข้อมูล ซึ่งส่งผลต่อประสิทธิภาพการทำงานและการตัดสินใจเชิงกลยุทธ์

โดยสรุป การแพร่หลายของ AI ส่งผลกระทบทางสังคมและจิตวิทยาในระดับกว้าง ตั้งแต่การสั่นคลอนของความไว้วางใจต่อข้อมูล ไปจนถึงการเปลี่ยนรูปแบบอัตลักษณ์และแรงกดดันทางจิตใจสำหรับผู้ใช้และพนักงานองค์กร ผู้บริหารควรตระหนักถึงความเสี่ยงเหล่านี้ และออกแบบนโยบายควบคุม การตรวจสอบ และการให้ความรู้แก่พนักงานและลูกค้าเพื่อรักษาความโปร่งใส ความรับผิดชอบ และสวัสดิภาพทางจิตใจของสังคมโดยรวม

จริยธรรม กฎหมาย และการกำกับดูแล: ข้อถกเถียงและแนวทางนโยบาย

คำถามจริยธรรมหลัก: ความรับผิดชอบ (accountability), ความโปร่งใส (transparency) และความเป็นธรรม (fairness)

การขยายตัวของระบบปัญญาประดิษฐ์ในภาคธุรกิจและภาครัฐ ทำให้เกิดคำถามจริยธรรมพื้นฐาน 3 ประการที่ต้องได้รับการตอบอย่างชัดเจน: ใครเป็นผู้รับผิดชอบเมื่อระบบตัดสินใจผิดพลาดหรือทำให้เกิดความเสียหาย, ระบบจะถูกเปิดเผยระดับใดให้ผู้ได้รับผลกระทบและสาธารณะเข้าตรวจสอบได้ และ จะป้องกันการเลือกปฏิบัติที่ฝังในโมเดลอย่างไรเพื่อไม่ให้ซ้ำเติมความเหลื่อมล้ำเดิมของสังคม

ตัวอย่างที่เป็นบทเรียนชัดเจน เช่น กรณีโมเดลประเมินความเสี่ยงด้านอาชญากรรม (COMPAS) ซึ่งงานวิจัยหลายชิ้นพบความเอนเอียงต่อผู้ต้องหาเชื้อชาติผิวดำ หรือกรณีผู้ว่าจ้างระบบคัดเลือกบุคลากรซึ่งบริษัทใหญ่ยอมรับว่าระบบ "กดคะแนน" ผู้สมัครเพศหญิงในบางตำแหน่ง (เช่น กรณี Amazon ที่ยกเลิกระบบคัดเลือกโดยอัตโนมัติในปี 2018) เหตุการณ์เหล่านี้ชี้ให้เห็นว่าการขาด accountability และ transparency สามารถนำไปสู่การเลือกปฏิบัติที่ฝังตัวอยู่ในเทคโนโลยีได้อย่างรวดเร็ว

แนวปฏิบัติและตัวอย่างการกำกับดูแลจากหลายประเทศ

ในระดับสากล เราเห็นแนวทางกำกับดูแลที่หลากหลาย ทั้งการวางกรอบเชิงนโยบาย การออกแนวปฏิบัติวิชาชีพ และการกำหนดมาตรฐานทางเทคนิค ตัวอย่างสำคัญได้แก่:

- สหภาพยุโรป (EU) — การร่างและผลักดัน AI Act ซึ่งแบ่งความเสี่ยงของระบบออกเป็นระดับต่างๆ และกำหนดข้อจำกัดสำหรับระบบที่มีความเสี่ยงสูง เช่น ระบบคัดกรองผู้สมัครงาน ระบบตรวจสอบใบหน้าในพื้นที่สาธารณะ และระบบตัดสินใจทางกฎหมาย

- สหรัฐอเมริกา — แนวทางเชิงปฏิบัติจากหน่วยงานเช่น NIST ที่ออก AI Risk Management Framework (AI RMF) เพื่อส่งเสริมการประเมินความเสี่ยงและการจัดการ lifecycle ของโมเดล โดยเน้นความยืดหยุ่นและความสามารถในการปฏิบัติ

- สิงคโปร์ — Model AI Governance Framework ที่เสนอแนวทางการออกแบบ ความโปร่งใส และการทวนสอบ (governance & oversight) สำหรับผู้ประกอบการ

- แคนาดาและสหราชอาณาจักร — เริ่มนำกฎหมายหรือแนวปฏิบัติที่บังคับการประเมินผลกระทบ (impact assessments) สำหรับระบบอัตโนมัติที่ส่งผลต่อสิทธิพลเมือง

กรอบเหล่านี้แม้จะมีรูปแบบต่างกัน แต่มีจุดร่วมที่สำคัญคือการเน้น การประเมินความเสี่ยงเชิงระบบ, การกำหนดมาตรฐานด้านการทดสอบความเอนเอียง และการเปิดเผยข้อมูลเพียงพอเพื่อให้เกิดการตรวจสอบโดยบุคคลที่สาม

ข้อเสนอเชิงนโยบายเพื่อบรรเทาผลกระทบและลดความ 'แปลก'

การจัดกรอบกฎหมายและนโยบายที่ชัดเจนสามารถลดผลกระทบลบของ AI และนำความเชื่อมั่นกลับสู่สังคมได้ โดยมาตรการที่ควรพิจารณามีหลายชั้นและสามารถประยุกต์ใช้ร่วมกัน ดังนี้:

- การประเมินผลกระทบทางจริยธรรมและความเสี่ยง (AI Impact Assessment) — ข้อกำหนดให้ผู้พัฒนาหรือผู้ใช้ระบบทำการประเมินก่อนนำระบบไปใช้จริง โดยครอบคลุมความเสี่ยงด้านความเป็นส่วนตัว ความเอนเอียง และผลกระทบทางสังคม

- การตรวจสอบอิสระ (Audit) — บังคับให้มีการตรวจสอบทั้งทางเทคนิคและจริยธรรมโดยหน่วยงานอิสระหรือผู้ตรวจสอบที่ได้รับการรับรอง เพื่อตรวจจับ bias, การรั่วไหลของข้อมูล และการทำงานไม่เป็นไปตามข้อบังคับ

- การรับรองและการให้ป้ายมาตรฐาน (Certification) — สร้างระบบการรับรองมาตรฐานสากลหรือระดับชาติสำหรับระบบที่มีความเสี่ยงสูง เช่น การให้ป้ายรับรองว่าผ่านการทดสอบ fairness และ security ก่อนวางจำหน่าย

- สิทธิในการอธิบายผลการตัดสินใจ (Rights to explanation) — ขยายสิทธิภายใต้กรอบกฎหมายเช่น GDPR ให้ผู้ได้รับผลกระทมได้รับคำอธิบายที่เข้าใจได้เกี่ยวกับการตัดสินใจอัตโนมัติ พร้อมช่องทางการร้องเรียนและการเยียวยา

- มาตรฐานการเปิดเผยและการรายงาน (Transparency & Reporting) — กำหนดให้เผยแพร่เอกสารสำคัญ เช่น model cards, data sheets, provenance logs และรายงานการทดสอบประสิทธิภาพและ bias เป็นประจำ

- กรอบความรับผิด (Liability frameworks) — ชี้ชัดความรับผิดระหว่างผู้พัฒนา ผู้ปรับใช้ และผู้ให้บริการคลาวด์ในกรณีเกิดความเสียหาย และพิจารณาระบบความรับผิดแบบเฉพาะสำหรับผลิตภัณฑ์ AI ที่มีความเสี่ยงสูง

- การฝึกอบรมและการเสริมสร้างศักยภาพ — สนับสนุนการฝึกอบรมด้านจริยธรรม AI และการทดสอบ bias สำหรับบุคลากรทั้งภาครัฐและเอกชน เพื่อให้การบังคับใช้เป็นไปอย่างมีประสิทธิภาพ

การนำมาตรการเหล่านี้มาปฏิบัติจริงควรเป็นแบบบูรณาการ: มาตรฐานทางเทคนิคต้องสอดคล้องกับกรอบกฎหมาย และการกำกับดูแลต้องเปิดช่องให้มีนวัตกรรมที่รับผิดชอบ ไม่ใช่การขัดขวางอย่างไม่จำเป็น โดยเฉพาะในบริบทธุรกิจที่ต้องการความชัดเจนด้านความเสี่ยงและต้นทุน

สุดท้าย การกำกับดูแล AI ควรยึดหลัก ความสมดุลระหว่างนวัตกรรมกับการคุ้มครองสาธารณะ—เมื่อผู้กำหนดนโยบาย สามารถวางมาตรการที่ชัดเจน เช่น การตรวจสอบอิสระ การรับรอง และสิทธิในการอธิบายผลการตัดสินใจ จะช่วยลดความรู้สึกว่ามนุษย์กำลังถูกแทนที่หรือถูก “โลกที่แปลก” ครอบงำ และคืนความเชื่อมั่นให้กับผู้ใช้งานและภาคธุรกิจได้อย่างยั่งยืน

กรณีศึกษาเชิงปฏิบัติ: deepfake, generative art, ระบบสรรหาพนักงานอัตโนมัติ

ส่วนนี้นำเสนอกรณีศึกษาจริงและเชิงสมมติที่ชัดเจนเพื่อให้เห็นผลกระทบทางสังคม เศรษฐกิจ และจริยธรรมของเทคโนโลยีปัญญาประดิษฐ์ในโลกปัจจุบัน โดยมุ่งเน้นที่สามประเด็นหลัก: deepfake ที่ส่งผลต่อสาธารณชนและการเมือง, การยอมรับงานศิลป์ที่สร้างโดย AI ในตลาดศิลปะเชิงพาณิชย์, และ ปัญหา bias ในระบบสรรหาพนักงานอัตโนมัติ ซึ่งแต่ละกรณีจะมีการอธิบายเหตุการณ์ ผลกระทบ ตัวเลขประกอบ และบทเรียนเชิงนโยบาย/ปฏิบัติการ

1. กรณี deepfake และผลกระทบต่อสาธารณชน

ตัวอย่างเชิงปฏิบัติที่พบได้บ่อยคือคลิปวิดีโอหรือเสียงที่สร้างขึ้นโดยเทคโนโลยี deep learning เพื่อเลียนแบบบุคคลสาธารณะ ในบางเหตุการณ์คลิปลักษณะนี้ถูกเผยแพร่ใกล้ช่วงการเลือกตั้งหรือเหตุการณ์ทางการเมืองสำคัญ ส่งผลให้เกิดความสับสนของข้อมูลข่าวสารและลดทอนความเชื่อมั่นของประชาชนต่อสื่อหลักและกระบวนการประชาธิปไตย ตัวอย่างที่เป็นที่ถกเถียงทั่วโลก เช่น การเผยแพร่คลิปปลอมของนักการเมืองซึ่งแม้จะไม่ใช่กรณีเดียวกันกับเหตุการณ์ทางกฎหมายใหญ่ แต่ได้สะท้อนให้เห็นว่าความเร็วในการแพร่กระจายและคุณภาพของ deepfake ปัจจุบันสามารถสร้างความเสียหายได้ในระดับที่เป็นรูปธรรม

สถิติบางชิ้นชี้ให้เห็นการเติบโตของปรากฏการณ์นี้ เช่นรายงานจากภาคเอกชนและสถาบันวิจัยพบว่าเนื้อหา deepfake เพิ่มขึ้นอย่างมีนัยสำคัญในช่วงสองสามปีที่ผ่านมา โดยเฉพาะในรูปแบบสื่อสังคมออนไลน์ ผลกระทบที่พบได้แก่: การบิดเบือนข้อมูลข่าวสาร, การโจมตีทางจริยธรรมต่อบุคคล, การกระทบต่อผู้มีสิทธิ์ออกเสียง และค่าใช้จ่ายในการตรวจสอบย้อนกลับเพื่อล้างข้อเท็จจริง

- บทเรียน: จำเป็นต้องมีมาตรการผสมผสานทั้งด้านเทคนิค (เช่น การพัฒนา watermarking, detection models), นโยบาย (กฎหมายคุ้มครองข้อมูลและการลงโทษการเผยแพร่โดยรู้เท่าไม่ถึงการณ์) และการเสริมสร้างความรู้แก่สาธารณะ (media literacy) เพื่อให้สังคมสามารถแยกแยะข้อมูลปลอมได้ดีขึ้น

- ข้อเสนอเชิงปฏิบัติ: ผนึกกำลังระหว่างรัฐบาล แพลตฟอร์มออนไลน์ และองค์กรสื่อเพื่อจัดตั้งศูนย์ตรวจสอบและตอบโต้แบบเรียลไทม์ พร้อมการกำกับดูแลเชิงมาตรฐานสำหรับการบันทึก/แสดงแหล่งที่มาของสื่อดิจิทัล

2. การยอมรับงานศิลป์ที่สร้างโดย AI ในตลาดศิลปะ

กรณีที่เป็นจุดเปลี่ยนของสาธารณชนคือการประมูลผลงานศิลปะที่ใช้เทคนิค generative models แล้วขายได้ในราคาสูง ตัวอย่างเชิงประวัติศาสตร์คือการขายผลงานศิลปะดิจิทัลที่เกี่ยวข้องกับ NFT ซึ่งบางชิ้นสร้างโดยเครื่องมือที่ขับเคลื่อนด้วย AI และดึงดูดความสนใจของนักสะสมระดับโลก การขายงานศิลป์โดยใช้ AI ทำให้เกิดคำถามทั้งด้านมูลค่าเชิงศิลปะ สิทธิในผลงาน และการแบ่งรายได้ให้กับศิลปินต้นทาง

ผลการยอมรับในตลาดแบ่งเป็นสองแนวทางชัดเจน: บางส่วนยอมรับและลงทุนอย่างรวดเร็ว โดยมองว่าเป็นนวัตกรรมและช่องทางสร้างมูลค่าใหม่ ในขณะที่ภาคศิลปินดั้งเดิมและผู้เชี่ยวชาญหลายฝ่ายกังวลเรื่อง ความโปร่งใสของแหล่งข้อมูลฝึกสอน และปัญหาลิขสิทธิ์ เช่น งานที่สร้างจากการใช้ชุดข้อมูลที่มีงานของศิลปินอื่นโดยไม่ได้รับอนุญาต ซึ่งก่อให้เกิดข้อพิพาททางกฎหมายและจริยธรรม

- บทเรียน: ตลาดศิลปะต้องการกรอบปฏิบัติที่ชัดเจนเกี่ยวกับการระบุแหล่งข้อมูลการฝึกสอน การให้เครดิต และการแบ่งผลประโยชน์ ไม่เช่นนั้นความเสี่ยงด้านกฎหมายและความไม่ไว้วางใจจะยับยั้งการเติบโตของภาคนี้

- ข้อเสนอเชิงปฏิบัติ: ส่งเสริมมาตรฐานการทำ metadata ของงานสร้างโดย AI, การติดป้ายแสดงกระบวนการสร้าง (provenance), และการตั้งแนวทางการแบ่งรายได้เมื่อผลงานสร้างมาจากชุดข้อมูลที่มีผลงานของคนอื่น

3. ปัญหา bias ในระบบสรรหาและผลต่อชีวิตคนจริง

ระบบสรรหาพนักงานที่ใช้ AI (automated hiring systems) ถูกนำมาใช้เพื่อลดภาระงานเชิงซ้ำซ้อนและเร่งกระบวนการคัดกรอง แต่มีกรณีศึกษาที่ชี้ชัดว่าอัลกอริทึมเหล่านี้สามารถสะท้อนและขยายความเอนเอียงของข้อมูลต้นทาง ตัวอย่างที่เป็นที่รู้จักคือกรณีของบริษัทเทคโนโลยีรายใหญ่ที่ต้องระงับ/ยกเลิกโครงการระบบคัดกรองใบสมัคร เพราะโมเดลให้คะแนนผู้สมัครผู้ชายสูงกว่าผู้หญิง เนื่องจากข้อมูลฝึกสอนย้อนหลังสะสมมาจากประวัติพนักงานที่ส่วนใหญ่เป็นผู้ชาย

ผลกระทบที่พบได้จริง ได้แก่การปิดกั้นโอกาสทางอาชีพสำหรับกลุ่มที่ถูกเลือกปฏิบัติอย่างไม่เป็นธรรม การสูญเสียความหลากหลายในองค์กร และความเสี่ยงทางกฎหมายและชื่อเสียงสำหรับนายจ้าง งานวิจัยด้านทรัพยากรบุคคลหลายชิ้นแสดงให้เห็นว่าแม้ระบบจะเพิ่มประสิทธิภาพในการคัดกรอง แต่หากไม่มีการทดสอบ fairness และการตรวจสอบภายในอย่างต่อเนื่อง ผลลัพธ์จะเอื้อต่อการเหยียดหรือเลือกปฏิบัติอย่างเป็นระบบ

- บทเรียน: การนำ AI มาใช้ในการสรรหาต้องมีหลักประกันด้านความยุติธรรม (fairness), ความโปร่งใส (explainability), และการกำกับดูแล (human oversight) ตลอดวงจรชีวิตของโมเดล

- ข้อเสนอเชิงปฏิบัติ: ใช้ชุดข้อมูลตัวอย่างที่เป็นตัวแทน (representative datasets), ประเมินโมเดลด้วยมาตรวัดความยุติธรรมหลายมิติ, ดำเนินการ audit โดยหน่วยงานอิสระเป็นระยะ และกำหนดให้มีการทบทวนโดยมนุษย์ก่อนตัดสินใจเชิงรุกต่อผู้สมัคร

สรุปเชิงบูรณาการ: ทั้งสามกรณีศึกษาชี้ให้เห็นว่าเทคโนโลยี AI มีศักยภาพสร้างคุณค่าเชิงเศรษฐกิจและนวัตกรรม แต่ในขณะเดียวกันก็สร้างผลกระทบต่อคนจริงอย่างเป็นรูปธรรม หากไม่ได้ออกแบบ ควบคุม และกำกับดูแลอย่างรอบคอบ บทเรียนร่วมกันคือการผสานมาตรการเชิงเทคนิค นโยบาย และการกำกับดูแลเชิงสังคม เพื่อให้การใช้ AI สอดคล้องกับค่านิยมของสังคมและปกป้องสิทธิขั้นพื้นฐานของปัจเจกบุคคล

อนาคตและข้อเสนอ: จะอยู่ร่วมกับโลกที่ 'แปลก' อย่างไร

ภาพรวมตามกรอบความคิดของ Smith

ตามมุมมองของ Smith โลกที่ได้รับผลกระทบจาก AI จะไม่เป็นเพียงการเปลี่ยนแปลงทางเทคโนโลยี แต่จะเป็นการเปลี่ยนโครงสร้างทางสังคมและเศรษฐกิจที่ทำให้ความคุ้นชินดั้งเดิม "แปลก" ขึ้น—ทั้งในความหมายของบทบาทงาน กฎระเบียบ และค่านิยมร่วมกัน Smith จึงเสนอว่าเราต้องตอบสนองผ่านสามแนวทางหลักที่ทำงานร่วมกัน: ปรับทักษะ (reskilling/upskilling), เพิ่มความต้านทานทางสังคม (social resilience) และ เปลี่ยนนโยบาย (policy transformation) เพื่อให้การเปลี่ยนผ่านไม่ทิ้งใครไว้ข้างหลัง

สามแนวทางหลัก: แนวทางเชิงยุทธศาสตร์

1) ปรับทักษะ — การยกระดับทักษะที่เน้นความสามารถเฉพาะของมนุษย์ (เช่น การคิดเชิงวิพากษ์ ความคิดสร้างสรรค์ การดูแลเชิงสังคม และการตัดสินใจเชิงคุณค่า) พร้อมกับทักษะเชิงเทคนิคใหม่ ๆ ในการทำงานร่วมกับ AI ตัวอย่างงานศึกษาเช่น WEF (2020) ชี้ว่าแม้ AI จะทำให้ตำแหน่งงานบางอย่างหายไป แต่ยังสร้างบทบาทใหม่ ๆ ซึ่งทำให้บริบทของการเรียนรู้ตลอดชีวิตเป็นเรื่องจำเป็น

2) เพิ่มความต้านทานทางสังคม — สร้างระบบสนับสนุนที่ช่วยลดผลกระทบเชิงลบ เช่น เครือข่ายความมั่นคงทางรายได้ การเข้าถึงบริการฝึกอบรม และโครงสร้างการคุ้มครองแรงงานแบบพกพา เพื่อให้ประชาชนสามารถฟื้นตัวและเคลื่อนย้ายไปสู่โอกาสใหม่ได้เร็วขึ้น

3) เปลี่ยนนโยบาย — ปรับกรอบกติกาและมาตรฐานการกำกับดูแลให้ทันต่อเทคโนโลยี ตั้งแต่มาตรฐานความปลอดภัย การกำกับดูแลข้อมูลส่วนบุคคล ไปจนถึงแนวทางการทำงานแบบมีความรับผิดชอบ (accountability) และการประเมินผลกระทบก่อนการใช้งานในวงกว้าง

ข้อเสนอเชิงปฏิบัติสำหรับองค์กรและผู้กำหนดนโยบาย

- สำหรับองค์กร: ตั้งงบประมาณการเรียนรู้ (learning budget) เป็นสัดส่วนของค่าใช้จ่ายบุคลากร จัดเส้นทาง reskilling ที่เชื่อมโยงกับโอกาสเลื่อนตำแหน่ง สร้างตำแหน่งงานที่ออกแบบมาให้มนุษย์และเครื่องจักรทำงานร่วมกัน (human-AI teaming) และจัดให้มี red-team ด้านจริยธรรมเพื่อทดสอบความเสี่ยงเชิงสังคมก่อนนำระบบไปใช้จริง

- สำหรับผู้กำหนดนโยบาย: พัฒนาโครงการสนับสนุนการฝึกอบรมระดับชาติ (เช่น matching grants หรือเครดิตภาษีเพื่อการฝึกอบรม) ริเริ่ม sandbox กฎระเบียบสำหรับการทดลอง AI ในอุตสาหกรรมสำคัญ กำหนดมาตรฐานความโปร่งใสของโมเดลและการประเมินผลกระทบด้านสังคม และออกแบบเครือข่ายความคุ้มครองทางสังคมที่ยืดหยุ่น เช่น ระบบประกันการตกงานที่เชื่อมโยงกับโปรแกรม reskilling

- ความร่วมมือภาคสาธารณะ-เอกชน: สร้างพันธมิตรด้านการฝึกอบรมร่วมกับสถาบันการศึกษา สถาบันวิจัย และผู้ประกอบการ เพื่อออกแบบหลักสูตรที่ตลาดแรงงานต้องการ และใช้ข้อมูลองานจริงเป็นตัวขับเคลื่อนมาตรฐานการฝึกอบรม

แผนการดำเนินการระยะสั้น-กลาง-ยาว (เชิงปฏิบัติ)

- ระยะสั้น (1–2 ปี):

- สำรวจความเสี่ยงและโอกาสภายในองค์กรโดยใช้การวิเคราะห์งาน (job-task analysis) และจัดทำแผน reskilling เป้าหมาย

- ตั้งคณะกรรมการจริยธรรม AI ภายในหน่วยงาน และเริ่มโครงการนำร่อง (pilot) ที่มีการประเมินผลกระทบทางสังคม

- ผู้กำหนดนโยบายออกแนวทางชั่วคราวหรือ sandbox สำหรับการทดสอบเทคโนโลยี

- ระยะกลาง (3–5 ปี):

- ขยายโครงการฝึกอบรมเป็นมาตรฐานระดับอุตสาหกรรม เชื่อมโยงผลการเรียนกับการรับรองทักษะ

- พัฒนากรอบการกำกับดูแลถาวรที่รวมมาตรฐานความโปร่งใส การทดสอบความปลอดภัย และกลไกการตรวจสอบภายนอก

- ระยะยาว (5–15 ปี):

- สถาปนากลไกสากลหรือภูมิภาคสำหรับการประเมินความเสี่ยงของเทคโนโลยีที่มีผลกระทบสูง

- สร้างระบบสวัสดิการและตลาดแรงงานที่ยืดหยุ่น เช่น สวัสดิการแบบพกพา (portable benefits) และการสนับสนุนการเปลี่ยนอาชีพอย่างยั่งยืน

- ลงทุนในงานวิจัยระยะยาวเกี่ยวกับผลกระทบทางสังคมของ AI และการออกแบบนโยบายเชิงคาดการณ์

คำถามวิจารณ์ที่ผู้อ่านควรนำไปใช้ต่อ

เพื่อไม่ให้เป้าหมายเชิงนโยบายและเชิงองค์กรกลายเป็นคำสวยหรูที่ไม่ปฏิบัติได้ ผู้อ่านโดยเฉพาะผู้บริหารและผู้กำหนดนโยบายควรถามตัวเองอย่างสม่ำเสมอ:

- องค์กรของเรา: เรามีข้อมูลที่ชัดเจนพอที่จะระบุงานที่เสี่ยงและงานที่มีศักยภาพสูงในการร่วมงานกับ AI หรือไม่? แผน reskilling ของเราวัดผลอะไรและอย่างไร?

- ภาครัฐ: นโยบายของเราช่วยให้แรงงานเปลี่ยนผ่านได้จริงหรือแค่บรรเทาอาการชั่วคราว? มาตรการใดที่สามารถป้องกันการรวมศูนย์อำนาจทางเทคโนโลยีได้?

- เชิงจริยธรรมและสิทธิ: เรามีมาตรการเพียงพอที่จะรับประกันความรับผิดชอบต่อผลกระทบของ AI ต่อชุมชนเปราะบางหรือไม่? การตัดสินใจโดยระบบอัตโนมัติสามารถถูกทบทวนได้อย่างไร?

- การวัดผล: KPI ที่เหมาะสมสำหรับความสำเร็จคืออะไร (เช่น อัตราการเปลี่ยนอาชีพที่ประสบความสำเร็จ ระยะเวลาในการกลับเข้าสู่ตลาดงาน ฯลฯ) และเราจะเก็บข้อมูลเหล่านี้อย่างโปร่งใสได้อย่างไร?

สรุปคือ การอยู่ร่วมกับโลกที่ 'แปลก' ตามกรอบของ Smith ไม่ใช่เรื่องของการป้องกันการเปลี่ยนแปลง แต่เป็นการออกแบบการเปลี่ยนแปลงให้เป็นระบบ: ลงทุนในทักษะที่ยั่งยืน, สร้างโครงสร้างสังคมที่ทนทาน, และ ปรับนโยบายให้ทันและมีความรับผิดชอบ—ทั้งสามแนวทางนี้หากนำไปปฏิบัติร่วมกัน จะช่วยให้ภาคธุรกิจ รัฐ และพลเมืองสามารถควบคุมทิศทางของการเปลี่ยนแปลง แทนที่จะถูกกำหนดโดยมัน

บทสรุป

บทความสรุปว่าเทคโนโลยีปัญญาประดิษฐ์ได้เปลี่ยนทั้งโครงสร้างทางเศรษฐกิจและรูปแบบความรู้สึกของชีวิตประจำวันที่ทำให้โลกดู “แปลก” ขึ้น—จากการทำงานอัตโนมัติ การแนะนำเนื้อหาเชิงส่วนบุคคล ไปจนถึงอินเทอร์เฟซที่เปลี่ยนวิธีสื่อสารและรับรู้ของเรา ตัวอย่างเช่น ระบบแนะนำ (recommendation engines), ผู้ช่วยเสียง และระบบขับเคลื่อนอัตโนมัติต่างมีผลต่อพฤติกรรมการบริโภคและความเป็นส่วนตัว ข้อมูลเชิงสำรวจชี้ว่าองค์กรจำนวนมาก (มากกว่า 50% ในหลายการสำรวจเชิงตลาด) ได้นำ AI ไปปรับใช้ในกระบวนการทำงาน ซึ่งสะท้อนว่าการเปลี่ยนแปลงนี้เป็นเรื่องจริงจังและกำลังกระจายตัวอย่างรวดเร็ว อย่างไรก็ดี บทความย้ำว่า ความแปลกประหลาดที่เกิดขึ้นยังสามารถจัดการได้ผ่านนโยบายสาธารณะที่รัดกุม การศึกษาเชิงป้องกัน และการออกแบบเทคโนโลยีที่คำนึงถึงจริยธรรมเป็นหลัก

บทเรียนสำคัญจากความคิดของ Smith คือการยอมรับความไม่แน่นอนของยุค AI แต่ต้องเตรียมตัวเชิงรุกด้วยมาตรการที่จับต้องได้: การปรับทักษะและการพัฒนาต่อเนื่องของแรงงาน (reskilling/upskilling), การกำกับดูแลเชิงสาธารณะที่โปร่งใสและเอื้อต่อนวัตกรรม (เช่น กรอบกฎหมาย จรรยาบรรณ และ sandbox เชิงนโยบาย), และการเสริมสร้างความไว้วางใจในระบบข้อมูลผ่านความโปร่งใสและการตรวจสอบย้อนกลับของข้อมูลและโมเดล ในมุมมองอนาคต หากภาครัฐ ภาคธุรกิจ และภาคการศึกษาเร่งสร้างความพร้อมร่วมกัน—โดยมุ่งไปที่การเรียนรู้ตลอดชีวิต นโยบายระยะยาว และการออกแบบที่คำนึงถึงผลกระทบทางสังคม—โลกที่ดู “แปลก” จะกลายเป็นโอกาสในการสร้างความมั่นคงและความยืดหยุ่น มากกว่าจะเป็นภัยคุกคามในระยะกลางถึงระยะยาว

📰 แหล่งอ้างอิง: Calgary Herald