ในยุคที่โมเดลปัญญาประดิษฐ์ (AI) เริ่มมีบทบาทในการตัดสินใจเชิงธุรกิจและบริการสาธารณะ ความเสี่ยงจากการทำงานผิดพลาดหรือการล่วงละเมิดข้อมูลได้กลายเป็นประเด็นทางกฎหมายและการเงินที่องค์กรไม่อาจมองข้ามได้ ล่าสุด บริษัทประกันรายหนึ่งได้เปิดตัวผลิตภัณฑ์ใหม่ชื่อ "AI‑Liability Score" ที่ให้คะแนนความเสี่ยงของโมเดล AI ก่อนออกกรมธรรม์ พร้อมเสนอการปรับลดเบี้ยประกันเป็นแรงจูงใจเมื่อผู้พัฒนาและองค์กรปฏิบัติตามมาตรฐานความปลอดภัยและการกำกับดูแล ข้อเสนอนี้สะท้อนการเปลี่ยนแปลงเชิงนโยบายของอุตสาหกรรมประกันที่เริ่มนำการประเมินเทคนิคมาผนวกกับการบริหารความเสี่ยงเชิงนโยบาย

บทความนี้จะพาอ่านว่าการให้คะแนน "AI‑Liability Score" ทำงานอย่างไร—จากตัวชี้วัดเช่นความทนทาน (robustness), ความโปร่งใสและการอธิบายผล (explainability), การจัดการข้อมูลและความเป็นส่วนตัว ไปจนถึงการเฝ้าระวังหลังใช้งาน—พร้อมวิเคราะห์ผลกระทบต่อรูปแบบธุรกิจของผู้ให้บริการซอฟต์แวร์และองค์กรผู้ใช้งาน ทั้งในแง่ต้นทุนการพัฒนา ความรับผิดชอบด้านกฎหมาย และโอกาสในการลดเบี้ยประกัน นอกจากนี้ยังสรุปแนวปฏิบัติที่องค์กรควรเตรียมตั้งแต่การออกแบบโมเดล การทดสอบเชิงสาธิต ไปจนถึงการสร้างกระบวนการตรวจสอบเพื่อให้ได้รับคะแนนที่ดีและสิทธิประโยชน์ด้านค่าเบี้ย

บทนำ: ข่าวสรุป — ผลิตภัณฑ์ใหม่จากบริษัทประกัน

บทนำ: ข่าวสรุป — ผลิตภัณฑ์ใหม่จากบริษัทประกัน

บริษัทประกันเปิดตัวผลิตภัณฑ์ใหม่ภายใต้ชื่อ AI‑Liability Score ซึ่งออกแบบมาเพื่อประเมินและให้คะแนนความเสี่ยงของโมเดลปัญญาประดิษฐ์ (AI) ก่อนการออกกรมธรรม์ความรับผิดชอบ โดยมีเป้าหมายหลักเพื่อลดความไม่แน่นอนด้านความเสี่ยงสำหรับทั้งผู้พัฒนาและผู้ใช้โมเดล ผลิตภัณฑ์นี้ให้บริการการวิเคราะห์เชิงเทคนิคและนโยบายความเสี่ยง รวมถึงรายงานการประเมินสภาพแวดล้อมการพัฒนา ข้อมูลสแต็กทางเทคนิค มาตรการควบคุมข้อมูล และการจัดการเหตุการณ์เพื่อประกอบการตัดสินใจในการออกกรมธรรม์

บริการหลักของ AI‑Liability Score ประกอบด้วยการประเมินความเสี่ยงเชิงปริมาณ (score) แบบครบวงจร การให้คำแนะนำเชิงนโยบายและเทคนิคเพื่อแก้ไขจุดอ่อน การตรวจสอบความต่อเนื่อง (continuous monitoring) หลังออกกรมธรรม์ และตัวเลือกการรับรองมาตรฐานจากผู้ตรวจสอบอิสระ รายงานการให้คะแนนถูกออกแบบมาในรูปแบบเชิงมาตรฐานเพื่อเชื่อมโยงกับระดับค่าเบี้ยประกันที่แปรผันตามความเสี่ยง (risk‑based premium)

กลุ่มเป้าหมายของผลิตภัณฑ์ครอบคลุมตั้งแต่ ผู้พัฒนาโมเดล AI และ สตาร์ทอัปด้านเทคโนโลยี ไปจนถึง ธุรกิจขนาดกลางและใหญ่ที่นำโมเดล AI มาใช้ในงานปฏิบัติการหรือการตัดสินใจเชิงธุรกิจ เช่น บริษัทฟินเทคที่ใช้โมเดลให้คะแนนเครดิต, ผู้พัฒนาระบบแชทบอทเชิงพาณิชย์, และผู้ให้บริการวิเคราะห์ภาพหรือการแพทย์ที่ใช้โมเดลเชิงคลินิก ตัวอย่างการนำไปใช้จริงได้แก่ การประเมินความเสี่ยงของโมเดลภาษาขนาดใหญ่ก่อนให้บริการแก่ลูกค้าและการตรวจสอบโมเดลการให้สินเชื่ออัตโนมัติก่อนออกกรมธรรม์ความรับผิดชอบต่อบุคคลภายนอก

ในด้านสิทธิประโยชน์ทางการเงิน บริษัทระบุว่า ผู้เอาประกันที่ปฏิบัติตามมาตรฐานความปลอดภัยที่กำหนดจะได้รับส่วนลดเบี้ยประกัน ซึ่งตัวอย่างช่วงเปอร์เซ็นต์ส่วนลดที่ประกาศเป็นกรอบคือประมาณ 5–20% ขึ้นอยู่กับคะแนนความเสี่ยงที่ได้และการยืนยันการปฏิบัติตามอย่างต่อเนื่อง (เช่น การตรวจสอบโดยบุคคลที่สาม การรายงานเหตุการณ์และการติดตามแบบเรียลไทม์) โดยผู้ที่ผ่านการประเมินในระดับสูงสุดอาจได้รับส่วนลดเพิ่มเติมหรือเงื่อนไขพิเศษเกี่ยวกับวงเงินคุ้มครอง

บริษัทระบุว่าได้เปิดตัวผลิตภัณฑ์นี้เมื่อเร็ว ๆ นี้ และเริ่มให้บริการในระดับประเทศเป็นลำดับแรก โดยมีแผนขยายการให้บริการในระดับนานาชาติตามความต้องการของตลาดและความสอดคล้องกับกฎระเบียบท้องถิ่น ทั้งนี้การเปิดตัวสะท้อนถึงแนวโน้มที่องค์กรกว่า หลายสิบเปอร์เซ็นต์ ได้นำ AI มาใช้ในกระบวนการธุรกิจ ซึ่งเพิ่มความต้องการเครื่องมือประเมินความเสี่ยงเช่นนี้เพื่อสนับสนุนการตัดสินใจด้านการประกันภัยและการกำหนดยุทธศาสตร์การจัดการความเสี่ยง

AI‑Liability Score คืออะไร: แนวทางการให้คะแนนและเกณฑ์สำคัญ

AI‑Liability Score คืออะไร — ภาพรวมและวัตถุประสงค์

AI‑Liability Score เป็นกรอบการให้คะแนนเชิงปริมาณที่บริษัทประกันใช้วัดความเสี่ยงของโมเดลปัญญาประดิษฐ์ก่อนการออกกรมธรรม์ โดยมีเป้าหมายเพื่อประเมินช่องโหว่ที่อาจก่อให้เกิดความเสียหายทางการเงิน กฎหมาย หรือชื่อเสียง ทั้งนี้คะแนนถูกออกแบบมาให้เป็นมาตรฐานกลางสำหรับการเปรียบเทียบโมเดลหลายรุ่นและเป็นฐานในการพิจารณาสิทธิประโยชน์เช่นการปรับลดเบี้ยประกันเมื่อปฏิบัติตามเกณฑ์ความปลอดภัย

ปัจจัยและเกณฑ์สำคัญที่นำมาประเมิน

ระบบการให้คะแนนจะแยกองค์ประกอบความเสี่ยงเป็นหมวดหมู่ย่อย (sub‑scores) เพื่อให้การประเมินมีความจำเพาะและสามารถดำเนินการตรวจสอบได้อย่างเป็นระบบ ปัจจัยหลักที่มักถูกประเมิน ได้แก่:

- Robustness (ความทนทาน) — การทดสอบต่อการโจมตีแบบ adversarial, การทดสอบ noise/perturbation, การวัดความมั่นคงของผลลัพธ์เมื่อข้อมูลเข้าเบี่ยงเบน

- Explainability (ความสามารถอธิบาย) — การใช้เทคนิคเช่น SHAP, LIME หรือการมีโมดูลอธิบายที่ตรวจสอบได้ เพื่อให้ผลการตัดสินใจของโมเดลสามารถตรวจสอบได้

- Data governance (การบริหารจัดการข้อมูล) — การควบคุม lineage, versioning, การจัดเก็บ metadata, สิทธิการเข้าถึง และนโยบายการเก็บรักษาข้อมูล

- Bias testing (การทดสอบความลำเอียง) — การประเมิน fairness ด้วย metric เช่น demographic parity difference, equalized odds difference, disparate impact และการทดสอบตามกลุ่มย่อย (subgroup analysis)

- Security (ความมั่นคงปลอดภัยของระบบ) — การทดสอบ penetration testing, การเข้ารหัสข้อมูลขณะพักและขณะส่ง, การจัดการคีย์และการป้องกันข้อมูลฝั่งโมเดล

- Monitoring & incident response (การติดตามและตอบสนอง) — ระบบตรวจจับ drift (เช่น Population Stability Index, PSI < 0.1), การแจ้งเตือนผิดปกติ, การสำรองและการกู้คืน รวมทั้ง playbook ในการรับมือเหตุการณ์

วิธีการรวมคะแนนย่อยเป็นคะแนนรวมและการกำหนดน้ำหนัก

คะแนนสำหรับแต่ละปัจจัยมักกำหนดเป็นสเกลตัวเลข เช่น 0–100 แล้วนำมารวมเป็นคะแนนรวมด้วยวิธีการที่ชัดเจน เช่น weighted sum หรือการทำ normalization ก่อนรวม ตัวอย่างน้ำหนักเชิงนโยบายที่ใช้กันบ่อย:

- Robustness: 25%

- Bias testing: 20%

- Data governance: 20%

- Explainability: 15%

- Monitoring: 10%

- Security: 10%

สูตรตัวอย่าง (weighted sum): Score_total = 0.25*Score_robustness + 0.20*Score_bias + 0.20*Score_data + 0.15*Score_explain + 0.10*Score_monitor + 0.10*Score_security. ก่อนรวม องค์ประกอบบางตัวอาจถูกปรับด้วยเกณฑ์ขั้นต่ำ (minimum thresholds) เช่น ถ้า Security ต่ำกว่า 40 จะถูกปรับลดคะแนนรวมอย่างอัตโนมัติเพื่อสะท้อนความเสี่ยงเชิงระบบ

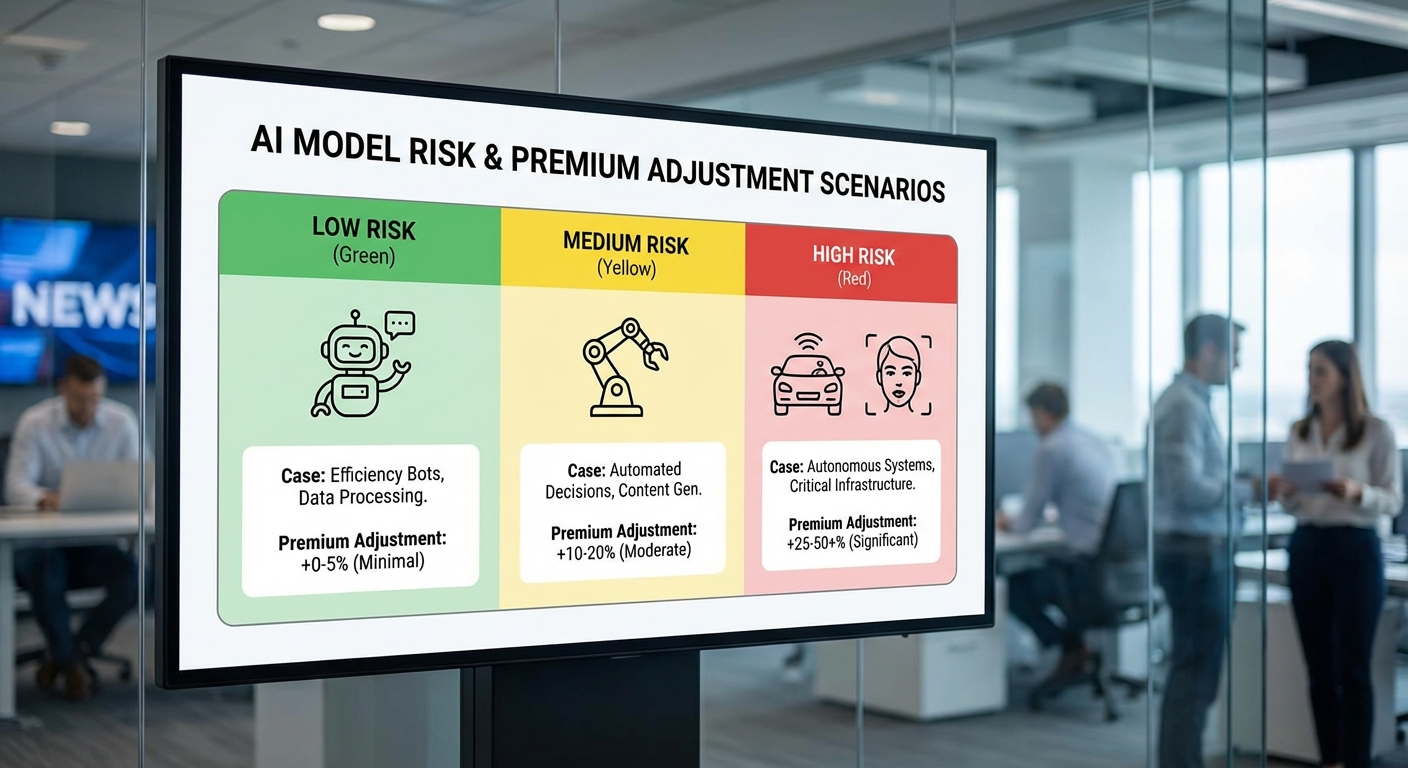

เกณฑ์ระดับความเสี่ยง (ต่ำ กลาง สูง) และตัวอย่างเชิงตัวเลข

เพื่อการตัดสินใจเชิงธุรกิจ คะแนนรวมมักถูกแมปเป็นระดับความเสี่ยงสามระดับ ตัวอย่างการกำหนดระดับ:

- ต่ำ (Low risk): คะแนนรวม 80–100 — ถือว่ามาตรฐานความปลอดภัยและการกำกับดูแลอยู่ในระดับดีเยี่ยม เหมาะสำหรับการพิจารณาเบี้ยส่วนลด

- กลาง (Medium risk): คะแนนรวม 50–79 — ต้องมีการปรับปรุงตามข้อเสนอแนะก่อนต่ออายุกรมธรรม์เต็มรูปแบบ

- สูง (High risk): คะแนนรวม <50 — ความเสี่ยงสูง อาจถูกจำกัดความคุ้มครองหรือปฏิเสธการออกกรมธรรม์โดยไม่มีการชดเชย

ตัวอย่างเชิงตัวเลขสมมติ: โมเดล A ได้คะแนนย่อยเป็น Robustness=70, Bias=55, Data governance=80, Explainability=65, Monitoring=60, Security=50 → คะแนนรวม = 0.25*70 + 0.20*55 + 0.20*80 + 0.15*65 + 0.10*60 + 0.10*50 = 64.25 → จัดเป็น ความเสี่ยงระดับกลาง

ตัวชี้วัดเชิงปฏิบัติ เช่น การทดสอบ adversarial อาจกำหนดว่า attack success rate มากกว่า 20% เป็นสัญญาณเตือน ในขณะที่โมเดลที่มี adversarial accuracy เกิน 95% และ PSI ต่ำกว่า 0.1 ในการติดตาม 3 เดือนจะได้คะแนนสูงกว่ามาก

กระบวนการประเมิน: on‑site, remote และ third‑party validation

การประเมินความเสี่ยงประกอบด้วยหลายรูปแบบเพื่อให้ได้มุมมองที่ครบถ้วน:

- Remote assessment: การส่งชุดเอกสาร, logs, model artifacts และการรันชุดทดสอบอัตโนมัติ (automated test suite) ผ่านช่องทางปลอดภัย ผู้ประเมินจะประมวลผลผลลัพธ์และรายงานข้อบกพร่อง

- On‑site audit: การเยี่ยมหน้างานเพื่อเข้าถึงสภาพแวดล้อมการพัฒนาและโครงสร้างพื้นฐาน เช่น การตรวจสอบการควบคุมการเข้าถึง, กระบวนการ CI/CD และการสัมภาษณ์ทีมวิศวกร/ผู้ออกแบบ

- Third‑party validation: การจ้างผู้เชี่ยวชาญอิสระหรือห้องทดลองเพื่อทำ penetration test, red‑team adversarial attacks, และการทดสอบ fairness แบบล้ำลึก เพื่อให้มีความเป็นกลางและเชื่อถือได้ยิ่งขึ้น

กระบวนการมักรวมทั้งการวิเคราะห์เชิงปริมาณ (เช่นการรัน adversarial toolkit, คำนวณ fairness metrics, วัด PSI/KL divergence) และการวิเคราะห์เชิงคุณภาพ (เช่น ตรวจสอบนโยบาย data retention และการสืบย้อน lineage) เพื่อให้ผลจากการประเมินสามารถนำไปปฏิบัติได้จริง

ตัวอย่างการทดสอบเชิงเทคนิคที่ใช้ในการให้คะแนน

ตัวอย่างการทดสอบเชิงเทคนิคที่ป้อนเข้าไปยังกระบวนการให้คะแนนได้แก่:

- Adversarial testing (เช่น FGSM, PGD, CW) — รายงานค่า attack success rate และ robust accuracy

- Fairness evaluation — คำนวณ demographic parity difference, equalized odds difference, disparate impact และการวิเคราะห์ subgroup

- Data drift monitoring — ใช้ PSI, population histograms หรือการทดสอบ Kolmogorov‑Smirnov เพื่อวัดการเปลี่ยนแปลงของ distribution

- Explainability checks — ตรวจสอบว่ามีการสร้าง feature attributions (SHAP/LIME) และการแปลผลที่ผ่านการตรวจสอบโดยผู้เชี่ยวชาญหรือไม่

- Security checks — penetration test, model extraction risk assessment, และการตรวจสอบการเข้ารหัส/การจัดการคีย์

โดยสรุป AI‑Liability Score ทำหน้าที่เป็นกรอบมาตรฐานเชิงปริมาณที่ช่วยให้บริษัทประกันและลูกค้าเข้าใจความเสี่ยงของโมเดลอย่างชัดเจน ทั้งในเชิงเทคนิคและการกำกับดูแล กระบวนการรวมถึงการทดสอบเชิงลึก การตรวจสอบภาคสนาม และการยืนยันจากบุคคลที่สาม ซึ่งช่วยสนับสนุนการตัดสินใจด้านการประกันและการมอบรางวัลเชิงนโยบายเช่นการปรับลดเบี้ยเมื่อปฏิบัติตามมาตรฐานที่กำหนด

การใช้คะแนนในการวางนโยบายและการกำหนดเบี้ยประกัน

การใช้คะแนนในการวางนโยบายและการกำหนดเบี้ยประกัน

AI‑Liability Score ถูกนำมาเป็นปัจจัยหลักในการประเมินความเสี่ยงเพื่อกำหนดเบี้ยประกัน (underwriting) โดยบริษัทจะผสานคะแนนนี้เข้ากับการคำนวณความเสี่ยงเชิงปริมาณ (actuarial) ซึ่งประกอบด้วยค่าคาดการณ์ความเสียหาย (expected loss), ความไม่แน่นอน (volatility) และต้นทุนการบริหารความเสี่ยง สำหรับการใช้งานจริง บริษัทมักใช้รูปแบบการคำนวณดังนี้: กำหนดเบี้ยฐาน (base premium) จากโมเดลทางการเงิน จากนั้นปรับด้วยตัวคูณความเสี่ยงที่ได้จากการแม็ปคะแนนเป็นระดับความเสี่ยง (risk multiplier) ก่อนนำไปคำนวณส่วนลดตามมาตรฐานการปฏิบัติตาม (compliance-based discounts).

ตัวอย่างวิธีการแม็ปคะแนนสู่ค่าเบี้ย: สมมติว่ามีคะแนน AI‑Liability อยู่ในระดับ 0–100 บริษัทกำหนดช่วง (band) และตัวคูณความเสี่ยง เช่น

- Score ≥ 90: risk multiplier = 0.8

- Score 75–89: risk multiplier = 1.0

- Score 50–74: risk multiplier = 1.3

- Score < 50: risk multiplier = 1.7

โมเดลส่วนลด (Discount tiers) ของผลิตภัณฑ์นี้ถูกออกแบบให้จูงใจองค์กรให้ยกระดับมาตรการความปลอดภัยและการกำกับดูแล โดยตัวอย่างรูปแบบส่วนลดมีดังนี้:

- Top‑tier (คะแนน ≥ 95): ลดเบี้ย 15% หากองค์กรผ่านการประเมินมาตรฐานความปลอดภัยครบถ้วน และมีการทดสอบภายนอก (third‑party audit) ภายใน 12 เดือนก่อนการออกกรมธรรม์

- High‑tier (คะแนน 85–94): ลดเบี้ย 10% เมื่อมีนโยบายการจัดการข้อมูลและการทดสอบ robustness ภายในองค์กร

- Mid‑tier (คะแนน 70–84): ลดเบี้ย 5% เมื่อมีการติดตามและรายงานความผิดพลาด (incident logging) เป็นประจำ

- Low‑tier (คะแนน <70): ไม่มีส่วนลดและอาจมีข้อจำกัดความคุ้มครอง

ตัวอย่างสถานการณ์ทางการเงิน (สมมติ) — เพื่อให้เห็นผลกระทบต่อเบี้ยประกัน สมมติ Base premium = 1,000,000 บาทต่อปี:

- กรณี Top‑tier (Score 96): risk multiplier = 0.8 → เบี้ยก่อนส่วนลด = 1,000,000 × 0.8 = 800,000 บาท → ลด 15% → เบี้ยสุทธิ = 680,000 บาท/ปี

- กรณี High‑tier (Score 88): risk multiplier = 1.0 → เบี้ยก่อนส่วนลด = 1,000,000 × 1.0 = 1,000,000 บาท → ลด 10% → เบี้ยสุทธิ = 900,000 บาท/ปี

- กรณี Mid‑tier (Score 75): risk multiplier = 1.3 → เบี้ยก่อนส่วนลด = 1,000,000 × 1.3 = 1,300,000 บาท → ลด 5% → เบี้ยสุทธิ = 1,235,000 บาท/ปี

- กรณี Low‑tier (Score 45): risk multiplier = 1.7 → เบี้ยก่อนส่วนลด = 1,000,000 × 1.7 = 1,700,000 บาท → ไม่มีส่วนลด → เบี้ยสุทธิ = 1,700,000 บาท/ปี

ข้อกำหนดหลังการออกกรมธรรม์ (Post‑issuance requirements) — เพื่อรักษาความถูกต้องของการให้ส่วนลดและบริหารความเสี่ยงอย่างต่อเนื่อง บริษัทประกันจะกำหนดเงื่อนไขผูกพันหลังการออกกรมธรรม์ ดังนี้

- การมอนิเตอร์ต่อเนื่อง: ผู้เอาประกันต้องจัดให้มีการมอนิเตอร์ระบบ AI เป็นประจำ (เช่น รายงานเชิงเทคนิครายไตรมาส) และมีการทำการทดสอบความทนทาน (stress/robustness tests) อย่างน้อยปีละ 1 ครั้ง

- การรายงานเหตุการณ์: ต้องแจ้งบริษัทประกันทันทีในกรณีเกิดเหตุการณ์ที่อาจก่อให้เกิดความเสี่ยงหรือความเสียหาย (incidents, near misses) ภายในระยะเวลาที่กำหนด เช่น 72 ชั่วโมงหลังทราบเหตุ

- เงื่อนไขการต่ออายุ: ณ การต่ออายุกรมธรรม์ บริษัทจะนำคะแนนล่าสุดและรายงานการมอนิเตอร์มาทบทวน หากคะแนนปรับลดลงหรือมีเหตุการณ์สำคัญ บริษัทมีสิทธิปรับเบี้ย เพิ่มค่าคุ้มครองแบบมีเงื่อนไข หรือต้องการให้มีการแก้ไข (remediation) ภายในกรอบเวลาที่กำหนด

- การตรวจสอบสิทธิ์ (audit rights): บริษัทประกันอาจขอสิทธิ์ในการตรวจสอบภายในหรือมอบหมายให้บุคคลที่สามทำการตรวจประเมิน เพื่อยืนยันความสอดคล้องกับข้อผูกพัน

- บทลงโทษและการเรียกร้องคืนส่วนลด: หากตรวจพบการไม่ปฏิบัติตามข้อกำหนด บริษัทอาจเรียกคืนส่วนลด คำนวณเบี้ยย้อนหลัง หรืองดความคุ้มครองบางส่วนตามเงื่อนไขในกรมธรรม์

สรุป — การนำ AI‑Liability Score มาใช้ในการวางนโยบายและกำหนดเบี้ยประกันเป็นเครื่องมือที่ช่วยเชื่อมโยงความเสี่ยงเชิงเทคนิคกับผลกระทบทางการเงินอย่างเป็นระบบ โดยโมเดลเบี้ยจะผสานการแม็ปคะแนนเป็นตัวคูณความเสี่ยงและกลไกส่วนลดเชิงจูงใจ ขณะเดียวกันข้อผูกพันหลังการออกกรมธรรม์ เช่น การมอนิเตอร์ รายงานเหตุการณ์ และการตรวจสอบ จะเป็นกลไกสำคัญที่ช่วยรักษาความถูกต้องของการประเมินและป้องกันการลดทอนความปลอดภัยหลังจากได้รับส่วนลดแล้ว

ตัวอย่างกรณีศึกษาและสถิติประกอบ: ผลกระทบเชิงปฏิบัติ

ตัวอย่างกรณีศึกษาและสถิติประกอบ: ผลกระทบเชิงปฏิบัติ

ส่วนนี้นำเสนอกรณีตัวอย่างเชิงปฏิบัติ 2–3 กรณี พร้อมการคาดการณ์เชิงสถิติ เพื่อให้เห็นภาพว่าโมเดล AI‑Liability Score ส่งผลอย่างไรต่อเบี้ยประกัน ความเสี่ยงทางการเงิน และการตัดสินใจเชิงกลยุทธ์ของทั้งทีมพัฒนาและฝ่ายบริหารระดับสูง ข้อมูลบางส่วนเป็นการประเมินเชิงสมมติบนพื้นฐานของหลักการประเมินความเสี่ยงทางเทคโนโลยีและงานวิจัยเชิงกว้างในอุตสาหกรรม

กรณีที่ 1 — สตาร์ทอัปฟินเทค: ลดเบี้ยประกัน 12% หลังแก้ปัญหา Bias

สตาร์ทอัปด้านการให้สินเชื่อออนไลน์ได้รับการประเมินโดย AI‑Liability Score และได้คะแนนความเสี่ยงระดับปานกลางถึงสูง เนื่องจากการทดสอบ bias พบความลำเอียงในการตัดสินสินเชื่อที่กระทบต่อกลุ่มประชากรบางกลุ่ม บริษัทดำเนินมาตรการแก้ไขที่ชัดเจน ได้แก่ การปรับชุดข้อมูลฝึกสอน (rebalancing), การเพิ่มตัวตรวจจับ bias แบบอัตโนมัติใน pipeline และการปรับปรุงเอกสารการออกแบบโมเดล (model cards) ผลลัพธ์เชิงการเงินหลังการปรับปรุงคือบริษัทสามารถขอเบี้ยประกันที่ลดลงได้ 12% จากอัตราที่เสนอเดิม (ตัวอย่างสมมติ: จากเบี้ยปีละ 1,000,000 บาท เหลือ 880,000 บาท) และบริษัทประเมินว่าความเสี่ยงการเรียกร้องค่าสินไหมจากความผิดพลาดด้านการตัดสินลดลงประมาณ 18% ในรอบปีแรกหลังการปรับปรุง

กรณีที่ 2 — ผู้ให้บริการสาธารณะ: ถูกปฏิเสธกรมธรรม์เนื่องจากคะแนนสูง

หน่วยงานบริการสาธารณะขนาดกลางที่พัฒนาระบบจัดสรรทรัพยากรอัตโนมัติถูกประเมินและได้คะแนนความเสี่ยงสูง สาเหตุหลักมาจากขาดกระบวนการตรวจสอบย้อนกลับ (lack of explainability), การขาดแนวทางการทดสอบแบบ stress test และไม่มีแผนตอบโต้เหตุผิดพลาด (incident response) ผู้ให้บริการประกันแจ้งปฏิเสธกรมธรรม์หรือเสนอเฉพาะเงื่อนไขที่มีข้อยกเว้นมากขึ้น ส่งผลให้หน่วยงานต้องรับความเสี่ยงเอง (self-insure) หรือจัดสรรงบประมาณสำรองเพิ่มขึ้น ตัวเลขสมมติแสดงว่าในกรณีนี้การปฏิเสธกรมธรรม์ทำให้หน่วยงานต้องจัดสรรทุนสำรองเพิ่มขึ้นราว 20–35% ของค่าใช้จ่ายที่คาดว่าจะเกิดขึ้นจากเหตุการณ์ที่เกี่ยวข้องกับ AI ต่อปี นอกจากนี้ยังมีค่าใช้จ่ายทางอ้อมจากการต้องหยุดระบบชั่วคราวเพื่อแก้ไขและทบทวนกระบวนการ

กรณีที่ 3 — ผู้ให้บริการโลจิสติกส์: ลดความเสียหายจากข้อผิดพลาดของ AI ประมาณ 15–30%

บริษัทโลจิสติกส์ที่ใช้โมเดลทำนายเส้นทางและการจัดสรรยานพาหนะนำมาตรการตามข้อเสนอของ AI‑Liability Score เช่น การติดตั้งระบบ monitor แบบเรียลไทม์, การทดสอบ A/B ก่อนเปลี่ยนโมเดล production และการจัดตั้งคณะกรรมการตรวจสอบความเป็นธรรมของโมเดล ผลลัพธ์เบื้องต้นชี้ว่าอัตราความผิดพลาดในการจัดส่งลดลง ส่งผลให้ต้นทุนการแก้ไขข้อผิดพลาด (เช่น ค่าขนส่งซ้ำ ค่าสินไหมความเสียหาย) ลดลงประมาณ 15–30% ภายใน 12 เดือน ซึ่งหมายถึงการลดค่าใช้จ่ายรวมจากข้อผิดพลาดของระบบ AI เป็นมูลค่าหลายล้านบาทต่อปีสำหรับองค์กรระดับกลางถึงใหญ่อย่างสมมติ

การคาดการณ์เชิงสถิติและการประเมินผลกระทบโดยรวม

จากการสังเคราะห์กรณีจริงและงานศึกษาเชิงกว้างในอุตสาหกรรม สามารถสรุปแนวโน้มเชิงตัวเลขได้ดังนี้ (เป็นการประเมินโดยอิงหลักการบริหารความเสี่ยง):

- การลดอุบัติการณ์ข้อผิดพลาดที่มีผลต่อผู้ใช้ ประมาณ 10–30% เมื่อองค์กรบังคับใช้มาตรการความปลอดภัยและการตรวจสอบอย่างต่อเนื่อง

- การลดค่าใช้จ่ายการเรียกร้องค่าสินไหม ประมาณ 15–25% เมื่อมีการตรวจจับ bias และเพิ่ม explainability ก่อนนำสู่ production

- การปรับเบี้ยประกัน สามารถลดได้ตั้งแต่ 5–20% ขึ้นกับระดับความเสี่ยงที่ลดได้และหลักฐานการปฏิบัติตามมาตรฐาน (เช่น ISO/IEEE ที่เกี่ยวข้อง)

- ความเสี่ยงที่ถูกปฏิเสธกรมธรรม์หรือถูกจำกัดความคุ้มครอง จะเกิดขึ้นกับองค์กรที่ไม่สามารถแสดงหลักฐานการควบคุมความเสี่ยงหรือไม่มีมาตรการตอบโต้ที่เป็นรูปธรรม ซึ่งอาจเพิ่มต้นทุนรวมทางการเงินได้ 20% ขึ้นไป

บทเรียนสำคัญสำหรับทีมพัฒนาและ C-suite

- สำหรับทีมพัฒนา: ให้ความสำคัญกับการทดสอบ bias, การสร้าง pipeline สำหรับการตรวจสอบแบบอัตโนมัติ, และการบันทึกข้อมูลเชิงตรวจสอบ (audit trails) เพื่อพิสูจน์การปฏิบัติตามมาตรฐาน เมื่อลดความเสี่ยงเชิงเทคนิคได้ทันที จะสะท้อนเป็นค่าเบี้ยที่ลดลงและการยอมรับจากตลาด

- สำหรับ C-suite: ควรพิจารณา AI‑Liability Score เป็นส่วนหนึ่งของกระบวนการบริหารความเสี่ยงระดับองค์กร การลงทุนในมาตรการป้องกันเชิงรุกมักจะคุ้มค่ากว่าการรับความเสี่ยงเองหรือถูกปฏิเสธกรมธรรม์ ควรเชื่อมโยงการประเมินคะแนนกับนโยบายการถือครองทุนสำรองและกลยุทธ์การโอนความเสี่ยง

- การสื่อสารข้ามหน่วยงาน: ข้อมูลคะแนนและข้อเสนอแนะจากการประเมินต้องถูกแปลเป็น KPI ที่จับต้องได้ เช่น อัตราการลดข้อผิดพลาด, ระยะเวลาเฉลี่ยในการตรวจจับ (MTTD), และเวลาเฉลี่ยในการแก้ไข (MTTR) เพื่อให้ฝ่ายบริหารสามารถตัดสินใจเชิงการเงินได้ชัดเจน

- การพิสูจน์ผลลัพธ์ด้วยข้อมูล: เอกสารการปฏิบัติตาม (evidence) เช่น รายงานการทดสอบ, model cards, audit log และแผนการตอบโต้เหตุการณ์ เป็นสิ่งจำเป็นสำหรับการต่อรองเบี้ยและแสดงความโปร่งใสต่อผู้ประเมินความเสี่ยง

สรุปคือ AI‑Liability Score ไม่เพียงเป็นเครื่องมือประเมินความเสี่ยงเชิงนโยบายเท่านั้น แต่ยังเป็นจุดเริ่มต้นของการเปลี่ยนแปลงเชิงปฏิบัติที่สามารถลดค่าใช้จ่ายและความเสี่ยงได้จริง หากองค์กรลงมือทำตามคำแนะนำและสร้างกระบวนการรองรับอย่างต่อเนื่อง

ประเด็นด้านเทคนิค กฎหมาย และจริยธรรมที่ต้องพิจารณา

ประเด็นด้านเทคนิค กฎหมาย และจริยธรรมที่ต้องพิจารณา

ความเป็นส่วนตัวและการจัดการข้อมูล (Privacy & Data Lineage) — การให้คะแนนความเสี่ยงของโมเดล (AI‑Liability Score) ขึ้นอยู่กับข้อมูลทั้งจากระบบภายใน ลูกค้า และผู้พัฒนารองรับ การเก็บรวบรวม การประมวลผล และการเปิดเผยข้อมูลเหล่านี้ต้องสอดคล้องกับข้อกฎหมายคุ้มครองข้อมูลส่วนบุคคล (เช่น GDPR ที่กำหนดค่าปรับสูงสุดถึง 4% ของรายได้รวมโลกหรือ €20 ล้าน ในกรณีละเมิดที่ร้ายแรง) รวมถึงข้อกำหนดการโอนข้อมูลข้ามพรมแดน เทคนิคปฏิบัติที่จำเป็นได้แก่ data minimization, การทำ pseudonymization/ anonymization, การเข้ารหัสขณะพักและขณะส่ง, การจำกัดสิทธิ์เข้าถึง และการเก็บรักษาระยะเวลาที่ชัดเจน นอกจากนี้ต้องมีระบบ data lineage และเวอร์ชันข้อมูล (provenance & versioning) เพื่อให้สามารถสืบย้อนที่มาของตัวอย่างข้อมูล การเปลี่ยนแปลง preprocessing และชุดเทรนได้เมื่อเกิดข้อพิพาทหรือจำเป็นต้องตรวจสอบผลการประเมิน

ความโปร่งใสและการอธิบายโมเดล (Explainability & Transparency) — ลูกค้าและฝ่ายที่เกี่ยวข้องมีสิทธิที่จะเข้าใจว่าคะแนนความเสี่ยงมาจากปัจจัยใด โดยเฉพาะเมื่อคะแนนนั้นส่งผลต่อเบี้ยประกันหรือการรับประกัน กรอบการปฏิบัติที่ควรนำมาใช้ประกอบด้วยการเปิดเผย model cards และ datasheets for datasets ที่ชี้แจงสถาปัตยกรรมโมเดล ขอบเขตการใช้งาน ข้อมูลฝึก และข้อจำกัด พร้อมการระบุตัวชี้วัดความไม่แน่นอน (uncertainty estimates) และตัวบ่งชี้ความเชื่อถือได้ (confidence, calibration) สำหรับผลลัพธ์ที่อาจส่งผลกระทบสำคัญ การใช้วิธีอธิบายทั้งในระดับกว้าง (global explanations) และระดับตัวอย่าง (local explanations) จะช่วยให้การตัดสินใจโปร่งใสขึ้น ตัวอย่างเช่น การแสดงรายการปัจจัยหลักที่ทำให้คะแนนสูงขึ้น (เช่น ข้อมูลสถิติขาดความสมดุล ความเสี่ยงจาก third‑party API) พร้อมแนวทางลดความเสี่ยงที่ชัดเจน จะช่วยให้ลูกค้าตัดสินใจได้โดยมีข้อมูลเพียงพอ

ความลำเอียง (Bias) และการประเมินความเป็นธรรม — โมเดลที่ประเมินโดยบริษัทประกันต้องผ่านการทดสอบความลำเอียงเชิงสถิติและเชิงผลกระทบ ไม่เพียงแต่การตรวจสอบความสมดุลของชุดข้อมูลเท่านั้น แต่ต้องทดสอบผลลัพธ์ต่อกลุ่มย่อยทางสังคม เศรษฐกิจ และเชื้อชาติ ตัวอย่างในอดีต เช่น คดีวิจัยเกี่ยวกับระบบประเมินความเสี่ยงด้านอาญา (COMPAS) แสดงให้เห็นว่าโมเดลสามารถสร้างความลำเอียงที่ไม่ตั้งใจได้ จึงควรกำหนดชุดตัวชี้วัดความเป็นธรรม (เช่น demographic parity, equalized odds, disparate impact) และค่าเกณฑ์ที่ยอมรับได้ พร้อมแผนการบรรเทา (rebalancing, reweighting, counterfactual testing) และการทดสอบอย่างต่อเนื่องหลังออกสู่การใช้งาน (continuous monitoring)

ผลทางกฎหมายและความรับผิด (Legal Liability & Disclosure) — การออกผลิตภัณฑ์ที่รวมคะแนนความเสี่ยงต้องคำนึงถึงประเด็นทางกฎหมายหลายมิติ ได้แก่ ขอบเขตความรับผิดของผู้ให้บริการประกัน บริษัทพัฒนาโมเดล และลูกค้าเอง สัญญากรมธรรม์ต้องมีการเปิดเผยเงื่อนไขอย่างชัดเจน เช่น วิธีคำนวณคะแนน ความหมายของระดับความเสี่ยง เงื่อนไขการลดเบี้ยและข้อกำหนดการปฏิบัติตามมาตรการลดความเสี่ยง รวมถึงช่องทางอุทธรณ์หรือทบทวนคะแนน นอกจากนี้ควรกำหนดข้อกำหนดทางสัญญาเกี่ยวกับการชดเชย (indemnity), การจำกัดความรับผิด (liability caps), และหน้าที่ในการแจ้งเหตุ (breach notification) เมื่อเกิดเหตุผิดพลาดหรือรั่วไหลของข้อมูล

- มาตรฐานที่ควรนำมาใช้เป็นเกณฑ์: ผสมผสานมาตรฐานความมั่นคงข้อมูล เช่น ISO/IEC 27001 กับแนวทางเฉพาะด้าน AI เช่น NIST AI Risk Management Framework (AI RMF) และเอกสารแนวทางของหน่วยงานกำกับดูแลในพื้นที่ที่บริษัทดำเนินการ

- การเปิดเผยต่อผู้เอาประกัน: ให้ลูกค้าเข้าถึงสรุปเชิงเหตุผล (plain‑language summary) ของคะแนนองค์ประกอบที่สำคัญ พร้อมคู่มือมาตรการที่ต้องดำเนินเพื่อรับส่วนลดเบี้ย

- การตรวจสอบโดยภายนอก: จัดให้มีการ audit โดย third‑party auditor หรือหน่วยงานอิสระเพื่อลดความเสี่ยงการจัดทำคะแนนที่เป็นส่วนตัวหรือมีผลประโยชน์ทับซ้อน

คำแนะนำเชิงปฏิบัติสำหรับ Compliance — เพื่อให้บริการ AI‑Liability Score ปลอดภัยและสอดคล้องกับกฎหมาย บริษัทควรจัดทำนโยบายและกระบวนการที่ชัดเจนดังนี้:

- ทำ Data Protection Impact Assessment (DPIA) ก่อนเปิดใช้งาน เพื่อประเมินความเสี่ยงต่อสิทธิและเสรีภาพของผู้เกี่ยวข้องและออกมาตรการบรรเทา

- จัดทำเอกสารเชิงเทคนิค ได้แก่ model cards, datasheets, audit logs, และ data lineage records ที่พร้อมนำส่งเป็นหลักฐานในการตรวจสอบ

- กำหนดเกณฑ์การอธิบายผล ที่จะนำเสนอแก่ลูกค้าในรูปแบบที่เข้าใจง่าย รวมทั้งช่องทางอุทธรณ์และการขอทบทวนคะแนน

- ทดสอบความลำเอียงเชิงระบบ และกำหนดค่าเกณฑ์ยอมรับได้ พร้อม roadmap สำหรับการบรรเทาเมื่อพบอคติ

- รวมข้อกำหนดสัญญาที่ชัดเจน ระหว่างบริษัทประกัน ผู้พัฒนาเทคโนโลยี และลูกค้า ระบุขอบเขตความรับผิด การชดเชย และหน้าที่ในการแจ้งเหตุ

- กำหนดกระบวนการตรวจสอบและการเฝ้าระวัง หลังการนำสู่การใช้งาน (monitoring, retraining triggers, incident response) พร้อมบันทึกและรายงานตามข้อกำหนดของหน่วยงานกำกับดูแล

- ฝึกอบรมและการกำกับดูแลภายใน ให้ทีมประกันและทีมเทคนิคมีความเข้าใจในความเสี่ยงเชิงเทคนิคและกฎหมาย รวมถึงจริยธรรม AI

การผสมผสานมาตรการทางเทคนิค นโยบายภายใน และข้อสัญญาทางกฎหมายที่ชัดเจนเป็นสิ่งจำเป็นเพื่อให้ผลิตภัณฑ์ AI‑Liability Score สามารถสร้างมูลค่าโดยไม่สร้างความเสี่ยงต่อบุคคลหรือองค์กร การยึดแนวทางมาตรฐานสากลและการเปิดเผยข้อมูลอย่างเหมาะสมจะช่วยลดความเสี่ยงทางกฎหมายและจริยธรรม พร้อมสร้างความเชื่อมั่นให้ลูกค้าและผู้กำกับดูแล

ผลกระทบต่อภาคธุรกิจและภาพรวมตลาด

ผลกระทบต่อภาคธุรกิจและภาพรวมตลาด

การเปิดตัวผลิตภัณฑ์ AI‑Liability Score จะเป็นตัวเร่งสำคัญที่เปลี่ยนพฤติกรรมการบริหารความเสี่ยงขององค์กรอย่างมีนัยสำคัญ เพราะการเชื่อมโยงคะแนนความเสี่ยงกับการปรับลดเบี้ยประกันทำให้องค์กรมีแรงจูงใจทางการเงินในการลงทุนเพื่อปรับปรุงมาตรการควบคุมโมเดล AI มากขึ้น เบื้องต้นเราประเมินเชิงสมมติว่าองค์กรขนาดกลางถึงใหญ่จะเพิ่มงบประมาณด้าน model governance และการประเมินความเสี่ยง AI ขึ้นประมาณ 25–40% ภายใน 12–24 เดือนหลังการเปิดตัว หากส่วนลดเบี้ยประกันที่ได้มีมูลค่าทัดเทียมกับค่าใช้จ่ายในการเสริมความปลอดภัย

ผลโดยตรงที่เห็นได้ชัดคือการย้ายงบประมาณจากโครงการนวัตกรรมด้านฟีเจอร์สู่การลงทุนด้านความน่าเชื่อถือ (reliability), การตรวจสอบ (validation), ความโปร่งใส (explainability) และการทดสอบความปลอดภัยของโมเดล (adversarial testing) ตัวอย่างเช่น บริษัทที่มีรายได้รวมมากกว่า 1 พันล้านดอลลาร์อาจจัดสรรงบประมาณเพิ่มเติมเพื่อทีม MLOps และการรับรองความปลอดภัยของโมเดลเป็นมูลค่า 5–15 ล้านดอลลาร์ต่อปี การสำรวจเชิงสมมติในกลุ่มผู้บริหารด้านไอทีและความเสี่ยง (n=300) ระบุว่า 68% มีแนวโน้มจะลงทุนเพิ่มเติมหากสามารถรับส่วนลดเบี้ยประกันได้อย่างเป็นรูปธรรม

ในแง่อุตสาหกรรมประกันภัย ผลิตภัณฑ์แบบใหม่นี้จะผลักดันให้เกิดการปรับรูปแบบการวินิจฉัยความเสี่ยงและโครงสร้างราคา (underwriting) ของประกันภัยไอที โดยจะเห็นความหลากหลายของผลิตภัณฑ์มากขึ้น เช่น การให้คะแนนภายใต้เกณฑ์มาตรฐานต่างกัน ซึ่งนำไปสู่ผลิตภัณฑ์ที่เป็น risk-based pricing, การประกันแบบที่รวมบริการตรวจสอบต่อเนื่อง (continuous monitoring) และบริการตอบโต้เหตุฉุกเฉินเฉพาะทาง นอกจากนี้ บริษัทประกันที่มีความสามารถในการพัฒนาวิธีการให้คะแนนที่น่าเชื่อถือและร่วมมือกับสถาบันตรวจสอบอิสระหรือผู้ให้บริการ MLOps จะได้เปรียบในการแข่งขันและอาจขยายส่วนแบ่งตลาดได้อย่างชัดเจน — เราประเมินเชิงสมมติว่าภายใน 3 ปี ราว 30% ของเบี้ยประกันด้านความเสี่ยงไอทีอาจย้ายมาอยู่ในผลิตภัณฑ์ที่เฉพาะทางสำหรับ AI

แนวโน้มการยอมรับขององค์กรจะขึ้นอยู่กับปัจจัยเร่งและปัจจัยชะลอหลายประการ โดยคาดการณ์การยอมรับคร่าว ๆ ดังนี้: ภายใน 12 เดือนจะเป็นกลุ่มผู้ใช้เบื้องต้น (early adopters) ประมาณ 15–25% ขององค์กรขนาดใหญ่; ภายใน 1–3 ปี การยอมรับอาจขยับเป็น 45–60% หากมีการรับรองมาตรฐานและผลประโยชน์ทางการเงินชัดเจน ปัจจัยที่มีผลต่อความเร็วในการนำไปใช้ได้แก่

- ปัจจัยเร่ง: กฎระเบียบ/มาตรฐานจากหน่วยงานกำกับดูแล, เหตุการณ์ความเสี่ยงทาง AI ที่ส่งผลกระทบต่อธุรกิจสูง, ส่วนลดเบี้ยประกันที่ชัดเจนและการยืนยัน ROI

- ปัจจัยชะลอ: ความไม่แน่นอนของวิธีการให้คะแนนระหว่างบริษัทประกัน, ต้นทุนการปฏิรูปกระบวนการภายใน, ปัญหาด้านข้อมูลและความเป็นส่วนตัว, และความเสี่ยงที่จะเกิดการปฏิบัติตามแบบเช็คบ็อกซ์ (checkbox compliance)

สรุปได้ว่า AI‑Liability Score มีแนวโน้มยกระดับมาตรฐานความปลอดภัยของโมเดลและเปลี่ยนรูปแบบการลงทุนขององค์กรจากการเน้นฟีเจอร์ไปสู่การเน้นความน่าเชื่อถือและการควบคุมความเสี่ยง อย่างไรก็ดี ตลาดจะต้องเผชิญกับความท้าทายด้านความเป็นมาตรฐานของการวัดผล การรวมระบบข้อมูล และการประสานงานระหว่างบริษัทประกัน ผู้พัฒนาเทคโนโลยี และหน่วยงานกำกับดูแล หากสามารถจัดการปัจจัยเหล่านี้ได้ ผลิตภัณฑ์ดังกล่าวจะผลักดันให้เกิดระบบนิเวศที่เอื้อต่อการใช้งาน AI อย่างปลอดภัยและยั่งยืนมากขึ้น

คำแนะนำการนำไปใช้สำหรับองค์กร: checklist และแผนปฏิบัติการ

บทนำสั้น

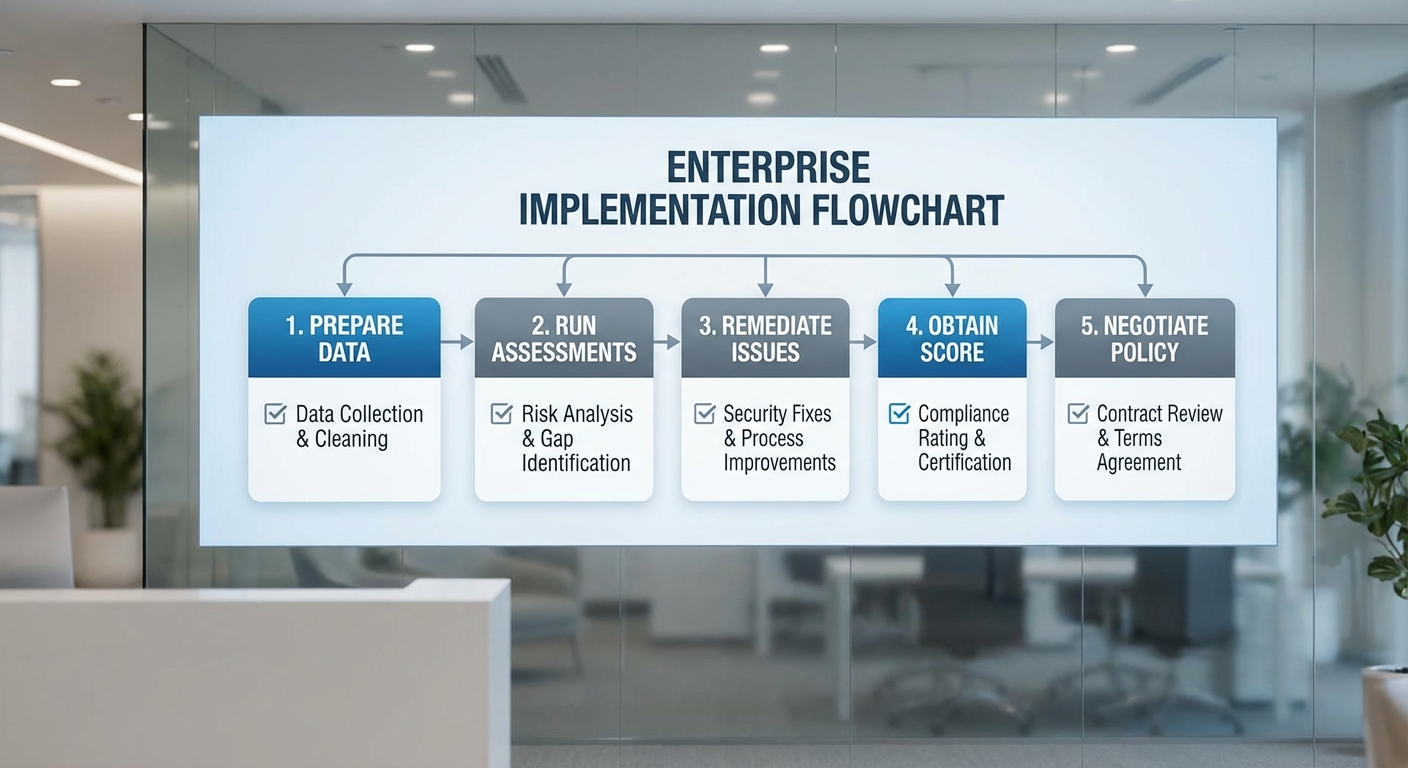

เมื่อองค์กรต้องการให้โมเดลผ่านการประเมิน AI‑Liability Score และรับสิทธิ์ปรับลดเบี้ยประกัน สิ่งสำคัญคือต้องเตรียมทั้งเชิงเทคนิคและเชิงบริหารอย่างเป็นระบบ บทความนี้เสนอ checklist เตรียมความพร้อม แผนการแก้ไข (remediation) พร้อมตารางเวลา และแนวทางการเจรจาเงื่อนไขกรมธรรม์รวมถึงการมอนิเตอร์หลังออกกรมธรรม์ เพื่อให้ทีมเทคนิคและทีมบริหารสามารถลงมือทำได้ทันที

Checklist เตรียมพร้อมสำหรับการประเมิน AI‑Liability Score

- ข้อมูลและการสำรวจข้อมูล (Data inventory): สร้างทะเบียนข้อมูล (data catalogue) ที่ระบุแหล่งที่มา ช่วงเวลาที่เก็บ ประเภทข้อมูล (PII, sensitive attributes) และนโยบายการเก็บรักษา เอกสารนี้ควรครอบคลุมทั้งชุดฝึก ชุดทดสอบ และข้อมูลที่ใช้ใน production

- การทดสอบอคติและความเป็นธรรม (Bias & fairness testing): มีรายงานผลการทดสอบ fairness (เช่น disparate impact, equalized odds) สำหรับกลุ่มสำคัญ พร้อมตัวอย่างชุดทดสอบและค่าเกณฑ์ที่ยอมรับได้

- เอกสารเทคนิคและการอธิบาย (Model documentation & explainability): จัดทำ Model Card, Datasheet, Architectural diagram, รายงาน SHAP/LIME หรือวิธีอธิบายผลลัพธ์สำหรับเคสที่มีความเสี่ยงสูง

- การติดตามและบันทึกเหตุการณ์ (Logging & observability): ระบุ logging policy, retention period, และตัวอย่าง log ที่บันทึกการตัดสินใจของโมเดล รวมถึง incident logs

- เวอร์ชันและการคุมโค้ด (Versioning & CI/CD): ยืนยันการใช้ระบบ version control สำหรับโมเดล โค้ด และข้อมูล พร้อมการตรวจสอบ CI/CD pipeline (unit tests, integration tests)

- มาตรการความมั่นคงปลอดภัยข้อมูล (Security & access control): นโยบายการเข้าถึง การเข้ารหัสข้อมูลขณะเก็บและขณะส่ง และการจัดการคีย์

- การทดสอบความทนทานและความถูกต้อง (Robustness & performance testing): รายงาน stress tests, adversarial tests, และ performance metrics ที่เปรียบเทียบกับ baseline

- การปฏิบัติตามกฎหมายและข้อบังคับ (Compliance): ระบุข้อกำหนดที่เกี่ยวข้อง (PDPA, GDPR, sectoral regulations) และหลักฐานการปฏิบัติตาม

- รายชื่อผู้รับผิดชอบและบทบาท (RACI): ระบุทีม ML, Data Engineering, DevOps, Legal, และ Risk รวมถึงผู้ตัดสินใจสำคัญ

- รายการ third‑party components: ระบุไลบรารี ภายนอก API และสัญญา third‑party ที่อาจส่งผลต่อความรับผิดชอบ

แผนปฏิบัติการ: pre‑assessment → remediation → re‑assessment (ตัวอย่างตารางเวลา)

ด้านล่างเป็นแผนปฏิบัติการเชิงปฏิบัติการที่สามารถปรับให้เหมาะกับขนาดองค์กรและความซับซ้อนของโมเดล ตัวอย่างเวลาเป็นค่าประมาณเพื่อใช้วางแผนทรัพยากร

- Pre‑assessment (1–3 สัปดาห์): รวบรวม checklist ข้างต้น ส่งมอบเอกสารพื้นฐานให้ผู้ประเมินภายนอก/ภายใน ทำ automated scans เบื้องต้น และจัดประชุม kickoff กับ auditor

- Formal assessment (2–4 สัปดาห์): ผู้ประเมินดำเนินการทดสอบเชิงลึก เช่น bias auditing, security scan, และการตรวจสอบ pipeline; ส่งผลการประเมินเบื้องต้น

- Remediation (2–8 สัปดาห์ ขึ้นกับ scope): แก้ไขจุดบกพร่องที่พบ จัดทำเอกสารเพิ่ม เช่น การปรับ dataset balancing, การเพิ่ม explainability layer, การแก้ไข access control; ทำ internal validation

- Re‑assessment (1–3 สัปดาห์): ยื่นหลักฐานการแก้ไขให้ผู้ประเมิน ทำการทดสอบซ้ำ และรับคะแนนใหม่/ใบรับรอง

หมายเหตุ: สำหรับกรณีมีข้อบกพร่องด้านความปลอดภัยหรือข้อมูลส่วนบุคคลที่ร้ายแรง ควรตั้งทีมตอบสนองฉุกเฉิน (incident response) เพื่อแก้ไขทันทีและอาจต้องแจ้ง regulator ภายในกรอบเวลาที่กฎหมายกำหนด

เอกสารและหลักฐานที่ต้องเตรียมสำหรับการยื่น re‑assessment

- Model Card เวอร์ชันล่าสุดพร้อม changelog

- รายงานการทดสอบ fairness และ performance พร้อมชุดทดสอบที่ใช้

- CI/CD pipeline logs และ testing artifacts

- Proof of deployment change — configuration, access control logs

- รายงานการสแกนความปลอดภัย (SAST/DAST) และการแก้ไขที่ทำ

- แผนการรักษาและ monitoring rules ที่จะใช้งานหลังออกกรมธรรม์

ทรัพยากรที่ต้องเตรียม (People, Process, Tools)

- People: ML engineers, data engineers, SRE/DevOps, privacy officer, legal counsel, risk manager, และถ้าจำเป็น external auditor

- Process: RACI, incident response playbook, change management, periodic review cycle (quarterly/biannual)

- Tools: MLOps (เช่น MLflow, Seldon, Kubeflow), monitoring & observability (Evidently, WhyLabs, Prometheus), security/scanning (Snyk, Trivy), bias testing frameworks และ automated testing suites

ข้อเสนอแนะแนวทางการเจรจาเงื่อนไขกรมธรรม์และ SLA

เมื่อต้องเจรจาเงื่อนไขกรมธรรม์ ควรกำหนดเงื่อนไขเชิงปฏิบัติที่ชัดเจนเพื่อให้เรียกร้องส่วนลดได้อย่างยั่งยืน ตัวอย่างประเด็นสำคัญที่ควรเจรจาได้แก่:

- เงื่อนไขการรับสิทธิ์ลดเบี้ย: ระบุมาตรฐานขั้นต่ำ (เช่น AI‑Liability Score ขั้นต่ำ) และข้อกำหนดด้าน documentation/monitoring ตลอดระยะเวลาของกรมธรรม์

- SLA สำหรับการแจ้งเตือนและการตอบสนอง: เวลาการแจ้งเหตุ (notification) ภายใน 24–72 ชั่วโมง และเวลาการแก้ไขเชิงเทคนิค (remediation timeframe) เช่น 14–30 วัน ขึ้นกับความร้ายแรง

- สิทธิการตรวจสอบ/audit rights: ระบุกระบวนการ audit ภายนอกและความถี่ (เช่น รายปี หรือเมื่อเกิดเหตุ) รวมถึงข้อจำกัดเรื่องการเข้าถึงข้อมูลที่เป็นความลับ

- การแสดงหลักฐานและการพิสูจน์การปฏิบัติตาม: กำหนดรูปแบบเอกสารหรือ dashboard ที่ต้องส่ง (เช่นรายงานรายเดือน, access logs) เพื่อรักษาสิทธิ์ส่วนลด

- ขอบเขตความคุ้มครองและการจำกัดความรับผิด: ระบุ exclusion clauses (เช่น การกระทำโดยประมาทของผู้ใช้งาน) และข้อตกลงเกี่ยวกับ indemnity/limit of liability

- เป้าหมายการปรับปรุง (remediation targets): ระบุ KPI ที่ต้องทำให้สำเร็จเพื่อให้สิทธิ์หรือลดเบี้ยยังคงมีผล เช่น ลด disparate impact ลง 20% ภายใน 90 วัน

การมอนิเตอร์หลังการออกกรมธรรม์: KPI และการรักษาสิทธิ์ส่วนลด

หลังออกกรมธรรม์ องค์กรต้องแสดงความต่อเนื่องในการปฏิบัติตามมาตรฐานเพื่อรักษาสิทธิ์ส่วนลด ตัวชี้วัดที่ควรกำหนดและรายงานมีดังนี้:

- Performance metrics: accuracy, AUC, precision/recall ตาม use‑case และการเปรียบเทียบกับ baseline ทุกช่วงเวลา (เช่น รายสัปดาห์/รายเดือน)

- Drift & data quality: covariate drift, label drift, data completeness metrics พร้อม threshold ที่กระตุ้นการ retrain (ตัวอย่าง: PSI > 0.2 ให้ trigger retraining)

- Fairness metrics: รายงานค่าที่เกี่ยวข้องกับกลุ่มเสี่ยง (e.g., disparate impact ratio) และเหตุการณ์ที่เกินเกณฑ์ต้องแจ้งภายใน SLA

- Incident count & MTTR: จำนวนเหตุการณ์ที่มีผลต่อการตัดสินใจของโมเดล และ Mean Time To Remediate สำหรับเหตุการณ์แต่ละระดับความร้ายแรง

- Reporting cadence: รายงานรวม (dashboard + PDF) ต่อผู้ประเมิน/ผู้ให้กรมธรรม์ ตามข้อตกลง (เช่น รายเดือน พร้อมรายงานเชิงลึกรายไตรมาส)

การรักษาสิทธิ์ส่วนลดมักขึ้นกับการรายงานที่สม่ำเสมอและการปฏิบัติตาม SLA ที่เจรจาไว้ หากเกิดการละเมิด ควรมี clause ที่ระบุขั้นตอนการลงโทษ เช่น การระงับส่วนลดชั่วคราวจนกว่าจะตรวจสอบเรียบร้อย

สรุปและข้อปฏิบัติแนะนำ

สรุปแล้ว องค์กรควรเริ่มจากการจัดทำ checklist ครบถ้วน ต่อด้วยแผนการประเมินที่มี timeline ชัดเจน เตรียมทรัพยากรทั้งคนและเครื่องมือสำหรับ remediation และวางกรอบการเจรจาเงื่อนไขกรมธรรม์ที่เน้นการปฏิบัติจริง (real‑world enforceable SLAs) สุดท้ายต้องมีระบบมอนิเตอร์หลังออกกรมธรรม์ที่ชัดเจนเพื่อรักษาสิทธิ์ส่วนลด การทำงานร่วมกันระหว่างทีมเทคนิค ฝ่ายความเสี่ยง และฝ่ายกฎหมาย จะเป็นกุญแจสำคัญสู่ความสำเร็จในการบริหารความเสี่ยง AI และการได้รับผลประโยชน์จากนโยบายประกันใหม่

บทสรุป

AI‑Liability Score เป็นกลไกการประเมินความเสี่ยงใหม่ที่ผสานทั้งปัจจัยเชิงเทคนิคของโมเดล (เช่น คุณภาพข้อมูล, ความทนทานต่อการโจมตี, explainability, การตรวจจับ drift) เข้ากับนโยบายการประกัน (วงเงินคุ้มครอง, ข้อยกเว้นทางกฎหมาย) เพื่อประเมินความเสี่ยงก่อนออกกรมธรรม์ ผลลัพธ์คือการสร้างแรงจูงใจเชิงการเงินให้องค์กรลงทุนในมาตรการความปลอดภัยของโมเดล: ผู้ให้บริการประกันสามารถเสนอส่วนลดเบี้ยตามคะแนน AI‑Liability Score ได้ ผู้เชี่ยวชาญประเมินว่าองค์กรที่มีมาตรฐานด้าน data governance, การจัดทำ model cards/ documentation, และการตั้งระบบ continuous monitoring ที่เป็นผู้ใหญ่แล้ว อาจได้รับส่วนลดเบี้ยประกันในช่วงโดยประมาณ 10–30% ขึ้นกับระดับความเสี่ยงและมาตรการที่นำเสนอ นอกจากนี้การเตรียมความพร้อมดังกล่าวยังช่วยลดความเสี่ยงทางกฎหมายและการดำเนินงาน เช่น โอกาสเกิดคดีสิทธิผู้บริโภค ค่าปรับจากการละเมิดข้อบังคับ และเวลาหยุดชะงักของบริการได้อย่างมีนัยสำคัญ

มุมมองอนาคต: AI‑Liability Score มีศักยภาพที่จะกลายเป็นกรอบมาตรฐานหนึ่งในการประเมินความปลอดภัยของโมเดล ซึ่งจะผลักดันให้เกิดการรวมระบบระหว่าง model registries, audit trails และการรายงานความเสี่ยงแบบเรียลไทม์ ตลาดประกันอาจพัฒนาไปสู่การกำหนดเบี้ยแบบไดนามิกที่อิงคะแนนความปลอดภัยและพฤติกรรมการจัดการความเสี่ยงขององค์กร อย่างไรก็ตาม ความสำเร็จของโมเดลนี้ขึ้นกับความโปร่งใสของเกณฑ์การให้คะแนนและการยอมรับจากผู้กำกับดูแล — หากออกแบบไม่ดีอาจเกิดแรงจูงใจผิดรูป เช่น การปรับโมเดลเพื่อ “ชนะคะแนน” โดยไม่เพิ่มความปลอดภัยจริง จึงจำเป็นต้องมีการกำกับดูแลมาตรฐานร่วม ระหว่างภาคธุรกิจ ผู้ให้บริการประกัน และหน่วยงานกำกับดูแล เพื่อให้ AI‑Liability Score เป็นเครื่องมือที่ลดความเสี่ยงได้จริงและสนับสนุนการพัฒนา AI อย่างรับผิดชอบ