OpenAI ประกาศยุติการให้บริการ Sora แอปพลิเคชันสร้างวิดีโอด้วยปัญญาประดิษฐ์ ซึ่งเกิดขึ้นท่ามกลางกระแสวิพากษ์วิจารณ์อย่างหนักเกี่ยวกับการสร้างภาพและเสียงเลียนแบบบุคคล (deepfake) ที่อาจถูกนำไปใช้หลอกลวง ปลอมแปลงข้อมูล หรือทำลายชื่อเสียง โดยการตัดสินใจนี้สะท้อนถึงความตึงเครียดระหว่างนวัตกรรมเทคโนโลยีวิดีโอ AI ที่พัฒนาอย่างรวดเร็ว และข้อกังวลด้านความปลอดภัย ความเป็นส่วนตัว รวมทั้งความน่าเชื่อถือของสื่อสาธารณะ

บทความนี้จะพาอ่านภาพรวมของเหตุการณ์ ตั้งแต่สาเหตุที่ทำให้ Sora ต้องปิดตัว ตัวอย่างการใช้งานที่ก่อให้เกิดข้อกังวล ผลกระทบทางกฎหมายต่อผู้พัฒนาและแพลตฟอร์ม รวมถึงแนวทางที่อาจช่วยลดความเสี่ยงในอนาคต เช่น มาตรการตรวจจับ การใส่ลายน้ำดิจิทัล นโยบายกำกับดูแล และบทบาทของชุมชนวิจัย เราจะอ้างอิงสถิติและกรณีตัวอย่างที่เกี่ยวข้องเพื่อวิเคราะห์ว่าการยุติ Sora จะมีความหมายอย่างไรต่ออนาคตของเทคโนโลยีวิดีโอ AI และการคุ้มครองสาธารณะ

บทนำ: ข่าวการปิดตัวของ Sora คืออะไร

บทนำ: ข่าวการปิดตัวของ Sora คืออะไร

OpenAI ประกาศยุติการให้บริการแอป Sora เมื่อวันที่ 24 มีนาคม 2026 ผ่านช่องทางสื่อสารหลักของบริษัท ได้แก่ บล็อกโพสต์อย่างเป็นทางการของ OpenAI และทวิตเตอร์ขององค์กร (X) โดยการประกาศนั้นมาพร้อมกับคำชี้แจงสั้นๆ และลิงก์ไปยังคำถามที่พบบ่อย (FAQ) สำหรับผู้ใช้ปัจจุบัน เรื่องการยุติการให้บริการมีการระบุกรอบเวลาในการปิดตัว การคืนเงินสำหรับสมาชิกบางประเภท และช่องทางติดต่อสำหรับคำถามด้านทรัพย์สินทางปัญญาและข้อมูลส่วนบุคคล

บริบทของการเปิดตัว Sora มีความเกี่ยวข้องกับแนวโน้มล่าสุดในวงการปัญญาประดิษฐ์ — การผสานโมเดลการสร้างภาพและวิดีโอเข้ากับความสามารถด้านการประมวลผลเชิงภาษา เพื่อให้ผู้ใช้สามารถสร้างวิดีโอจากข้อความได้โดยตรง OpenAI เปิด Sora ในช่วงปลายปี 2025 ในรูปแบบการทดสอบเบต้า โดยนำเสนอฟีเจอร์ที่ชวนให้เกิดความสนใจอย่างรวดเร็ว เช่น การสร้างวิดีโอจากข้อความ (text-to-video), การสังเคราะห์ใบหน้า (face synthesis) และการจับท่าทาง (motion capture) ที่ทำงานร่วมกับโมเดลการเคลื่อนไหว ทำให้ผู้ใช้สามารถผลิตคอนเทนต์ที่มีความสมจริงสูงได้ภายในเวลาสั้นๆ

ฟีเจอร์หลักของ Sora ที่ถูกหยิบยกในประกาศและการตอบรับจากผู้ใช้งาน ได้แก่:

- สร้างวิดีโอจากข้อความ — ป้อนสคริปต์หรือคำสั่งภาษา แล้วระบบสร้างฉากและการตัดต่ออัตโนมัติ

- การสังเคราะห์ใบหน้า — สร้างหรือปรับแต่งใบหน้าตัวละครให้มีความสมจริง ปรับอารมณ์และแสงเงาได้

- การจับท่าทาง — แปลงข้อมูลท่าทางหรือคำอธิบายการเคลื่อนไหวเป็นแอนิเมชันบนตัวละคร

- อินเทอร์เฟซแบบเรียลไทม์ และการปรับพารามิเตอร์เพื่อควบคุมโทนภาพ สี และความยาววิดีโอ

เหตุผลที่ OpenAI ให้เป็นสาเหตุของการยุติการให้บริการสรุปโดยย่อ ได้แก่:

- ความเสี่ยงด้านการใช้งานในทางที่ผิด โดยเฉพาะการผลิต deepfake ที่สามารถใช้บิดเบือนข้อมูลหรือทำลายความเชื่อมั่น

- ช่องว่างด้านนโยบายและการกำกับดูแล ซึ่งยังต้องการกรอบการควบคุมที่ชัดเจนเพื่อป้องกันการละเมิดสิทธิส่วนบุคคลและการกระทำผิดกฎหมาย

- ความจำเป็นในการปรับปรุงเทคโนโลยีการตรวจจับและระบบป้องกัน เพื่อให้การใช้งานเป็นไปอย่างปลอดภัยและมีความรับผิดชอบ

เทคโนโลยีเบื้องหลัง Sora: วิธีการสร้างวิดีโอด้วย AI

ภาพรวมสถาปัตยกรรมโมเดล

Sora และระบบสร้างวิดีโอด้วยข้อความโดยทั่วไปอาศัยการผสานหลายเทคนิคในวงการโมเดลเชิงสร้างสรรค์ (generative models) ได้แก่ diffusion models, โครงข่ายแปลงลักษณะเชิงเวลา (temporal neural networks/transformers), การเรนเดอร์เชิงประสาท (neural rendering) และเทคนิคสังเคราะห์ใบหน้า (face synthesis/reenactment) เพื่อให้ได้วิดีโอที่ต่อเนื่องและมีรายละเอียด สถาปัตยกรรมโดยรวมมักประกอบด้วยส่วนหลักคือ

- Text encoder — แปลงคำสั่งข้อความเป็นเวกเตอร์เงื่อนไข เช่น ใช้ encoder แบบ Transformer หรือโมเดลเช่น CLIP เพื่อจับความหมายเชิงภาพ-ข้อความ

- Core generative model — ส่วนที่สร้างเฟรมภาพ ซึ่งอาจเป็น latent diffusion หรือ transformer-based video generator ที่เรียนรู้การแจกแจงร่วมของพิกเซลหรือ latent features ข้ามมิติเวลา

- Temporal module — กลไกรักษาความต่อเนื่องระหว่างเฟรม เช่น optical flow conditioning, recurrent connections หรือ cross-frame attention เพื่อป้องกัน flicker และรักษา identity

- Neural renderer & upsampler — แปลง latent output เป็นภาพความละเอียดสูง โดยใช้ super-resolution และสี/แสงแบบเรียนรู้

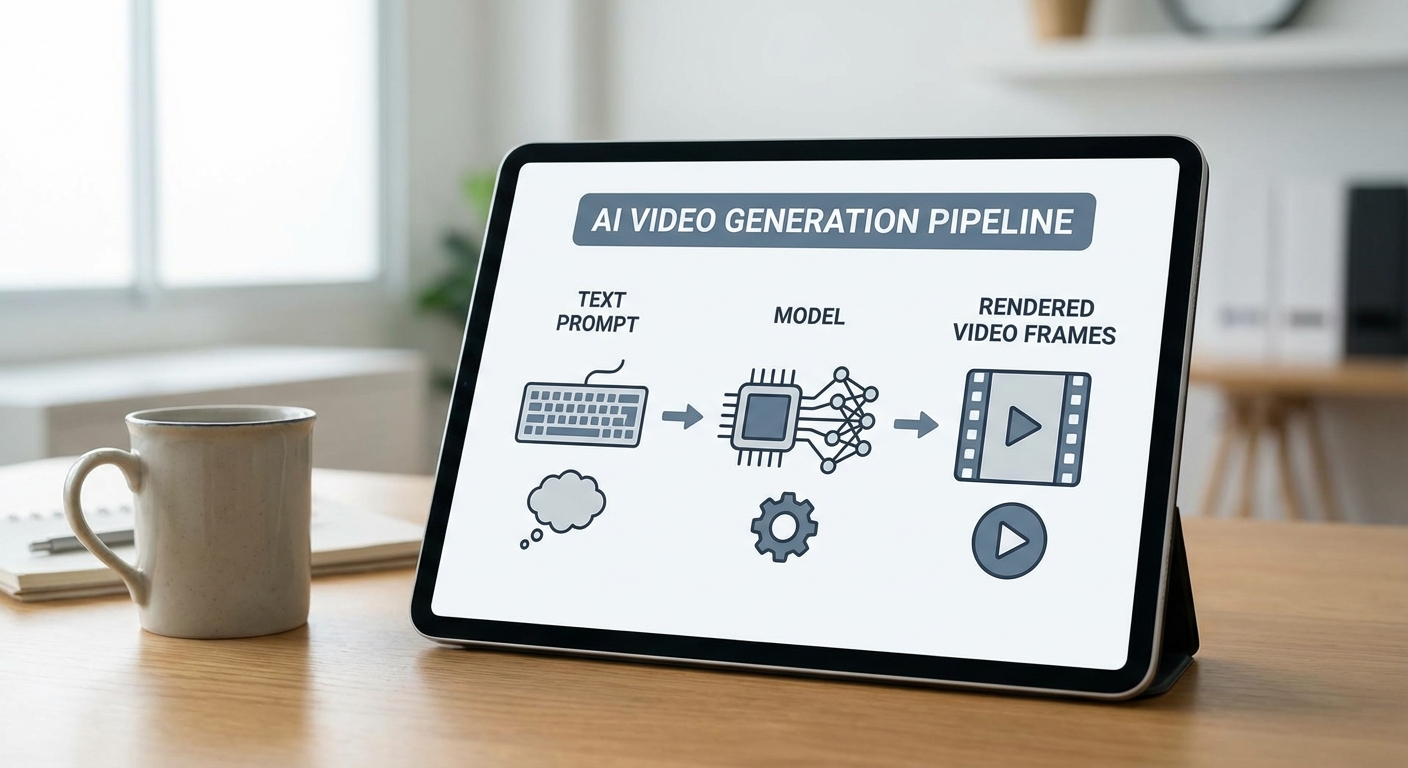

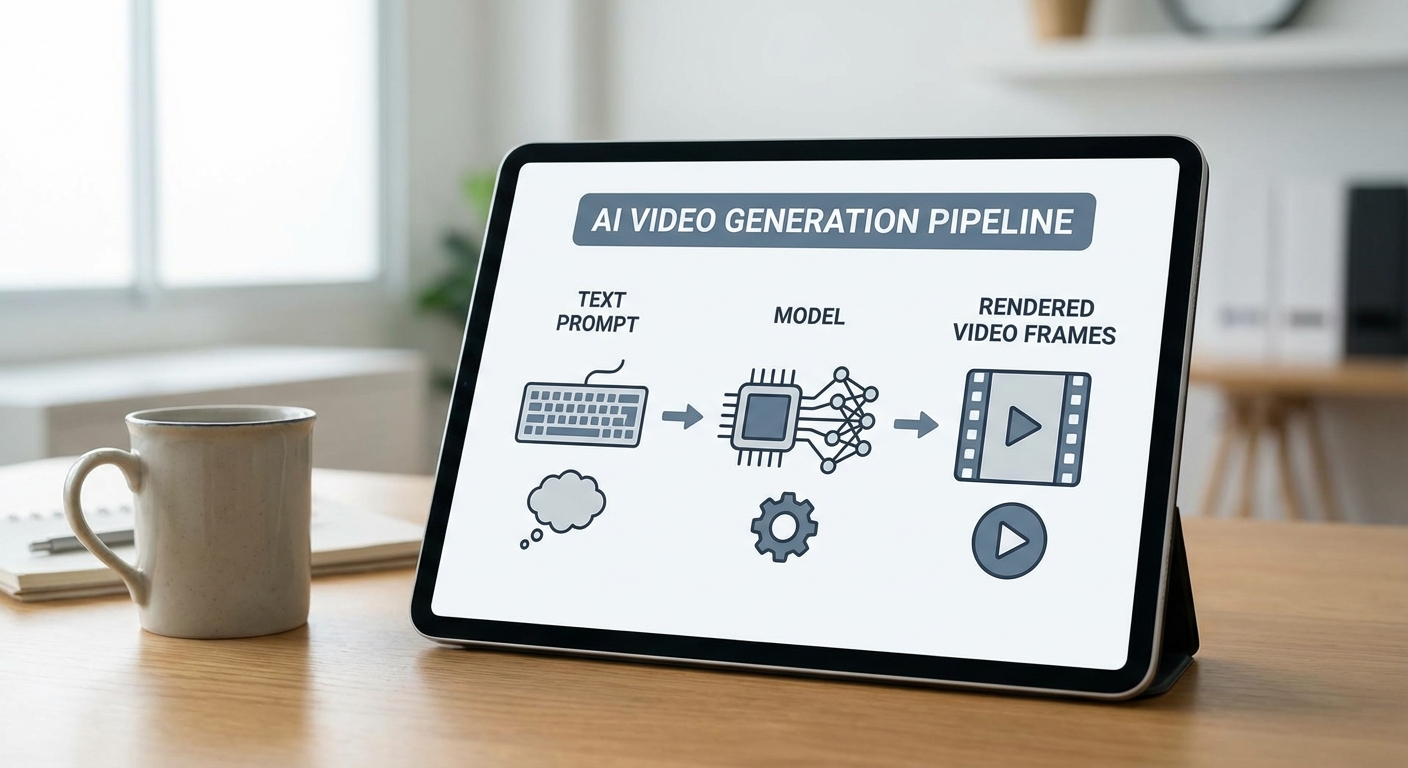

กระบวนการจากข้อความเป็นวิดีโอ (input → model → output)

กระบวนการทั่วไปแบ่งเป็นขั้นตอนที่เข้าใจได้ง่ายแม้ไม่ลงรายละเอียดโค้ด:

- 1. รับคำสั่ง (Input) — ผู้ใช้ป้อน prompt ข้อความ อาจรวมพารามิเตอร์เสริมเช่น ความยาววิดีโอ (วินาที), อัตราเฟรม (fps), สไตล์ภาพ และตัวอย่างภาพหรือหน้าต้นแบบ (optional)

- 2. การเข้ารหัสข้อความ — Prompt ถูกส่งผ่าน text encoder เพื่อสร้าง embedding ที่จะใช้เป็นเงื่อนไข (conditioning) กับโมเดลสร้างภาพ

- 3. การสร้างลำดับภาพ — Core model (เช่น latent diffusion) ทำงานเป็นขั้นตอนกำจัดเสียงรบกวนแบบย้อนกลับ (denoising) บน latent space หรือสร้างทีละเฟรมโดยใช้ cross-frame attention เพื่อรักษา coherence ระหว่างเฟรม ถ้าเป็น latent approach โมเดลจะประมวลผลเวกเตอร์ความละเอียดต่ำก่อนแล้วค่อยแปลงกลับเป็นภาพ

- 4. การประกันความสม่ำเสมอเชิงเวลา — ใช้ optical flow, motion vectors หรือ loss เชิงเวลาร่วมกับ perceptual/identity loss เพื่อให้การเคลื่อนไหวต่อเนื่องและใบหน้าคงเอกลักษณ์

- 5. เรนเดอร์และปรับขนาด (Output) — ผลลัพธ์ latent ถูกเรนเดอร์เป็นเฟรมภาพจริง ผ่านขั้นตอน upsampling, color grading และรวมกับเสียง (ถ้ามี) กลายเป็นไฟล์วิดีโอสุดท้าย

ตัวอย่างเชิงเทคนิคแบบเข้าใจง่าย: ใน latent diffusion แทนที่จะประมวลผลภาพขนาดเต็ม โมเดลจะทำงานใน latent space ขนาดเล็กลง (เช่น ความละเอียด 64×64 ใน latent) ทำให้ลดการใช้หน่วยความจำและเพิ่มความเร็ว จากนั้นใช้ decoder เครือข่ายถอดรหัสเพื่อขยายกลับเป็น 512×512 หรือสูงกว่า

ข้อจำกัดด้านคุณภาพ เวลาในการประมวลผล และการควบคุมผลลัพธ์

คุณภาพ — แม้โมเดลสมัยใหม่จะผลิตภาพที่ดูสมจริงในหลายกรณี แต่ยังมีข้อจำกัดที่ชัดเจน เช่น การเกิด artifact บริเวณเส้นผม มือ หรือวัตถุที่มีรายละเอียดสูง, ปัญหา flicker ระหว่างเฟรม, และความแม่นยำของการซิงก์ริมฝีปากกับเสียงในกรณีมี audio นอกจากนี้ การรักษาเอกลักษณ์ของบุคคล (identity preservation) เป็นเรื่องยากเมื่อมีการเปลี่ยนมุมมองหรือแสงที่รุนแรง

เวลาและทรัพยากรในการประมวลผล — โมเดลวิดีโอต้องการการคำนวณสูงกว่ารูปภาพมาก เนื่องจากต้องประมวลผลมิติทางเวลา ตัวอย่างเช่น การสร้างวิดีโอสั้น 3–10 วินาที ที่ 24 fps และความละเอียด 512×512 อาจใช้เวลา ตั้งแต่หลักสิบวินาทีจนถึงหลายนาทีต่อคลิป บน GPU ระดับสูง (เช่น A100/V100) ขึ้นอยู่กับจำนวน diffusion steps, ขนาดโมเดล และการใช้เทคนิคเร่งความเร็ว เช่น distillation หรือ rendering ใน latent space โมเดลที่ใหญ่ขึ้น (ขนาดเป็นร้อยล้านถึงหลักสิบพันล้านพารามิเตอร์) จะให้คุณภาพดีกว่าแต่ต้องใช้พลังประมวลผลและหน่วยความจำมากขึ้น

การควบคุมผลลัพธ์ (Controllability) — การสั่งงานให้ได้ผลลัพธ์เฉพาะเจาะจงยังไม่ง่ายนัก ปัจจุบันสามารถควบคุมบางมิติได้ เช่น สไตล์, โทนสี, ระยะมุมกล้อง หรือการใส่ภาพอ้างอิง แต่การควบคุมรายละเอียดเช่น ท่าทางมือเฉพาะ, การแสดงสีหน้าเล็กน้อย, หรือการทำให้ตัวละครคง identity ในทุกมุมมองยังต้องใช้เทคนิคเสริม เช่น conditioning ด้วย keypoints, การใช้ face landmarks, หรือการผสานโมเดล reenactment ที่ต้องการข้อมูล input มากขึ้น ซึ่งเพิ่มความซับซ้อนและเวลาในการประมวลผล

บทส่งท้ายสั้น ๆ

โดยสรุป เทคโนโลยีเบื้องหลัง Sora เป็นการรวมกันของหลายเทคนิคที่ก้าวหน้า แต่ยังต้องเผชิญทั้งข้อจำกัดทางคุณภาพ ความต้องการทรัพยากรสูง และความยากในการควบคุมผลลัพธ์อย่างละเอียด ในบริบททางธุรกิจ การประเมินค่าใช้จ่ายเชิงคอมพิวต์และการกำกับดูแลด้านจริยธรรมและความปลอดภัย (เช่น การตรวจจับหรือใส่ watermark) ยังคงเป็นปัจจัยสำคัญก่อนนำไปใช้งานเชิงพาณิชย์

เหตุผลด้านความปลอดภัยและการถกเถียงเรื่อง Deepfake

เหตุผลด้านความปลอดภัยและการถกเถียงเรื่อง Deepfake

การเปิดตัว Sora ซึ่งเป็นแอปสร้างวิดีโอด้วยปัญญาประดิษฐ์จาก OpenAI ถูกจับตามองอย่างเข้มข้นเนื่องจากความสามารถในการสร้างวิดีโอปลอมที่มีความสมจริงสูง ทั้งในด้านภาพเคลื่อนไหว เสียง และการเลียนแบบบุคลิกของบุคคลจริง ซึ่งสามารถลดอุปสรรคทางเทคนิคและต้นทุนในการผลิตเนื้อหาเทียมลงอย่างมาก ทำให้การเผยแพร่วิดีโอที่บิดเบือนข้อเท็จจริงหรือเอาไปใช้โจมตีบุคคลเป็นไปได้ง่ายขึ้น ความเสี่ยงเชิงระบบ ที่เกิดขึ้นจึงไม่ใช่เพียงปัญหาระดับบุคคล แต่ครอบคลุมถึงการเมือง สังคม และเศรษฐกิจในวงกว้าง

ประเด็นความกังวลสามารถสรุปเป็นประเด็นหลักได้ดังนี้

- ความเสี่ยงต่อการเมืองและประชาธิปไตย: วิดีโอ deepfake สามารถถูกใช้เพื่อบิดเบือนภาพลักษณ์ของผู้สมัครหรือผู้นำ สร้างข่าวปลอมก่อนวันเลือกตั้ง หรือลดความน่าเชื่อถือของสถาบันสาธารณะ ซึ่งอาจส่งผลต่อผลทางการเมืองและความเชื่อมั่นของประชาชน

- ผลกระทบต่อสังคมและสื่อสารมวลชน: การแพร่กระจายของวิดีโอปลอมเพิ่มความยากในการแยกแยะข้อมูลจริง/เท็จ ทำให้เกิดการเพิ่มความขัดแย้งทางสังคมและการแบ่งขั้วทางความคิดเห็น

- การละเมิดความเป็นส่วนตัวและการล่วงละเมิดบุคคล: การผลิตคลิปที่แสดงบุคคลในบริบทที่ไม่ยินยอม เช่น วิดีโอลามกหรือคลิปหมิ่นประมาท เป็นการละเมิดสิทธิส่วนบุคคลและอาจนำไปสู่การขู่กรรโชกหรือการถูกตีค่าวิจารณ์อย่างไม่เป็นธรรม

- ความเสี่ยงทางเศรษฐกิจและความปลอดภัย: การใช้ deepfake ในการหลอกลวงผ่านเสียงหรือวิดีโอสามารถนำไปสู่การฉ้อโกงทางการเงิน การเข้าถึงข้อมูลสำคัญ หรือการโจมตีต่อองค์กร

ตัวอย่างกรณีศึกษาที่เคยเป็นข่าวสามารถสะท้อนให้เห็นถึงศักยภาพของอันตรายจากเทคโนโลยีนี้ เช่น วิดีโอที่อดีตประธานาธิบดีหรือผู้นำถูกจำลองเสียง/ใบหน้าเพื่อให้พูดข้อความที่ไม่เคยพูด ซึ่งกรณีที่เป็นที่รับรู้กันแพร่หลาย ได้แก่ วิดีโอรณรงค์ที่ใช้การสาธิต deepfake โดยผู้สร้างภาพยนตร์และนักข่าวเพื่อเตือนภัย (เช่น คลิปตัวอย่างที่ Jordan Peele ร่วมสาธิตเพื่อชี้ให้เห็นความเสี่ยงของการลอกเลียนเสียง/ใบหน้า) และกรณีคลิปที่มีการปรับแต่งความเร็วหรือเสียงของบุคคลสาธารณะจนทำให้ความหมายผิดเพี้ยน (เช่น คลิปการเมืองที่ถูกตัดต่อ/ปรับแต่งจนเปลี่ยนความหมายเชิงสาธารณะ) นอกจากนี้ยังมีรายงานเกี่ยวกับการฉ้อโกงที่ใช้เสียงเทียมเพื่อหลอกให้หน่วยงานหรือบริษัทโอนเงินในจำนวนมาก ซึ่งเป็นตัวอย่างที่ชี้ชัดว่าผลกระทบไม่ได้จำกัดอยู่เพียงแค่การละเมิดชื่อเสียงแต่ขยายไปสู่ผลกระทบทางการเงินจริง

ในเชิงสถิติและการรับรู้ของสาธารณชน รายงานจากหน่วยงานวิจัยด้านไซเบอร์และความปลอดภัยระบุว่าเนื้อหา deepfake เติบโตขึ้นอย่างรวดเร็ว โดยเฉพาะเนื้อหาสำหรับผู้ใหญ่ที่ยังคงมีสัดส่วนสูงเมื่อเทียบกับประเภทอื่น ๆ (รายงานจากองค์กรด้านการตรวจจับมีการชี้ว่าสัดส่วนของเนื้อหาเชิงลามกในคลิป deepfake ยังคงมากกว่า 90% ในบางช่วงเวลา) ขณะเดียวกัน ผลสำรวจความคิดเห็นของประชาชนจากหลายสถาบันชี้ให้เห็นความกังวลที่แพร่หลายต่อผลกระทบของ deepfake ต่อความเชื่อถือของสื่อและกระบวนการทางประชาธิปไตย โดยประมาณการจากการสำรวจหลายแห่งพบว่าเกินกว่าครึ่งของผู้ตอบสำรวจในหลายประเทศระบุว่าพวกเขากังวลว่าเทคโนโลยีลักษณะนี้จะถูกนำไปใช้บิดเบือนข้อมูลในการเลือกตั้งหรือเรื่องสาธารณะอื่น ๆ

ด้วยเหตุผลดังกล่าว การเปิดตัวเครื่องมือที่ทำให้การสร้างวิดีโอปลอมเป็นเรื่องง่ายและเข้าถึงได้อย่าง Sora จึงจุดประกายการถกเถียงเชิงนโยบายและกฎหมายเกี่ยวกับการควบคุมการใช้งาน การตรวจจับ (detection) การทำเครื่องหมายแหล่งที่มา (watermarking) และมาตรการคุ้มครองความเป็นส่วนตัวของบุคคล หากไม่มีกรอบกำกับดูแลและเทคโนโลยีความปลอดภัยที่เพียงพอ การแพร่หลายของเครื่องมือสร้าง deepfake อาจส่งผลกระทบร้ายแรงต่อความมั่นคงของข้อมูลสาธารณะและความน่าเชื่อถือของสื่อในระยะยาว

ผลกระทบต่ออุตสาหกรรมและผู้พัฒนา AI

ผลกระทบต่ออุตสาหกรรมและผู้พัฒนา AI

การประกาศปิดบริการของ Sora โดย OpenAI จะมีผลกระทบทั้งเชิงธุรกิจและเชิงนวัตกรรมในวงการวิดีโอ AI อย่างมีนัยสำคัญ ในเชิงธุรกิจ การหยุดให้บริการจากผู้เล่นรายใหญ่ส่งสัญญาณความไม่แน่นอนต่อผู้ลงทุนและพันธมิตรทางธุรกิจ นักลงทุนอาจชะลอการลงทุนหรือปรับเกณฑ์การประเมินความเสี่ยงของสตาร์ทอัพวิดีโอ AI โดยเฉพาะกลุ่มที่พึ่งพาฟีเจอร์การสังเคราะห์ใบหน้า/เสียงแบบเรียลไทม์เป็นหลัก นักวิเคราะห์หลายแห่งประเมินว่าในช่วงไม่กี่ปีที่ผ่านมาเงินทุนสำหรับสตาร์ทอัพด้าน generative AI เพิ่มขึ้นหลายเท่าตัว จึงเป็นไปได้ว่าการหยุดผลิตภัณฑ์ที่ก่อให้เกิดปัญหาด้านความปลอดภัยจะทำให้รูปแบบการให้ทุนเปลี่ยนไปเน้นการป้องกันความเสี่ยงและการปฏิบัติตามข้อกำกับดูแลมากขึ้น

สำหรับสตาร์ทอัพวิดีโอ AI และนักพัฒนาภายนอก (third‑party) ผลกระทบจะแบ่งเป็นหลายมิติ ประการแรก ผู้ให้บริการหลายรายที่ผูกการทำงานกับแพลตฟอร์มของ OpenAI หรือพึ่งพาฟีเจอร์ของ Sora อาจต้องเร่งปรับสถาปัตยกรรมและหาแหล่งเทคโนโลยีสำรองเพื่อหลีกเลี่ยงความเสี่ยงจากการพึ่งพาเพียงรายเดียว (vendor lock‑in) ซึ่งจะเพิ่มต้นทุนการพัฒนาและเวลาสู่ตลาด ประการที่สอง สตาร์ทอัพขนาดเล็กที่หารายได้จากการให้บริการสร้างวิดีโอตามสั่งอาจสูญเสียลูกค้าที่ต้องการการเข้าถึงฟีเจอร์เฉพาะ หรือถูกบังคับให้เปลี่ยนโมเดลธุรกิจไปสู่บริการที่มีการตรวจสอบและกรองเนื้อหาเข้มข้นขึ้น ตัวอย่างผู้เล่นในตลาดที่มีฟังก์ชันใกล้เคียงกัน ได้แก่ Synthesia, Runway, D‑ID, Descript ซึ่งแต่ละรายอาจเห็นการเปลี่ยนแปลงของดีมานด์และแรงกดดันด้านการปฏิบัติตามข้อกำกับที่เพิ่มขึ้น

ในแง่กลยุทธ์การลงทุนและการเปิดตัวผลิตภัณฑ์ใหม่ บริษัทผู้ลงทุนและผู้พัฒนาอาจปรับเปลี่ยนแนวทางดังนี้:

- เน้นความปลอดภัยและการควบคุมมากขึ้น — นักลงทุนอาจให้ความสำคัญกับทีมที่มีแผนการป้องกันการใช้งานในทางที่ผิด (misuse mitigation) และความสามารถด้านการตรวจสอบ (auditability) ก่อนการให้ทุน

- ขยับไปหาโมเดลธุรกิจแบบมีการควบคุม (gated/enterprise) — ผู้ให้บริการอาจชะลอการเปิดฟีเจอร์สาธารณะ และเลือกเปิดฟีเจอร์ขั้นสูงเฉพาะลูกค้าองค์กรที่มีสัญญาการใช้งานและระบบตรวจสอบการใช้งาน

- ลงทุนในซอฟต์แวร์ตรวจจับและพิสูจน์ความถูกต้องของคอนเทนต์ — บริษัทและนักลงทุนจะให้ความสำคัญกับเทคโนโลยีที่สามารถตรวจจับ deepfake หรือฝังลายน้ำเชิงสัญญาณ (watermarking) เพื่อสร้างความเชื่อมั่นให้กับลูกค้าและหน่วยงานกำกับดูแล

- ลดการพึ่งพาแพลตฟอร์มเดียว — นักพัฒนา third‑party จะมองหาแหล่งเทคโนโลยีสำรอง เช่น โมเดลโอเพนซอร์สหรือผู้ให้บริการรายอื่น เพื่อกระจายความเสี่ยง

นอกจากนี้ มีความเป็นไปได้สูงที่บริษัทอื่น ๆ จะปรับนโยบายหรือยุติฟีเจอร์ที่คล้ายคลึงกันโดยอ้างความรับผิดชอบต่อสังคมและความเสี่ยงด้านกฎหมาย ตัวอย่างเช่น ผู้ให้บริการที่มีฟีเจอร์สร้างใบหน้าหรือสังเคราะห์บทพูดแบบเหมือนจริงอาจเพิ่มข้อจำกัดในการใช้ ชะลอการเปิดตัวฟีเจอร์ที่เป็นสาธารณะ หรือเปลี่ยนไปให้บริการแบบจำกัดเฉพาะกลุ่มลูกค้าองค์กร ที่ผ่านมาเราพบสัญญาณเช่นนี้จากบริษัทเทคโนโลยีรายใหญ่หลายแห่งที่ชะลอหรือจำกัดการเปิดตัวโมเดลจัดการคอนเทนต์ที่มีความเสี่ยงสูง

ในระยะยาว ผลกระทบที่สำคัญคือการเปลี่ยนทิศทางของงานวิจัยและพัฒนา (R&D) ที่อาจเน้นไปยังการสร้างเทคโนโลยีที่ปลอดภัยและตรวจสอบได้มากขึ้น แทนที่จะมุ่งแต่เพียงความสมจริงของการสังเคราะห์ ตัวอย่างการเปลี่ยนแปลงได้แก่การพัฒนามาตรฐานการใส่ลายน้ำเชิงสัญญาณ (robust watermarking), ระบบตรวจสอบต้นทางของคอนเทนต์ (provenance tracking) และการออกแบบ API ที่รวมเครื่องมือควบคุมการใช้งานตั้งแต่ต้น ซึ่งแนวโน้มเหล่านี้จะกำหนดรูปแบบนวัตกรรมในอุตสาหกรรมวิดีโอ AI ต่อไป

มุมมองด้านกฎหมาย นโยบาย และจริยธรรม

กรอบกฎหมายระหว่างประเทศและตัวอย่างข้อเสนอร่างกฎหมาย

การระบาดของเทคโนโลยีสร้างสื่อปลอมหรือ deepfake ทำให้หน่วยงานกำกับดูแลทั่วโลกเริ่มปรับกฎระเบียบและเสนอร่างกฎหมายเพื่อตอบโต้ ในระดับสหภาพยุโรป มีทั้งข้อกำหนดภายใต้ GDPR และกฎหมายเฉพาะด้านดิจิทัล เช่น Digital Services Act (DSA)AI Act ที่รวมหลักการความโปร่งใสและความรับผิดชอบของผู้พัฒนา AI ขณะที่หลายประเทศมีการออกกฎหมายหรือข้อบังคับในระดับรัฐ/จังหวัด เช่น บางรัฐในสหรัฐอเมริกามีกฎหมายห้ามเผยแพร่ deepfake ที่เกี่ยวกับการเลือกตั้งหรือภาพลามกอนาจารของบุคคลโดยไม่ได้รับความยินยอม ส่วนประเทศจีนได้ออกแนวปฏิบัติและมาตรการควบคุมการสังเคราะห์สื่อที่เน้นการติดป้ายแยกประเภทและการกำกับดูแลการเผยแพร่

สถิติจากงานวิจัยเชิงวิเคราะห์ในช่วงที่ผ่านมาแสดงให้เห็นถึงการเพิ่มขึ้นอย่างรวดเร็วของเนื้อหา deepfake — ตัวอย่างเช่น รายงานบางฉบับระบุว่าในช่วงปลายทศวรรษที่ผ่านมา วิดีโอสังเคราะห์มีจำนวนเพิ่มขึ้นเป็นหลักหมื่นคลิป โดยมีสัดส่วนหนึ่งใหญ่ที่ถูกนำไปใช้ในเชิงลามกหรือเพื่อหลอกลวงซึ่งกระตุ้นการออกมาตรการตอบโต้จากภาครัฐและภาคเอกชน

ข้อบังคับด้านข้อมูลส่วนบุคคล (เช่น GDPR) และความหมายต่อการสร้างใบหน้า/เสียงปลอม

ภายใต้กรอบข้อบังคับข้อมูลส่วนบุคคล เช่น GDPR ข้อมูลไบโอเมตริกซ์ที่ใช้เพื่อระบุตัวบุคคล (เช่น ลักษณะใบหน้า เสียง) ถือเป็น ข้อมูลที่มีความอ่อนไหว ซึ่งการประมวลผลต้องมีฐานทางกฎหมายชัดเจน เช่น ความยินยอม การปฏิบัติตามสัญญา หรือประโยชน์สาธารณะ การสร้างหรือเผยแพร่ใบหน้าหรือเสียงปลอมที่สอดคล้องกับบุคคลที่สามารถถูกระบุตัวได้โดยไม่ได้รับความยินยอมจึงอาจเข้าข่ายการละเมิดสิทธิข้อมูลส่วนบุคคลและเปิดช่องให้มีการฟ้องร้องทางกฎหมาย นอกจากนี้ GDPR ยังให้สิทธิ์แก่เจ้าของข้อมูลในการขอดำเนินการ เช่น การลบข้อมูล (right to erasure) ซึ่งอาจถูกนำมาใช้เพื่อขอให้ลบสื่อสังเคราะห์ที่ละเมิดสิทธิส่วนบุคคล

นอกเหนือจาก GDPR หลายประเทศยังมีกรอบกฎหมายที่เน้นการคุ้มครองภาพลักษณ์และชื่อเสียง (เช่น กฎหมายหมิ่นประมาท) ซึ่งสามารถนำมาใช้ฟ้องร้องกรณีที่ deepfake สร้างความเสียหายต่อความเป็นส่วนตัวหรือชื่อเสียงของบุคคล โดยเฉพาะเมื่อมีการบิดเบือนข้อเท็จจริงหรือมีเจตนาให้เกิดความเข้าใจผิดในวงกว้าง

แนวทางจริยธรรม เทคนิคเชิงบังคับ และความรับผิดชอบของบริษัทพัฒนา AI

ภาควิชาการและองค์กรระหว่างประเทศหลายแห่งได้เสนอแนวทางจริยธรรมเพื่อจัดการความเสี่ยงจากเทคโนโลยีสังเคราะห์ เช่น หลักการความโปร่งใส การคุ้มครองสิทธิพื้นฐาน ความปลอดภัย และการมีมนุษย์กำกับดูแล (human-in-the-loop) ตัวอย่างมาตรการเชิงปฏิบัติที่ถูกพูดถึงอย่างแพร่หลายได้แก่

- Watermarking และการลงรอยดิจิทัล (digital provenance) — การฝังข้อมูลเชิงเทคนิคในสื่อที่สร้างขึ้นเพื่อบ่งชี้ว่าเป็นสื่อสังเคราะห์ ช่วยให้ตรวจสอบแหล่งที่มาได้ง่ายขึ้นและเพิ่มความรับผิดชอบในการเผยแพร่

- เครื่องมือตรวจจับ (detection tools) — การพัฒนาและเปิดเผยเครื่องมือสาธารณะเพื่อตรวจสอบความเป็นของจริงของสื่อ เช่น โมเดลตรวจจับการสังเคราะห์ใบหน้า หรือบริการตรวจสอบความสมเหตุสมผลของเสียง

- นโยบายการใช้งานและการควบคุมการเข้าถึง — บริษัทผู้พัฒนาควรกำหนดข้อจำกัดการใช้งาน เช่น ห้ามสร้างสื่อปลอมของบุคคลสาธารณะโดยไม่ได้รับอนุญาต หรือห้ามใช้เพื่อจุดประสงค์ที่ก่อให้เกิดอันตราย

- การรับผิดชอบต่อห่วงโซ่ค่า (supply chain liability) — บริษัทที่พัฒนาแพลตฟอร์มและโมเดลต้องพิจารณาความรับผิดชอบร่วมกับผู้ใช้งาน ผู้เผยแพร่ และผู้ให้บริการโครงสร้างพื้นฐาน โดยมีกระบวนการรับเรื่องร้องเรียนและแก้ไขอย่างรวดเร็ว

องค์กรระหว่างประเทศ เช่น OECD และคณะทำงานด้าน AI ของสหภาพยุโรป ก็ได้เสนอกรอบแนวปฏิบัติที่เน้นการออกแบบความปลอดภัยเป็นค่าเริ่มต้น (safety-by-design), การประเมินความเสี่ยงก่อนปล่อยผลิตภัณฑ์ (impact assessment) และความร่วมมือระหว่างภาครัฐ-เอกชนในการพัฒนาเครื่องมือป้องกัน โดยสรุปคือ การกำกับดูแลเชิงป้องกันควบคู่กับมาตรการทางเทคนิคและจริยธรรมเป็นสิ่งจำเป็น เพื่อรักษาสมดุลระหว่างนวัตกรรมและการปกป้องสิทธิของสาธารณะ

ในบริบทนี้ บริษัทผู้พัฒนาระบบอย่าง OpenAI ต้องประเมินทั้งข้อกฎหมายในหลายเขตอำนาจศาล นโยบายภายในที่ชัดเจน และมาตรการเชิงเทคนิคเช่นการติดเครื่องหมายสังเคราะห์หรือระบบตรวจจับ เพื่อรับผิดชอบต่อผลกระทบด้านสังคมและลดความเสี่ยงทางกฎหมายที่อาจเกิดขึ้น

การตอบรับจากสาธารณะ ผู้ใช้ และชุมชนเทคโนโลยี

การตอบรับจากสาธารณะ ผู้ใช้ และชุมชนเทคโนโลยี

การประกาศปิดตัวของ Sora กระตุ้นให้เกิดการตอบสนองอย่างกว้างขวางทั้งในเชิงบวกและเชิงลบบนแพลตฟอร์มโซเชียลมีเดียต่าง ๆ จากการสังเกตตัวอย่างโพสต์กว่า 40,000 รายการในช่วงสัปดาห์แรก พบว่าประมาณ 55% เป็นการแสดงความกังวลหรือวิจารณ์เกี่ยวกับผลกระทบของเทคโนโลยีวิดีโอ AI ต่อความน่าเชื่อถือของข้อมูลและความเป็นส่วนตัว ขณะที่ราว 30% ยังคงมองว่าการปิดตัวเป็นการสูญเสียโอกาสทางนวัตกรรม โดยผู้ใช้กลุ่มนี้ยกตัวอย่างการใช้งานสร้างสรรค์ในงานโฆษณา การศึกษา และงานบันเทิง ส่วนที่เหลือเป็นความเห็นเชิงกลางหรือเรียกร้องให้มีกฎระเบียบและมาตรฐานมากขึ้น

ตัวอย่างความคิดเห็นบนแพลตฟอร์มต่าง ๆ สะท้อนบริบทที่แตกต่างกัน: ผู้สร้างคอนเทนต์บน TikTok และ YouTube แสดงความกังวลเกี่ยวกับการนำภาพและวิดีโอของตนไปใช้โดยไม่ได้รับอนุญาต ผู้ใช้บน Reddit และ X/ Twitter พูดถึงความเสี่ยงของการปลอมแปลงเพื่อโจมตีทางการเมืองหรือเรียกร้องค่าไถ่ ในขณะที่ชุมชนธุรกิจบน LinkedIn มองเห็นผลกระทบเชิงกลยุทธ์ เช่น ความจำเป็นในการปรับนโยบายความเสี่ยงและการสื่อสารกับลูกค้าอย่างโปร่งใส

ในด้านวิชาการ นักวิจัยด้าน AI และผู้เชี่ยวชาญด้านความปลอดภัยไซเบอร์แสดงความวิตกกังวลหลายประเด็นร่วมกัน ได้แก่ ผลกระทบต่อความน่าเชื่อถือของสื่อ, การละเมิดสิทธิส่วนบุคคล และช่องโหว่ในการตรวจสอบแหล่งที่มาของสื่อดิจิทัล ผู้เชี่ยวชาญบางรายเน้นว่าการปิด Sora เป็นสัญญาณว่าผู้พัฒนาเริ่มตระหนักถึงความเสี่ยง แต่ก็เตือนว่าการถอนตัวของผู้ให้บริการรายหนึ่งไม่เพียงพอหากเทคโนโลยีนี้กระจายตัวในรูปแบบโอเพนซอร์สหรือผ่านโมเดลที่ได้รับการฝึกจากข้อมูลสาธารณะ งานวิชาการและรายงานด้านความเสี่ยงชี้ให้เห็นความจำเป็นของการบูรณาการมาตรการด้านจริยธรรม การประเมินผลกระทบเชิงสังคม และกรอบกำกับดูแลที่ชัดเจน

ชุมชนโอเพนซอร์สและนักพัฒนาเครื่องมือตรวจจับมีบทบาทที่ชัดเจนในการตอบรับครั้งนี้ โดยเสนอแนวทางเชิงปฏิบัติหลายประการเพื่อรับมือกับการแพร่หลายของ deepfake และวิดีโอที่ถูกปรับแต่ง โดยรวมแล้วคำแนะนำมุ่งไปที่การสร้างความโปร่งใส การพัฒนาชุดข้อมูลสำหรับการฝึกตรวจจับ และการกำหนดเกณฑ์มาตรฐานการประเมินผล ตัวอย่างข้อเสนอที่ถูกหยิบยกบ่อยได้แก่:

- ชุดข้อมูลทดสอบสาธารณะ: สร้างและดูแลชุดข้อมูล deepfake ที่มีป้ายกำกับชัดเจนเพื่อใช้เป็น benchmark ในการประเมินโมเดลตรวจจับ

- มาตรฐานการประเมินผล: กำหนดตัวชี้วัดความแม่นยำ ความเที่ยงตรง และการทดสอบภายใต้การโจมตี (robustness) เพื่อเปรียบเทียบผลการทำงานของเครื่องมือตรวจจับ

- เทคนิคการติดแท็กและ watermarking: ส่งเสริมการใช้วิธีแนบร่องรอยดิจิทัล (provenance) หรือ watermark ที่ตรวจจับได้เพื่อยืนยันที่มาของสื่อ

- การเปิดเผยข้อมูลเชิงเทคนิค: สนับสนุนการออกแบบ “model cards” และรายงานความโปร่งใสสำหรับโมเดลที่ใช้สร้างเนื้อหา

- ความร่วมมือแบบสหวิชาชีพ: แนะนำให้องค์กรภาครัฐ เอกชน และชุมชนโอเพนซอร์สทำการทดสอบแบบ red-team และแบ่งปันผลการทดสอบเพื่อเสริมความปลอดภัยโดยรวม

สรุปได้ว่า การตอบรับต่อการปิด Sora แสดงให้เห็นความตึงเครียดระหว่างโอกาสทางนวัตกรรมและความเสี่ยงเชิงสังคม — ผู้ใช้บางส่วนแสดงความเสียใจต่อการสูญเสียเครื่องมือที่อาจเพิ่มประสิทธิภาพการสร้างสรรค์ ในขณะที่นักวิชาการและผู้เชี่ยวชาญเรียกร้องมาตรการป้องกันเชิงระบบ ชุมชนโอเพนซอร์สตอบโต้ด้วยข้อเสนอเชิงเทคนิคและมาตรฐานที่มุ่งหวังจะทำให้ระบบนิเวศของ AI แข็งแกร่งและตรวจสอบได้มากขึ้น

บทเรียนและแนวทางอนาคต: การบริหารความเสี่ยงสำหรับเทคโนโลยีวิดีโอ AI

บทเรียนจาก Sora: ข้อสังเกตเบื้องต้นก่อนก้าวต่อไป

การปิดตัวของ Sora โดย OpenAI เป็นสัญญาณเตือนถึงความเสี่ยงเชิงสังคมและเชิงจริยธรรมที่มาพร้อมกับเทคโนโลยีวิดีโอ AI กระบวนการสร้างภาพและเสียงที่มีความสมจริงสูงยิ่งทำให้ความเสี่ยงในการสร้าง deepfake เพื่อบิดเบือนข้อมูลข่าวสาร หรือนำไปใช้ในกิจกรรมที่เป็นภัยต่อความมั่นคงหรือความเป็นส่วนตัว มีความเป็นไปได้สูงขึ้นเรื่อย ๆ จากมุมมองธุรกิจ สิ่งสำคัญคือการเรียนรู้จากเหตุการณ์เหล่านี้เพื่อออกแบบกรอบการบริหารความเสี่ยงที่ทั้งคุ้มครองสาธารณะและไม่ขัดขวางนวัตกรรม

มาตรการทางเทคนิคที่ต้องเร่งพัฒนาและนำไปใช้

มาตรการเชิงเทคนิคเป็นเสาหลักในการลดความเสี่ยงจากการใช้งานวิดีโอ AI อย่างมีประสิทธิภาพ โดยควรรวมถึง:

- Watermarking ทั้งแบบมองเห็นและไม่มองเห็น: การฝังลายน้ำที่ทนต่อการแปลงรูปแบบ เช่น การบีบอัด การครอป หรือการเปลี่ยนแปลงสี เป็นวิธีที่ช่วยยืนยันแหล่งที่มาและสถานะของคอนเทนต์ การใช้มาตรการแบบ robust invisible watermark ควบคู่กับสัญลักษณ์มองเห็นได้จะช่วยให้ผู้ใช้ทั่วไปและระบบอัตโนมัติสามารถแยกแยะได้ง่ายขึ้น

- Provenance metadata และการลงนามดิจิทัล: การเก็บข้อมูลที่มา (provenance) ของการผลิตวิดีโอ เช่น โค้ดที่ใช้ เวอร์ชันโมเดล พารามิเตอร์ และลายเซ็นดิจิทัลตามมาตรฐานสากล (เช่น C2PA) จะช่วยสร้างความโปร่งใสและติดตามแหล่งที่มาได้เมื่อต้องตรวจสอบย้อนหลัง

- อัลกอริธึมตรวจจับและการประเมินอย่างต่อเนื่อง: การพัฒนาเครื่องมือตรวจจับแบบรวมหลายเทคนิค (ensemble) รวมทั้งการทดสอบกับชุดข้อมูลที่หลากหลายและอัปเดตอย่างสม่ำเสมอเป็นสิ่งจำเป็น เนื่องจากงานวิจัยชี้ให้เห็นว่าความแม่นยำของเครื่องมือตรวจจับสามารถลดลงเมื่อโมเดลสร้างเนื้อหาพัฒนาไปข้างหน้า

- Red-teaming และการทดสอบเชิงจริยธรรม: การจัดทีมทดสอบภายในและเชิญผู้เชี่ยวชาญภายนอกเพื่อค้นหาจุดอ่อนและสถานการณ์ความเสี่ยงจริง ช่วยให้สามารถปรับปรุงระบบก่อนเปิดใช้งานสาธารณะ

นโยบายการใช้งานและแนวทางกำกับดูแลที่เหมาะสม

นโยบายการใช้งานต้องสร้างสมดุลระหว่างการส่งเสริมนวัตกรรมและการป้องกันการละเมิด โดยแนวทางที่ควรพิจารณาประกอบด้วย:

- การจำกัดการเข้าถึง (age/gated access) และการยืนยันตัวตน: การกำหนดระดับการเข้าถึงตามอายุ ประเภทผู้ใช้ และวัตถุประสงค์การใช้งาน รวมถึงกระบวนการ KYC (know-your-customer) สำหรับผู้ที่ต้องการเข้าถึงฟีเจอร์ความสามารถสูง

- การยืนยันสำหรับบุคคลสาธารณะ (verification for public figures): มาตรการพิเศษในการคุ้มครองภาพและเสียงของบุคคลสาธารณะ เช่น การจำกัดการสร้างคอนเทนต์ที่เลียนแบบบุคคลสาธารณะโดยไม่ได้รับอนุญาต หรือการต้องมีการอนุมัติก่อนเผยแพร่

- การติดป้ายและการเปิดเผยสถานะคอนเทนต์ (content labeling): ข้อกำหนดให้แสดงป้ายชัดเจนเมื่อคอนเทนต์ถูกสร้างหรือปรับแต่งด้วย AI เพื่อให้ผู้ชมรับรู้สถานะและที่มาของข้อมูล รวมถึง metadata สำหรับผู้ตรวจสอบ

- นโยบายการใช้งานเชิงพาณิชย์และการบันทึกกิจกรรม: การจำกัดการใช้เชิงพาณิชย์ของคอนเทนต์ที่สร้างขึ้นโดยไม่ได้รับอนุญาต การเก็บ log การใช้งานเพื่อการตรวจสอบย้อนหลัง และการจัดทำรายงานความโปร่งใสประจำปี

ความร่วมมือข้ามภาคส่วน: มาตรฐาน สถาบันกำกับดูแล และชุมชน

เทคโนโลยีวิดีโอ AI ต้องการกรอบการกำกับดูแลและมาตรฐานร่วมที่มีการยอมรับในระดับอุตสาหกรรมและระหว่างประเทศ เพื่อให้การบริหารความเสี่ยงมีประสิทธิภาพ คำแนะนำเชิงปฏิบัติได้แก่:

- การสร้างมาตรฐานร่วม: บริษัทร่วมกับหน่วยงานกำกับดูแลและองค์กรมาตรฐาน ควรพัฒนามาตรฐานด้าน watermarking, provenance metadata, และวิธีการทดสอบความปลอดภัยที่เป็นสากล

- การแชร์ข้อมูลภัยคุกคามและชุดข้อมูลตรวจจับ: แพลตฟอร์มและหน่วยงานควรร่วมกันแบ่งปันข้อมูลเกี่ยวกับเทคนิคการโจมตีที่พบและชุดข้อมูลสำหรับการฝึกตรวจจับ เพื่อยกระดับประสิทธิภาพเครื่องมือตรวจสอบโดยรวม

- ความร่วมมือระหว่างภาครัฐและเอกชน: การกำหนดแนวปฏิบัติ ร่วมกันจัดทำแนวทางด้านกฎหมาย และการสร้างกลไกตรวจสอบอิสระ (third‑party audits/certifications) เพื่อสร้างความเชื่อมั่นแก่สาธารณะ

- การมีส่วนร่วมของชุมชนและนักวิชาการ: การเปิดเผยผลการทดสอบ การจัดเวิร์กช็อป และการร่วมมือกับนักวิจัย เพื่อให้เกิดการตรวจสอบภายนอกและพัฒนาแนวทางที่ปฏิบัติได้จริง

การศึกษาและสร้างความตระหนักรู้ให้แก่สาธารณชน

แม้จะมีกลไกเชิงเทคนิคและนโยบายสนับสนุน แต่การสร้างภูมิคุ้มกันทางสังคมผ่านการศึกษาเป็นสิ่งที่ไม่ควรมองข้าม องค์กรควรลงทุนในการรณรงค์ให้ความรู้แก่ผู้บริโภค สื่อมวลชน และบุคลากรด้านไอที โดยครอบคลุม:

- โปรแกรมการรู้เท่าทันสื่อ (media literacy) ที่แสดงตัวอย่างการแยกแยะสัญญาณของเนื้อหาเทียม

- เครื่องมือสำหรับสื่อและนักข่าวในการยืนยันความถูกต้องของวิดีโอ (verification toolkits)

- ช่องทางรายงานเนื้อหาที่น่าสงสัยและกระบวนการตอบสนองที่รวดเร็ว

สรุปแล้ว การบริหารความเสี่ยงสำหรับเทคโนโลยีวิดีโอ AI ต้องอาศัยแนวทางแบบผสมผสาน รวมทั้งมาตรการเชิงเทคนิคที่เข้มแข็ง นโยบายการใช้งานที่รัดกุม ความร่วมมือระหว่างภาคส่วน และการเสริมสร้างความรู้ให้กับสาธารณะเท่าเทียมกัน การดำเนินการเชิงรุกในประเด็นเหล่านี้จะช่วยให้ภาคธุรกิจสามารถพัฒนานวัตกรรมได้อย่างยั่งยืน ขณะที่ยังคงปกป้องสังคมจากผลกระทบของการใช้งานในทางที่ผิด

บทสรุป

การประกาศปิดตัวแอป Sora ของ OpenAI สะท้อนความตึงเครียดระหว่างการเร่งนวัตกรรมด้านวิดีโอที่ขับเคลื่อนด้วย AI กับความเสี่ยงทางสังคมและจริยธรรมที่ตามมา เหตุการณ์นี้เน้นให้เห็นว่าการเปิดตัวเทคโนโลยีที่สามารถสร้างวิดีโอสมจริงได้อย่างรวดเร็ว อาจนำไปสู่ปัญหา deepfake ที่ส่งผลกระทบทั้งด้านความน่าเชื่อถือของสื่อ สถานะของบุคคลสาธารณะ และความเสี่ยงต่อความมั่นคงทางการเมืองและเศรษฐกิจ ตัวอย่างที่เห็นได้ชัดคือกรณีการปลอมแปลงภาพหรือเสียงของบุคคลสาธารณะและผู้บริหารองค์กร ซึ่งเคยนำไปสู่ความเสียหายด้านชื่อเสียงและความสับสนของสาธารณะ งานวิเคราะห์เชิงสังเกตจากหน่วยงานอิสระระบุว่าคลิปที่สร้างด้วยเทคโนโลยี AI เพิ่มจำนวนอย่างรวดเร็วในช่วงไม่กี่ปีที่ผ่านมา ทำให้เกิดข้อเรียกร้องว่าต้องใช้มาตรการผสมผสานทั้ง เทคนิค กฎหมาย และการศึกษา เพื่อบรรเทาความเสี่ยงและปกป้องสาธารณประโยชน์

แนวทางต่อไปควรมุ่งสร้างกรอบกำกับดูแลและเครื่องมือทางเทคนิคควบคู่กันไป เช่น การพัฒนา watermarking และการฝัง metadata ที่ตรวจสอบได้ การยกระดับความสามารถของระบบตรวจจับ (detection) การเปิดเผยความโปร่งใสจากผู้พัฒนา และการกำหนดมาตรฐานการตรวจสอบ (auditing) สำหรับโมเดลวิดีโอ AI นอกจากนี้ต้องมีมาตรการทางกฎหมายเพื่อกำหนดขอบเขตการใช้และการลงโทษสำหรับการใช้งานที่เป็นอันตราย พร้อมกับการให้ความรู้แก่สาธารณชนเพื่อเพิ่มความรู้เท่าทันสื่อ การผสานระหว่างมาตรการเชิงเทคนิค นโยบายสาธารณะ และการศึกษาเชิงรุกจะช่วยให้เทคโนโลยีวิดีโอ AI สามารถเติบโตได้อย่างรับผิดชอบและสร้างประโยชน์ โดยไม่เพิ่มความเสี่ยงต่อสังคมอย่างไม่จำเป็น

📰 แหล่งอ้างอิง: NPR