สตาร์ทอัพไทยเปิด 'Synthetic‑Sensor Suite' พลิกโฉมการเทรน AI รถยนต์ไร้คนขับด้วยข้อมูลจำลองความสมจริงสูง

สตาร์ทอัพด้านเทคโนโลยีจากประเทศไทยประกาศเปิดตัว Synthetic‑Sensor Suite ระบบสร้างข้อมูลจำลองความสมจริงสูง (high‑fidelity synthetic data) ที่ออกแบบมาเพื่อเทรนและทดสอบโมเดลปัญญาประดิษฐ์สำหรับยานยนต์ไร้คนขับ โดยบริษัทระบุว่าสามารถลดการทดสอบบนถนนจริงได้ถึง 90% ซึ่งไม่เพียงช่วยลดต้นทุนและความเสี่ยงจากการทดสอบในสภาพแวดล้อมจริง แต่ยังเร่งการปล่อยฟีเจอร์ใหม่ให้เร็วขึ้นอย่างมีนัยสำคัญ เหตุการณ์นี้ถือเป็นจุดเปลี่ยนที่อาจเร่งการนำเทคโนโลยีขับขี่อัตโนมัติสู่การใช้งานเชิงพาณิชย์ในประเทศไทยและภูมิภาคได้

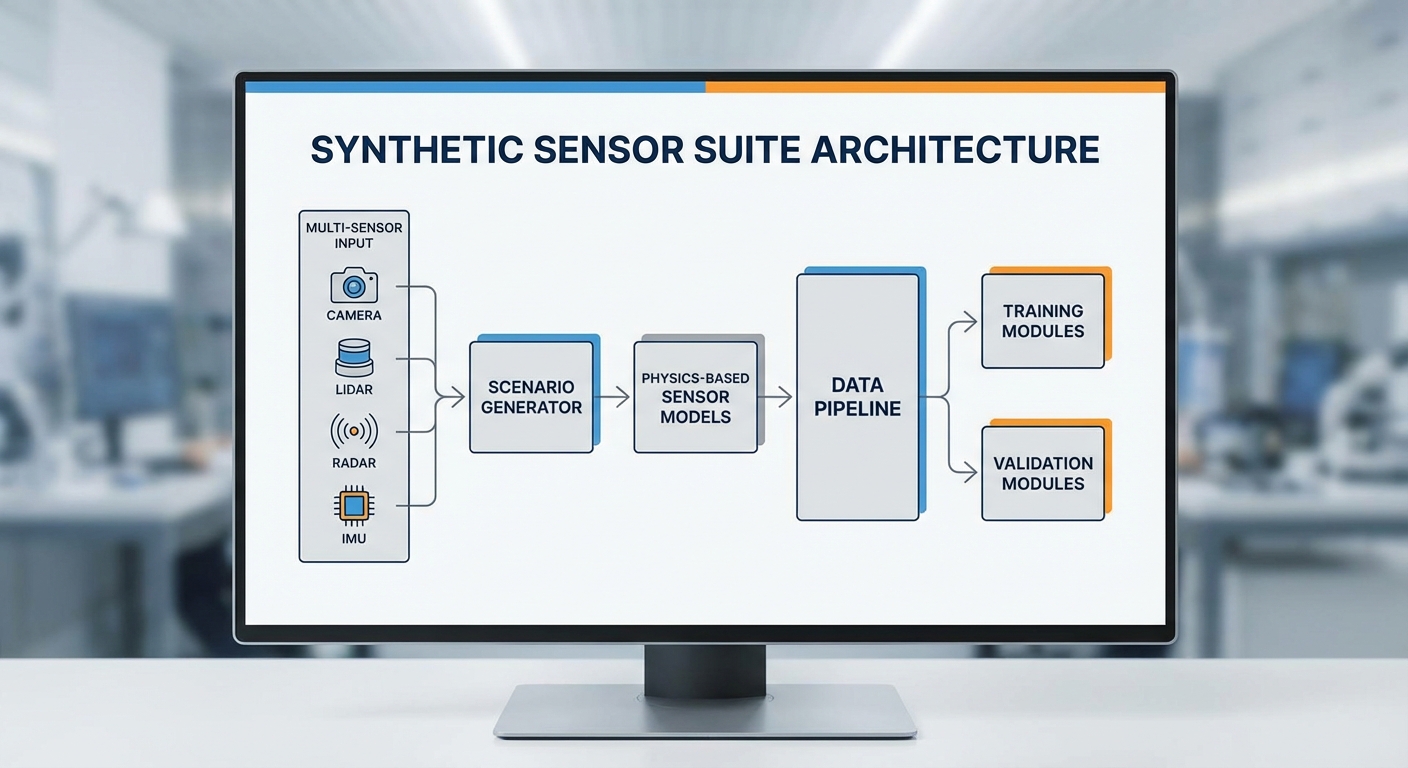

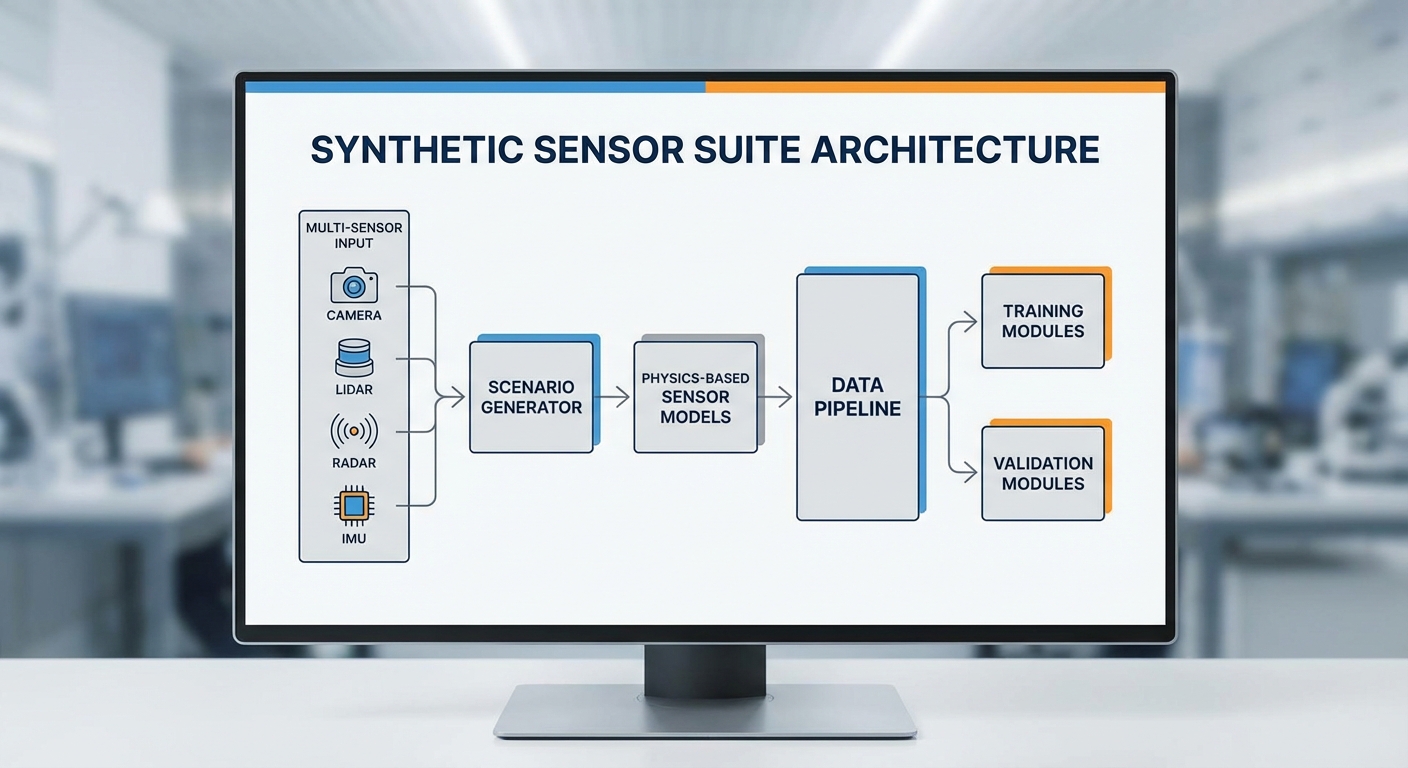

บทนำของบทความนี้จะพาผู้อ่านสำรวจภาพรวมของโซลูชันดังกล่าว ตั้งแต่ข้อดีเชิงเทคนิค เช่น การจำลองเซนเซอร์หลายชนิด (กล้อง, LiDAR, Radar) ในระดับ photorealism และ physics‑based simulation ไปจนถึงสถาปัตยกรรมทางเทคนิคที่สนับสนุนการผลิตข้อมูลพร้อมป้ายกำกับอัตโนมัติ (automated labeling) และการผนวกเข้ากับ pipeline ของการเทรนโมเดล นอกจากนี้ยังสรุปกรณีศึกษาจริงเบื้องต้นที่แสดงผลลัพธ์และตัวชี้วัดสำคัญ รวมถึงผลกระทบต่ออุตสาหกรรมยานยนต์ในไทย ทั้งด้านความปลอดภัย ต้นทุน และนโยบายกำกับดูแล เพื่อให้ผู้อ่านเข้าใจว่าเทคโนโลยีนี้จะเปลี่ยนโฉมวงการอย่างไร

สรุปข่าว (Lead)

สรุปข่าว (Lead)

สตาร์ทอัพเทคโนโลยีสัญชาติไทยเปิดตัวแพลตฟอร์มข้อมูลจำลองความสมจริงสูงในชื่อ 'Synthetic‑Sensor Suite' เพื่อรองรับการเทรนโมเดลปัญญาประดิษฐ์สำหรับรถยนต์ไร้คนขับและระบบช่วยขับขั้นสูง โดยผู้พัฒนาระบุว่าแพลตฟอร์มดังกล่าวสามารถลดความจำเป็นในการทดสอบบนถนนจริงได้ถึง 90% ขณะเดียวกันช่วยเร่งการปล่อยฟีเจอร์ใหม่เข้าสู่ตลาดอย่างมีนัยสำคัญ ซึ่งเป็นผลโดยตรงจากการลดรอบการทดลองและการเพิ่มอัตราการครอบคลุมสถานการณ์ทดสอบแบบ edge‑case ที่เกิดขึ้นได้ยากในภาคสนาม

Synthetic‑Sensor Suite จำลองข้อมูลจากเซ็นเซอร์หลายรูปแบบทั้งกล้อง, LiDAR และเรดาร์ในสภาพแวดล้อมที่ปรับแต่งได้ละเอียดเพื่อให้ได้ชุดข้อมูลที่มีฉลากครบถ้วนและความหลากหลายของเหตุการณ์จราจรจริง ระบบรองรับการสร้างสถานการณ์จำลองตั้งแต่สภาพอากาศและแสงที่เปลี่ยนแปลงไปจนถึงพฤติกรรมผู้ใช้ถนนที่ซับซ้อน ซึ่งช่วยลดเวลาในการรวบรวมและทำป้ายกำกับข้อมูลจริง รวมทั้งเพิ่มประสิทธิภาพการฝึกสอนโมเดล AI ในการจัดการเหตุการณ์ผิดปกติ

ในเชิงธุรกิจ ผู้พัฒนาระบุว่าเทคโนโลยีนี้จะช่วยให้ผู้ผลิตรถยนต์และผู้พัฒนาระบบ ADAS สามารถย่นระยะเวลาในการทดสอบภาคสนามและปล่อยฟีเจอร์ใหม่ได้เร็วขึ้นอย่างชัดเจน โดยมีการทดลองนำร่องร่วมกับพันธมิตรในไทยเป็นตัวอย่าง เช่น

- ผู้ผลิตยานยนต์ไทยรายใหญ่ในกลุ่มผู้ผลิตเชิงพาณิชย์ (ตัวอย่างเช่น โครงการนำร่องที่ทำร่วมกับโรงงานประกอบ)

- สตาร์ทอัพผู้พัฒนาระบบขับเคลื่อนอัตโนมัติและแพลตฟอร์ม Mobility

- สถาบันวิจัยและมหาวิทยาลัยที่มีศูนย์ทดสอบยานยนต์เพื่อพัฒนามาตรฐานการทดสอบ

เป้าหมายของสตาร์ทอัพคือการขยายตลาดในประเทศและภูมิภาคอาเซียน โดยตั้งเป้าให้ Synthetic‑Sensor Suite เป็นโซลูชันหลักสำหรับการพัฒนาและรับรองความปลอดภัยของระบบขับเคลื่อนอัตโนมัติในภูมิภาค ซึ่งจะส่งผลให้ต้นทุนการพัฒนาและเวลาสู่ตลาดของฟีเจอร์ใหม่ลดลงอย่างมีนัยสำคัญสำหรับทั้งผู้ผลิตรถยนต์และผู้ให้บริการ Mobility ในระดับภูมิภาค

อะไรคือ 'Synthetic‑Sensor Suite' — แนวคิดและคุณสมบัติหลัก

อะไรคือ 'Synthetic‑Sensor Suite' — แนวคิดและคุณสมบัติหลัก

Synthetic‑Sensor Suite เป็นชุดเครื่องมือซอฟต์แวร์และโมดูลจำลองที่ออกแบบมาเพื่อสร้างข้อมูลจำลองความสมจริงสูงสำหรับเซ็นเซอร์ยานยนต์ยุคใหม่ ด้วยแนวคิดหลักในการแทนที่การทดสอบและเก็บข้อมูลภาคสนามบางส่วนด้วยข้อมูลสังเคราะห์ที่ควบคุมได้ ชุดนี้รองรับการสร้างสตรีมข้อมูลจากเซ็นเซอร์หลากหลายชนิดในสภาพแวดล้อมที่สามารถปรับแต่งได้อย่างละเอียด ตั้งแต่สภาพอากาศ แสง การจราจร ไปจนถึงเหตุการณ์หายาก (edge cases) เพื่อเพิ่มความครอบคลุมของการทดสอบและเร่งการปล่อยฟีเจอร์ใหม่ โดยผู้พัฒนาอ้างว่าสามารถลดความจำเป็นในการทดสอบถนนจริงได้ถึง ประมาณ 90% ในกรณีการทดสอบซ้ำและ scenario-based validation

ระบบออกแบบมาเพื่อรองรับเซ็นเซอร์ที่ใช้จริงในยานยนต์ไร้คนขับอย่างครบวงจร โดยเฉพาะการซิงโครไนซ์สัญญาณแบบ multi‑sensor และการให้แอนโนเทชัน (annotations) ที่สอดคล้องกับงานวิจัยและการพาณิชย์ ตัวอย่างการรองรับที่สำคัญ ได้แก่:

- RGB cameras (single‑view และ multi‑view), รวมถึงกล้องความละเอียดสูงและกล้องแบบ fisheye

- Stereo cameras สำหรับการคำนวณความลึกเชิงสเตอริโอ

- LiDAR แบบ 16/32/64/128 beams พร้อมโมเดล pattern ของ beam และอัตราการสแกนที่ปรับได้

- Radar ที่จำลองการสะท้อนคลื่น (RCS), multipath และสัญญาณรบกวนในสภาพแวดล้อมจริง

- IMU (accelerometer/gyroscope) พร้อมโมเดลอัตราไดรฟ์, bias และ jitter

- GPS/GNSS พร้อมโมเดลสัญญาณรบกวน, multipath และการสูญเสียสัญญาณ

ฟีเจอร์หลักของ Suite ถูกพัฒนาขึ้นเพื่อให้ข้อมูลที่สร้างมีความสมจริงทางฟิสิกส์และใช้งานได้กับ pipeline การเทรนจริง ได้แก่:

- Photorealistic rendering — ใช้เทคนิค PBR (physically based rendering), HDR, motion blur และการจำลองแสง/เงา เพื่อให้ภาพกล้องมีความใกล้เคียงกับกล้องจริงทั้งกลางวันและกลางคืน รวมถึงสภาวะฝน ตกหิมะ และฝุ่น

- Sensor noise & physics modelling — โมดูลเฉพาะสำหรับเลียนแบบลักษณะเฉพาะของแต่ละเซ็นเซอร์ เช่น LiDAR intensity, beam divergence, radar RCS, กล้อง rolling shutter, lens distortion, และ IMU bias/scale error

- Scenario generator — เครื่องมือสร้างสถานการณ์อัตโนมัติที่ผสมผสานองค์ประกอบแบบสุ่มและแบบกำหนดเอง (domain randomization) เพื่อผลิตกรณีทดสอบจำนวนมาก ตั้งแต่การเปลี่ยนเลนแบบซับซ้อน ไปถึงเหตุการณ์หายากเช่นคนวิ่งข้ามถนนในสภาพฝนตกหนัก

- Multi‑sensor synchronization & calibration — การสร้าง timestamp ที่แม่นยำ การจัดวางตำแหน่ง/อ็อกซทรินสิค (extrinsic) ระหว่างเซ็นเซอร์ และการจำลอง jitter/latency เพื่อให้สามารถทดสอบระบบที่ต้องการความแม่นยำในการรวมข้อมูลได้อย่างสมจริง

ด้านการเชื่อมต่อกับ pipeline การเทรนและทดสอบ ระบบนี้ถูกออกแบบให้ทำงานเป็นส่วนหนึ่งของวงจรพัฒนาแบบปิด (closed‑loop) ได้อย่างราบรื่น — ทั้งการสร้างชุดข้อมูลสำหรับการเทรน การทำ data augmentation และการทดสอบโมเดลที่ถูกฝังกลับเข้าไปในสภาพแวดล้อมจำลองเพื่อประเมินพฤติกรรม end‑to‑end ตัวอย่างการเชื่อมต่อที่สำคัญได้แก่:

- รองรับการส่งออกเป็นฟอร์แมตที่ใช้กันแพร่หลาย เช่น ROS bag สำหรับการบูรณาการกับระบบโรโบติกส์, แพ็กเกจสภาพแวดล้อมอย่าง CARLA หรือการส่งออกเป็นชุดแอนโนเทชันในรูปแบบ COCO/KITTI เพื่อใช้เทรน perception models

- รองรับกระบวนการ data augmentation และ domain randomization อัตโนมัติ เพื่อลดการ overfit และเพิ่มความทนทานของโมเดลต่อสภาพแวดล้อมจริง

- สามารถรันการทดสอบแบบ closed‑loop โดยนำโมเดลที่ถูกฝึกแล้ว (สามารถนำเข้าเป็น ONNX เพื่อรันบน engine ต่างๆ) กลับมาทดสอบร่วมกับตัวขับเคลื่อนการควบคุมและแผนที่พฤติกรรม เพื่อประเมินผลกระทบต่อการตัดสินใจและความปลอดภัย

- รองรับการสเกลการผลิตข้อมูล — ผู้ใช้สามารถสร้างสตรีมข้อมูลระดับหลายล้านเฟรมต่อวันและจัดการ metadata/benchmarking เพื่อใช้ในการวิเคราะห์ประสิทธิภาพของโมเดลแบบองค์รวม

สรุปแล้ว Synthetic‑Sensor Suite ไม่ใช่เพียงเครื่องมือสร้างภาพหรือ point cloud เท่านั้น แต่เป็นแพลตฟอร์มที่ผสมผสานการเรนเดอร์ความสมจริงสูง การจำลองฟิสิกส์ของเซ็นเซอร์ และการสร้างสถานการณ์อัตโนมัติ เข้ากับการส่งออกที่เข้ากันได้กับระบบพัฒนา AI ปัจจุบัน ผลลัพธ์ที่ได้คือความสามารถในการเพิ่มความครอบคลุมของการทดสอบ ลดความเสี่ยงและเวลาในการทดสอบภาคสนาม และช่วยให้องค์กรสามารถเร่งการปล่อยฟีเจอร์ใหม่ได้อย่างปลอดภัยและมีประสิทธิภาพ

เทคโนโลยีเบื้องหลัง — การสร้างความสมจริงและลดช่องว่าง Sim-to‑Real

เทคโนโลยีเบื้องหลัง — การสร้างความสมจริงและลดช่องว่าง Sim-to‑Real

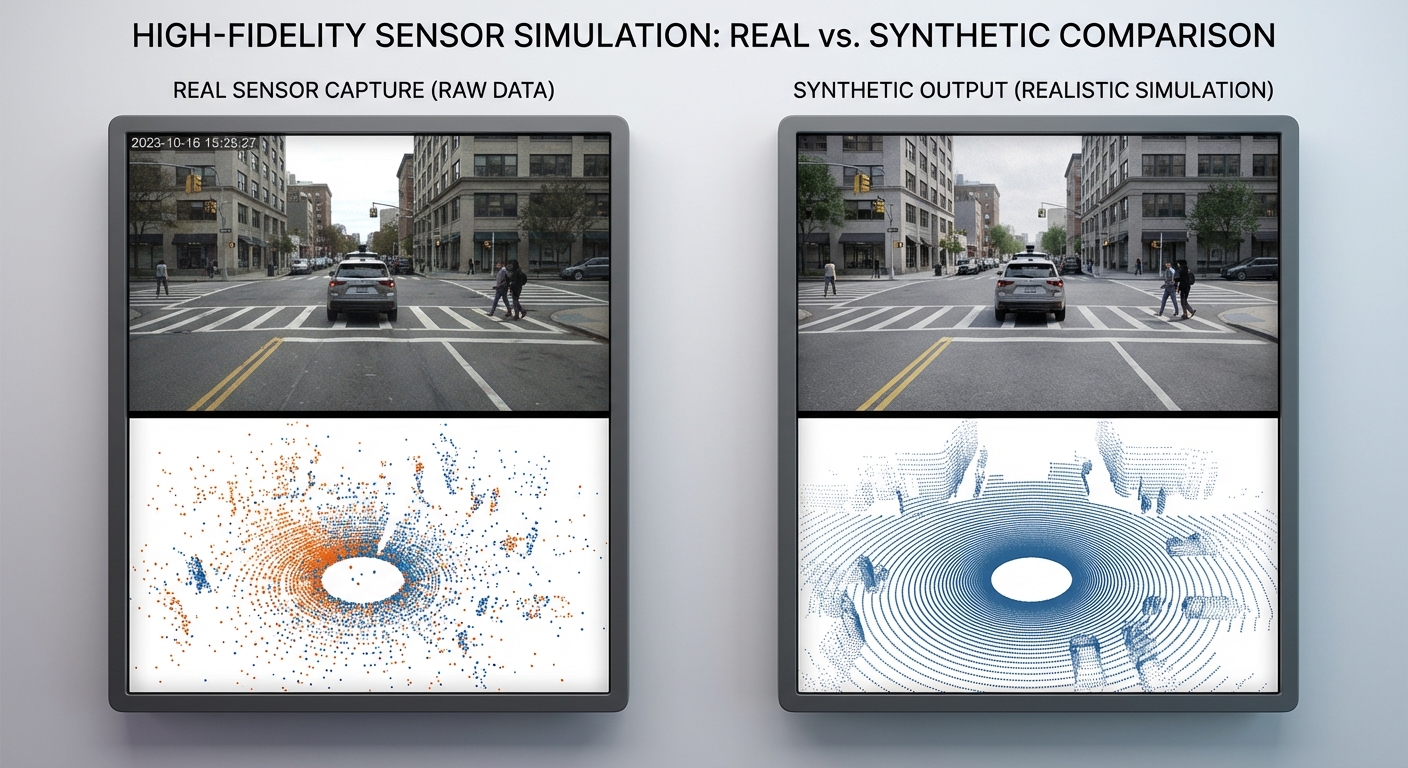

เพื่อให้ชุดข้อมูลจำลองของ Synthetic‑Sensor Suite มีความสมจริงเพียงพอสำหรับการเทรนโมเดลรถยนต์ไร้คนขับ ทีมพัฒนานำแนวทางเชิงฟิสิกส์และการเรนเดอริงขั้นสูงมารวมกับการจำลองพฤติกรรมของเซ็นเซอร์ในระดับรายละเอียดสูง กระบวนการหลักประกอบด้วยการใช้ physics‑based rendering (PBR) และโมเดลการกระจายแสง (BRDF/BSDF) เช่น Cook‑Torrance และ microfacet เพื่อให้การสะท้อนและการกระจายของแสงบนวัสดุตรงตามลักษณะทางกายภาพจริง ๆ รวมทั้งใช้เทคนิค Monte Carlo path tracing และ ray tracing แบบปรับแต่งเพื่อจำลองปฏิสัมพันธ์ของแสงกับชิ้นส่วนต่าง ๆ อย่างถูกต้อง การผสานการเรนเดอริงเชิงฟิสิกส์กับระบบวัสดุ (material shaders) ที่มีพารามิเตอร์วัดได้จริง (เช่น albedo, roughness, specular) ทำให้ภาพและการสะท้อนบนพื้นผิวเปียก/แห้งมีความเที่ยงตรงเมื่อเทียบกับข้อมูลสนามจริง

ชุดเทคนิคที่ใช้ในการสร้างความสมจริงของภาพและ point cloud รวมถึง:

- โมเดลวัสดุเชิงวัดผล: การใช้ตารางค่าการสะท้อนจริงจากตัวอย่างวัสดุ (measured BRDF) เพื่อให้ค่าความสะท้อนในภาพและค่าความสว่างในการคืนสัญญาณ LiDAR สอดคล้องกับโลกจริง

- การจำลองแสงและสภาพอากาศแบบไดนามิก: HDR environment maps, แบบจำลองพระอาทิตย์แบบพารามิเตอร์, ระบบเมฆแบบกายภาพ, การกระจายและการกระเจิงในบรรยากาศ (volumetric scattering) สำหรับหมอก ฝน และหิมะ รวมถึงการจำลองเงาสะท้อนบนพื้นเปียก

- การเรนเดอริงแบบเชื่อมโยงกับเซ็นเซอร์: การจำลองแสงแฟลร์, การกระเจิงผ่านเลนส์, rolling shutter, motion blur และการบิดเบือนเชิงเรขาคณิตของเลนส์กล้อง

- โมเดลฟิสิกส์สำหรับ LiDAR และ Radar: จำลองการตกกระทบของลำแสงแต่ละบีม, ความกว้างมุมของบีม, การสะท้อนหลายทาง (multipath), การสูญเสียสัญญาณตามระยะทาง และลักษณะความเข้มสัญญาณ (intensity/reflectivity)

สำหรับข้อมูลประเภท point cloud ทีมพัฒนายกระดับความสมจริงด้วยการจำลองละเอียดของการทำงานของ LiDAR เช่น การโมเดลการกระเจิงเกล็ดน้ำบนพื้นผิวเปียก การรวมเอฟเฟ็กต์ noise แบบระยะทาง (range‑dependent noise) และลักษณะการคืนค่า intensity ที่ขึ้นกับมุมตกกระทบของลำแสง ทั้งนี้รวมถึงการจำลองจุดหลอก (ghost points) และการสูญเสียจุดจากการบัง (occlusion) เพื่อให้รูปแบบความหนาแน่นของ point cloud ใกล้เคียงกับข้อมูลที่บันทึกในสนามจริง ซึ่งมีผลโดยตรงต่อประสิทธิภาพของอัลกอริทึมการตรวจจับและการทำแผนที่ (e.g., การวัด mAP และ IoU ในการทดสอบภาคสนาม)

อีกหนึ่งกลยุทธ์สำคัญคือการใช้ domain randomization ร่วมกับการสร้างสถานการณ์แบบ adversarial เพื่อรับประกันความทนทานของโมเดล ทีมจะสุ่มความแปรผันของพารามิเตอร์หลายมิติพร้อมกัน — เช่น สีและลวดลายผิวของวัตถุ, ตำแหน่งและความหนาแน่นของการจราจร, มุมกล้อง, พารามิเตอร์เซ็นเซอร์ (เช่น SNR, gain), เวลาของวัน และสภาพอากาศ — เพื่อให้โมเดลไม่พึ่งพาลักษณะจำเพาะของฉากจำลองเพียงรูปแบบเดียว นอกจากนี้ยังสร้าง adversarial scenarios เช่น แสงย้อน, รถตัดหน้าแบบกะทันหัน, การเกิดเงาเข้มแบบไม่ปกติ หรือการล้มเหลวของเซ็นเซอร์บางส่วน เพื่อให้โมเดลได้ฝึกเผชิญกับเหตุการณ์หายากและ edge case ที่มักเป็นสาเหตุของความล้มเหลวในโลกจริง

การลดช่องว่าง Sim‑to‑Real ยังพึ่งพาการผสานข้อมูลจริงอย่างเป็นระบบ (real‑world calibration) โดยใช้ชุดข้อมูลอ้างอิงจากการทดสอบบนทางจริงเพื่อปรับพารามิเตอร์ของซิมูเลเตอร์ กระบวนการนี้ประกอบด้วย:

- การเก็บข้อมูลการทดลองควบคุม (calibration runs) บนทางทดสอบ: เก็บข้อมูลกล้อง, LiDAR, Radar และ telematics เพื่อสถิติของ noise, distribution ของ intensity และข้อผิดพลาดเชิงตำแหน่ง

- การปรับพารามิเตอร์แบบมีตัวชี้วัด (metric‑driven optimization): ใช้การปรับจูนพารามิเตอร์ซิมูเลเตอร์โดยลดความคลาดเคลื่อนระหว่างสถิติของข้อมูลจำลองและข้อมูลจริง (เช่น histogram ของ intensity, spatial error distribution, angular error) โดยใช้วิธีเช่น Bayesian optimization หรือ gradient‑based tuning หาก renderer รองรับ differentiable rendering

- การประยุกต์ใช้ domain adaptation และ GANs: ใช้เครือข่ายเช่น CycleGAN หรือ feature‑level adversarial alignment เพื่อย่อส่วนความแตกต่างด้านสไตล์ระหว่างภาพจำลองและภาพจริง จากนั้น fine‑tune โมเดลด้วยชุดข้อมูลจริงขนาดเล็ก (few‑shot) เพื่อลดการพึ่งพาข้อมูลสนามขนาดใหญ่

- วงจรป้อนกลับแบบปิด (closed‑loop validation): นำโมเดลที่เทรนจากข้อมูลจำลองไปทดสอบในสภาพสนามจริงจริง เก็บข้อผิดพลาดหลักกลับมาปรับพารามิเตอร์ซิมูเลเตอร์อย่างต่อเนื่อง ซึ่งช่วยให้ sim‑to‑real gap ลดลงอย่างมีระบบ

ผลลัพธ์เชิงประจักษ์จากการใช้งานกระบวนการข้างต้นโดยสตาร์ทอัพรายนี้แสดงให้เห็นว่าเมื่อผสาน PBR ระดับพารามิเตอร์วัดได้, โมเดล noise ของเซ็นเซอร์อย่างละเอียด และการทำ domain randomization ร่วมกับการปรับเทียบจากข้อมูลจริงแล้ว สามารถลดความจำเป็นในการทดสอบถนนจริงสำหรับการเปิดตัวฟีเจอร์ใหม่ได้อย่างมีนัยสำคัญ — บริษัทรายงานการลดการทดสอบภาคสนามได้สูงสุดถึง 90% ในกรณีฟีเจอร์บางประเภท และมีการเพิ่มขึ้นของประสิทธิภาพการตรวจจับในสภาพแวดล้อมจริง (เช่น mAP เพิ่มขึ้นโดยเฉลี่ย 10–20% เมื่อเทียบกับการเทรนด้วยข้อมูลจำลองแบบพื้นฐานเพียงอย่างเดียว) ซึ่งสะท้อนว่าการออกแบบซิมูเลเตอร์เชิงฟิสิกส์ร่วมกับกลยุทธ์ด้านข้อมูลจริงเป็นกุญแจสำคัญในการปิดช่องว่าง Sim‑to‑Real

ผลลัพธ์เชิงตัวเลข: การลดทดสอบถนนจริงและตัวชี้วัดสำคัญ

ผลลัพธ์เชิงตัวเลข: การลดทดสอบถนนจริงและตัวชี้วัดสำคัญ

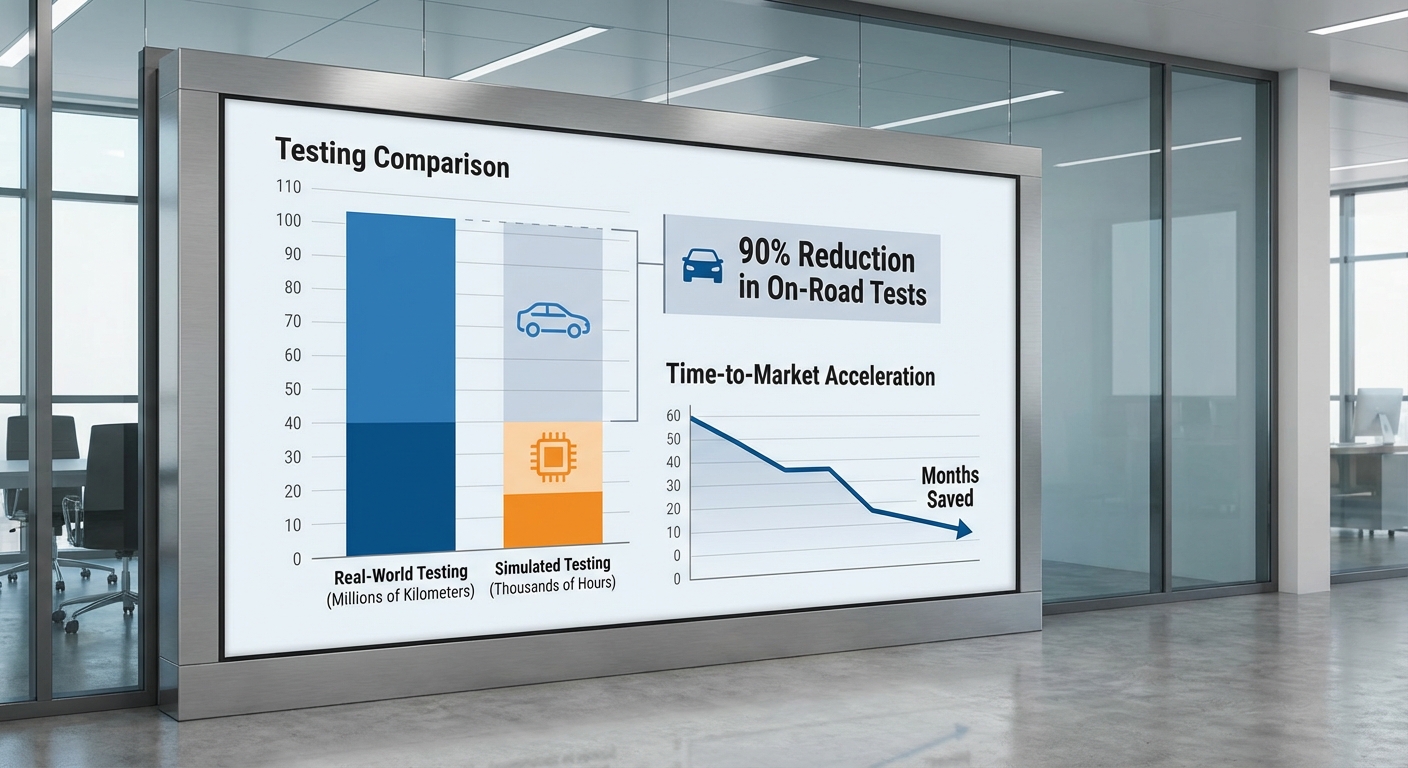

สตาร์ทอัพระบุว่าแพลตฟอร์ม Synthetic‑Sensor Suite ช่วยลดความจำเป็นในการทดสอบบนถนนจริงได้สูงสุดถึง 90% (ตามข้อมูลภายในของบริษัท) — ผลลัพธ์ซึ่งหมายถึงการลดชั่วโมงบุคลากร ค่าเช่าสนามทดสอบ และความเสี่ยงด้านความปลอดภัยอย่างมีนัยสำคัญ ตัวอย่างเชิงเปรียบเทียบที่นำเสนอโดยบริษัทแสดงให้เห็นว่า จากเดิมที่ต้องใช้การทดสอบจริงประมาณ 10,000 ชั่วโมงต่อปี สำหรับชุดฟีเจอร์หนึ่งชุด สามารถลดลงเหลือเพียง 1,000 ชั่วโมง หลังผสานกับการทดสอบเชิงสังเคราะห์อย่างเข้มข้น

การลดชั่วโมงทดสอบจริงมาพร้อมกับการเพิ่มชั่วโมงการทดสอบในซิมอย่างก้าวกระโดด ตัวอย่างจากการประยุกต์ใช้จริงของลูกค้าในกลุ่มยานยนต์แสดงว่า ชั่วโมงการทดสอบเชิงจำลองเพิ่มขึ้นจาก 20,000 ชั่วโมงเป็น 1,200,000 ชั่วโมง ต่อปี (เพิ่มขึ้นประมาณ 60 เท่า) — ทำให้ทีมวิศวกรรมสามารถสร้างและวนทดสอบสถานการณ์ที่หายาก (edge cases) ได้ในระดับที่เป็นไปไม่ได้หากพึ่งพาการทดสอบจริงเพียงอย่างเดียว นอกจากนี้การเทียบเชิงมูลค่าทางธุรกิจพบว่าเมื่อนับต้นทุนต่อชั่วโมง ทดสอบในซิมมีต้นทุนต่ำกว่าการทดสอบจริงถึง 5–10 เท่า ในหลายกรณี

เมตริกสำคัญที่ใช้วัดผลลัพธ์เชิงตัวเลข (จากรายงานภายในและผลการประเมินเชิงพรีโปรดักชัน) ประกอบด้วย:

- Scenario coverage: เพิ่มจากประมาณ 35% (จากชุดทดสอบจริงเท่านั้น) เป็นกว่า 92–95% เมื่อรวมการทดสอบเชิงจำลอง ซึ่งครอบคลุมสถานการณ์วันต่อวันและเหตุการณ์หายากที่มีความซับซ้อน

- Closed-loop failure rate (อัตราความล้มเหลวในระบบปิดต่อชั่วโมงทดสอบ): จากการวัดจริงอยู่ที่ ~0.4% ต่อหมวดสถานการณ์ ลดลงเป็น ~0.02% ในซิม — สะท้อนการค้นพบและแก้ไขข้อบกพร่องก่อนปล่อยเข้าสนามจริง

- Mean Time Between Failures (MTBF): สำหรับบิลด์ก่อนปล่อย (release candidate) MTBF ที่สังเกตได้เพิ่มจากเฉลี่ย ~150–300 ชั่วโมง ในการทดสอบจริง เป็นกว่า 10,000 ชั่วโมง เมื่อรวมการทดสอบเชิงจำลองเชิงปิดวงจร (aggregated simulated hours)

- Reduction in late-stage defects: จำนวนปัญหาที่พบในขั้นตอนทดสอบจริงของ release candidate ลดลงประมาณ 60–75% ตัวอย่างเช่น จากเดิมพบเฉลี่ย 150 ปัญหาต่อ RC ลดเหลือ 35–60 ปัญหา

- Time-to-market: ด้วยการย้ายภาระการทดสอบไปยังซิมและตรวจสอบฟีเจอร์ในสเกลที่ใหญ่ขึ้น บริษัทลูกค้ารายหนึ่งรายงานว่าเวลาในการออกฟีเจอร์จากต้นแบบสู่การปล่อยลดลงจาก 6 เดือนเป็น 3 เดือน (เพิ่มความเร็วประมาณ 50%)

เพื่อสื่อสารภาพรวมเชิงตัวเลขไปยังผู้บริหารและนักลงทุน แนะนำชุดกราฟตัวอย่างดังนี้:

- Bar chart — ชั่วโมงทดสอบ (จริง vs ซิม): แสดงการลดลงของชั่วโมงทดสอบจริงพร้อมการเพิ่มขึ้นของชั่วโมงทดสอบซิม (เช่น 10,000 → 1,000 ชั่วโมง; 20,000 → 1,200,000 ชั่วโมง)

- Line chart — Closed-loop failure rate ต่อรอบการทดสอบ: เทรนด์ค่าความล้มเหลวจากหลายรีลีส แสดงการลดลงหลังนำซิมเข้ามาใช้

- Stacked bar — Cost breakdown per release: ต้นทุนการทดสอบจริง เทียบกับต้นทุนการทดสอบซิม และการประหยัดรวม

- Radar chart — Scenario coverage: เปรียบเทียบขอบเขตสถานการณ์ที่ครอบคลุมก่อนและหลังใช้งาน Synthetic‑Sensor Suite

สรุปเชิงธุรกิจ: ตัวเลขแสดงให้เห็นว่าวิธีการทดสอบที่ผสมผสานซิมและเซ็นเซอร์จำลองอย่างสูง ช่วยให้ทีมวิศวกรรมเพิ่มความถี่ของการทดสอบ ลดความเสี่ยงจากการทดสอบจริง และปล่อยฟีเจอร์ได้เร็วขึ้นโดยมีข้อบกพร่องในระยะสุดท้ายลดลงอย่างชัดเจน — ผลลัพธ์ที่ชัดเจนทั้งในเชิงเวลาและต้นทุน ซึ่งเป็นปัจจัยสำคัญในการแข่งขันของผู้พัฒนายานยนต์ไร้คนขับในปัจจุบัน

กรณีศึกษา/พาร์ทเนอร์นำร่องในไทย

กรณีศึกษา/พาร์ทเนอร์นำร่องในไทย

ในโครงการนำร่องที่ดำเนินการร่วมกันระหว่างสตาร์ทอัพผู้พัฒนา Synthetic‑Sensor Suite กับผู้ผลิตยานยนต์และทีมวิจัยจากสถาบันเทคโนโลยีแห่งหนึ่งในประเทศไทย เป้าหมายหลักคือเร่งการพัฒนาและทดสอบสองฟีเจอร์สำคัญคือ automated lane change และ urban intersection handling โดยมุ่งให้ระบบสามารถตัดสินใจและปฏิบัติในสภาพการจราจรจริงที่มีความซับซ้อนได้อย่างปลอดภัยและเป็นไปตามมาตรฐานความปลอดภัยสากล

รายละเอียดของ pilot ระบุว่าโครงการใช้ระยะเวลา 6 เดือน ทีมทดสอบรวมทั้งหมด 18 คน ประกอบด้วยวิศวกรซอฟต์แวร์ 10 คน, นักวิทยาศาสตร์ข้อมูล/ML 4 คน, วิศวกรความปลอดภัย 2 คน และคนขับทดสอบ 2 คน การทำงานแบ่งเป็นรอบสั้น (sprint) รายสัปดาห์ โดยผสานการสร้างสถานการณ์จำลอง (scenario generation), เซนเซอร์จำลองความสมจริงสูง (LiDAR, radar, camera noise & weather emulation), และการถอดรหัสผลทดสอบอัตโนมัติกลับสู่ระบบ CI/CD ของทีมผู้ผลิต

ผลลัพธ์เชิงปฏิบัติที่วัดได้จาก pilot แสดงความแตกต่างอย่างชัดเจน ได้แก่ จำนวนสถานการณ์ที่ซิมูเลตได้เทียบกับการทดสอบบนถนนจริง: ทีมสามารถสร้างและรัน 15,200 สกีนาริโอจำลอง สำหรับทั้งสองฟีเจอร์ ในขณะที่การทดสอบบนถนนจริงถูกจำกัดอยู่ที่ 1,520 สกีนาริโอ — เทียบเท่าการลดความจำเป็นในการทดสอบจริงลงถึง 90% ตามเป้าหมายเชิงประสิทธิภาพ นอกจากนี้ Suite สามารถจับข้อบกพร่องสำคัญก่อนปล่อย (pre‑release) ได้ทั้งหมด 412 รายการ ในสเตจการจำลอง และอีก 48 รายการ ระหว่างการทดสอบยานพาหนะจริงก่อนปล่อยสู่ลูกค้า ทำให้จำนวนบั๊กที่ไปถึงผู้ใช้หลังปล่อยลดลงอย่างมีนัยสำคัญ

สรุปตัวชี้วัดสำคัญจาก pilot:

- สถานการณ์จำลอง: 15,200 สกีนาริโอ (8,600 สำหรับ lane change, 6,600 สำหรับ intersection)

- การทดสอบถนนจริง: 1,520 สกีนาริโอ (ลดลง 90%)

- ข้อบกพร่องที่จับได้ก่อนปล่อย: 460 รายการรวม (412 ในซิมูเลชัน + 48 ในการทดสอบจริง)

- เวลาในการปล่อยฟีเจอร์: ลดจากเฉลี่ย 24 สัปดาห์เป็น 8 สัปดาห์ (เร็วขึ้น 3 เท่า)

- บั๊กหลังปล่อยในสนาม: ลดลงจาก baseline ประมาณ 340 รายการต่อไตรมาส เป็น 72 รายการ (ลด ~79%)

- การจับปัญหาด้านความปลอดภัยเชิงวิศวกรรม: ซิมูเลชันสามารถจับได้ถึง 94% ของ violation ที่จัดว่า critical สำหรับ lane change และ 89% สำหรับ intersection

บทเรียนที่ได้และการปรับปรุง workflow หลัง pilot มีดังนี้: ทีมผู้ผลิตปรับหลักการทดสอบให้เริ่มด้วย scenario-driven simulation ตั้งแต่ต้นวงจรพัฒนาเพื่อลด rework, กำหนด metric การยอมรับที่ชัดเจน (pass/fail thresholds) สำหรับแต่ละสถานการณ์, รวมการรันซ้ำอัตโนมัติใน CI/CD pipeline และสร้างกระบวนการ feedback loop ที่ดึง log จากการทดสอบถนนจริงมาสร้างสถานการณ์ใหม่แบบอัตโนมัติ (closed‑loop scenario generation) เทคนิคเหล่านี้ช่วยให้ทีมระบุ regression ได้เร็วขึ้นและลดเวลาที่ต้องใช้สำหรับการทดสอบซ้ำในสนาม

ข้อจำกัดและข้อควรระวังที่ทีมสังเกตเห็นคือ แม้ซิมูเลชันจะลดความจำเป็นสำหรับการทดสอบสนามได้มาก แต่ยังมี corner cases และปัจจัยสภาพแวดล้อมท้องถิ่นเฉพาะจุดที่ต้องยืนยันด้วยการขับจริง เช่น พฤติกรรมผู้ขับขี่ท้องถิ่นหรือการบิดเบือนเชิงแสงในบางมุมกล้อง ดังนั้นบทสรุปทางปฏิบัติคือให้ใช้ Synthetic‑Sensor Suite เป็นเครื่องมือหลักในการคัดกรองและเสริมการทดสอบสนาม ไม่ใช่ทดแทนการยืนยันความปลอดภัยสุดท้ายบนถนนจริง

จากผลลัพธ์ของ pilot นี้ ผู้ร่วมโครงการได้ขยายการใช้งาน Suite ไปยังโปรเจ็กต์ย่อยอื่น ๆ ของบริษัท พร้อมตั้งเป้าทำให้กระบวนการ simulation‑first กลายเป็นมาตรฐานการทดสอบสำหรับฟีเจอร์ ADAS ต่อไปเพื่อเพิ่มความรวดเร็วในการปล่อยสินค้าพร้อมรักษามาตรฐานความปลอดภัยสูงสุด

ความปลอดภัย กฎระเบียบ และข้อจำกัดที่ต้องระวัง

ความปลอดภัย กฎระเบียบ และข้อจำกัดที่ต้องระวัง

การนำชุดเครื่องมือ Synthetic‑Sensor Suite มาใช้เพื่อสร้างข้อมูลจำลองความสมจริงสูงสำหรับเทรน AI รถยนต์ไร้คนขับสร้างโอกาสในการลดการทดสอบบนท้องถนนจริงลงอย่างมีนัยสำคัญ — ตามที่สตาร์ทอัพรายงานว่าสามารถลดการทดสอบถนนจริงได้ถึง 90% ในบางกรณี อย่างไรก็ตาม ด้านความปลอดภัยและการยอมรับจากหน่วยงานกำกับดูแลยังคงมีเงื่อนไขและข้อจำกัดที่ต้องจัดการอย่างเป็นระบบก่อนนำระบบขึ้นใช้งานเชิงพาณิชย์บนถนนสาธารณะ

หน่วยงานกำกับดูแลและมาตรฐานที่เกี่ยวข้องมักต้องการหลักฐานการวาลิเดชันที่ชัดเจนและเป็นไปตามหลักการรับรอง (assurance) ที่ตรวจสอบได้ ได้แก่การปฏิบัติตามมาตรฐานความปลอดภัยสำหรับยานพาหนะและซอฟต์แวร์ เช่น ISO 26262 (functional safety), ISO/PAS 21448 (SOTIF) สำหรับความปลอดภัยของฟังก์ชันที่ตั้งใจไว้ และกฎระเบียบระดับสากลอย่าง UNECE ที่ครอบคลุมเรื่องการอนุญาตและการตรวจสอบซอฟต์แวร์ ยิ่งไปกว่านั้น ผู้พัฒนาจำเป็นต้องจัดทำ assurance case หรือชุดหลักฐานประกอบการยืนยันความปลอดภัย ซึ่งรวมถึงเอกสารข้อกำหนด, เทสเคสที่ครอบคลุม, รายงานการทดสอบเชิงปริมาณ และกระบวนการควบคุมคุณภาพของข้อมูลจำลองและโมเดล

การออกแบบแนวทางวาลิเดชันควรประกอบด้วยกระบวนการเชิงปฏิบัติ ดังนี้

- นิยามเกณฑ์ความปลอดภัยเชิงปริมาณ — กำหนดตัวชี้วัด (metrics) เช่นอัตราการชน, false positive/negative ในการตรวจจับสิ่งกีดขวาง, และเวลาตอบสนอง เพื่อใช้เปรียบเทียบผลจากซิมูเลชันและข้อมูลจริง

- ชุดสถานการณ์มาตรฐานและแบบสุ่ม — สร้างและใช้ชุดสถานการณ์ (scenario catalog) ที่ครอบคลุมสภาวะปกติและสถานการณ์เสี่ยงสูง (corner cases) เพื่อทดสอบความคงเส้นคงวาของโมเดล

- การตรวจสอบโดยภายนอก — จัดให้มีการตรวจประเมินจากหน่วยงานอิสระหรือห้องปฏิบัติการรับรอง เพื่อยืนยันความถูกต้องของโมเดลการจำลองและกระบวนการวาลิเดชัน

- traceability และการจัดการเวอร์ชัน — เก็บบันทึกที่เชื่อมโยงข้อกำหนด เทสเคส ผลการทดสอบ และเวอร์ชันของโมเดล/ข้อมูล เพื่อรองรับการตรวจสอบย้อนหลัง

อย่างไรก็ตาม ข้อมูลจำลองมีข้อจำกัดที่ต้องตระหนักชัดเจนก่อนยอมรับผลการทดสอบเป็นหลักฐานความปลอดภัยเต็มรูปแบบ:

- sim‑to‑real gap — แม้การจำลองจะมีความสมจริงทางภาพและสัญญาณเซนเซอร์สูง แต่ยังคงมีช่องว่างระหว่างพฤติกรรมในโลกเสมือนกับโลกจริง เช่น โมเดลแสงเงา การสะท้อน การสั่นสะเทือน และการรบกวนสัญญาณที่เกิดขึ้นจริงอาจสร้างผลการรับรู้ต่างไป

- rare edge cases — เหตุการณ์หายากแต่มีผลร้ายแรง (เช่น เด็กวิ่งตามลูกบอลข้ามถนนในที่มืด, วัสดุชิ้นเล็กบนพื้นถนนในมุมมองที่แปลก) อาจไม่ถูกจับหรือจำลองครบถ้วนใน dataset แม้จะใช้การสุ่มหรือการเร่งสถานการณ์ก็ตาม

- inter‑agent interactions — การโต้ตอบเชิงซับซ้อนระหว่างหลายฝ่าย (ผู้ขับขี่คนอื่น ผู้เดินถนน รถจักรยานยนต์ รถฉุกเฉิน) มีพลวัตที่ยากต่อการจำลองพฤติกรรมมนุษย์ที่ไม่เป็นเหตุเป็นผลหรือไม่สอดคล้องกับกฎจราจร

- human factors — ปัจจัยด้านพฤติกรรมมนุษย์ เช่น การตัดสินใจฉับพลัน ความสับสนของผู้เดินถนน หรือการรบกวนจากสิ่งรอบข้าง—สิ่งเหล่านี้ซ้ำยากในซิมูเลชัน

เพื่อบรรเทาความเสี่ยงและเพิ่มโอกาสการยอมรับจากหน่วยงานกำกับดูแล บริษัทสตาร์ทอัพและผู้ผลิตควรนำแนวทางเชิงผสมผสานมาปรับใช้:

- hybrid testing — ผสานการทดสอบเชิงซิมูเลชันกับการทดสอบในสนามจริงแบบค่อยเป็นค่อยไป (closed‑course + controlled on‑road) โดยเริ่มจากสถานการณ์ที่ซิมูเลชันทำนายได้ดี ไปสู่สถานการณ์ที่มีความไม่แน่นอนสูง

- shadow mode testing — ใช้ระบบในโหมดเงา (ไม่ควบคุมพาหนะจริง) เพื่อรันทดสอบโมเดลกับข้อมูลจากรถที่ขับโดยมนุษย์จริง ๆ และวัดความแตกต่างระหว่างการตัดสินใจของโมเดลกับการตัดสินใจที่เกิดขึ้นจริงในสภาพแวดล้อมต่าง ๆ

- continuous monitoring & fleet learning — หลังการปรับใช้ ต้องมีกลไกมอนิเตอร์แบบเรียลไทม์สำหรับข้อมูลเหตุการณ์ที่ไม่คาดคิด พร้อมวงจรเรียนรู้ต่อเนื่อง (continuous validation) เพื่ออัปเดตโมเดลและข้อมูลจำลองอย่างมีการควบคุม

- stress testing และ adversarial scenario generation — สร้างสถานการณ์เชิงรุกที่ออกแบบมาเพื่อทำลายสมมติฐานของโมเดล (adversarial) และทดสอบการตอบสนองของระบบภายใต้เงื่อนไขรุนแรง

- safety‑by‑design และ runtime assurance — รวมมาตรการความปลอดภัยที่ทำงานในระดับ runtime เช่น safety monitors, fallback strategies, และวงจรการตัดการควบคุมอัตโนมัติเมื่อสภาพแวดล้อมเกินขอบเขตที่รับประกันได้

สรุปได้ว่า Synthetic‑Sensor Suite สามารถเป็นเครื่องมือทรงพลังในการลดภาระการทดสอบและเร่งการพัฒนาฟีเจอร์ใหม่ แต่การยอมรับเชิงกฎระเบียบและความปลอดภัยในระดับการใช้งานจริงจำเป็นต้องอาศัยกระบวนการวาลิเดชันที่โปร่งใส มีการตรวจสอบโดยอิสระ และการทดสอบแบบผสม (hybrid) ที่ครอบคลุม corner‑cases, inter‑agent interactions และ human factors อย่างต่อเนื่อง ระบบที่ประสบความสำเร็จจะต้องนำเสนอทั้งหลักฐานเชิงปริมาณและกรณีทดสอบเชิงคุณภาพที่สอดคล้องกับข้อกำหนดของหน่วยงานกำกับดูแลก่อนจะได้รับความไว้วางใจให้ปฏิบัติการบนถนนสาธารณะอย่างกว้างขวาง

ผลกระทบเชิงธุรกิจและอนาคตของตลาดในไทย/อาเซียน

ผลกระทบเชิงธุรกิจและอนาคตของตลาดในไทย/อาเซียน

การนำเสนอ Synthetic‑Sensor Suite ที่สร้างข้อมูลจำลองความสมจริงสูงสำหรับการเทรน AI ของรถยนต์ไร้คนขับมีผลกระทบเชิงธุรกิจโดยตรงต่อโมเดลต้นทุนและวิธีการทำงานของผู้พัฒนา AV โดยเฉพาะการลดความจำเป็นในการทดสอบถนนจริงที่ผู้พัฒนาต้องลงทุนมากทั้งด้านยานพาหนะ บุคลากร ค่าน้ำมัน/พลังงาน และความเสี่ยงทางกฎหมาย เมื่อการทดสอบถนนจริงสามารถลดลงได้ถึง 90% ค่าใช้จ่ายเชิงปฏิบัติการในระยะสั้นจะลดลงอย่างมีนัยสำคัญ ส่วนในภาพรวมต้นทุนการพัฒนาอาจลดลงได้ตั้งแต่ระดับหลักสิบเปอร์เซ็นต์ไปจนถึงมากกว่า 50% ขึ้นกับสัดส่วนการพึ่งพาการทดสอบจริงของแต่ละโครงการและระดับการจำลองที่ใช้งาน

ผลทางธุรกิจอีกด้านคือการเปลี่ยนผ่านของโมเดลธุรกิจจากการขายฮาร์ดแวร์และบริการติดตั้ง ไปสู่ Data-as-a-Service และ Simulation-as-a-Service ที่เปิดโอกาสให้ผู้พัฒนาสร้างรายได้ต่อเนื่องจากการให้เช่าไลบรารีเหตุการณ์ (scenario libraries), โมดูลเซ็นเซอร์จำลอง และชุดการทดสอบมาตรฐานสำหรับการรับรองความปลอดภัย นอกจากนี้ความสามารถในการสร้างสถานการณ์ท้องถิ่นที่ซับซ้อน — เช่น สภาพถนนในเมืองไทยที่มีมอเตอร์ไซค์ รถสามล้อ และสภาพอากาศมรสุม — จะช่วยเร่งการยอมรับในเชิงพาณิชย์เพราะลดความเสี่ยงเมื่อนำระบบไปใช้งานจริง

สำหรับสตาร์ทอัพไทย โอกาสทางการค้ามีความชัดเจนในภูมิภาคอาเซียนที่มีประชากรกว่า 650 ล้านคนและการเติบโตของความต้องการโซลูชัน Mobility-as-a-Service และโลจิสติกส์อัตโนมัติ การเสนอผลิตภัณฑ์ที่ปรับแต่งได้ตามบริบทท้องถิ่น (localized scenarios) ทำให้สตาร์ทอัพไทยสามารถแข่งขันได้ด้วยความรู้เชิงภูมิศาสตร์และการจูนพฤติกรรมการขับขี่เฉพาะของประเทศในอาเซียน นอกจากนี้การเป็นผู้ให้บริการแพลตฟอร์มจำลองที่รองรับมาตรฐานความปลอดภัยและการรับรอง (เช่น การบูรณาการกับกรอบงาน ISO/SOTIF และการสนับสนุนการทดลองใน sandbox ของหน่วยงานกำกับดูแล) จะทำให้มีช่องทางร่วมมือกับผู้ผลิตรถยนต์ (OEM) และซัพพลายเออร์รายใหญ่ในภูมิภาค

แนวโน้มเทคโนโลยีที่ควรจับตามองประกอบด้วย digital twins สำหรับเมืองและโครงข่ายจราจร, federated simulation ซึ่งรองรับการร่วมมือกันของหลายองค์กรโดยไม่ต้องแชร์ข้อมูลดิบ, และ online learning ที่ทำให้โมเดลสามารถปรับตัวจากข้อมูลจำลองและข้อมูลจริงอย่างรวดเร็ว ระยะถัดไปจะเห็นการผสมผสานของ generative models ที่สร้างเหตุการณ์หายาก (edge cases), การทำ domain adaptation เพื่อลดช่องว่างระหว่างข้อมูลจริงและจำลอง และการสร้างระบบตรวจสอบ/อธิบายผล (explainability) เพื่อสนับสนุนการรับรองความปลอดภัย

- ข้อเสนอแนะเชิงกลยุทธ์สำหรับผู้ประกอบการ: ลงทุนในไลบรารีสถานการณ์ที่เป็นภูมิภาค (localized scenario libraries), พัฒนา API แบบโมดูลาร์สำหรับการบูรณิง่าย, และจัดตั้งพันธมิตรกับ OEM, ฟลีทโลจิสติกส์ และศูนย์ทดสอบเพื่อสร้างกรณีใช้งานเชิงพาณิชย์ที่ชัดเจน

- ข้อเสนอแนะสำหรับนักลงทุน: มองหา startups ที่มีความเชี่ยวชาญทางโดเมนท้องถิ่นและความสามารถทางเทคนิคในด้าน simulation fidelity และ data governance; ให้ความสำคัญกับทีมที่มีแผนการสร้างรายได้แบบซับสคริปชัน และมีช่องทางการขยายสู่ตลาดอาเซียน

- สิ่งที่ต้องจับตามองด้านนโยบายและมาตรฐาน: การออกแนวทางการรับรองการใช้ข้อมูลจำลองในการพิสูจน์ความปลอดภัย ความชัดเจนของกฎระเบียบใน sandbox ของหน่วยงานกำกับ และความร่วมมือระหว่างประเทศในอาเซียนจะเป็นปัจจัยสำคัญในการขยายตลาด

โดยสรุป Synthetic‑Sensor Suite ไม่เพียงช่วยลดต้นทุนและเร่งการออกฟีเจอร์ของผู้พัฒนา AV เท่านั้น แต่ยังสร้างโอกาสให้สตาร์ทอัพไทยขยับไปสู่บทบาทผู้ให้บริการเทคโนโลยีที่สามารถส่งออกไปยังอาเซียนได้ หากผสานกับกลยุทธ์เชิงพาณิชย์ที่ชัดเจน การปฏิบัติตามมาตรฐานความปลอดภัย และการติดตามเทคโนโลยีใหม่อย่างต่อเนื่อง สตาร์ทอัพเหล่านี้มีโอกาสเป็นผู้เล่นสำคัญในห่วงโซ่คุณค่าของระบบ mobility อัจฉริยะในภูมิภาคได้อย่างยั่งยืน

บทสรุป

Synthetic‑Sensor Suite เป็นเทคโนโลยีการสร้างข้อมูลจำลองความสมจริงสูงสำหรับเซนเซอร์ยานยนต์ (เช่น LiDAR, กล้อง, เรดาร์) ที่ช่วยย่นระยะเวลาการพัฒนาและลดการทดสอบถนนจริงอย่างมีนัยสำคัญ โดยบริษัทอ้างว่าสามารถ ลดการทดสอบถนนจริงได้ถึง 90% และเร่งการปล่อยฟีเจอร์ใหม่ให้สั้นลงจากระดับหลายเดือนลงเหลือสัปดาห์ถึงเดือนในหลายกรณี ตัวอย่างการใช้งานรวมถึงการสร้าง point cloud จำลองภายใต้สภาพอากาศต่าง ๆ, การสังเคราะห์ภาพกล้องพร้อม noise และ occlusion, และการจำลองเหตุการณ์มุมฉาก (corner cases) ที่หายากในข้อมูลจริง อย่างไรก็ตามความท้าทายเชิงวิศวกรรมยังคงอยู่ที่ sim-to-real gap — ความแตกต่างระหว่างพฤติกรรมในซิมูเลเตอร์กับโลกจริง — จึงจำเป็นต้องมีการวาลิเดชันและการทดสอบต่อเนื่อง (continuous validation, real-world fine‑tuning, domain randomization และ monitoring) เพื่อยืนยันความปลอดภัยและประสิทธิผลก่อนนำไปใช้งานจริง

ในเชิงธุรกิจ สตาร์ทอัพไทยมีโอกาสขยายตลาดและยกระดับระบบนิเวศยานยนต์อัตโนมัติทั้งในประเทศและภูมิภาค หากสามารถผสานการทดสอบซิมูเลเตอร์เข้ากับกระบวนการทดสอบจริงอย่างเป็นระบบ (hybrid test pipelines, certified validation workflows) องค์กรจะได้ประโยชน์จากต้นทุนการทดสอบที่ต่ำลง เวลาออกสู่ตลาดที่เร็วขึ้น และความสามารถในการร่วมมือกับ OEMs และซัพพลายเออร์ระดับต้น ๆ เพื่อสร้างมาตรฐานร่วม การมองไปข้างหน้าควรให้ความสำคัญกับกรอบการวาลิเดชันที่ชัดเจน การรับรองจากหน่วยงานกำกับ และระบบการมอนิเตอร์หลังออกสู่สนาม เพื่อให้การลดการทดสอบจริงไม่ได้มาพร้อมกับความเสี่ยงที่ไม่ถูกตรวจจับ — เมื่อออกแบบกระบวนการผสมผสานอย่างรัดกุมแล้ว เทคโนโลยีนี้สามารถเป็นเครื่องมือเร่งการเติบโต สร้างความได้เปรียบทางการแข่งขัน และผลักดันให้ระบบนิเวศอัตโนมัติของไทยก้าวสู่ระดับสากล