เมื่อเทคโนโลยี AI พัฒนาไปอย่างรวดเร็วจนสัญญาณที่เคยบอกว่า "นี่คือผลงานของเครื่อง" เริ่มเลือนหาย หลายคนอาจรู้สึกเหมือนกำลังยืนอยู่บนเส้นแบ่งที่พร่าเลือน: ข้อความ ภาพ และสื่อสังเคราะห์กลายเป็นธรรมชาติขึ้นจนยากจะบอกความต่างกับงานของมนุษย์ ไม่ว่าจะเป็นบทความข่าว คำอธิบายเชิงเทคนิค หรือภาพประกอบที่มีรายละเอียดสูง—ความก้าวหน้าของโมเดลภาษาและโมเดลมัลติโมดัล ทำให้รูปแบบซ้ำ ๆ ความผิดเพี้ยนเชิงสไตล์ หรือข้อผิดพลาดเชิงตรรกะที่เคยเป็นสัญลักษณ์ของงานเครื่องค่อย ๆ ถูกขจัดออกไป

บทนำนี้จะพาอ่านไปยังประเด็นสำคัญที่บทความจะลงลึกต่อไป: เหตุผลทางเทคนิคที่ทำให้ "สัญญาณ AI" หายไป (เช่น การเพิ่มความซับซ้อนของโมเดล การปรับจูนกับข้อมูลจริง และการใช้ตัวอย่างจากมนุษย์), ข้อจำกัดและความเปราะบางของวิธีตรวจจับที่ใช้อยู่ในปัจจุบัน (จากการวิเคราะห์สถิติไปจนถึงลายน้ำดิจิทัล), ผลกระทบเชิงสังคมที่ขยายวงกว้างตั้งแต่ความน่าเชื่อถือของข้อมูลไปจนถึงการแบ่งงานระหว่างคนกับเครื่อง และแนวทางรับมือทั้งเชิงเทคนิค (เช่น การพัฒนาการพิสูจน์แหล่งที่มาและการฝังเมตาดาต้า) และเชิงนโยบาย (เช่น มาตรฐานการเปิดเผยและกรอบการกำกับดูแล)

เป้าหมายของบทความคือช่วยให้ผู้อ่านเข้าใจว่าเหตุใดเส้นแบ่งระหว่างงานคนกับงานเครื่องจึงเลือน และเสนอชุดเครื่องมือทั้งทางเทคนิค นโยบาย และการปฏิบัติ ที่สามารถนำไปใช้เพื่อลดความเสี่ยงและรักษาไว้ซึ่งความน่าเชื่อถือของข้อมูลในโลกที่ AI ก้าวหน้าอย่างรวดเร็ว

นำเข้า: ปรากฏการณ์ที่พบได้บ่อยขึ้น

นำเข้า: ปรากฏการณ์ที่พบได้บ่อยขึ้น

ในช่วงไม่กี่ปีที่ผ่านมา สังคมเริ่มเห็นปรากฏการณ์ที่เคยถูกมองว่าเป็นเรื่องไกลตัวกลายเป็นเรื่องปกติ: ผลงานที่สร้างโดยปัญญาประดิษฐ์ (AI) มีลักษณะใกล้เคียงงานมนุษย์จนยากจะสังเกตได้ด้วยตาเปล่า ทั้งบทความข่าว การแสดงความคิดเห็นทางสังคมออนไลน์ โฆษณาเชิงสร้างสรรค์ และวิดีโอที่ผ่านการแก้ไขจนคล้ายจริง ตัวอย่างกรณีล่าสุดรวมถึงบทความคอลัมน์หรือโพสต์ในบล็อกที่ต่อมาพบว่าเขียนด้วยโมเดลภาษาใหญ่ และวิดีโอ deepfake ของบุคคลสาธารณะที่ผู้ชมจำนวนมากแทบไม่สามารถแยกความแตกต่างได้เมื่อเปรียบเทียบกับสื่อที่ผลิตโดยมนุษย์

ปรากฏการณ์นี้สำคัญต่อภาคธุรกิจและสังคม เพราะเมื่อสัญญาณที่เคยบ่งชี้ว่าเป็นงานของ AI (เช่น ความผิดพลาดทางภาษา รูปแบบการโต้ตอบที่จำกัด หรือข้อผิดพลาดเชิงตรรกะ) ค่อยๆ หายไป ความเสี่ยงด้านความเชื่อมั่น ข้อมูลเท็จ และการบิดเบือนข้อมูลจะทวีความรุนแรงขึ้น องค์กรที่พึ่งพาการตัดสินใจจากข้อมูลดิจิทัลจึงเผชิญความท้าทายใหม่ในการตรวจสอบแหล่งที่มาและความน่าเชื่อถือของเนื้อหา

สถิติด้านการเติบโตของโมเดลภาษาและเทคโนโลยีเชิงสร้างสรรค์ ช่วยอธิบายว่าทำไมความสามารถในการเลียนแบบมนุษย์จึงพัฒนาอย่างรวดเร็ว—ภายในทศวรรษที่ผ่านมา ขนาดโมเดล (จำนวนพารามิเตอร์) เพิ่มจากหลักล้านสู่หลักร้อยพันล้าน ตัวอย่างที่ชัดเจนคือ BERT (ประมาณ 110 ล้านพารามิเตอร์) ในปี 2018, GPT-2 (1.5 พันล้าน) ในปี 2019, GPT-3 (ประมาณ 175 พันล้าน) ในปี 2020 และมีการเปิดตัวโมเดลขนาดหลายร้อยพันล้านจนถึงหลายแสนล้านพารามิเตอร์ในช่วงถัดมา การเติบโตของพลังประมวลผลและข้อมูลฝึกสอนประกอบกับการเข้าถึงเทคโนโลยีจากผู้พัฒนาและชุมชนโอเพนซอร์ส ทำให้โมเดลสามารถเรียนรู้รูปแบบภาษาและสไตล์การสื่อสารได้ละเอียดขึ้น

- ขนาดโมเดล: การเพิ่มจำนวนพารามิเตอร์อย่างรวดเร็วช่วยให้โมเดลจับความละเอียดของภาษาและบริบทได้ดีขึ้น ส่งผลให้ข้อผิดพลาดเชิงรูปแบบที่เคยเป็นสัญญาณบ่งชี้ของงาน AI ค่อย ๆ ลดลง

- อัตราการนำไปใช้ (adoption): งานวิจัยและรายงานอุตสาหกรรมชี้ให้เห็นว่าองค์กรจำนวนมากเริ่มนำเครื่องมือต่าง ๆ ที่ใช้ AI เข้ามาใช้ในกระบวนการธุรกิจ ไม่ว่าจะเป็นการสร้างเนื้อหา การวิเคราะห์ข้อมูล หรือระบบตอบคำถามอัตโนมัติ ซึ่งเร่งการแพร่หลายของเนื้อหาที่อาจถูกสร้างโดย AI

- deepfake และมัลติมีเดียเชิงปลอม: เทคโนโลยีการสังเคราะห์เสียงและวิดีโอพัฒนาไปอย่างรวดเร็ว ทำให้ภาพหรือเสียงปลอมที่เคยดูหลอกตากลายเป็นสิ่งที่ผู้ชมทั่วไปอาจยอมรับได้หากขาดการตรวจสอบเชิงเทคนิค

ในทางสังคม ผลสำรวจความเชื่อมั่นของประชาชนต่อเนื้อหาดิจิทัลแสดงสัญญาณแห่งความไม่แน่นอน—งานสำรวจจากหลายสถาบันในช่วงหลังแสดงให้เห็นว่า ผู้ใช้งานจำนวนไม่น้อยรู้สึกว่ามีความยากลำบากในการแยกแยะเนื้อหาเทียมจากเนื้อหาจริง โดยบางการสำรวจพบอัตราการไม่แน่ใจหรือความไม่เชื่อมั่นที่สูง (ตัวอย่างเช่นช่วง 40–60% ในกลุ่มตัวอย่างบางงานวิจัย) ซึ่งสะท้อนถึงความเสี่ยงต่อความน่าเชื่อถือของสื่อสารมวลชนและการสื่อสารทางธุรกิจ

สรุปคือปรากฏการณ์นี้ไม่ได้เป็นเพียงความก้าวหน้าทางเทคนิคเท่านั้น แต่ยังมีนัยสำคัญต่อการจัดการความเสี่ยงขององค์กรและการกำกับดูแลสื่อสาร—เมื่อสัญญาณที่เคยบ่งบอกว่า "นี่คือ AI" ค่อย ๆ เลือนหาย การตั้งมาตรฐานการตรวจสอบ การใช้เครื่องมือพิสูจน์แหล่งที่มา และการยกระดับความตระหนักรู้ของผู้บริโภคกลายเป็นเรื่องจำเป็นสำหรับภาคธุรกิจและผู้กำหนดนโยบาย

สัญญาณเก่า: สัญญาณที่เคยบอกว่า 'นี่คือ AI' มีอะไรบ้าง

สัญญาณเก่า: สัญญาณที่เคยบอกว่า 'นี่คือ AI' มีอะไรบ้าง

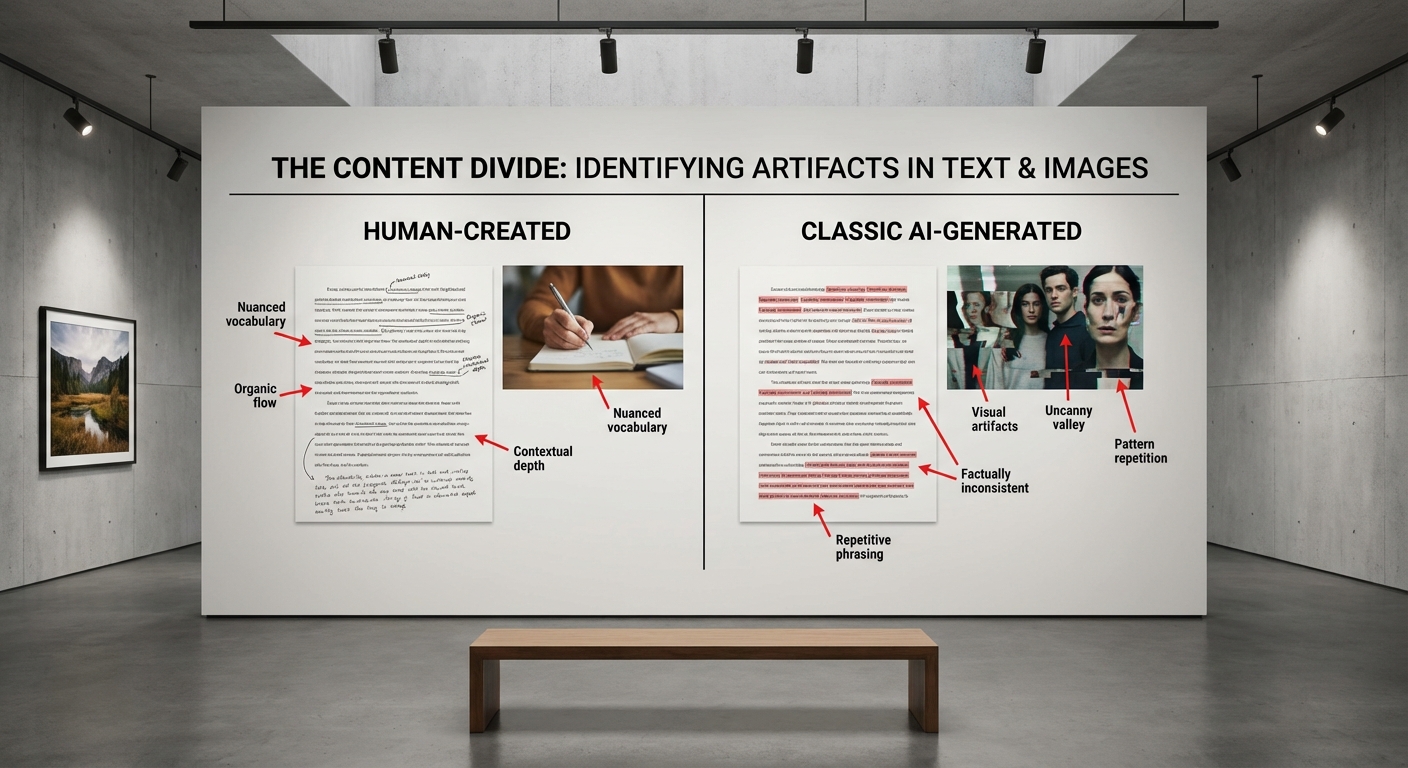

ในช่วงก่อนหน้าที่โมเดลปัญญาประดิษฐ์จะมีความสามารถสูง สัญญาณที่นักวิจัย นักข่าว และผู้ตรวจสอบใช้ตรวจแยกงานที่สร้างโดย AI ออกจากงานของมนุษย์มีลักษณะชัดเจน โดยสามารถแบ่งเป็นกลุ่มหลักๆ ได้แก่ ลักษณะภาษาที่เป็นไปในเชิงสถิติ, ความผิดปกติของภาพ และ metadata/ลายนิ้วดิจิทัล การเข้าใจสัญญาณเหล่านี้ช่วยให้การตรวจสอบเชิงเทคนิคและเชิงบริบทมีความแม่นยำมากขึ้น แม้ปัจจุบันสัญญาณเหล่านี้กำลังถูกทำให้เบาบางลงด้วยเทคโนโลยีที่พัฒนาเร็วขึ้น

ตัวอย่าง: ลักษณะภาษาที่เป็นไปในเชิงสถิติ

งานที่ผลิตโดยโมเดลเก่ามักมีลักษณะเชิงสถิติที่โดดเด่น เช่น การซ้ำคำหรือวลีกันบ่อย (repetition), การเชื่อมต่อบริบทที่ขาดช่วง (context discontinuity) หรือการใช้โครงสร้างประโยคที่ผิดธรรมชาติ นักวิเคราะห์ภาษาใช้เกณฑ์เชิงสถิติเพื่อตรวจจับ เช่น perplexity, อัตราการเกิด n-gram ซ้ำ, และการวัด burstiness ของคำ ในเชิงปฏิบัติ เครื่องมือตรวจจับบนชุดข้อมูลมาตรฐานเคยรายงานอัตราความถูกต้องอยู่ในช่วงประมาณ 70–90% สำหรับโมเดลรุ่นเก่า แต่ความแม่นยำนี้ลดลงเมื่อโมเดลใหม่สามารถเลียนแบบ distribution ของมนุษย์ได้ดีขึ้น

- สัญญาณเชิงสถิติที่มักพบ: ซ้ำคำเดิมในย่อหน้าที่ยาว, การเปลี่ยนหัวข้ออย่างฉับพลันโดยไม่มีสัญญาณเชื่อมโยง, การเลือกคำที่ไม่สอดคล้องกับบริบทเช่นคำเฉพาะทางที่ผิดที่

- วิธีการใช้งานจริง: ใช้เครื่องมือวัด perplexity และ n-gram analyzer เปรียบเทียบกับ baseline ของงานมนุษย์ หรือใช้โมเดลตรวจจับเฉพาะ (classifier) เพื่อคำนวณความน่าจะเป็นว่าเนื้อหาเป็นของ AI

ตัวอย่าง: ความผิดปกติในภาพ

ภาพที่สร้างโดย GAN หรือ diffusion models รุ่นก่อนมักแสดงความผิดพลาดเชิงโครงสร้างหรือรายละเอียดเล็ก ๆ ที่มนุษย์มองเห็นได้ เช่น เงาที่ไม่สอดคล้องกับทิศทางแสง, นิ้วมือที่เชื่อมติดผิดปกติ, ข้อต่อบริเวณใบหน้าไม่สมมาตร หรือวัตถุขอบไม่คมชัดในบางส่วน การสังเกตด้วยสายตาเป็นก้าวแรก แต่การตรวจสอบเชิงเทคนิคมักรวมถึงการวิเคราะห์โดเมนความถี่, การทำ Error Level Analysis (ELA), และการเปรียบเทียบกับฐานข้อมูลภาพต้นฉบับ

- สัญญาณภาพที่มักพบ: เงาที่หายไปหรือผิดตำแหน่ง, นิ้วมือจำนวนผิดปกติ, ข้อความในภาพที่อ่านไม่ได้หรือผิดไวยากรณ์, พื้นผิวที่มีรูปแบบซ้ำอย่างผิดธรรมชาติ

- วิธีการใช้งานจริง: ใช้เครื่องมือ forensic เช่น ELA, frequency analysis, การทำ residual analysis เพื่อตรวจหา pattern ของการ upsampling หรือ artefact ของโมเดล และใช้การเปรียบเทียบกับฐานข้อมูลภาพจริงผ่าน reverse image search หรือ perceptual hashing

ตัวอย่าง: การใช้ metadata, timestamps, และ digital fingerprints ในการตรวจสอบ

อีกหนึ่งชั้นสำคัญของการตรวจสอบคือข้อมูลประกอบ (metadata) ที่ฝังมาในไฟล์ เช่น EXIF ในภาพ ซึ่งบอกข้อมูลกล้อง รุ่นซอฟต์แวร์ที่ใช้แก้ไข ตำแหน่งทางภูมิศาสตร์ และ timestamp สำหรับไฟล์ข้อความหรือเอกสาร อาจมี header ของระบบสร้างหรือข้อมูลเวอร์ชันซอฟต์แวร์ ข้อมูลเหล่านี้มักใช้เพื่อประเมินความน่าเชื่อถือและร่องรอยของการปรับแก้

- สัญญาณ metadata ที่มักพบ: EXIF ที่ระบุซอฟต์แวร์แก้ไขภาพเช่นชื่อ editor, timestamps ที่ไม่สอดคล้องกับแหล่งที่มาที่อ้าง, หรือการหายไปของ metadata หลังการบันทึกซ้ำ

- วิธีการใช้งานจริง: ตรวจสอบ EXIF ด้วยเครื่องมือ forensic, ตรวจสอบความสอดคล้องของ timestamps กับ log ของระบบหรือ server-side records, ใช้ perceptual hash (pHash) เพื่อตรวจความใกล้เคียงของภาพ และใช้ digital signatures หรือมาตรฐาน provenance (เช่น C2PA) เมื่อมีการลงชื่อ/เซ็นต์ดิจิทัล

โดยรวมแล้ว สัญญาณเก่าเหล่านี้เคยเป็นเครื่องมือที่ทรงพลัง แต่ปัจจุบันมีแนวโน้มถูกลดทอนความชัดเจนเมื่อโมเดลสังเคราะห์ข้อมูลสามารถเลียนแบบรูปแบบเชิงสถิติของมนุษย์และปรับแก้ artefact เบื้องต้นได้อย่างรวดเร็ว ดังนั้นการตรวจสอบที่ได้ผลในเชิงธุรกิจในปัจจุบันมักต้องรวมการวิเคราะห์หลายมิติ ทั้งเชิงสถิติ ภาพ และเชิงเมตาดาต้า พร้อมกับการนำเทคโนโลยี provenance และการเซ็นต์ดิจิทัลมาใช้เพื่อยืนยันที่มาของข้อมูลอย่างต่อเนื่อง

ทำไมสัญญาณเหล่านั้นจึงเลือนหาย: เหตุผลทางเทคนิค

ทำไมสัญญาณเหล่านั้นจึงเลือนหาย: เหตุผลทางเทคนิค

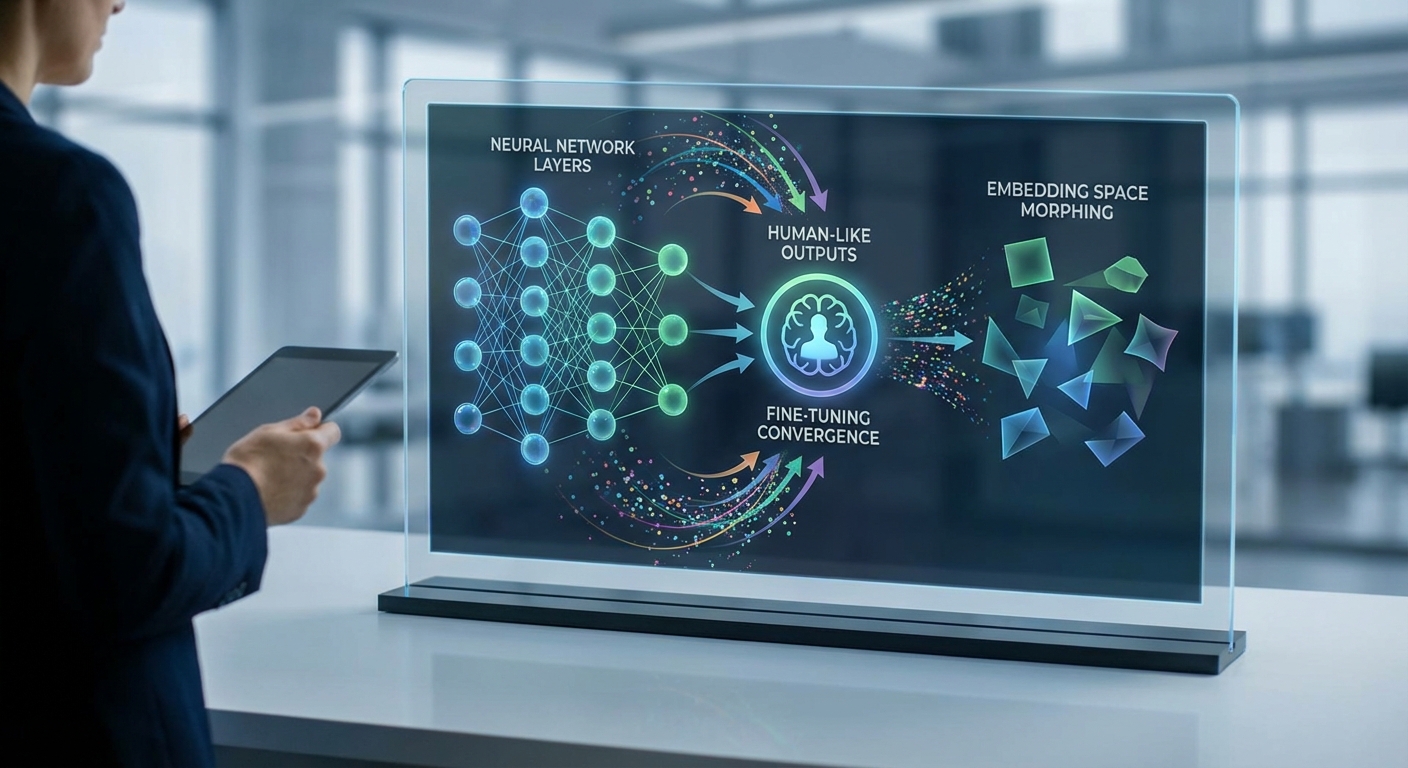

ในเชิงเทคนิค สัญญาณที่เคยบ่งชี้ว่า “นี่คือผลลัพธ์จาก AI” ค่อย ๆ หายไปเพราะการพัฒนาหลายชั้นที่ร่วมกันทำให้ผลลัพธ์มีความใกล้เคียงกับสถิติภาษามนุษย์และลักษณะการสื่อสารของมนุษย์มากขึ้น โดยปัจจัยหลัก ได้แก่ การเพิ่มขีดความสามารถของโมเดล (higher capacity), การฝึกปรับจูนด้วยข้อมูลจากมนุษย์ (human preference data และ RLHF), การปรับปรุงกระบวนการสร้างข้อมูล (data augmentation) และการพัฒนาโมเดลแบบมัลติโมดัลที่ผสานสัญญาณหลายรูปแบบ ทั้งภาพ เสียง และข้อความ ผลลัพธ์คืออาการเด่นชัดเดิม เช่น สำนวนซ้ำๆ โทนแห้งหรือการผิดเพี้ยนของสัญญาณภาพ/เสียง ถูกลดทอนอย่างเห็นได้ชัด

โมเดลที่มีพารามิเตอร์มากขึ้น ไม่ได้เป็นเพียงตัวเลขใหญ่ ๆ แต่หมายถึงความสามารถในการจับสถิติร่วมเชิงซ้อนของภาษาและบริบทได้ดียิ่งขึ้น งานวิจัยด้าน scaling laws ชี้ให้เห็นว่าการเพิ่มพารามิเตอร์พร้อมข้อมูลการฝึกที่เพียงพอจะทำให้ loss ลดลงอย่างสม่ำเสมอ ซึ่งแปลว่าโมเดลสามารถทำนายโทเค็นถัดไปได้แม่นยำกว่าเดิม การเปรียบเทียบเชิงปฏิบัติ เช่น โมเดลขนาดล้านพารามิเตอร์เปรียบเทียบกับพันล้านหรือหมื่นล้านแสดงให้เห็นว่ารูปแบบการใช้คำ วลีเชื่อม ความต่อเนื่องเชิงบริบท และการเลียนแบบสไตล์มีความเป็นธรรมชาติมากขึ้น ทำให้สัญญาณเช่น "ซ้ำคำแบบหุ่นยนต์" หรือ "โครงประโยคไม่ต่อเนื่อง" ถูกกลบหายไป

การฝึกด้วยข้อมูลจากมนุษย์ และ RLHF (Reinforcement Learning from Human Feedback) เป็นปัจจัยสำคัญที่เปลี่ยนพฤติกรรมการตอบของโมเดลจากความถูกต้องตามสถิติไปสู่ความพึงพอใจของผู้ใช้จริง ขั้นตอนทั่วไปคือสร้างโมเดลรางวัล (reward model) โดยใช้การจัดลำดับหรือการให้คะแนนจากมนุษย์ แล้วใช้วิธีเช่น PPO (Proximal Policy Optimization) ในการอัปเดตโมเดลผลลัพธ์ ผลลัพธ์คือการเลือกสไตล์โทนภาษาที่คนชอบมากขึ้น ตอบคำถามด้วยความกระชับหรือเป็นมิตรขึ้น และลดความโน้มเอียงไปยังการตอบที่เป็นประโยคแบบ "สคริปต์" ตัวอย่างเชิงตัวเลขจากงานอุตสาหกรรมหลายงานชี้ว่าโมเดลที่ผ่าน RLHF มักถูกมนุษย์จัดว่าเป็นคำตอบที่เป็นประโยชน์และเป็นธรรมชาติมากกว่าเวอร์ชันก่อนหน้าอย่างเห็นได้ชัด

เทคนิคการสังเคราะห์และการปรับกระบวนการ sampling ก็มีบทบาทสำคัญเช่นกัน ตัวอย่างเช่นการปรับพารามิเตอร์ sampling อย่าง temperature จะควบคุมความสุ่มของคำตอบ—temperature ต่ำจะให้คำตอบแน่นอนและสม่ำเสมอ ขณะที่ temperature สูงจะให้ความหลากหลาย แต่อาจดูแปลก การใช้วิธี sampling ที่ดี เช่น top-k, top-p (nucleus) และการปรับสมดุลระหว่างความแม่นยำกับความหลากหลาย ช่วยให้ output ดูเป็นธรรมชาติมากขึ้น นอกจากนี้เทคนิค decoding อย่าง beam search เมื่อปรับใช้อย่างระมัดระวังสามารถรักษาความสอดคล้องของข้อความในเชิงโครงสร้าง ทำให้ไม่เกิดข้อผิดพลาดเชิงวากยสัมพันธ์ที่เคยเป็นสัญญาณบ่งชี้ว่าเกิดจากโมเดล

การปรับปรุงด้านภาพและเสียง รวมถึงโมเดลมัลติโมดัล ทำให้สัญญาณที่เคยเป็นเอกลักษณ์ของคอนเทนต์ที่สร้างโดยเครื่องลดน้อยลงอย่างรวดเร็ว ในด้านภาพ เทคนิค diffusion models และการใช้ guidance เช่น classifier-free guidance, การทำ super-resolution, และการฝึกเครือข่ายขึ้นความละเอียด (upscaling) ช่วยลด artifact แบบเดิม ๆ (เช่น ขอบหยัก รูปทรงผิดเพี้ยน) ในด้านเสียง การใช้ neural vocoder สมัยใหม่ (เช่น HiFi-GAN, WaveNet derivatives) ร่วมกับการเรียนรู้แบบ end-to-end ช่วยลดเสียงกระพือหรือความไม่ต่อเนื่อง ทำให้เสียงที่สร้างขึ้นมีโทน น้ำเสียง และไดนามิกใกล้เคียงมนุษย์มากขึ้น โมเดลมัลติโมดัลที่ผสาน embeddings ของภาพ เสียง และข้อความ ช่วยให้การตีความบริบทดีขึ้น ตัวอย่างเช่นการนำ embedding ข้ามมอดอลมาต่อกัน (cross-modal embeddings) ทำให้คำอธิบายภาพสอดคล้องกับลักษณะภาพในรายละเอียดมากขึ้น

เพื่อสรุป ทั้งการเพิ่มขนาดโมเดล การใช้ข้อมูลและคำติชมจากมนุษย์ เทคนิค sampling/decoding ที่ละเอียดขึ้น การขยายข้อมูลและการฝึกด้วยข้อมูลสังเคราะห์ รวมถึงความก้าวหน้าทางด้านการประมวลผลภาพและเสียง ทำให้สิ่งที่เคยเป็น “สัญญาณบ่งชี้ AI” ค่อย ๆ เลือนหายไป ผู้ประกอบการและผู้บริหารควรตระหนักว่าเทคโนโลยีในปัจจุบันไม่ได้เพียงสร้างผลลัพธ์ที่ใช้งานได้เท่านั้น แต่ยังสามารถเลียนแบบเส้นทางการสื่อสารและลักษณะเชิงความรู้สึกของมนุษย์ได้ดีขึ้น จึงต้องมีมาตรการทางเทคนิคและนโยบายการตรวจสอบเพื่อประเมินความเป็นต้นฉบับและความเหมาะสมของเนื้อหาอย่างรอบคอบ

การตรวจจับที่สั่นคลอน: Watermarking, Forensics และ Arms Race

การตรวจจับที่สั่นคลอน: Watermarking, Forensics และ Arms Race

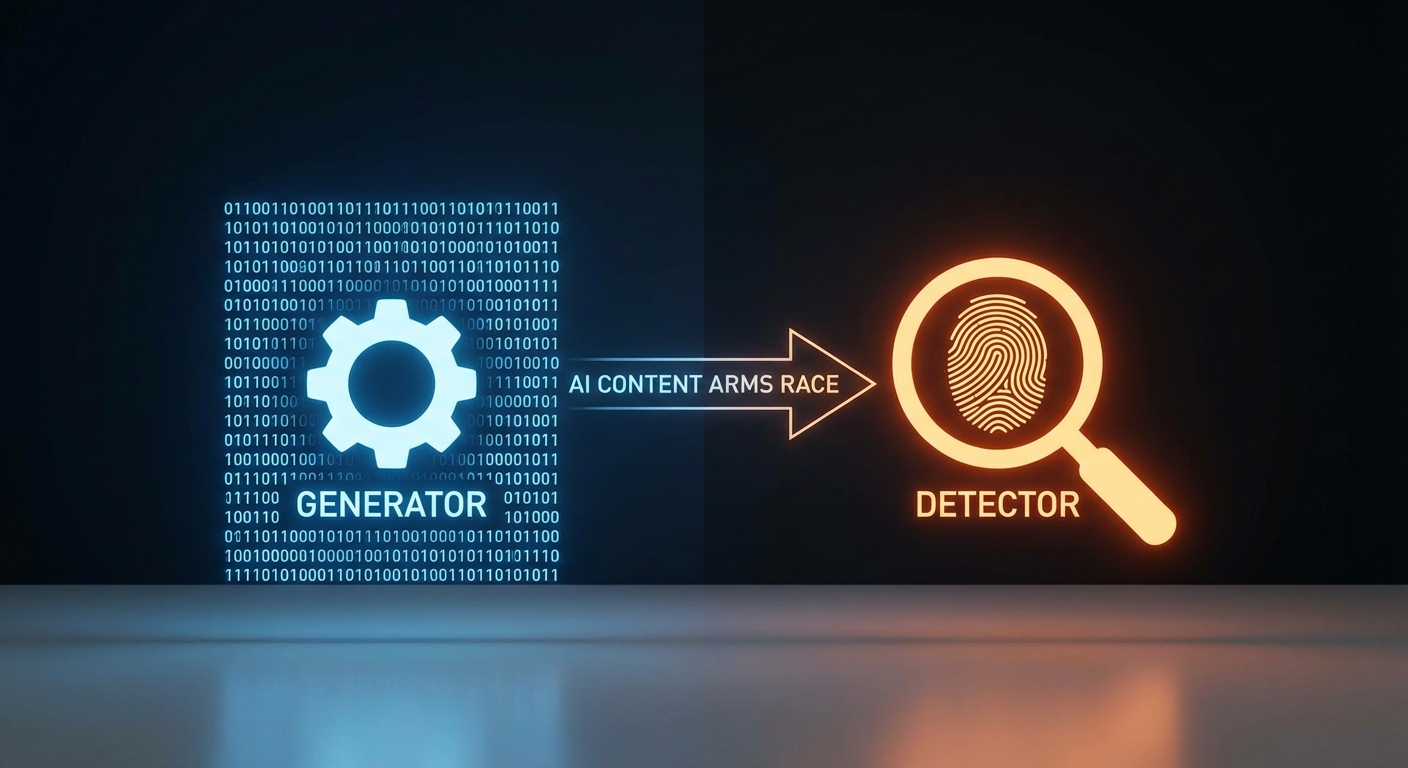

เมื่อเทคโนโลยีการสร้างเนื้อหาโดย AI ก้าวหน้าอย่างรวดเร็ว การพึ่งพาเครื่องมือสำหรับการตรวจจับ — ไม่ว่าจะเป็น watermarking ที่ฝังสัญญาณลงในผลลัพธ์ หรือเทคนิค forensic ที่วิเคราะห์ลักษณะเชิงสถิติของข้อความและภาพ — กำลังเผชิญความท้าทายอย่างหนัก หลักการพื้นฐานของ watermarking คือการปรับกระบวนการสุ่มเลือกคำหรือพิกัดพิกเซลให้ออกมาในรูปแบบที่มีรูปแบบซ้ำหรือความเบี่ยงเบนน้อยซึ่งสามารถตรวจจับได้โดยผู้ถือคีย์ แต่ข้อจำกัดเชิงปฏิบัติจะเกิดขึ้นเมื่อผู้ประสงค์ร้ายพยายามลบหรือเบี่ยงเบนสัญญาณเหล่านี้ด้วยวิธีการต่าง ๆ เช่น การ paraphrase, back-translation, การบีบอัดข้อมูล, หรือการนำผลลัพธ์ไปผ่านโมเดลใหม่ (re-generation)

งานวิจัยหลายชิ้นชี้ให้เห็นว่าประสิทธิภาพของตัวตรวจจับสามารถลดลงอย่างมีนัยสำคัญเมื่อโมเดลถูกปรับแต่ง (fine-tuned) หรือเมื่อข้อความถูกเปลี่ยนรูปแบบ ตัวอย่างเช่น การทดสอบตัวตรวจจับที่ใช้ลักษณะทางสถิติเช่น perplexity และ token-distribution รายงานความแม่นยำสูง (บางงานรายงานค่า accuracy หรือ AUC ใกล้ 0.9) สำหรับผลลัพธ์ของโมเดลดั้งเดิม แต่เมื่อเพิ่มขั้นตอนการ fine-tuning หรือการทำ adversarial paraphrasing ประสิทธิภาพมักลดลงอย่างรวดเร็วในช่วงกว้าง — โดยหลายผลการทดลองวัดการลดลงของ accuracy อยู่ในช่วงประมาณ 20–50 จุดเปอร์เซ็นต์ หรือทำให้ AUC ลดจาก ~0.9 ลงสู่ ~0.55–0.7 ขึ้นอยู่กับกรณีและวิธีการโจมตี

เทคนิค forensic ที่ใช้ปัจจุบันมีหลายหมวด เช่น

- สถิติโครงภาษาและไวยากรณ์: การวิเคราะห์ perplexity, n-gram distribution และความเบี่ยงเบนของไวยากรณ์

- ลักษณะเชิงสไตล์และ stylometry: รูปแบบการใช้คำ วลี และโครงสร้างประโยคที่อาจต่างจากมนุษย์

- watermarking แบบฝังลับ: การปรับการสุ่มตัวอย่างให้เกิด pattern ที่ตรวจได้เมื่อใช้คีย์

- การวิเคราะห์เชิงสัญญาณ (สำหรับภาพ/เสียง): เช่น ความถี่เชิงเค้าโครง (spectral) หรือการกระจายพิกเซลที่ผิดปกติ

อย่างไรก็ดี เทคนิคเหล่านี้มีข้อจำกัดร่วมกัน: เมื่อเกิดการเปลี่ยนแปลงโดเมน (domain shift) หรือโมเดลถูก fine-tuned บนข้อมูลที่ใกล้เคียงกับมนุษย์ ทรัพยากรเพื่อเทรนตัวตรวจจับให้ทันกับการเปลี่ยนแปลงเหล่านี้มีต้นทุนสูง และมักต้องแลกมาด้วยอัตรา false positive ที่เพิ่มขึ้น — ปัญหาที่สำคัญสำหรับองค์กรที่ต้องรักษาความน่าเชื่อถือของระบบ

นอกจากนี้ยังมีชุดเทคนิคสำหรับการลบร่องรอยที่เกิดขึ้นจริง เช่น

- paraphrasing / rephrasing: ใช้โมเดลอื่นเขียนทับข้อความเดิมเพื่อลบรูปแบบการแจกแจง token

- back-translation: แปลข้อความไปมาระหว่างภาษาหลายรอบเพื่อลบลักษณะเด่น

- adversarial fine-tuning: นำข้อความที่มี watermark มาฝึกร่วมกับตัวแปลงสภาพ (denoiser) เพื่อเรียนรู้การลบสัญญาณ

- compression / format changes: สำหรับภาพและวิดีโอ การบีบอัดหรือปรับโค้ดก่อให้เกิดการสูญเสียที่ทำให้ watermark อ่อนแรง

การทดลองหลายงานพบว่าเทคนิคเหล่านี้สามารถทำให้การตรวจจับกลับมาใกล้กับค่า random-chance ได้ในบางสถานการณ์ — ตัวอย่างเช่น การใช้ paraphrase ร่วมกับ fine-tuning บางกรณีสามารถลดอัตราการตรวจจับลงจนเหลือใกล้ 50% (หรือเท่ากับสุ่ม) สำหรับชุดข้อมูลและตัวตรวจจับบางแบบ

ผลจากข้อเท็จจริงเหล่านี้นำไปสู่รูปแบบการแข่งขันแบบ “arms race” ระหว่างผู้พัฒนาโมเดลและนักวิจัย forensic — ฝ่ายหนึ่งพยายามปรับปรุงความสมจริงและความยืดหยุ่นของโมเดล ในขณะที่อีกฝ่ายพัฒนาวิธีการตรวจจับและ watermarking ที่ทนทานขึ้น แนวโน้มที่เกิดขึ้นคือการเพิ่มจำนวนรอบของการโจมตีและการป้องกัน: watermark ที่รอบแรกอาจทนต่อการบีบอัด แต่พ่ายแพ้ต่อ paraphrasing; การป้องกันรุ่นถัดไปต้องซับซ้อนขึ้นและอาจกระทบต่อคุณภาพหรือความเป็นส่วนตัวของระบบ การลงทุนด้านการวิจัยเพื่อรักษาประสิทธิภาพของตัวตรวจจับจึงสูงขึ้นอย่างต่อเนื่อง ทำให้ธุรกิจและหน่วยงานกำกับดูแลต้องพิจารณาเรื่องการประเมินความเสี่ยงที่ซับซ้อนกว่าเดิมในการตัดสินใจใช้หรืออาศัยเครื่องมือเหล่านี้

สรุปคือ แม้จะมีเทคนิค watermarking และ forensic ที่ก้าวหน้า แต่สภาพแวดล้อมที่มีการปรับตัวอย่างรวดเร็วของผู้โจมตีและการปรับแต่งโมเดลหมายความว่าไม่มีวิธีใดที่สามารถยืนยันผลได้แบบเด็ดขาดในทุกสถานการณ์ สำหรับภาคธุรกิจ การออกแบบนโยบายที่รวมการตรวจสอบเชิงเทคนิคร่วมกับกระบวนการทางองค์กร เช่น การตรวจสอบแหล่งที่มา (provenance) และการกำกับดูแลภายใน จึงเป็นแนวทางที่จำเป็นเพื่อรับมือกับการแข่งขันในสนามตรวจจับ-ต่อต้านนี้

ผลกระทบเชิงสังคมและเชิงนโยบาย

ผลกระทบเชิงสังคมและเชิงนโยบาย

การที่เทคโนโลยีปัญญาประดิษฐ์สามารถสร้างเนื้อหาเสียง ภาพ และวิดีโอที่มีความสมจริงสูงจนผู้ชมแยกไม่ออก ส่งผลโดยตรงต่อ ความน่าเชื่อถือของสื่อและสถาบันสาธารณะ ในระดับกว้าง ผู้บริโภคข้อมูลข่าวสารเริ่มมีความไม่แน่ใจต่อแหล่งที่มาของข่าวสาร ทำให้สถาบันสื่อมวลชน รัฐบาล และองค์กรสาธารณะต้องเผชิญกับโจทย์ใหม่ในการยืนยันความถูกต้องของข้อมูล งานสำรวจหลายฉบับแสดงให้เห็นถึงระดับความกังวลต่อข้อมูลเทียมที่เพิ่มขึ้น — บางการศึกษาให้ค่าประมาณว่าผู้บริโภครายใหญ่ (ร้อยละหลายสิบถึงกว่า 60–70 ในบางสำรวจ) กังวลว่าเทคโนโลยีดังกล่าวจะถูกใช้บิดเบือนข้อมูลทางการเมืองหรือความเห็นสาธารณะ

ในด้านการเมืองและความมั่นคง สื่อเทียมที่มีความสมจริงสูงหรือ deepfake สามารถถูกนำไปใช้เพื่อชิงความได้เปรียบในการเลือกตั้งหรือบ่อนทำลายความเชื่อมั่นของผู้นำ ตัวอย่างเช่นคลิปที่ถูกปรับแต่งในช่วงไทม์ไลน์การเมืองสำคัญ ๆ ทั่วโลกได้แสดงให้เห็นผลกระทบเชิงการรับรู้ที่รวดเร็วและกว้างไกล การแพร่กระจายของ misinformation แบบอัตโนมัติผ่านเครือข่ายสังคมออนไลน์ยังทำให้การแก้ไขข้อมูลล่าช้าและยากขึ้น การตอบโต้ทางเทคนิคเพียงอย่างเดียวจึงไม่เพียงพอ ต้องอาศัยการร่วมมือด้านนโยบายและการมีมาตรการป้องกันทั้งในระดับชาติและระหว่างประเทศ

ประเด็นทางกฎหมายและความรับผิดชอบ (liability) ของผู้สร้างเนื้อหาและแพลตฟอร์มออนไลน์กลายเป็นประเด็นเชิงยุทธศาสตร์ กรอบกฎหมายแบบดั้งเดิมมักออกแบบมาเพื่อจัดการผู้ผลิตเนื้อหาแบบดั้งเดิม แต่เมื่อเนื้อหาเกิดขึ้นจากโมเดล AI หรือถูกเผยแพร่ผ่านแพลตฟอร์มที่ใช้ระบบอัตโนมัติ การระบุผู้รับผิดชอบจึงซับซ้อนมากขึ้น ระบบกฎหมายบางภูมิภาค เช่น สหภาพยุโรป ผ่านกฎหมาย Digital Services Act (DSA) ได้เริ่มกำหนดให้แพลตฟอร์มต้องมีความรับผิดชอบด้านการบริหารความเสี่ยงและความโปร่งใส ซึ่งเป็นทิศทางที่หลายประเทศกำลังพิจารณา ขณะเดียวกันก็กำเนิดคำถามทางกฎหมายใหม่ ๆ เกี่ยวกับการติดตามแหล่งที่มา การพิสูจน์ต้นกำเนิดของเนื้อหา และการลงโทษผู้ใช้เทคโนโลยีเชิงรุกเพื่อชี้นำข้อมูลผิด

เพื่อรองรับสถานการณ์ดังกล่าว จึงมีการเสนอมาตรการเชิงนโยบายที่ควรพิจารณาดำเนินการควบคู่กันดังนี้

- บังคับใช้มาตรการการระบุแหล่งที่มาและการประทับตราดิจิทัล (content provenance และ watermarking) เพื่อให้สามารถตรวจสอบได้ว่าเนื้อหาใดถูกสร้างหรือแก้ไขด้วย AI

- ปรับปรุงกรอบความรับผิดชอบของแพลตฟอร์ม ให้ชัดเจนในเรื่องการจัดการเนื้อหาเทียม รวมถึงกำหนดหน้าที่ในการตรวจจับและรายงานความเสี่ยงต่อสาธารณะ เช่น รายงานความโปร่งใสเทคโนโลยีและนโยบายคัดกรอง

- ส่งเสริมมาตรฐานสากลและความร่วมมือระหว่างประเทศ ในด้านกฎหมาย กรอบเทคนิค และการแบ่งปันเครื่องมือตรวจจับ deepfake เพื่อป้องกันช่องว่างทางกฎระเบียบ

- ลงทุนในการวิจัยและพัฒนาเทคโนโลยีตรวจจับ พร้อมสนับสนุนการฝึกอบรมด้าน media literacy ให้แก่ประชาชนเพื่อลดความเปราะบางต่อการถูกชักนำด้วยข้อมูลเทียม

- สร้างกรอบทางกฎหมายที่ยืดหยุ่น ทั้งการกำหนดความผิดชอบของผู้สร้างโมเดล ผู้ให้บริการโครงสร้างพื้นฐานข้อมูล (infrastructure providers) และการคุ้มครองสิทธิเสรีภาพของผู้ใช้ เพื่อหลีกเลี่ยงการกำกับดูแลที่ก้าวล่วงเกินจำเป็นต่อนวัตกรรม

สำหรับแรงงานในสายครีเอทีฟ ผลกระทบเป็นได้ทั้งโอกาสและภัยคุกคาม ด้านโอกาส AI สามารถเป็นเครื่องมือเพิ่มศักยภาพ ช่วยลดภาระงานเชิงเทคนิค ทำให้ผู้สร้างโฟกัสกับคอนเซปต์เชิงสร้างสรรค์ได้มากขึ้น และเปิดตลาดสำหรับคอนเทนต์แบบปรับเฉพาะบุคคล (personalized content) ตลอดจนสร้างบทบาทงานใหม่ ๆ เช่น ผู้เชี่ยวชาญด้านการออกแบบ prompt, บรรณาธิการ AI, ผู้ตรวจสอบความถูกต้องของเนื้อหา และนักจริยธรรมเทคโนโลยี

ในทางกลับกัน ภัยคุกคามที่ชัดเจนคือการทดแทนงานบางประเภทที่เป็นกิจวัตรและสามารถอัตโนมัติได้ เช่น งานแต่งภาพพื้นฐาน การตัดต่อเสียงมาตรฐาน หรือการเขียนเนื้อหาเชิงข้อมูลจำนวนมาก อาจนำไปสู่แรงกดดันด้านค่าจ้างและความไม่มั่นคงของอาชีพ กลไกนโยบายที่เหมาะสมควรรวมถึงการส่งเสริมการพัฒนาทักษะใหม่ การออกแบบหน้าที่แรงงานที่ผสมผสานกับ AI และนโยบายคุ้มครองสังคม (reskilling, upskilling, social safety nets) เพื่อให้การเปลี่ยนผ่านเป็นธรรมและยั่งยืน

โดยสรุป การพัฒนา AI ที่ทำให้ “สัญญาณว่ามันคือ AI” หายไป ยกระดับความท้าทายเชิงสังคมและเชิงนโยบายอย่างมีนัยสำคัญ รัฐบาล ภาคธุรกิจ แพลตฟอร์ม และชุมชนผู้สร้างจำเป็นต้องร่วมวางมาตรการเชิงเทคนิค กฎหมาย และนโยบายแรงงานควบคู่กัน เพื่อรักษาความน่าเชื่อถือของสื่อ ปกป้องกระบวนการประชาธิปไตย และสนับสนุนการปรับตัวของแรงงานในเศรษฐกิจดิจิทัล

การตอบสนองของอุตสาหกรรม: มาตรฐาน เครื่องมือ และนโยบาย

การตอบสนองของอุตสาหกรรม: มาตรฐาน เครื่องมือ และนโยบาย

เมื่อสัญญาณที่เคยบอกว่า "นี่คือ AI" เริ่มพร่ามัว อุตสาหกรรมและหน่วยงานกำกับดูแลต่างเร่งสร้างกรอบการทำงานทั้งทางเทคนิคและนโยบายเพื่อยืนยันความน่าเชื่อถือของเนื้อหา แนวทางที่เด่นชัดได้แก่การกำหนดมาตรฐาน metadata สำหรับ content provenance (ระบุแหล่งที่มาและกระบวนการสร้างเนื้อหา), ระบบการลงทะเบียนและติดตามเนื้อหา (เช่น CRS ในเชิงแนวคิดหรือ Content Registration Service), รวมถึงความร่วมมือระดับองค์กรเพื่อผลักดันการยอมรับมาตรฐานร่วมกัน ตัวอย่างเช่น C2PA (Coalition for Content Provenance and Authenticity) ที่ริเริ่มโดย Adobe, Microsoft และ BBC ได้พัฒนาโครงสร้างข้อมูล metadata และการเซ็นรับรองดิจิทัลเพื่อให้ข้อมูล provenance แนบมากับไฟล์ภาพและวิดีโอผ่านมาตรฐานแบบเปิด

ในระดับเครื่องมือ เราเห็นการพัฒนาตรวจจับแบบ multi-modal (ข้อความ ภาพ เสียง ผสมกัน) และการใช้ระบบตรวจจับแบบ ensemble ที่รวมวิธีการหลากหลายทั้งสถิติ การวิเคราะห์เชิงภาษาศาสตร์ การตรวจสอบเครือข่ายการสร้างภาพ และการตรวจจับลายน้ำดิจิทัล งานวิจัยและโครงการแข่งขั้นเปิด (open benchmark) เช่น Deepfake Detection Challenge (DFDC) และชุดข้อมูล FaceForensics++ ช่วยสร้างมาตรฐานการประเมิน และชุมชนวิจัยก็ใช้ชุดข้อมูลสาธารณะบนแพลตฟอร์มอย่าง Hugging Face เพื่อตั้ง benchmark สำหรับโมเดลตรวจจับมัลติมีเดีย การทดสอบเชิงอิสระชี้ให้เห็นว่าเครื่องมือตรวจจับแบบเดี่ยวมักมีความเปราะบางต่อการเปลี่ยนแปลงของโมเดลหรือการโจมตีเชิงพรางตัว ทำให้แนวทาง ensemble และการทดสอบข้ามโดเมน (cross-domain evaluation) เป็นทิศทางสำคัญ

นโยบายความโปร่งใสและการตรวจสอบภายในของแพลตฟอร์มก็มีพัฒนาการชัดเจน บริษัทชั้นนำและแพลตฟอร์มโซเชียลมีเดียเริ่มบังคับให้มีการเปิดเผยข้อมูลเกี่ยวกับที่มาของเนื้อหา การใช้ model cards และ datasheets เพื่อระบุความสามารถ จุดอ่อน และบริบทการใช้งานของโมเดล รวมถึงการจัดทำรายงานความโปร่งใส (transparency reports) และกระบวนการ audit ภายใน/ภายนอก ตัวอย่างของมาตรการ ได้แก่ การติดป้าย (labeling) กับสื่อที่มีการแก้ไขหรือสร้างด้วย AI, ระบบ human-in-the-loop สำหรับกรณีที่มีความเสี่ยงสูง และการบังคับใช้มาตรการแก้ไขเมื่อพบการละเมิด

นอกจากนี้ หลายองค์กรระดับประเทศและระหว่างประเทศได้ริเริ่มกรอบนโยบายเพื่อควบคุมและส่งเสริมความรับผิดชอบ เช่น NIST ที่พัฒนาแนวทางประเมินความเสี่ยงของ AI (AI RMF), ความพยายามของ ISO/IEC JTC 1/SC 42 ในการกำหนดมาตรฐาน AI ระดับสากล และข้อเสนอด้านกฎหมายอย่าง EU AI Act ที่ผลักดันให้แพลตฟอร์มรับผิดชอบต่อความเสี่ยงของระบบอัตโนมัติ ทุกแนวทางเหล่านี้มุ่งเน้นการผสานเทคนิคทางวิศวกรรม (เช่น provenance metadata, watermarking) เข้ากับนโยบายกำกับดูแลและการตรวจสอบเพื่อเพิ่มความเชื่อมั่นของผู้ใช้

ท้ายสุด การตอบสนองของอุตสาหกรรมไม่ได้มุ่งเพียงการพัฒนาเทคนิคเท่านั้น แต่ยังรวมถึงการสร้างระบบนิเวศที่รองรับความร่วมมือแบบเปิด—จากการกำหนดมาตรฐาน metadata, การพัฒนา benchmark แบบ multi-modal และ ensemble detectors ไปจนถึงนโยบายโปร่งใสและการตรวจสอบภายใน—เพื่อให้การยืนยันความน่าเชื่อถือของเนื้อหาเป็นไปได้อย่างมีประสิทธิภาพในยุคที่ขีดจำกัดระหว่าง "มนุษย์" และ "เครื่องจักร" ทับซ้อนกันมากขึ้น

- มาตรฐานและโครงการสำคัญ: C2PA, Adobe Content Credentials, CRS (แนวคิดการลงทะเบียนเนื้อหา)

- เครื่องมือและ benchmark: Deepfake Detection Challenge (DFDC), FaceForensics++, การใช้ชุดข้อมูลสาธารณะบน Hugging Face สำหรับการประเมิน multi-modal detectors

- นโยบายและกรอบกำกับ: NIST AI RMF, ISO/IEC JTC 1/SC 42, EU AI Act, รายงานความโปร่งใสและ audit ภายในของแพลตฟอร์ม

- ตัวอย่างองค์กรที่ประกาศแนวทางจริง: Adobe (Content Credentials/C2PA), Microsoft (ร่วมใน C2PA และนโยบายความรับผิดชอบ AI), BBC (การใช้งาน provenance), Meta (DFDC), OpenAI (งานวิจัย watermarking และแนวทางความโปร่งใส)

แนวทางปฏิบัติสำหรับองค์กรและผู้ใช้งานทั่วไป

แนวทางปฏิบัติสำหรับองค์กรและผู้ใช้งานทั่วไป

เมื่อเทคโนโลยีปัญญาประดิษฐ์ (AI) สามารถสร้างข้อความ รูปภาพ และวิดีโอที่ใกล้เคียงความจริงได้มากขึ้น องค์กรต้องปรับแนวทางการปฏิบัติทั้งทางเทคนิคและเชิงนโยบายเพื่อปกป้องความน่าเชื่อถือของข้อมูลและลดความเสี่ยงจากการเผยแพร่ข้อมูลบิดเบี้ยว เริ่มจากการยืนยันแหล่งที่มาและ metadata ก่อนเผยแพร่เนื้อหาเชิงสำคัญ รวมถึงจัดทำกระบวนการตรวจสอบแบบหลายขั้นตอน (multi-tier verification) ที่ผสานการตรวจสอบอัตโนมัติและการตรวจสอบโดยมนุษย์

การตรวจสอบแหล่งที่มาและ metadata ควรเป็นขั้นแรกสำหรับเนื้อหาที่มีผลกระทบสูง เช่น ข่าวสารทางการเงิน ประกาศบริษัท หรือข้อมูลสุขภาพ โดยแนะนำให้รวมการตรวจสอบต่อไปนี้เข้าไว้ใน workflow ก่อนการเผยแพร่:

- ตรวจสอบ metadata ของไฟล์ (EXIF, timestamps, origin headers) และบันทึกค่า hash ของไฟล์เพื่อตรวจสอบความสมบูรณ์ของเนื้อหา

- ยืนยัน chain of custody และแหล่งที่มาของเนื้อหาจากผู้ส่งหรือผู้สร้างต้นทาง (เช่น ตรวจสอบบัญชีผู้ใช้ สัญญาณการยืนยันสองปัจจัย)

- ใช้มาตรฐานการพิสูจน์แหล่งที่มา เช่น C2PA หรือการลงลายมือชื่อดิจิทัล (digital signatures) เพื่อให้ผู้รับสามารถยืนยันความถูกต้องได้ในภายหลัง

- กำหนดระดับความเสี่ยงและนโยบายการเผยแพร่ที่แตกต่างกันตามประเภทของเนื้อหา: เนื้อหาที่เสี่ยงสูงต้องผ่านการอนุมัติอย่างน้อยสองชั้น

การนำเครื่องมือ forensic และ multi-tool ตรวจจับมาใช้ใน workflow เป็นแนวปฏิบัติที่สำคัญ เนื่องจากเครื่องมือตรวจจับแบบเดี่ยวมักให้ผลลวงได้เมื่อ AI พัฒนาเร็วขึ้น ควรรวมเครื่องมือหลายตัวเพื่อตรวจสอบองค์ประกอบต่าง ๆ ของเนื้อหา เช่น:

- เครื่องมือตรวจสอบภาพ: ตรวจ EXIF, วิเคราะห์ความผิดปกติของพิกเซล (noise patterns), ตรวจหาการผสานของเลเยอร์ (forensic artefacts)

- เครื่องมือตรวจสอบวิดีโอ/เสียง: ตรวจ sync ของแทร็กเสียง-ภาพ, วิเคราะห์เฟรมและสัญญาณความผิดปกติทางคลื่นความถี่

- เครื่องมือตรวจจับข้อความที่สร้างโดยโมเดล: เปรียบเทียบลายมือเขียน (stylometry), ตรวจสอบความสอดคล้องของข้อเท็จจริงกับฐานข้อมูลภายใน

- การใช้ระบบรวมผล (ensemble) ที่ให้คะแนนความเสี่ยงจากหลายแหล่ง แล้วให้ผู้เชี่ยวชาญตัดสินจากคะแนนรวม

ฝึกอบรมพนักงานและผู้ใช้งานในด้าน media literacy และ response plan เป็นกุญแจสำคัญในการลดความเสี่ยงระยะยาว องค์กรควรจัดโปรแกรมฝึกอบรมอย่างสม่ำเสมอและทดสอบความพร้อมด้วยรูปแบบต่าง ๆ ดังนี้:

- การฝึกอบรมเชิงปฏิบัติ (hands-on) ในการใช้เครื่องมือ forensic และการอ่าน metadata

- การอบรม media literacy สำหรับพนักงานทุกระดับ โดยเน้นการตั้งคำถามกับแหล่งที่มาและการตีความบริบท

- การซ้อมแผนตอบสนองต่อเหตุการณ์ (tabletop exercises) เพื่อประเมินความเร็วและประสิทธิผลของขั้นตอนการตรวจสอบ การแจ้งเตือน และการสื่อสารภายใน/ภายนอก

- กำหนดบทบาทและความรับผิดชอบชัดเจน (who does what) ในกรณีพบเนื้อหาที่น่าสงสัยหรือการโจมตีด้วย AI

Checklist ด้านเทคนิคและนโยบาย (สำหรับใช้ทันที)

- ตรวจสอบ metadata และ hash ของไฟล์ก่อนเผยแพร่

- รันเนื้อหาผ่านชุดเครื่องมือ forensic แบบ multi-tool และบันทึกผลการวิเคราะห์

- หากผลการวิเคราะห์มีความเสี่ยงเกินค่าที่กำหนด ให้ยกเลิกการเผยแพร่ชั่วคราวและส่งต่อให้ทีมผู้เชี่ยวชาญตรวจสอบ

- บันทึกทุกขั้นตอนในระบบ logging ที่ไม่สามารถแก้ไขได้ (immutable logs) เพื่อใช้เป็นหลักฐานกรณีข้อพิพาท

- สื่อสารกับผู้ที่ได้รับผลกระทบและเผยแพร่คำชี้แจงเมื่อแก้ไขหรือถอนเนื้อหา

ข้อเสนอเทคโนโลยีและมาตรการที่ช่วยลดความเสี่ยง

- นำระบบการพิสูจน์แหล่งที่มา (provenance) เช่น C2PA หรือ Content Authenticity Initiative มาใช้ควบคู่กับการลงลายมือชื่อดิจิทัล

- ติดตั้ง API ที่เชื่อมต่อกับบริการตรวจจับหลายราย (multi-vendor detection) เพื่อให้ผลการวิเคราะห์ไม่ขึ้นกับผู้ให้บริการเพียงรายเดียว

- ใช้ watermarking ทางดิจิทัลและสัญญาณลับ (fragile & robust watermarks) สำหรับเนื้อหาในองค์กร

- นำระบบ SIEM/EDR มาตรวจจับพฤติกรรมผิดปกติที่อาจชี้ถึงการโจมตีด้วยข้อมูลหรือโมเดล AI

- ออกแบบระบบการเผยแพร่ให้มีการยืนยันหลายขั้นตอน (approval workflows) และการกำหนดสิทธิ์ตามบทบาท (role-based access control)

ท้ายที่สุดแล้ว การป้องกันความเสี่ยงจาก AI ที่สร้างเนื้อหาปลอมต้องอาศัยทั้งเทคโนโลยี นโยบาย และการสร้างวัฒนธรรมองค์กรที่มีความตระหนักรู้ การผสมผสานเครื่องมือทางเทคนิค การฝึกอบรมอย่างต่อเนื่อง และแผนรับมือที่ชัดเจน จะช่วยให้องค์กรสามารถตอบสนองได้รวดเร็วและรักษาความน่าเชื่อถือของข้อมูลในยุคที่สัญญาณบอกว่า "มันคือ AI" เริ่มจางลง

บทสรุป

ความก้าวหน้าของปัญญาประดิษฐ์ในช่วงไม่กี่ปีมานี้ทำให้ "สัญญาณ" ที่เคยบ่งชี้ว่าผลงานเป็นของเครื่อง (เช่น รูปแบบคำผิดปกติ โทนเสียงซ้ำซาก หรือเมตาดาต้าที่ผิดปกติ) เริ่มเลือนรางลง แต่ไม่ได้หมายความว่าการตรวจจับจะหมดหนทาง การวิเคราะห์ทางเทคนิคเชิงลึก เช่น การใช้โมเดลตรวจจับใหม่ การวิเคราะห์เชิงสถิติและไบโอมิทริกซ์เชิงพฤติกรรม รวมทั้งการติดฉลากเชิงสัญญะ (watermarking) ยังคงเป็นเครื่องมือสำคัญ เมื่อผนวกกับนโยบายที่ชัดเจนและการให้ความรู้แก่ประชาชน ผลงานที่สร้างโดย AI ยังคงสามารถระบุและบริหารความเสี่ยงได้ ตัวอย่างเช่น องค์กรสื่อและแพลตฟอร์มดิจิทัลหลายแห่งเริ่มทดลองใช้ระบบพิสูจน์แหล่งที่มาและมาตรฐานการติดฉลากเพื่อรักษาความน่าเชื่อถือของข้อมูล

ในมุมมองอนาคต สังคมต้องเตรียมมาตรการแบบหลายชั้น (multi-layered) ที่ผสานทั้งเชิงเทคนิค นโยบายสาธารณะ และการศึกษาเชิงรุกเพื่อรับมือกับยุคที่มนุษย์และเครื่องจักรสร้างเนื้อหาที่แยกจากกันได้ยากขึ้น หน่วยงานกำกับดูแลและภาคเอกชนควรร่วมพัฒนามาตรฐานการพิสูจน์แหล่งที่มา (provenance standards) ระบบตรวจสอบอัตโนมัติที่มีการทดสอบต่อเนื่อง และกรอบกฎหมายที่ส่งเสริมความโปร่งใส ขณะเดียวกันต้องลงทุนในโครงการให้ความรู้ประชาชนเพื่อเพิ่มความตระหนักและทักษะในการประเมินข้อมูล ความร่วมมือระหว่างประเทศและการเปิดเผยข้อมูลเชิงเทคนิคจะเป็นกุญแจสำคัญในการรักษาความน่าเชื่อถือของระบบข้อมูลในระยะยาว

📰 แหล่งอ้างอิง: BBC