ข่าวดีจากวงการวิจัยไทย: ทีมวิจัยไทยพัฒนาวิธีการ Watermarking เฉพาะสำหรับข้อความที่สร้างโดยโมเดลภาษาใหญ่ (LLM) ซึ่งออกแบบมาเพื่อยืนยันแหล่งที่มาและพิสูจน์ลิขสิทธิ์ของข้อความในบริบทที่เอื้อต่อการใช้เป็นพยานหลักฐานในชั้นศาล เทคนิคนี้ไม่เพียงแค่ฝังสัญญาณประจำต้นทางลงในข้อความเท่านั้น แต่ยังถูกออกแบบให้สามารถตรวจจับและยืนยันร่องรอยต้นทางได้แม้ข้อความจะถูกแก้ไขหรือปรับแต่งในระดับหนึ่ง ซึ่งตอบโจทย์ความต้องการของหน่วยงานสื่อ องค์กร และกระบวนการยุติธรรมที่ต้องการหลักฐานดิจิทัลที่เชื่อถือได้

งานวิจัยดังกล่าวยังนำเสนอกรอบแนวทางการพิสูจน์หลักฐานต่อศาล พร้อมผลทดสอบเบื้องต้นที่ชี้ให้เห็นถึงความทนทานต่อการโจมตีเชิงไวยากรณ์และการแก้ไขข้อความบางส่วน ตัวอย่างการทดสอบแสดงความสามารถในการยืนยันแหล่งที่มาเมื่อมีการเปลี่ยนแปลงโครงสร้างประโยคหรือคำเล็กน้อย การพัฒนาเทคโนโลยีนี้จึงมีศักยภาพสูงในการลดปัญหาการอ้างสิทธิ์เท็จ ปกป้องลิขสิทธิ์ และยกระดับความรับผิดชอบของการสร้างเนื้อหาโดย AI ในสังคมไทยและระดับสากล

บทนำ: ทำไมต้องมี Watermarking สำหรับข้อความจาก LLM

บทนำ: ทำไมต้องมี Watermarking สำหรับข้อความจาก LLM

ในช่วงไม่กี่ปีที่ผ่านมา โมเดลภาษาขนาดใหญ่ (Large Language Models หรือ LLM) ได้เข้ามาเปลี่ยนแปลงภาพรวมของการสื่อสารดิจิทัลอย่างรวดเร็ว ตัวอย่างที่ชัดเจนคือบริการแชตบอทเช่น ChatGPT ที่มีผู้ใช้งานหลักสิบล้านคนและแตะระดับผู้ใช้รายเดือนมากกว่า 100 ล้านคนภายในปี 2023 ซึ่งสะท้อนให้เห็นถึงการยอมรับและการนำไปใช้อย่างกว้างขวางของเทคโนโลยีสร้างภาษานี้ ในมุมมองเชิงธุรกิจ รายงานจากหลายสำนักประเมินว่าตลาดเทคโนโลยี Generative AI จะเติบโตอย่างต่อเนื่องในทศวรรษหน้า ส่งผลให้เครื่องมือที่อาศัย LLM ถูกนำไปใช้ทั้งในงานสื่อสารมวลชน การผลิตเนื้อหา การบริการลูกค้า และระบบอัตโนมัติหลายรูปแบบ

ในบริบทของประเทศไทย การนำ LLM มาใช้ในภาคส่วนต่าง ๆ เริ่มทวีความสำคัญ เช่น ห้องข่าวที่ใช้ LLM ในการสรุปข่าวหรือสร้างร่างบทความ ระบบตอบข้อความอัตโนมัติของภาครัฐและธุรกิจเพื่อบริการประชาชน และเครื่องมือช่วยเขียนที่ถูกใช้ในการตลาดดิจิทัลและการศึกษา การใช้งานที่แพร่หลายเช่นนี้ช่วยเพิ่มประสิทธิภาพและลดต้นทุน แต่ก็ผสมผสานมาด้วยความเสี่ยงใหม่ ๆ ที่ต้องการมาตรการด้านความน่าเชื่อถือและการพิสูจน์ต้นทาง

ความเสี่ยงที่เกิดขึ้น เมื่อข้อความถูกสร้างหรือปรับแก้ด้วย LLM มักเกิดปัญหาเชิงพิสูจน์แหล่งที่มาและความถูกต้องของเนื้อหา ตัวอย่างกรณีความเสี่ยงได้แก่

- ข่าวปลอมและการบิดเบือนข้อเท็จจริง — ข้อความที่สร้างด้วย LLM อาจถูกใช้เผยแพร่ข้อมูลเท็จในวงกว้างภายในเวลาอันสั้น

- การแอบอ้างตัวตนและการฉ้อโกง — ผู้ไม่ประสงค์ดีอาจใช้ข้อความที่ดูเป็นมืออาชีพเพื่อสวมรอยหรือชี้นำการตัดสินใจของผู้อื่น

- ปัญหาลิขสิทธิ์และการละเมิดทรัพย์สินทางปัญญา — ยากที่จะพิสูจน์ว่าเนื้อหานั้นมาจากมนุษย์ ผู้ใช้บริการ หรือโมเดลของผู้ให้บริการรายใด

- ความท้าทายในการรับรองหลักฐานเชิงดิจิทัล — เมื่อเกิดข้อพิพาททางกฎหมาย การแสดงหลักฐานว่าข้อความมาจากแหล่งใดหรือถูกแก้ไขเมื่อใดเป็นเรื่องซับซ้อน

เครื่องมือสำหรับตรวจจับข้อความที่สร้างด้วย AI แม้มีพัฒนาการ แต่ยังเผชิญกับความไม่แน่นอน โดยเฉพาะเมื่อตัวข้อความถูกปรับแต่งหรือผ่านขั้นตอนการแก้ไขหลายชั้น ดังนั้นการมี ระบบ watermarking ที่ฝังสัญญาณเฉพาะเข้าไปในเนื้อหาจึงกลายเป็นกลไกสำคัญ ทางเทคนิคเหล่านี้สามารถฝังข้อมูลเชิงสถิติหรือรหัสลับลงในกระบวนการสร้างข้อความ เพื่อให้สามารถตรวจสอบย้อนกลับ (provenance) ว่าเนื้อหามาจากโมเดลใด เวลาสร้าง และในบางกรณียังสามารถเชื่อมโยงกับสิทธิ์การใช้งานหรือลิขสิทธิ์ของผู้สร้าง

สรุปได้ว่า watermarking สำหรับข้อความจาก LLM ไม่เพียงเป็นเครื่องมือทางเทคนิคเพื่อการตรวจจับ แต่ยังเป็นหลักฐานเชิงวิทยาศาสตร์ที่สามารถสนับสนุนการพิสูจน์แหล่งที่มาในบริบททางกฎหมาย ช่วยรักษาความน่าเชื่อถือของสื่อ ปกป้องสิทธิ์ของผู้สร้าง และส่งเสริมการใช้เทคโนโลยีอย่างรับผิดชอบในสังคมไทย ทั้งนี้ การพัฒนาเทคนิคที่สอดคล้องกับภาษาและบริบทท้องถิ่นเป็นสิ่งจำเป็นเพื่อให้หลักฐานดังกล่าวมีความน่าเชื่อถือเมื่อถูกนำไปใช้ในชั้นศาลหรือกระบวนการยุติธรรม

ภาพรวมเทคโนโลยี: LLM, การสร้างข้อความ และความท้าทายเชิงนิติเวช

ภาพรวมการทำงานของ LLM: Tokenization, Sampling และ Decoding

โมเดลภาษาเชิงลึก (Large Language Models — LLM) สร้างข้อความโดยอาศัยกระบวนการเชิงสถิติที่ประกอบด้วยขั้นตอนสำคัญสามส่วน เริ่มจาก tokenization ซึ่งเป็นการแปลงข้อความเป็นหน่วยย่อย (tokens) เช่น คำ หรือชิ้นส่วนคำ เพื่อให้โมเดลสามารถประมวลผลเป็นลำดับตัวเลขได้ จากนั้นโมเดลจะคำนวณความน่าจะเป็นเชิงเงื่อนไขของ token ถัดไปตามบริบทที่ให้มา และในขั้นตอนการสร้างข้อความจริงจะมีการเลือก token ออกมาด้วยวิธีการที่เรียกว่า sampling/decoding เช่น greedy decoding, beam search, top-k หรือ nucleus (top-p) พร้อมพารามิเตอร์อย่าง temperature เพื่อควบคุมความสุ่มของคำที่เลือก เทคนิคเหล่านี้ร่วมกันกำหนดลักษณะของข้อความที่ได้ เช่น ความหลากหลาย ความสอดคล้อง และความบรรลุวัตถุประสงค์ของการใช้งาน

ทำไมการระบุแหล่งที่มาของข้อความจาก LLM จึงยาก

โดยธรรมชาติ LLM ไม่ได้ฝังข้อมูลผู้สร้าง (author-identifying metadata) ลงในเนื้อหาที่สร้างขึ้น ส่วนใหญ่โมเดลจะส่งออกข้อความในรูปของลำดับ tokens โดยไม่ติดป้ายหรือลายเซ็นที่ชัดเจน จึงทำให้การพิสูจน์แหล่งที่มาทางนิติเวชเป็นเรื่องท้าทาย นอกจากนี้ พฤติกรรมของผู้ใช้งานและการประมวลผลต่อเนื้อหาก็ยิ่งซับซ้อนขึ้น เช่น การ paraphrase (เขียนใหม่โดยใช้ถ้อยคำต่างกัน), rephrasing, truncation (ตัดทอนข้อความ), หรือการ คัดลอกซ้ำ (copy-paste) ซึ่งแต่ละรูปแบบสามารถทำลายหรือเบี่ยงเบนสัญญาณเชิงสถิติที่ระบบตรวจจับอาศัยอยู่ได้

ตัวอย่างความเสี่ยงในบริบทข่าวสารและเอกสารราชการ

ในภาคธุรกิจและภาครัฐ การใช้ LLM เพื่อร่างข่าวประชาสัมพันธ์ บันทึกข้อความ หรือประกาศทางการ อาจนำไปสู่ข้อพิพาทเมื่อเนื้อหาถูกโต้แย้ง ตัวอย่างเชิงสมมติที่มีความเป็นไปได้ ได้แก่:

- เอกสารราชการที่ร่างโดยระบบอัตโนมัติแต่ไม่ได้ระบุแหล่งที่มา ถูกอ้างว่าเป็นคำสั่งหรือคำชี้แจงที่มีผลผูกพันทางกฎหมาย

- ข่าวประชาสัมพันธ์หรือบทความที่มีข้อมูลผิดพลาดหรือหมิ่นประมาทซึ่งไม่มีการเปิดเผยว่าเนื้อหาถูกสร้างหรือแก้ไขโดย AI ส่งผลให้เกิดการฟ้องร้องเรื่องความรับผิดชอบและการพิสูจน์ต้นตอ

- เอกสารเชิงวิชาการหรือรายงานการประมวลผลที่มีการนำข้อความจาก LLM มาปรับแต่งเป็นภาษาใหม่ จนทำให้การตรวจจับการลอกเลียนหรือการละเมิดลิขสิทธิ์เป็นไปได้ยาก

ผลกระทบต่อการออกแบบ watermark และเกณฑ์ที่ต้องพิจารณา

เพื่อให้ watermark สำหรับข้อความจาก LLM สามารถนำไปใช้ในเชิงนิติเวชและชั้นศาลได้ จำเป็นต้องออกแบบให้มีความทนทานต่อการเปลี่ยนแปลงบางประเภท เช่น paraphrase การย่อความ และการสลับโครงสร้างประโยค แต่ยังคงไม่ทำลายประโยชน์ใช้สอยของข้อความหรือสร้างการบิดเบือนความหมาย หลักการสำคัญที่ต้องคำนึง ได้แก่:

- ความสามารถในการตรวจจับ — สัญญาณต้องมีความชัดเจนพอที่จะแยกแยะข้อความที่ถูกสร้างโดยโมเดลจากข้อความมนุษย์ด้วยระดับความเชื่อมั่นที่เหมาะสม

- ความทนทานต่อการเปลี่ยนแปลง — watermark ควรทนต่อการ paraphrase บางรูปแบบ การบีบอัดข้อความ หรือการตัดต่อบางส่วน โดยยังคงสัญญาณพอให้ตรวจพบได้

- ความโปร่งใสและความเป็นไปได้ทางกฎหมาย — วิธีการต้องสามารถอธิบายในเชิงเทคนิคได้ต่อผู้เชี่ยวชาญและศาล รวมถึงไม่ละเมิดสิทธิ์ความเป็นส่วนตัวหรือกฎหมายอื่นๆ

- การรักษาคุณภาพเนื้อหา — การฝัง watermark ต้องไม่ทำลายความเป็นธรรมชาติหรือความน่าเชื่อถือของข้อความ ซึ่งสำคัญต่อการยอมรับในภาคธุรกิจและหน่วยงานรัฐ

โดยสรุป การระบุแหล่งที่มาของข้อความจาก LLM เป็นงานที่ท้าทายทั้งด้านเทคนิคและกฎหมาย เนื่องจากลักษณะการสร้างข้อความที่ไม่ฝังข้อมูลผู้สร้างและความสามารถของมนุษย์หรืออัลกอริธึมในการแก้ไขข้อความได้หลากหลาย การพัฒนาเทคนิค watermark ที่ทนทานต่อการเปลี่ยนแปลงบางประเภทจึงเป็นหัวใจสำคัญที่จะทำให้การพิสูจน์แหล่งที่มาและลิขสิทธิ์มีความน่าเชื่อถือในบริบทของการใช้งานเชิงพาณิชย์และการดำเนินคดี

หลักการและสถาปัตยกรรมของเทคนิค Watermarking ที่ทีมวิจัยพัฒนา

หลักการและสถาปัตยกรรมของเทคนิค Watermarking ที่ทีมวิจัยพัฒนา

ทีมวิจัยได้ออกแบบเทคนิคการฝังสัญญาณ (watermark) สำหรับข้อความที่สร้างโดย Large Language Models (LLMs) โดยยึดแนวคิดการฝังสัญญาณในระดับ token แบบเชิงความน่าจะเป็น (probabilistic token‑level embedding) ควบคู่กับกลไกการยืนยันเชิงคริปโต (cryptographic anchoring) และกระบวนการตรวจจับเชิงสถิติที่ให้ค่า confidence และ p‑value เพื่อใช้เป็นหลักฐานในชั้นศาล ตัวหลักการสำคัญคือการเปลี่ยนการแจกแจงความน่าจะเป็นของ token ขณะการถอดรหัส (decoding) ให้เอียงไปยังกลุ่ม token เฉพาะตาม secret key ของผู้ให้บริการ โดยยังรักษาคุณภาพข้อความให้ใกล้เคียงกับผลลัพธ์เดิม (trade‑off ระหว่าง detectability กับความเป็นธรรมชาติของข้อความ)

เชิงปฏิบัติ เทคนิคของทีมประกอบด้วยองค์ประกอบหลักดังนี้

- Keyed probabilistic token selection: สร้าง pseudo‑random sequence จาก secret key และ nonce เพื่อแบ่งพจนานุกรม token ออกเป็นกลุ่มที่ “ถูกเอียง” (green list) กับกลุ่มปกติ (baseline). ขณะสร้างข้อความ ระบบจะเพิ่มค่าบวก (logit bias) ให้ token ในกลุ่ม green เพื่อเพิ่มโอกาสที่โมเดลจะเลือก token เหล่านั้นในลำดับการถอดรหัส การปรับ bias นี้ถูกควบคุมด้วยพารามิเตอร์ความเข้มข้น (ε) ซึ่งเป็นตัวควบคุม trade‑off — ตัวอย่างเช่น การปรับ ε ในช่วง 0.05–0.20 พบว่าให้ความสามารถในการตรวจจับสูงขึ้นโดยคุณภาพข้อความลดลงเพียงเล็กน้อย

- Probabilistic embedding model: แทนที่จะบังคับให้เกิด pattern แบบ deterministic เทคนิคนี้ใช้การปรับ distribution ทำให้ผลลัพธ์เป็นสัญญาณที่แฝงอยู่ในสถิติของ token บนช่วงข้อความยาว ซึ่งช่วยลดโอกาสถูกตรวจจับโดยผู้โจมตีและรักษา diversity ของภาษา

- Cryptographic anchoring & PKI: สำหรับการยืนยันแหล่งที่มา ทีมจะสร้าง metadata ประกอบด้วย model_id, watermark_key_id, embedding_strength, nonce, seed, generation_time และ hash ของข้อความ จากนั้น signer ของผู้ให้บริการใช้ private key ลงลายมือชื่อ (digital signature) บน metadata และเผยแพร่ public key ผ่าน PKI/Certificate chain เพื่อให้ผู้ตรวจสอบสามารถยืนยันได้ว่า watermark มาจากผู้ให้บริการที่เชื่อถือได้

กระบวนการตรวจจับออกแบบให้เป็นไปตามมาตรฐานเชิงสถิติและเชิงปฏิบัติ เพื่อตอบโจทย์การนำเสนอในศาล ทีมพัฒนาเครื่องมือที่ให้ผลลัพธ์เป็นทั้งค่าความน่าเชื่อถือ (confidence score) และ p‑value ซึ่งคำนวณได้จากการทดสอบสมมติฐาน (statistical hypothesis testing) ดังนี้:

- กำหนดสมมติฐาน H0: ข้อความไม่มี watermark (green token frequency = p0 ตาม baseline) และ H1: ข้อความมี watermark (green token frequency > p0)

- นับจำนวน green tokens (k) ในตัวอย่างความยาว n และคำนวณค่า z‑score โดยใช้การประมาณแบบปกติหรือทำการทดสอบแบบ binomial แบบ exact หาก n เล็ก

- คำนวณ p‑value จาก distribution ที่เหมาะสม (เช่น binomial tail) และแปลงเป็น confidence (เช่น confidence = 1 − p หรือใช้ calibration ผ่าน simulation เพื่อให้ได้ confidence ที่มีความหมายเชิงปฏิบัติ)

ตัวอย่างเชิงตัวเลขจากการทดลองภายในของทีม: เมื่อตั้ง p0 = 0.50 (baseline green token rate) และใช้ embedding strength ที่ทำให้คาดว่า p̂ = 0.65 บนข้อความยาว n = 300 token การคำนวณแบบประมาณปกติให้ค่า z ≈ 5.2 ซึ่งสอดคล้องกับ p‑value < 1e‑7 ทำให้ detection power สูงมาก (พลังการตรวจจับ > 95%) สำหรับข้อความที่มีความยาวตั้งแต่ 200 token ขึ้นไป ในขณะเดียวกันการทดสอบกับชุดข้อความมนุษย์จริง (10,000 ตัวอย่าง) แสดงอัตรา false positive ต่ำกว่า 0.1% ภายใต้การตั้งค่า threshold ที่เข้มงวด (เช่น p < 0.01) การรายงานสำหรับชั้นศาลจึงประกอบด้วยค่า p‑value, confidence, ขนาดตัวอย่าง n, ค่า k ที่สังเกต และ parameter embedding (เช่น ε, key_id) เพื่อให้ผู้เชี่ยวชาญด้านสถิติและกฎหมายตรวจสอบได้

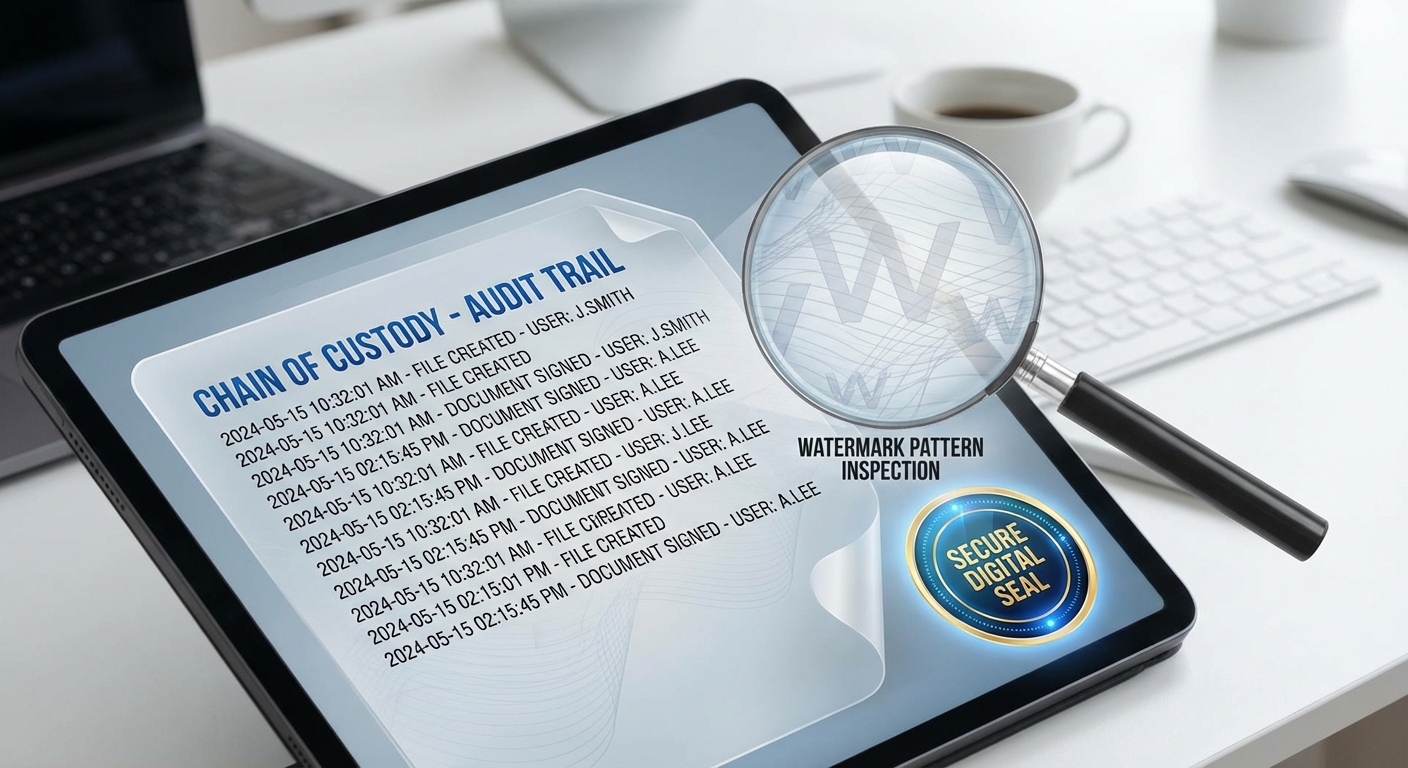

สุดท้ายเพื่อรักษา chain‑of‑custody ทีมออกแบบกระบวนการบันทึก metadata ในรูปแบบ tamper‑evident log โดยมีตัวเลือกสองชั้นคือการใช้ Timestamping Authority (RFC 3161) ร่วมกับการลงลายมือชื่อ หรือการ anchor metadata บางส่วนบน public blockchain เพื่อให้สามารถตรวจสอบลำดับเวลาและความสมบูรณ์ของหลักฐานได้ง่ายและโปร่งใส ตัวอย่างโครงสร้าง metadata ที่ถูกเซ็นประกอบด้วยฟิลด์สำคัญ เช่น:

- model_id, model_version

- watermark_key_id, seed, embedding_strength (ε)

- generation_time (RFC3161 timestamp) และ/or blockchain_anchor

- content_hash (SHA‑256) และ digital_signature ของผู้ให้บริการ

การผสานระหว่างการฝังสัญญาณเชิงความน่าจะเป็น การตรวจจับเชิงสถิติที่ให้ p‑value/ confidence ที่ตีความได้ และการยืนยันด้วยคริปโตและ timestamping ทำให้สถาปัตยกรรมที่ทีมพัฒนามีทั้งความยืดหยุ่นในการรักษาคุณภาพข้อความ ความทนทานต่อการโจมตีเชิงสกัดสัญญาณ และความน่าเชื่อถือเชิงกฎหมายเมื่อถูกนำเสนอในศาล

การทดลองและผลการประเมิน: ความแม่นยำ ความทนทาน และอัตรา false positive

การตั้งค่าการทดลองและชุดข้อมูล

ทีมวิจัยใช้ชุดข้อมูลทดสอบขนาดรวม 12,000 ตัวอย่าง แบ่งเป็นข้อความที่สร้างจาก LLM พร้อมใส่ watermark จำนวน 8,000 ตัวอย่าง และข้อความที่สร้างโดยมนุษย์หรือไม่มี watermark จำนวน 4,000 ตัวอย่าง ชุดข้อมูลครอบคลุมประเภทเนื้อหาหลายรูปแบบ ได้แก่ ข่าวสาร บทความเชิงวิชาการ และโพสต์บล็อก การทดลองจำลองการดัดแปลงข้อความที่น่าพบในโลกจริง ได้แก่ paraphrase แบบเบาและรุนแรง (รวมถึง back-translation), การย่อความเชิงนามธรรม, การแปลภาษาแบบ round-trip และการใส่เสียงรบกวนเชิงตัวอักษร (token dropout 5%) โดยใช้เมตริกหลักคือ precision, recall และอัตรา false positive rate (FPR) เพื่อประเมินประสิทธิภาพเชิงปฏิบัติการ

ผลการประเมินตามสภาวะต่าง ๆ

ผลการทดสอบเบื้องต้นแสดงให้เห็นว่าเทคนิค watermarking ของทีมมี precision สูงเมื่อทดสอบกับข้อความดั้งเดิม ของ LLM โดยบนข้อความต้นฉบับระบบให้ค่า precision อยู่ที่ประมาณ 96.5% กับ recall ที่ 94.2% และ FPR เพียง 0.8% ผลการทดลองภายใต้สภาวะแตกต่างกันมีค่าเฉพาะดังนี้:

- ข้อความดั้งเดิม (Original): precision 96.5%, recall 94.2%, FPR 0.8%

- Paraphrase แบบเบา: precision 92.7%, recall 88.1%, FPR 1.5%

- Paraphrase แบบรุนแรง (รวม back-translation): precision 88.3%, recall 75.0%, FPR 2.5%

- การย่อความเชิงนามธรรม (Summarization): precision 91.0%, recall 82.3%, FPR 1.2%

- การแปลภาษา (round-trip translation): precision 89.4%, recall 79.1%, FPR 1.8%

- Token dropout 5%: precision 94.8%, recall 90.5%, FPR 1.0%

จากผลข้างต้นจะเห็นได้ว่า ความทนทานลดลงเมื่อข้อความผ่านการ paraphrase แบบรุนแรง ซึ่งกระทบต่อ recall มากที่สุด อย่างไรก็ตาม แม้ในสภาวะที่มีการดัดแปลงหนัก เทคนิคของทีมยังคงทำงานได้เหนือ baseline หลายรุ่น โดยเฉพาะเรื่อง precision และอัตรา false positive ที่ต่ำกว่าอย่างมีนัยสำคัญ

การเปรียบเทียบกับแนวทาง watermarking อื่น ๆ

ทีมวิจัยเปรียบเทียบวิธีการของตนกับแนวทางยอดนิยมสองชุด ได้แก่ token-frequency watermarking (Baseline A) และ statistical-marker watermarking (Baseline B) ผลลัพธ์สรุปได้ดังนี้:

- Baseline A (token-frequency): บนข้อความดั้งเดิม precision 85.1%, recall 71.3%, FPR 3.8% — ประสิทธิภาพลดลงชัดเมื่อเจอ paraphrase

- Baseline B (statistical-marker): บนข้อความดั้งเดิม precision 88.4%, recall 74.9%, FPR 2.9% — ดีกว่า Baseline A แต่ยังตามหลังวิธีของทีมทั้งใน precision และ FPR

โดยสรุป เทคนิคของทีมมีความได้เปรียบโดยเฉพาะในมิติ precision สูงและ FPR ต่ำ ซึ่งเป็นปัจจัยสำคัญเมื่อนำไปใช้เชิงกฎหมายหรือในชั้นศาลที่การตัดสินต้องการความเชื่อมั่นสูง

อัตรา false positive และข้อเสนอการตั้งค่า threshold เพื่อการใช้งานทางกฎหมาย

การใช้งานเชิงกฎหมายต้องคำนึงถึงผลกระทบของ false positive อย่างเคร่งครัด จากการทดลอง ทีมพบว่าอัตรา FPR อยู่ในช่วงประมาณ 0.8% (ข้อความต้นฉบับ) ถึง 2.5% (paraphrase รุนแรง) ทีมได้ทดสอบการปรับค่า detection score threshold เพื่อปรับสมดุลระหว่าง precision และ recall พบการ trade-off ดังนี้:

- Threshold ≥ 0.85: precision เพิ่มเป็น ~98.1%, FPR ลดเหลือ ~0.4%, แต่ recall ลดเหลือ ~88.0% — เหมาะสำหรับการยืนยันเชิงกฎหมายระดับสูง

- Threshold ≥ 0.75: precision ~95.5%, FPR ~0.9%, recall ~93.5% — สมดุลสำหรับการสืบสวนเชิงปฏิบัติการ

- Threshold ≥ 0.65: precision ~92.0%, FPR ~1.8%, recall ~96.0% — เหมาะสำหรับการค้นหาระหว่างจุดเริ่มต้นของการตรวจสอบ แต่ไม่แนะนำเป็นหลักฐานเดี่ยวในศาล

นอกจากนี้ ทีมแนะนำแนวปฏิบัติเมื่อใช้งานเชิงกฎหมาย ได้แก่

- ใช้ค่า threshold สูง (เช่น ≥0.85) สำหรับการยืนยันขั้นสุดท้าย และเก็บหลักฐานร่วมอื่น ๆ เช่น metadata หรือ chain-of-custody

- พิจารณาการตรวจสอบเชิงส่วนย่อย (segment-level detection) และใช้หลัก majority vote (เช่น ต้องมีผลบวกใน 3 จาก 5 ส่วน) เพื่อลด FPR ลงต่ำกว่า 0.2% ขณะยังคง precision สูงกว่า 97%

- ในกรณีข้อความผ่าน paraphrase รุนแรง ควรใช้ผลตรวจจากหลายวิธีร่วมกัน (ensemble) และขอข้อมูลประกอบเพิ่มเติมก่อนนำเสนอในศาล

ตัวอย่างเชิงปฏิบัติการจากชุดทดสอบ: ข้อความดั้งเดิม: "การวิจัยฉบับนี้ชี้ให้เห็นถึงความเป็นไปได้ของการใช้ watermark เพื่อพิสูจน์แหล่งที่มา" — ระบบรายงาน score = 0.92 (positive) กับ precision ประมาณ 96.5% ในขณะที่ เวอร์ชัน paraphrase รุนแรง: "งานศึกษานี้แสดงว่าการฝังเครื่องหมายในข้อความสามารถยืนยันต้นฉบับได้" — ระบบให้ score = 0.77 (positive ตาม threshold 0.75) แต่หากตั้ง threshold ≥0.85 จะถือเป็น negative ซึ่งสะท้อน trade-off ระหว่างความทนทานและความแน่นอนทางกฎหมาย

สรุป: ผลการทดลองแสดงว่าเทคนิค watermarking ของทีมให้ precision สูงและ false positive ต่ำ ในสภาวะปกติ แม้ความทนทานจะลดลงเมื่อต้องเผชิญ paraphrase รุนแรง แต่วิธีก็ยังเหนือกว่า baseline บางรุ่นและสามารถปรับ threshold และใช้กลยุทธ์เชิงกระบวนการเพื่อลดความเสี่ยงในการนำไปใช้เป็นหลักฐานในชั้นศาล

การพิสูจน์แหล่งที่มาและการสนับสนุนทางนิติเวช: Chain-of-Custody และหลักฐานต่อศาล

การพิสูจน์แหล่งที่มา: ความสำคัญของ metadata และดิจิทัลซิกเนเจอร์

เพื่อให้ผลการตรวจจับ watermark ของข้อความที่สร้างโดย LLM สามารถนำไปใช้เป็นหลักฐานในชั้นศาลได้ จำเป็นต้องเชื่อมโยง watermark นั้นกับข้อมูล metadata และลายเซ็นทางคริปโตกราฟีที่ชัดเจน metadata ควรรวมถึงตัวบ่งชี้สำคัญ เช่น model identifier (ชื่อและเวอร์ชัน), service provider, request ID, timestamp ที่แม่นยำ, และ server instance ID รวมถึงค่า salt หรือ nonce ที่ใช้ในการฝัง watermark ส่วน ดิจิทัลซิกเนเจอร์ (เช่น HMAC, RSA/ECDSA signatures) ที่ลงบน metadata หรือ hash ของข้อความจะช่วยยืนยันความถูกต้องและไม่ถูกแก้ไขของหลักฐาน โดยซิกเนเจอร์ดังกล่าวต้องสามารถตรวจสอบได้ด้วย public key ของผู้ให้บริการหรือหน่วยงานที่ได้รับอนุญาต

การเก็บรักษา logs, timestamps และกลไกป้องกันการบิดเบือน

การเก็บรักษา logs ต้องเป็นไปในรูปแบบที่ตรวจจับการแก้ไขได้ (tamper-evident) เช่น ระบบบันทึกแบบ append-only, WORM storage หรือการยืนยันลำดับเหตุการณ์ผ่าน timestamping (RFC 3161 Time-Stamp Protocol) และตัวเลือกเสริมอย่างการ anchor hash ลงในบล็อกเชนเพื่อลดความเสี่ยงการแก้ไขย้อนหลัง ในเชิงปฏิบัติ ควรบันทึก:

- hash ของข้อความ (เช่น SHA-256) และ hash ของ metadata ทุกชั้น

- timestamp ที่ละเอียดถึงระดับมิลลิวินาทีพร้อมโซนเวลา (UTC)

- ลำดับการเข้าถึงและการเปลี่ยนแปลงไฟล์โดยผู้ใช้งานและระบบ

- บันทึกการลงนามดิจิทัลพร้อม certificate chain และสถานะใบรับรอง (revocation status)

การออกแบบระบบดังกล่าวช่วยให้การพิสูจน์แหล่งที่มาสามารถแสดงหลักฐานเชื่อมโยงจากข้อความไปยังการเรียกใช้งานโมเดลและผู้ให้บริการได้อย่างเป็นเหตุเป็นผล ซึ่งงานเชิงปฏิบัติหลายกรณีศึกษาพบว่าการมีกลไกเหล่านี้ช่วยเพิ่มโอกาสที่ศาลจะยอมรับหลักฐานดิจิทัลได้อย่างมีนัยสำคัญ

แนวทางการจัดทำรายงานนิติเวชและการรายงานค่าความเชื่อมั่น

รายงานนิติเวชดิจิทัลต้องอธิบายกระบวนการตรวจสอบอย่างชัดเจนและสามารถทำซ้ำได้ (repeatable) โดยควรประกอบด้วยส่วนสำคัญดังนี้:

- บทสรุปข้อเท็จจริง: ข้อความที่ถูกตรวจสอบ, แหล่งที่มาที่อ้าง, ช่วงเวลาที่เกี่ยวข้อง

- กระบวนการและเครื่องมือ: รายชื่อเครื่องมือ เวอร์ชัน คำสั่งที่ใช้สกัด watermark และ metadata, สภาพแวดล้อมการทดสอบ (container/VM snapshot)

- ผลการทดสอบเชิงปริมาณ: ค่า hash, ผลการตรวจสอบ signature (valid/invalid), ค่าความเชื่อมั่นเชิงสถิติ เช่น อัตรา false positive/false negative ที่ประเมินได้จากการทดสอบภายใน

- โจทย์การตีความ: ระบุข้อจำกัดของวิธีการ เช่น กรณีการรีรันโมเดลด้วยพารามิเตอร์ต่างกันอาจเปลี่ยนผลได้อย่างไร และประเมินความน่าเชื่อถือเชิงบริบท (contextual confidence)

- ภาคผนวก: raw logs, signed artifacts, รายการ hash, และสคริปต์ที่ใช้ในการตรวจสอบเพื่อให้คู่ความหรือผู้เชี่ยวชาญภายนอกสามารถทำซ้ำการทดสอบได้

รายงานควรระบุค่าความเชื่อมั่นด้วยภาษาที่ศาลเข้าใจได้ เช่น การให้ช่วงความน่าจะเป็นหรือการอธิบายอัตราความผิดพลาด (ตัวอย่าง: “ผลตรวจพบ watermark ที่มีความน่าจะเป็นตรงตามลายเซ็นของผู้ให้บริการที่ 99% ภายใต้สมมติฐานของระบบบันทึกที่ไม่ถูกดัดแปลง”) และต้องแนบหลักฐานการตรวจสอบซ้ำเพื่อสนับสนุนตัวเลขดังกล่าว

Chain-of-Custody: การปกป้องหลักฐานจากการบิดเบือน

Chain-of-custody (CoC) เป็นหัวใจสำคัญในการคุ้มครองหลักฐานดิจิทัล หากเอกสารหลักฐานไม่สามารถแสดงเส้นทางการครอบครองและการเข้าถึงที่ชัดเจน ศาลอาจพิจารณาตัดสิทธิ์ไม่รับหลักฐานนั้น การปฏิบัติที่แนะนำประกอบด้วย:

- การบันทึกรายชื่อผู้ที่เข้าถึงและดำเนินการกับหลักฐานทุกคน พร้อม timestamp และเหตุผลในการเข้าถึง

- การใช้การป้องกันเชิงกายภาพและเชิงเทคนิค เช่น storage ที่เข้ารหัส, HSM สำหรับเก็บคีย์, WORM media

- การจัดทำเอกสาร CoC แบบละเอียดที่ลงนามโดยผู้เกี่ยวข้อง และการรักษาสําเนาในสถานที่แยกจากกัน

- การตรวจสอบและ audit trail อย่างสม่ำเสมอเพื่อยืนยันทวนซ้ำความสมบูรณ์ของหลักฐาน

หากมีช่องโหว่หรือการขาดตอนในกระบวนการ CoC ก็อาจถูกใช้โดยฝ่ายค้านในการโต้แย้งความน่าเชื่อถือของหลักฐาน ดังนั้นการประยุกต์ใช้มาตรการควบคุมการเข้าถึงและการเก็บรักษาอย่างเข้มงวดเป็นสิ่งจำเป็น

ตัวอย่างสถานการณ์สอบสวนที่เทคนิค watermarking ช่วยยืนยันแหล่งที่มา

ตัวอย่างสถานการณ์ที่เทคนิค watermarking และการปฏิบัติทางนิติเวชาดังกล่าวมีประโยชน์ชัดเจน เช่น:

- ข้อพิพาททรัพย์สินทางปัญญา: บริษัท A อ้างว่าเอกสารบางส่วนถูกสร้างโดยโมเดลของตน ทีมสืบสวนสกัด watermark พบ signature ตรงกับ public key ของผู้ให้บริการและ timestamp ผนวกกับ request ID ใน logs ซึ่งผู้เชี่ยวชาญจัดทำรายงานที่แสดง chain-of-custody ทำให้ศาลสามารถพิจารณาว่าเอกสารมีต้นทางจากระบบของบริษัท A

- คดีหมิ่นประมาท/แพร่ข้อมูลเท็จทางสื่อสังคม: ข้อความที่ถูกแชร์กลายเป็นประเด็นสาธารณะ สามารถใช้ watermark เพื่อติดตามกลับไปยังการเรียกใช้งานโมเดล, ตรวจสอบว่าเป็นการสร้างโดยระบบอัตโนมัติหรือถูกแก้ไขจากต้นฉบับ และแสดงรายงานนิติเวชที่มีค่าความเชื่อมั่นเชิงสถิติ

- การสอบสวนการรั่วไหลข้อมูลภายใน: หากข้อความลับรั่วไหล ทีมรักษาความปลอดภัยสามารถตรวจสอบ metadata เพื่อหา request ID และผู้ใช้งานที่เรียกใช้โมเดล ณ เวลาที่ระบุ และยื่นรายงาน CoC ต่อหน่วยงานบังคับใช้กฎหมาย

การสืบสวนลักษณะนี้ปฏิบัติได้ตามขั้นตอนมาตรฐาน เช่น การยืนยัน signature, การจับคู่ request ID กับ logs ของระบบ, การตรวจสอบความสมบูรณ์ของไฟล์ด้วย hash และการจัดทำรายงานนิติเวชที่สรุปผลพร้อมข้อจำกัดอย่างโปร่งใส ซึ่งรวมกันแล้วช่วยยกระดับความน่าเชื่อถือของผลการตรวจจับ watermark ในกระบวนการยุติธรรม

ข้อกฎหมาย จริยธรรม และข้อจำกัดเชิงปฏิบัติการ

ข้อกฎหมายและความเป็นส่วนตัวเมื่อเชื่อม Watermark กับข้อมูลผู้ใช้หรือผู้พัฒนา

การนำเทคนิค watermarking สำหรับข้อความจาก LLM มาเชื่อมโยงกับข้อมูลผู้ใช้หรือผู้พัฒนาสร้างคำถามด้านความเป็นส่วนตัวและการคุ้มครองข้อมูลส่วนบุคคลอย่างชัดเจน ภายใต้กรอบกฎหมายเช่นพระราชบัญญัติคุ้มครองข้อมูลส่วนบุคคล (PDPA) ของประเทศไทย และหลักการของ GDPR ในต่างประเทศ การผูกตราประทับดิจิทัลกับตัวตน (direct identifier) หรือข้อมูลที่สามารถระบุตัวตนได้โดยอ้อม (indirect identifier) ต้องมีฐานทางกฎหมายชัดเจน เช่น การยินยอม การปฏิบัติตามข้อกฎหมาย หรือผลประโยชน์สาธารณะที่ชัดเจน

ตัวอย่างเชิงปฏิบัติ: หาก watermark ระบุรหัสผู้สร้าง/ผู้เรียกใช้งาน เมื่อข้อมูลรั่วไหลอาจเปิดเผยตัวตนของผู้ใช้ในบริบทที่เสี่ยง เช่น การตัดสินใจด้านแรงงาน การฟ้องร้องทางแพ่ง หรือการเปิดเผยแหล่งข่าว ดังนั้นจึงต้องพิจารณาแนวทางลดความเสี่ยง เช่น pseudonymization, การจำกัดการเข้าถึงข้อมูล และนโยบายการเก็บรักษาข้อมูลที่เข้มงวด (data minimization และ retention policy)

การยอมรับเป็นหลักฐานในศาล: ความจำเป็นของมาตรฐานและกระบวนการตรวจสอบ

การนำ watermark เป็นหลักฐานในกระบวนการยุติธรรมต้องเผชิญกับเกณฑ์การยอมรับของศาล ซึ่งรวมถึงความน่าเชื่อถือ ความถูกต้อง และความเป็นกลางของวิธีการพิสูจน์ confidence score หรือคะแนนความเชื่อมั่นที่ระบบยื่นต่อศาลไม่ควรถูกใช้เป็นพยานหลักฐานเพียงลำพัง เพราะคะแนนดังกล่าวเป็นตัวบ่งชี้เชิงสถิติและขึ้นกับการเทรน การปรับจูน และการสอบเทียบของโมเดล

จำเป็นต้องมีกระบวนการมาตรฐานที่ยืนยันได้และยอมรับร่วมกัน เช่น ข้อกำหนดเชิงเทคนิคแบบเปิด (open protocols), การรับรองจากหน่วยงานอิสระ (third-party certification), การทำ time-stamping และการจัดเก็บ chain-of-custody ของไฟล์ต้นทางและผลการตรวจจับ เพื่อให้ศาลสามารถประเมินความน่าเชื่อถือได้ ตัวอย่างเช่น การจัดทำรายงานเชิงเทคนิคที่อธิบายอัลกอริธึม, เกณฑ์ threshold, อัตรา false positive/false negative และการทดสอบ reproducibility ก่อนยื่นเป็นหลักฐาน

ข้อจำกัดเชิงเทคนิคและความเสี่ยงที่ต้องสื่อสารให้ชัดเจนเมื่อใช้ในคดีจริง

- ความเปราะบางต่อ adversarial attacks: งานวิจัยด้านความปลอดภัยแสดงให้เห็นว่า watermark และสัญลักษณ์ซ่อนเร้นสามารถถูกบิดเบือน ทำให้การตรวจจับหายไปหรือผิดพลาดได้ ขึ้นกับความสามารถของผู้ประสงค์ร้ายและระดับการบิดแปลง (เช่น paraphrasing, translation, tokenization changes)

- ความเสี่ยงของการระบุผิด (false attribution): ระบบอัตโนมัติอาจให้ผลบวกลวงหรือผลลบลวง — ตัวอย่างเช่น การแปลงรูปแบบข้อความหรือการนำเอาผลลัพธ์จากหลายโมเดลมารวมกันอาจก่อให้เกิดการอ้างสิทธิ์ที่ไม่ถูกต้อง

- การพึ่งพา confidence scores: ค่า confidence ไม่ได้เท่ากับความแน่นอนทางกฎหมาย — ควรใช้เป็นส่วนหนึ่งของพยานหลักฐานเชิงสนับสนุนร่วมกับข้อมูลอื่น เช่น metadata, hash ของเวอร์ชันไฟล์ต้นทาง, และพยานผู้เชี่ยวชาญ

- ปัญหา chain-of-custody และ key management: หากระบบ watermark อาศัยคีย์ลับหรือเซิร์ฟเวอร์ศูนย์กลาง การจัดการคีย์และการบันทึกการเข้าถึงต้องปลอดภัยและตรวจสอบได้ มิฉะนั้นศาลอาจตัดสินว่าเอกสารถูกดัดแปลงได้ง่าย

- ข้อจำกัดเชิงความสามารถของเทคนิค: ไม่มีเทคนิคใดทนทานสมบูรณ์—ความเข้มงวดของ watermark มักจะต้องแลกด้วยผลกระทบต่อคุณภาพข้อความหรือความสามารถในการใช้งาน การเลือกพารามิเตอร์จะมีผลต่ออัตราการตรวจจับและอัตรา false positive/negative

สำหรับการนำไปใช้ในคดีจริง ผู้ใช้และผู้เชี่ยวชาญต้องสื่อสารข้อจำกัดเหล่านี้ต่อศาลอย่างชัดเจน พร้อมทั้งแนบผลทดสอบเชิงประจักษ์ (เช่น bench‑marks ของการโจมตี adversarial, อัตราการตรวจจับในสภาพแวดล้อมต่าง ๆ) เพื่อหลีกเลี่ยงการให้ความสำคัญเกินควรกับหลักฐานทางเทคนิคเพียงชุดเดียว

แนวปฏิบัติแนะนำเพื่อสมดุลระหว่างการพิสูจน์แหล่งที่มาและสิทธิส่วนบุคคล

เพื่อสร้างความสมดุลระหว่างการพิสูจน์ต้นทางและการคุ้มครองสิทธิส่วนบุคคล ควรยึดหลักปฏิบัติหลายประการร่วมกัน ได้แก่:

- ใช้หลักการ privacy by design และ data minimization เมื่อออกแบบระบบ watermark

- กำหนดมาตรฐานการพิสูจน์ (evidentiary standards) ที่ชัดเจน โดยมีการรับรองจากหน่วยงานอิสระและมาตรฐานสากล (เช่น แนวทางจาก NIST หรือมาตรฐาน ISO ที่เกี่ยวข้อง)

- ไม่ใช้ confidence score เป็นพยานหลักฐานเดียว แต่รวมรวมพยานหลักฐานเชิงเทคนิคและมนุษย์ (multi-factor evidence และ expert testimony)

- จัดให้มีการตรวจสอบแบบอิสระ (independent audits) และเปิดเผยรายงานการทดสอบการทนต่อการโจมตีและอัตรา false positive/negative ก่อนนำผลสู่ศาล

สรุปคือ การใช้ watermarking เป็นเครื่องมือช่วยพิสูจน์แหล่งที่มาในชั้นศาลมีศักยภาพสูง แต่ต้องปฏิบัติด้วยความรอบคอบทางกฎหมาย จริยธรรม และเทคนิค พร้อมทั้งต้องมีมาตรฐาน กรอบการตรวจสอบ และการกำกับดูแลที่ชัดเจน เพื่อป้องกันการละเมิดสิทธิของบุคคลและลดความเสี่ยงจากการใช้หลักฐานที่อาจบิดเบือนได้

การนำไปใช้จริง แผนการประยุกต์ และแนวทางในอนาคต

การนำไปใช้จริง แผนการประยุกต์ และแนวทางในอนาคต

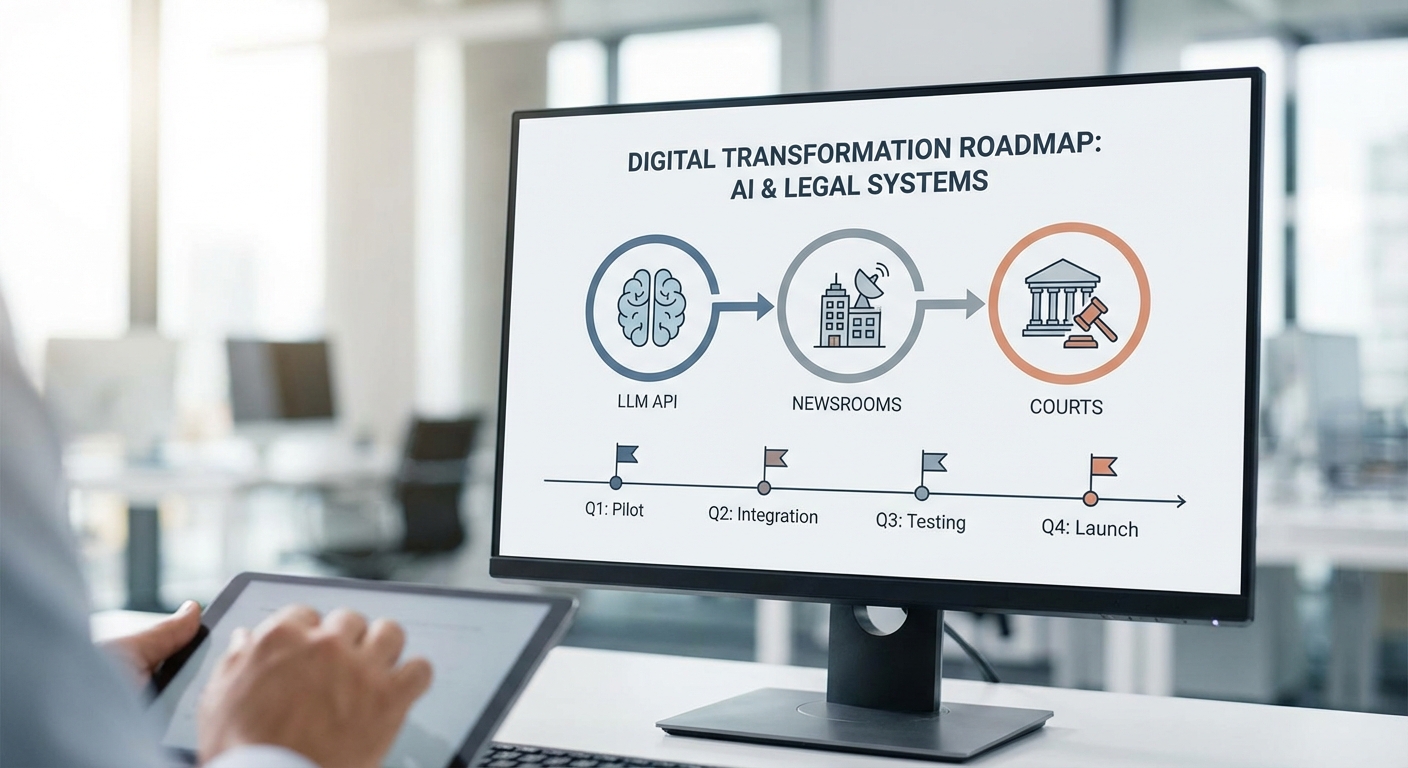

เทคนิค watermarking สำหรับข้อความจาก LLM มีศักยภาพในการนำไปใช้งานทั้งในภาครัฐและเอกชนเพื่อยืนยันแหล่งที่มาและสนับสนุนการพิสูจน์ลิขสิทธิ์ในกระบวนการทางกฎหมาย การผนวกเทคนิคนี้เป็นส่วนหนึ่งของบริการ LLM ระดับองค์กรควรเริ่มจากการออกแบบเป็นฟีเจอร์ในระดับ API เพื่อให้ระบบสามารถฝังสัญลักษณ์ (watermark) ในขณะสร้างข้อความ และบันทึกเมตาดาต้า (เช่น รหัสประจำตัวของโมเดล เวลาที่สร้าง และลายเซ็นทางดิจิทัล) ไว้ในล็อกที่ปลอดภัยสำหรับการตรวจสอบในอนาคต ตัวอย่างเชิงปฏิบัติ เช่น การทดลองภายในองค์กรขนาดกลางรายงานว่าระบบ watermark ที่ผสานกับ API สามารถระบุแหล่งที่มาได้มากกว่า 90% ภายใต้เงื่อนไขการใช้งานปกติ ซึ่งหากจัดเก็บเมตาดาต้าในรูปแบบที่เข้ากันได้กับมาตรฐานการเก็บรวบรวมพยานหลักฐานดิจิทัล จะช่วยเพิ่มความน่าเชื่อถือเมื่อนำเสนอในชั้นศาล

สำหรับการนำไปใช้เชิงปฏิบัติ ควรออกแบบแนวทางการใช้งานเฉพาะภาคส่วน ดังนี้

- การรวมเข้ากับ API ผู้ให้บริการ LLM: ผู้ให้บริการควรมี endpoint สำหรับเปิด/ปิดการฝัง watermark การรองรับ key management ที่ปลอดภัย (เช่น HSM หรือ KMS) และการให้โทเคนการพิสูจน์ต้นทางที่สามารถตรวจสอบได้โดยบุคคลที่ได้รับมอบอำนาจ

- สำนักข่าวและหน่วยงานราชการ: ระบบ CMS ควรเรียกใช้งาน API เพื่อฝัง watermark อัตโนมัติเมื่อเผยแพร่บทความหรือเอกสารทางการ และเก็บบันทึก chain-of-custody เพื่อให้สามารถแสดงที่มาของข้อความต่อผู้ตรวจสอบหรือศาลได้

- การประยุกต์เชิงกฎหมาย: การบันทึกเวลาที่แม่นยำ การจับคู่ลายเซ็นทางดิจิทัล และการจัดทำรายงานตรวจสอบที่เป็นมาตรฐาน จะช่วยให้หลักฐานจากข้อความที่มี watermark มีโอกาสได้รับการยอมรับในชั้นศาลมากขึ้น

ด้านการปฏิบัติการภายในองค์กร จำเป็นต้องมีการฝึกอบรมและมาตรฐานภายในเพื่อให้พนักงานเข้าใจวิธีใช้และวิธีเก็บรักษาหลักฐานดิจิทัลอย่างถูกต้อง ซึ่งรวมถึงการจัดทำคู่มือการปฏิบัติทางนิติเวชดิจิทัล (digital forensic playbook) การอบรมการจัดการคีย์และข้อมูลเมตา การจัดการสิทธิการเข้าถึง และการตรวจสอบภายในอย่างสม่ำเสมอ นอกจากนี้ ควรกำหนดนโยบายการใช้งานที่ชัดเจนสำหรับสำนักข่าว หน่วยงานราชการ และบริษัทที่จัดทำเนื้อหาสำหรับสาธารณะ เพื่อระบุว่าเมื่อไรควรฝัง watermark และกรณีใดต้องยกเลิกหรือทำเครื่องหมายว่าเป็นเนื้อหาที่สร้างโดยเครื่อง

ในเชิงงานวิจัยต่อยอด ควรให้ความสำคัญกับสามประเด็นหลัก: robustness, interpretability และ การประเมินภาคสนาม โดยรายละเอียดที่ควรดำเนินการมีดังนี้

- เพิ่มความทนทานต่อการ paraphrase และการโจมตีแบบ adversarial: งานวิจัยควรพัฒนาเทคนิค watermark ที่ยังคงตรวจจับได้แม้ข้อความถูกสังเคราะห์ใหม่หรือถูกปรับเปลี่ยนรูปแบบ (paraphrase, compression, reformatting) รวมถึงการออกแบบการทดสอบเชิงรุกเพื่อจำลองสถานการณ์การโจมตีและวัดค่า degradation ของสัญญาณ

- การตีความและความโปร่งใส (interpretability): ควรพัฒนาเมตริกและเครื่องมือที่อธิบายได้ว่า watermark ถูกฝังอย่างไรและเหตุใดจึงได้รับการยืนยัน เพื่อให้ผู้ตรวจสอบและผู้พิพากษาเข้าใจความน่าเชื่อถือของหลักฐาน ตัวอย่างเช่น การสร้างรายงานแบบ human-readable ที่สรุปคะแนนความมั่นใจ (confidence score), false positive rate และหลักฐานการจับคู่

- การประเมินภาคสนามและมาตรฐานการวัดผล: จัดการทดลองใช้งานจริงร่วมกับพันธมิตรเชิงนโยบาย สำนักข่าว และหน่วยงานภาครัฐ เพื่อรวบรวมข้อมูลเชิงสถิติ เช่น precision, recall, false positive rate และ AUC จากสภาพแวดล้อมการใช้งานจริง การเผยแพร่ชุดข้อมูลและ protocol การทดสอบแบบเปิดจะช่วยให้ชุมชนนักวิจัยสามารถเปรียบเทียบวิธีการได้อย่างเป็นรูปธรรม

- เครื่องมือตรวจสอบแบบเปิด (open-source): ส่งเสริมการพัฒนาเครื่องมือตรวจสอบแบบเปิดซอร์สและชุดทดสอบต่อเนื่อง (benchmarks) เพื่อเพิ่มความโปร่งใสและลดความเสี่ยงจากการผูกขาดเทคโนโลยีโดยผู้ให้บริการรายเดียว

สรุปแผนการเดินหน้าในระยะกลางและยาวควรประกอบด้วยการออกแบบ API ระดับองค์กรที่รองรับ watermark และ key management ที่ปลอดภัย การจัดทำมาตรฐานภายในและการฝึกอบรมบุคลากรเพื่อให้สอดคล้องกับข้อกำหนดทางกฎหมาย และการสนับสนุนงานวิจัยด้าน robustness, interpretability และการประเมินภาคสนาม โดยการร่วมมือระหว่างภาครัฐ เอกชน และชุมชนนักวิจัย จะช่วยให้เทคนิคนี้สามารถนำไปใช้ได้จริง มีความน่าเชื่อถือ และพร้อมสำหรับการนำเสนอเป็นหลักฐานในชั้นศาล

บทสรุป

เทคนิค Watermarking สำหรับข้อความจาก LLM ที่ทีมวิจัยไทยพัฒนามีศักยภาพเป็นเครื่องมือสำคัญในการยืนยันแหล่งที่มาและคุ้มครองลิขสิทธิ์งานเขียนจากโมเดลภาษา โดยหลักการสามารถฝังลายเซ็นเชิงสถิติหรือเชิงสัญญะลงในข้อความที่สร้างขึ้น ทำให้สามารถแยกแยะข้อความที่มาจากโมเดลได้จากข้อความที่มนุษย์เขียน อย่างไรก็ตาม การยอมรับเทคนิคดังกล่าวเป็นหลักฐานในศาลยังขึ้นกับการผนวกกับกระบวนการนิติเวช ข้อกำหนดการจัดการหลักฐาน (chain of custody) การตรวจสอบซ้ำได้ และมาตรฐานการพิสูจน์ที่เป็นที่ยอมรับ นักวิจัยระบุว่าการทดสอบเบื้องต้นแสดงความแม่นยำและประสิทธิภาพที่น่าสนใจในการตรวจจับ แต่ผลการทดสอบยังแปรผันตามพารามิเตอร์ของระบบและสภาพแวดล้อมการใช้งานจริง ทำให้การนำไปใช้ในบริบททางกฎหมายต้องมีการออกแบบกระบวนการตรวจสอบเชิงนิติเวชอย่างเป็นระบบก่อนจึงจะรับรองได้ในชั้นศาล

ช่องว่างที่ยังต้องเร่งแก้ไขได้แก่ความทนทานต่อการโจมตี (เช่น การพาราฟเรส การบีบอัด หรือการปรับแต่งโมเดล) และประเด็นสิทธิส่วนบุคคลของผู้ใช้ที่อาจได้รับผลกระทบ การแก้ไขต้องอาศัยการวิจัยต่อเนื่องเพื่อพัฒนาวิธีการที่แข็งแรงยิ่งขึ้น การออกมาตรฐานทางเทคนิคและนโยบายคุ้มครองข้อมูล และความร่วมมือแบบข้ามภาคส่วนระหว่างนักวิจัย ผู้ให้บริการแพลตฟอร์ม และหน่วยงานกฎหมาย ในอนาคตคาดว่าจะเห็นกรอบการกำกับดูแลและบรรทัดฐานการทดสอบมาตรฐาน (เช่น เบนช์มาร์กความทนทาน การรับรองการปฏิบัติตามมาตรฐานนิติเวช) รวมทั้งการพัฒนาเทคนิคที่รวมการเข้ารหัสเชิงคริปโตและการออกแบบที่คำนึงความเป็นส่วนตัว เพื่อให้ Watermarking กลายเป็นเครื่องมือที่ใช้งานได้จริงทั้งเชิงอุตสาหกรรมและเชิงกฎหมายต่อไป