ความสัมพันธ์ระหว่าง Anthropic บริษัทสตาร์ทอัพด้านปัญญาประดิษฐ์ที่ถูกจับตามองกับกระทรวงกลาโหมสหรัฐฯ (DoD) กำลังสั่นคลอนอย่างชัดเจน หลังการเจรจาที่หลายฝ่ายคาดหวังว่าจะเปิดทางสู่ข้อตกลงด้านการจัดหาและทดสอบโมเดล AI สำหรับการใช้งานเชิงกลาโหมกลับล่มลงอย่างกะทันหัน เหตุการณ์นี้ไม่เพียงสร้างความตกตะลึงในวงการเทคโนโลยี แต่ยังยกคำถามสำคัญเกี่ยวกับความสมดุลระหว่างนวัตกรรม พาณิชย์ และความปลอดภัยของชาติ — โดยเฉพาะเมื่องบประมาณและโครงการด้าน AI ของกลาโหมมีมูลค่าหลายพันล้านดอลลาร์และเติบโตอย่างรวดเร็วในช่วงไม่กี่ปีที่ผ่านมา

บทนำนี้จะพาไปยังประเด็นสำคัญที่บทความจะลงลึก: เบื้องหลังการเจรจาที่ล่มมีปัจจัยใดบ้าง — ทั้งข้อขัดแย้งทางเทคนิค (เช่น การเข้าถึงโมเดล การเปิดเผยสถาปัตยกรรม และมาตรการป้องกัน misuse), ปัจจัยทางการเมือง (ความกังวลจากสภาคองเกรสและผู้กำหนดนโยบาย) และประเด็นนโยบาย (เงื่อนไขการใช้งาน ข้อจำกัดการส่งออก และการตรวจสอบความปลอดภัย) — พร้อมไทม์ไลน์เหตุการณ์สำคัญ ผลกระทบต่อกระบวนการจัดซื้อ AI เชิงทหาร และบทเรียนเชิงนโยบายที่ภาครัฐและเอกชนควรนำไปพิจารณา

อ่านต่อเพื่อรับรู้ภาพรวมเหตุการณ์ รายละเอียดตัวอย่างการเจรจา ความเสี่ยงที่อาจเกิดขึ้น รวมทั้งการวิเคราะห์เชิงลึกและข้อเสนอแนะที่อาจชี้นำหน่วยงานรัฐและบริษัท AI ในการสร้างกรอบการทำงานร่วมกันที่ยั่งยืนและปลอดภัยยิ่งขึ้นสำหรับอนาคต

สาระสำคัญ: เหตุการณ์และผลลัพธ์โดยย่อ

สาระสำคัญ: เหตุการณ์และผลลัพธ์โดยย่อ

เมื่อเร็ว ๆ นี้ ความสัมพันธ์ระหว่าง Anthropic บริษัทพัฒนาโมเดลปัญญาประดิษฐ์ และ กระทรวงกลาโหมสหรัฐฯ (DoD) เกิดความตึงเครียดขึ้นอย่างชัดเจน รายงานหลายฉบับระบุว่าเหตุการณ์หลักเกิดขึ้นในช่วงปลายกุมภาพันธ์ 2026 เมื่อนัดหมายการหารือระดับอาวุโสระหว่างสองฝ่ายถูกเลื่อนและหยุดชั่วคราวภายใน 48 ชั่วโมง หลังการประชุมรอบก่อนหน้า ทำให้การเจรจาที่ดำเนินมาเปลี่ยนสถานะเป็นการระงับชั่วคราวและสร้างความไม่แน่นอนต่อความร่วมมือเชิงกลยุทธ์ระหว่างกัน

ผลลัพธ์ทันทีที่ปรากฏชัดคือ การหยุดชั่วคราวของการเจรจา รวมถึงการยกเลิกการประชุมอย่างน้อยหนึ่งครั้งและการออกคำแถลงสาธารณะที่เป็นทางการจากทั้งสองฝ่าย ภายใน 24–72 ชั่วโมงหลังเกิดเหตุ มีการระบุว่าทั้งสองฝ่ายเริ่มขั้นตอนทบทวนภายใน เช่น การตรวจสอบเงื่อนไขความปลอดภัย ขอบเขตข้อมูล และมาตรการป้องกันการใช้งานทางทหาร ซึ่งส่งผลให้แผนงานร่วมบางส่วนถูกเลื่อนออกไปอย่างไม่มีกำหนด

สรุปประเด็นสำคัญเชิงข้อเท็จจริง (โดยย่อ):

- ช่วงเวลา — เหตุการณ์สำคัญเกิดขึ้นช่วงปลายกุมภาพันธ์ 2026; การยกเลิกและการหยุดเจรจาเกิดขึ้นภายใน 48 ชั่วโมงหลังการหารือรอบล่าสุด

- ผลลัพธ์ทันที — การเจรจาถูกระงับชั่วคราว การประชุมระดับผู้บริหารถูกยกเลิก และมีการทบทวนเงื่อนไขความปลอดภัยและจริยธรรมของความร่วมมือ

- ผลกระทบต่อโครงการ — แผนงานร่วมเชิงปฏิบัติการและการลงนามข้อตกลงที่อาจเกิดขึ้นถูกเลื่อนออกไปจนกว่าจะมีการประเมินความเสี่ยงเพิ่มเติม

คำแถลงสั้นจากสองฝ่าย (ฉบับย่อ):

- Anthropic แถลงสั้นว่า บริษัทให้ความสำคัญกับความปลอดภัยและความโปร่งใสในการพัฒนาเทคโนโลยี AI และพร้อมร่วมมือเพื่อแก้ไขข้อกังวลที่ DoD ยกขึ้น แต่ต้องมีการตกลงกรอบการทำงานที่ชัดเจนก่อนจะกลับมาสานต่อการเจรจา

- กระทรวงกลาโหมสหรัฐฯ (DoD) ระบุว่าได้ระงับการหารือบางส่วนเพื่อทบทวนเงื่อนไขด้านความปลอดภัยและความเสี่ยงเชิงยุทธศาสตร์ พร้อมยืนยันว่าการตัดสินใจดังกล่าวเป็นไปเพื่อความมั่นคงของชาติและการประเมินความเสี่ยงเชิงปฏิบัติจริง

ภูมิหลังบริษัท: Anthropic และตำแหน่งในอุตสาหกรรม AI

ภูมิหลังบริษัท: Anthropic และตำแหน่งในอุตสาหกรรม AI

ก่อตั้งและภาพรวม — Anthropic ก่อตั้งขึ้นในปี 2021 โดยกลุ่มอดีตวิศวกรและผู้บริหารจากสถาบันวิจัย AI ชั้นนำ โดยมีจุดมุ่งหมายชัดเจนในการพัฒนาโมเดลภาษาธรรมชาติ (large language models) ที่เน้นความปลอดภัยและความสอดคล้อง (alignment) ผลิตภัณฑ์หลักของบริษัทคือชุดโมเดลภายใต้แบรนด์ Claude ซึ่งถูกออกแบบมาเพื่อรองรับงานเชิงสนทนา การสรุปข้อมูล การช่วยเขียนโค้ด และการให้คำปรึกษาทางธุรกิจในรูปแบบที่ผู้ใช้เข้าถึงง่ายและมีความเสี่ยงต่อการสร้างเนื้อหาอันตรายน้อยลง

เทคโนโลยีหลักและจุดยืนด้านความปลอดภัย — Anthropic เด่นชัดด้วยแนวทางด้านความปลอดภัยที่เป็นระบบ ได้แก่ การพัฒนาแนวทางที่เรียกว่า Constitutional AI เพื่อลดพฤติกรรมที่เป็นอันตรายของโมเดล การทำ red‑teaming และการทดสอบเชิงปฏิบัติ (adversarial testing) อย่างต่อเนื่อง รวมทั้งการลงทุนในการวิจัยด้าน interpretability และ scalable oversight บริษัทประกาศนโยบายเชิงจริยธรรมและข้อจำกัดการใช้งานที่ชัดเจน เช่นการคัดกรองและจำกัดการใช้ในกรณีที่อาจนำไปสู่ความเสี่ยงด้านความปลอดภัยหรือการละเมิดสิทธิมนุษยชน ซึ่งเป็นเหตุผลสำคัญที่ทำให้ Anthropic ถูกมองว่าเป็นหนึ่งในผู้เล่นที่มีจุดยืนด้าน “AI ที่ปลอดภัย” ในตลาด

การเติบโตและการระดมทุน — ในช่วงหลายปีหลังจากก่อตั้ง Anthropic เติบโตอย่างรวดเร็วทั้งในด้านทีมวิจัยและขนาดการดำเนินงาน บริษัทได้รับเงินลงทุนจากกองทุน VC และพันธมิตรเชิงกลยุทธ์ รวมถึงการจัดตั้งข้อตกลงด้านโครงสร้างพื้นฐานกับผู้ให้บริการคลาวด์รายใหญ่เพื่อรองรับความต้องการการประมวลผลของโมเดลขนาดใหญ่ ผลลัพธ์คือ Anthropic ถูกประเมินมูลค่าในระดับหลายพันล้านดอลลาร์และกลายเป็นหนึ่งในสตาร์ทอัพ AI ชั้นนำของสหรัฐฯ ทั้งนี้การระดมทุนและความร่วมมือเชิงโครงสร้างพื้นฐานเป็นปัจจัยสำคัญที่ช่วยให้บริษัทสามารถขยายการให้บริการเชิงพาณิชย์ได้รวดเร็ว

ความเกี่ยวข้องกับภาครัฐและพันธมิตรเชิงพาณิชย์ก่อนหน้า — แม้ Anthropic จะเน้นภาพลักษณ์ด้านความปลอดภัย บริษัทมีความสัมพันธ์เชิงพาณิชย์กับองค์กรธุรกิจหลากหลายภาคส่วน เช่น การให้บริการแก่ภาคการเงิน การดูแลสุขภาพ และองค์กรขนาดใหญ่ผ่านทางผลิตภัณฑ์ Claude นอกจากนี้ บริษัทยังให้บริการผ่านพันธมิตรคลาวด์ซึ่งเปิดช่องให้หน่วยงานภาครัฐบางแห่งเข้าถึงเทคโนโลยีของ Anthropic ในรูปแบบการจัดหาเชิงพาณิชย์ แต่อุดมคติเรื่องการใช้งานที่เป็นอันตรายทำให้ Anthropic ต้องวางกรอบเงื่อนไขด้านจริยธรรมและการกำกับดูแลอย่างเข้มงวด ซึ่งเป็นปัจจัยที่ทำให้การเจรจากับหน่วยงานอย่างกระทรวงกลาโหมสหรัฐฯ มีความละเอียดอ่อนและมีนัยสำคัญทางยุทธศาสตร์

- ตัวอย่างนโยบายความปลอดภัย: การใช้ Constitutional AI, red‑teaming และข้อจำกัดเชิงจริยธรรมต่อการประยุกต์ใช้ที่เป็นอันตราย

- การระดมทุนและพันธมิตร: ได้รับการสนับสนุนจากนักลงทุนสถาบันและจัดตั้งความร่วมมือด้านโครงสร้างพื้นฐานกับผู้ให้บริการคลาวด์รายใหญ่ ทำให้มีทรัพยากรสำหรับฝึกและให้บริการโมเดลระดับองค์กร

- บทบาทเชิงพาณิชย์และภาครัฐ: ให้บริการแก่ลูกค้าภาคเอกชนหลายภาคและผ่านช่องทางพันธมิตรคลาวด์ที่เปิดโอกาสให้หน่วยงานภาครัฐเข้าถึงเทคโนโลยี แต่ต้องทำภายใต้กรอบข้อจำกัดด้านจริยธรรมและความปลอดภัย

บริบทดังกล่าวทำให้ข้อตกลงหรือการเจรจากับกระทรวงกลาโหมสหรัฐฯ มีความสำคัญเป็นพิเศษ: ไม่เพียงแต่เป็นการขยายฐานลูกค้ารายใหญ่ แต่ยังเป็นการทดสอบว่า Anthropic จะสามารถรักษาจุดยืนด้านความปลอดภัยและข้อจำกัดเชิงจริยธรรมไว้ได้อย่างไรเมื่อเผชิญกับความต้องการและเงื่อนไขจากภาครัฐที่มีความซับซ้อนทางยุทธศาสตร์

ไทม์ไลน์การเจรจา: เหตุการณ์สำคัญจนถึงการล่ม

นี่คือการจัดเรียงเชิงเวลาอย่างละเอียดของการเจรจาระหว่างบริษัท Anthropic และกระทรวงกลาโหมสหรัฐฯ (DoD) ตั้งแต่การเริ่มต้นการติดต่อจนถึงช่วงเวลาที่การเจรจาล้มเหลว โดยรวบรวมจากรายงานสาธารณะ แหล่งข่าวที่ไม่เปิดเผยชื่อ และเอกสารที่รั่วไหลในช่วงเวลาดังกล่าว เพื่อเน้นจุดเปลี่ยนสำคัญ เหตุการณ์ที่พลิกทิศทาง และหลักฐานเชิงเอกสารที่ชี้สาเหตุของความล่ม

มิ.ย. 2022 — การเริ่มต้นการติดต่อและการวางกรอบข้อเสนอ

ในช่วงกลางปี 2022 มีรายงานว่าเกิดการติดต่อครั้งแรกในระดับผู้บริหารและทีมวิชาการระหว่าง Anthropic กับหน่วยงานวิจัยของกระทรวงกลาโหม เพื่อสำรวจความเป็นไปได้ในการนำโมเดลภาษาขนาดใหญ่ไปใช้ในงานด้านการวิเคราะห์ข้อมูลและการสนับสนุนการตัดสินใจ (non-combat, decision-support) ตัวชี้วัดการพบปะเบื้องต้นรวมถึงการประชุมแบบไกล่เกลี่ย 2–3 ครั้ง การแลกเปลี่ยน Non-Disclosure Agreement (NDA) และการส่งเอกสารแนะนำ (whitepaper / model card) จาก Anthropic เพื่ออธิบายขอบเขตความสามารถและมาตรการด้านความปลอดภัยที่บริษัทเสนอ

พ.ย. 2022 — ข้อเสนอหลักและเงื่อนไขที่เป็นพัวพัน

ในช่วงปลายปี 2022 ทั้งสองฝ่ายเริ่มแลกเปลี่ยนข้อเสนอเชิงรูปธรรมมากขึ้น โดย DoD สนใจขอให้มีการทดสอบเชิงรุก (red-team) และการปรับแต่งเพื่อให้สอดคล้องกับงานภาครัฐ ขณะที่ Anthropic ยืนยันเงื่อนไขด้านจริยธรรม เช่น ข้อจำกัดเรื่องการใช้งานที่ก่อให้เกิดอันตราย การตรวจสอบผล (auditing) และข้อเรียกร้องด้านความโปร่งใสของการใช้งาน รายงานระบุว่ามีการหารือเรื่องมูลค่าการสัญญาในวงกว้าง (จากระดับหลักสิบล้านจนถึงหลักร้อยล้านดอลลาร์ในเงื่อนไขบางกรณี) แต่ไม่ได้มีการตกลงตัวเลขขั้นสุดท้าย

เม.ย.–ก.ค. 2023 — การขยายการประชุมเชิงเทคนิคและความเห็นที่แตกต่างเชิงนโยบาย

ในช่วงต้นถึงกลางปี 2023 เกิดการประชุมเชิงเทคนิคหลายชุด (รายงานบอกว่าเกิน 5 ครั้ง) เพื่อวัดผลการทดสอบความปลอดภัยของโมเดล การกำหนด API access controls และการจัดทำกรอบการกำกับดูแล (governance framework) แต่ในระหว่างการพูดคุยมีความเห็นแตกต่างด้านนโยบายชัดเจน: DoD มองว่า ความสามารถในการปรับแต่ง (customization) และสิทธิ์ในการใช้งานเชิงลึกเป็นเรื่องจำเป็นต่อภารกิจบางประเภท ขณะที่ Anthropic ยืนกรานเงื่อนไขการจำกัดการใช้งานและหลักการไม่สนับสนุนการนำ AI ไปใช้ในลักษณะที่ก่อให้เกิดอันตรายต่อพลเรือนหรือขยายปฏิบัติการโจมตี

ส.ค.–ก.ย. 2023 — สื่อมวลชนและเอกสารรั่ว: จุดเปลี่ยนที่เพิ่มแรงกดดัน

ช่วงปลายฤดูร้อนปี 2023 ปรากฏข่าวสื่อมวลชนเกี่ยวกับการเจรจาระหว่าง Anthropic กับ DoD ซึ่งจุดประกายการถกเถียงสาธารณะเกี่ยวกับจริยธรรมของการทำงานร่วมกันระหว่างหน่วยทหารกับผู้พัฒนา AI พร้อมกันนั้นมีรายงานการรั่วไหลของอีเมลภายในและเอกสารนำเสนอ (reportedly มากกว่า 10 ฉบับตามแหล่งข่าว) ที่เผยให้เห็นข้อความภายในบางฉบับ เช่น คำขอด้านสิทธิ์ในการปรับแต่งโมเดลเพื่อสนับสนุนปฏิบัติการบางประเภท และการหารือเกี่ยวกับข้อกำหนดการรายงานที่อาจจำกัดความโปร่งใสของ Anthropic เอง เอกสารที่รั่วไหลถูกยกขึ้นเป็นหลักฐานเชิงบริบทว่าปัญหาด้านความเชื่อมั่น (trust) และภาพลักษณ์เป็นปัจจัยเร่งให้การเจรจาตึงเครียดขึ้นอย่างรวดเร็ว

ต.ค. 2023 — การประชุมสุดท้ายและข้อขัดแย้งเชิงนโยบายที่ไร้ทางประนีประนอม

ในการประชุมระดับผู้บริหารครั้งสุดท้ายก่อนการล่ม ทั้งสองฝ่ายนำข้อเรียกร้องหลักมาประชันกัน ได้แก่

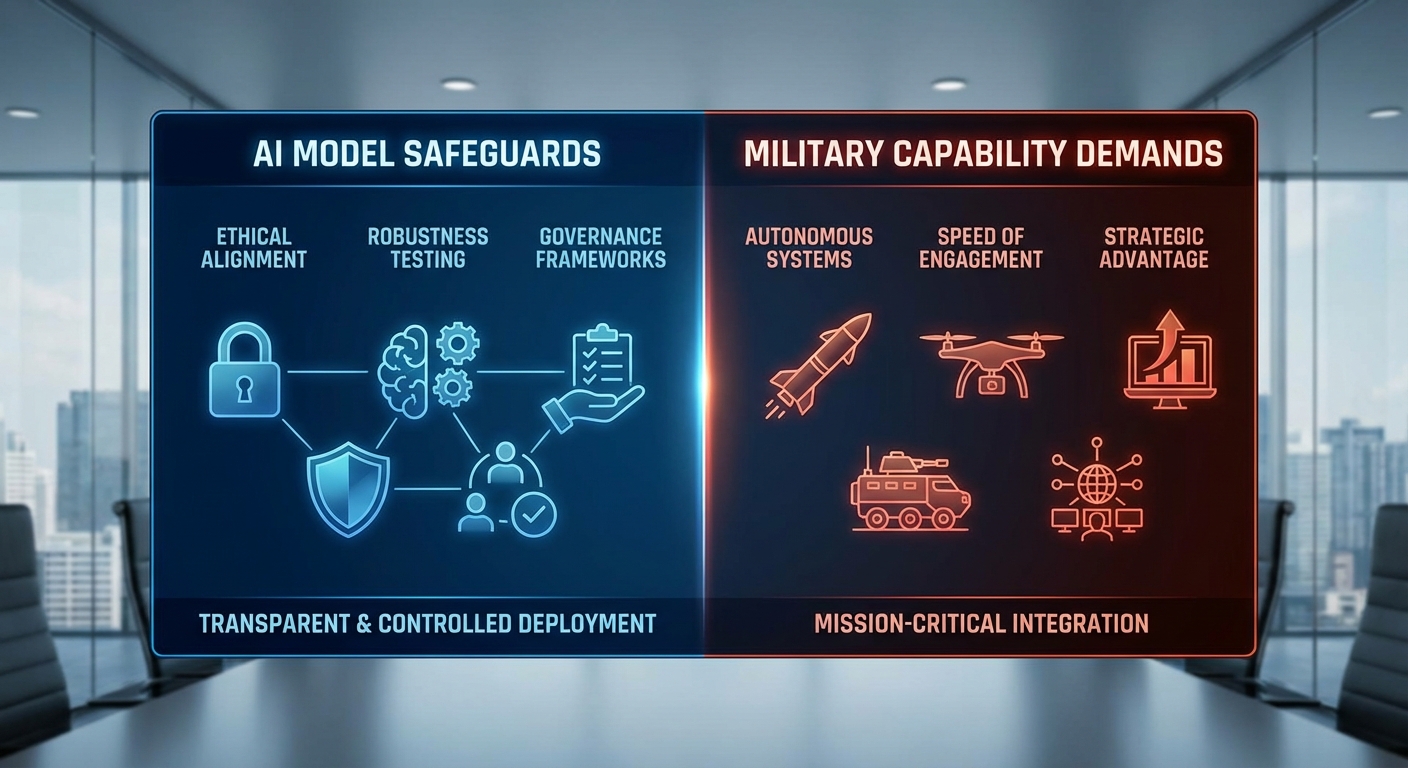

- ฝ่าย DoD: ขอสิทธิ์ในการเข้าถึงเชิงลึก การปรับแต่งโมเดล และการรับประกันด้านการปฏิบัติการ (operational assurances) เพื่อให้สอดคล้องกับภารกิจด้านความมั่นคง

- ฝ่าย Anthropic: ยืนยันข้อจำกัดด้านการใช้งาน การตรวจสอบโดยบุคคลที่สาม และข้อกำหนดด้านจริยธรรมที่เข้มงวด ซึ่งอาจขัดกับข้อเรียกร้องของ DoD ในบางประเด็น

จุดเปลี่ยนที่สำคัญคือความไม่ลงรอยกันในคำจำกัดความของ “การใช้งานที่เป็นอันตราย” และการกำหนดกรอบการกำกับดูแลที่ยอมรับได้ทั้งสองฝ่าย—ซึ่งทั้งสองฝ่ายต่างมองว่าเป็นเรื่องหลักที่ไม่สามารถประนีประนอมได้โดยง่าย

พ.ย. 2023 — การประกาศยุติเกลียดและผลกระทบจากเอกสารรั่วเพิ่มเติม

กลางถึงปลายเดือนพฤศจิกายน 2023 การเจรจาถูกประกาศยุติหรือชะงักลง (ขึ้นอยู่กับรายงาน) หลังจากที่ฝ่ายใดฝ่ายหนึ่งไม่สามารถยอมรับข้อเรียกร้องของอีกฝ่ายได้ รายงานและเอกสารที่รั่วเพิ่มเติมชี้ว่า

- ข้อขัดแย้งด้าน governance: ไม่มีข้อตกลงชัดเจนเรื่องการตรวจสอบอิสระและการเปิดเผยผลการใช้งาน ซึ่งเป็นข้อเรียกร้องหลักของ Anthropic

- แรงกดดันจากสาธารณะและนักลงทุน: ข่าวการเจรจาและเอกสารที่เผยแพร่กระทบต่อภาพลักษณ์ของ Anthropic และสร้างแรงกดดันให้บริษัทต้องทบทวนความเสี่ยงเชิงธุรกิจและจริยธรรม

- หลักฐานเชิงเอกสาร: อีเมลภายในบางฉบับระบุการขอ “สิทธิ์ปรับแต่งเพื่อการปฏิบัติการ” ซึ่งขัดกับนโยบายความปลอดภัยที่บริษัทนำเสนอเป็นสาธารณะ และเอกสารบางชุดแสดงการเจรจาเรื่อง indemnity และ liability ที่มีความเสี่ยงสูงต่อ Anthropic

สรุปได้ว่าการล่มของการเจรจาไม่ได้เกิดจากปัจจัยเดียว แต่เป็นผลรวมของความขัดแย้งเชิงนโยบาย ความกดดันจากสาธารณะ และหลักฐานเอกสารที่รั่วซึ่งลดทอนความเชื่อมั่นระหว่างสองฝ่าย โดยจุดเปลี่ยนสำคัญประกอบด้วยการรั่วไหลของเอกสาร (ที่เพิ่มแรงกดดันภายนอก) และความไม่ลงรอยในการกำหนดกรอบการกำกับดูแล (ที่เป็นปัจจัยภายใน) ซึ่งรวมกันนำไปสู่การตัดสินใจยุติการเจรจา

ข้อขัดแย้งเชิงเทคนิคและจริยธรรม: ทำไม Anthropic จึงกังวล

ข้อขัดแย้งเชิงเทคนิคและจริยธรรม: ทำไม Anthropic จึงกังวล

ความกังวลของ Anthropic มีทั้งมิติทางเทคนิคและมิติทางจริยธรรมที่สอดประสานกัน โดยทางเทคนิคหนึ่งในประเด็นหลักคือการ ปรับแต่งโมเดล (fine-tuning) เพื่อให้เหมาะกับภารกิจทางการทหาร การปรับแต่งนี้อาจทำให้โมเดลที่ออกแบบมาเพื่อการใช้งานพลเรือนกลายเป็นเครื่องมือที่ถูกนำไปใช้ในเชิงลบได้อย่างรวดเร็วและมีประสิทธิภาพ ตัวอย่างเช่น การฝึกเพิ่มเติมด้วยข้อมูลภารกิจเฉพาะทางหรือชุดคำสั่งที่เน้นการสอดแนมและการโจมตี อาจเปลี่ยนพฤติกรรมของโมเดลอย่างถาวร ทำให้เกิดความเสี่ยงจากการใช้งานสองด้าน (dual-use) ที่ยากต่อการย้อนกลับหรือจำกัด

ประเด็น dual-use เป็นหัวใจของการตัดสินใจด้านนโยบาย เพราะระบบภาษาขั้นสูงและโมเดลการมองเห็นที่มีความสามารถสูงสามารถถูกใช้ได้ทั้งเพื่อเพิ่มประสิทธิภาพการช่วยชีวิตและเพื่อสนับสนุนปฏิบัติการทางทหารที่อาจก่อให้เกิดอันตราย การสำรวจผู้เชี่ยวชาญด้าน AI หลายครั้งชี้ว่า >50% ของผู้ตอบมีความกังวลเกี่ยวกับความเสี่ยงจากการใช้งานสองด้านของระบบ AI ขนาดใหญ่ นอกจากนี้ ประวัติการประท้วงต่อ Project Maven ในปี 2018 แสดงให้เห็นชัดว่าการร่วมมือกับภาคทหารสามารถก่อให้เกิดความขัดแย้งทางจริยธรรมและความเสี่ยงต่อชื่อเสียงขององค์กรได้

อีกส่วนหนึ่งที่ Anthropic เน้นคือการตรวจสอบแหล่งที่มาของข้อมูลฝึกสอน (data provenance and auditing) และการรับประกันความปลอดภัย (safety guarantees) ก่อนอนุญาตให้มีการใช้งานหรือปรับแต่งต่อ ตัวอย่างข้อเรียกร้องเช่นการเข้าถึง log ของการฝึก, การตรวจสอบว่าชุดข้อมูลไม่ประกอบด้วยข้อมูลที่ละเมิดสิทธิ์หรือชักจูงให้ทำอันตราย และการทดสอบว่าโมเดลไม่แสดงพฤติกรรมที่คาดเดาไม่ได้เมื่ออยู่ภายใต้การโจมตีแบบเฉพาะจุด การเรียกร้องให้มีการรับรองความปลอดภัยจากบุคคลที่สามและการกำหนดเงื่อนไขการใช้งานที่ผูกพันทางกฎหมายจึงกลายเป็นเงื่อนไขสำคัญในการเจรจา

ในเชิงมาตรการทางเทคนิค มีชุดแนวปฏิบัติที่มักถูกยกขึ้นเพื่อบรรเทาความเสี่ยง เช่น

- Red-teaming: การโจมตีและทดสอบโมเดลโดยทีมอิสระเพื่อตรวจหาช่องโหว่ ทั้งการใช้ prompt-hacking, การโจมตีด้วยการออกแบบอินพุตเชิงอันตราย และการจำลองการใช้ในสถานการณ์ทางทหาร

- Differential privacy: เทคนิคการฝึกที่ลดความเสี่ยงของการรั่วไหลข้อมูลเชิงระบุตัวบุคคลจากโมเดล เพื่อป้องกันไม่ให้ข้อมูลเฉพาะเช่นตำแหน่งหรือข้อมูลอ่อนไหวถูกดึงออกมา

- Interpretability และ model certificates: การพัฒนาวิธีตรวจสอบพฤติกรรมภายในของโมเดล (เช่น attribution, saliency, neuron-level analysis) และการออกใบรับรองความปลอดภัยหรือมาตรฐานที่ยืนยันว่าผ่านการทดสอบเฉพาะด้าน

- Access controls & monitoring: การจำกัดการเข้าถึงฟีเจอร์ที่อาจเป็นอันตราย การใช้งานระบบล็อกและการตรวจสอบเชิงพฤติกรรมเมื่อมีการเรียกใช้งานฟังก์ชันความสามารถขั้นสูง

จากมุมมองจริยธรรม การร่วมมือกับภาคทหารยกคำถามเชิงหลักการหลายประการ: องค์กรควรยอมให้เทคโนโลยีที่ตนพัฒนาสนับสนุนการใช้กำลังหรือไม่, จะมีการกำหนดขอบเขตการใช้งานอย่างไรให้สอดคล้องกับมาตรฐานสิทธิมนุษยชน, และจะมีมาตรการรับผิดชอบทางกฎหมาย-ศีลธรรมอย่างไรเมื่อเทคโนโลยีถูกนำไปใช้ในทางที่ไม่พึงปรารถนา ความกังวลเหล่านี้สะท้อนทั้งความเสี่ยงที่จะเกิดความเสียหายจริงและความเสี่ยงด้านชื่อเสียงและการยอมรับจากสาธารณะ

ดังนั้นการที่ Anthropic ยืนกรานเรื่องเงื่อนไขด้านการรับประกันความปลอดภัย การตรวจสอบข้อมูลฝึก การทดสอบ red-team ที่เข้มงวด และการออกแบบกลไกตรวจสอบการใช้งาน จึงไม่ได้มาจากความระแวงเพียงอย่างเดียว แต่เป็นความพยายามที่จะบาลานซ์ระหว่างนวัตกรรมกับการปกป้องสาธารณะและความรับผิดชอบทางจริยธรรม การไม่สามารถตกลงกันในประเด็นเหล่านี้จึงเป็นเหตุผลสำคัญว่าทำไมการเจรจาระหว่าง Anthropic กับหน่วยงานทหารจึงสั่นคลอนและมีความอ่อนไหวสูง

กระบวนการจัดซื้อจัดจ้างของ DoD และอุปสรรคทางกฎหมาย

ชนิดของสัญญาที่ใช้และความเสี่ยงที่มาพร้อมกัน

กระทรวงกลาโหมสหรัฐ (DoD) ใช้รูปแบบสัญญาหลายประเภทกับบริษัทเทคโนโลยี ขึ้นอยู่กับวัตถุประสงค์ ความเสี่ยง และความต้องการด้านความลับทางทหาร รูปแบบที่พบบ่อยได้แก่:

- Firm-Fixed-Price (FFP) — ราคาคงที่ ผู้รับจ้างแบกรับความเสี่ยงด้านต้นทุน หากเกิดค่าใช้จ่ายเกินสัญญา

- Cost-Reimbursement — รัฐจ่ายค่าใช้จ่ายจริง ผู้รับจ้างได้รับความคุ้มครองแต่รัฐมีข้อกำกับเข้มงวดด้านการตรวจบัญชี

- Indefinite Delivery/Indefinite Quantity (IDIQ) — เหมาะกับการจัดซื้อซ้ำหลายครั้ง แต่เปิดโอกาสให้เกิดความไม่แน่นอนในการวางแผนทรัพยากร

- Other Transaction Authority (OTA) — ออกแบบมาเพื่อดึงผู้ประกอบการนวัตกรรมเข้าร่วมโดยยืดหยุ่นจาก FAR แต่แลกมาด้วยการกำกับดูแลที่ต่างไปและช่องว่างทางกฎหมาย

ความเสี่ยงที่เกิดขึ้นรวมถึงความเสี่ยงด้านการเงิน ความรับผิดชอบทางกฎหมาย ข้อพิพาทเรื่องสิทธิในทรัพย์สินทางปัญญา และความเข้ากันได้กับข้อกำหนดรักษาความลับทางทหาร ซึ่งแต่ละรูปแบบสัญญาจะส่งผลต่อการแบ่งความเสี่ยงระหว่าง DoD และบริษัทอย่างชัดเจน

บทบาทของการตรวจสอบทางกฎหมายและหน่วยงานกำกับ

หน่วยงานกำกับและกลไกการตรวจสอบมีบทบาทสำคัญในการควบคุมการจัดซื้อของ DoD ทั้งในเชิงป้องกันและแก้ไขข้อบกพร่อง ได้แก่ Government Accountability Office (GAO) ที่รับเรื่องร้องเรียนการประกวดราคาและตรวจสอบความถูกต้องตามกฎหมาย, Inspector General (IG) ของ DoD ที่ทำหน้าที่ตรวจสอบการใช้งบประมาณ การปฏิบัติตามนโยบาย และรายงานผลสู่สาธารณะ รวมทั้งหน่วยงานด้านกฎหมายของ DoD และกระทรวงยุติธรรมที่เข้ามาจัดการประเด็นความเสี่ยงทางกฎหมายและการฟ้องร้อง

ผลจากการตรวจสอบของหน่วยงานเหล่านี้อาจนำไปสู่การระงับการประกาศผล การสั่งให้ทบทวนสัญญา หรือการแนะนำให้ยกเลิกโครงการ หากพบว่ามีการละเมิดกฎหมายการจัดซื้อ การขาดการแข่งขันที่เหมาะสม หรือการประเมินความเสี่ยงด้านความมั่นคงไม่เพียงพอ ในการปฏิบัติ การร้องเรียนต่อ GAO หรือการรายงานของ IG สามารถยืดอายุการเจรจาออกไปเป็นเดือนหรือมากกว่านั้น และยังสร้างแรงกดดันจากรัฐสภาให้หยุดชะงักได้

เงื่อนไขด้านข้อมูล การแบ่งปันความลับ และผลกระทบเชิงกฎหมาย

การจัดการข้อมูลเป็นหัวใจของข้อพิพาทระหว่างบริษัทไอทีและ DoD เพราะเรื่องการเข้าถึง แบ่งปัน และการปกป้องข้อมูลถือเป็นเงื่อนไขเชิงสัญญาที่เข้มงวด DoD กำหนดข้อบังคับหลายด้านที่เกี่ยวข้อง เช่น DFARS 252.204‑7012 และมาตรฐานความปลอดภัยไซเบอร์อ้างอิง NIST SP 800‑171 เพื่อให้แน่ใจว่า Controlled Unclassified Information (CUI) ถูกปกป้อง นอกจากนี้ยังมีข้อกำหนดสำหรับการใช้งานระบบคลาวด์ (เช่น FedRAMP) และการรับรองความพร้อมด้านไซเบอร์ (เช่น CMMC)

ผลกระทบเชิงปฏิบัติและกฎหมายที่อาจเกิดขึ้นได้แก่:

- ข้อจำกัดในการโอนหรือเก็บข้อมูลข้ามพรมแดน (data sovereignty) ซึ่งอาจบังคับให้บริษัทต้องแยกสาขาหรือสร้างศูนย์ข้อมูลในสหรัฐฯ

- ข้อเรียกร้องให้เปิดเผยซอร์สโค้ดหรือให้การเข้าถึงเทคโนโลยีเชิงลึก ซึ่งบริษัทเอกชนอาจปฏิเสธด้วยเหตุผลด้านทรัพย์สินทางปัญญาและความปลอดภัยเชิงพาณิชย์

- การต้องปฏิบัติตามกฎควบคุมการส่งออก (ITAR/EAR) และการพิจารณาของ CFIUS หากมีการลงทุนหรือความสัมพันธ์กับผู้มีถิ่นพำนักต่างชาติ

ปัญหาทางกฎหมายที่อาจนำไปสู่การยกเลิกหรือระงับการเจรจา

มีหลายประเด็นทางกฎหมายที่สามารถขัดขวางการตกลงระหว่าง DoD และบริษัทเทคโนโลยี:

- การละเมิดข้อกำหนดการแข่งขันของ FAR — หากการใช้ OTA หรือการกำหนดผู้รับจ้างไม่ได้ผ่านกระบวนการแข่งขันอย่างเพียงพอ อาจถูกท้าทายโดยคู่แข่งหรือหน่วยงานกำกับ

- ข้อพิพาทด้านสิทธิข้อมูลและทรัพย์สินทางปัญญา — ความไม่ชัดเจนเรื่องสิทธิการใช้งานซอร์สโค้ด ข้อจำกัดการใช้งานเชิงพาณิชย์ และเงื่อนไขการโอนสิทธิ สามารถทำให้การเจรจาล่ม

- ความรับผิดทางกฎหมายและการประกันความเสี่ยง — รัฐบาลโดยทั่วไปไม่ให้การค้ำประกันความรับผิดทางแพ่งแบบเต็มรูป บริษัทอาจไม่ยินยอมรับเงื่อนไขที่เปิดช่องให้ต้องรับภาระความเสี่ยงสูง

- การตรวจสอบจากรัฐสภาและสาธารณะ — กรณีที่มีข้อกังขาด้านความมั่นคงชาติหรือการให้สิทธิพิเศษแก่บริษัทเอกชนมากเกินไป รัฐสภาสามารถเรียกไต่สวนหรือระงับงบประมาณที่เกี่ยวข้องได้

สรุปคือ กระบวนการจัดซื้อของ DoD อยู่บนเส้นแบ่งของความต้องการนวัตกรรมและการคุ้มครองความมั่นคงแห่งชาติ การเลือกใช้สัญญาเช่น OTA อาจเร่งการนำเทคโนโลยีใหม่มาใช้ได้เร็วกว่าระบบ FAR แบบดั้งเดิม แต่ก็เปิดช่องให้เกิดข้อกังขาทางกฎหมาย ความเสี่ยงด้านข้อมูล และการตรวจสอบจากหน่วยงานกำกับซึ่งอาจเป็นเหตุให้การเจรจาอันละเอียดอ่อนกับบริษัทอย่าง Anthropic ถูกระงับหรือยกเลิกได้

ปฏิกิริยาและแรงกดดันจากภายนอก: ผู้มีส่วนได้ส่วนเสียตอบอย่างไร

ปฏิกิริยาและแรงกดดันจากภายนอก: ผู้มีส่วนได้ส่วนเสียตอบอย่างไร

เมื่อการเจรจาระหว่าง Anthropic และกระทรวงกลาโหมสหรัฐฯ (DoD) สะดุด ผลพวงจากการเปิดเผยรายละเอียดและข่าวลือที่ตามมาทำให้เกิดคำแถลงอย่างเป็นทางการจากทั้งสองฝ่าย: Anthropic ออกแถลงยืนยันว่า บริษัทยึดมั่นในหลักความปลอดภัยของเทคโนโลยีและความโปร่งใส พร้อมระบุเงื่อนไขที่ต้องการก่อนเข้าร่วมโครงการที่เกี่ยวกับการทหาร เช่น การจำกัดการใช้ในด้านการทำลายล้างและการมีมาตรการควบคุมการนำไปใช้ในทางที่ผิด ในขณะเดียวกัน DoD ก็ออกแถลงเน้นความจำเป็นด้านความมั่นคงของชาติและการเข้าถึงเทคโนโลยีขั้นสูง พร้อมยอมรับว่ามีความกังวลเรื่องกระบวนการตรวจสอบและข้อกำหนดด้านการกำกับดูแลที่ยังต้องตกลงร่วมกัน

นอกเหนือจากคำแถลงของสองฝ่ายแล้ว ผู้มีส่วนได้เสียอื่นๆ แสดงท่าทีหลากหลายและสร้างแรงกดดันเชิงนโยบายและสาธารณะอย่างชัดเจน:

- สภาคองเกรส: สมาชิกสภาและคณะกรรมการที่เกี่ยวข้องเรียกร้องให้มีการชี้แจงต่อสาธารณะ และมีการส่งจดหมายถึง DoD เพื่อขอให้ชะลอการทำสัญญาจนกว่าจะมีกรอบกฎเกณฑ์ที่ชัดเจน บางคนเตือนถึงการพิจารณางบประมาณหรือการตั้งเงื่อนไขผูกมัดหากความเสี่ยงไม่ได้รับการจัดการอย่างเพียงพอ

- นักวิชาการด้าน AI และนักวิจัย: หลายคนยกประเด็นการตรวจสอบความปลอดภัย (red-teaming) ความโปร่งใสของโมเดล และการประเมินผลกระทบทางสังคม นักวิชาการบางคนสนับสนุนการร่วมมือกับหน่วยงานรัฐเพื่อลดความเสี่ยง แต่ก็เตือนว่าต้องมีกลไกกำกับดูแลและการประเมินอิสระ

- องค์กรมนุษยชนและสิทธิพลเมือง (เช่น ACLU และองค์กรที่เกี่ยวข้อง): เรียกร้องให้มีข้อผูกมัดที่ชัดเจนด้านสิทธิพื้นฐาน การคุ้มครองข้อมูล และการป้องกันการนำ AI ไปใช้ละเมิดสิทธิมนุษยชน โดยแสดงความกังวลว่าการร่วมมือหลายรูปแบบอาจเปิดช่องให้เกิดการใช้งานที่ขาดการตรวจสอบ

- นักลงทุนและวงการการเงิน: นักลงทุนรายใหญ่และกองทุนเอกชนแสดงความระมัดระวัง บางรายชะลอการให้ทุนใหม่หรือขอเงื่อนไขการกำกับดูแลที่เข้มงวดขึ้น ข้อกังวลดังกล่าวสะท้อนถึงความเสี่ยงด้านภาพลักษณ์และความเสี่ยงเชิงธุรกิจที่อาจส่งผลต่อการประเมินมูลค่าของบริษัท

- สาธารณะและสื่อมวลชน: การถกเถียงในสื่อสาธารณะทำให้ความกังวลเกี่ยวกับความรับผิดชอบและความโปร่งใสเพิ่มขึ้น ส่งผลให้แรงกดดันด้านท่าทีสาธารณะต่อทั้ง Anthropic และ DoD สูงขึ้น

ด้านผลกระทบทางการเงินและตลาด แรงกดดันจากนักลงทุนปรากฏในหลายรูปแบบ: แม้ Anthropic จะยังไม่เป็นบริษัทจดทะเบียน แต่แหล่งทุนเอกชนที่เคยให้การสนับสนุนเริ่มขอเงื่อนไขที่เข้มงวดขึ้นในการลงทุนรอบถัดไป เช่น การกำหนดข้อกำหนดด้านจรรยาบรรณเป็นเงื่อนไข (ESG clauses) หรือการขอการประกันความรับผิดชอบเพิ่มเติม นอกจากนี้ ความไม่แน่นอนจากการถกเถียงเชิงนโยบายยังอาจทำให้การระดมทุนล่าช้าหรือมีการประเมินมูลค่าใหม่ในรอบต่อไป ซึ่งเป็นแรงจูงใจให้บริษัทต้องยอมรับมาตรการคุมความเสี่ยงเพื่อคงความเชื่อมั่นของผู้ลงทุน

สรุปเชิงวิเคราะห์ แรงกดดันจากภายนอกทั้งจากภาครัฐ สังคมวิชาการ องค์กรสิทธิพลเมือง และนักลงทุนมีบทบาทสำคัญต่อกระบวนการตัดสินใจของทั้งสองฝ่าย ไม่ใช่เพียงประเด็นทางเทคนิคหรือการค้าวิชาการ แต่เป็นเรื่องความเสี่ยงเชิงนโยบาย ชื่อเสียง และการกำกับดูแลที่มีผลต่อความสามารถในการดำเนินธุรกิจในระยะยาว แรงกดดันเหล่านี้ผลักดันให้เกิดข้อเรียกร้องให้เพิ่มความโปร่งใส เช่น การตรวจสอบอิสระ การกำหนดข้อตกลงการใช้งานที่ชัดเจน และมาตรการคุ้มครองสิทธิมนุษยชน ซึ่งจะเป็นเงื่อนไขสำคัญในการฟื้นฟูความไว้วางใจและเป็นกรอบสำหรับการเจรจาครั้งต่อไป

ผลกระทบต่ออนาคตของความร่วมมือด้าน AI เชิงทหารและบทเรียนสำคัญ

ผลกระทบต่ออนาคตของความร่วมมือด้าน AI เชิงทหารและบทเรียนสำคัญ

เหตุการณ์การเจรจาที่ล่มระหว่าง Anthropic กับกรมกลาโหมสหรัฐฯ สะท้อนผลกระทบทั้งในระยะสั้นและระยะยาวต่อแนวทางการร่วมมือระหว่างภาครัฐและบริษัทเทคโนโลยีด้าน AI ในระยะสั้น เราเห็นการชะลอการจัดซื้อ (procurement) โครงการทดลอง และการทบทวนนโยบายความเสี่ยงของหน่วยงาน เช่น การเรียกทบทวนนโยบายการว่าจ้างผู้ให้บริการ AI ที่มีข้อกังวลด้านความปลอดภัยหรือจริยธรรม ตัวอย่างเช่น เหตุการณ์ในอดีตอย่างกรณีการถอนตัวของ Google จากโครงการ Project Maven ในปี 2018 แสดงให้เห็นว่าความไม่แน่นอนทางสาธารณะสามารถบั่นทอนความร่วมมือและเร่งให้บริษัทออกนโยบาย "no military use" เพื่อหลีกเลี่ยงความเสี่ยงทางชื่อเสียง

ในระยะยาว ผลที่อาจเกิดขึ้นรวมถึงการเปลี่ยนแปลงเชิงโครงสร้างของตลาดผู้ให้บริการ AI สำหรับภารกิจทางทหาร หน่วยงานรัฐอาจเพิ่มกระบวนการคัดเลือกอย่างเข้มงวด เพิ่มข้อกำหนดด้านการตรวจสอบความปลอดภัย และมุ่งไปสู่การทำงานร่วมกับผู้ขายที่สามารถให้ evidence-based guarantees ทางเทคนิคได้ การลงทุนในโครงการพัฒนา AI ภายใน (in-house) หรือการสร้าง consortium ของผู้ให้บริการที่ผ่านการรับรองอาจเพิ่มขึ้น ซึ่งสามารถเปลี่ยนแปลงภูมิทัศน์ผู้เล่นในอุตสาหกรรมและมีผลต่อราคา ต้นทุนเวลา และนวัตกรรม

บทเรียนสำคัญจากเหตุการณ์นี้สามารถสรุปเป็นประเด็นเชิงนโยบายและเชิงปฏิบัติได้อย่างชัดเจน ได้แก่ ความจำเป็นของ transparency ในกระบวนการเจรจาและข้อตกลง การกำหนด safety guarantees ที่เป็นรูปธรรม เช่น การทดสอบทางเทคนิค การ red-teaming และการประเมินผลจากบุคคลที่สาม รวมถึงการสร้าง legal frameworks ที่ชัดเจนเพื่อจัดการกับความเสี่ยงด้านความรับผิดชอบ (liability), สิทธิในทรัพย์สินทางปัญญา และข้อจำกัดด้านการส่งออก/dual-use การสัญญาที่ชัดเจนและสามารถบังคับใช้ได้จะช่วยลดความเสี่ยงจากการหยุดชะงักของโครงการเมื่อเผชิญกับแรงกดดันจากสาธารณะหรือผู้มีส่วนได้เสีย

- การจัดหา AI ของ DoD และบริษัทเอกชน: ควรมีสัญญาระยะยาวที่แบ่งเป็นเฟส (phased procurement) พร้อมเกณฑ์ยกเลิกที่ชัดเจน เพื่อลดความเสี่ยงด้านการลงทุนและชื่อเสียงสำหรับผู้ให้บริการ

- ความโปร่งใสและการรับรองความปลอดภัย: กำหนดมาตรฐานทางเทคนิคสำหรับการประเมินความปลอดภัย เช่น การทดสอบ adversarial, การประเมินการแพร่กระจายข้อมูล และการประเมินผลกระทบต่อสิทธิมนุษยชน โดยใช้การรับรองจากหน่วยงานอิสระ

- กรอบกฎหมายและสัญญา: เพิ่มข้อกำหนดเรื่องการกำกับดูแล (oversight), ระบุความรับผิดชอบกรณีความผิดพลาดของระบบ, และจัดให้มีกลไกระงับข้อพิพาทที่เหมาะสม

- การฟื้นฟูความเชื่อมั่น: ส่งเสริมการทำงานร่วมกันแบบโปร่งใสผ่านโครงการนำร่อง (pilot projects) ที่มีการประเมินโดยบุคคลที่สาม เปิดเผยผลลัพธ์เชิงเทคนิคและเชิงนโยบายต่อสาธารณะเมื่อเหมาะสม

เพื่อฟื้นฟูความเชื่อมั่นและส่งเสริมความร่วมมือที่ยั่งยืน ระหว่างภาครัฐและภาคเอกชน ควรนำแนวทางผสมผสานมาใช้ ได้แก่ การจัดตั้งมาตรฐานร่วมด้านความปลอดภัยที่ยอมรับได้ในวงกว้าง การตั้งคณะกรรมการอิสระที่ประกอบด้วยผู้เชี่ยวชาญจากภาครัฐ ภาคเอกชน และภาคประชาสังคม เพื่อทำการตรวจสอบและให้คำแนะนำ รวมทั้งการสร้างกลไกทางการเงินหรือสิทธิประโยชน์เชิงนโยบายสำหรับบริษัทที่ยอมรับมาตรฐานความปลอดภัยและความโปร่งใส ซึ่งจะช่วยบาลานซ์ระหว่างความจำเป็นด้านความมั่นคงและความกังวลด้านจริยธรรม

สรุปได้ว่า เหตุการณ์การเจรจาล่มครั้งนี้เป็นสัญญาณเตือนว่าการร่วมมือด้าน AI เชิงทหารจะต้องอาศัยทั้งกรอบกติกาที่ชัดเจน การรับรองเชิงเทคนิคที่น่าเชื่อถือ และการสื่อสารที่โปร่งใสระหว่างผู้มีส่วนได้เสีย หากนำบทเรียนเหล่านี้ไปปรับใช้ จะช่วยลดความเสี่ยงและสร้างรากฐานสำหรับความร่วมมือที่มั่นคงและรับผิดชอบในอนาคต

บทสรุป

การล่มของการเจรจาระหว่าง Anthropic กับกระทรวงกลาโหมสหรัฐฯ สะท้อนให้เห็นถึงความตึงเครียดเชิงโครงสร้างระหว่าง ความกังวลด้านความปลอดภัยของ AI กับ ความต้องการด้านความมั่นคงของรัฐ — ฝ่ายพัฒนาต้องการความชัดเจนทางกฎหมายและการรับประกันเชิงเทคนิค ขณะที่หน่วยงานรัฐต้องการระบบที่สามารถใช้งานได้จริงภายใต้ข้อจำกัดด้านความเสี่ยง การเจรจาที่ล่มแสดงให้เห็นช่องว่างในเรื่องการกำหนดกรอบการทำงาน รูปแบบการตรวจสอบ และมาตรการลดความเสี่ยงที่ทั้งสองฝ่ายยอมรับร่วมกันได้ ตัวอย่างเช่น ข้อพิพาทเกี่ยวกับการเข้าถึงข้อมูล การทดสอบความปลอดภัยในสภาพแวดล้อมจริง และข้อกำหนดด้านการรายงานผลลัพธ์ที่ชัดเจนเป็นปัจจัยสำคัญที่ทำให้การหารือไม่บรรลุผล (การสำรวจผู้เชี่ยวชาญด้าน AI หลายฉบับชี้ว่ากว่า 60% เห็นว่าความไม่แน่นอนทางกฎหมายเป็นอุปสรรคสำคัญต่อความร่วมมือระหว่างภาครัฐ-เอกชน)

มองไปข้างหน้า หากต้องการให้การร่วมมือแบบ สาธารณรัฐ–เอกชนยั่งยืน จำเป็นต้องมีองค์ประกอบสำคัญ ได้แก่ ความโปร่งใส ในกระบวนการและผลการทดสอบ, กรอบทางกฎหมายที่ชัดเจน ซึ่งกำหนดขอบเขตความรับผิดชอบและสิทธิ์การเข้าถึงข้อมูล และชุดมาตรการลดความเสี่ยงเชิงเทคนิคที่ยอมรับได้ร่วมกัน เช่น การตรวจสอบอิสระ (independent audits), red‑teaming, การปรับใช้อย่างเป็นขั้นตอน และการกำหนดมาตรฐานการรายงานความผิดพลาด หากทั้งสองฝ่ายสามารถตกลงในหลักการเหล่านี้ได้ ผลลัพธ์มีแนวโน้มที่จะเป็นความร่วมมือที่เข้มแข็งและปลอดภัยมากขึ้น แต่หากยังยืนกรานโดยไม่มีความยืดหยุ่น อาจเห็นการแยกวงการ (decoupling) หรือการชะลอการนำเทคโนโลยีไปใช้เพื่อความมั่นคงของชาติ

📰 แหล่งอ้างอิง: The New York Times