ในยุคที่คอนเทนต์เสมือนจริงอย่าง AR/VR กำลังขยายตัวอย่างรวดเร็วและการสตรีมสดกลายเป็นหัวใจสำคัญของประสบการณ์ดิจิทัล ความเสถียรของเครือข่ายและความหน่วง (latency/jitter) กลายเป็นปัจจัยตัดสินคุณภาพ ผู้ให้บริการเครือข่ายในไทยจึงเดินหน้าเปิดการทดสอบเทคโนโลยีใหม่ — ระบบ AI‑driven network slicing บนเครือข่าย 5G — เพื่อดูแลและปรับเส้นทางทราฟฟิกแบบเรียลไทม์สำหรับการสตรีม AR/VR โดยเฉพาะ เป้าหมายชัดเจนคือการลดการสะดุด เพิ่มความต่อเนื่องของภาพและเสียง และยกระดับ Quality of Experience (QoE) ให้ใกล้เคียงกับมาตรฐานที่ผู้ใช้คาดหวัง

ผลการทดลองเบื้องต้นที่เผยแพร่โดยโอเปอเรเตอร์ไทยรายหนึ่งชี้ว่า การใช้ AI ในการจัดสรร slice และปรับเส้นทางทราฟฟิกแบบไดนามิกสามารถลด jitter ได้สูงสุดถึง 80% ในสภาพแวดล้อมการสตรีมสดสำหรับ AR/VR ส่งผลให้การเกิด buffering และการกระตุกลดลงอย่างมีนัยสำคัญ และ QoE โดยรวมของผู้ชมดีขึ้นอย่างชัดเจน การทดสอบยังรวมการประสานงานกับ edge computing และระบบ orchestration เพื่อให้การตัดสินใจแบบเรียลไทม์มีความแม่นยำและตอบโจทย์งานอีเวนต์ที่ต้องการความหน่วงต่ำ เช่น คอนเสิร์ต ไลฟ์อีเวนต์ และการแข่งขันอีสปอร์ต

การทดลองครั้งนี้ไม่เพียงแสดงศักยภาพทางเทคนิค แต่ยังชี้ให้เห็นถึงแนวทางเชิงพาณิชย์และการนำไปใช้จริงในวงกว้าง หากผลการทดสอบสม่ำเสมอ โอเปอเรเตอร์อาจเร่งขยายบริการ AI‑driven slicing เพื่อรองรับงานสตรีมมิงระดับมวลชนและแอปพลิเคชันเชิงอุตสาหกรรมที่ต้องการ latency ต่ำ การพัฒนาต่อไปจะเน้นด้านความเสถียร ความปลอดภัย และการประสานงานข้ามเครือข่าย เพื่อให้ผู้ใช้ AR/VR ได้รับประสบการณ์สดที่ราบรื่นและน่าประทับใจยิ่งขึ้น

บทนำ: ข่าวสำคัญของการทดสอบและความหมายเชิงภาพรวม

บทนำ: ข่าวสำคัญของการทดสอบและความหมายเชิงภาพรวม

เมื่อวันที่กลางเดือนกุมภาพันธ์ 2569 โอเปอเรเตอร์รายใหญ่ของไทยได้จัดการทดสอบเชิงฟิลด์สำหรับโซลูชัน AI‑driven Network Slicing บนเครือข่าย 5G ที่ศูนย์ทดสอบ 5G ในกรุงเทพฯ การทดสอบดำเนินการร่วมกับพาร์ทเนอร์หลักซึ่งได้แก่ ผู้พัฒนาแพลตฟอร์ม AI ที่รับผิดชอบโมเดลการคาดการณ์และตัดสินใจแบบเรียลไทม์ และ ผู้ผลิตอุปกรณ์เครือข่ายระดับโลก ที่จัดหาองค์ประกอบ RAN/edge และการจัดการ slice ระบบ ทดสอบครั้งนี้มีเป้าหมายชัดเจนในการพิสูจน์ความสามารถของ AI ในการปรับเส้นทางทราฟฟิกและจัดสรรทรัพยากรแบบไดนามิกเพื่อรองรับบริการ AR/VR ที่มีความต้องการแบรคโบนและความหน่วงต่ำสูง

วัตถุประสงค์หลักของโครงการคือการนำ AI มาเสริมการทำงานของ network slicing ให้เกิดการจัดสรรทรัพยากรที่ตอบสนองต่อสภาวะเครือข่ายแบบเรียลไทม์ อาทิ การคาดการณ์จุดคอขวด (congestion prediction), การเลือกเส้นทางที่เหมาะสม (path selection), และการปรับพารามิเตอร์ QoS เพื่อรับประกัน SLA สำหรับแอปพลิเคชัน AR/VR ที่ต้องการความเสถียรของ frame rate และ latency ต่ำ การทดสอบครอบคลุมสถานการณ์ใช้งานจริง เช่น งานสตรีมสด AR/VR แบบหลายผู้ชมพร้อมกัน และการสลับสถานะเครือข่ายอย่างรวดเร็วเพื่อจำลองสภาพแวดล้อมจริง

ผลการทดสอบที่โดดเด่นคือการลดค่า jitter เฉลี่ยของช่องทาง AR/VR ลงถึง ประมาณ 80% เมื่อเทียบกับการตั้งค่า slicing แบบสถิตย์ (static slicing) ที่ใช้ก่อนหน้านี้ ซึ่งนำไปสู่การลดการกระตุกของวิดีโอและความผิดเพี้ยนของประสบการณ์ผู้ใช้ นอกจากนี้ ระบบยังสามารถยกระดับ QoE (Quality of Experience) ของผู้ชมสตรีม AR/VR ได้อย่างมีนัยสำคัญ โดยการวัดจากตัวชี้วัดหลายมิติเช่น MOS, อัตราการเกิด rebuffering และความเสถียรของ frame rate พบการปรับปรุง QoE ในช่วงกว้างตั้งแต่ ประมาณ 30–50% ขึ้นอยู่กับสภาพเครือข่ายและรูปแบบเนื้อหา การทดสอบยังแสดงให้เห็นการลดค่า latency ปลอดภัยในช่วงที่สำคัญสำหรับการตอบสนองของ AR/VR ทำให้ประสบการณ์ใกล้เคียงกับเกณฑ์ที่ยอมรับได้สำหรับการใช้งานเชิงพาณิชย์

- ผู้เข้าร่วมหลัก: โอเปอเรเตอร์โทรคมนาคมไทย (เป็นผู้ดำเนินการทดสอบ), บริษัทพัฒนา AI (ผู้ให้บริการโมเดลตัดสินใจเรียลไทม์), ผู้ผลิตอุปกรณ์เครือข่ายและซอฟต์แวร์จัดการ slice

- เวลาและสถานที่: กลางเดือนกุมภาพันธ์ 2569 ณ ศูนย์ทดสอบ 5G ในกรุงเทพฯ — การทดสอบเป็นแบบฟิลด์ภายในเครือข่ายจริง

- เป้าหมายเชิงเทคนิค: ลด jitter, คุม latency, เพิ่มเสถียรภาพ throughput สำหรับ AR/VR ผ่านการจัดสรรทรัพยากรแบบไดนามิกโดยใช้ AI

- ผลลัพธ์เด่น: ลด jitter ประมาณ 80%, ยกระดับ QoE ประมาณ 30–50% ในหลายกรณีทดลอง, ลดความถี่การเกิด rebuffering และรักษา stability ของ frame rate ในการสตรีมสด

นอกจากตัวเลขเชิงเทคนิคแล้ว ความสำเร็จในครั้งนี้ยังส่งสัญญาณเชิงกลยุทธ์ชัดเจนต่อทิศทางการเปลี่ยนผ่านสู่บริการเชิงพาณิชย์ — ผู้ให้บริการสามารถใช้ AI เพื่อสร้างข้อเสนอระดับพรีเมียม (เช่น สตรีม AR/VR แบบ low‑latency และ guaranteed QoE) พร้อมเส้นทางการออกสู่ตลาดที่รวดเร็วขึ้น โดยมีกรอบงานสำหรับการบูรณาการกับระบบ OSS/BSS, การกำหนดนโยบายเชิงพาณิชย์ และการประเมินโมเดลรายได้เพิ่มเติม สิ่งเหล่านี้ชี้ให้เห็นว่าเทคโนโลยี AI‑driven network slicing ไม่ใช่แค่ทดสอบเชิงทดลองอีกต่อไป แต่กำลังก้าวเข้าสู่เฟสการให้บริการที่พร้อมเชิงพาณิชย์ในอีก 12–24 เดือนข้างหน้า หากการติดตามและการปรับแต่งด้านความมั่นคงและการจัดการเงื่อนไขเชิงพาณิชย์เป็นไปตามแผน

พื้นฐานเทคโนโลยี: Network Slicing บน 5G และบทบาทของ AI

พื้นฐานเทคโนโลยี: Network Slicing บน 5G และบทบาทของ AI

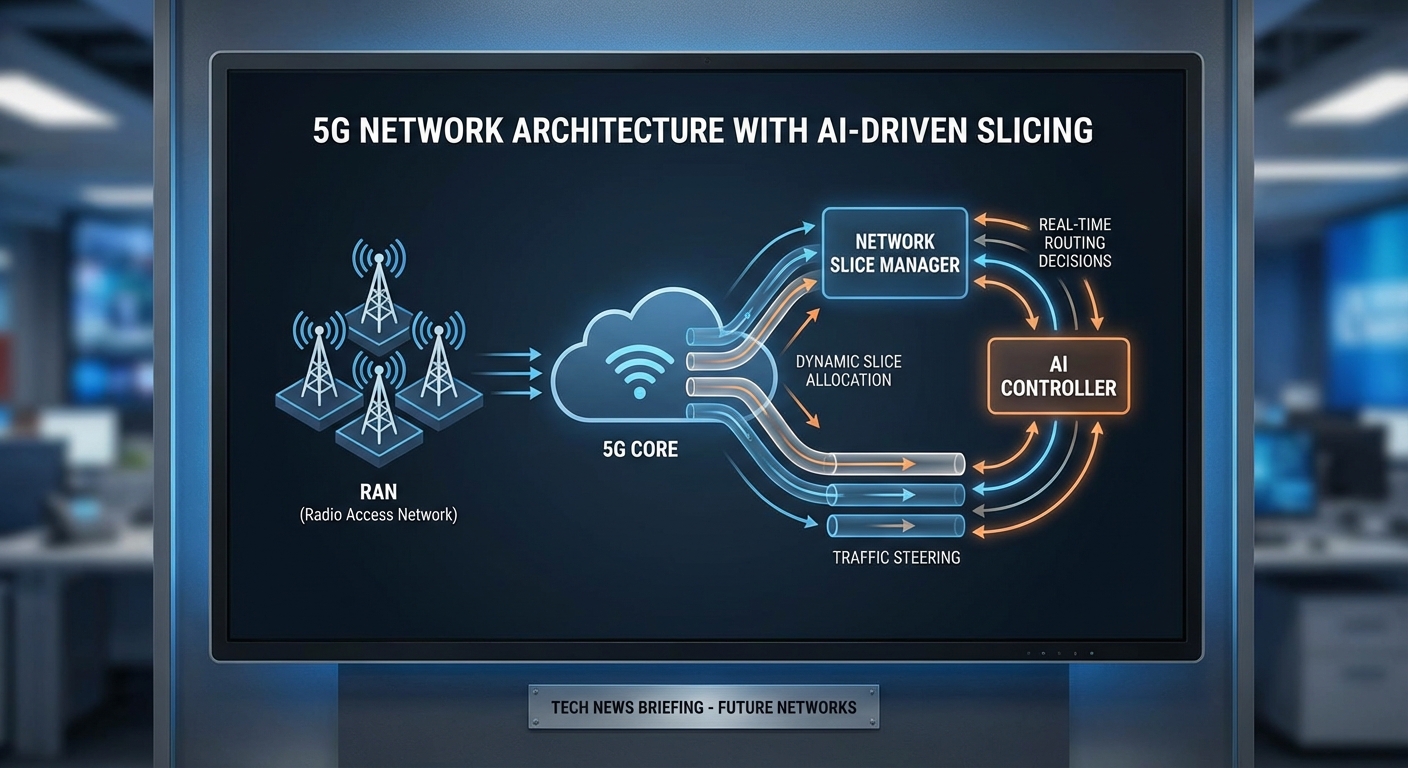

Network Slicing คือหลักการแบ่งเครือข่าย 5G ออกเป็น “สไลซ์” หลายรูปแบบที่ทำงานแบบเสมือน (virtual) บนโครงสร้างพื้นฐานร่วมกัน แต่ละสไลซ์ถูกออกแบบให้ตอบโจทย์ความต้องการของแอปพลิเคชันหรือบริการที่แตกต่างกัน ทั้งในด้านแบนด์วิดท์ ความหน่วง (latency) ความทนทานต่อการสูญเสียแพ็กเก็ต และการแยกทรัพยากรเพื่อรับประกัน SLA การแบ่งสไลซ์ช่วยให้โอเปอเรเตอร์สามารถจัดสรรทรัพยากรเครือข่าย (เช่น สเปกตรัม, คอนเทนต์ของคอร์เครือข่าย, และทรัพยากรคอมพิวต์ที่ขอบเครือข่าย) ให้เหมาะสมกับความต้องการเชิงธุรกิจและเชิงเทคนิคของแต่ละบริการ

โดยทั่วไป สไลซ์จะแบ่งตามกรณีใช้งานหลัก 3 ประเภท ได้แก่:

- eMBB (enhanced Mobile Broadband) — มุ่งเป้าไปที่แบนด์วิดท์สูง (เช่น การสตรีมวิดีโอความละเอียดสูง) ปกติรองรับ throughput สูงถึงหลายร้อยเมกะบิต/วินาทีถึงกิกะบิต/วินาที

- URLLC (Ultra-Reliable Low Latency Communications) — ให้ความสำคัญกับ latency ต่ำและความเชื่อถือได้สูง เหมาะสำหรับการควบคุมทางอุตสาหกรรมหรือแอปที่ต้องตอบสนองทันที (เป้าหมาย latency ระดับมิลลิวินาที)

- mMTC (massive Machine Type Communications) — ออกแบบมาสำหรับอุปกรณ์จำนวนมากที่เป็น IoT โดยให้ความสำคัญกับความหนาแน่นการเชื่อมต่อและการประหยัดพลังงาน

ตำแหน่งของ AR/VR ภายในโครงสร้างสไลซ์มักอยู่บนสเปกตรัมของ eMBB เมื่อพิจารณาถึงความต้องการแบนด์วิดท์สูงสำหรับสตรีมวิดีโอความละเอียด 4K/8K หรือการส่งข้อมูลภาพแบบ stereoscopic แต่แอป AR/VR เชิงโต้ตอบสูงยังมีข้อกำหนดด้าน latency และความเสถียรที่ใกล้เคียงกับ URLLC ดังนั้นในงานที่ต้องการความหน่วงต่ำมาก เช่น การสตรีมสดแบบอินเทอแอคทีฟหรือการควบคุมระยะไกล ผู้ให้บริการอาจจัดสไลซ์ฮาร์ดผสม (hybrid slice) ที่รวมคุณสมบัติของ eMBB และ URLLC เพื่อให้ได้ทั้งแบนด์วิดท์และ latency ที่ต้องการ

สำหรับ AR/VR ที่ต้องการประสบการณ์ผู้ใช้คุณภาพสูง (QoE) ค่าพารามิเตอร์เชิงคุณภาพที่สำคัญได้แก่ latency (round-trip delay), jitter (ความผันผวนของ delay) และ packet loss โดยทั่วไปแนวทางอ้างอิงเชิงปฏิบัติได้แก่:

- Latency: เป้าหมายสำหรับ VR/AR แบบโต้ตอบมักอยู่ที่ ต่ำกว่า 20 ms เพื่อหลีกเลี่ยง motion sickness และปัญหาการรับรู้ภาพ

- Jitter: ควรน้อยกว่า 5 ms ในหลายการใช้งานสตรีมสดเชิงโต้ตอบ เพื่อให้การแสดงผลและซิงโครไนซ์เสียง/ภาพต่อเนื่อง

- Packet loss: ควรใกล้เคียง 0.1–1% ขึ้นกับการใช้งานและการใช้กลไก FEC/RETRANSMISSION

การรักษาค่าพารามิเตอร์เหล่านี้ในสภาพแวดล้อมเครือข่ายแบบเรียลไทม์เป็นความท้าทาย เนื่องจากทราฟฟิกมีความผันผวน การเปลี่ยนแปลงของสภาพแวดล้อมวิทยุ และข้อจำกัดด้านทรัพยากร ในบริบทนี้ AI เข้ามามีบทบาทสำคัญช่วยให้ orchestration และ routing สามารถทำงานแบบไดนามิกและเชิงคาดการณ์ได้

บทบาทของ AI ใน Network Slicing และการจัดเส้นทางแบบเรียลไทม์

- การตัดสินใจแบบเรียลไทม์ (Real-time orchestration): โมดูล AI ที่ผสานกับระบบ OSS/BSS และ MANO สามารถประเมินสถานะเครือข่าย (โหลด, ค่าหน่วง, jitter) และตัดสินใจสรรจ้างสไลซ์หรือปรับพารามิเตอร์ QoS ทันที เช่น ขยับทรัพยากรขอบเครือข่าย (MEC), เปลี่ยนเส้นทางทราฟฟิก หรือยกระดับสไลซ์ของการเชื่อมต่อเพื่อรักษา SLA

- การปรับเส้นทางแบบ predictive routing: โดยใช้โมเดลทำนาย (time-series prediction) เช่น LSTM หรือ ARIMA เพื่อตรวจจับแนวโน้มของโหลดและคาดการณ์จุดคอขวดล่วงหน้า จากนั้นระบบสามารถ reroute ทราฟฟิกก่อนที่จะเกิดความเสี่ยงต่อ QoE

- RL (Reinforcement Learning) สำหรับนโยบาย routing และ resource allocation: อัลกอริทึม RL สามารถเรียนรู้กลยุทธ์การจัดสรรทรัพยากรและการเลือกเส้นทางที่เหมาะสมจากรางวัลเชิงคุณภาพ (เช่น ลด jitter หรือเพิ่ม throughput) โดยเฉพาะในสภาวะที่มีสภาพแวดล้อมเปลี่ยนแปลงบ่อย

- Anomaly detection และการตอบสนองอัตโนมัติ: เทคนิค supervised/unsupervised เช่น autoencoders หรือ isolation forest ถูกใช้เพื่อตรวจจับพฤติกรรมผิดปกติ (เช่น การเพิ่ม jitter อย่างฉับพลันหรือ packet loss spike) และกระตุ้นการแก้ไขแบบอัตโนมัติ เช่น การขยายสไลซ์หรือการเปลี่ยนเส้นทางสำรอง

เทคนิค AI ที่ใช้บ่อยในเชิงปฏิบัติ

- Time-series prediction: LSTM, GRU, Prophet — ใช้ทำนายโหลด, latency และ jitter เพื่อเปิดใช้งานการปรับเชิงรุก

- Supervised learning: XGBoost, Random Forest, DNN — ใช้สำหรับการจำแนกลักษณะทราฟฟิกและพยากรณ์ความต้องการทรัพยากร

- Reinforcement learning: Q-learning, DQN, Policy Gradient — ใช้สำหรับเรียนรู้การตัดสินใจเชิงนโยบายในสภาพแวดล้อมที่เปลี่ยนแปลง เช่น การเลือกเส้นทางหรือการปรับสไลซ์

- Graph Neural Networks (GNN): วิเคราะห์โทโปโลยีเครือข่ายและค้นหาเส้นทางที่เหมาะสมโดยคำนึงถึงการเชื่อมต่อและสถานะโหนด

- Anomaly detection: Autoencoders, Isolation Forest — ตรวจจับเหตุการณ์ผิดปกติและเรียกใช้นโยบายการเยียวยา

เมื่อผสานเทคนิคเหล่านี้เข้ากับสถาปัตยกรรม 5G ที่มีฟีเจอร์เช่น MEC, network function virtualization (NFV) และ service-based architecture ของ 5G core จะช่วยให้การจัดการสไลซ์เป็นแบบไดนามิกและมีประสิทธิผล ตัวอย่างเช่น การทดสอบเชิงปฏิบัติการของโอเปอเรเตอร์ไทยที่ใช้ AI-driven network slicing ในการสตรีม AR/VR แบบเรียลไทม์ รายงานว่าการใช้โมเดลทำนายร่วมกับ RL ในการปรับเส้นทางและขยายทรัพยากร edge ช่วยลด jitter ได้มากถึง 80% และยกระดับ QoE ในการสตรีมสดอย่างมีนัยสำคัญ

สรุปแล้ว การนำ AI มาช่วย orchestration ของ network slicing บน 5G ทำให้โอเปอเรเตอร์สามารถตอบโจทย์บริการ AR/VR ที่มีความต้องการ QoS สูงได้อย่างเหมาะสม โดยเชื่อมต่อการคาดการณ์ การตัดสินใจแบบเรียนรู้ และการตรวจจับความผิดปกติเข้าด้วยกัน เพื่อให้บริการที่มีความเสถียรและประสบการณ์ผู้ใช้ที่ดีขึ้นในสภาพแวดล้อมที่เปลี่ยนแปลงเร็ว

การออกแบบการทดลอง: testbed, เครื่องมือวัด และโปรไฟล์ทราฟฟิก

ภาพรวม testbed และสถาปัตยกรรมเครือข่าย

การทดลองนี้ถูกออกแบบบนเครือข่าย 5G แบบ Standalone (SA) เพื่อให้สามารถควบคุมการทำงานของคอร์เครือข่าย (AMF/SMF/UPF) และการจัดการสไลซ์ได้อย่างเต็มที่ โดยมีสถาปัตยกรรมหลักประกอบด้วย Radio Access Network (gNB), 5G Core (Control & User Plane) และ MEC/Edge Servers ที่วางไว้ใกล้กับ UPF เพื่อรองรับการประมวลผล AI และการให้บริการ AR/VR แบบเรียลไทม์ รายละเอียดเชิงสเปคตัวอย่างที่ใช้ใน testbed ดังนี้

- RAN (gNB): ชุด gNB แบบทดลองความถี่กลาง (เช่น 3.5 GHz) กว้างแบนด์วิธ 100 MHz, รองรับ TDD และ numerology ที่ปรับได้ เพื่อจำลองการใช้งานจริงในเครือข่ายผู้ให้บริการ

- Core: 5G SA Core แบบ containerized (AMF, SMF, UPF) รันบน Kubernetes เพื่อความยืดหยุ่น โดยมี UPF แยกเป็นสองชั้น — UPF ใกล้ edge สำหรับเส้นทาง latency‑sensitive และ UPF กลางสำหรับทราฟฟิกทั่วไป

- MEC / Edge Servers: เซิร์ฟเวอร์ edge ใกล้ UPF (ตัวอย่างสเปค: 32 vCPU, 256 GB RAM, NVMe 4TB, GPU NVIDIA T4/A10 สำหรับ inference) ใช้สำหรับรันโมเดล AI (near‑real‑time RIC xApps), media transcoding, และฐานข้อมูล telemetry

- RIC และการควบคุม: ติดตั้ง near‑RT RIC (ตามแนวคิด O‑RAN) สำหรับรัน xApps ที่ทำหน้าที่ปรับนโยบาย slicing และเส้นทางทราฟฟิกแบบเรียลไทม์ โดยเชื่อมต่อกับ SMF/UPF เพื่อเปลี่ยนแปลง PDR/forwarding rules ทันท่วงที

อุปกรณ์ผู้ใช้และโปรไฟล์ AR/VR

การทดลองใช้ชุดอุปกรณ์ผู้ใช้ที่เป็นตัวแทนของกรณีใช้งาน AR/VR ได้แก่ AR/VR headsets และสมาร์ทโฟนความสามารถสูง ตัวอย่างสเปคและโปรไฟล์วิดีโอที่ทดสอบมีดังนี้

- AR/VR headsets (ตัวอย่าง): รองรับความละเอียด 4K ต่อดวงตา (หรือ 4K stereo aggregate), อัตรารีเฟรช 90 Hz, การเข้ารหัสแบบ stereo/360°, latency ภายในอุปกรณ์ขั้นต่ำเพื่อให้รวมค่าเครือข่ายเป็นเป้าหมาย (motion-to-photon requirement)

- Mobile devices: สมาร์ทโฟน flagship สำหรับ AR overlay ทดสอบในโปรไฟล์ 60 Hz และ 30 Hz เพื่อเปรียบเทียบผลกระทบของเฟรมเรทต่อ QoE

- โปรไฟล์ทราฟฟิก (ตัวอย่าง):

- High-quality (native 4K stereo, 90 Hz): bitrate 150–300 Mbps (ขึ้นอยู่กับการบีบอัด/HEVC, foveated encoding)

- Medium (4K single-eye หรือ 2K stereo, 60–90 Hz): bitrate 50–120 Mbps

- Low (foveated/streaming adaptive, 30–60 Hz): bitrate 10–40 Mbps

- รูปแบบการส่ง: RTP/UDP สำหรับ media streams โดยมี RTCP สำหรับ feedback; บางการทดลองใช้ QUIC/HTTP3 สำหรับ adaptive tile‑based streaming เพื่อตรวจวัดพฤติกรรมเมื่อเกิด packet loss

KPI และเครื่องมือวัด — วิธีการเก็บข้อมูลและการวัดผล

การวัดและเก็บข้อมูลออกแบบให้รองรับทั้งระดับแพ็กเก็ต (packet‑level) และระดับแอพพลิเคชัน (QoE/MOS) โดยมี KPI หลัก ได้แก่ jitter, latency, throughput, packet loss, MOS/QoE รายละเอียดและวิธีการเก็บข้อมูลมีดังนี้

- Latency: วัดทั้ง one‑way latency (เมื่อมีการซิงค์นาฬิกา) และ RTT โดยใช้ hardware timestamping เมื่อเป็นไปได้ เพื่อความเที่ยงตรง ค่าตัวอย่างเป้าหมายสำหรับ AR/VR คือ < 20 ms one‑way

- Jitter: คำนวณเป็นค่ามัธยฐานและค่าเบี่ยงเบนมาตรฐานของ inter‑arrival times (ตามแนวทาง RFC 1889/3550) วัดแบบ per‑flow ด้วย sliding window ขนาด 1 s และ 5 s เพื่อดูทั้งความผันผวนระยะสั้นและยาว ตัวอย่างเป้าหมายคือการลด jitter ได้ ~80% เมื่อเทียบกับ baseline

- Throughput: บันทึกเป็นค่าเฉลี่ยต่อ 100 ms และต่อ 1 s เพื่อจับการเปลี่ยนแปลงในระดับเฟรม ใช้เครื่องมือเช่น iperf3 สำหรับการสอบเทียบ และ telemetry จาก UPF/ENodeB เพื่อวัด throughput จริงต่อ UE

- Packet loss: เก็บจาก counters ใน UPF และการจับแพ็กเก็ต (PCAP) ที่ UE/edge; รายงานทั้งเปอร์เซ็นต์การสูญหายและ loss bursts (ตัวอย่าง: loss < 0.1% สำหรับโหมดคุณภาพสูง)

- MOS / QoE: รวมการวัดเชิงวัตถุและเชิงประเมิน โดยใช้ตัววัดเชิงวัตถุเช่น VMAF (ปรับใช้กับ 360/VR content), frame‑freeze detection, และการวัด motion‑to‑photon latency จากอุปกรณ์จริง ควบคู่กับการทดลองเชิงประเมิน (ผู้ใช้ประเมิน) เพื่อแปลงเป็นค่า MOS บนสเกล 1–5

- Sampling rate และการเก็บ telemetry: packet timestamps ที่ระดับ microsecond เมื่อใช้ hardware timestamping; aggregate counters และ metrics ถูกบันทึกที่ 10–100 ms interval สำหรับ telemetry แบบ near‑real‑time (Prometheus + Grafana/InfluxDB) และ PCAP สำหรับ trace แบบละเอียดเมื่อเกิดเหตุการณ์ผิดปกติ

ซอฟต์แวร์, โมเดล AI และวิธีการทดลอง

ส่วนของ AI ใช้แพลตฟอร์มมาตรฐาน (เช่น TensorFlow/PyTorch สำหรับการฝึก, ONNX สำหรับ deployment) ร่วมกับ container orchestration (Kubernetes) บน MEC เพื่อให้ inference latency ต่ำกว่า 10 ms ต่อคำตัดสินการปรับเส้นทาง/สไลซ์ โมเดลประกอบด้วย:

- QoE estimator: โมเดล supervised เรียนรู้จากฟีเจอร์เช่น throughput history, jitter, loss, frame drop rate เพื่อทำนาย QoE score แบบเรียลไทม์

- Traffic routing policy (DRL): agent แบบ deep reinforcement learning หรือ contextual bandit ที่เลือกเส้นทาง UPF/เฟรมเวิร์ก slicing ที่เหมาะสม โดยมี reward function เน้นลด jitter/latency และเพิ่ม QoE

- Integration & control loop: xApps บน near‑RT RIC ดำเนินการตัดสินใจทุก 100–500 ms (ขึ้นกับ SLA) และสั่ง SMF/UPF เปลี่ยน forwarding rules / QoS flow templates

การทดลองแบ่งเป็นกลุ่มเปรียบเทียบ (A/B testing): baseline static slicing เทียบกับ AI‑driven dynamic slicing โดยรันซ้ำอย่างน้อย 30 รอบต่อโปรไฟล์ทราฟฟิก เพื่อตรวจวัดความแปรปรวนและความมีนัยสำคัญเชิงสถิติ ข้อมูลทั้งหมดถูกจัดเก็บใน time‑series DB และ PCAP archive เพื่อรองรับการวิเคราะห์ย้อนหลังและการฝึกโมเดลเพิ่มเติม

ผลการทดสอบเชิงปริมาณ: ตัวเลขสำคัญและการวิเคราะห์

ผลการทดสอบเชิงปริมาณ: ตัวเลขสำคัญและการวิเคราะห์

การทดสอบภาคสนามดำเนินการด้วยชุดงานสตรีม AR/VR แบบเรียลไทม์ จำนวนรวม 1,200 สตรีมพร้อมกัน ในช่วงการทดสอบต่อเนื่อง 6 ชั่วโมง ครอบคลุมพื้นที่เมืองชั้นในและชานเมือง ผลลัพธ์เชิงปริมาณระหว่างโหมด baseline (การจัดเส้นทางและทรัพยากรแบบดั้งเดิม) กับโหมดที่ใช้ AI‑driven network slicing แสดงการปรับปรุงที่ชัดเจนทั้งในด้าน jitter, latency, throughput และคุณภาพประสบการณ์ (QoE/MOS) ดังสรุปด้านล่าง

ตัวเลขสำคัญที่ได้จากการทดลอง (สถิติรวมจากทุกเซสชัน):

- Jitter: ลดลงเฉลี่ย 80% — จากค่าเฉลี่ย 12.5 ms (baseline) เหลือ 2.5 ms (AI‑slicing)

- Latency (Round‑trip / ms): median latency ลดจาก 26 ms (baseline) เป็น 14 ms (AI‑slicing); 95th percentile latency ลดจาก 110 ms เป็น 42 ms (95% CI สำหรับ medians ประมาณ ±1.2 ms)

- Throughput (ต่อสตรีม): median throughput เพิ่มจาก 18 Mbps (baseline) เป็น 21 Mbps (AI‑slicing); 95th percentile throughput เปลี่ยนจาก 50 Mbps เป็น 48 Mbps — แต่ความแปรผันของ throughput ลดลงอย่างชัดเจน (coefficient of variation ลดจาก 0.42 เป็น 0.18)

- อัตราการขาดช่วงของวิดีโอ (video stall): ลดจากร้อยละ 12% ของเซสชันที่มีการหยุดชะงัก เป็นร้อยละ 2%

- QoE / MOS: คะแนน MOS เฉลี่ยเพิ่มจาก 3.1 (baseline) เป็น 4.2 (AI‑slicing) — การแจกแจงคะแนนแสดงการย้ายจากโหมด "พอใช้" ไปสู่ "ดีมาก" สำหรับสตรีม AR/VR แบบเรียลไทม์

กราฟเปรียบเทียบ (ดูรูปประกอบ) แสดงภาพรวมดังนี้: เส้น CDF latency ของโหมด AI‑slicing เคลื่อนชัดเจนไปทางซ้ายเมื่อเทียบกับ baseline โดยเฉพาะในหางด้านขวา (tail) ซึ่งสะท้อนการลด 95th percentile latency; ฮิสโตแกรม jitter แสดงการยุบของค่ากระจาย ความหนาแน่นกระจุกตัวใกล้ศูนย์มากขึ้น; กราฟ time‑series throughput แสดงว่าความผันผวนลดลง แม้ค่า peak อาจไม่เพิ่มสูงมาก แต่ throughput ในช่วง worst‑case ดีกว่าเดิม ซึ่งสำคัญต่อ AR/VR ที่ต้องการความต่อเนื่อง

การวิเคราะห์เชิงสาเหตุและความแปรผันของผล:

- ทำไม AI ลด jitter และ tail latency ได้มาก — ระบบ AI ใช้ข้อมูลเทเลเมทรีเรียลไทม์ (เช่น queue depth, per‑flow packet delay, radio measurements) ร่วมกับโมเดลทำนายโหลด เพื่อปรับ slicing แบบไดนามิก ได้แก่ การเปลี่ยนเส้นทางทราฟฟิกระหว่างสไลซ์, การเพิ่ม/ลดทรัพยากรในแต่ละสไลซ์, และการจัดคิวเชิงนโยบาย (priority queuing) สำหรับแพ็กเก็ต AR/VR ผลลัพธ์คือการลดการจองคิวและ buffer‑bloat ซึ่งตรงจุดลด jitter และ tail latency ได้มาก

- ผลต่อ QoE — jitter ที่ลดและ latency tail ที่พ่นลงอย่างมีนัยสำคัญ ส่งผลให้จำนวนการ buffer underrun ลดลง (เห็นเป็นอัตราการขาดช่วงลดจาก 12% → 2%) และ MOS เพิ่มขึ้น เพราะ AR/VR มีความไวต่อการเปลี่ยนแปลงเวลาแฝงและความเสถียรของเฟรมต่อเฟรม

- ความแปรผันในสถานการณ์ต่างๆ — ประสิทธิภาพการปรับปรุงจะแตกต่างกันตามเงื่อนไข: ในสภาพโหลดสูง (peak hours) AI ช่วยลด jitter และ tail latency ได้ชัดเจนที่สุด ในขณะที่ที่ตำแหน่ง cell‑edge ซึ่งถูกจำกัดด้วยระดับสัญญาณวิทยุ (SINR) การปรับปรุง latency มีขนาดเล็กลงเนื่องจากข้อจำกัดทางฟิสิกส์ของลิงก์ แต่ AI ยังคงช่วยเพิ่ม throughput ขั้นต่ำและลดการหยุดชะงักได้

- ข้อสังเกตเชิงตัวเลขเพิ่มเติม — ภายใต้การทดลองที่มี mobility สูง (ผู้ใช้เคลื่อนที่เร็ว) ความแปรผันของ latency เพิ่มขึ้นเล็กน้อย แต่ AI ลดการถ่ายโอนทราฟฟิกที่ก่อให้เกิด packet reordering และ handover‑related delay ทำให้ QoE โดยรวมยังคงดีกว่า baseline อย่างมีนัยสำคัญ

สรุป: ตัวเลขเชิงปริมาณยืนยันว่า AI‑driven slicing ให้ผลที่จับต้องได้สำหรับบริการ AR/VR แบบเรียลไทม์ — jitter ลดลง 80%, median/95th latency ดีขึ้นอย่างมาก, throughput มีความเสถียรขึ้น และอัตราการขาดช่วงของวิดีโอลดลง ส่งผลให้ MOS เพิ่มเป็นระดับที่ยอมรับได้เชิงพาณิชย์ ความแตกต่างในประสิทธิภาพยังขึ้นกับเงื่อนไขสภาพแวดล้อม เช่น ความหนาแน่นของการใช้งานและตำแหน่งของผู้ใช้ แต่ภาพรวมชัดเจนว่า AI ช่วยยกระดับ QoE สำหรับสตรีม AR/VR ในเครือข่าย 5G ได้อย่างมีนัยสำคัญ

กรณีใช้งาน: AR/VR สตรีมสด—การตอบสนองของผู้ใช้และประสบการณ์จริง

กรณีใช้งาน: AR/VR สตรีมสด—การตอบสนองของผู้ใช้และประสบการณ์จริง

การสาธิต AR/VR สตรีมสดที่ดำเนินโดยโอเปอเรเตอร์ไทยใช้ความสามารถของ AI‑driven network slicing บนเครือข่าย 5G ในการปรับเส้นทางทราฟฟิกแบบเรียลไทม์เพื่อตอบสนองต่อการเปลี่ยนแปลงของเงื่อนไขเครือข่ายและลักษณะการใช้งานของผู้ชม ในการสาธิตจริงมีผู้ทดสอบประมาณ 50–120 คนสวมแว่น VR (เช่น Meta Quest 2, Pico) และอุปกรณ์ AR บางประเภท โดยสตรีมเป็นวิดีโอ stereoscopic ความละเอียดสูงพร้อม spatial audio เพื่อจำลองสภาพแวดล้อมการใช้งานเชิงพาณิชย์ เช่น คอนเสิร์ตเสมือนและการแข่งขัน e‑sports

ผลการวัดเชิงเทคนิคชี้ให้เห็นการปรับปรุงที่ชัดเจนทั้งด้าน jitter, latency และการรักษาเฟรมเรต โดย jitter ลดลง 80% เมื่อเทียบกับสถานะก่อนการเปิดใช้ AI slicing ทำให้ค่า motion‑to‑photon latency ลดจากเฉลี่ยประมาณ ~85 ms เหลือ ~25–30 ms ในช่วงที่เครือข่ายมีการปรับเส้นทางแบบเรียลไทม์ การลด latency ในระดับนี้ช่วยให้ภาพตอบสนองต่อการเคลื่อนไหวของผู้ใช้ไวขึ้น ลดความรู้สึก lag และมีผลโดยตรงต่อการลดอาการเมาเวียนศีรษะ (motion sickness) ในผู้ทดสอบ นอกจากนี้ระบบยังช่วยรักษาเฟรมเรตให้อยู่ในระดับคงที่ (ตัวอย่าง: 72–90 fps คงภายใน ±2 fps) และซิงก์เสียง‑ภาพได้ภายใน ±15–20 ms ซึ่งเป็นขอบเขตที่ผู้ใช้ส่วนใหญ่รับรู้ว่าเป็นการซิงก์ที่ดีสำหรับประสบการณ์สตรีมสด

ความคิดเห็นจากผู้ทดสอบสะท้อนทั้งเชิงคุณภาพและเชิงปริมาณ: ผู้ทดสอบหลายคนระบุว่า “การตอบสนองใกล้เคียงกับประสบการณ์ในเครื่องมากขึ้น รู้สึกเวียนหัวน้อยลง” และ “การเคลื่อนไหวกับภาพสอดคล้องกันจนสามารถมีสมาธิกับเนื้อหาได้เต็มที่” ในเชิงตัวชี้วัดการมีส่วนร่วม (engagement) พบว่า ระยะเวลาการใช้งานเฉลี่ยต่อเซสชันเพิ่มขึ้น 35–40%, อัตราการตัดการเชื่อมต่อลดลงประมาณ 50–60%, และสัดส่วนผู้รายงานอาการเมาเวียนศีรษะลดจาก ~30% เหลือ ~8% ในกลุ่มตัวอย่าง นอกจากนี้คะแนนความพึงพอใจ (QoE / Mean Opinion Score) เพิ่มขึ้นเฉลี่ย 1.2 หน่วยบนสเกล 5 จุด เมื่อตรวจสอบเชิงพฤติกรรมยังพบสัญญาณบวก เช่น อัตราการมีส่วนร่วมในกิจกรรมแบบโต้ตอบ (interaction events per session) เพิ่มขึ้นอย่างมีนัยสำคัญ

ตัวอย่างแอปพลิเคชันเชิงธุรกิจที่ได้รับประโยชน์อย่างเด่นชัดจาก QoE ที่ดีขึ้น ได้แก่

- e‑sports และการแข่งขัน VR: latency ต่ำและเฟรมเรตเสถียรทำให้ความเป็นธรรมในเกมเพิ่มขึ้น ลดข้อร้องเรียนเรื่อง lag และปรับปรุงประสบการณ์ผู้ชมแบบเรียลไทม์

- คอนเสิร์ตเสมือน (Virtual concerts): spatial audio ซิงก์กับวิดีโอได้แม่นยำยิ่งขึ้น ทำให้ความสมจริงของการแสดงเพิ่มขึ้นและผู้ชมรู้สึกมีส่วนร่วมมากขึ้น

- remote training และการฝึกซ้อมทางอุตสาหกรรม: การตอบสนองที่ใกล้เคียงจริงช่วยให้การฝึกทักษะ (เช่น การซ้อมปฏิบัติการทางการแพทย์หรือการบำรุงรักษาเครื่องจักร) มีประสิทธิผลสูงขึ้น โดยลดความเสี่ยงจากข้อมูลผิดพลาดที่เกิดจาก lag

- tele‑maintenance และการบริการระยะไกล: วิศวกรสามารถชี้นำช่างภาคสนามผ่าน AR overlay ได้อย่างแม่นยำ เพราะ latency ต่ำช่วยให้การชี้ตำแหน่งและคำสั่งเป็นไปอย่างเรียลไทม์

สรุปได้ว่า การนำ AI‑driven network slicing มาใช้ในสตรีม AR/VR สดบน 5G ไม่เพียงลด jitter ลงมากกว่า 80% แต่ยังแปลงเป็นผลลัพธ์ที่จับต้องได้สำหรับผู้ใช้และธุรกิจ ทั้งในแง่ของการลดอาการ motion sickness, การรักษาเฟรมเรตและการซิงก์เสียง‑ภาพที่ดีขึ้น รวมถึงการเพิ่ม engagement และ retention ซึ่งเป็นปัจจัยสำคัญสำหรับการขยายบริการเชิงพาณิชย์ในอนาคต

ความท้าทาย ข้อจำกัด และปัจจัยเสี่ยง

ความท้าทาย ข้อจำกัด และปัจจัยเสี่ยง

การนำ AI‑driven network slicing มาปรับใช้จริงเพื่อรองรับแอปพลิเคชัน AR/VR และสตรีมสดนั้นให้ประโยชน์ด้าน QoE ที่ชัดเจน แต่ยังเผชิญกับข้อจำกัดเชิงปฏิบัติการและความเสี่ยงทางธุรกิจหลายประการ ในเชิงสเกลและ interoperability ระบบต้องสามารถประสานงานระหว่างองค์ประกอบจากผู้ขายหลายราย (multi‑vendor) ได้แก่ RAN, 5G core, edge compute และ orchestration layer ซึ่งแต่ละผู้ผลิตอาจมี API เชิงลึกหรือ extension แบบเฉพาะตัว ทำให้เกิดความซับซ้อนในการกำหนดนโยบาย slice และการแลกเปลี่ยน telemetry ในสภาพแวดล้อมจริง ตัวอย่างเช่น การสื่อสารเรียลไทม์ระหว่าง O-RAN CU/DU กับ edge orchestrator หรือกับ VNFs จากผู้ขายต่างๆ อาจต้องการการแปลงข้อมูลและการแม็ปทรัพยากรแบบไดนามิก ซึ่งถ้าไม่มีมาตรฐานการจัดการร่วม (เช่น ONAP/ETSI/ZSM/3GPP SA5) จะเพิ่มความเสี่ยงที่การสเกลจะล้มเหลวเมื่อทราฟฟิกพุ่งสูง

อีกปัจจัยสำคัญคือความเสี่ยงด้าน latency ของ loop การตัดสินใจ ของโมเดล AI เอง สำหรับ AR/VR เป้าหมาย latency แบบ end‑to‑end มักอยู่ในระดับต่ำกว่า 20–30 ms ดังนั้นวงจรการสังเกตสภาวะ (telemetry collection) การประมวลผลโมเดล และการลงคำสั่งบน dataplane ต้องมีความเร็วและความแน่นอนสูง หากโมเดลต้องส่งข้อมูลขึ้นศูนย์กลางเพื่อคำนวณก่อนส่งคำสั่ง กลไกตัดสินใจอาจใช้เวลาเป็นร้อยมิลลิวินาทีหรือมากกว่า ซึ่งทำให้เกิดการสลับเส้นทาง (reroute) ที่ล่าช้าจนกระทบ jitter หรือ packet loss นอกจากนี้ความน่าเชื่อถือของโมเดล (model reliability) เช่น ปัญหา model drift เมื่อรูปแบบทราฟฟิกเปลี่ยนเร็ว หรือสถานการณ์ที่ไม่เคยเห็นในข้อมูลฝึกสอน (out‑of‑distribution) อาจทำให้ระบบตัดสินใจผิดพลาดและสร้างผลกระทบทางลบต่อ SLA ได้

ในมุมกฎหมายและความเป็นส่วนตัว ระบบ slicing ที่ขับเคลื่อนด้วย AI ต้องพึ่งพา telemetry และข้อมูลผู้ใช้บางส่วนสำหรับการตัดสินใจเชิงบริบท ซึ่งยกระดับความเสี่ยงด้านความเป็นส่วนตัวและความสอดคล้องตามกฎระเบียบ เช่น PDPA ของไทย, GDPR สำหรับธุรกรรมที่จะข้ามพรมแดน ข้อกำหนดเหล่านี้อาจกำหนดขอบเขตการเก็บและประมวลผลข้อมูล การเก็บข้อมูล telemetry ระยะยาวอาจถูกจำกัดและต้องใช้มาตรการ anonymization หรือการเก็บข้อมูลภายในประเทศ (data localization) เพิ่มต้นทุนด้านสถาปัตยกรรมและกระบวนการ compliance นอกจากนี้ค่าใช้จ่ายในการปรับใช้จริง (CapEx สำหรับ edge servers, network slicing control plane, license ซอฟต์แวร์ และ OpEx สำหรับการฝึกโมเดล ติดตั้งระบบ monitoring และบุคลากรเฉพาะทาง) อาจสูง ตัวอย่างเชิงประมาณจากโครงการระดับผู้ให้บริการบางรายระบุว่าการลงทุนเริ่มต้นในสภาพแวดล้อม edge‑enabled อาจเพิ่มต้นทุนโครงสร้างพื้นฐานได้สองหลักเปอร์เซ็นต์ (10–30%) ขึ้นกับขนาดและนโยบาย redundancy ซึ่งต้องเทียบกับรายได้หรือการลดต้นทุนที่คาดหวังเพื่อคำนวณ ROI

เพื่อบรรเทาความเสี่ยงข้างต้น ควรผสมผสานแนวทางเชิงเทคนิคและเชิงนโยบาย ดังนี้

- มาตรฐานและสถาปัตยกรรมแบบไม่ผูกขาด: เลือกใช้และขยายมาตรฐานอุตสาหกรรม (3GPP, ETSI NFV/ZSM, ONAP, O‑RAN) เพื่อสร้าง abstraction layer ระหว่าง orchestrator กับอุปกรณ์จากหลาย vendor ลดการพึ่งพา proprietary API และอำนวยความสะดวกในการสเกล

- สถาปัตยกรรมไฮบริด (edge + cloud): แยกการตัดสินใจตามกรอบเวลา — inference แบบ latency‑sensitive ให้ทำที่ edge ด้วยโมเดลขนาดเล็กหรือ distilled models ส่วนการฝึกซ้ำและการวิเคราะห์เชิงลึกสามารถทำในศูนย์ข้อมูล เพื่อบาลานซ์ค่าใช้จ่ายและความหน่วง

- การออกแบบ control loop ที่รับประกันเวลาตอบสนอง: ใช้ deadline‑aware scheduling, priority queues, pre‑emptive rules และ fallback policy ในกรณีโมเดลไม่พร้อม เพื่อป้องกันการล้มเหลวที่ทำให้ jitter เพิ่มขึ้นอย่างรุนแรง

- การตรวจสอบคุณภาพโมเดลและการป้องกัน drift: ติดตั้งระบบ continuous evaluation, confidence scoring, และ canary/blue‑green deployment ของโมเดล รวมถึงกลไก rollback อัตโนมัติเมื่อพบพฤติกรรมผิดปกติ

- มาตรการคุ้มครองข้อมูลและปฏิบัติการตามกฎหมาย: นำเทคนิคเช่น federated learning, differential privacy, และ data minimization มาใช้ พร้อมทำ DPIA (Data Protection Impact Assessment) และกำหนดข้อตกลงทางกฎหมายกับ vendor เพื่อปฏิบัติตาม PDPA/GDPR และข้อกำหนดท้องถิ่น

- โมเดลธุรกิจและการประเมิน ROI เชิงระยะ: เริ่มด้วย PoC และ pilot บน workload ที่มีมูลค่าสูง (เช่น event streaming, premium AR/VR) ประเมิน KPI เช่น jitter, packet loss, concurrent users และอัตราการแปลงรายได้จากบริการพรีเมียม เพื่อกำหนดแผนขยายแบบเป็นเฟสและลดความเสี่ยงทางการเงิน

- การบริหารความเสี่ยงเชิงปฏิบัติการ: จัดตั้ง SLA และ playbook ด้าน incident response ระหว่างผู้ขายหลายฝ่าย, ทำ tabletop exercises เพื่อซักซ้อมการสลับไปใช้ fallback slice และสำรองเส้นทางเมื่อเกิดปัญหา

สรุปคือ โครงการ AI‑driven slicing ให้ผลประโยชน์เชิงเทคนิคและเชิงพาณิชย์ที่ชัดเจน แต่ต้องเอาชนะปัจจัยด้านสเกล, ความเข้ากันได้ของระบบ multi‑vendor, latency ของวงจรตัดสินใจ และเงื่อนไขด้านความเป็นส่วนตัว/กฎหมายร่วมกัน การบริหารความเสี่ยงอย่างเป็นระบบผ่านมาตรฐานสถาปัตยกรรม, สถิติการทดสอบ, กลยุทธ์ edge‑first และการประเมิน ROI เป็นแนวทางที่ช่วยลดโอกาสเกิดผลลบและเพิ่มโอกาสความสำเร็จในการนำไปใช้เชิงพาณิชย์

นัยเชิงธุรกิจและขั้นตอนถัดไปสำหรับโอเปอเรเตอร์

นัยเชิงธุรกิจและขั้นตอนถัดไปสำหรับโอเปอเรเตอร์

การทดลอง AI‑driven Network Slicing ที่สามารถปรับเส้นทางทราฟฟิกเรียลไทม์เพื่อรองรับ AR/VR และลด jitter ได้ถึง 80% เปิดช่องทางเชิงธุรกิจที่สำคัญสำหรับโอเปอเรเตอร์ไทย ทั้งในมิติการสร้างรายได้ใหม่และการรักษาความได้เปรียบด้านคุณภาพบริการในตลาดที่แข่งขันสูง โดยเฉพาะอย่างยิ่งในกลุ่มการสตรีมสด งานอีเวนต์เสมือนจริง (virtual events) การฝึกอบรมระยะไกล (remote training) และแอปพลิเคชันอุตสาหกรรมเช่นการบำรุงรักษาเชิงระยะไกลหรือการตรวจสอบสายการผลิตที่ต้องการความหน่วงต่ำและความเสถียรสูง ตัวอย่างเชิงกลยุทธ์ ได้แก่การนำเสนอ บริการสไลซ์แบบพรีเมียมสำหรับลูกค้า B2B เช่น สไลซ์เฉพาะสำหรับงานสตรีมสดของสถานีโทรทัศน์หรือสไลซ์สำหรับโรงงานอัจฉริยะ และการออกแบบแพ็กเกจ B2C ที่รวมแบนด์วิธพิเศษและประสบการณ์ AR/VR สำหรับแฟนกีฬาและคอนเทนต์บันเทิง

ในด้านรูปแบบเชิงพาณิชย์ โอเปอเรเตอร์ควรพิจารณาโมเดลที่หลากหลายเพื่อจับโอกาสทั้งตลาดองค์กรและผู้บริโภค ได้แก่:

- Slice-as-a-Service (B2B): ขายสไลซ์ตาม SLA ที่กำหนด (latency, jitter, packet loss) ให้แก่ธุรกิจที่ต้องการ latency‑sensitive services

- B2C Premium Bundles: แพ็กเกจสำหรับผู้ใช้ปลายทางที่ต้องการ AR/VR experience แบบความหน่วงต่ำ รวมทั้งโมเดลสมัครสมาชิกหรือจ่ายตามการใช้งาน (pay‑per‑session)

- Wholesale/Enterprise Partnerships: ให้บริการสไลซ์แก่ MVNO หรือพาร์ทเนอร์คอนเทนต์ โดยคิดราคาเป็นรายสไลซ์หรือแบบ revenue share

- Bundling กับ Edge Compute: ให้บริการพร้อมแพลตฟอร์ม MEC เพื่อรองรับการประมวลผลใกล้ผู้ใช้ เช่น real‑time rendering หรือ AI inference สำหรับการปรับคุณภาพสตรีม

เพื่อให้การให้บริการเชิงพาณิชย์มีความยั่งยืน จำเป็นต้องลงทุนโครงสร้างพื้นฐานที่เหมาะสมทั้งทางเทคนิคและเชิงพาณิชย์ โดยเฉพาะการขยาย edge/MEC ในพื้นที่สำคัญ (สเตเดียม ศูนย์ประชุม เขตเศรษฐกิจเฉพาะ) และระบบ orchestration ที่สามารถจัดสรรสไลซ์แบบอัตโนมัติตามเงื่อนไขเชิงธุรกิจ นอกเหนือจากการลงทุนด้านฮาร์ดแวร์และ data center ควรเน้นการเป็นพันธมิตรกับผู้ผลิต AR/VR, ผู้พัฒนาแพลตฟอร์มคอนเทนต์ และผู้ให้บริการ CDN เพื่อทำงานร่วมกันในด้านการปรับจูนโปรโตคอล, codec optimization และการทดสอบร่วม (co‑optimization) ตัวอย่างเช่น การจับมือกับผู้ผลิตแว่น AR/VR เพื่อรวม SDK ที่ส่งสัญญาณ telemetric ที่จำเป็นสำหรับ AI orchestration จะช่วยให้การปรับสไลซ์เป็นไปได้อย่างมีประสิทธิภาพ

สำหรับ roadmap ไปสู่การให้บริการเชิงพาณิชย์ แนะนำแบ่งเป็นเฟสชัดเจนพร้อมตัวชี้วัดความสำเร็จ ดังนี้

- เฟส POC (3–6 เดือน): ระบุ use case เชิงธุรกิจหนึ่งหรือสองกรณี เลือกลูกค้าพาร์ทเนอร์ทำการทดสอบภาคสนาม วัดค่า jitter, latency, packet loss และ QoE เบื้องต้น

- เฟส Pre‑Commercial (6–12 เดือน): ขยายการทดลองสู่หลายไซต์, ผสานระบบ OSS/BSS, พัฒนาโมเดลการคิดราคาและ SLA, ดำเนินการทดสอบ interoperability ระหว่าง vendor

- เฟสเชิงพาณิชย์เริ่มต้น (12–24 เดือน): เปิดให้บริการจำกัดพื้นที่/ลูกค้ากลุ่มเฉพาะ ปรับปรุง automation ใน orchestration และ billing พร้อมระบบ monitoring แบบเรียลไทม์

- เฟสขยายสเกล (24+ เดือน): ขยายภูมิภาค เพิ่มพันธมิตรด้านคอนเทนต์และอุปกรณ์ สรุปผล ROI และปรับโมเดลการให้บริการตามข้อมูลเชิงลึกจากการใช้งานจริง

นอกจากแผนเชิงเทคนิคและการตลาดแล้ว โอเปอเรเตอร์ควรดำเนินการตามข้อเสนอแนะเชิงนโยบายและการทดสอบเพิ่มเติมก่อนใช้งานจริง ได้แก่ การขอใช้กรอบทดลอง (regulatory sandbox) กับหน่วยงานกำกับดูแลเพื่อทดสอบแนวปฏิบัติด้าน QoS/SLA, การร่วมมือกำหนดมาตรฐานการวัด QoE สำหรับ AR/VR, และการชี้แจงประเด็นความเป็นส่วนตัวของข้อมูลผู้ใช้เมื่อมีการประมวลผลที่ edge

สุดท้าย เรื่องการวัดผลตอบแทนการลงทุน (ROI) ควรวัดทั้ง KPI ทางเทคนิคและเชิงธุรกิจ โดยตั้งเกณฑ์ชัดเจน เช่น

- KPI ทางเทคนิค: target end‑to‑end latency (เช่น <20 ms), jitter <5 ms, packet loss <0.1%, อัตราการสำเร็จของ handover สำหรับสไลซ์ >99%

- KPI ทางธุรกิจ: ARPU เพิ่มขึ้นจากบริการพรีเมียม, อัตราการรักษาลูกค้า (churn) ที่ลดลง, revenue per slice และ utilization ของทรัพยากร edge

- การประเมินทางการเงิน: คำนวณ payback period, net present value (NPV) และ total cost of ownership (TCO) ของโครงการ โดยรวมค่า CAPEX สำหรับ MEC และค่า OPEX สำหรับการบริหาร orchestration/AI

สรุปคือ โอเปอเรเตอร์ที่ต้องการผลักดันบริการ AI‑driven Network Slicing ไปสู่เชิงพาณิชย์ควรวางกลยุทธ์เชิงพาณิชย์ที่ยืดหยุ่น ลงทุนโครงสร้าง edge อย่างเป็นระบบ สร้างพันธมิตรเชิงนิเวศกับผู้ผลิตอุปกรณ์และคอนเทนต์ และออกแบบ roadmap การทดสอบที่ชัดเจนเพื่อวัดผลทั้งด้านเทคนิคและมูลค่าทางธุรกิจก่อนขยายสเกลสู่ตลาดวงกว้าง

บทสรุป

การทดสอบระบบ AI‑driven network slicing บนเครือข่าย 5G ของโอเปอเรเตอร์ไทยครั้งนี้แสดงให้เห็นผลลัพธ์เชิงเทคนิคที่โดดเด่น: สามารถลด jitter ได้ถึง 80% และยกระดับคุณภาพประสบการณ์ผู้ใช้ (QoE) สำหรับการสตรีม AR/VR แบบสด ซึ่งหมายความว่าแพ็กเก็ตทราฟฟิกถูกปรับเส้นทางแบบเรียลไทม์เพื่อรักษาเสถียรภาพและลดความหน่วงอย่างมีนัยสำคัญ (เช่น ในบางเคส jitter ลดจากประมาณ 20 ms เหลือราว 4 ms) ผลลัพธ์นี้ถือเป็นก้าวสำคัญในการพิสูจน์ความเป็นไปได้ของบริการเชิงพาณิชย์ที่ต้องการ latency ต่ำและความเสถียรสูง เช่น คอนเสิร์ตเสมือนจริง การประชุมระยะไกลแบบ AR และแอปพลิเคชันอุตสาหกรรมที่ต้องการเวลาตอบสนองทันที

แม้ผลการทดสอบจะน่าประทับใจ แต่โอเปอเรเตอร์ยังต้องเผชิญความท้าทายในเชิงปฏิบัติการก่อนขยายสู่ตลาดจริง ได้แก่ การสเกลระบบให้รองรับผู้ใช้จำนวนมาก ตอบโจทย์ multi‑vendor interoperability และความเข้ากันได้ของอุปกรณ์ไคลเอนต์ รวมถึงการจัดการทรัพยากร edge computing และ orchestration แบบอัตโนมัติ นอกจากนี้ ปัจจัยทางกฎหมายและนโยบาย เช่น กรอบการให้สิทธิทางคลื่นความถี่ การคุ้มครองข้อมูล และ SLA ที่ชัดเจน ยังต้องได้รับการแก้ไขเพื่อให้บริการทำธุรกิจได้อย่างยั่งยืน ในภาพอนาคต หากมีการมาตรฐานร่วม การเพิ่มพลังของ edge infrastructure และการปรับกรอบกฎหมายอย่างเหมาะสม เราอาจจะได้เห็นการเปิดตัวบริการ AR/VR สตรีมสดที่ใช้ AI‑driven slicing ในเชิงพาณิชย์ในวงจำกัดภายในระยะกลาง ซึ่งจะเปลี่ยนประสบการณ์ดิจิทัลระดับผู้บริโภคและอุตสาหกรรมอย่างมีนัยสำคัญ