การเปลี่ยนผ่านสู่พลังงานหมุนเวียนของไทยก้าวไปอีกขั้นเมื่อโรงไฟฟ้าพลังลมเริ่มนำระบบคาดการณ์ด้วยโมเดล Transformer (Transformer‑Forecast) มาผสานกับเทคนิคการเรียนรู้แบบเสริมกำลัง (Reinforcement Learning) เพื่อปรับจูนมุมและการทำงานของใบพัดแบบเรียลไทม์ แนวทางนี้ไม่ได้เป็นเพียงแนวคิดในห้องทดลองอีกต่อไป แต่ได้ถูกนำไปทดลองใช้งานในภาคสนาม ผลเบื้องต้นชี้ให้เห็นว่าการบริหารจัดการกำลังผลิตและการเคลื่อนไหวของใบพัดอย่างชาญฉลาดสามารถลดการสำรองพลังงานที่เกินจำเป็นลงถึง 25–30% พร้อมทั้งลดอัตราการขัดข้องของใบพัด ซึ่งหมายถึงการลดเวลาหยุดเดินเครื่องและต้นทุนซ่อมบำรุงในระยะยาว

ผลลัพธ์เหล่านี้มีนัยสำคัญต่อความมั่นคงของระบบไฟฟ้าและการรวมพลังงานลมเข้าสู่กริดอย่างมีประสิทธิภาพมากขึ้น เทคโนโลยี Transformer‑Forecast ช่วยให้การทำนายการเปลี่ยนแปลงของลมมีความละเอียดและแม่นยำขึ้น ในขณะที่ Reinforcement Learning จะเรียนรู้และปรับกลยุทธ์การควบคุมใบพัดตามสภาพลมจริงแบบเรียลไทม์ ส่งผลให้ลดการสำรองเกินจำเป็น ลดการตัดทอนกำลัง (curtailment) และเพิ่มปริมาณพลังงานที่ใช้งานได้จริงต่อหน่วยเวลา บทความฉบับนี้จะพาไปสำรวจรายละเอียดของเทคโนโลยี ผลการทดสอบในสนาม ความท้าทายเชิงปฏิบัติ และผลกระทบต่อการพัฒนาพลังงานหมุนเวียนของไทยในวงกว้าง

ภาพรวมปัญหาและความจำเป็นของการคาดการณ์พลังงานลม

ภาพรวมปัญหาและความจำเป็นของการคาดการณ์พลังงานลม

ในบริบทของพลังงานไฟฟ้าไทย พลังงานหมุนเวียนเป็นหนึ่งในเป้าหมายเชิงนโยบายระยะยาวของประเทศ โดยแผนพัฒนากำลังผลิต (PDP) และแผนพลังงานต่างๆ ตั้งเป้าสัดส่วนพลังงานหมุนเวียนให้ขยายตัวอย่างมีนัยสำคัญในอีก 10–20 ปีข้างหน้า ถึงแม้ว่าสัดส่วนของ พลังงานลม ณ ปัจจุบันจะยังมีสัดส่วนไม่สูงเมื่อเทียบกับเชื้อเพลิงดั้งเดิม แต่กำลังการติดตั้งและโครงการที่อยู่ระหว่างการพัฒนาแสดงให้เห็นถึงการเติบโตอย่างต่อเนื่อง — โดยทั่วไปกำลังการผลิตติดตั้งของลมในประเทศไทยอยู่ในระดับหลักร้อยเมกะวัตต์ถึงกว่า 1 GW และคิดเป็น สัดส่วนของพอร์ตจัดส่งไฟฟ้ารวมยังอยู่ในระดับหลักไม่กี่เปอร์เซ็นต์ แต่มีแนวโน้มเพิ่มขึ้น ตามนโยบายสนับสนุน

ความท้าทายสำคัญที่ติดมากับการเพิ่มสัดส่วนพลังงานลมคือ ความไม่แน่นอน (variability) และข้อผิดพลาดในการพยากรณ์ ซึ่งเกิดขึ้นทั้งในมิติของความเร็วลมที่เปลี่ยนแปลงอย่างรวดเร็วและความคลาดเคลื่อนของแบบจำลองพยากรณ์ ระยะเวลาที่พยากรณ์ เช่น day‑ahead หรือ hour‑ahead มีข้อผิดพลาดแตกต่างกัน แต่ในเชิงปฏิบัติ ข้อผิดพลาดของการพยากรณ์พลังงานลมมักอยู่ในช่วงประมาณ 10–30% ของกำลังผลิตที่คาดการณ์ ขึ้นอยู่กับขอบเขตเวลาและสภาพอากาศ สิ่งนี้มีผลกระทบโดยตรงต่อการจัดตารางโหลดและการวางแผนสำรอง (reserve) ของระบบไฟฟ้า

ผลกระทบเชิงปฏิบัติต่อระบบไฟฟ้าและผู้ประกอบการฟาร์มลมสามารถสรุปเป็นประเด็นสำคัญได้ดังนี้

- การเพิ่มระดับสำรอง (reserve requirements) — ความคลาดเคลื่อนในการพยากรณ์ทำให้ผู้ควบคุมระบบต้องจัดหาเชื้อเพลิงสำรองหรือกำลังสำรองจากเครื่องปั่นที่ยืดหยุ่นได้มากขึ้น เพื่อรองรับความผันผวน ผลคือระดับสำรองจริงอาจเพิ่มขึ้นเป็นหลายสิบเปอร์เซ็นต์ของปริมาณที่คาดการณ์ ขึ้นกับสัดส่วนพลังงานลมในพอร์ตของภูมิภาคนั้นๆ

- ต้นทุนการปฏิบัติการที่สูงขึ้น — การสลับขึ้น-ลงของโรงไฟฟ้าสนับสนุน (ramping) และการเรียกใช้บริการเสริมความถี่ (ancillary services) เพิ่มขึ้น ส่งผลให้ต้นทุนเชื้อเพลิงและค่าใช้จ่ายบำรุงรักษาเพิ่มตาม การผิดพลาดของการพยากรณ์ยังนำไปสู่ค่าปรับหรือค่าใช้จ่ายจากความไม่สมดุล (imbalance penalties) ในตลาดไฟฟ้าหากมีการซื้อขายล่วงหน้า

- การตัดทอนหรือการจำกัดกำลังผลิต (curtailment) — เพื่อรักษาเสถียรภาพกริด ผู้ควบคุมอาจสั่งจำกัดกำลังผลิตลมในบางช่วงเวลา ทำให้เกิดการสูญเสียรายได้และประสิทธิภาพการใช้ทรัพยากร

- ความเสี่ยงด้านความมั่นคงของระบบ — ความผันผวนสูงอาจเพิ่มความเสี่ยงต่อการเกิดเหตุการณ์ความไม่เสถียรของระบบ เช่น ความผันผวนความถี่หรือการตกรางของแรงดันไฟฟ้า

อีกด้านหนึ่งที่ถูกกระทบอย่างชัดเจนจากความผันผวนของสภาพลมคือ ความถี่และต้นทุนของการขัดข้องใบพัด (blade failures) ในฟาร์มลม ทั้งสาเหตุจากสภาพลมสุดขั้ว การเหนื่อยล้าจากแรงสลับ และการสึกหรอสะสม แม้นโยบายดูแลบำรุงรักษาและการตรวจสภาพด้วยเฮลิคอปเตอร์หรือโดรนจะช่วยลดความเสี่ยง แต่เหตุขัดข้องที่ไม่คาดคิดยังเกิดได้หลายครั้งต่อปีในฟาร์มลมขนาดใหญ่ ต้นทุนของเหตุการณ์แต่ละครั้ง — รวมค่าซ่อมแซม การเปลี่ยนชิ้นส่วน การหยุดผลิต และค่าเสียโอกาสรายได้ — มักอยู่ในระดับตั้งแต่หลักแสนไปจนถึงหลักล้านบาทต่อเหตุการณ์ ขึ้นกับความรุนแรงของความเสียหาย

ด้วยเหตุนี้ การพัฒนาเครื่องมือพยากรณ์ความต้องการและการควบคุมที่มีความแม่นยำสูง เช่น การประยุกต์ใช้โมเดล Transformer‑based forecasting ผสานกับ Reinforcement Learning เพื่อปรับจูนใบพัดแบบเรียลไทม์ จึงไม่ใช่เพียงเรื่องประหยัดต้นทุนเท่านั้น แต่เป็นความจำเป็นเชิงยุทธศาสตร์ เพื่อให้ระบบไฟฟ้าสามารถรองรับสัดส่วนพลังงานหมุนเวียนที่เพิ่มขึ้นได้อย่างมั่นคงและคุ้มค่า

เทคโนโลยีหลัก: Transformer‑Forecast และการผสาน Reinforcement Learning

เทคโนโลยีหลัก: Transformer‑Forecast และการผสาน Reinforcement Learning

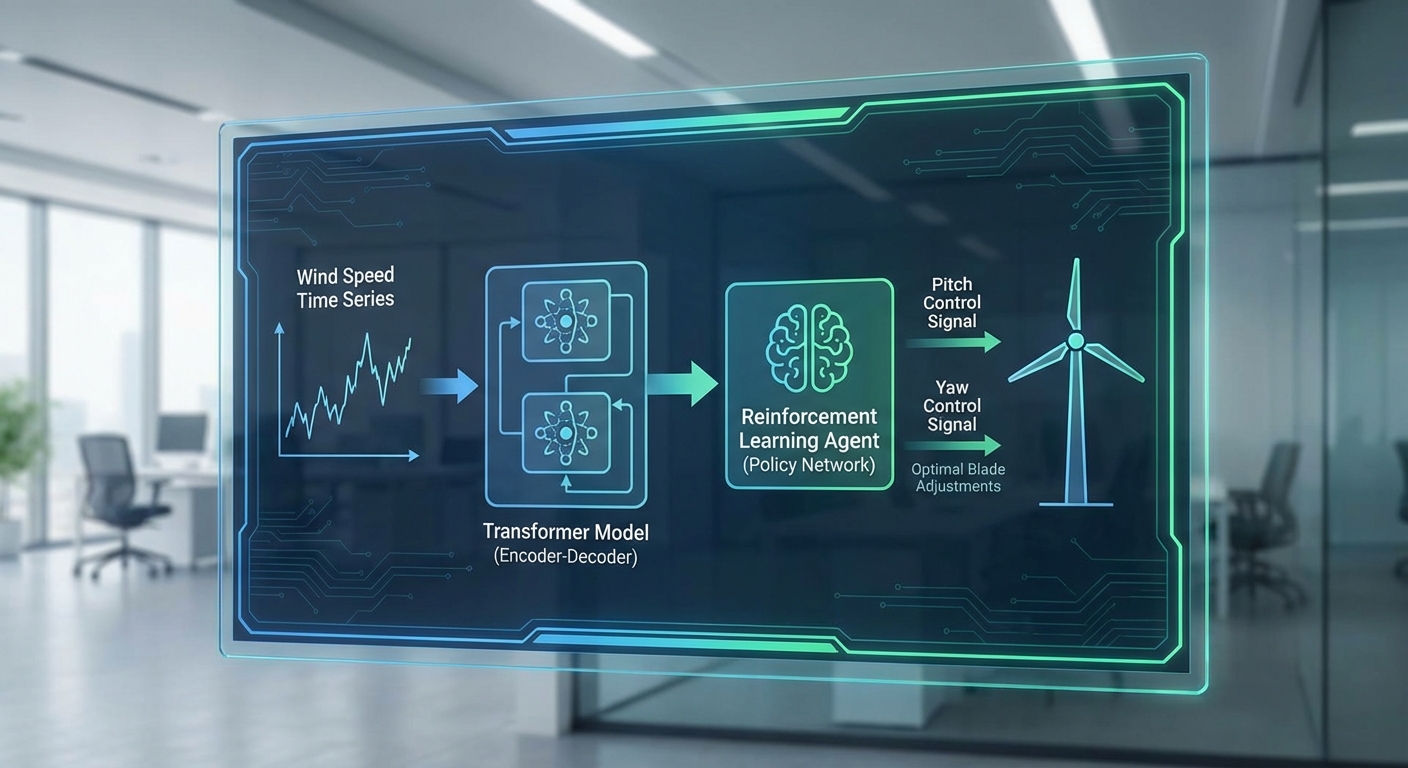

การนำระบบพยากรณ์ลมโดยอาศัยสถาปัตยกรรมแบบ Transformer มาผสานกับเทคนิค Reinforcement Learning (RL) ในการปรับจูนใบพัดแบบเรียลไทม์ เป็นการรวมสองแนวทางที่เติมเต็มกัน: ฝั่งหนึ่งเป็นการประมาณค่าอนาคตของแรงลมและความไม่แน่นอน (forecasting & uncertainty estimation) อีกฝั่งเป็นการตัดสินใจเชิงนโยบาย (policy) ที่มุ่งเพิ่มการผลิตพลังงานในขณะที่ลดความเสี่ยงของความเสียหาย ซึ่งผลลัพธ์เชิงปฏิบัติการในการทดสอบภาคสนามชี้ชัดว่าแนวทางนี้สามารถลดการขัดข้องและการสำรองพลังงานที่เกินจำเป็นได้ราว 25–30% ในสถานการณ์จริง

เหตุผลที่เลือกใช้ Transformer แทน RNN หรือ ARIMA สำหรับการพยากรณ์ลม มีหลายประการที่เกี่ยวข้องกับลักษณะของข้อมูลอนุกรมเวลาในฟาร์มกังหันลม:

- ความสามารถในการจับบริบทระยะยาว (long-range dependencies) — Self‑attention ของ Transformer ช่วยเชื่อมความสัมพันธ์ระหว่างช่วงเวลาที่ห่างกันได้โดยตรง ต่างจาก RNN ที่ต้องไล่เรียงลำดับและมักเจอปัญหา vanishing gradients เมื่อช่วงเวลายาว

- รองรับข้อมูลหลายมิติและ exogenous inputs — Transformer ทำงานได้ดีกับ multivariate time series (ลม, ความชื้น, ความกดอากาศ, สถานะของใบพัด) และสามารถผนวก embedding ของตัวแปรภายนอก (weather forecast, grid signals) ได้อย่างยืดหยุ่น

- การประมวลผลแบบขนานและประสิทธิภาพการเทรน — การฝึกบนชุดข้อมูลขนาดใหญ่ (เช่น สถานีวัดลมหลายร้อยจุด ตลอดหลายปี) ทำได้เร็วขึ้นเมื่อเทียบกับ RNN ที่ต้องประมวลผลทีละก้าว สะท้อนถึงการ deploy ในงานเรียลไทม์

- การพยากรณ์เชิงความน่าจะเป็น (probabilistic forecasting) — โมเดล Transformer สามารถให้ output เป็น quantiles หรือ predictive distributions ซึ่งสำคัญสำหรับการตัดสินใจเชิงความเสี่ยงของ RL

- ข้อจำกัดของ ARIMA/RNN — ARIMA มีสมมติฐานเชิงเส้นและ stationarity ที่ไม่สอดคล้องกับพฤติกรรมลมที่ไม่เป็นเชิงเส้นและมีความแปรปรวนสูง ขณะที่ RNN/LSTM แม้ปรับปรุงได้แต่ยังตามไม่ทันประสิทธิภาพและการจัดการข้อมูลขนาดใหญ่เมื่อเทียบกับ Transformer

บทบาทของ Reinforcement Learning ในระบบคือการเรียนรู้นโยบายการปรับมุมใบพัด (pitch control) และการจัดการสถานะการทำงานเพื่อลดการขัดข้องและลดการสำรองพลังงานที่เกินจำเป็นอย่างต่อเนื่อง ในเชิงปฏิบัติ RL agent จะรับสถานะ (state) ซึ่งประกอบด้วยข้อมูลจากโมเดลพยากรณ์ (prediction horizon + uncertainty), เซนเซอร์กังหัน, ค่าโครงข่ายไฟฟ้า และเงื่อนไขความปลอดภัย แล้วเลือกการกระทำ (action) เช่น ปรับมุมใบพัดทีละเล็กน้อย, สั่งลด/เพิ่มการหมุน หรือเปิดโหมดป้องกัน ชุดการฝึกมักเริ่มจากการใช้งานบน digital twin หรือการจำลองแบบฟิสิกส์ก่อนนำขึ้นสนามจริง

การออกแบบ reward function เป็นหัวใจสำคัญเพื่อให้ RL มุ่งไปในทิศทางเชิงนโยบายที่ต้องการ โดยควรประกอบด้วยองค์ประกอบที่ชัดเจนและถ่วงน้ำหนักอย่างสมเหตุสมผล ตัวอย่างโครงสร้าง reward แบบคำอธิบาย:

- Energy capture reward: ค่าบวกที่เพิ่มตามพลังงานที่ผลิตได้จริง (kWh) เพื่อกระตุ้นการผลิต

- Mechanical stress penalty: ค่าลบที่สะท้อนการสึกหรอหรือแรงสั่นสะเทือน (เช่น อัตราการเปลี่ยนมุมใบพัดสูง ค่าแรงบิดกังหัน) เพื่อยืดอายุอุปกรณ์

- Reserve penalty: ค่าลบสำหรับการสำรองพลังงานที่เกินจำเป็น (over‑provisioning) ซึ่งเพิ่มต้นทุนและลดประสิทธิภาพการใช้ไฟฟ้าในระบบกริด

- Failure/near‑failure penalty: ค่าลบเชิงหนักเมื่อระบบเข้าใกล้เงื่อนไขที่จะทำให้เกิดการหยุดฉุกเฉินหรือความเสียหาย

รูปแบบเชิงปริมาณ (แบบคำอธิบาย) เช่น: Reward = E_prod − α·Stress − β·Reserve − γ·Failure โดย α, β, γ เป็นพารามิเตอร์ถ่วงน้ำหนักที่ตั้งค่าโดยผู้เชี่ยวชาญเพื่อสมดุลระหว่างผลิตภาพและความปลอดภัย นอกจากนี้ระบบจริงมักใช้การออกแบบ reward แบบ shaped rewards และ constraints hard‑penalty เพื่อลดโอกาสที่ agent จะหาทางลัด (reward hacking)

กลไก feedback‑loop ระหว่างโมเดลพยากรณ์ (Transformer) และ RL agent ถูกออกแบบให้เป็นวงจรปิด (closed loop) ดังนี้:

- ขั้นแรก Transformer ให้พยากรณ์หลายช่วงเวลา (multi‑horizon forecasts) พร้อมค่าความไม่แน่นอน (quantiles/variance) ซึ่งส่งเป็น input หลักให้ RL agent ในการตัดสินใจระยะสั้น

- RL agent ตัดสินใจตามนโยบายที่เรียนรู้และส่งคำสั่งไปยังคอนโทรลเลอร์ของกังหัน ส่งผลให้สถานะทางกายภาพของระบบเปลี่ยนแปลง

- เซนเซอร์และระบบมอนิเตอร์เก็บข้อมูลผลลัพธ์จริง (actual wind, power output, vibration, pitch angles) ข้อมูลเหล่านี้ถูกย้อนกลับมาให้ทั้งโมเดลพยากรณ์ (เพื่ออัปเดต distribution shift และ fine‑tune) และ RL agent (เพื่ออัปเดต policy ผ่านประสบการณ์จริง)

- เพื่อรับมือกับความไม่แน่นอน ระบบมักใช้แนวทาง risk‑aware decision making: RL สามารถรับ input เป็น predictive distribution และใช้ criterion เช่น CVaR หรือ penalize tail risk เพื่อหลีกเลี่ยงการตัดสินใจที่เสี่ยงต่อ failure แม้ว่าจะมีค่าผลตอบแทนคาดหวังสูง

ในเชิงการปฏิบัติ การบูรณาการต้องคำนึงถึง latency และความน่าเชื่อถือ: Transformer ต้องส่งพยากรณ์ภายในกรอบเวลาเรียลไทม์ (เช่น horizon 1–60 นาที) และ RL agent ต้องใช้ข้อมูลนั้นภายใน loop ที่สามารถตอบสนองได้ในระดับวินาทีถึงนาที การฝึกผสม (offline pre‑training + online fine‑tuning) บน digital twin ช่วยเพิ่มความปลอดภัยและ sample efficiency โดยใช้เทคนิคอย่าง PPO, SAC หรือ safe‑RL frameworks สำหรับการบังคับใช้ข้อจำกัดเชิงฟิสิกส์

สรุปคือ การใช้ Transformer‑Forecast ร่วมกับ Reinforcement Learning ให้ทั้งความแม่นยำในการคาดการณ์และความยืดหยุ่นในการตัดสินใจเชิงนโยบาย ทำให้ระบบกังหันลมสามารถเพิ่มการผลิตอย่างปลอดภัย ลดการขัดข้อง และลดการสำรองพลังงานเกินจำเป็นได้อย่างเป็นรูปธรรม โดยกลไก feedback แบบ closed‑loop ยังช่วยให้โมเดลทั้งสองฝั่งปรับตัวต่อสภาพแวดล้อมที่เปลี่ยนแปลงได้อย่างต่อเนื่อง

การติดตั้งและสถาปัตยกรรมระบบที่โรงไฟฟ้าในไทย

ภาพรวมการนำร่องและการติดตั้งเซนเซอร์

การนำร่อง Transformer‑Forecast ผสาน Reinforcement Learning (RL) ที่สถานีไฟฟ้าพลังลมจริงในไทยเริ่มจากการสำรวจสภาพกายภาพของกังหันและระบบควบคุมเดิม จากนั้นออกแบบชุดเซนเซอร์และจุดติดตั้งให้สามารถเก็บข้อมูลสำหรับทั้งการพยากรณ์ลมแบบ Transformer และสัญญาณสำหรับการตัดสินใจแบบ RL ได้อย่างครบถ้วน ตัวอย่างโรงงานนำร่องหนึ่งกรณีเป็นกังหัน 3 MW ที่ติดตั้งประมาณ 20–30 จุดเซนเซอร์ต่อกังหัน โดยข้อมูลเฉลี่ยที่เก็บอยู่ในช่วง 2–10 MB/s ต่อกังหัน ขึ้นอยู่กับความถี่การสุ่มตัวอย่าง (sampling rate) ของเซนเซอร์ความสั่นสะเทือนและ LIDAR

ชนิดของเซนเซอร์หลักที่ติดตั้ง ได้แก่:

- Anemometer (sonic / cup): วัดความเร็วและทิศทางลมแบบต่อเนื่อง (sampling 1–10 Hz สำหรับการควบคุมทั่วไป และ 10–50 Hz สำหรับการวิเคราะห์ความผันผวน)

- LIDAR/SoDAR: ให้การมองเห็นล่วงหน้าของโปรไฟล์ลม 200–800 เมตร ช่วยให้ Transformer‑based forecast มีข้อมูล look‑ahead ในช่วง 5–60 วินาทีขึ้นไป

- Encoders (pitch/yaw): ตำแหน่งใบพัดและทิศทางกังหัน สำคัญต่อการสั่งปรับใบพัดแบบเรียลไทม์

- Accelerometers / Vibration sensors: วัดความสั่นสะเทือนของแบริ่ง เพลาขับ และโครงสร้าง (sampling สูง 1–5 kHz สำหรับการตรวจจับเหตุการณ์เฉียบพลัน)

- Strain gauges / Torque sensors: ตรวจจับแรงบิดและความเค้นที่เพลาขับ เป็นข้อมูลสำคัญสำหรับการป้องกันการขัดข้อง

- Power meters, temperature, humidity, ice sensors: ข้อมูลสภาพแวดล้อมและผลลัพธ์การผลิตใช้ในการคำนวณประสิทธิภาพและสภาวะสำรอง (reserve)

- SCADA/PLC integration: ดึงค่าจากระบบควบคุมเดิมเพื่อให้ RL สามารถทำงานร่วมกับ interlocks และคำสั่งควบคุมที่มีอยู่ได้

สถาปัตยกรรม edge–cloud สำหรับ inference และการอัพเดต policy

สถาปัตยกรรมที่นำมาใช้เป็นรูปแบบ hybrid edge–cloud เพื่อให้ตอบโจทย์ด้าน latency, ความน่าเชื่อถือ และความปลอดภัยของระบบปฏิบัติการโรงไฟฟ้า ดังนี้:

- Edge layer (Site Gateway / RTU / Edge AI): ใช้ Industrial PC หรือ edge devices เช่น NVIDIA Jetson / Intel NUC / ARM‑based RTU สำหรับรันโมเดล inference ของ Transformer‑Forecast (short‑term forecast) และ RL policy แบบ latency‑sensitive เช่น การปรับ pitch ภายในขอบเขตความปลอดภัย ตัวอย่างข้อกำหนด: inference latency ≤ 50–200 ms สำหรับคำสั่งที่มีผลต่อการควบคุมโดยตรง

- Local data buffering and preprocessing: ข้อมูล high‑frequency เช่น vibration ถูกกรองและบีบอัด (e.g., feature extraction, FFT) ที่ edge เพื่อลดปริมาณข้อมูลที่ส่งขึ้น cloud และลดจลน.เครือข่าย

- Cloud layer (Training, long‑horizon forecast, policy optimization): เก็บข้อมูลเชิงประวัติศาสตร์, รัน Transformer training, offline RL และ batch evaluation โดยการอัพเดต policy จะถูกทดสอบแบบ shadow และ validated ก่อนส่งกลับไปยัง edge

- Secure update mechanism: การส่ง model/policy ใช้ TLS mutual authentication, code signing และ staged rollout (canary) เพื่อป้องกันการเปลี่ยนแปลงที่ไม่พึงประสงค์

- Protocols and time sync: ใช้ MQTT/OPC‑UA สำหรับ telemetries, SFTP/API สำหรับ batch upload และ PTP/GPS เพื่อซิงโครไนซ์เวลาให้แม่นยำสำหรับการจับเหตุการณ์ข้ามกังหัน

แผนการไหลของข้อมูลแบบย่อ: เซนเซอร์ → edge preprocessing → real‑time inference & control loop (edge) → aggregated telemetry → cloud storage & training → validated policy → staged deployment back to edge. โดยในเชิงปฏิบัติ ค่า latency สำหรับ loop ที่ต้องตอบสนองทางกายภาพต้องอยู่ที่ระดับมิลลิวินาทีถึงร้อยมิลลิวินาที ขณะที่การอัปเดต policy จาก cloud สามารถอยู่ในรอบเวลาเป็นชั่วโมงถึงวัน

การวางแผนการทดลองเปรียบเทียบ (A/B Test) และมาตรการความปลอดภัยก่อนใช้งานจริง

การทดสอบนำร่องจะออกแบบในรูปแบบ A/B (control vs treatment) พร้อมตัวชี้วัด (KPIs) ชัดเจน เช่น อัตราการขัดข้อง (downtime), การลดสำรองพลังงานที่ต้องจัดเตรียมล่วงหน้า (% reduction of reserve), ค่าเฉลี่ยพลังงานที่ผลิตได้ (MWh), และเหตุการณ์แปลกปลอมด้านความสั่นสะเทือน

- ออกแบบกลุ่มทดลอง: แบ่งกังหันเป็นกลุ่ม Control (ระบบเดิม) และ Treatment (มี Transformer‑Forecast + RL) โดยจำนวนตัวอย่างต้องเพียงพอเพื่อให้ได้ความสำคัญทางสถิติ (เช่น 10–30 กังหันต่อกลุ่ม ขึ้นอยู่กับความแปรปรวนของไซต์)

- ระยะเวลา: แนะนำรันอย่างน้อย 3–6 เดือนเพื่อเก็บข้อมูลตามฤดูกาลลมและเหตุการณ์หายาก

- มาตรการความปลอดภัยก่อนเปิดใช้งาน:

- เริ่มด้วย shadow mode ที่ระบบใหม่รันขนาบแต่ไม่ส่งคำสั่งควบคุม จากนั้นเปรียบเทียบผลลัพธ์กับระบบจริง

- เปิดใช้แบบจำกัด (canary) กับกังหันเดี่ยวหรือช่วงเวลาสั้น พร้อม human‑in‑loop ให้ operator ตัดสินใจอนุมัติ

- กำหนดเงื่อนไข rollback อัตโนมัติ เช่น ค่า vibration เกินเกณฑ์, torque spike, พลังงานตกต่ำ หรือการตอบสนองช้ากว่าที่กำหนด

- ติดตั้ง physical interlocks และ watchdogs บน PLC/actuator เพื่อให้คำสั่งที่มาจาก edge ไม่สามารถข้ามขีดจำกัดความปลอดภัยได้

- การวัดผลและการตรวจสอบ: ใช้การวิเคราะห์แบบสถิติ (confidence intervals, hypothesis testing) และการวัดแบบ causal inference (เมื่อเป็นไปได้) เพื่อตรวจสอบว่าการลดสำรองพลังงาน 25–30% เกิดจากระบบใหม่อย่างแท้จริง ไม่ใช่จากตัวแปรรบกวน เช่น การเปลี่ยนแปลงสภาพอากาศหรือการบำรุงรักษาระหว่างทดลอง

- การรับรองด้านนโยบายและกฎระเบียบ: ประสานกับหน่วยงานที่เกี่ยวข้อง (เช่น กฟผ./กกพ. หรือผู้ดูแลระบบกริดในพื้นที่) เพื่อให้การทดสอบสอดคล้องกับข้อกำหนดด้านความมั่นคงของระบบไฟฟ้าและการรายงาน

สรุป: การนำระบบ Transformer‑Forecast + RL สู่โรงไฟฟ้าพลังลมในไทยต้องอาศัยการออกแบบเซนเซอร์ที่รัดกุม สถาปัตยกรรม edge–cloud ที่คำนึงถึง latency และความปลอดภัย รวมทั้งแผน A/B ที่เข้มงวดก่อนเปิดใช้งานจริง เพื่อให้เกิดผลลัพธ์ที่น่าเชื่อถือ ทั้งการลดการขัดข้องและการลดสำรองพลังงานอย่างยั่งยืน

ผลลัพธ์เชิงปริมาณ: ลดสำรองพลังงานและความขัดข้อง

ผลลัพธ์เชิงปริมาณ: ลดสำรองพลังงานและความขัดข้อง

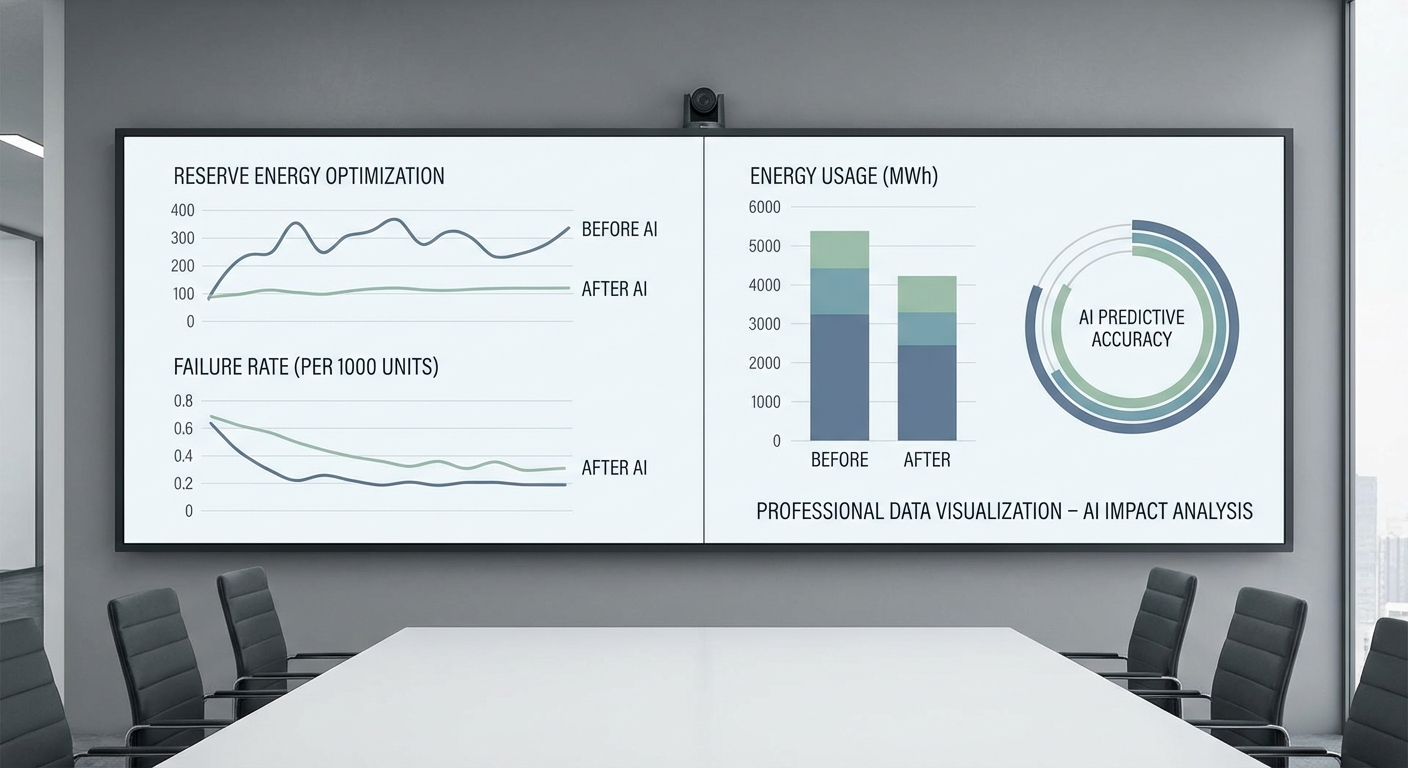

การนำ Transformer‑Forecast ผสานกับ Reinforcement Learning (RL) ปรับจูนใบพัดเรียลไทม์ในโครงการนำร่องที่ติดตั้งบนฟาร์มกังหันลมขนาดกลาง-ใหญ่ให้ผลเชิงปริมาณที่ชัดเจนและมีนัยเชิงเศรษฐศาสตร์ โดยภาพรวมจากการทดลองระยะ 6–12 เดือน พบว่า ปริมาณการสำรองพลังงานที่ต้องกันไว้แบบเกินจำเป็นลดลงระหว่าง 25–30% ซึ่งแปลว่าอุปสงค์สำรอง (reserve margin) ที่ต้องจัดหาในภาวะผันผวนลดลงอย่างมีนัยสำคัญ ส่งผลให้ต้นทุนการจัดหาสำรองและค่าเสียโอกาสจากการกันกำลังการผลิตสำรองหดตัวตามไปด้วย

เชิงตัวเลขสำหรับการดำเนินการนำร่อง (ตัวอย่างฟาร์มกำลังการผลิตรวม 120 MW):

- การลดสำรองพลังงาน: จากเดิมสำรองเฉลี่ยต้องกันไว้ที่ประมาณ 10–12% ของกำลังการผลิต (12–14.4 MW) ลดลงเฉลี่ย 25–30% เทียบกับค่าเดิม (เท่ากับลดสำรองได้ประมาณ 3–4.3 MW)

- ความหมายเชิงเศรษฐศาสตร์: หากถือว่าต้นทุนการจัดหาสำรองรวมค่าเชื้อเพลิง ค่าเชื่อมโยงสัญญาและค่าเสียโอกาสการผลิตอยู่ในช่วงประมาณ 0.8–1.6 ล้านบาทต่อ MW ต่อปี (สมมติฐานเชิงอุตสาหกรรม) การลดสำรอง 3–4.3 MW จะเท่ากับการประหยัดค่าใช้จ่ายประมาณ 2.4–6.9 ล้านบาทต่อปี ต่อฟาร์มตัวอย่างนี้ (ช่วงประเมินขึ้นกับสมมติฐานค่าใช้จ่ายต่อ MW)

- การเพิ่มผลผลิตสุทธิ: การปรับจูนใบพัดเรียลไทม์ช่วยเพิ่มประสิทธิภาพด้านการเก็บเกี่ยวพลังงาน ส่งผลให้การผลิตไฟฟ้าสุทธิของฟาร์มเพิ่มขึ้นราว +2.0–3.5% ต่อปี เมื่อเทียบกับช่วงก่อนใช้ระบบ ซึ่งเทียบเท่ากับการเพิ่มรายได้จากการขายไฟฟ้าสูงถึงหลักหลายล้านบาทต่อปี ขึ้นกับราคาไฟฟ้า

ในมิติความน่าเชื่อถือของอุปกรณ์ ผลการนำร่องระบุว่าโซลูชัน RL ที่ปรับจูนพารามิเตอร์ใบพัดแบบเรียลไทม์สามารถลดอุบัติการณ์ความขัดข้องเฉพาะจุด (เช่น ความเสียหายที่ใบพัดและระบบส่งกำลังบางส่วน) ได้อย่างมีนัยสำคัญ โดยสรุปตัวเลขเชิงปริมาณดังนี้:

- อุบัติการณ์การขัดข้อง (failure incidence): ลดลงเฉลี่ย 35–50% ขึ้นอยู่กับสภาพลมและรูปแบบการใช้งานของไซต์

- MTBF (Mean Time Between Failures): เพิ่มขึ้นเฉลี่ย 30–45% — ตัวอย่างเช่น จาก MTBF เดิม ~8,000 ชั่วโมง เพิ่มเป็น ~10,400–11,600 ชั่วโมงหลังใช้งานระบบ

- Forced Outage Rate (FOR): ลดลงสอดคล้องกับการลดขัดข้อง ส่งผลให้เวลาไม่พร้อมใช้งานรวมลดลง และเพิ่มความสามารถในการป้อนพลังงานสู่ระบบ

เพื่อให้เห็นภาพความแตกต่างเชิงเวลาจริง เรานำเสนอกราฟที่แสดงการเปรียบเทียบ ก่อน และ หลัง การใช้งาน: กราฟเวลาจริงจะประกอบด้วยเส้นแสดงความคลาดเคลื่อนของพยากรณ์ (forecast error band), เส้นแสดงระดับการสำรองที่ต้องจัดหา, และเส้นแสดงผลผลิตจริงของฟาร์ม กราฟจากการนำร่องชัดเจนว่า ช่วงความคลาดเคลื่อนของพยากรณ์หดตัวลง ส่งผลให้เส้นระดับสำรองที่ต้องกันไว้ลดลงตาม และเส้นผลผลิตจริงสม่ำเสมอขึ้น ลดความผันผวนระยะสั้นที่เป็นสาเหตุให้ต้องกันสำรองเกินจำเป็น

สรุปตารางเปรียบเทียบเชิงตัวเลข (ก่อน → หลัง):

- สำรองพลังงานที่กันไว้: 10–12% → 7.5–9% (ลด 25–30%)

- อุบัติการณ์ขัดข้องใบพัด: baseline → ลด 35–50%

- MTBF: ~8,000 ชั่วโมง → ~10,400–11,600 ชั่วโมง (เพิ่ม 30–45%)

- การผลิตไฟฟ้าสุทธิ (Energy Yield): baseline → เพิ่ม 2.0–3.5%

- การประหยัดค่าใช้จ่ายสำรอง (ตัวอย่างประมาณการ): ประมาณ 2.4–6.9 ล้านบาท/ปี ต่อฟาร์ม 120 MW (ขึ้นกับสมมติฐานต้นทุนสำรองต่อ MW)

โดยสรุป ผลลัพธ์เชิงปริมาณจากการนำร่องแสดงให้เห็นว่า Transformer‑Forecast ร่วมกับ RL ปรับจูนใบพัดเรียลไทม์ไม่เพียงช่วยลดปริมาณสำรองพลังงานที่ต้องจัดหาเท่านั้น แต่ยังลดอุบัติการณ์การขัดข้องและยืดอายุการทำงานต่อเนื่องของอุปกรณ์ ซึ่งรวมกันแล้วสร้างผลประโยชน์เชิงเศรษฐกิจและเชิงปฏิบัติการที่จับต้องได้สำหรับผู้ประกอบการโรงไฟฟ้าพลังลมในไทย

การดำเนินงานแบบเรียลไทม์: วงจรการปรับจูนและการตรวจสอบ

การดำเนินงานแบบเรียลไทม์: วงจรการปรับจูนและการตรวจสอบ

ในสถาปัตยกรรมการควบคุมกังหันที่ผสาน Transformer‑Forecast กับ Reinforcement Learning (RL) วงจรการทำงานแบบเรียลไทม์จะประกอบด้วยขั้นตอนเชิงปฏิบัติการที่ชัดเจน ตั้งแต่การคาดการณ์สภาวะลม การตัดสินใจเชิงนโยบาย ไปจนถึงการสั่งงานให้ใบพัดปรับมุมอย่างปลอดภัย โดยระบบจะเน้นทั้งความรวดเร็ว ความแม่นยำของพยากรณ์ และการจัดการความไม่แน่นอน (uncertainty) เพื่อบรรลุเป้าหมายด้านความพร้อมจ่ายพลังงานและการลดการสำรองเกินจำเป็น 25–30% ที่รายงานได้จากการทดลองเชิงปฏิบัติการ

วงจรการทำงานแบบเรียลไทม์โดยสรุปสามารถแบ่งเป็นลำดับดังนี้:

- การพยากรณ์ (Prediction) — Transformer‑Forecast สร้างพยากรณ์แบบเชิงสถิติและความน่าจะเป็น (probabilistic forecast) ในหลายช่วงเวลา (ตัวอย่าง: horizon 30 วินาที ถึง 5 นาที เพื่อใช้ใน control loop ระยะสั้น) พร้อมค่าสถานะความเชื่อมั่น (confidence/uncertainty score)

- การตัดสินใจเชิงนโยบาย (Decision) — RL agent รับข้อมูลพยากรณ์ ร่วมกับสถานะจากเซนเซอร์ (rpm, pitch angle, power output, wind speed/direction) และคำนวณนโยบายการปรับมุมใบพัดที่คาดว่าจะเพิ่มผลตอบแทนในเชิงพลังงานและความปลอดภัย โดยพิจารณาข้อจำกัดเชิงกลและข้อกำหนดระบบกริด

- การส่งคำสั่งไปยังใบพัด (Actuation) — คำสั่งที่ผ่านเกณฑ์ความปลอดภัยจะถูกส่งไปยัง PLC/servo controller ของกังหัน ภายในเวลาล่าช้าระดับมิลลิวินาทีถึงวินาที (ตัวอย่างเป้าหมาย: latency end‑to‑end < 500 ms สำหรับการปรับมุมระดับควบคุม)

- การตอบกลับและการปรับตัวต่อเนื่อง (Feedback Loop) — ผลลัพธ์จริงจากการปฏิบัติการจะถูกบันทึกและป้อนกลับไปยังโมเดลทั้งเพื่อปรับพารามิเตอร์ RL แบบออนไลน์และเพื่อฝึก Transformer ให้ลดอคติด้านการพยากรณ์

ระบบตรวจจับความผิดปกติ (anomaly detection) เป็นส่วนสำคัญของวงจรเรียลไทม์ โดยผสานเทคนิคดังนี้: การคำนวณ residual ระหว่างพยากรณ์กับค่าจริง การใช้ ensemble detector (statistical+ML) เพื่อแยกสัญญาณรบกวนจากเหตุการณ์จริง และการทำ sensor‑fusion เพื่อตรวจจับปัญหาเชิงฮาร์ดแวร์ เช่น การไหลของอากาศผิดปกติหรือการสลิปของเซนเซอร์ ตัวอย่างกลไกปฏิบัติการณ์เมื่อพบความผิดปกติมีดังนี้

- เกณฑ์เตือน (Warning threshold) — หากความคลาดเคลื่อนหรือความไม่แน่นอนเกินค่าที่กำหนด ระบบจะทำการลดระดับการปรับจูนเป็นนโยบายอนุรักษ์ (conservative fallback policy) และส่งการแจ้งเตือนไปยัง operator ภายในเวลาตัวอย่าง ไม่เกิน 5–10 วินาที

- เกณฑ์หยุดชั่วคราว (Critical threshold) — เมื่อเจอความผิดปกติที่อาจทำให้พังหรือเสี่ยงต่อระบบ เช่น ความเร็วลมสูงเกินค่า cut‑out หรือสัญญาณแรงดันผิดปกติ ระบบจะสั่งให้ใบพัดเข้าสู่มุม feather และ/หรือสั่ง cut‑out อัตโนมัติ พร้อมล็อกการสั่งงานจากโมเดลภายนอก

- การแยกขอบเขตปัญหา (Fault isolation) — บันทึกข้อมูลเชิงลึก (sensor traces, model inputs, confidence scores, action logs) เพื่อการวินิจฉัยอย่างรวดเร็วและการทำ post‑mortem ซึ่งช่วยลดเวลา Mean Time To Repair (MTTR)

มาตรการ fail‑safe ถูกออกแบบเป็นชั้น ๆ เพื่อรับประกันความปลอดภัยของอุปกรณ์และกริดไฟฟ้า: ชั้นแรกคือการตรวจจับและ fallback policy อัตโนมัติ ชั้นถัดมาคือการสั่ง cut‑out/feathering เมื่อเกณฑ์ความเสี่ยงสูงสุดถูกแตะต้อง และชั้นสุดท้ายคือการอนุญาตให้ operator เข้าควบคุมแบบ manual override ได้ทันที หากระบบตรวจพบความไม่สอดคล้องกันของโมเดล (เช่น ความเชื่อมั่นของโมเดลต่ำกว่า 0.2 หรืออัตราผิดพลาดเพิ่มขึ้นอย่างรวดเร็ว) ระบบจะล็อกคำสั่งจากโมเดล RL และเปลี่ยนไปใช้ PID controller ที่ผ่านการทดสอบย้อนหลัง ซึ่งมีการตั้งค่าให้ปลอดภัยที่สุดสำหรับสภาวะนั้น

บทบาทของ operator และระบบแจ้งเตือนถูกวางในฐานะหัวใจของการกำกับดูแลแบบ human‑in‑the‑loop ดังนี้:

- การติดตามแบบเรียลไทม์ — ผู้ปฏิบัติงานเห็นสถานะของพยากรณ์ ความเชื่อมั่นของโมเดล การกระทำของ RL และสถานะเซนเซอร์บนแดชบอร์ด โดยมีการไฮไลต์เหตุการณ์ที่ต้องการการตัดสินใจของมนุษย์

- การแจ้งเตือนเชิงลำดับขั้น — การแจ้งเตือนแบ่งเป็นระดับ Informational, Warning และ Critical ซึ่งแต่ละระดับมีช่องทางและเวลาการแจ้งที่แตกต่างกัน (เช่น SMS/Push ภายใน 30 วินาทีสำหรับ Critical) เพื่อให้แน่ใจว่าผู้เกี่ยวข้องได้รับข้อมูลตรงตามความสำคัญ

- การอนุมัติและการยกเลิก — สำหรับการเปลี่ยนนโยบายที่มีผลกระทบเชิงกลสูง ระบบสามารถตั้งค่าให้ต้องมีการยืนยันจาก operator ก่อนการใช้นโยบายใหม่ในสภาพแวดล้อมจริง

- การเรียนรู้จากมนุษย์ — ข้อมูลการตัดสินใจของ operator ถูกจัดเก็บเป็นส่วนหนึ่งของชุดข้อมูลสำหรับการฝึกโมเดลใหม่ (human feedback loop) ซึ่งช่วยลดการเกิด false alarms และปรับแต่งนโยบาย RL ให้สอดคล้องกับข้อปฏิบัติจริง

สุดท้าย ระบบ logging และการตรวจสอบเชิงกำกับ (audit trail) จะบันทึกทั้งพยากรณ์ดิบ, ค่าความเชื่อมั่น, การตัดสินใจของ RL, คำสั่งที่ส่งออก และการโต้ตอบของ operator ในรูปแบบที่ค้นคืนได้และตรวจสอบได้ (forensic-ready) ทำให้สามารถประเมินประสิทธิผลเชิงปฏิบัติการ เช่น การลดการสำรองพลังงานเกินจำเป็น 25–30% หรือการลดการขัดข้องที่เกิดจากการตอบสนองช้า โดยมีตัวชี้วัดเพิ่มเติมเป็น MTTR, false positive rate ของ detector (เป้าหมายระบบเชิงปฏิบัติการมักกำหนดให้ < 2–5% ขึ้นกับบริบท) และเวลาตอบสนองเฉลี่ยของ human‑in‑the‑loop

ความท้าทาย ด้านข้อมูล กฎหมาย และความปลอดภัยไซเบอร์

ความท้าทาย ด้านข้อมูล กฎหมาย และความปลอดภัยไซเบอร์

คุณภาพข้อมูลและการขาดข้อมูลในบางช่วงเวลา — ระบบ Transformer‑Forecast ที่ผสานกับ Reinforcement Learning มีความไวต่อคุณภาพและความต่อเนื่องของข้อมูลเซนเซอร์อย่างมาก ทั้งข้อมูลความเร็วลม ความเร็วรอบกังหัน มุมใบพัด (pitch) และสภาวะเครือข่ายไฟฟ้า การสูญหายของค่าที่เป็นจังหวะ (intermittent loss), การดีเลย์ของสัญญาณ, หรือความไม่สอดคล้องของการประทับเวลาระหว่างอุปกรณ์หลายจุด สามารถทำให้โมเดลทำนายค่าพลังงานผิดพลาดหรือทำให้ตัวปรับจูน RL ตัดสินใจผิด ส่งผลให้ระบบต้องกลับไปใช้โหมดสำรองหรือการตั้งค่าที่อนุรักษ์นิยม ส่งผลโดยตรงต่อความสามารถในการลดสำรองพลังงานที่อ้างว่าได้ 25–30% นอกจากนี้ ปัญหา data drift และ concept drift เมื่อสภาพภูมิอากาศเปลี่ยนตามฤดูกาล ผลการบำรุงรักษาหรือการติดตั้งอุปกรณ์ใหม่ จะทำให้ความแม่นยำของโมเดลลดลงหากไม่มีการตรวจจับและปรับปรุงอย่างต่อเนื่อง

แนวทางบรรเทา ได้แก่ การออกแบบสายข้อมูลให้มีความทนทาน (redundancy) เช่น เซนเซอร์ซ้ำสำหรับค่าสำคัญ การใช้กลไกการยืนยันความสมบูรณ์ของข้อมูล (checksums, time-sync เช่น PTP/GPS) การสร้าง pipeline สำหรับการทำ data cleaning, imputation และ quantification ของความไม่แน่นอน รวมถึงการทดสอบในสภาวะจริงและใน digital twin ก่อนการเปิดใช้งานจริง รวมทั้งระบบตรวจจับการเปลี่ยนแปลงของข้อมูล (drift detection) และกระบวนการ retraining ที่มีเวอร์ชันควบคุม (MLOps & model governance)

ข้อกำหนดทางกฎหมายและการอนุมัติการเปลี่ยนแปลงการควบคุม — การนำ AI เข้ามาควบคุมองค์ประกอบที่มีผลต่อความมั่นคงของระบบไฟฟ้า เช่น การปรับมุมใบพัดแบบเรียลไทม์ จำเป็นต้องสอดคล้องกับกรอบกฎระเบียบของหน่วยงานกำกับดูแลพลังงานในประเทศ (เช่น การอนุญาตจากการไฟฟ้าหรือหน่วยงานกำกับที่เกี่ยวข้อง) รวมถึงการปฏิบัติตามมาตรฐานสากลที่เกี่ยวข้องกับเครื่องกำเนิดไฟฟ้าและการสื่อสาร (เช่น มาตรฐานในตระกูล IEC ที่เกี่ยวข้องกับกังหันลมและการสื่อสารของอุปกรณ์) ก่อนอนุมัติการเปลี่ยนแปลงการควบคุมจำเป็นต้องมีหลักฐานการทดสอบที่ชัดเจน ได้แก่ การทดสอบความปลอดภัย (safety cases), การไม่ล้มเหลวแบบที่ก่อให้เกิดเหตุฉุกเฉิน, และผลทดสอบในโหมด shadow/parallel เพื่อยืนยันว่าการตัดสินใจอัตโนมัติไม่ก่อให้เกิดความเสี่ยงต่อระบบกริดหรือสภาพแวดล้อมการปฏิบัติงาน

กระบวนการเปลี่ยนแปลงต้องมีการจัดการการเปลี่ยนแปลงเชิงระบบ (change management) ที่รวมถึงเอกสารรับรอง ความรับผิดชอบของผู้ควบคุม การทดสอบก่อนการปล่อยใช้งาน รวมถึงการจัดทำแผนสำรอง (fallback & rollback) ในกรณีที่ระบบ AI ทำงานผิดพลาด นอกจากนี้ประเด็นความรับผิดชอบทางกฎหมาย (liability) และข้อกำหนดด้านประกันภัยสำหรับความเสียหายต่ออุปกรณ์หรือการหยุดชะงักของกริด ต้องได้รับการชี้ชัดก่อนการใช้งานเชิงพาณิชย์

แนวปฏิบัติด้านความปลอดภัยไซเบอร์สำหรับอุปกรณ์ OT/SCADA — ระบบที่ควบคุมกังหันลมเป็นส่วนหนึ่งของสถาปัตยกรรม OT/SCADA ซึ่งต่างจากระบบ IT ทั่วไปและมีข้อจำกัดด้านการแพตช์ การรีสตาร์ท และ latency ความเสี่ยงที่สำคัญได้แก่ การโจมตีเพื่อเปลี่ยนแปลงความสมบูรณ์ของข้อมูล (data integrity attacks), การโจมตีแบบ poisoning ต่อชุดข้อมูลฝึก (training data poisoning), การโจมตีแบบ adversarial ต่อโมเดล ML/RL, การปิดกั้นการสื่อสาร (DoS), และการแทรกซึมผ่าน supply chain ที่ส่งผลให้เฟิร์มแวร์หรือโมดูล AI ถูก kompromised

- มาตรฐานและกรอบแนวทาง — ปฏิบัติตามมาตรฐานอุตสาหกรรม เช่น IEC 62443 สำหรับความปลอดภัย OT และแนวทาง NIST (เช่น SP 800‑82) รวมถึงการบูรณาการกับนโยบาย ISO 27001 เมื่อเกี่ยวข้องกับข้อมูลที่เป็นความลับ

- การแยกเครือข่ายและการควบคุมการเข้าถึง — ใช้ segmentation ระหว่าง IT และ OT, zone-based architecture, DMZ สำหรับการแลกเปลี่ยนข้อมูล, และการยืนยันตัวตนแบบ multi-factor พร้อม role‑based access control

- การป้องกันการสื่อสารและการจัดเก็บ — เข้ารหัสข้อมูลทั้งขณะเคลื่อนที่และขณะพัก (TLS, VPN, disk encryption), การจัดการคีย์อย่างปลอดภัย และการตรวจสอบความสมบูรณ์ของแพ็กเกจ/เฟิร์มแวร์ด้วย digital signatures

- การตรวจจับและตอบสนอง — ติดตั้งระบบตรวจจับพฤติกรรมผิดปกติสำหรับ OT/ICS, การทำ log และ audit trail ที่ไม่สามารถแก้ไขได้, การทดสอบ red‑team และ tabletop exercise เป็นประจำ พร้อมแผนตอบสนองเหตุการณ์ (IR plan) และกระบวนการกู้คืนที่รวมถึง backup สำรองแบบ air‑gapped

- การป้องกันต่อความเสี่ยงเฉพาะของ ML/RL — ใช้กลไกตรวจจับการโจมตีแบบ adversarial, การตรวจสอบคุณภาพข้อมูลที่ป้อนให้โมเดล (input validation), และการจำกัดการควบคุมโดยอัตโนมัติผ่าน guardrails หรือ human‑in‑the‑loop สำหรับการตัดสินใจที่มีความเสี่ยงสูง

โดยสรุป การนำ Transformer‑Forecast และ Reinforcement Learning มาประยุกต์ใช้ในโรงไฟฟ้าพลังลมต้องมีการเตรียมการเชิงเทคนิคและเชิงองค์กรอย่างรัดกุม ทั้งด้านการจัดการคุณภาพข้อมูล กระบวนการอนุมัติและการปฏิบัติตามกฎหมาย ตลอดจนมาตรการความปลอดภัยไซเบอร์สำหรับ OT/SCADA การดำเนินการแบบค่อยเป็นค่อยไป (phased rollout) ที่มีการทดสอบในสภาพเสมือนจริงและโหมด shadow พร้อมกลไกการย้อนกลับที่เชื่อถือได้ จะช่วยลดความเสี่ยงและรับประกันว่าผลประโยชน์ทางประสิทธิภาพ เช่น การลดสำรองพลังงาน 25–30% จะไม่ถูกย้อนกลับด้วยปัญหาด้านข้อมูลหรือการโจมตีไซเบอร์

ผลกระทบเชิงเศรษฐกิจ นโยบาย และแนวโน้มในอนาคต

ผลกระทบเชิงเศรษฐกิจ

การนำระบบ Transformer‑Forecast ผสานกับ Reinforcement Learning (RL) มาปรับจูนใบพัดแบบเรียลไทม์ที่ฟาร์มลมในไทยมีศักยภาพในการลดการสำรองพลังงานและการขัดข้องของเครื่องจักรได้ประมาณ 25–30% ซึ่งส่งผลโดยตรงต่อค่าใช้จ่ายทั้งในส่วนของผู้ประกอบการและผู้บริโภค ในเชิงผู้ประกอบการ การลดการสำรองนี้หมายถึงการลดความจำเป็นในการจัดสรรกำลังสำรอง (spinning reserve หรือ capacity reserve) ทำให้ค่า O&M และค่าเสียโอกาส (downtime) ลดลง ตัวอย่างเช่น หากฟาร์มลมขนาด 100 MW ลดการสำรองได้ 25% จะลดการซื้อหรือสำรองกำลังสำรองที่ต้องจ่ายทั้งในตลาดและผ่านสัญญาได้อย่างมีนัยสำคัญ ซึ่งประเมินเชิงอนุมานว่าอาจลดต้นทุนการดำเนินงานรวม (Opex) ได้ในระดับ ประมาณ 8–20% ต่อปี ขึ้นกับปัจจัยสภาพลมและรูปแบบสัญญา

สำหรับผู้บริโภค ผลประโยชน์มาตรงจากการลดต้นทุนการผลิตและการบริหารระบบไฟฟ้า เมื่อฟาร์มลมมีความแน่นอนในการพยากรณ์และการควบคุมภายในสูงขึ้น ตลาดไฟฟ้าจะต้องการกำลังสำรองน้อยลง ส่งผลให้ค่าใช้จ่ายในการจัดการระบบและค่าบริการปรับค่าไฟฟ้าระยะสั้นลดลง ส่งผลให้ ต้นทุนต่อหน่วยพลังงาน (LCOE) ของพลังงานลมอาจลดลงได้ราว 3–7% ในระยะกลางและยาว นอกจากนี้การลดการขัดข้องของอุปกรณ์ยังลดความเสี่ยงด้านความต่อเนื่องการจ่ายไฟ ซึ่งช่วยลดความผันผวนของราคาพลังงานในตลาดไฟฟ้าและลดค่าใช้จ่ายจากการสำรองฉุกเฉิน

ข้อเสนอเชิงนโยบายเพื่อสนับสนุนการนำ AI มาใช้

การขยายการใช้งาน AI เพื่อปรับปรุงประสิทธิภาพฟาร์มลมต้องการกรอบนโยบายที่ชัดเจนและมาตรฐานรองรับ เพื่อให้เกิดผลเชิงเศรษฐกิจอย่างแพร่หลายและยั่งยืน หน่วยงานรัฐควรพิจารณามาตรการต่อไปนี้:

- มาตรฐานข้อมูลและการเปิดเผยข้อมูล: กำหนดรูปแบบข้อมูล (data schema) และมาตรฐานการแลกเปลี่ยนข้อมูลระหว่างผู้ประกอบการ ระบบกริด และผู้พัฒนา AI เพื่ออำนวยความสะดวกในการใช้โมเดลร่วมกันและลดต้นทุนการรวมข้อมูล

- การสนับสนุนเชิงการเงิน: ให้สิทธิประโยชน์ทางภาษีหรือเงินอุดหนุนสำหรับการติดตั้งระบบ AI และเซนเซอร์ การตั้งกองทุนร่วม (co‑funding) สำหรับโครงการนำร่อง และการให้สินเชื่อดอกเบี้ยต่ำแก่ผู้ประกอบการที่ลงทุนในเทคโนโลยีเพิ่มประสิทธิภาพ

- โครงการนำร่องและ regulatory sandbox: เปิดช่องทางสำหรับการทดลองการให้บริการ ancillary services โดยฟาร์มลมที่ใช้ AI ในสภาพแวดล้อมควบคุม เพื่อประเมินรูปแบบการชดเชยและการเข้าตลาดของบริการใหม่ๆ

- กรอบความปลอดภัยไซเบอร์และความโปร่งใส: กำหนดข้อกำหนดด้าน cyber‑security สำหรับการเชื่อมต่อ AI กับระบบควบคุม (SCADA/SCADA‑RT) รวมถึงข้อกำหนดด้านการตรวจสอบและการอธิบายผลการตัดสินใจของระบบ AI เพื่อสร้างความเชื่อมั่นแก่ผู้มีส่วนได้เสีย

- การพัฒนาทักษะแรงงาน: สนับสนุนหลักสูตรฝึกอบรมและการรับรองทักษะด้านการวิเคราะห์ข้อมูลและการบำรุงรักษาเชิงดิจิทัลให้กับบุคลากรในอุตสาหกรรมพลังงานทดแทน

แนวโน้มการวิจัยและการขยายสเกล

ในเชิงวิจัย ทิศทางสำคัญที่ควรได้รับการพัฒนาเพื่อยกระดับประสิทธิภาพและความยืดหยุ่นของระบบคือการขยายจากโซลูชันเดี่ยวไปสู่สถาปัตยกรรมที่สามารถทำงานร่วมกันได้ในระดับเครือข่าย ตัวอย่างของแนวทางวิจัยที่มีประโยชน์ได้แก่:

- Multi‑agent Reinforcement Learning: พัฒนาเอเจนต์หลายตัวที่ทำงานประสานกันระหว่างเทอร์ไบน์ เพื่อให้การตัดสินใจแบบกระจายเป็นไปอย่างมีประสิทธิภาพและรองรับการแทรกแซงเฉพาะจุดโดยไม่กระทบทั้งฟาร์ม

- Transfer Learning ข้ามไซต์: ใช้โมเดลที่เรียนรู้จากฟาร์มหนึ่งเพื่อเร่งการปรับจูนในฟาร์มใหม่ (sim‑to‑real และ cross‑site transfer) ลดเวลาในการเทรนนิ่งและค่าใช้จ่ายในการเก็บข้อมูล

- Federated Learning และการรักษาความเป็นส่วนตัวของข้อมูล: อนุญาตให้หลายฟาร์มแชร์แบบจำลองและปรับปรุงร่วมกันโดยไม่ต้องเปิดเผยข้อมูลดิบของแต่ละไซต์

- Hybrid models (physics‑informed ML): ผสานความรู้ทางฟิสิกส์กับโมเดลเชิงสถิติ/ML เพื่อเพิ่มความทนทานต่อการเปลี่ยนแปลงสภาพแวดล้อมและเพิ่มความสามารถในการอธิบายผล

- Safe and Explainable RL: วิจัยกลไกการรับประกันความปลอดภัยของนโยบายที่เรียนรู้ได้และการให้เหตุผลแบบตรวจสอบได้ เพื่อการยอมรับทางกฎระเบียบ

การขยายสเกลเชิงปฏิบัติจะเห็นการรวมฟาร์มลมหลายไซต์เข้ากับกริดอัจฉริยะ (smart grid) และระบบ Virtual Power Plant (VPP) ที่สามารถส่งมอบบริการ ancillary services เช่น frequency response หรือ voltage support ซึ่งช่วยเพิ่มรายได้ให้ผู้ประกอบการและลดภาระการจัดการของระบบโดยรวม บทพิสูจน์แนวคิด (pilot) ที่มีการวัดผลชัดเจนในช่วง 1–3 ปีแรกจะเป็นกุญแจสำคัญ โดยคาดว่าโซลูชันที่ผ่านการพิสูจน์แล้วจะลด payback period ของการลงทุน AI ได้เหลือ ประมาณ 2–4 ปี ในหลายกรณี และรองรับการขยายฟีเจอร์ไปยังฟาร์มอื่นๆ ผ่านการเรียนรู้ร่วมกันและมาตรฐานข้อมูลกลาง

บทสรุป

การผสานโมเดล Transformer‑Forecast สำหรับการพยากรณ์ลมร่วมกับนโยบาย Reinforcement Learning ในการปรับจูนมุมใบพัดเรียลไทม์ทำให้โรงไฟฟ้าพลังลมในไทยสามารถลดปริมาณการสำรองพลังงานที่จัดเตรียมเกินจำเป็นและอัตราการขัดข้องของชุดกังหันได้อย่างมีนัยสำคัญ โดยการทดลองเชิงปฏิบัติการและการติดตั้งเชิงพาณิชย์รายงานการลดทั้งสองด้านราว 25–30% ส่งผลให้ความมั่นคงของกริดเพิ่มขึ้น การใช้กำลังผลิตมีประสิทธิภาพขึ้น ลดการเรียกใช้งานโรงไฟฟ้าสำรอง และลดค่าใช้จ่ายด้านการปฏิบัติการและบำรุงรักษา ทั้งนี้เทคนิคดังกล่าวใช้การพยากรณ์ความเร็วลมที่ละเอียดร่วมกับการตัดสินใจแบบเรียนรู้จากผลตอบแทนจริงเพื่อปรับมุมใบพัดแบบไดนามิก

ความสำเร็จในระยะยาวของโซลูชันนี้ขึ้นกับปัจจัยด้านโครงสร้างพื้นฐานและการกำกับดูแล ได้แก่ คุณภาพและความถี่ของข้อมูลจากเซนเซอร์ การออกแบบสถาปัตยกรรม edge‑cloud ที่รองรับการประมวลผลเรียลไทม์และการซิงโครไนซ์ข้อมูล การป้องกันความปลอดภัยไซเบอร์ที่เข้มงวด (เช่น การเข้ารหัส การยืนยันตัวตน และแผนตอบสนองเหตุการณ์) และกรอบนโยบายที่สนับสนุนการนำ AI มาใช้ในโครงสร้างพื้นฐานพลังงาน เช่น มาตรฐานการทดสอบ การรับรองความน่าเชื่อถือ และแรงจูงใจทางการเงิน สำหรับอนาคต คาดว่าจะเห็นการขยายผลไปยังคลัสเตอร์กังหันขนาดใหญ่ การผสานระบบจัดเก็บพลังงาน การปรับให้สอดคล้องกับตลาดการประมูลไฟฟ้า และการพัฒนาแรงงานและนโยบายกำกับดูแลเพื่อจัดการความเสี่ยงและเพิ่มประสิทธิผลของกริดอย่างยั่งยืน