รายงานใหม่จากกลุ่มนักวิจัยด้านความปลอดภัยดิจิทัลเผยเบื้องหลังที่น่าตกใจ: เครือข่ายปฏิบัติการที่เชื่อมโยงกับกลุ่มในจีนใช้ ChatGPT และเครื่องมือปัญญาประดิษฐ์อื่น ๆ ในการผลิตข้อความยุยง ปลอมตัวเป็นบุคคลจริง สร้างบัญชีปลอม และจัดแคมเปญกลั่นแกล้งแบบข้ามพรมแดนเพื่อโจมตีผู้วิจารณ์สื่อ นักข่าวสืบสวน และนักเคลื่อนไหว ผลลัพธ์คือการข่มขู่ทางออนไลน์ การแพร่ข้อมูลบิดเบือน และการชะลอหรือปิดปากเสียงวิพากษ์วิจารณ์ในหลายภูมิภาค

ประเด็นสำคัญ ได้แก่ การนำ AI ไปใช้ในการสร้างเนื้อหาเชิงลบและการปลอมข้อมูลที่ทำให้การระบุแหล่งที่มาเป็นไปได้ยากขึ้น รายงานระบุว่าแคมเปญดังกล่าวมีการกระจายข้อความปลอมและสร้างบัญชีปลอมเป็นจำนวนมาก ครอบคลุมผู้เป้าหมายในหลายประเทศและมีผลกระทบทั้งต่อความปลอดภัยส่วนบุคคลและความเชื่อมั่นต่อสื่อ ซึ่งยิ่งตอกย้ำความจำเป็นที่จะต้องปรับนโยบายความปลอดภัยดิจิทัล เพิ่มการตรวจสอบการใช้ AI และเรียกร้องให้แพลตฟอร์มออนไลน์รับผิดชอบมากขึ้น

บทนำ: การเปิดเผยและความสำคัญของข่าว

บทนำ: การเปิดเผยและความสำคัญของข่าว

การเปิดเผยล่าสุดชี้ให้เห็นว่ากลุ่มที่มีความเชื่อมโยงกับเครือข่ายในจีนได้ใช้ระบบสร้างภาษาธรรมชาติอย่าง ChatGPT เป็นเครื่องมือสำคัญในการขับเคลื่อนแคมเปญกลั่นแกล้งข้ามพรมแดน ซึ่งมุ่งเป้าไปยังผู้วิจารณ์ นักเคลื่อนไหว และบุคคลสาธารณะในหลายประเทศ เหตุการณ์นี้ถูกนำเสนอโดยการร่วมมือระหว่าง นักวิจัยด้านความปลอดภัยไซเบอร์อิสระ และ สำนักข่าวสืบสวน ซึ่งอาศัยการวิเคราะห์ข้อมูลเมตา ทรานสคริปต์ของบทสนทนา และโครงข่ายบัญชีออนไลน์เพื่อสรุปพฤติกรรมที่เป็นระบบและมีการประสานงานอย่างเป็นลำดับขั้น

ผู้เปิดเผยระบุหลักฐานเชิงเทคนิคหลายประการ ได้แก่ รูปแบบคำสั่ง (prompts) ที่มีความคล้ายคลึงกัน ข้อความที่สร้างขึ้นแบบอัตโนมัติซ้ำ ๆ และเครือข่ายบัญชีเทียมที่ประสานการโพสต์เพื่อเสริมแรงส่งต่อ ข้อค้นพบชี้ให้เห็นว่ามีการใช้บัญชีเทียมจำนวน ตั้งแต่ระดับหลายร้อยไปจนถึงหลายพันบัญชี ในการเปิดตัวข้อความยุยงและการปลอมตัวเพื่อให้ดูเป็นความคิดเห็นจากพลเมืองทั่วไป นอกจากนี้ยังพบการใช้ข้อความที่ปรับแต่งเพื่อเจาะจงลักษณะส่วนบุคคลของเป้าหมาย เช่น การนำข้อมูลส่วนตัวจากแหล่งสาธารณะมาสร้างข้อความโจมตีหรือข่มขู่

ภาพรวมพฤติกรรมที่ถูกเปิดเผยสามารถสรุปได้เป็นประเด็นหลักดังนี้

- การสร้างข้อความยุยงและข้อมูลเท็จ: ใช้ ChatGPT เพื่อผลิตบทความ คอมเมนต์ และข้อความสื่อสังคมที่ดูเป็นธรรมชาติแต่มีเจตนาทำลายชื่อเสียง

- การปลอมตัวเป็นบุคคล: การสร้างข้อความในน้ำเสียงของบุคคลจริงหรือสร้างโปรไฟล์ที่เลียนแบบบุคคลเป้าหมายเพื่อทำให้ข้อมูลผิดเชื่อถือได้

- การประสานบัญชีเทียม (sockpuppet): เครือข่ายบัญชีที่ประสานกันเพื่อขยายความแพร่หลายของเนื้อหาและสร้างภาพว่ามีการสนับสนุนจากสาธารณะ

ความสำคัญของการเปิดเผยนี้มีสองมิติหลักต่อสาธารณะและภาคดิจิทัล: ด้านความปลอดภัยข้อมูลและด้านเสรีภาพในการแสดงความคิดเห็น ในแง่ความปลอดภัย ข้อมูลส่วนบุคคลที่ถูกรวบรวมและนำมาใช้ร่วมกับข้อความที่สร้างโดย AI เสี่ยงต่อการถูกคุกคามทางไซเบอร์ เช่น การเปิดเผยข้อมูล (doxxing) หรือการพยายามแฮกบัญชีที่เกี่ยวข้อง สำหรับเสรีภาพการแสดงความเห็น การโจมตีที่มีการประสานและปรับแต่งอย่างเป็นระบบสามารถสร้างผลกระทบเชิงสังคมและจิตวิทยาที่ทำให้ผู้วิจารณ์เงียบหรือถอนตัวจากการแสดงความเห็น ซึ่งเป็นผลกระทบที่ส่งผลต่อสาธารณชนในวงกว้างและท้าทายการกำกับดูแลของแพลตฟอร์มดิจิทัล

การเปิดเผยครั้งนี้จึงไม่เพียงเป็นข่าวเชิงเทคนิค แต่เป็นสัญญาณเตือนระดับนโยบายและธุรกิจ: มันสะท้อนถึงความจำเป็นในการปรับปรุงกลไกการตรวจจับ การป้องกันข้อมูลส่วนบุคคล และการบังคับใช้กฎระเบียบข้ามประเทศเพื่อรับมือกับการใช้ AI ในเชิงรุกที่มีเจตนาเป็นอันตรายต่อเสรีภาพสาธารณะและความมั่นคงดิจิทัล

วิธีการปฏิบัติการ: กลุ่มใช้ ChatGPT อย่างไร

วิธีการปฏิบัติการ: กลุ่มใช้ ChatGPT อย่างไร

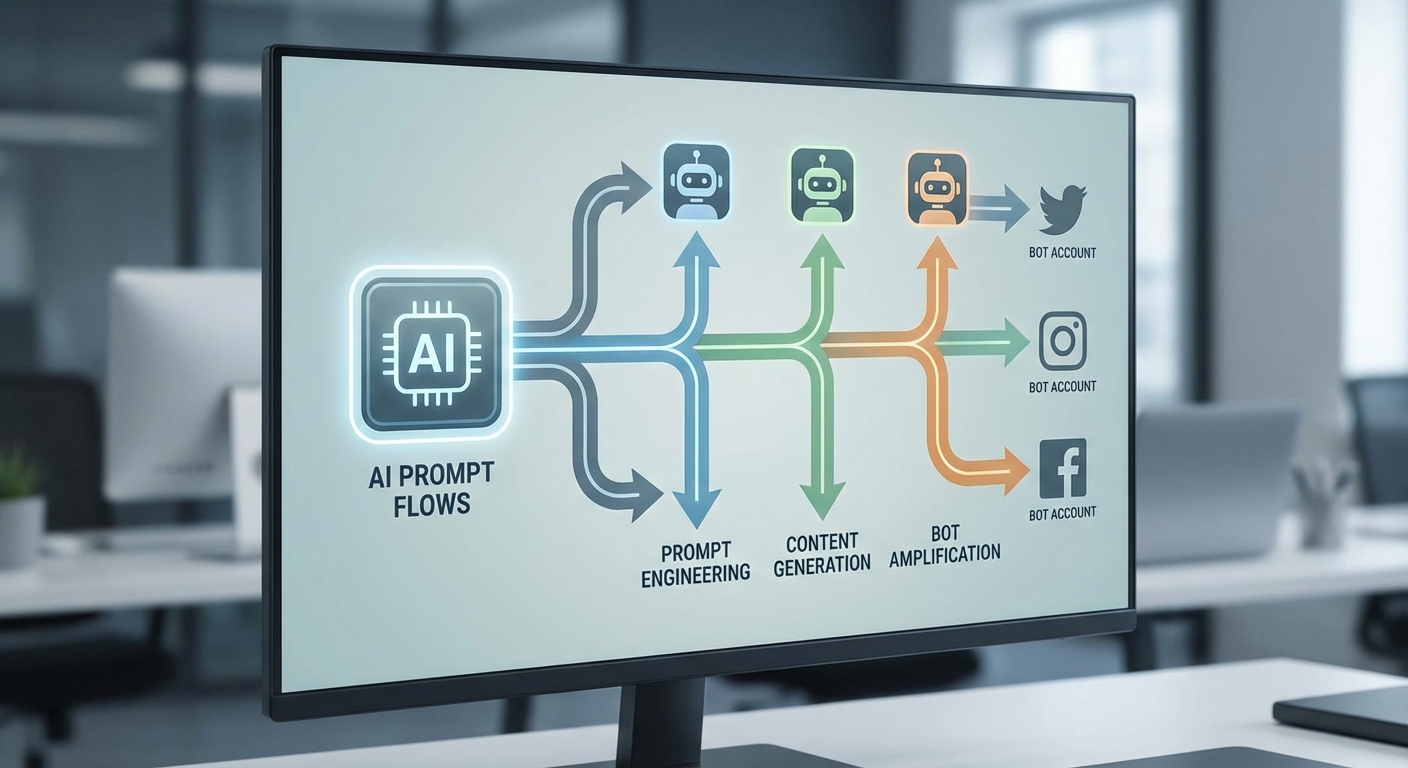

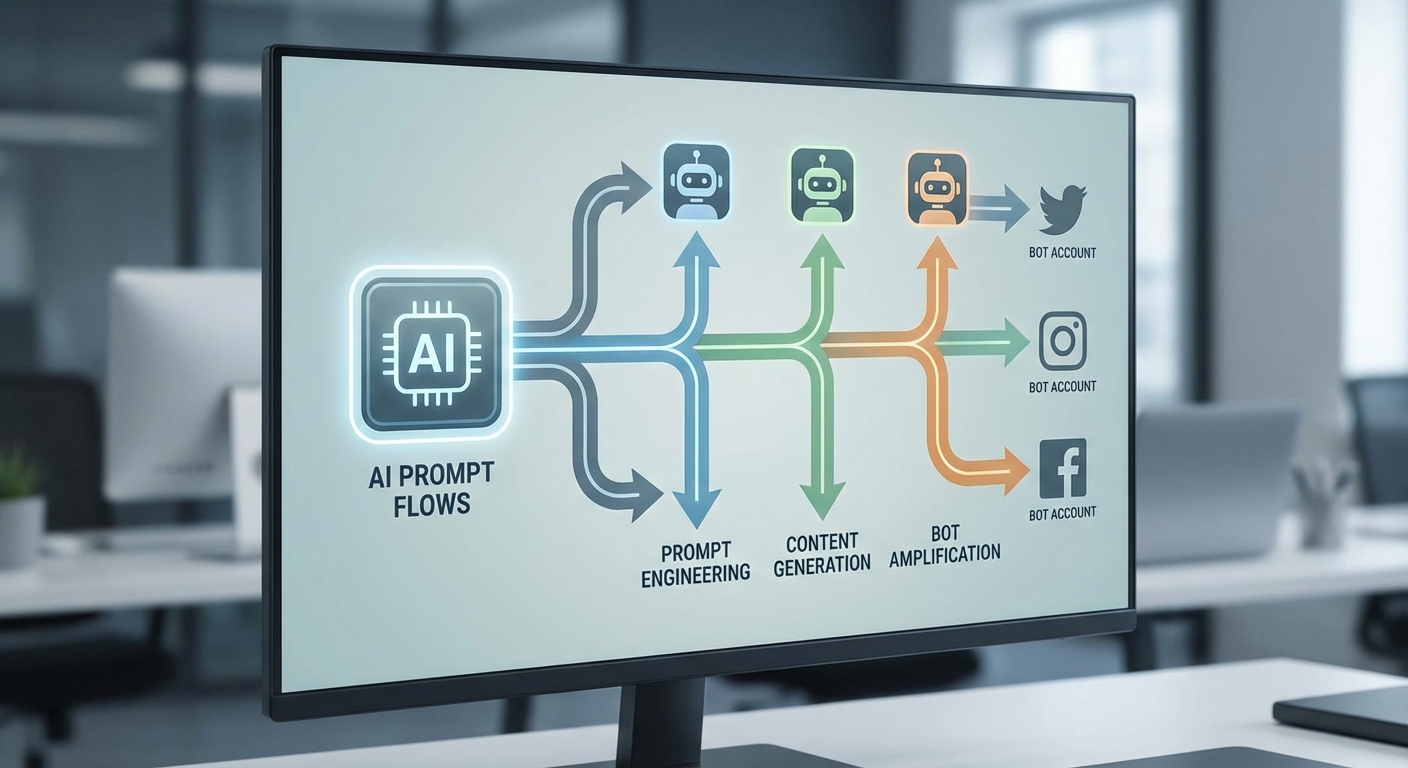

การสอบสวนเชิงข่าวและการวิเคราะห์ทางเทคนิคชี้ให้เห็นว่าแคมเปญกลั่นแกล้งระหว่างประเทศที่ถูกระบุว่ามีความเชื่อมโยงกับกลุ่มจากจีน ใช้โมเดลภาษาขั้นสูง เช่น ChatGPT เป็นส่วนหนึ่งของกระบวนการสร้างเนื้อหาเชิงรุก โดยไม่จำกัดเพียงการเขียนข้อความโจมตีตรงๆ แต่ขยายไปยังการปรับข้อความให้สอดคล้องกับบริบทท้องถิ่น ปรับโทนให้เหมาะกับผู้รับ และสร้างตัวเลือกข้อความหลายรูปแบบเพื่อกระจายความเสี่ยง การใช้โมเดลภาษาเป็นเพียงหนึ่งองค์ประกอบในห่วงโซ่การปฏิบัติการที่ใหญ่กว่า ซึ่งรวมถึงเครือข่ายบัญชีปลอม ระบบอัตโนมัติ และการตรวจวัดผลแบบเรียลไทม์

ในเชิงปฎิบัติ พวกเขาใช้แนวทางของ prompt engineering เพื่อกำหนดโทนและกรอบข้อมูล โดยจะมีชุดประเภท prompt ที่ใช้อย่างเป็นระบบ ตัวอย่างเชิงอธิบายของประเภท prompt ที่พบ ได้แก่:

- Prompt ประเภทการปรับโทน (Tone calibration): คำแนะนำเชิงคร่าวๆ เพื่อให้โมเดลผลิตข้อความในโทนที่ต้องการ เช่น เป็นการเย้ยหยัน เป็นการตั้งคำถามอย่างสับสน หรือเป็นการนำเสนอข้อมูลเชิงลบในลักษณะที่ปรับให้น่าเชื่อถือ

- Prompt ประเภทการท้องถิ่น화 (Localization templates): โครงร่างที่ขอให้โมเดลแปลงข้อความให้เข้ากับสำนวนท้องถิ่น ภาษาแสลง หรืออ้างอิงวัฒนธรรม เพื่อเพิ่มความสัมพันธ์กับกลุ่มเป้าหมาย

- Prompt ประเภทการกระจายเวอร์ชัน (Variant generation): แนวทางให้สร้างชุดข้อความหลายเวอร์ชันจากกรอบเนื้อหาเดียวกัน เพื่อลดความซ้ำซ้อนและหลีกเลี่ยงการถูกตรวจจับจากอัลกอริทึมที่มองหาลายเซ็นซ้ำ

- Prompt ประเภทการชี้นำเชิงคำถาม (Seeding & framing): รูปแบบที่ออกแบบมาเพื่อวาง “ประเด็น” หรือ “คำถาม” ไว้กับผู้รับ ทำให้การตอบสนองของสาธารณะเบี่ยงไปในทางเดียวกับเป้าหมายของแคมเปญ

ตัวอย่างสคริปต์ที่ใช้เป็นแนวทางมักถูกจัดเก็บในรูปแบบเทมเพลตภายใน (เชิงอธิบายและไม่เปิดเผยข้อมูลลับ) เช่น เทมเพลตบรีฟที่ระบุเป้าหมาย ทางวัฒนธรรมที่ต้องปรับ สไตล์การสื่อสารที่ต้องการ และรายการคำที่ต้องหลีกเลี่ยง สคริปต์เหล่านี้ทำหน้าที่เป็นแม่แบบให้ผู้ดำเนินการหรือระบบอัตโนมัติส่งคำขอไปยังโมเดล และมักมีชั้นการตรวจสอบโดยมนุษย์ก่อนเผยแพร่จริงเพื่อลดความเสี่ยงและปรับแต่งสุดท้าย

ด้านการเชื่อมต่อทางเทคนิค ระหว่างโมเดลภาษากับเครือข่ายบัญชีปลอม มักเป็นสถาปัตยกรรมแบบหลายชั้น ประกอบด้วย:

- ชั้นการสร้างเนื้อหา: โมเดลภาษาผลิตร่างข้อความ เวอร์ชันต่างๆ และคำแนะนำในการโพสต์

- ชั้นการประมวลผลและปรับแต่ง: ซอฟต์แวร์หรือมนุษย์ปรับคำ ให้เข้ากับสำนวนท้องถิ่น ตรวจความสมเหตุสมผล และคัดเลือกรูปแบบที่จะส่งต่อ

- ชั้นการกระจายผ่านบัญชี: เครือข่ายบัญชีปลอมและบอทรับข้อความที่ผ่านการอนุมัติแล้ว และทำการโพสต์หรือส่งต่อบนแพลตฟอร์มเป้าหมาย

- ชั้นการวัดผลและขับเคลื่อนซ้ำ: ระบบวิเคราะห์ปฏิกิริยา (engagement, sentiment) เพื่อปรับเทมเพลตและกลยุทธ์แบบเรียลไทม์

ในการหลีกเลี่ยงการตรวจจับ (evasion) แคมเปญมักใช้ชุดเทคนิคที่ไม่ซับซ้อนแต่มีประสิทธิภาพเมื่อใช้อย่างต่อเนื่อง ได้แก่ การเปลี่ยนสำนวนและโครงสร้างประโยคอย่างเป็นระบบ การกระจายเวลาโพสต์และความถี่เพื่อเลียนแบบพฤติกรรมผู้ใช้จริง การใช้บัญชีหลากหลายอายุและประวัติ การสลับใช้แพลตฟอร์ม และการผสมผสานระหว่างการโพสต์อัตโนมัติกับการแทรกแซงจากมนุษย์เพื่อหลอกล่อระบบตรวจจับอัตโนมัติ โดยมีการวัดผลเป็นตัวชี้วัดเพื่อทดสอบว่าแนวทางใดมีความเสี่ยงต่ำที่สุด

ตัวอย่างเชิงตัวเลขจากการศึกษาเคสแคมเปญต่างประเทศระบุว่า เครือข่ายบัญชีปลอมสามารถสร้างโพสต์ได้เป็นพันรายการต่อวันสำหรับแคมเปญขนาดกลาง และการผสานโมเดลภาษาเข้ากับกระบวนการอัตโนมัติสามารถเพิ่มความเร็วในการผลิตเนื้อหาได้หลายเท่า ซึ่งทำให้การตอบโต้เชิงนโยบายและการบล็อกต้องอาศัยการตรวจสอบเชิงคุณภาพควบคู่ไปกับเทคนิคเชิงปริมาณ

สำหรับภาคธุรกิจและผู้กำหนดนโยบาย ข้อสังเกตที่สำคัญคือการเฝ้าระวังควรครอบคลุมตั้งแต่ระดับข้อความ (linguistic signals) ระดับพฤติกรรมบัญชี และระดับสถาปัตยกรรมการแจกจ่ายข้อมูล การเข้าใจรูปแบบการใช้โมเดลภาษาในภูมิทัศน์ภัยคุกคามช่วยให้สามารถออกแบบมาตรการตอบโต้ที่เหมาะสม เช่น การเสริมความสามารถในการตรวจจับลักษณะการเปลี่ยนเวอร์ชันของข้อความ การตรวจสอบเครือข่ายบัญชี และมาตรการความยืดหยุ่นของชุมชนออนไลน์

ขอบเขตและสถิติ: ข้อมูลเชิงปริมาณของแคมเปญ

ขอบเขตและสถิติ: ข้อมูลเชิงปริมาณของแคมเปญ

การวิเคราะห์เชิงปริมาณจากทีมวิจัยสื่อสารสนเทศและความปลอดภัยเปิดเผยว่าแคมเปญกลั่นแกล้งซึ่งอาศัยการสร้างข้อความด้วย ChatGPT มีขนาดและความต่อเนื่องที่สำคัญในระดับสากล โดยสรุปเบื้องต้น พบว่าโครงสร้างการเผยแพร่มีทั้งโพสต์ที่เป็นข้อความยาว ข้อความสั้น ลิงก์ และคอมเมนต์อัตโนมัติ ซึ่งถูกปล่อยออกมาอย่างเป็นระบบเพื่อลดทอนชื่อเสียงผู้วิจารณ์และชี้ขาดการรับรู้ของสาธารณะ

ปริมาณเนื้อหา: ตัวเลขที่ได้รับจากการสกัดข้อมูลและการตรวจสอบเครือข่ายแสดงให้เห็นว่าแคมเปญผลิตเนื้อหาในระดับหลักพันถึงหลักหมื่นข้อความต่อเดือน ตัวอย่างเช่น งานวิจัยหนึ่งระบุการสร้างข้อความประมาณ 3,000–20,000 ข้อความต่อเดือน ในช่วงการระบาดของกิจกรรมที่เข้มข้นที่สุด โดยเมื่อรวมการรีโพสต์และคอมเมนต์อัตโนมัติแล้ว ปริมาณข้อความรวมตลอดระยะเวลา 12 เดือนอาจสูงถึง 100,000–250,000 ชิ้น ทั้งนี้ตัวเลขขึ้นกับพารามิเตอร์การสุ่มตัวอย่างและช่วงเวลาที่ศึกษา

บัญชีผู้เผยแพร่และเครือข่าย: นักวิจัยระบุว่ามีบัญชีที่เกี่ยวข้องในเครือข่ายตั้งแต่ระดับพันถึงหลายพันบัญชีที่ใช้ร่วมกันหรือสลับกันเผยแพร่ข้อมูล โดยประมาณการเบื้องต้นชี้ว่าเครือข่ายที่ถูกระบุมีจำนวนบัญชีประมาณ 2,500–8,000 บัญชี ซึ่งรวมทั้งบัญชีจริงที่ถูกแฮ็ก บัญชีปลอม และแอคเซาท์ที่ทำงานร่วมกันแบบประสานงานได้ (coordinated inauthentic behavior)

- จำนวนโพสต์เฉลี่ยต่อบัญชี: 4–30 โพสต์ต่อเดือน ขึ้นกับบทบาทของบัญชี (ผู้ผลิตเนื้อหา vs. ผู้กระจาย)

- โพสต์ที่มีลักษณะ/รูปแบบซ้ำซ้อน: ราว 40–65% ของเนื้อหาทั้งหมด

- ระยะเวลาแคมเปญที่สังเกตได้: โดยทั่วไปมีช่วงยาวตั้งแต่ 12–24 เดือน พร้อมจังหวะเพิ่มความถี่เป็นช่วง ๆ

การกระจายเชิงภูมิศาสตร์: แผนที่การกระจาย (ดูภาพประกอบด้านบน) แสดงให้เห็นว่าแคมเปญมีการกระจายข้ามทวีป โดยพื้นที่ที่ได้รับผลกระทบมากที่สุดได้แก่ เอเชียตะวันออกเฉียงใต้ ยุโรปตะวันตก และอเมริกาเหนือ นักวิจัยพบหลักฐานของกิจกรรมที่สามารถสืบย้อนกลับมาส่งผลกระทบในมากกว่า 30–60 ประเทศ ขึ้นอยู่กับเกณฑ์การนับ (เช่น การมีส่วนร่วมขั้นต่ำหรือการมองเห็นขั้นต่ำในแต่ละประเทศ)

ดัชนีการเข้าถึงและการมีส่วนร่วม (engagement): เพื่อประมาณผลกระทบ ทีมวิเคราะห์ได้ประเมินตัวชี้วัดเช่น การแสดงผล (impressions), การถูกใจ/รีแอคชั่น, คอมเมนต์ และการแชร์ ผลลัพธ์เบื้องต้นสรุปได้ว่า:

- Impressions รวมที่ประมาณการ: 50–450 ล้านครั้ง ในช่วงระยะเวลาแคมเปญ ขึ้นกับเครือข่ายการกระจายและแพลตฟอร์มที่ใช้

- อัตราการมีส่วนร่วมเฉลี่ยต่อโพสต์: 10–200 การมีส่วนร่วม (รวมไลก์ คอมเมนต์ แชร์) ต่อโพสต์ โดยโพสต์ที่อาศัยเนื้อหาเชิงโจมตีมักมีอัตรสูงกว่ามาตรฐาน

- การขยายวง (secondary amplification): ประมาณ 20–35% ของการมีส่วนร่วมมาจากบัญชีที่ไม่เกี่ยวข้องโดยตรง แต่ถูกชักนำให้เข้าร่วมผ่านการแชร์หรือการขยับแนวโน้ม (trending) ซึ่งเพิ่มผลกระทบเหนือการควบคุมของผู้วิจัย

เมื่อพิจารณาร่วมกัน ข้อมูลเชิงปริมาณชี้ให้เห็นว่าแคมเปญดังกล่าวไม่ใช่การปะทุชั่วคราว แต่เป็นโครงงานที่มีทั้งความต่อเนื่องและความสามารถในการเข้าถึงกลุ่มเป้าหมายในหลายประเทศและภูมิภาค ซึ่งสร้างความเสี่ยงต่อการรับรู้สาธารณะและความปลอดภัยของผู้วิจารณ์ ตัวเลขเหล่านี้ยังต้องการการตรวจสอบและการยืนยันข้ามแหล่งข้อมูลเพิ่มเติม แต่ให้กรอบเชิงตัวเลขที่เพียงพอสำหรับนโยบายการตอบโต้และการออกแบบมาตรการป้องกัน

ตัวอย่างเคสศึกษา: ใครบ้างได้รับผลกระทบ

ตัวอย่างเคสศึกษา: ใครบ้างได้รับผลกระทบ

การสืบสวนพบว่าเหยื่อของแคมเปญกลั่นแกล้งมีความหลากหลาย ทั้งนักข่าว นักวิจารณ์ นโยบายสาธารณะ รัฐมนตรีท้องถิ่น และผู้เคลื่อนไหวด้านสิทธิมนุษยชน ในภาพรวม ลักษณะการโจมตีมักเป็นการสร้างเรื่องเท็จ การสร้างบัญชีปลอมเพื่อแอบอ้างและเผยแพร่ข้อความลบต่อเนื่อง รวมถึงการประสานงานข้ามแพลตฟอร์มเพื่อขยายผลกระทบ ทำให้เหยื่อได้รับความเสียหายทั้งระดับชื่อเสียงและความปลอดภัยส่วนบุคคล

กรณีแบบ A — นักข่าว: การสร้างข่าวลือและบัญชีปลอมแอบอ้าง

ตัวอย่างที่เป็นตัวแทนคือกรณีนักข่าวอาวุโสของสำนักข่าวระดับภูมิภาค ถูกโจมตีด้วยชุดโพสต์ที่ประดิษฐ์ข้อเท็จจริงและภาพนิ่งที่ตัดต่อเพื่อให้ดูเหมือนหลักฐานการทุจริต ข้อความเหล่านี้ถูกเผยแพร่โดยบัญชีโซเชียลมีเดียมากกว่า 30 บัญชี ซึ่งส่วนใหญ่เป็นบัญชีที่เพิ่งสร้างขึ้นภายในช่วง 2–6 สัปดาห์ก่อนการโจมตี หลักฐานที่ตรวจยืนยันรวมถึงการจับคู่ข้อความซ้ำซ้อน (textual fingerprinting) การวิเคราะห์เวลาสร้างบัญชีและรูปแบบเวลาการโพสต์ ซึ่งชี้ว่าการเผยแพร่ถูกประสานงานอย่างมีแบบแผน ผลกระทบต่อเหยื่อรวมถึงการสูญเสียแหล่งข่าวบางส่วน การเรียกร้องให้มีการสอบสวน และการรับข้อความข่มขู่ทางตรง ส่งผลให้นักข่าวต้องลดบทบาทการปรากฏตัวสาธารณะชั่วคราว

กรณีแบบ B — นักเคลื่อนไหว: การลักลักษณ์ แปลความหมาย และการข่มขู่จนต้องหลบหน้าออนไลน์

อีกตัวอย่างหนึ่งเป็นนักเคลื่อนไหวด้านสิทธิมนุษยชนซึ่งเป็นเป้าหมายของการบิดเบือนข้อความที่เคยกล่าวไว้ โดยมีการตัดต่อวาทกรรมจากการพูดสาธารณะและแยกออกมานำเสนอในบริบทที่บิดเบือน รวมถึงการแพร่กระจายข้อมูลส่วนตัว (doxxing) และการข่มขู่ทางโทรศัพท์/ข้อความ ซึ่งบ่งชี้ถึงการรวบรวมข้อมูลจากหลายแหล่ง เช่น บัญชีโซเชียลที่เชื่อมโยงกันและฐานข้อมูลสาธารณะ เหยื่อรายนี้ต้องปิดบัญชีบางส่วน เลื่อนการเดินทางสาธารณะ และรายงานว่ามีครอบครัวได้รับผลกระทบจากการข่มขู่ด้วย

แนวทางการตรวจสอบและหลักฐานที่ใช้ยืนยันเหตุการณ์

- การวิเคราะห์เมตาดาต้าและเวลาสร้างบัญชี: ตรวจสอบเวลาที่บัญชีถูกสร้าง การเชื่อมโยง IP เบื้องต้นจากบันทึกเซิร์ฟเวอร์ และรูปแบบเวลาการโพสต์ที่บ่งชี้การประสานงาน (เช่น ช่วงเวลาโพสต์ซ้ำ ๆ ตรงกันในหลายบัญชี)

- Fingerprinting ของข้อความและภาพ: การค้นหาข้อความหรือประโยคที่ซ้ำกันข้ามแพลตฟอร์ม การจับคู่แฮชของภาพหรือการใช้ reverse image search เพื่อยืนยันว่ารูปถ่ายถูกดัดแปลงหรือใช้ซ้ำจากแหล่งเดียวกัน

- การตรวจสอบบัญชีปลอมและเครือข่าย: การสแกนเครือข่ายผู้ติดตาม/การติดตามย้อนกลับ เห็นรูปแบบบัญชีที่มีลักษณะเป็นบ็อตหรือบัญชีเปล่า (no profile activity) และการเชื่อมโยงแบบกราฟระหว่างบัญชีที่สนับสนุนข้อความเดียวกัน

- หลักฐานเชิงเทคนิคจากแพลตฟอร์ม: รายงานการละเมิดที่ยื่นต่อโซเชียลมีเดียซึ่งนำไปสู่การระงับบัญชีและการเปิดเผยเมตาดาต้าบางส่วนจากแพลตฟอร์มหลังการร้องขอ (เช่น IP ranges, device fingerprints)

- การวิเคราะห์เชิงภาษาและรูปแบบการป้อนข้อมูลจากโมเดล: การจับลายเซ็นเชิงภาษาที่สอดคล้องกับ prompt หรือรูปแบบการตอบของโมเดลภาษาที่ใช้ ซึ่งช่วยเชื่อมโยงเนื้อหาไปยังแหล่งกำเนิดการผลิตข้อความอัตโนมัติ

- พยานและเอกสารประกอบ: ข้อความขู่ที่ถูกบันทึก โทรศัพท์ หรืออีเมล รวมถึงการยืนยันจากผู้ถูกกล่าวหา/พยานภายในเครือข่ายว่ามีการประสานงานจริง

จากการรวมกันของหลักฐานเชิงเทคนิคและพยานทำให้ทีมสืบสวนสามารถเชื่อมโยงรูปแบบการโจมตีไปยังแคมเปญเดียวกันได้ในหลายกรณี โดยตัวชี้วัดสำคัญ ได้แก่ อัตราการซ้ำของข้อความ (overlap rate) ที่เกิน 70% ในกลุ่มตัวอย่างบางชุด เวลาและภูมิภาคการโพสต์ที่สอดคล้องกัน และการเปิดเผยเมตาดาต้าจากแพลตฟอร์มที่ยืนยันแหล่งที่มาของบางบัญชี การสรุปผลเชิงหลักฐานเหล่านี้ช่วยให้องค์กรสื่อและหน่วยงานที่เกี่ยวข้องดำเนินมาตรการตอบโต้ ทั้งการระงับบัญชี แจ้งความ และออกคำเตือนต่อสาธารณะได้อย่างมีน้ำหนัก

ผลกระทบต่อสังคมและเสรีภาพการแสดงออก

ผลกระทบต่อสังคมและเสรีภาพการแสดงออก

การเปิดเผยแคมเปญกลั่นแกล้งที่ใช้ ChatGPT เป็นเครื่องมือสร้างเนื้อหาเชิงโจมตีสะท้อนให้เห็นผลกระทบเชิงสังคมที่ทั้งรวดเร็วและยืดเยื้อ ในระยะสั้น สิ่งที่เกิดขึ้นคือการเพิ่มขึ้นของเนื้อหาปลอมที่มีลักษณะเป็นมนุษย์ (human-like) จำนวนมาก ซึ่งสามารถแพร่กระจายในแพลตฟอร์มสื่อสังคมอย่างรวดเร็ว ส่งผลให้ผู้สื่อข่าว นักวิจารณ์ และนักกิจกรรมต้องพิจารณาถึงความเสี่ยงก่อนจะโพสต์ความเห็นหรือรายงานข่าว ความเสี่ยงนี้มักนำไปสู่ self-censorship โดยผู้ที่วิตกว่าจะถูกโจมตีหรือถูกกลั่นแกล้งเลือกที่จะหลีกเลี่ยงการแสดงความคิดเห็นที่ตรงไปตรงมา ผลกระทบเช่นนี้ไม่เพียงทำให้เสียงวิจารณ์ลดลงเท่านั้น แต่ยังบั่นทอนการถกเถียงสาธารณะที่มีคุณภาพ

ในระยะยาว การแพร่กระจายของข้อมูลที่สร้างโดย AI มีแนวโน้มลดทอน คุณภาพของข้อมูลสาธารณะ และทำให้ประชาชนยากจะคัดกรองความจริงจากเรื่องราวเท็จ เมื่อความน่าเชื่อถือของแหล่งข้อมูลลดลง การตัดสินใจทางสังคม ทั้งในระดับบุคคล (เช่น การเลือกข่าวสารเพื่อตัดสินใจเกี่ยวกับสุขภาพหรือการเงิน) และในระดับนโยบาย (เช่น การกำหนดทิศทางการเมืองหรือมาตรการสาธารณะ) อาจถูกชักนำด้วยข้อมูลบิดเบือนหรือการเล่าเรื่องที่มีจุดมุ่งหมายเชิงยุทธศาสตร์ งานวิเคราะห์หลายฉบับชี้ว่าการเพิ่มขึ้นของบัญชีปลอมและบอตส่งผลให้ปริมาณข้อความเชิงลบต่อเป้าหมายหนึ่งเพิ่มขึ้นหลายเท่าในช่วงรณรงค์การโจมตี ทำให้ประชาชนรับรู้ภาพรวมสาธารณะในแบบที่คลาดเคลื่อน

นอกจากผลต่อความเชื่อมั่นแล้ว ยังมี ความเสี่ยงทางจริยธรรม ที่สำคัญเมื่อนำ AI มาใช้ในปฏิบัติการเชิงการเมือง เช่น ปัญหาความรับผิดชอบ (accountability) เมื่อเกิดการละเมิดหรือแพร่ข้อมูลเท็จ ผู้สืบสวนและผู้เสียหายมักประสบความยากลำบากในการระบุผู้กระทำผิดที่แท้จริง เนื่องจากเทคนิคการปกปิดร่องรอยและการใช้ตัวกลางระหว่างประเทศ นอกจากนี้มีความเสี่ยงด้านการเลือกปฏิบัติและการละเมิดสิทธิมนุษยชนเมื่อกลุ่มหรือรัฐใช้ AI เพื่อกำหนดเป้าหมายเฉพาะกลุ่ม ทำให้เกิดการขัดขวางการแสดงออกอย่างไม่เป็นธรรมและการบิดเบือนกระบวนการสาธารณะ

ผลกระทบเชิงพฤติกรรมและสังคมยังรวมถึงการสร้างสภาวะความหวาดกลัว (chilling effect) ที่ขยายวงกว้าง เมื่อผู้วิจารณ์เห็นตัวอย่างการถูกกลั่นแกล้งหรือการถูกรุมโจมตี การรับรู้ว่าการแสดงความคิดเห็นอาจนำไปสู่ความเสี่ยงส่วนบุคคลสูงจะทำให้เสียงที่มีบทบาทตรวจสอบอำนาจหดหายไป ซึ่งสิ่งนี้ส่งผลกระทบต่อความโปร่งใสขององค์กรและการกำกับดูแลภาครัฐในระยะยาว

- Self-censorship: แรงกดดันจากการคุกคามออนไลน์กระตุ้นให้สื่อและนักวิจารณ์หลีกเลี่ยงประเด็นที่อ่อนไหว ซึ่งลดการตรวจสอบอำนาจและความหลากหลายของมุมมอง

- คุณภาพข้อมูลและการตัดสินใจ: การล้นหลามของเนื้อหาเทียมทำให้สังคมต้องพึ่งพากลไกตรวจสอบที่ดีขึ้น มิฉะนั้นการตัดสินใจส่วนบุคคลและนโยบายสาธารณะอาจถูกบิดเบือน

- ความเสี่ยงทางจริยธรรม: การใช้ AI ในปฏิบัติการเชิงการเมืองสร้างคำถามเรื่องความรับผิดชอบ การโปร่งใส และการคุ้มครองสิทธิมนุษยชน ทั้งในระดับผู้พัฒนาแพลตฟอร์มและผู้ใช้งาน

เพื่อบรรเทาผลกระทบ จำเป็นต้องมีมาตรการผสมผสานทั้งทางเทคนิค นโยบาย และสังคม ได้แก่ การพัฒนาวิธีตรวจจับเนื้อหา AI, กรอบกฎหมายที่ชัดเจนเพื่อคุ้มครองผู้วิจารณ์และสื่อ, และมาตรการส่งเสริมความรู้เท่าทันสื่อ (media literacy) ในประชาชน เท่านั้นสังคมจะสามารถรักษาพื้นที่สำหรับการแสดงความเห็นที่เสรีและมีความรับผิดชอบท่ามกลางการเปลี่ยนแปลงทางเทคโนโลยีที่รวดเร็ว

การตอบสนอง: แพลตฟอร์ม เทคโนโลยี และนโยบายสาธารณะ

การตอบสนอง: แพลตฟอร์ม เทคโนโลยี และนโยบายสาธารณะ

เมื่อมีรายงานว่ากลุ่มที่เกี่ยวข้องกับการใช้ ChatGPT เพื่อขับเคลื่อนแคมเปญกลั่นแกล้งต่อผู้วิจารณ์ แพลตฟอร์มผู้ให้บริการโมเดลภาษา เช่น ผู้ให้บริการ API และเจ้าของโมเดล รวมถึงแพลตฟอร์มโซเชียลมีเดีย มักตอบสนองด้วยชุดมาตรการผสมผสาน ทั้งด้านเทคนิค นโยบาย และการประสานงานกับหน่วยงานภายนอก ในเชิงปฏิบัติผู้ให้บริการโมเดลจะเพิ่มการตรวจสอบการใช้งาน (usage monitoring), จำกัดการเข้าถึง API สำหรับพฤติกรรมที่น่าสงสัย, ปรับปรุงกลไกเรียกใช้งานที่ปลอดภัย (safety filters) และออกแนวปฏิบัติการใช้บริการที่ห้ามการละเมิดสิทธิบุคคลหรือการยุยงปลุกปั่น โดยทั่วไปคำชี้แจงอย่างเป็นทางการจากผู้ให้บริการจะเน้นไปที่การยืนยันการตรวจสอบเหตุการณ์ การชี้แจงการปิดกั้นคีย์หรือบัญชีผู้ใช้ที่ฝ่าฝืนนโยบาย และการประกาศแนวทางป้องกันเพิ่มเติม

แพลตฟอร์มโซเชียลมีเดียตอบสนองด้วยการระงับบัญชี การลบเนื้อหา และการติดป้ายเตือน (content labeling) สำหรับโพสต์ที่มีเจตนาระรานหรือบิดเบือน ขณะเดียวกันก็มีการดำเนินการที่เรียกว่า “network takedowns” เพื่อตัดเครือข่ายบัญชีที่ประสานกันเป็นระบบ โดยขั้นตอนตรวจจับและระงับบัญชีที่เกี่ยวข้องมักรวมถึง:

- การวิเคราะห์พฤติกรรมผู้ใช้: ตรวจจับพฤติกรรมการโพสต์ที่ซ้ำซ้อน ความเร็วในการส่งข้อความ และรูปแบบการโต้ตอบที่ผิดปกติ

- การวิเคราะห์เครือข่าย: ใช้กราฟเครือข่ายเพื่อตรวจหาคลัสเตอร์บัญชีที่มีการเชื่อมโยงกันอย่างแปลกประหลาดหรือประสานงานกัน

- การตรวจสอบเมตาดาทาและอุปกรณ์: วิเคราะห์ IP, ฟิงเกอร์พรินต์อุปกรณ์ และพฤติกรรมการสร้างบัญชีเพื่อระบุบัญชีที่อาจเป็นบ็อตหรือบัญชีที่สร้างขึ้นเป็นกลุ่ม

- การใช้โมเดล ML สำหรับจำแนกเนื้อหา: ประยุกต์ใช้โมเดลภาษาร่วมกับกฎระเบียบเพื่อคัดกรองภาษาส่อการยุยง การคุกคาม หรือการเผยแพร่ข้อมูลเท็จ

- กลไกรายงานโดยผู้ใช้: รวมรายงานจากผู้ใช้จริงเป็นสัญญาณเสริมเพื่อเร่งตรวจสอบบัญชีที่อาจเป็นภัย

แม้จะมีมาตรการข้างต้น แต่ข้อจำกัดทางเทคนิคและช่องว่างเชิงนโยบายยังคงมีอยู่และเป็นปัจจัยสำคัญที่ทำให้การตอบโต้ซับซ้อน ตัวอย่างประเด็นที่ต้องพิจารณาได้แก่ การพรางตัวของการสื่อสารผ่านบัญชีหลายชั้น, ความสามารถในการสร้างข้อความที่ดูเหมือนมนุษย์, และปัญหาด้านความเป็นส่วนตัวเมื่อพยายามรวบรวมเมตาดาทาเพื่อพิสูจน์ความประสานงาน นอกจากนี้การใช้เทคนิคการโจมตีเช่น prompt injection หรือการนำโมเดลไปปรับจูนภายนอก (fine-tuning) อาจทำให้ระบบตรวจจับแบบเดิมล้าหลังได้ อีกทั้งนโยบายปัจจุบันมักให้ความสำคัญกับการควบคุมเนื้อหาเชิงกว้าง แต่ยังขาดมาตรการเชิงสถาบันที่ชัดเจนสำหรับกรณีการใช้โมเดลภาษาในรูปแบบเป็นระบบเพื่อการกลั่นแกล้งระยะยาว

ทางด้านกฎหมายและการกำกับดูแล มีแนวทางและมาตรการที่เป็นไปได้หลายประการที่ผู้กำหนดนโยบายควรพิจารณา ได้แก่:

- การบังคับใช้กฎหมายคุ้มครองบุคคลและการล่วงละเมิดออนไลน์: ขยายความหมายของความรับผิดชอบทางแพ่งและอาญาให้ครอบคลุมการใช้ AI ในการกลั่นแกล้งและการลูกรัง

- ข้อกำหนดความโปร่งใสและการรายงาน: บังคับให้แพลตฟอร์มและผู้ให้บริการโมเดลเผยแพร่รายงานการโปร่งใสเป็นประจำ (transparency reports) เกี่ยวกับการระงับบัญชี การลบเนื้อหา และการสืบสวนเครือข่ายแบบประสานงาน

- มาตรฐานการควบคุมการเข้าถึงโมเดล: กำหนดข้อกำหนดด้านการรู้จักผู้ใช้ (KYC) ในระดับความเสี่ยงสูง, ข้อจำกัดอัตราการใช้งาน (rate limits) และระบบการตรวจสอบย้อนหลัง (audit logging) สำหรับการเรียกใช้งาน API ที่มีศักยภาพถูกนำไปใช้ในทางที่ผิด

- การประสานงานข้ามประเทศและแพลตฟอร์ม: เนื่องจากการโจมตีมักข้ามพรมแดน ผู้กำกับควรส่งเสริมความร่วมมือระหว่างประเทศและการแบ่งปันข้อมูลเชิงเทคนิคระหว่างแพลตฟอร์มเพื่อการตอบโต้เชิงรุก

- การคุ้มครองสิทธิพลเมืองและกลไกอุทธรณ์: ออกแบบกระบวนการอุทธรณ์ที่โปร่งใสเพื่อหลีกเลี่ยงการระงับที่ผิดพลาดและรักษาสมดุลระหว่างการจัดการภัยคุกคามและเสรีภาพในการแสดงความเห็น

ตัวอย่างคำชี้แจงเชิงนโยบายที่มักปรากฏในเหตุการณ์ลักษณะนี้ ได้แก่คำสรุปว่าผู้ให้บริการจะ “ระงับการเข้าถึงคีย์ API ที่ใช้ในทางละเมิด, เพิ่มการเฝ้าระวังบัญชีที่มีพฤติกรรมประสานงาน และร่วมมือกับแพลตฟอร์มโซเชียลรวมถึงหน่วยงานบังคับใช้กฎหมาย” ข้อความเช่นนี้สะท้อนแนวปฏิบัติทั่วไป แต่ประสิทธิผลขึ้นกับความสามารถทางเทคนิคของแต่ละองค์กรและกรอบกฎหมายในแต่ละเขตอำนาจ การตอบโจทย์เชิงนโยบายที่ยั่งยืนจึงต้องอาศัยทั้งการปรับปรุงเทคโนโลยีการตรวจจับ การแก้ไขช่องว่างในนโยบาย และการร่วมมือระหว่างภาครัฐ ภาคเอกชน และภาคประชาสังคม

การวิเคราะห์เชิงเทคนิคและคำแนะนำการป้องกัน

การวิเคราะห์เชิงเทคนิคและคำแนะนำการป้องกัน

แคมเปญกลั่นแกล้งที่อาศัยโมเดลภาษาขนาดใหญ่ (Large Language Models – LLMs) เช่น ChatGPT แสดงให้เห็นจุดอ่อนทั้งในเชิงเทคนิคของระบบตรวจจับอัตโนมัติและช่องโหว่เชิงปฏิบัติการของแพลตฟอร์มสื่อสังคมออนไลน์ เหตุผลหลักที่ระบบตรวจจับถูกหลอกได้ประกอบด้วย: ความสามารถของโมเดลในการปรับรูปแบบข้อความให้เหมือนการเขียนของมนุษย์, เทคนิค prompt engineering ที่ทำให้ผลลัพธ์เปลี่ยนไปตามคำสั่งเฉพาะ, และการมีคนกลางแก้ไข (human-in-the-loop) เพื่อหลีกเลี่ยงลายเซ็นที่ระบบตรวจจับมองหา งานวิจัยหลายชิ้นรายงานว่าเครื่องมือตรวจจับ AI-output มีอัตราการถูกหลอก (false negative) อยู่ในช่วงคร่าว ๆ ประมาณ 20–50% ขึ้นอยู่กับวิธีการทดสอบและชนิดของการดัดแปลงข้อความ

เทคนิคตรวจจับที่สามารถนำมาใช้เพื่อเพิ่มความแม่นยำ ได้แก่:

- Fingerprinting ของข้อความ — การวิเคราะห์ลักษณะเชิงสถิติ เช่น n-gram distribution, การใช้คำศัพท์เฉพาะ, ความยาวประโยค และสไตล์ (stylometry) เพื่อสร้างลายนิ้วมือของข้อความที่น่าจะมาจากโมเดลหรือผู้ปฏิบัติการกลุ่มเดียวกัน

- AI-output watermarking — การฝังสัญลักษณ์เชิงสถิติหรือเชิงคริปโตลงไปในลำดับ token ที่สร้างโดยโมเดล (statistical watermarks หรือ cryptographic watermarks) ซึ่งแม้จะไม่เห็นเป็นสายตาแต่สามารถตรวจจับด้วยอัลกอริทึมเฉพาะได้ จุดแข็งคือการยืนยันแหล่งกำเนิดของข้อความ แต่จุดอ่อนคือต้องได้รับความร่วมมือจากผู้ให้บริการโมเดล

- การวิเคราะห์พฤติกรรมเครือข่าย (network behavioral analysis) — การตรวจสอบรูปแบบการโพสต์ เช่น ความถี่ในการโพสต์, เวลา (temporal patterns), ความสัมพันธ์ระหว่างบัญชี (graph clustering), การใช้ IP/UA ซ้ำ และรูปแบบการกระจายข้อความ (information diffusion) เพื่อระบุบัญชีที่ประสานงานเป็นระบบ

แนวทางป้องกันเชิงเทคนิคที่ควรพิจารณารวมถึง:

- Rate-limiting และการจำกัดสิทธิ์การเข้าถึง API — กำหนดเพดานการเรียกใช้งานจาก IP, อุปกรณ์ หรือบัญชี เพื่อยับยั้งการสร้างเนื้อหาจำนวนมากแบบอัตโนมัติ พร้อมเกณฑ์การยืนยันตัวตนเพิ่มเติมเมื่อตรวจพบพฤติกรรมผิดปกติ

- การวิเคราะห์พฤติกรรมแบบเรียลไทม์ — นำโมเดลการตรวจจับพฤติกรรมที่รวมสัญญาณหลายมิติ (textual features + metadata + graph signals) มาใช้งาน โดยให้ความสำคัญกับการตรวจจับกลุ่มบัญชีที่มี pattern เดียวกันมากกว่าการตัดสินจากข้อความทีละชิ้น

- การนำ watermarking มาใช้ในเชิงป้องกัน — สนับสนุนมาตรฐานการฝัง watermark ระดับ industry-wide เพื่อให้แพลตฟอร์มและหน่วยงานตรวจสอบสามารถยืนยันได้ว่าเนื้อหาบางชิ้นมาจากการผลิตของโมเดลหรือไม่

- Provenance metadata และ audit logs — บันทึกแหล่งที่มา (provenance) ของเนื้อหา เช่น token-level signatures, API keys ที่เรียกใช้งาน, และ audit trail เพื่อใช้เป็นหลักฐานทางเทคนิคในการสืบสวนและบล็อกบัญชีที่ละเมิด

- การใช้การยืนยันตัวตนหลายชั้นและ CAPTCHA แบบปรับตัว — เมื่อพบการกระทำที่มีลักษณะเป็นบอทหรือการประสานงาน ให้ใช้การยืนยันตัวตนและการทดสอบเพิ่มเติมเพื่อแยกมนุษย์จากระบบอัตโนมัติ

สำหรับนักข่าวและองค์กรสื่อ ควรปฏิบัติตามแนวทางด้านความปลอดภัยและจริยธรรมเพื่อปกป้องแหล่งข่าวและบุคลากร:

- การสื่อสารที่ปลอดภัย — ใช้ช่องทางเข้ารหัสปลายทาง (end-to-end encryption) เช่น Signal และหลีกเลี่ยงการส่งข้อมูลสำคัญผ่านแพลตฟอร์มที่ไม่ปลอดภัย

- การรักษา metadata — ก่อนเผยแพร่สื่อ ให้ลบหรือทำให้เป็นกลาง metadata ที่อาจเปิดเผยตัวตนของแหล่งข่าว เช่น EXIF ของภาพ, headers ของไฟล์, หรือข้อความที่มีข้อมูลชี้ตำแหน่ง

- การยืนยันแหล่งข้อมูลหลายชั้น — ไม่พึ่งพาแหล่งเดียว โดยใช้เทคนิค cross-verification, การตรวจสอบกับเอกสารต้นทาง และการใช้แหล่งอิสระเพื่อยืนยันข้อเท็จจริง

- นโยบายด้านการรักษาความปลอดภัยภายใน — ฝึกอบรมพนักงานเรื่อง OPSEC, มีแผนตอบโต้กรณีถูกคุกคามออนไลน์, และจำกัดการเข้าถึงข้อมูลสำคัญภายในบรรณาธิการ

ในระดับนโยบาย จำเป็นต้องมีการประสานงานระหว่างภาครัฐ ภาคเอกชน และชุมชนนานาชาติ:

- ความโปร่งใสจากผู้ให้บริการโมเดล — ผู้ให้บริการควรเผยแพร่ model cards และรายงานการใช้งาน API ที่สำคัญ พร้อมสนับสนุนมาตรฐาน watermarking และกลไกการตรวจสอบต้นทางของเนื้อหา

- ความร่วมมือข้ามพรมแดน — เนื้อหาที่กระจายข้ามประเทศต้องการกรอบความร่วมมือระหว่างประเทศเพื่อแลกเปลี่ยน indicators of compromise (IOCs), บล็อกโดเมน/บัญชีที่ใช้ในการประสานงาน และช่วยเหลือด้านการสืบสวนข้ามพรมแดน

- มาตรฐานความโปร่งใสและความรับผิดชอบ — กำหนดข้อบังคับที่ชัดเจนเกี่ยวกับการเปิดเผยการใช้เนื้อหาเชิงสร้างสรรค์โดย AI, การติดตามการละเมิด และบทลงโทษต่อผู้ที่ใช้เทคโนโลยีเพื่อการบิดเบือนหรือคุกคาม

- การรักษาสมดุลของสิทธิมนุษยชน — มาตรการใด ๆ ต้องคำนึงถึงเสรีภาพในการแสดงความเห็นและความเป็นส่วนตัว โดยออกแบบกระบวนการตรวจสอบที่มีการคุ้มครองสิทธิขั้นพื้นฐาน

สรุปแล้ว การป้องกันแคมเปญกลั่นแกล้งที่ใช้ LLM จำเป็นต้องเป็นแนวทางผสมผสาน ทั้งการเสริมมาตรการเชิงเทคนิคบนแพลตฟอร์ม, การปฏิบัติการที่รัดกุมขององค์กรสื่อและนักข่าว, และกรอบนโยบายระดับชาติและนานาชาติ การนำเทคนิคเช่น watermarking, behavioral network analysis และ provenance logging มาร่วมกับความร่วมมือของผู้ให้บริการโมเดลและหน่วยงานกำกับดูแล จะช่วยลดความเสี่ยงและสร้างระบบที่ทนทานต่อการถูกล่อลวงโดยการใช้ AI เพื่อกลั่นแกล้งหรือบ่อนทำลายผู้วิจารณ์

บทสรุป

เหตุการณ์การใช้ ChatGPT โดยกลุ่มที่เชื่อมโยงกับจีนเพื่อเปิดเผยแคมเปญกลั่นแกล้งผู้วิจารณ์ทั่วโลกสะท้อนปัญหาเชิงโครงสร้างของการนำปัญญาประดิษฐ์มาใช้ในพื้นที่สาธารณะ — คือเทคโนโลยีที่ทรงพลังสามารถถูกนำไปใช้เพื่อประสานงาน การขยายผลข้อความเท็จ และการโจมตีเชิงจิตวิทยาต่อบุคคลหรือกลุ่มได้อย่างรวดเร็ว การตอบสนองจึงไม่อาจเป็นหน้าที่ของฝ่ายใดฝ่ายหนึ่งเพียงลำพัง แต่ต้องเป็นความร่วมมือระหว่างแพลตฟอร์มผู้ให้บริการระบบออนไลน์ นโยบายสาธารณะ และสังคมพลเมือง เพื่อยับยั้งความเสียหายที่เกิดขึ้นและฟื้นฟูความน่าเชื่อถือของพื้นที่สาธารณะดิจิทัล

คำแนะนำเชิงปฏิบัติที่สำคัญได้แก่: เพิ่มการตรวจจับเชิงพฤติกรรม เพื่อจับรูปแบบการประสานงานของบัญชีและข้อความที่ผิดปกติ, ใช้เทคนิค watermarking และมาตรการเชิงเทคนิค เพื่อติดตามและพิสูจน์แหล่งที่มาของเนื้อหาที่สร้างจากโมเดล, และ เสริมความรู้ด้านดิจิทัล ให้แก่ผู้ใช้งานและนักข่าวเพื่อแยกแยะข้อมูลที่ถูกจัดการได้ดีขึ้น นอกจากนี้ต้องเร่งขับเคลื่อน มาตรฐานความโปร่งใสของผู้ให้บริการโมเดล เช่น รายงานการใช้งานเชิงนโยบาย การเปิดเผยเมตริกและเครื่องมือที่ใช้ควบคุมการนำโมเดลไปประยุกต์ใช้ ในภาพอนาคต ควรมองว่าการป้องกันเป็นการแข่งขันเชิงเทคโนโลยีและการกำกับดูแลร่วมกัน — หากไม่เร่งสร้างมาตรฐานและความต้านทานของสังคม เราจะเห็นการเลียนแบบและขยายผลของแคมเปญเช่นนี้มากขึ้นทั่วโลก

📰 แหล่งอ้างอิง: CyberScoop