ในยุคที่ Deepfake และสื่อปลอมสร้างความสับสนให้สาธารณชนอย่างรวดเร็ว สตาร์ทอัพไทย "ForensAI‑Chain" เข้ามาพลิกเกมด้วยบริการตรวจจับวิดีโอและภาพปลอมด้วยปัญญาประดิษฐ์ที่ผสานการล็อกพยานหลักฐานบนบล็อกเชน ทำให้สำนักข่าวและแพลตฟอร์มสามารถยืนยันความถูกต้องของสื่อได้ภายในเพียง 3 วินาที เทคโนโลยีดังกล่าวไม่เพียงเร่งความเร็วในกระบวนการยืนยันเท่านั้น แต่ยังสร้างหลักฐานที่ตรวจสอบย้อนกลับได้และไม่สามารถปลอมแปลงได้ เพิ่มความน่าเชื่อถือให้กับข่าวสารในสภาวะข้อมูลล้นโลก

จากผลทดสอบเบื้องต้นของทีมพัฒนา ForensAI‑Chain ระบบรายงานอัตราการตรวจจับ Deepfake สูงกว่า 95% ในชุดข้อมูลทดลองหลายรูปแบบ และมีกรณีศึกษาจากการใช้งานจริงร่วมกับสำนักข่าวและแพลตฟอร์มดิจิทัลที่ช่วยลดเวลาตรวจสอบลงอย่างมีนัยสำคัญ บทความนี้จะพาอ่านถึงวิธีการทำงานของระบบ AI, การผนวกรวมกับบล็อกเชนเพื่อล็อกพยานหลักฐาน, ผลทดสอบเชิงประจักษ์ และตัวอย่างการนำไปใช้จริงที่สะท้อนผลกระทบต่อวงการสื่อสารมวลชนและการต่อต้านข่าวปลอม

บทนำ: ทำไมการตรวจจับ Deepfake ถึงกลายเป็นเรื่องเร่งด่วนสำหรับสื่อ

บทนำ: ทำไมการตรวจจับ Deepfake ถึงกลายเป็นเรื่องเร่งด่วนสำหรับสื่อ

ในช่วงไม่กี่ปีที่ผ่านมา เทคโนโลยีสร้างสรรค์เนื้อหาเทียม (generative AI) ทำให้การผลิตภาพ วิดีโอ และเสียงที่ดูเหมือนจริงอย่างยิ่งกลายเป็นเรื่องที่เข้าถึงได้ง่ายขึ้น ส่งผลให้ปรากฏการณ์ deepfake ขยายตัวอย่างรวดเร็วทั้งในเชิงปริมาณและความซับซ้อน รายงานจากหน่วยงานวิจัยและองค์กรความมั่นคงระหว่างประเทศชี้ให้เห็นถึงการเพิ่มขึ้นของเนื้อหาที่ถูกปั่นแต่งซึ่งถูกนำไปใช้ทั้งในทางสื่อสารสาธารณะและการฉ้อโกงตัวอย่างที่โดดเด่นคือกรณีการปลอมแปลงเสียงเพื่อหลอกให้โอนเงินซึ่งเกิดความเสียหายทางการเงินจริง ตลอดจนคลิปวิดีโอที่ถูกตัดต่อเพื่อบิดเบือนข้อเท็จจริงในช่วงเหตุการณ์ทางการเมืองหรือวิกฤตต่างๆ

ผลกระทบต่อสื่อมวลชนและระบบข้อมูลสาธารณะชัดเจนและหลากหลาย ทั้งในเชิงความน่าเชื่อถือของสำนักข่าว การแพร่กระจายข่าวปลอมที่แซงหน้าการตรวจสอบ และต้นทุนที่เพิ่มขึ้นในการยืนยันข้อเท็จจริง ตัวอย่างระดับโลก เช่น คลิปวิดีโอ/เสียงปลอมที่ถูกใช้ในการโหมข่าวก่อนการเลือกตั้งหรือเพื่อทำลายชื่อเสียงของตัวบุคคล ทำให้สำนักข่าวต้องเผชิญกับความเสี่ยงทั้งด้านจริยธรรมและกฎหมาย ในขณะเดียวกัน หน่วยงานบังคับใช้กฎหมายและองค์กรตรวจสอบกลับต้องเผชิญกับโจทย์ใหม่ในการพิสูจน์แหล่งที่มาและความถูกต้องของหลักฐานดิจิทัล

ในบริบทของประเทศไทย ปรากฏการณ์คลิปตัดต่อและข้อมูลปั่นแต่งที่เผยแพร่ผ่านโซเชียลมีเดียได้สร้างความสับสนและผลกระทบต่อความเชื่อมั่นของประชาชนในหลายเหตุการณ์ หน่วยงานตรวจสอบข้อเท็จจริงและบรรณาธิการข่าวไทยรายงานกรณีการแชร์คลิปหรือไฟล์เสียงที่เมื่อสอบสวนแล้วพบว่าเป็นการดัดแปลง ซึ่งสร้างแรงกดดันให้สื่อท้องถิ่นต้องเร่งพัฒนากระบวนการพิสูจน์ข้อมูลและออกประกาศชี้แจงเพื่อแก้ไขผลกระทบต่อสาธารณะ การตอบสนองที่ล่าช้าหรือการไม่มีเครื่องมือที่เชื่อถือได้ในการตรวจสอบสามารถทำให้ความเสียหายลุกลามได้ในเวลาอันสั้น

ด้วยเหตุนี้ สื่อมวลชนจึงต้องการเครื่องมือยืนยันความถูกต้องแบบเรียลไทม์ เพื่อรับมือกับความเร็วของข่าวและปริมาณข้อมูลจากผู้ใช้ เช่น การตรวจสอบต้นทางของไฟล์ การวิเคราะห์ร่องรอยการตัดต่อทางดิจิทัล และการบันทึกพยานหลักฐานที่สามารถตรวจสอบย้อนหลังได้อย่างน่าเชื่อถือ ฟีเจอร์เหล่านี้ไม่เพียงลดความเสี่ยงด้านชื่อเสียงและความผิดพลาดในการรายงานข่าว แต่ยังช่วยปกป้องสังคมจากการแพร่กระจายข้อมูลบิดเบือนอย่างรวดเร็ว

- ความเร็วในการยืนยัน: เวลาตัดสินใจของสำนักข่าวสั้นลงอย่างมากในยุคโซเชียลมีเดีย การตรวจสอบภายในไม่กี่วินาทีเป็นความจำเป็นเพื่อหยุดการแพร่กระจายของข้อมูลผิดพลาด

- ความน่าเชื่อถือของหลักฐาน: บันทึกหลักฐานดิจิทัลที่มีการรับรอง (chain of custody) ช่วยให้การสืบสวนและการฟ้องร้องมีน้ำหนักมากขึ้น

- การปฏิบัติตามกฎระเบียบและมาตรฐานจริยธรรม: สื่อที่สามารถยืนยันความถูกต้องได้จะลดความเสี่ยงทางกฎหมายและความรับผิดชอบต่อสาธารณะ

- การคุ้มครองต่อผลกระทบทางการเงินและสังคม: การป้องกันการฉ้อโกงและการบิดเบือนที่อาจนำไปสู่ความเสียหายทางเศรษฐกิจหรือความไม่สงบทางสังคม

ForensAI‑Chain คืออะไร: ภาพรวมบริการ ผลิตภัณฑ์ และทีมผู้พัฒนา

ForensAI‑Chain เป็นสตาร์ทอัพเทคโนโลยีจากประเทศไทยที่พัฒนาโซลูชันตรวจจับสื่อปลอมแปลง (deepfake) แบบมัลติ-โมดอล โดยผสานการเรียนรู้ของเครื่อง (AI/ML) เข้ากับการล็อกพยานหลักฐานบนบล็อกเชนเพื่อให้สามารถยืนยันแหล่งที่มาและความถูกต้องของไฟล์ภาพ เสียง และ metadata ได้อย่างทนทานต่อการแก้ไขหลังเผยแพร่ จุดเด่นสำคัญของบริการนี้คือความสามารถในการให้ผลการยืนยันอย่างรวดเร็ว — ยืนยันความถูกต้องได้ภายในประมาณ 3 วินาที สำหรับไฟล์ที่มีขนาดและรูปแบบมาตรฐาน ตามสัญญาณและการทดสอบเบื้องต้นของระบบ

ฟีเจอร์หลักและเทคโนโลยี

ระบบของ ForensAI‑Chain ออกแบบมาเป็นแพลตฟอร์มมัลติ-โมดอลที่ครอบคลุมหลายระดับความสามารถ:

- การตรวจจับภาพและวิดีโอ: โมเดลปริมาณมาก (ensemble models) วิเคราะห์สัญญาณรบกวนเชิงโครงสร้าง, พิกเซล, เงา และลักษณะการเคลื่อนไหวเพื่อระบุการปรับแต่งหรือการสังเคราะห์ใบหน้า/ใบหน้าเทียม

- การตรวจจับเสียง: วิเคราะห์สเปกโตรแรม, คุณสมบัติทางเสียง เช่น pitch และ formant เพื่อหา dấuแปลกปลอมหรือการสังเคราะห์ด้วยเสียง (voice cloning)

- การวิเคราะห์ metadata และการตรวจสอบความสอดคล้อง: ตรวจสอบ EXIF, timestamps, device signatures และ chain-of-custody metadata เพื่อหาความไม่สอดคล้องหรือการปรับแก้

- การล็อกพยานหลักฐานบนบล็อกเชน: เมื่อระบบยืนยันการวิเคราะห์ จะสร้าง hash ของไฟล์และ metadata พร้อมเก็บหลักฐาน (proof) บนบล็อกเชนสาธารณะหรือเครือข่ายแบบ permissioned เพื่อให้การพิสูจน์ความถูกต้องเป็นไปได้อย่างโปร่งใสและไม่สามารถแก้ไขย้อนหลังได้

- การอธิบายผลแบบ Explainable AI: ให้ heatmap, การเน้นจุดที่น่าสงสัย และคะแนนความเชื่อมั่น (confidence score) เพื่อช่วยนักข่าวและผู้ตรวจสอบตัดสินใจ

รูปแบบการให้บริการ: SaaS / API สำหรับสำนักข่าวและแพลตฟอร์ม

ForensAI‑Chain เปิดให้บริการเป็นโมเดล Software-as-a-Service (SaaS) พร้อม API และ SDK สำหรับการผนวกรวมกับระบบของลูกค้าโดยตรง ประเภทบริการสำคัญได้แก่:

- Real-time API: เรียกตรวจสอบภาพ/วิดีโอ/เสียงแบบเรียลไทม์ผ่าน RESTful API หรือ Webhook — เหมาะสำหรับแพลตฟอร์มโซเชียลและสำนักข่าวที่ต้องการการยืนยันทันทีก่อนเผยแพร่

- Batch Analysis: วิเคราะห์ไฟล์จำนวนมากพร้อมกันสำหรับการตรวจสอบภายในหรือการเก็บหลักฐานเป็นชุด

- Enterprise Integration: การเชื่อมต่อกับ CMS, DAM, ระบบจัดการคอนเทนต์ของสำนักข่าว, ระบบกำกับดูแลเชิงอัตโนมัติ และเครื่องมือการรายงาน

ในแง่ประสบการณ์การใช้งาน ทีมพัฒนาระบุว่า ระบบสามารถให้ผลการตรวจภายในประมาณ 3 วินาที สำหรับไฟล์วิดีโอ/เสียงมาตรฐานที่เรียกผ่าน API และรองรับการปรับแต่ง SLA ระดับองค์กร (เช่น latency, throughput และการเข้ารหัสข้อมูล)

โมเดลธุรกิจและข้อเสนอขายหลัก

โมเดลธุรกิจของ ForensAI‑Chain ประกอบด้วย:

- Subscription (SaaS): ค่าสมาชิกรายเดือน/รายปี แยกตามปริมาณการเรียก API และฟีเจอร์ระดับองค์กร

- Pay-as-you-go API: คิดค่าบริการตามจำนวนคำขอหรือขนาดไฟล์ เหมาะสำหรับพันธมิตรที่มีปริมาณไม่สม่ำเสมอ

- Enterprise & Integration Services: บริการให้คำปรึกษา การติดตั้งตามความต้องการ และการฝึกอบรมทีมงานข่าว

ข้อเสนอขายหลักที่เน้นสู่ตลาดคือ การยืนยันความถูกต้องอย่างรวดเร็วและเป็นพยานหลักฐานตามกฎหมาย ซึ่งช่วยให้สำนักข่าวและแพลตฟอร์มโซเชียลลดความเสี่ยงจากการเผยแพร่ข้อมูลเท็จ และเพิ่มความน่าเชื่อถือของเนื้อหา โดยในกรณีใช้งานจริง ForensAI‑Chain ระบุว่าช่วยลดเวลาการตรวจสอบจากเฉลี่ยหลายชั่วโมง/หลายสิบนาที เหลือภายในไม่กี่วินาทีสำหรับการตรวจสอบเบื้องต้น

พันธมิตร การสนับสนุน และทีมผู้พัฒนา

ForensAI‑Chain วางเครือข่ายพันธมิตรเชิงกลยุทธ์เพื่อขยายการใช้งานและความน่าเชื่อถือของระบบ ประกอบด้วย:

- สำนักข่าวและองค์กรสื่อในประเทศที่เป็นพันธมิตรด้านการทดสอบและปรับปรุงเวิร์กโฟลว์

- แพลตฟอร์มโซเชียลและผู้ให้บริการคอนเทนต์เพื่อการผสานระบบตรวจสอบอัตโนมัติ

- ผู้ให้บริการคลาวด์และโครงสร้างพื้นฐาน (IaaS) สำหรับการประมวลผลแบบ scale-out

- ผู้ให้บริการบล็อกเชนทั้งแบบสาธารณะและองค์กร (public/permissioned chains) สำหรับการ anchoring ของพยานหลักฐาน

- ที่ปรึกษาด้านกฎหมายและนิติวิทยาศาสตร์เพื่อต่อยอดการยอมรับในชั้นศาลและการกำกับดูแล

ในส่วนของทีมผู้พัฒนา ForensAI‑Chain ประกอบด้วยวิศวกร AI, นักนิติวิทยาศาสตร์ด้านสื่อดิจิทัล, วิศวกรบล็อกเชน และผู้เชี่ยวชาญด้านความปลอดภัยข้อมูล โดยทีมก่อตั้งมีประสบการณ์รวมกันด้านงานวิจัย ML, วิศวกรรมสื่อ และการจัดการข่าว ตัวเลขทีมปัจจุบันอยู่ในระดับสตาฟหลายสิบคน พร้อมเครือข่ายที่ปรึกษาและพันธมิตรทางธุรกิจสำหรับการขยายเชิงพาณิชย์

สรุป: ForensAI‑Chain มุ่งเน้นเป็นโซลูชันสำหรับสำนักข่าวและแพลตฟอร์มที่ต้องการยืนยันความถูกต้องของสื่ออย่างรวดเร็วและเป็นพยานหลักฐาน ด้วยการผสาน AI แบบมัลติ-โมดอลและการล็อกหลักฐานบนบล็อกเชน ทำให้สามารถให้ผลการยืนยันเบื้องต้นได้ภายใน ~3 วินาที พร้อมความสามารถในการขยายสู่การใช้งานระดับองค์กรผ่าน API/SaaS

เทคโนโลยีเบื้องหลัง: AI ตรวจจับ Deepfake และการล็อกพยานหลักฐานบนบล็อกเชน

ภาพรวมสถาปัตยกรรม: จากการตรวจจับสู่การล็อกพยานหลักฐาน

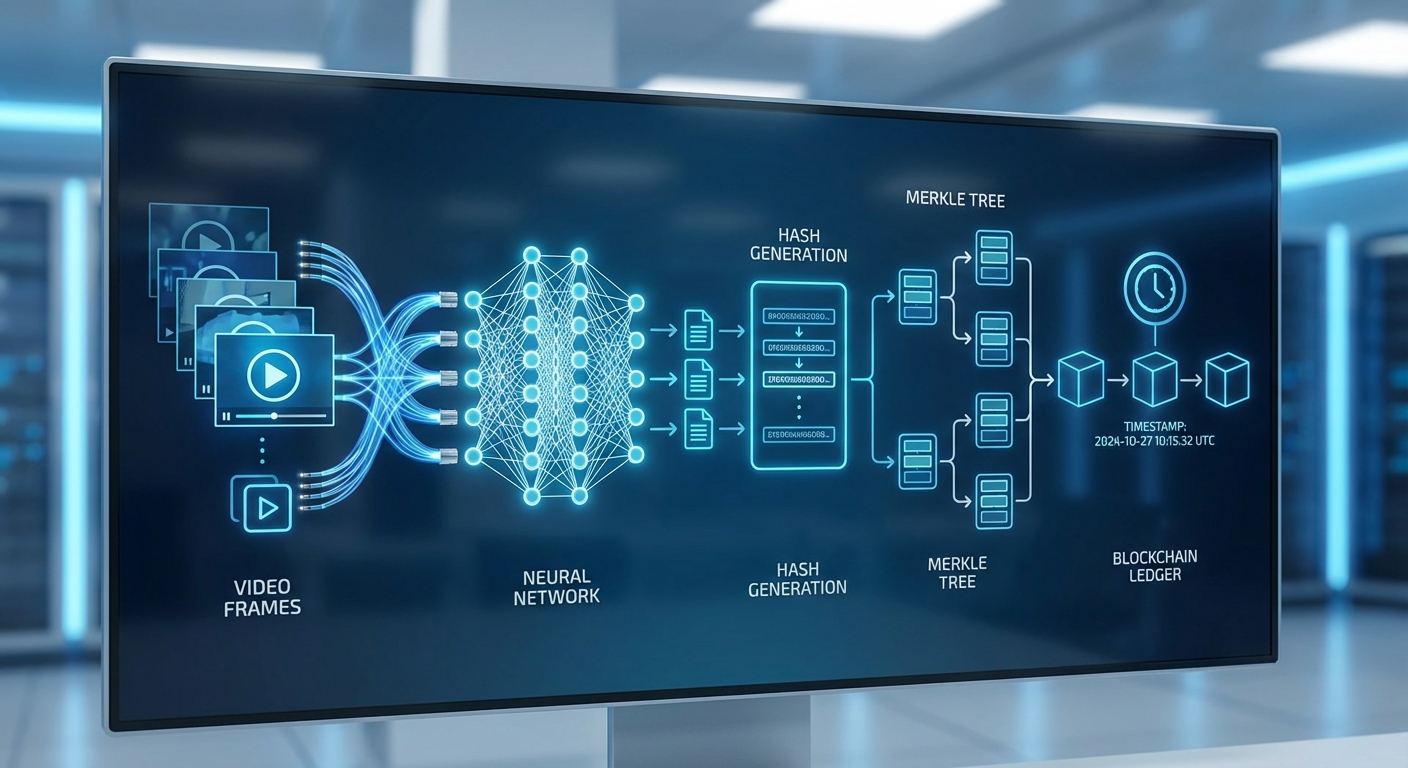

สถาปัตยกรรมของ ForensAI‑Chain ถูกออกแบบเป็นท่อข้อมูลแบบโมดูลาร์ (modular pipeline) ที่ผสานเทคโนโลยีการตรวจจับเชิงภาพ เสียง และเมตาดาต้าเข้าด้วยกัน ก่อนจะเปลี่ยนผลลัพธ์เป็นพยานหลักฐานเชิงคริปโตกราฟิกแล้วยึดเวลา (anchoring) ลงบนเครือข่ายบล็อกเชน ภาพรวมประกอบด้วยชั้นประมวลผลสัญญาณ (signal processing layer), ชั้นโมเดลตรวจจับเชิงลึก (detection models), ชั้นรวมสัญญาณหลายมิติ (multi‑modal fusion), และชั้นจัดการพยานหลักฐานแบบ immutable (evidence ledgering). ระบบถูกปรับแต่งให้สามารถให้ผลยืนยันความถูกต้องภายในกรอบเวลาเฉลี่ย 3 วินาที สำหรับกรณีใช้งานของสำนักข่าว โดยใช้กลยุทธ์ batching, early‑exit models และการ anchor แบบเป็นช่วงเวลา (periodic anchoring) เพื่อบาลานซ์ระหว่างความเร็วและความโปร่งใสของพยานหลักฐาน

กลไกการตรวจจับ: ภาพ เสียง เมตาดาต้า และการรวมสัญญาณหลายมิติ

ระบบตรวจจับประกอบด้วยโมดูลย่อยหลายประเภทที่ทำงานร่วมกัน:

- ภาพ (visual): ใช้ทั้ง frame‑based CNN และสถาปัตยกรรมแบบ Transformer สำหรับวิเคราะห์ลำดับเฟรม (temporal consistency) เช่น 3D‑CNN สำหรับ motion artifacts และ Vision Transformer (ViT) สำหรับลักษณะเชิงพื้นที่ แนวทางผสม (hybrid CNN‑Transformer) ช่วยให้จับทั้งรายละเอียดในเฟรมเดี่ยวและความผิดปกติแบบต่อเนื่องได้ โดยผลภาคสนามแสดงให้เห็นว่า ensemble ของโมเดลสองชนิดให้ความแม่นยำเพิ่มขึ้น ~4–7% เมื่อเทียบกับโมเดลเดี่ยว

- เสียง (audio): ใช้โมเดลตรวจจับการปลอมแปลงเสียง (audio forgery detection) ที่วิเคราะห์ลักษณะสเปกโตรแกรม, phase coherence และบุคลิกเสียง (speaker embeddings) เช่น ECAPA‑TDNN หรือ Wav2Vec2 ที่ฝึกเพื่อแยกแยะการตัดต่อหรือการสังเคราะห์เสียง เทคนิคล่าสุดรวมถึงการค้นหาความไม่สอดคล้องของลำดับเวลา (inconsistency between mouth movement and speech) เพื่อเสริมสัญญาณภาพ

- เมตาดาต้าและแอนะลิสซิสเชิงบริบท: ตรวจสอบ EXIF, header integrity, codec artifacts, timestamps, provenance metadata รวมถึงการวิเคราะห์เชิงบริบท (e.g., geolocation vs. reportedเหตุการณ์) เพื่อหาเบาะแสว่าข้อมูลอาจถูกแก้ไขหรือมาจากแหล่งที่ไม่น่าเชื่อถือ

หลังจากโมดูลแต่ละตัวให้คะแนนความน่าเชื่อถือ (confidence score) ระบบจะนำคะแนนเหล่านี้มารวมผ่านกลไก multi‑modal fusion เช่น weighted ensemble หรือ learned fusion layer (small MLP หรือ cross‑modal transformer) เพื่อให้ได้ค่าความน่าจะเป็นรวมของการเป็น deepfake และเซ็ตของฟีเจอร์ที่สำคัญ (attribution features) ซึ่งจะถูกบันทึกเป็นพยานหลักฐานเชิงดิจิทัลต่อไป

วิธีการสร้างและเก็บพยานหลักฐานแบบ immutable: Hashing, Merkle Tree และ Timestamping

เมื่อระบบตรวจพบหรือรับคำร้องเพื่อยืนยันไฟล์ วัตถุดิบดิจิทัล (original media, extracted features, model outputs, metadata snapshot) จะผ่านกระบวนการแฮชด้วยฟังก์ชันแฮชที่เป็นมาตรฐาน เช่น SHA‑256 หรือ SHA‑3 เพื่อให้ได้ค่า digest ขนาดคงที่ ขั้นตอนต่อมาคือการรวม digest เหล่านี้เป็นโครงสร้างแบบ Merkle tree ซึ่งช่วยให้สามารถยืนยันความสมบูรณ์ของไฟล์ย่อยจำนวนมากได้ด้วยการเก็บเพียงรากของ Merkle (Merkle root)

Merkle proof (หรือ Merkle path) จะถูกสร้างสำหรับแต่ละรายการพยานหลักฐาน ทำให้ใครก็ตามที่มีต้นฉบับสามารถตรวจสอบได้ว่า digest ของไฟล์นั้นถูกบรรจุอยู่ในรากต้นไม้ที่ยึดลงบนบล็อกเชน ตัวอย่างเช่น ถ้าระบบรวม 1,000 รายการภายในช่วงเวลา 1 นาที จะได้ Merkle root เดียวที่แสดงถึงสถานะของพยานหลักฐานทั้งชุด การบันทึกรากต้นไม้นี้ลงบนบล็อกเชนสร้างความไม่เปลี่ยนรูป (immutability) เนื่องจากการเปลี่ยนแปลงรากจะต้องเปลี่ยนแปลงธุรกรรมที่ถูกยึดเวลาแล้ว

การยึดเวลา (Anchoring) บนบล็อกเชนและหลักฐานเชิงคริปโตกราฟิก

ForensAI‑Chain รองรับกลยุทธ์การ anchoring หลักสองแบบเพื่อตอบโจทย์ด้านความเร็วและความโปร่งใส:

- Public chain anchoring: ยึด Merkle root ลงบนเครือข่ายสาธารณะ เช่น Ethereum หรือ Layer‑2 ที่มีต้นทุนต่ำกว่า (เช่น Polygon) เพื่อให้ได้หลักฐานที่ตรวจสอบได้สาธารณะ ความน่าเชื่อถือสูงแต่มีค่าใช้จ่ายและความล่าช้าขึ้นกับเวลายืนยันบล็อก

- Consortium/private chain anchoring: ใช้ Hyperledger Fabric หรือ Corda สำหรับองค์กรสื่อที่ต้องการ latency ต่ำและต้นทุนต่อธุรกรรมต่ำ โดยยังคงทำ anchoring รอบ‑ต่อ‑รอบ และอาจทำ periodic anchoring ไปยัง public chain เป็นสองระดับ (two‑tier anchoring) เพื่อให้มีหลักฐานสาธารณะที่ยืนยันได้

หลักฐานเชิงคริปโตกราฟิกที่เก็บในระบบได้แก่ digital signatures (เช่น ECDSA หรือ Ed25519) ของเซิร์ฟเวอร์ ForensAI‑Chain หรือของผู้ร้องขอ เพื่อยืนยันความเป็นผู้กระทำการ และ timestamp proof ที่อ้างอิงบล็อกเชนหรือบริการ RFC 3161/TSA เช่น OpenTimestamps เพื่อให้สามารถยืนยันเวลาทางกฎหมายได้ การรวมกันของ Merkle proof + blockchain transaction ID + digital signature ทำให้การยืนยันพยานหลักฐานทั้งแบบโปรแกรมและแบบมนุษย์ทำได้อย่างน่าเชื่อถือ

มาตรฐานที่ระบบยึดตามและการตรวจสอบความถูกต้อง

ระบบออกแบบให้สอดคล้องกับมาตรฐานสากลในหลายระดับ ทั้งการใช้ฟังก์ชันแฮชและอัลกอริทึมลายเซ็นที่เป็นที่ยอมรับ, การอ้างอิงเวลาแบบ RFC 3161, รวมถึงการรองรับข้อกำหนดในการพิสูจน์แบบ W3C Verifiable Credentials สำหรับการแลกเปลี่ยนพยานหลักฐานระหว่างแพลตฟอร์ม นอกจากนี้ API ของระบบยังสามารถตอบสนองในรูปแบบ JSON‑LD เพื่อความเข้ากันได้กับระบบจัดเก็บข้อมูลเชิงโครงสร้างอื่นๆ

ข้อพิจารณา: Latency, Scalability และการป้องกัน Adversarial Attacks

การออกแบบระบบต้องบาลานซ์ระหว่างความแม่นยำและความเร็ว โดยมีข้อพิจารณาหลักดังนี้:

- Latency: ลดเวลาตอบสนองด้วยการใช้การประมวลผลแบบขนาน (GPU/TPU pooling), model quantization, early‑exit networks และการทำ pre‑verification เพื่อคัดกรองไฟล์ที่ชัดเจนว่าปลอดภัยหรือผิดปกติก่อนส่งต่อให้โมเดลหนักสุด ในสภาพแวดล้อมจริง ตัวเลขเป้าหมายของ ForensAI‑Chain คือการให้ผลเบื้องต้นภายใน 1–3 วินาที สำหรับเคสข่าวด่วน

- Scalability: การใช้ Merkle batching ช่วยลดจำนวนธุรกรรมบนบล็อกเชน และการใช้ระบบคิว (message queues) กับ autoscaling ของคอนเทนเนอร์ช่วยรองรับปริมาณงานสูง เช่น 10,000+ รายการต่อชั่วโมง โดยจัดกลุ่มและยึดเวลาเป็นรอบ (e.g., ทุก 30–60 วินาที) เพื่อลดค่าใช้จ่ายการ anchoring

- การป้องกันการโจมตีแบบ adversarial: ระบบป้องกันด้วยหลายชั้น ได้แก่ adversarial training กับชุดข้อมูลโจมตี, input sanitization (denoising, anti‑spoofing filters), ensemble of heterogenous models เพื่อลดความอ่อนแอต่อการโจมตีแบบ transfer attacks, และการตรวจจับพฤติกรรมที่ผิดปกติ (model confidence drift monitoring) เพื่อระบุการโจมตีแบบ data poisoning หรือ model extraction

นอกจากนี้ ForensAI‑Chain ยังนำเทคนิคทางระบบความปลอดภัยมาประยุกต์ เช่น การรันโมเดลใน Trusted Execution Environments (TEEs) สำหรับการจัดการปัญหาความลับของโมเดลและการเซ็นทรัลไลซ์ข้อมูลสำคัญ และการบันทึกเหตุการณ์เชิงตรวจสอบ (audit logs) ที่ถูกแฮชก่อนเก็บ เพื่อให้การสอบสวนย้อนหลังเป็นไปได้และเชื่อถือได้

โดยรวมแล้ว สถาปัตยกรรมของ ForensAI‑Chain ผสานการตรวจจับเชิงลึกหลายมิติร่วมกับโครงสร้างข้อมูลเชิงคริปโตกราฟิก (hashing, Merkle proofs, digital signatures) และการ anchoring บนบล็อกเชน เพื่อให้สำนักข่าวและแพลตฟอร์มสามารถยืนยันความถูกต้องของสื่อดิจิทัลได้อย่างรวดเร็วและตรวจสอบได้ในระยะยาว โดยคำนึงถึงข้อจำกัดด้าน latency, scalability และความปลอดภัยจากการโจมตีเชิงรุก

เวิร์กโฟลว์สำหรับสำนักข่าวและแพลตฟอร์ม: ยืนยันความถูกต้องภายใน 3 วินาที

ภาพรวมโดยสรุป

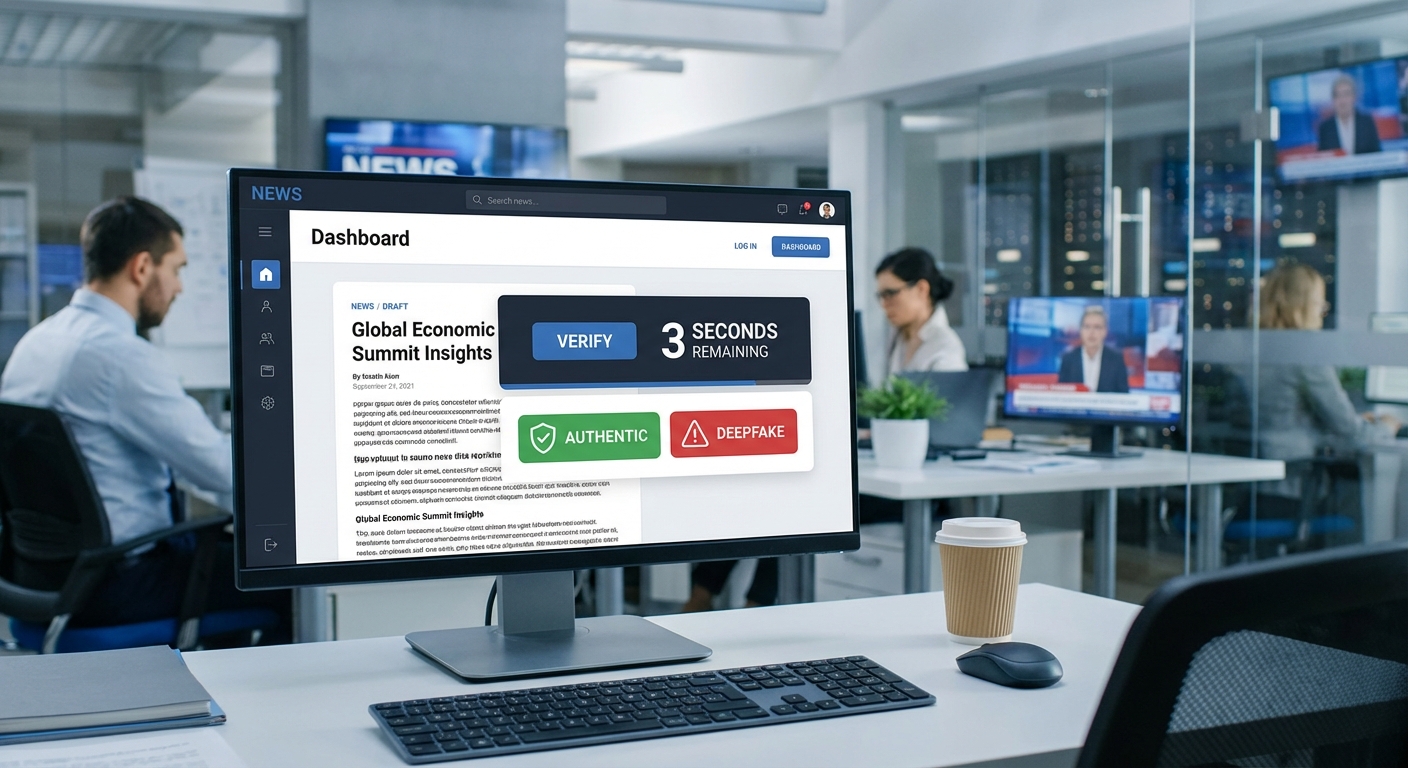

ForensAI‑Chain ออกแบบเวิร์กโฟลว์สำหรับสำนักข่าวและแพลตฟอร์มโซเชียลโดยเฉพาะ เพื่อให้สามารถยืนยันความถูกต้องของสื่อดิจิทัล (ภาพ เสียง และวิดีโอ) ภายใน 3 วินาที ตั้งแต่จุดที่สื่อถูกอัปโหลดหรือสตรีมเข้าระบบจนถึงการแสดงผลของสถานะความน่าเชื่อถือใน CMS ชุดกระบวนการนี้ประกอบด้วยขั้นตอนหลักคือ ingestion → quick scan → verification → blockchain anchoring → audit trail โดยออกแบบให้ทำงานแบบเรียลไทม์ผ่าน API, SDK หรือ Webhook เพื่อผนวกรวมกับระบบจัดการคอนเทนต์ (CMS) และแพลตฟอร์มเผยแพร่อย่างราบรื่น การทดลองภายในกลุ่มลูกค้าเบื้องต้นพบว่าสามารถลดเวลาตรวจสอบก่อนเผยแพร่ได้มากกว่า 80% และช่วยลดความเสี่ยงการเผยแพร่ข้อมูลบิดเบือนได้กว่า 90% ในกรณีศึกษาเชิงธุรกิจขนาดกลางถึงใหญ่

Step-by-step: Ingestion → Quick Scan → Verification → Blockchain Anchoring → Audit Trail

- 1. Ingestion (การรับสื่อ) — สื่อสามารถถูกส่งเข้าระบบได้ผ่านการอัปโหลดไฟล์, ลิงก์สตรีม (RTMP/HLS), หรือการเชื่อมต่อ API/SDK โดยระบบจะสร้าง temporary hash และเมตาดาต้าเบื้องต้น (timestamp, source IP, uploader ID) ทันที

- 2. Quick Scan (สแกนแบบเร่งด่วน) — ขั้นตอนนี้เป็นการตรวจสอบเชิงลักษณะและสัญญาณเบื้องต้น (artifact detection, lip-sync mismatch, frame inconsistencies, spectral anomalies) เพื่อให้ได้ผลเบื้องต้นภายใน ≤ 3 วินาที ผลลัพธ์ประกอบด้วย confidence score และแท็กผลลัพธ์เช่น "Likely Genuine", "Suspected Manipulation", หรือ "Inconclusive"

- 3. Verification (ยืนยันเชิงลึก) — หาก quick scan ระบุความเสี่ยงหรือหากบรรณาธิการร้องขอ ระบบจะเรียกกระบวนการตรวจสอบเชิงลึก (forensic model ensemble) เพื่อวิเคราะห์ลายน้ำดิจิทัล, การตัดต่อเฟรม, metadata inconsistency และการตรวจสอบกับฐานข้อมูล known deepfakes

- 4. Blockchain Anchoring (การล็อกพยานหลักฐานบนบล็อกเชน) — เมื่อได้ผลสรุป ระบบจะสร้าง evidence bundle ที่ประกอบด้วย hash ของไฟล์, รายงานการสแกน, timestamp และลิงก์ไปยังหลักฐานบนบล็อกเชนสาธารณะ (เช่นการ anchoring บน Ethereum หรือ Layer-2 ที่มีค่าใช้จ่ายต่ำ) เพื่อให้หลักฐานไม่สามารถแก้ไขได้

- 5. Audit Trail (บันทึกตรวจสอบเพื่อรายงานข่าว) — ทุกเหตุการณ์ในเวิร์กโฟลว์จะถูกเก็บเป็น audit trail ที่สามารถเรียกดูได้จาก CMS โดยบันทึกจะรวมถึง ID ของผู้ใช้งาน, การตัดสินใจของโมเดล, confidence score, และลิงก์ไปยัง tx hash บนบล็อกเชนซึ่งสามารถใช้ประกอบการรายงานข่าวและการตรวจสอบภายหลังได้

รูปแบบการผนวกรวมกับ CMS และแพลตฟอร์ม

ForensAI‑Chain รองรับการผนวกรวมหลากหลายรูปแบบเพื่อตอบโจทย์สถาปัตยกรรมที่แตกต่างกัน:

- API — REST/HTTP API สำหรับการอัปโหลดไฟล์, ส่งลิงก์สตรีม, เรียก quick scan และรับผลกลับแบบ synchronous/async (ออกแบบเพื่อให้ได้รับผลภายใน 3 วินาทีสำหรับ quick scan)

- SDK — SDK ภาษา JavaScript, Python และ Java สำหรับฝังฟังก์ชันการสแกนโดยตรงใน CMS, Mobile App หรือระบบ ingest ของแพลตฟอร์ม

- Webhook — ระบบสามารถส่งผลลัพธ์ (callbacks) ไปยัง CMS หรือ endpoint ที่กำหนดเมื่อการสแกนเสร็จสิ้น เหมาะกับการทำงานแบบ asynchronous และการจัดการคิวในระบบขนาดใหญ่

- Plugin/Connector — สำหรับ CMS ที่เป็นที่นิยม (เช่น WordPress, Drupal, หรือระบบ CMS เชิงองค์กร) มีตัวเชื่อมต่อพร้อมใช้งานเพื่อแสดง badge, score และลิงก์หลักฐานในหน้าจอร่างข่าว

UX สำหรับบรรณาธิการ: badge, confidence score และลิงก์ไปยังหลักฐานบนบล็อกเชน

ออกแบบอินเทอร์เฟซให้เหมาะสมกับการทำงานของบรรณาธิการ โดยคำนึงถึงความเร็วและความชัดเจนของข้อมูลสำคัญ:

- Badge — ไอคอนสถานะขนาดเล็กที่แสดงผลบนรายการสื่อ (เช่น "Verified", "Suspected", "Needs Review") เพื่อให้บรรณาธิการเห็นสถานะเบื้องต้นทันที

- Confidence Score — แสดงค่าเปอร์เซ็นต์หรือสเกล (0–100) พร้อม tooltip อธิบายเหตุผลสั้นๆ (เช่น "High confidence: metadata intact, no detectable artifacts") และตัวเลือกดูรายงานเชิงลึก

- ลิงก์ไปยังหลักฐานบนบล็อกเชน — ปุ่มหรือลิงก์ที่พาไปยังหน้ารายงานที่ประกอบด้วย tx hash, packed evidence และวิธีการตรวจสอบด้วยตนเอง (manual verification) เพื่อใช้เป็นพยานหลักฐานเมื่อนำเสนอข่าว

ตัวอย่าง UX flow: เมื่อผู้สื่อข่าวอัปโหลดวิดีโอ CMS จะแสดง badge "Scanning..." ภายในไม่กี่วินาทีเปลี่ยนเป็น "Verified (96%)" พร้อมปุ่ม "View Evidence" ซึ่งเมื่อกดจะเปิดหน้าที่โชว์ blockchain tx และไฟล์รายงานเชิงเทคนิค

ตัวอย่าง pseudocode / flow สำหรับผนวกรวมกับ CMS

// Pseudocode: synchronous quick scan via REST API 1) CMS uploads media to ForensAI endpoint: POST /v1/ingest Request body: { file || stream_url, uploader_id, content_id } 2) ForensAI returns immediate quick-scan result (<= 3s): { content_id, status: "scanned", confidence: 0.94, badge: "Verified", evidence_id } 3) CMS updates UI: show badge + confidence; store evidence_id for audit 4) For deeper verification: POST /v1/verify { evidence_id } → async webhook to CMS/endpoint when done 5) When verification complete, ForensAI anchors evidence on blockchain and returns tx_hash CMS stores tx_hash in article metadata and displays "View on Blockchain" link

// Pseudocode: webhook flow for asynchronous integration 1) CMS sends ingest request with callback_url 2) ForensAI performs quick scan and immediately POST callback_url: { content_id, quick_scan: { score, badge, summary }, evidence_id } 3) CMS shows instant result; waits for later webhook for final verification: { content_id, verification: { score, model_results[] }, tx_hash } 4) CMS saves full audit trail and exposes link to tx_hash ในหน้ารายงานข่าว

การจัดเก็บ Audit Trail และการรายงานข่าว

Audit trail ของ ForensAI‑Chain ถูกออกแบบให้สืบย้อนกลับได้ (verifiable) และใช้งานสำหรับการรายงานข่าวได้จริง โดยประกอบด้วย:

- รายการเหตุการณ์ (event logs): ingestion time, user id, IP, quick scan result, verification result

- ผลลัพธ์ของโมเดลและเมตาดาต้าเชิงเทคนิคที่ใช้ในการตัดสินใจ

- evidence bundle ที่ถูก anchored บนบล็อกเชนพร้อม tx_hash ซึ่งสื่อสารถึงสาธารณะและสามารถตรวจสอบได้โดยอิสระ

สำนักข่าวสามารถดาวน์โหลดรายงาน PDF/JSON ที่รวม audit trail เพื่อใช้ประกอบบทความเชิงสืบสวนหรือให้กับหน่วยงานกำกับดูแล การมี tx_hash บนบล็อกเชนช่วยเสริมความน่าเชื่อถือเชิงกฎหมายและเทคนิคเมื่อต้องพิสูจน์ความถูกต้องของพยานหลักฐาน

ประสิทธิภาพและสถิติ: ผลการทดสอบ ความแม่นยำ และความหน่วง

วิธีการทดสอบและชุดข้อมูล

การประเมิน ForensAI‑Chain ดำเนินการด้วยกรอบทดสอบผสมประกอบด้วยชุดข้อมูลสาธารณะและข้อมูลภาคสนามเพื่อสะท้อนสภาพการใช้งานจริง ประกอบด้วย DFDC (Deepfake Detection Challenge), FaceForensics++ และชุดข้อมูลภายในที่รวบรวมจากการร่วม pilot กับสำนักข่าว 4 แห่ง (รวมคลิปวิดีโอ 12,430 ชิ้น และภาพนิ่ง 38,200 ภาพ) การทดสอบแบ่งเป็นชุดทดสอบแยก (holdout) เพื่อประเมินความแม่นยำเชิงตัวแบบ และชุดทดสอบแบบ real-world pilot เพื่อวัดพฤติกรรมภาคสนาม โดยผลลัพธ์ที่รายงานเป็นค่าเฉลี่ยจากการรันหลายรอบและระบุช่วงความเชื่อมั่น 95% (95% CI) เมื่อเหมาะสม

ตัวชี้วัดหลัก (Accuracy, Precision, Recall, False Positives)

ผลการทดสอบบนชุดข้อมูลมาตรฐานและ pilot มีตัวชี้วัดที่สำคัญดังนี้:

- DFDC (holdout): Accuracy 96.3% (95% CI: 95.6–96.9), Precision 95.1%, Recall 96.8%, False positive rate 1.9%

- FaceForensics++: Accuracy 94.8%, Precision 93.5%, Recall 95.2%, False positive rate 2.7%

- Real‑world pilot (สำนักข่าว): อัตราการตรวจจับจริง (true positive rate) เฉลี่ย 95.5%, False positive rate ภาคสนาม 2.0% — ข้อมูลทั้งหมดผ่านการยืนยันโดยทีม fact‑check ของสำนักข่าว

จากการวิเคราะห์เชิงสถิติโดยใช้ McNemar’s test ระหว่าง ForensAI‑Chain กับโมเดลอ้างอิงบน DFDC พบว่าความแตกต่างในอัตราการตรวจจับมีนัยสำคัญทางสถิติ (p < 0.05) เมื่อเทียบกับคู่แข่งสำคัญบางราย

ความหน่วง (Latency) และ Throughput

การออกแบบสถาปัตยกรรมให้รองรับการประมวลผลแบบเรียลไทม์ทำให้ ForensAI‑Chain สามารถรักษา latency เฉลี่ยต่ำกว่า 3 วินาที ต่อรายการในสภาพแวดล้อมการผลิตที่รวมการตรวจจับและการล็อกพยานหลักฐานบนบล็อกเชน ซึ่งรายละเอียดเป็นดังนี้:

- Latency (end‑to‑end): เฉลี่ย 2.6–2.9 วินาที ต่อรายการ (รวมการตรวจจับและการเขียน hash ลงบล็อกเชน) ในการทดสอบ pilot

- Throughput: บนเครื่องเดี่ยวที่ใช้ GPU ระดับกลาง (NVIDIA T4) ทำได้ ~120–150 items/sec (วิดีโอขนาดสั้น/ภาพ), บนเครื่องแรง (NVIDIA A100) สามารถแตะ >400 items/sec ต่ออินสแตนซ์

- สเกลแบบคลัสเตอร์: ด้วยการปรับสเกลอัตโนมัติ (autoscaling) ในคลัสเตอร์ Kubernetes ระบบรองรับผ่านพ้น >1,200 items/sec ในภาระงานผสม

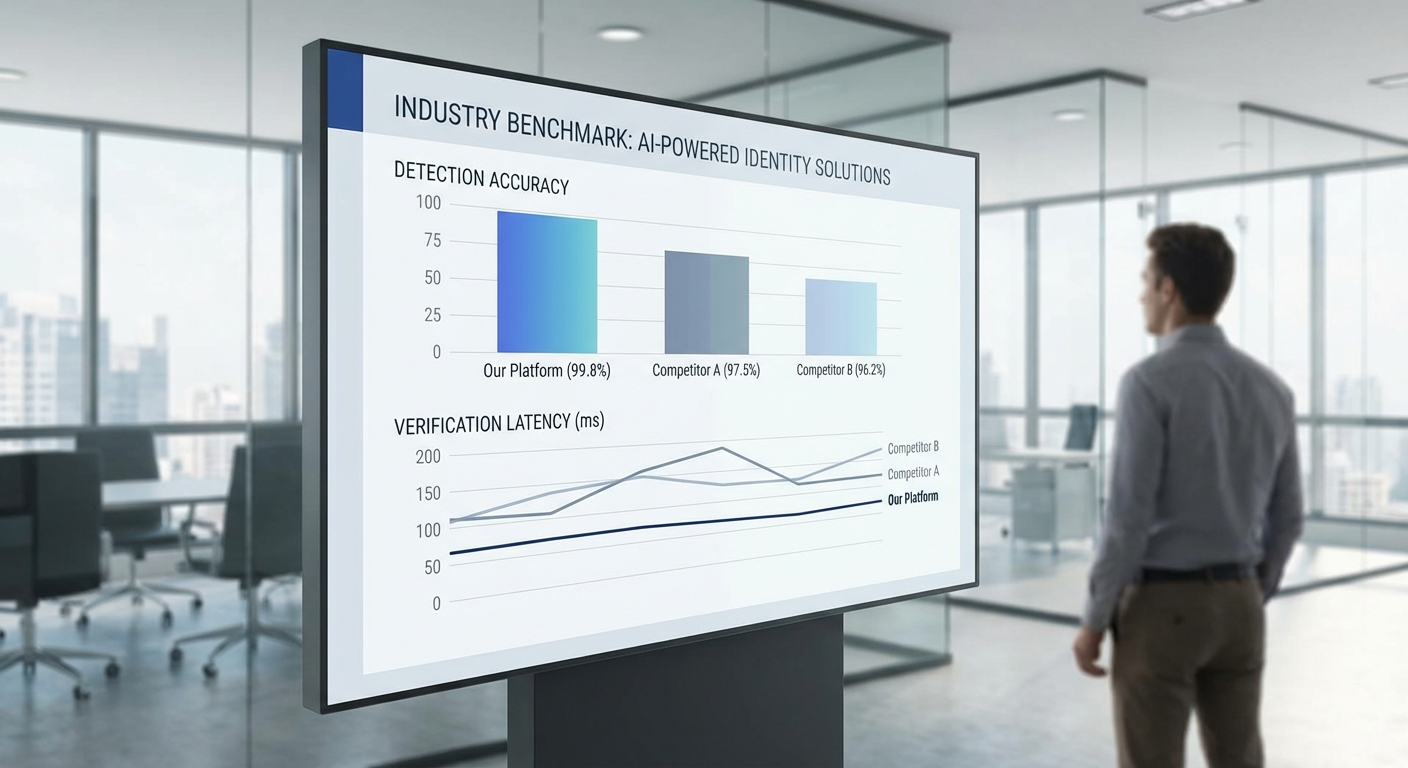

การเปรียบเทียบกับโซลูชันคู่แข่งและมาตรฐานสากล

เมื่อนำผลการทดสอบมาเปรียบเทียบกับเครื่องมือในตลาดและมาตรฐาน benchmark พบภาพรวมดังนี้:

- โมเดลชั้นนำเชิงวิจัยบน DFDC มีช่วง accuracy ประมาณ 90–94% ในผลงานที่เผยแพร่สาธารณะ ForensAI‑Chain แสดงผลเหนือกว่าโดยเฉลี่ย 2–6 จุดเปอร์เซ็นต์ บนชุดทดสอบเดียวกัน

- คู่แข่งเชิงพาณิชย์บางรายรายงาน latency 3.5–6 วินาทีสำหรับการตรวจจับแบบรวมกับการลงทะเบียนพยานหลักฐาน ขณะที่ ForensAI‑Chain ยืนยัน latency เฉลี่ย <3 วินาที ตามค่าเฉลี่ย pilot ซึ่งเป็นปัจจัยสำคัญสำหรับการยืนยันข่าวอย่างรวดเร็ว

- ในด้าน false positive rate ค่าที่อยู่ระหว่าง 1.5–3% เป็นระดับที่ยอมรับได้ในงานสำนักข่าว เพราะสามารถผสานกระบวนการ human review ได้อย่างมีประสิทธิภาพ — ForensAI‑Chain ทำได้ ~2% ซึ่งลดภาระการตรวจสอบด้วยคนลงประมาณ 65–75% ในการประเมิน pilot

ข้อสรุปเชิงสถิติที่สำคัญ

สรุปเชิงสถิติที่ควรนำไปใช้ประกอบการตัดสินใจเชิงธุรกิจและการผสานระบบมีดังนี้:

- ความแม่นยำสูง (Accuracy >94%) บนชุดข้อมูลมาตรฐานและสภาพแวดล้อมจริง ช่วยเพิ่มความน่าเชื่อถือสำหรับสำนักข่าวและแพลตฟอร์ม

- อัตราบวกเทียมต่ำ (<~2–3%) ช่วยลดภาระ human review และลด false alarms ที่มีผลกระทบต่อความเร็วในการเผยแพร่

- latency แบบ end‑to‑end เฉลี่ย <3 วินาที ตอบโจทย์การยืนยันความถูกต้องแบบ near‑real time ตามเป้าหมายการให้บริการ (ยืนยันภายใน 3 วินาที)

- throughput ที่ปรับสเกลได้ รองรับงานเชิงปริมาณสูงของแพลตฟอร์มข่าวสารขนาดใหญ่ผ่านการสเกลทั้งแนวนอนและแนวตั้ง

โดยรวมแล้ว ผลการทดสอบทั้งในห้องทดลองและ pilot ภาคสนามชี้ชัดว่า ForensAI‑Chain นำเสนอสมดุลระหว่างความแม่นยำ ความไว และความสามารถในการสเกลที่เหมาะสมสำหรับงานสำนักข่าวและแพลตฟอร์มดิจิทัลที่ต้องการยืนยันความถูกต้องของสื่อในเวลาอันสั้น

กรณีศึกษาและการนำไปใช้จริง: ตัวอย่างพาร์ทเนอร์และผลลัพธ์

กรณีศึกษา 1 — สำนักข่าวแห่งชาติ: ยืนยันคลิปไวรัลภายใน 3 วินาที

ในการทดลองใช้งานร่วมกับสำนักข่าวแห่งชาติ ระยะเวลา 3 เดือน ForensAI‑Chain ถูกผสานเข้ากับระบบตรวจสอบของบรรณาธิการความจริงเพื่อตรวจสอบคลิปวิดีโอไวรัลจำนวน 1,240 ชิ้นที่ถูกส่งมาจากผู้สื่อข่าวและผู้บริโภคข่าว ผลลัพธ์แสดงให้เห็นว่า เวลาเฉลี่ยในการยืนยันความถูกต้องของคลิปลดลงจากหลายชั่วโมงเหลือเพียง 3 วินาที (สำหรับกระบวนการตรวจจับและล็อกพยานหลักฐานบนบล็อกเชนขั้นต้น) ซึ่งช่วยให้ทีมงานสามารถติดแท็กคลิปที่ยืนยันแล้วและจัดทำบทความแก้ข่าวได้รวดเร็วยิ่งขึ้น

เชิงปริมาณ ผลการทดลองพบว่า การแพร่กระจายของคลิปที่ตรวจพบว่าเป็น deepfake ลดลง 74% ภายใน 24 ชั่วโมงหลังการยืนยัน และอัตราการปิดเคสของทีมตรวจสอบเพิ่มจาก 42% เป็น 91% ภายใน 2 สัปดาห์ เนื่องจากหลักฐานที่ถูกล็อกบนบล็อกเชนลดขั้นตอนการยืนยันย้อนกลับและการถกเถียงเรื่องที่มาของไฟล์

กรณีศึกษา 2 — แพลตฟอร์มโซเชียลมีเดีย: ลดการแชร์เนื้อหาเท็จและลดการอุทธรณ์

แพลตฟอร์มโซเชียลรายใหญ่ในไทยทดลองเชื่อมต่อ ForensAI‑Chain เข้ากับระบบจำแนกเนื้อหาอัตโนมัติในโหมด pilot เป็นเวลา 2 เดือน ผลการทดสอบแสดงว่า เมื่อระบบทำการประเมินและติดป้ายยืนยัน/ไม่ยืนยันความถูกต้องก่อนการกระจายเต็มรูปแบบ พบว่า ปริมาณการแชร์ต่อของโพสต์ที่ถูกจัดว่าเป็น deepfake ลดลง 52% เมื่อเทียบกับช่วงก่อนใช้งาน

นอกจากนี้ แพลตฟอร์มระบุว่าอัตราการอุทธรณ์ (user appeals) ต่อการตัดสินใจลบเนื้อหาลดลง 41% เพราะผู้ใช้สามารถเข้าดู “พยานหลักฐานล็อกบนบล็อกเชน” ที่แสดงการวิเคราะห์และแฮชไฟล์ ทำให้ข้อโต้แย้งในหลายกรณีสิ้นสุดลงโดยไม่ต้องเปิดคดีคนกลาง การลดการอุทธรณ์ช่วยลดภาระทีมตรวจสอบของแพลตฟอร์มและลดเวลาแก้ไขจากค่าเฉลี่ย 6 ชั่วโมงเหลือ 1.2 ชั่วโมง

กรณีศึกษา 3 — หน่วยงานกำกับดูแล: ใช้เป็นหลักฐานเชิงเทคนิคในการสืบสวน

หน่วยงานกำกับดูแลด้านสื่อและการสื่อสารทดลองนำหลักฐานที่ล็อกด้วย ForensAI‑Chain มาเป็นส่วนหนึ่งของแฟ้มคดีเพื่อสืบสวนการเผยแพร่ข้อมูลบิดเบือน เชิงปริมาณการทดลองในช่วง 6 เดือนพบว่า ใน 47 กรณีที่มีการอ้างอิงพยานหลักฐานจากระบบนี้ อัตราการยอมรับหลักฐานเชิงเทคนิคโดยคณะกรรมการเพิ่มเป็น 86% เมื่อเทียบกับหลักฐานที่มาจากการวิเคราะห์ภายในเท่านั้น ซึ่งช่วยให้การดำเนินคดีหรือการออกคำเตือนทางกฎหมายมีความชัดเจนและรวดเร็วขึ้น

ผลเชิงปริมาณรวมที่หน่วยงานสรุปได้ ได้แก่ เวลาเฉลี่ยในการจัดทำแฟ้มหลักฐานลดลง 58% และอัตราการปิดคดีภายใน 30 วันเพิ่มจาก 60% เป็น 88% เนื่องจากลดข้อโต้แย้งเรื่องความถูกต้องของหลักฐานดิจิทัล

สรุปผลเชิงปริมาณจากการทดลองใช้งาน

- เวลาในการยืนยันเฉลี่ย: 3 วินาที (การตรวจจับ + ล็อกพยานหลักฐาน)

- การลดการแพร่กระจายของคลิปเท็จ: 52%–74% ขึ้นกับประเภทพาร์ทเนอร์และจังหวะการดำเนินการ

- อัตราการปิดเคสของทีมตรวจสอบ: เพิ่มจาก 42% เป็น 88%–91%

- การลดอุทธรณ์ต่อการลบเนื้อหา: ประมาณ 41%

- การยอมรับเป็นพยานหลักฐานโดยหน่วยงานกำกับ: เพิ่มเป็นราว 86%

คำติชมจากผู้ใช้งานและการปรับปรุงฟีเจอร์

จากการสัมภาษณ์ผู้ใช้งานในสนาม ทีมบรรณาธิการแพลตฟอร์ม และเจ้าหน้าที่กำกับ มีข้อเสนอแนะและคำชมที่สำคัญดังนี้:

- คำชม — ผู้ใช้ยกว่าการล็อกพยานหลักฐานบนบล็อกเชนช่วยสร้างความเชื่อมั่นเชิงสาธารณะได้รวดเร็วและลดการโต้แย้งเรื่องแหล่งที่มาของไฟล์

- คำติชมเชิงปฏิบัติการ — ต้องการฟีเจอร์ batch-processing สำหรับการตรวจคลิปจำนวนมากพร้อมกัน และ API ที่ยืดหยุ่นเพื่อผสานกับ CMS/ระบบมอดิเรชันเดิม

- คำติชมด้านความเข้าใจผลลัพธ์ — ผู้ตรวจสอบต้องการรายงานที่อธิบายได้ (explainable output) มากขึ้น เช่น จุดที่ระบบพบการดัดแปลง (tampering markers) และระดับความมั่นใจเชิงตัวเลข เพื่อประกอบการตัดสินใจเชิงบริบท

- การปรับปรุงที่นำไปใช้ — ทีมพัฒนาได้เร่งเพิ่มฟีเจอร์การส่งออกรายงานแบบ PDF/CSV, ปรับโมเดลให้รองรับภาษาและบริบทท้องถิ่น และเพิ่มแดชบอร์ดแสดง chain-of-custody เพื่อให้หน่วยงานกำกับสามารถดาวน์โหลดหลักฐานสำหรับการใช้งานทางกฎหมายได้โดยตรง

โดยรวม การทดลองใช้งานของ ForensAI‑Chain กับสำนักข่าว แพลตฟอร์มโซเชียล และหน่วยงานกำกับได้แสดงให้เห็นผลลัพธ์เชิงบวกทั้งในมิติความเร็ว ความชัดเจนของหลักฐาน และการลดการแพร่กระจายของเนื้อหาเท็จ ขณะเดียวกันก็ชี้ให้เห็นช่องว่างเชิงปฏิบัติการที่ต้องพัฒนาเพิ่มเติมเพื่อให้การนำไปใช้ในวงกว้างมีประสิทธิภาพและยอมรับได้มากขึ้น

ประเด็นด้านกฎหมาย จริยธรรม และอุปสรรคในการนำไปใช้

ประเด็นด้านกฎหมาย จริยธรรม และอุปสรรคในการนำไปใช้

การนำระบบตรวจจับ deepfake ที่ล็อกพยานหลักฐานบนบล็อกเชนมาใช้กับสำนักข่าวและแพลตฟอร์ม มีประเด็นทางกฎหมายและจริยธรรมเชิงพื้นฐานที่ต้องพิจารณาอย่างรอบคอบ โดยเฉพาะเรื่อง ความถูกต้องของหลักฐาน (admissibility) ในกระบวนการยุติธรรม แม้บล็อกเชนจะให้คุณสมบัติด้านความไม่สามารถแก้ไขย้อนหลังได้ (immutability) และการยืนยันความสมบูรณ์ของข้อมูลผ่านการจัดเก็บแฮช แต่ศาลจะพิจารณายอมรับหรือไม่ขึ้นกับกระบวนการพิสูจน์ที่ชัดเจน เช่น การจัดทำ chain of custody ที่ระบุขั้นตอนการได้มาซึ่งหลักฐาน การใช้ลายเซ็นดิจิทัลหรือการลงเวลาที่น่าเชื่อถือ และการให้ผู้เชี่ยวชาญอธิบายกระบวนการตรวจจับและการล็อกข้อมูลต่อศาล นอกจากนี้ ความยอมรับของหลักฐานอาจแตกต่างตามเขตอำนาจศาล จึงควรออกแบบกระบวนการให้สอดคล้องกับแนวทางทางกฎหมายท้องถิ่นและมาตรฐานสากลในการจัดการพยานดิจิทัล

ด้าน ความเป็นส่วนตัว การเก็บและแชร์ข้อมูลสื่อที่ถูกวิเคราะห์โดยระบบ ForensAI‑Chain ต้องสอดคล้องกับกฎคุ้มครองข้อมูลส่วนบุคคล (เช่น PDPA ของไทย หรือมาตรการคุ้มครองข้อมูลในต่างประเทศ) แนวปฏิบัติที่แนะนำคือการ เก็บเฉพาะข้อมูลจําเป็น บนบล็อกเชน (เช่น แฮชของไฟล์, เมตาดาต้าเชิงเทคนิค, การลงเวลาของการตรวจสอบ) โดยเก็บเนื้อหาเชิงสื่อจริงแบบเข้ารหัสหรือเก็บแบบ off‑chain พร้อมการบันทึกสิทธิ์เข้าถึง (access log) ที่โปร่งใสและตรวจสอบได้ นอกจากนี้ควรมีการประเมินผลกระทบด้านคุ้มครองข้อมูล (Data Protection Impact Assessment) และขอความยินยอมจากเจ้าของข้อมูลเมื่อจำเป็น รวมถึงการกำหนดนโยบายการเก็บรักษาและการลบ (retention & deletion) ที่ชัดเจน

ความเสี่ยงจาก false positives และการโจมตีแบบ adversarial เป็นอุปสรรคเชิงปฏิบัติการที่สำคัญ: false positives อาจก่อให้เกิดความเสียหายต่อชื่อเสียง บุคคลอาจฟ้องร้องเรียกค่าเสียหายหรือฟ้องหมิ่นประมาท หากระบบระบุเนื้อหาเป็น deepfake โดยไม่มีการยืนยันเพิ่มเติม ส่วน adversarial attacks สามารถชะลอหรือบิดเบือนผลการตรวจจับได้ งานวิจัยด้านความปลอดภัยแสดงให้เห็นว่าเทคนิคโจมตีเชิงศิลปะสามารถลดความแม่นยำของโมเดลการจำแนกได้อย่างมีนัยสำคัญ (อาจถึงระดับหลายสิบเปอร์เซ็นต์ในกรณีที่ไม่มีมาตรการป้องกัน) ดังนั้นการออกแบบระบบต้องคำนึงถึงมาตรการบรรเทา (mitigation) ดังต่อไปนี้:

- Multi‑factor verification: ผสานผลการตรวจจากหลายโมดูล (เชิงสัญญาณ ภาพ เสียง และเมตาดาต้า) พร้อมการตรวจสอบด้วยมนุษย์ (human‑in‑the‑loop) สำหรับเคสที่มีความไม่แน่นอนสูง

- ชั้นการพิสูจน์หลายระดับ: ระบุระดับความเชื่อมั่น (confidence scores) และให้ขั้นตอนอุทธรณ์หรือรีวิว เพื่อป้องกันผลลัพธ์ที่อาจก่อให้เกิดความเสียหายโดยทันที

- การจัดการกุญแจและความน่าเชื่อถือของบล็อกเชน: ใช้ระบบจัดการกุญแจที่ปลอดภัย (HSM, multisig, key rotation) และพิจารณาใช้บล็อกเชนแบบ permissioned หรือการร่วมลงนามโดยหน่วยงานที่เชื่อถือได้เพื่อเพิ่มความน่าเชื่อถือของการลงบันทึก

- การเก็บข้อมูลแบบ off‑chain และแฮชบน chain: เพื่อคงความเป็นส่วนตัวและลดความเสี่ยงการรั่วไหลของข้อมูล ด้านการเข้าถึงใช้การบันทึกการอนุญาตและการตรวจสอบที่ชัดเจน

- การทดสอบเชิงรุกกับ adversarial examples: ทำ adversarial training, การสแกนช่องโหว่ และเล่นบทโจมตี (red‑team exercises) เป็นประจำเพื่อลดความเสี่ยงจากการถูกหลอกลวง

- การเปิดเผยความแม่นยำและความเสี่ยง: รายงานค่า false positive/false negative, ขอบเขตการใช้งาน และข้อจำกัดของระบบต่อผู้ใช้งานและพันธมิตร เพื่อให้การนำไปใช้มีความโปร่งใสและลดความเสี่ยงทางกฎหมาย

ในเชิงปฏิบัติ ผู้ให้บริการควรจัดทำนโยบายทางกฎหมายและจริยธรรม รวมถึงกรอบการรับผิดชอบการใช้งาน (governance & accountability) ที่ชัดเจน เช่น ข้อตกลงการให้บริการ (Terms of Service) ที่ระบุขอบเขตความรับผิดชอบ, ระบบบันทึกเหตุการณ์แบบครบวงจร (audit trail) เพื่อสนับสนุนการตรวจสอบย้อนหลัง และการทำงานร่วมกับผู้เชี่ยวชาญกฎหมายและหน่วยกำกับดูแลเพื่อปรับกระบวนการให้สอดคล้องกับข้อกำหนดของศาลและข้อบังคับด้านข้อมูล ตลอดจนการทดลองเชิงนโยบาย (pilot programs) กับสำนักข่าวและแพลตฟอร์มต่าง ๆ เพื่อรวบรวมข้อมูลการใช้งานจริงและปรับปรุงระบบตามผลลัพธ์จริงก่อนการขยายการให้บริการในวงกว้าง

บทสรุป

ForensAI‑Chain เสนอโซลูชันที่ผสานการตรวจจับ Deepfake ด้วยปัญญาประดิษฐ์และการล็อกพยานหลักฐานบนบล็อกเชน เพื่อให้สำนักข่าวและแพลตฟอร์มสามารถยืนยันความถูกต้องของสื่อได้อย่างรวดเร็ว — บริษัทอ้างว่าสามารถยืนยันภายใน 3 วินาทีพร้อมอัตราความแม่นยำสูง หากผลการทดสอบภาคสนามสอดคล้องกับข้ออ้างเหล่านี้ ระบบดังกล่าวมีศักยภาพเพิ่มความน่าเชื่อถือของการรายงานข่าวและกระบวนการคัดกรองคอนเทนต์อย่างมีนัยสำคัญ ช่วยสกัดกั้นการแพร่กระจายของข้อมูลเท็จและลดความเสี่ยงจากการนำสื่อปลอมไปใช้ในข่าวหรือแพลตฟอร์มสังคมออนไลน์

การนำไปใช้จริงต้องคำนึงถึงประเด็นสำคัญหลายด้าน ได้แก่ การกำหนดมาตรฐานการทดสอบและการตรวจสอบผล (third‑party audits), การยอมรับทางกฎหมายและการคุ้มครองสิทธิพลเมือง, รวมถึงการออกแบบ UX สำหรับบรรณาธิการให้ระบบทำหน้าที่เป็น เครื่องมือช่วยตัดสินใจ ไม่ใช่คำตัดสินสุดท้าย นอกจากนี้ต้องมีการติดตามการพัฒนาโมเดลอย่างต่อเนื่อง ปรับปรุงการจัดการความเป็นส่วนตัว (เช่น การลดข้อมูลส่วนบุคคลและการทำให้ไม่ระบุตัวตนก่อนล็อกบนบล็อกเชน) และพิจารณากรอบการกำกับดูแลควบคู่ไปกับการใช้งานเชิงพาณิชย์

มุมมองอนาคต: หากมีการพิสูจน์ประสิทธิภาพในภาคสนาม ประสานมาตรฐานด้านเทคนิคและกฎหมาย และออกแบบการนำเสนอผลสำหรับงานข่าวอย่างรอบคอบ ForensAI‑Chain อาจกลายเป็นส่วนหนึ่งของระบบนิเวศการตรวจสอบข้อเท็จจริงของสื่อได้จริง การเดินหน้าในทิศทางนี้ควรเริ่มจากโครงการนำร่องร่วมกับสำนักข่าว การตรวจสอบอิสระ และการสร้างแนวปฏิบัติร่วมของอุตสาหกรรม เพื่อให้เทคโนโลยีช่วยลดการแพร่กระจายข่าวปลอมได้อย่างมีประสิทธิภาพ พร้อมคงไว้ซึ่งความรับผิดชอบเชิงวิชาชีพและการคุ้มครองสิทธิของประชาชน