รัฐบาลประกาศเปิดตัว OpenGov‑Vector API เวกเตอร์ข้อมูลภาครัฐ ซึ่งเป็นโครงสร้างข้อมูลเชิงบริบทที่ออกแบบมาให้โมเดลภาษาขนาดใหญ่ (LLM) สามารถดึงข้อมูลภาครัฐแบบเรียลไทม์พร้อมแท็กแหล่งที่มาได้โดยตรง เป้าหมายหลักคือการลดความคลาดเคลื่อนของข้อมูล (hallucination) ที่เกิดจากการอ้างอิงข้อมูลล้าสมัยหรือไม่ชัดเจน และเพิ่มความโปร่งใสในการให้บริการสาธารณะ โดย OpenGov‑Vector จะจัดทำดัชนีเวกเตอร์จากเอกสาร นโยบาย บันทึกการประชุม และชุดข้อมูลเปิดของหน่วยงานราชการ พร้อมเก็บเมตาดาต้า เช่น แหล่งที่มา วันที่ และลิงก์อ้างอิง เพื่อให้คำตอบจาก LLM สามารถแสดงบริบทและการอ้างอิงแหล่งข้อมูลได้ทันที

จุดเด่นของโครงการคือการผสานการอัปเดตแบบเรียลไทม์กับการระบุแหล่งที่มาที่ชัดเจน ส่งผลให้แชตบอทของหน่วยงานสามารถตอบคำถามเช่นเกณฑ์รับสิทธิ์สวัสดิการ การเปลี่ยนแปลงกฎหมาย หรือข้อมูลเหตุฉุกเฉิน โดยแนบลิงก์เอกสารต้นฉบับและเวลาที่ข้อมูลอัปเดต ตัวอย่างการใช้งานครอบคลุมตั้งแต่ระบบให้บริการประชาชนผ่านช่องทางดิจิทัล การสนับสนุนการตัดสินใจของข้าราชการ จนถึงการวิเคราะห์นโยบายเชิงลึก ซึ่งคาดว่าจะช่วยยกระดับความน่าเชื่อถือของข้อมูลภาครัฐและเพิ่มความโปร่งใสต่อสาธารณะในวงกว้าง

บทนำ: ประกาศเปิดตัวและความสำคัญ

บทนำ: ประกาศเปิดตัวและความสำคัญ

รัฐบาลประกาศเปิดตัว OpenGov‑Vector—แพลตฟอร์มและ API เวกเตอร์สำหรับเข้าถึงข้อมูลภาครัฐในรูปแบบที่รองรับการดึงข้อมูลเชิงบริบทโดยโมเดลภาษาใหญ่ (LLM) แบบเรียลไทม์ ระบบนี้ออกแบบมาเพื่อให้ LLM สามารถค้นหาและยกข้อมูลอ้างอิงจากเอกสารภาครัฐ ฐานข้อมูลเชิงสถิติ และรายงานนโยบายต่าง ๆ ได้ทันที พร้อมทั้งแนบ แท็กแหล่งที่มา (provenance) ที่ระบุแหล่งข้อมูลอย่างชัดเจน ทั้ง URL, หน่วยงานที่เผยแพร่ และรหัสเอกสาร ทำให้คำตอบมีความโปร่งใสและตรวจสอบย้อนกลับได้ง่ายขึ้น

ฟีเจอร์หลักของ OpenGov‑Vector สรุปได้เป็นข้อ ๆ ดังนี้

- การค้นหาเวกเตอร์เชิงบริบท — รองรับการแมตช์ความหมายเชิงบริบทของคำถามกับเนื้อหาเอกสาร ที่ช่วยให้ LLM ดึงส่วนที่สอดคล้องที่สุดแทนการพึ่งพาความทรงจำภายในเพียงอย่างเดียว

- อัปเดตแบบเรียลไทม์ — ดัชนีและเวกเตอร์ข้อมูลอัปเดตเมื่อมีเอกสารใหม่หรือการแก้ไข ลดปัญหาข้อมูลล้าสมัย

- แท็กแหล่งที่มาและเมตาดาต้าเชิงมาตรฐาน — แนบข้อมูลแหล่งที่มาในผลลัพธ์เพื่อการอ้างอิงและการตรวจสอบย้อนกลับ (audit trail)

- ระบบควบคุมการเข้าถึงและคีย์ API — รองรับการใช้งานทั้งแบบสาธารณะและแบบมีข้อจำกัดสำหรับหน่วยงานภาครัฐ

- รูปแบบการตอบสนองที่เชื่อมโยงกับนโยบาย — ส่งผลให้บริการตอบคำถามของภาครัฐสามารถอ้างอิงกฎหมาย ระเบียบ หรือประกาศล่าสุดได้ทันที

ในด้านนโยบาย OpenGov‑Vector ตั้งเป้าไปที่การยกระดับ ความถูกต้อง (accuracy), ความโปร่งใส (transparency) และ การเข้าถึงข้อมูล (accessibility) สำหรับประชาชนและผู้พัฒนาระบบ โดยการจัดให้มีแหล่งข้อมูลที่เป็นทางการและสามารถตรวจสอบได้เป็นมาตรฐานเดียวกัน จะช่วยลดความเสี่ยงจากคำตอบที่บิดเบือนหรือเกิดการ "hallucination" ของ LLM และสนับสนุนการปฏิบัติตามข้อกำหนดด้านข้อมูลเปิด (open data) และการคุ้มครองข้อมูลภาครัฐ

ผลกระทบทันทีที่คาดหวังต่อการพัฒนาระบบ LLM ทั้งของภาครัฐและผู้ให้บริการเอกชน ได้แก่ การลดความคลาดเคลื่อนของคำตอบเมื่อเทียบกับการใช้โมเดลเพียงอย่างเดียว การเพิ่มความสามารถในการอ้างอิงแหล่งที่มาทางข้อความตอบกลับ และการเร่งเวลานำผลิตภัณฑ์สู่การใช้งานจริง ตัวอย่างเช่น ในกรณีการตอบคำถามเกี่ยวกับนโยบายภาษีหรือประกาศฉุกเฉิน ระบบที่ผสานกับ OpenGov‑Vector จะสามารถดึงมาตรา วรรค หรือลิงก์ประกาศล่าสุดมาแสดงเป็นหลักฐานประกอบคำตอบได้ทันที ซึ่งคาดว่าจะช่วยลดข้อผิดพลาดเชิงเนื้อหาในระดับที่มีนัยสำคัญและเสริมสร้างความเชื่อมั่นของประชาชน

โดยสรุป การเปิดตัว OpenGov‑Vector ถือเป็นก้าวสำคัญทางเทคนิคและเชิงนโยบายที่จะผลักดันให้บริการดิจิทัลของรัฐมีทั้งความแม่นยำและความโปร่งใสมากขึ้น ขณะเดียวกันยังส่งสัญญาณถึงผู้พัฒนาและผู้ให้บริการ AI ว่าแหล่งข้อมูลภาครัฐจะพร้อมสำหรับการเชื่อมต่อเชิงบริบท ซึ่งสามารถช่วยยกระดับบริการพลเมือง (citizen services) ตลอดจนการตรวจสอบและประเมินผลนโยบายในอนาคต

ทำไมต้องมี OpenGov‑Vector: ปัญหาเดิมและความจำเป็น

ทำไมต้องมี OpenGov‑Vector: ปัญหาเดิมและความจำเป็น

ในยุคที่ปัญญาประดิษฐ์เชื่อมโยงกับการให้ข้อมูลสาธารณะ บทบาทของ Large Language Models (LLMs) ในการตอบคำถามสาธารณะและช่วยบริการภาครัฐเพิ่มขึ้นอย่างรวดเร็ว แต่ปัญหาพื้นฐานหลายประการยังเป็นอุปสรรคสำคัญต่อความน่าเชื่อถือและการใช้งานจริง ตัวอย่างที่ชัดเจนคือปรากฏการณ์ hallucination ของโมเดลภาษาซึ่งงานวิจัยหลายชิ้นชี้ว่าอัตราการเกิดข้อเท็จจริงผิดพลาดอาจอยู่ในช่วง ประมาณ 10–30% ขึ้นอยู่กับประเภทข้อมูลและเมตริกที่ใช้วัด การให้ข้อมูลที่ผิดหรือเก่าแก่โดยไม่อ้างอิงแหล่งที่มา ทำลายความเชื่อมั่น ของประชาชนและเสี่ยงต่อผลกระทบทางกฎหมายหรือการบริหารที่ไม่ถูกต้อง

อีกปัญหาหนึ่งที่เห็นได้ชัดคือข้อมูลภาครัฐมักถูกเก็บและเผยแพร่อย่างกระจัดกระจายระหว่างหน่วยงานต่าง ๆ ทั้งในรูปแบบเอกสาร PDF, หน้าเว็บไซต์แบบสแตติก, ฐานข้อมูลเดิมที่ไม่ได้ออกแบบมาเพื่อการดึงข้อมูลเชิงบริบท และบริการ API ที่ไม่สอดคล้องกัน ผลลัพธ์คือ LLM เมื่อพยายามสรุปหรือให้คำแนะนำมักต้องพึ่งพาข้อมูลที่รวมจากแหล่งต่าง ๆ ซึ่งเพิ่มโอกาสของความผิดพลาดและการให้คำตอบที่ขัดกันต่อผู้ใช้

ผลกระทบจากข้อมูลที่ผิดพลาดหรือล้าสมัยต่อประชาชนเป็นเรื่องที่เกิดขึ้นจริง ตัวอย่างเช่น ในสถานการณ์ฉุกเฉินหรือการเปลี่ยนนโยบายที่รวดเร็ว (เช่น มาตรการสาธารณสุข สิทธิประโยชน์สวัสดิการ หรือการชำระภาษี) หากระบบตอบกลับด้วยข้อมูลที่ยังไม่อัปเดตหรือไม่มีการอ้างอิง ก็อาจนำไปสู่การตัดสินใจที่ผิดพลาดของประชาชน การยื่นคำขอที่ไม่เป็นไปตามกฎระเบียบ หรือล่าช้าในการได้รับสิทธิ ซึ่งในระดับประชากรจำนวนมากอาจก่อให้เกิดความเสียหายทั้งทางเศรษฐกิจและสังคมได้

ความต้องการที่สำคัญเพื่อลดปัญหาเหล่านี้คือความสามารถของระบบในการดึงข้อมูลเชิงบริบทที่มีการอัปเดตแบบเรียลไทม์ พร้อมทั้งแสดง แหล่งที่มา (source attribution) ที่ชัดเจนและตรวจสอบได้ ประชาชนและหน่วยงานต่าง ๆ ต้องการระบบที่ไม่เพียงแต่ให้คำตอบที่รวดเร็ว แต่ต้องสามารถยืนยันความถูกต้องทางข้อมูลได้ทันที การเชื่อมต่อ LLM เข้ากับ API ข้อมูลภาครัฐที่มีทั้งเวอร์ชันและแท็กแหล่งที่มา จึงกลายเป็นความจำเป็นเชิงโครงสร้างเพื่อป้องกัน hallucination และลดความคลาดเคลื่อนของข้อมูลภาครัฐ

- Hallucination และข้อมูลล้าสมัย — โมเดลอาจสร้างคำตอบที่ดูสมเหตุสมผลแต่ไม่ถูกต้อง หรือใช้ข้อมูลที่เก่าจนทำให้คำแนะนำไม่สอดคล้องกับนโยบายปัจจุบัน (งานวิจัยชี้อัตราประมาณ 10–30%)

- ข้อมูลภาครัฐกระจัดกระจาย — ข้อมูลกระจายในหลายหน่วยงาน รูปแบบไม่เป็นมาตรฐาน และเก็บในระบบเดิมที่ไม่รองรับการสืบค้นเชิงบริบท

- ความต้องการการอ้างอิงแหล่งที่มาและการอัพเดตเรียลไทม์ — ผู้ใช้และผู้ตัดสินใจต้องการคำตอบที่มาพร้อมแหล่งอ้างอิงที่ชัดเจน และการอัปเดตข้อมูลทันทีที่มีการเปลี่ยนแปลงนโยบายหรือกฎระเบียบ

ด้วยเหตุนี้ การมอบโครงสร้างข้อมูลกลางที่สามารถเชื่อมต่อกับ LLM ในรูปแบบเวกเตอร์เชิงบริบท ซึ่งรวมถึงการแท็กแหล่งที่มาและการอัปเดตแบบเรียลไทม์ จึงไม่ใช่เพียงฟีเจอร์เสริม แต่เป็นองค์ประกอบจำเป็นในการยกระดับความน่าเชื่อถือของบริการข้อมูลภาครัฐ ลดความเสี่ยงจากข้อมูลผิดพลาด และสร้างความไว้วางใจต่อประชาชนและภาคธุรกิจ

สถาปัตยกรรมเทคนิคของ OpenGov‑Vector

สถาปัตยกรรมเทคนิคของ OpenGov‑Vector

ภาพรวมเชิงสถาปัตยกรรม — OpenGov‑Vector ถูกออกแบบเป็นแพลตฟอร์มบริการเวกเตอร์สำหรับข้อมูลภาครัฐที่สนับสนุนการดึงข้อมูลเชิงบริบทแบบเรียลไทม์ เพื่อให้ LLM สามารถอ้างอิงแหล่งข้อมูลได้อย่างมีหลักฐาน (provenance) สถาปัตยกรรมหลักประกอบด้วยชั้น (layer) ดังนี้: แหล่งข้อมูลภาครัฐ (ต้นทางเอกสารและฐานข้อมูล), ท่อการนำเข้าและแปลงข้อมูล (ingestion & preprocessing), บริการสร้าง embeddings, ตัวจัดเก็บเวกเตอร์ (vector database) พร้อมดัชนี ANN, บริการ API สำหรับการค้นคืนและการผสานกับ LLM ผ่านกลไก RAG, และชั้นการจัดการความปลอดภัยและการตรวจสอบ (auth & audit).

การแปลงเอกสารราชการเป็น embeddings และการจัดทำดัชนีเวกเตอร์: เอกสารราชการถูกนำเข้าผ่าน connector แบบเชื่อมต่อกับระบบภายในภาครัฐ (เช่น CKAN, DMS, FTP, หรือฐานข้อมูล SQL/NoSQL) แล้วผ่านกระบวนการ preprocessing (OCR สำหรับเอกสารสแกน, การทำ tokenization, การตรวจจับภาษาหลัก/ย่อย ฯลฯ) ก่อนจะถูกแบ่งเป็นชิ้น (chunking) ขนาดมาตรฐาน (มักใช้ช่วง 512–1,024 tokens โดยมี overlap 10–30% เพื่อรักษาบริบทที่ต่อเนื่อง) แต่ละชิ้นจะถูกส่งไปยังโมดูล embedding generator ซึ่งรองรับโมเดลหลากหลาย (เช่น multilingual sentence-transformers ขนาด 768–1,536 มิติ หรือบริการ embeddings ภายนอก) พร้อมกันนี้จะบันทึกเมตาดาต้าเชิงบริบท ได้แก่ doc_id, section_id, author/หน่วยงานต้นทาง, timestamp และ offset ในเอกสาร เพื่อให้สามารถทำ provenance ในผลลัพธ์ได้

การจัดเก็บและดัชนีแบบ nearest neighbor (ANN): Embedding ที่ได้จะถูกใส่ลงในระบบจัดเก็บเวกเตอร์ที่รองรับการค้นหา ANN แบบกระจาย (เช่น HNSW, IVF‑PQ ใน Faiss, หรือระบบเชิงพาณิชย์เช่น Milvus, Pinecone) โดยสถาปัตยกรรมการจัดเก็บคำนึงถึงการชาร์ด (sharding), การทำซ้ำ (replication) และการสำรองข้อมูล การสร้างดัชนีจะมีนโยบายอัปเดตสองทางคือ (1) batch re‑indexing รายวัน/รายชั่วโมง สำหรับการเปลี่ยนแปลงปริมาณมาก และ (2) near‑real‑time upserts ผ่าน event stream (เช่น Kafka / Google Pub/Sub) สำหรับการอัปเดตเอกสารสำคัญที่ต้องการเผยแพร่แบบทันที ดัชนี ANN ถูกตั้งค่าพารามิเตอร์เพื่อปรับสมดุลระหว่าง recall และ latency (เช่น ค่า M และ efSearch ใน HNSW หรือ nlist/nprobe ใน IVF) และระบบสนับสนุน hybrid search โดยรวมสัญญาณแบบเวกเตอร์กับสัญญาณแบบคลาสสิก (BM25) สำหรับกรณีที่ต้องการความแม่นยำเชิงคำค้นสูง

การค้นคืนเชิงบริบทด้วย ANN และการผสานกับ LLM ผ่าน RAG — เมื่อมีคำถามจาก API หรือจาก LLM (เช่นในกระบวนการ RAG) ระบบ retriever จะเรียก ANN search เพื่อดึง top‑k chunks ที่เกี่ยวข้อง (ค่าทั่วไป k=5–20 ขึ้นกับ use case) ผลลัพธ์จะแนบเมตาดาต้า provenance และส่งต่อไปยังขั้นตอน optional: (1) re‑ranking โดยใช้ cross‑encoder แบบเบาเพื่อปรับลำดับความเกี่ยวข้อง (2) context fusion เช่นการย่อสรุป (summarization) ของหลายชิ้นก่อนนำเข้า LLM หรือ (3) fusion‑in‑decoder เมื่อใช้สถาปัตยกรรมที่ LLM สามารถอ่านหลายบริบทพร้อมกัน จากนั้น LLM จะสร้างคำตอบโดยอ้างอิงบริบทที่ดึงมาและแนบแท็กแหล่งที่มา (เช่น [หน่วยงาน/เอกสาร/พารากราฟ:offset]) เพื่อให้ผู้ใช้งานตรวจสอบได้

ประสิทธิภาพ (latency, throughput) และการปรับแต่งเชิงปฏิบัติ: ระดับ latency มีหลายชั้นที่ต้องพิจารณา — การค้นหา ANN ในดัชนีที่ปรับแต่งมาดีบนฮาร์ดแวร์ที่เหมาะสมมักอยู่ในช่วง ~1–20 ms ต่อคำค้น (ขึ้นกับขนาดดัชนีและพารามิเตอร์ ANN) แต่การรวมขั้นตอน re‑ranking, การดึงเมตาดาต้า และการเตรียม context อาจเพิ่มเป็น ~10–150 ms ต่อคำขอ ในทางกลับกัน การเรียกใช้งาน LLM เพื่อสร้างคำตอบแบบเต็ม (ขึ้นกับขนาดโมเดลและการตั้งค่า) จะเพิ่มเวลาอีก ~100 ms จนถึงหลายวินาที: ตัวอย่างเช่น LLM ขนาดกลางบน GPU อาจตอบภายใน 200–800 ms สำหรับผลลัพธ์สั้น ๆ ขณะที่รุ่นใหญ่หรือการใช้ streaming output อาจอยู่นานเป็นวินาที สำหรับ throughput ระบบสามารถปรับสเกลด้วยการชาร์ดดัชนี, replication ของบริการ retriever, และการใช้ batching ในการทำ embedding และ search — ค่าที่เป็นไปได้ในระบบผลิตจริงคือ tens ถึง thousands QPS โดยใช้ cluster ขนาดกลางถึงใหญ่ พร้อม caching ของผลการค้นหายอดนิยมเพื่อลด latency ซ้ำ

มาตรฐาน API และความมั่นคงปลอดภัย: OpenGov‑Vector ให้บริการ API ทั้งแบบ REST และ gRPC เพื่อรองรับลูกค้าหลากหลายรูปแบบ โดยมี endpoint สำหรับ ingestion (bulk & streaming), embeddings (batch & real‑time), search/retrieve (sync & streaming), และ provenance retrieval ตอบกลับจะมีโครงสร้าง JSON ที่รวม score, source_id, section_offset, และ confidence/flags เพื่อให้ง่ายต่อการตรวจสอบ ระบบการยืนยันตัวตนรองรับ OAuth2 (client credentials, JWT), API keys แบบมีเวลาหมดอายุ, และ mTLS สำหรับการเชื่อมต่อระหว่างหน่วยงานภายใน นโยบาย authorization แบบ role‑based (RBAC) ถูกใช้ควบคุมสิทธิ์ในการเข้าถึงระดับช่องข้อมูลและฟังก์ชันการเรียกใช้ นอกจากนี้มี logging/Audit trail เพื่อรองรับข้อกำหนดด้านการกำกับดูแล (compliance) ของภาครัฐ

- ตัวอย่างพารามิเตอร์เชิงเทคนิค: embedding dim = 768–1,536; chunk size = 512–1,024 tokens; ANN engine = HNSW (M=16–64, efConstruction=200–1,000), IVF‑PQ (nlist=1k–10k, nprobe=10–100)

- นโยบายการอัปเดต: batch reindex ทุก 1–24 ชั่วโมง + near‑real‑time upsert ผ่าน event stream สำหรับเอกสารด่วน

- SLAs ที่คาดไว้: search p95 latency ≤ 200 ms (สำหรับการตั้งค่าโหนดขนาดกลาง); end‑to‑end RAG response p95 ≤ 1.5 s กับ LLM ขนาดกลาง

โดยสรุป สถาปัตยกรรมของ OpenGov‑Vector มุ่งสร้างสมดุลระหว่างความแม่นยำในการค้นคืนเชิงบริบท การตอบสนองเชิงเวลาที่เป็นมิตรต่อผู้ใช้งาน และการรับรองแหล่งที่มาของข้อมูลอย่างชัดเจน ซึ่งจำเป็นต่อการลดความคลาดเคลื่อนของข้อมูลภาครัฐและเพิ่มความโปร่งใสในการใช้งาน LLM ในบริบทเชิงนโยบายและบริการสาธารณะ

ฟีเจอร์สำคัญ: แท็กแหล่งที่มา (provenance) และมาตรฐานเมตาดาต้า

แท็กแหล่งที่มาที่มีโครงสร้าง (Structured Provenance Tags)

ระบบ OpenGov‑Vector บันทึกแท็กแหล่งที่มาในรูปแบบที่เป็นโครงสร้างชัดเจน เพื่อให้ LLM และแอปพลิเคชันภายนอกสามารถตรวจสอบความถูกต้องและย้อนกลับไปยังต้นฉบับได้โดยอัตโนมัติ ข้อมูลที่เก็บสำหรับแต่ละรายการประกอบด้วย:

- id — รหัสเอกสารเฉพาะ (Document ID) ที่ใช้เชื่อมโยงกับดัชนีและประวัติการแก้ไข

- date — วันที่เผยแพร่หรือวันที่ออกเอกสาร (Publication/Effective Date) ซึ่งสำคัญต่อการประเมินความทันสมัย

- agency — หน่วยงานเจ้าของข้อมูล (Owning Agency) เช่น กระทรวง เทศบาล หรือหน่วยงานรัฐวิสาหกิจ

- version — เลขเวอร์ชันของเอกสาร (Version) เพื่อให้ระบบสามารถแยกแยะระหว่างร่าง/ฉบับปรับปรุงได้

- url — ลิงก์ต้นฉบับที่สามารถเข้าถึงเอกสารเต็มข้อความหรือหน้าเว็บที่เผยแพร่

การจัดเก็บข้อมูลดังกล่าวเป็นไปตามแนวทางเมตาดาต้าแบบเปิด (เช่น การแมปไปยัง schema.org หรือมาตรฐาน metadata ภาครัฐ) เพื่อรองรับการทำงานร่วมกับระบบอื่นและการตรวจสอบย้อนหลัง

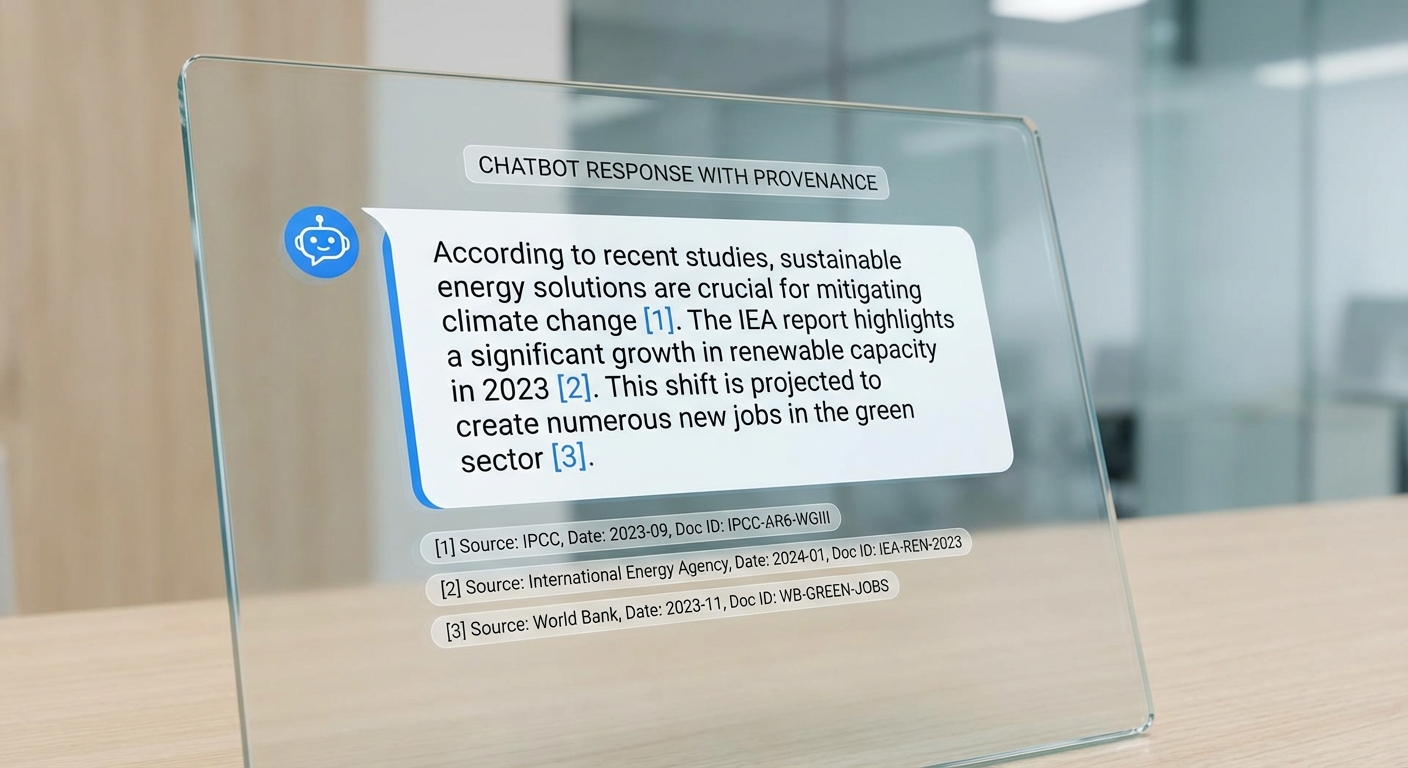

การแนบแหล่งที่มาเมื่อ LLM ตอบ (Inline Citations และ Citation Snippets)

เมื่อ LLM ตอบคำถาม ระบบจะแนบแหล่งที่มาแบบ inline (inline citations) พร้อมกับ citation snippet ที่สรุปบริบทสั้นๆ จากเอกสารต้นทาง ทำให้ผู้ใช้ทราบได้ทันทีว่าเนื้อหาชิ้นใดมาจากเอกสารอะไร ตัวอย่างรูปแบบการแสดงผลที่ใช้ได้จริง เช่น:

- คำตอบ: "อัตราภาษีใหม่มีผลบังคับใช้ตั้งแต่ 1 ก.ค. 2567"

แหล่งที่มา: [GOV-2024-045 | 2024-07-01 | Ministry of Finance | v1 | https://gov.example/notice/045] — Excerpt: "ประกาศกระทรวงการคลัง เรื่อง อัตราภาษี ปี 2567 (ข้อ 2.1)…" - ผู้ใช้สามารถคลิกที่ลิงก์เพื่อไปยังหน้าต้นฉบับ หรือขยาย snippet เพื่อดูบริบทเพิ่มเติม เช่น ย่อหน้าเต็มหรือหมายเหตุประกาศ

การแสดงแหล่งที่มาแบบนี้ช่วยให้ผู้ใช้ประเมินความถูกต้องได้รวดเร็ว ลดความเสี่ยงจากการอ้างอิงผิดพลาด และสนับสนุนการตรวจสอบโดยมนุษย์ (human-in-the-loop)

ระบบคะแนนความน่าเชื่อถือ (Trust Score) และการจัดอันดับแหล่งข้อมูล

OpenGov‑Vector ประเมินความน่าเชื่อถือของแต่ละเอกสารด้วย trust score ที่คำนวณจากปัจจัยหลายมิติ ได้แก่ ความน่าเชื่อถือของหน่วยงานเจ้าของความถูกต้องของข้อมูล (authority), ความทันสมัย (recency), ความสมบูรณ์ของเมตาดาต้า (provenance completeness) และความสอดคล้องกับแหล่งอื่น (cross-source consistency)

- รูปแบบคะแนนเป็นมาตรฐาน (เช่น 0–100) โดยมีเกณฑ์กำหนดว่าเอกสารใดควรได้รับน้ำหนักสูงเมื่อนำไปเป็นบริบทสำหรับ LLM

- อัลกอริทึมการให้คะแนนผสมทั้งเงื่อนไขเชิงกฎ (heuristics) และโมเดลการเรียนรู้เครื่องที่ตรวจจับรูปแบบความน่าเชื่อถือจากประวัติการยืนยันข้อมูล

- ในทางปฏิบัติ ระบบจะเรียงลำดับเอกสารตาม trust score และเลือกแหล่งข้อมูลที่เหมาะสมที่สุดสำหรับการตอบ โดยสามารถกำหนดค่า threshold เพื่อกรองเอกสารที่คะแนนต่ำเกินไป

ผลการทดสอบนำร่องภายในระบุว่าเมื่อนำระบบแท็กแหล่งที่มาและ trust scoring มาใช้ร่วมกับ LLM พบการลดอัตราข้อผิดพลาดเชิงข้อเท็จจริง (fact errors) ลงอย่างมีนัยสำคัญ ผู้ทดสอบรายงานการลดความคลาดเคลื่อนของคำตอบได้กว่า ราว 30–40% เมื่อเทียบกับการดึงบริบทโดยไม่มีการแนบแหล่งที่มาและคะแนนความน่าเชื่อถือ

มาตรการอัปเดตทรัพยากรและการกำกับดูแล

เพื่อให้ข้อมูลใน OpenGov‑Vector ยังคงทันสมัยและเชื่อถือได้ ระบบออกแบบให้รองรับกระบวนการอัปเดตเชิงรุกและการตรวจสอบหลายชั้น ปัจจัยสำคัญได้แก่:

- Versioning และ Audit Trail — เก็บประวัติการเปลี่ยนแปลงทุกเวอร์ชันของเอกสาร พร้อมบันทึกการแก้ไขว่าใครแก้เมื่อใด

- Automated Refresh & Webhooks — หน่วยงานสามารถส่งสัญญาณอัปเดต (push) หรือระบบจะมีการสแกน/รีครอลตามตารางเวลาเพื่อตรวจหาการเปลี่ยนแปลง

- Re-validation และ Human Review — เมื่อมีความขัดแย้งระหว่างแหล่ง ระบบจะยกระดับไปยังการตรวจสอบโดยผู้เชี่ยวชาญของหน่วยงานก่อนเผยแพร่เป็นบริบทต่อสาธารณะ

- การจัดการ TTL และ Deprecation — เอกสารที่หมดความทันสมัยจะถูกติดป้ายว่า deprecated และได้รับคะแนน trust ต่ำลงจนกว่าจะได้รับการอัปเดตอย่างเป็นทางการ

นอกจากนี้ ระบบออกแบบให้สอดคล้องกับหลักการความโปร่งใส โดยเก็บบันทึกการตัดสินใจของโมเดล (decision logs) และเปิดให้หน่วยงานตรวจสอบย้อนหลังได้ ซึ่งช่วยเสริมการกำกับดูแลและตอบสนองต่อข้อร้องเรียนด้านข้อมูล

โดยสรุป การผสานแท็กแหล่งที่มาแบบมีโครงสร้าง การแสดง inline citations และระบบ trust scoring ใน OpenGov‑Vector ช่วยเพิ่มความโปร่งใส ลดความคลาดเคลื่อนของคำตอบจาก LLM และสร้างความเชื่อมั่นให้ผู้ใช้งานภาครัฐและภาคธุรกิจในการใช้ข้อมูลเชิงบริบทแบบเรียลไทม์

ตัวอย่างการใช้งาน (Use Cases) และกรณีศึกษา

ตัวอย่างการใช้งานโดยสรุป

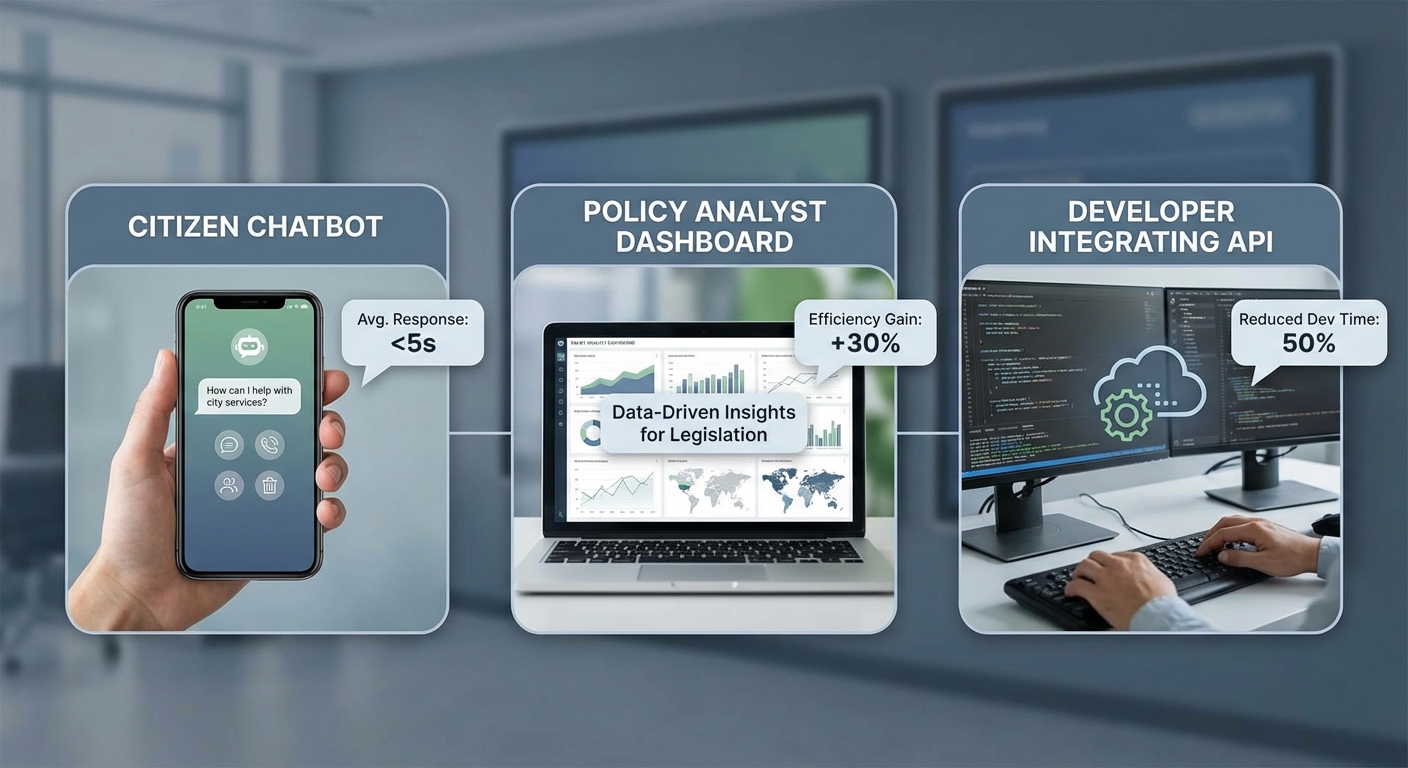

OpenGov‑Vector เป็น API เวกเตอร์ข้อมูลภาครัฐที่เปิดช่องทางให้ LLM ดึงข้อมูลเชิงบริบทแบบเรียลไทม์ พร้อมแท็กแหล่งที่มา ทำให้เกิดการใช้งานได้หลากหลายทั้งในภาครัฐและภาคเอกชน โดยเฉพาะในงานที่ต้องการ ความถูกต้องของข้อเท็จจริง และ การอ้างอิงแหล่งข้อมูล เช่น ระบบตอบคำถามพลเมือง (citizen helpdesk), เครื่องมือช่วยนักนโยบายในการสืบค้นเอกสารและข้อกฎหมายเชิงบริบท, รวมถึงการนำข้อมูลภาครัฐไปต่อยอดเป็นบริการสาธารณะโดยผู้ให้บริการภายนอก

1. บริการตอบคำถามพลเมืองพร้อมแหล่งอ้างอิง

การติดตั้ง OpenGov‑Vector ร่วมกับ LLM ในระบบตอบคำถามสาธารณะ ทำให้ทุกคำตอบสามารถแนบ แท็กแหล่งที่มา (provenance) เช่น ชื่อเอกสาร หน้าที่มาที่มา URL และวันที่อัปเดต ช่วยลดความคลาดเคลื่อนและสร้างความเชื่อมั่นต่อผู้ใช้

- ฟีเจอร์หลัก: การค้นหาเอกสารเชิงบริบท, การจัดอันดับเอกสารตามความเกี่ยวข้อง, การแนบแหล่งที่มาแบบเรียลไทม์

- ประโยชน์: ลดความเสี่ยงจากการให้ข้อมูลคลาดเคลื่อน, เพิ่มความโปร่งใส และลดภาระงานของเจ้าหน้าที่ที่ต้องตอบคำถามซ้ำซ้อน

ตัวอย่างเชิงปริมาณ (จำลอง): ก่อนใช้ OpenGov‑Vector ระบบตอบคำถามมีอัตราความคลาดเคลื่อนของคำตอบประมาณ 28% และใช้เวลาเฉลี่ยในการตอบ 18 วินาที ต่อคำถาม หลังนำ OpenGov‑Vector มาใช้ พบว่าอัตราความคลาดเคลื่อนลดลงเป็น 4% (ลดลงราว 86% ของอัตราคลาดเคลื่อนเดิม) และเวลาเฉลี่ยในการให้คำตอบลดลงเป็น 6 วินาที พร้อมกับมีการแนบแหล่งอ้างอิงในคำตอบ 100% ของกรณีที่ต้องอ้างอิงเอกสาร

2. เครื่องมือช่วยนักนโยบายสืบค้นเอกสารและข้อกฎหมายเชิงบริบท

นักนโยบายและนักวิเคราะห์มักต้องอ่านกฎหมายระเบียบและเอกสารนโยบายหลายฉบับ OpenGov‑Vector ช่วยให้การสืบค้นทำได้เชิงบริบทมากขึ้น เช่น ค้นตามช่วงเวลา (effective date), ขอบเขตอำนาจ (jurisdiction), ประเภทเอกสาร (กฎกระทรวง ประกาศ ระเบียบ) และสามารถดึงข้อความอ้างอิงย่อย (passage) ที่เกี่ยวข้องมาให้ LLM สรุปหรือเปรียบเทียบได้ทันที

- ตัวอย่างการใช้งาน: นักนโยบายสามารถขอ "สรุปบทบัญญัติที่เกี่ยวข้องกับการคุ้มครองข้อมูลส่วนบุคคลภายใต้มาตรา X" และได้ทั้งสรุปเชิงบริบทพร้อมยกข้อความต้นฉบับและอ้างอิงเอกสาร

- ผลลัพธ์เชิงประสิทธิภาพ (จำลอง): Precision ของผลการค้นหาเพิ่มจากราว 55% เป็น 93% และเวลาที่ใช้ในการรวบรวมข้อมูลสำหรับร่างรายงานลดจากเฉลี่ย 6–8 ชั่วโมง เหลือ 30–45 นาที (ประหยัดเวลาเกิน 80%)

การผสาน OpenGov‑Vector ยังสนับสนุนการทำงานเป็นทีมโดยการแนบแหล่งที่มาที่สามารถตรวจสอบย้อนหลัง (audit trail) ทำให้การอ้างอิงข้อกฎหมายมีความน่าเชื่อถือและสามารถบันทึกบริบทการค้นหาได้

3. ผู้ให้บริการภายนอกใช้ข้อมูลรัฐบาลเพื่อนำเสนอบริการ

ภาคเอกชน เช่น ฟินเทค, ลอจิสติกส์, LegalTech หรือซอฟต์แวร์บริหารงานบุคคล สามารถเรียกใช้ OpenGov‑Vector เพื่อผนวกข้อมูลภาครัฐเข้าในผลิตภัณฑ์ของตน เช่น ตรวจสอบสิทธิ์สวัสดิการ, คำนวณภาษีตามกฎล่าสุด, หรือแนะนำการปฏิบัติตามกฎหมาย

- ประโยชน์ทางธุรกิจ: ลดความเสี่ยงด้านข้อกฎหมายของลูกค้า, เพิ่มความแม่นยำของบริการ, ลดคำร้องเรียนและต้นทุนฝ่ายสนับสนุน

- ตัวอย่างเชิงปริมาณ (จำลอง): ผู้ให้บริการ "BenefitsChecker" นำ OpenGov‑Vector มาใช้ ตรวจพบว่าอัตราความถูกต้องของการคำนวณสิทธิ์เพิ่มจาก 78% เป็น 96% และจำนวนตั๋วบริการลูกค้าลดลง 40% ภายในไตรมาสแรก

กรณีศึกษาจำลอง (Mock Case Studies)

ต่อไปนี้เป็นกรณีศึกษาจำลองที่แสดงกระบวนการใช้งานและผลลัพธ์เชิงปริมาณ เพื่อให้เห็นภาพการเปลี่ยนแปลงก่อนและหลังการใช้งาน OpenGov‑Vector

กรณีศึกษา A — เมือง X: ระบบตอบคำถามสาธารณะ (Pilot 3 เดือน)

- สถานการณ์ก่อนใช้: ระบบตอบคำถามอัตโนมัติเดิมให้คำตอบโดยไม่แนบแหล่งที่มา มีอัตราความคลาดเคลื่อน ~28% อัตราการแก้ไขโดยเจ้าหน้าที่ 35% ของคำตอบทั้งหมด คะแนนความพึงพอใจของผู้ใช้เฉลี่ย 3.4/5

- การดำเนินการ: เมือง X ผนวก OpenGov‑Vector เพื่อให้ LLM ดึงเอกสารประกาศ ระเบียบ และคำชี้แจงจากหน่วยงานที่เกี่ยวข้อง พร้อมแนบ URL และวันที่ประกาศในทุกคำตอบที่อ้างเอกสาร

- ผลลัพธ์หลัง 3 เดือน (จำลอง): อัตราความคลาดเคลื่อนลดเหลือ 4% (ลด 86%), อัตราการแก้ไขโดยเจ้าหน้าที่ลดจาก 35% เหลือ 7%, คะแนนความพึงพอใจเพิ่มเป็น 4.5/5, จำนวนคำถามที่ต้องส่งต่อไปยังเจ้าหน้าที่ลดลง 60%

กรณีศึกษา B — หน่วยงานกลาง: เครื่องมือสืบค้นข้อกฎหมายสำหรับนักนโยบาย

- สถานการณ์ก่อนใช้: นักวิเคราะห์ต้องค้นเอกสารด้วยตนเอง ใช้เวลาเฉลี่ย 7 ชั่วโมงต่อกรณี และพบเอกสารที่เกี่ยวข้องเพียง ~55% ของความต้องการ

- การดำเนินการ: นำ OpenGov‑Vector มาใช้ในการจัดดัชนีเอกสารทั้งหมดตามเวลามีผลบังคับใช้และประเภทเอกสาร เปิดฟังก์ชันค้นหาเชิงบริบทให้ LLM สรุปผลและอ้างอิงย่อหน้าต้นฉบับ

- ผลลัพธ์หลังใช้งาน (จำลอง): เวลาที่ใช้ลดเหลือ 30–45 นาทีต่อกรณี Precision เพิ่มเป็น 93% และความพึงพอใจของนักวิเคราะห์เพิ่มขึ้นอย่างมีนัยสำคัญ

เปรียบเทียบเชิงปริมาณ: ก่อน vs หลังใช้ OpenGov‑Vector (สรุป)

- อัตราความคลาดเคลื่อนของคำตอบ: ลดจาก 28% → 4% (ลด ~86%)

- Precision ของผลการค้นหาเอกสาร: เพิ่มจาก 55% → 93%

- เวลาเฉลี่ยในการสืบค้น/ตอบคำถาม: ลดจาก 6–8 ชั่วโมง → 30–45 นาที (สำหรับงานวิเคราะห์) และ 18 วินาที → 6 วินาที (สำหรับแชทบอต)

- อัตราการแก้ไขโดยเจ้าหน้าที่/ส่งต่อ: ลดจาก 35% → 7%

- ความพึงพอใจของผู้ใช้ (mock): เพิ่มจาก 3.4/5 → 4.5/5

สรุปแล้ว OpenGov‑Vector ช่วยยกระดับความน่าเชื่อถือของระบบที่พึ่งพา LLM โดยการจัดหาแหล่งข้อมูลเชิงบริบทแบบเรียลไทม์และการแท็กแหล่งที่มา ทำให้ทั้งหน่วยงานภาครัฐและผู้ให้บริการภายนอกสามารถลดความคลาดเคลื่อน เพิ่มความโปร่งใส และปรับปรุงประสิทธิภาพการให้บริการได้อย่างเป็นรูปธรรม

ความปลอดภัย การคุ้มครองข้อมูล และการกำกับดูแล

ความปลอดภัย การคุ้มครองข้อมูล และการกำกับดูแล

การเปิดให้บริการ OpenGov‑Vector แก่โมเดลภาษา (LLM) เพื่อเรียกใช้ข้อมูลเชิงบริบทแบบเรียลไทม์ จำเป็นต้องมีกลไกด้านความปลอดภัยและการกำกับดูแลที่เข้มแข็งตั้งแต่ชั้นเครือข่ายไปจนถึงระดับข้อมูลและการใช้งานของผู้ใช้ ระบบต้องปกป้องทั้งการส่งข้อมูล (in transit) และการจัดเก็บ (at rest) พร้อมกับการควบคุมการเข้าถึงเชิงบทบาท (role‑based) และเชิงบริบท (attribute‑based) เพื่อให้มั่นใจว่าเฉพาะผู้มีสิทธิที่เหมาะสมเท่านั้นที่สามารถดึงหรือดูเมตาดาต้าที่บ่งชี้แหล่งที่มาได้

มาตรการรักษาความปลอดภัยของ API และการจัดการสิทธิการเข้าถึง — ควรนำแนวทางปฏิบัติมาตรฐานมาใช้ เช่น การพิสูจน์ตัวตนด้วย OAuth 2.0 / OpenID Connect, การออกโทเค็นแบบ JWT ที่มีอายุจำกัด, การใช้ mutual TLS (mTLS) สำหรับการเชื่อมต่อระหว่างบริการ, และการจัดเก็บกุญแจใน Hardware Security Module (HSM) หรือบริการจัดการคีย์ที่ได้รับการรับรอง นอกจากนี้ต้องมี least privilege และนโยบาย RBAC/ABAC ที่ชัดเจน การจำกัดอัตราการเรียก (rate limiting), การตรวจจับพฤติกรรมผิดปกติ (anomaly detection), และการตั้งค่า Web Application Firewall (WAF) ช่วยลดความเสี่ยงจากการโจมตีแบบ automated และการโจมตีช่องโหว่ API

การกรองและมาร์กข้อมูลที่เป็นความลับหรือข้อมูลส่วนบุคคล — ข้อมูลทุกชิ้นที่ถูกดึงผ่าน OpenGov‑Vector ต้องผ่านกระบวนการจัดประเภท (data classification) และติดแท็ก (tagging) เช่น PUBLIC, INTERNAL, CONFIDENTIAL, PERSONAL_DATA ก่อนจะถูกจัดทำเป็นเวกเตอร์ การติดแท็กนี้ต้องสอดรับกับนโยบายการเข้าถึงแบบจุดต่อจุด (contextual access control) โดยตัวอย่างการปฏิบัติที่ควรมี เช่น การ redaction/obfuscation ของฟิลด์ที่เป็นข้อมูลส่วนบุคคล (เช่น หมายเลขบัตร, ข้อมูลประจำตัว) ก่อนจัดทำ embedding, การเลือกให้ระบบส่งเพียงเมตาดาต้าเชิงอ้างอิง (source tag) แทนการส่งข้อมูลเต็มรูปแบบ และการใช้เทคนิค pseudonymization หรือ differential privacy เมื่อจำเป็น เพื่อลดโอกาสที่ LLM จะคืนข้อมูลส่วนบุคคลแบบ verbatim

การทำ logging และ audit trail — การบันทึกเหตุการณ์ต้องละเอียดและไม่เปลี่ยนแปลงได้ (immutable), บันทึกทั้งผู้เรียก (user/service identity), โทเค็น, คำถามที่ส่ง, ผลลัพธ์ที่ส่งกลับ (หรือ hash ของผลลัพธ์เพื่อรักษาความลับ), เวลา, และแหล่งที่มาของเวกเตอร์ การส่ง logs ไปยังระบบ SIEM ที่เข้ารหัส พร้อมการตั้งค่า retention policy ที่สอดคล้องกับกฎหมาย จะช่วยให้ตรวจสอบเหตุการณ์ย้อนหลังได้อย่างรวดเร็ว ควรกำหนดเกณฑ์การแจ้งเตือนอัตโนมัติ เช่น การเรียกข้อมูลความลับผิดปกติหรือการเรียกจากไอพีที่ไม่คุ้นเคย และต้องมีการเข้ารหัส log ทั้งขณะส่งและเมื่อจัดเก็บ รวมถึงกลไกตรวจสอบความสมบูรณ์ของ log (log integrity) เพื่อป้องกันการแก้ไข

การปฏิบัติตามกฎหมายคุ้มครองข้อมูล (PDPA) และมาตรฐานสากล — ระบบต้องสอดคล้องกับพระราชบัญญัติคุ้มครองข้อมูลส่วนบุคคลของไทย (PDPA) โดยมีการจัดทำ Data Protection Impact Assessment (DPIA) สำหรับการเปิดเผยข้อมูลเชิงบริบทผ่าน LLM, การกำหนดหน่วยงานคุ้มกันข้อมูล (Data Protection Officer) และการบริหารจัดการความยินยอม (consent management) สำหรับข้อมูลที่ต้องได้รับความยินยอมก่อนใช้งาน ควรอ้างอิงมาตรฐานสากล เช่น ISO 27001 สำหรับระบบบริหารความมั่นคงสารสนเทศ, SOC 2 สำหรับการรับรองการควบคุมภายใน และ NIST SP 800‑53 หรือ OWASP API Security Guidelines สำหรับแนวทางปฏิบัติทางเทคนิค

- นโยบายการกำกับดูแลและการทดสอบเชิงรุก: ดำเนิน penetration testing, red‑team exercises, และ fuzz testing สำหรับ API และโมดูลแปลงข้อมูลเป็นเวกเตอร์อย่างสม่ำเสมอ (อย่างน้อยปีละหนึ่งครั้งหรือเมื่อมีการเปลี่ยนแปลงสำคัญ)

- การตรวจสอบโดยอิสระ: จ้างผู้ตรวจสอบภายนอกเพื่อทบทวนนโยบายความเป็นส่วนตัว การปฏิบัติตาม PDPA และการตั้งค่าความมั่นคงของระบบ เช่น การตรวจสอบตามข้อกำหนด ISO 27001 / SOC 2 และเผยแพร่รายงานการตรวจสอบที่สรุปผลการประเมินความเสี่ยงและการแก้ไข

- การทดสอบการรั่วไหลข้อมูลจากโมเดล: ใช้ Python‑based data exfiltration tests, prompt injection simulations และการวิเคราะห์ output ของ LLM เพื่อยืนยันว่าไม่มีการเปิดเผยข้อมูลที่ติดแท็กเป็นความลับหรือเป็นข้อมูลส่วนบุคคล

- การตรวจวัดและการรายงาน: กำหนด KPI ด้านความปลอดภัย เช่น จำนวนเหตุการณ์ความปลอดภัยต่อเดือน, เวลาตอบสนองต่อเหตุการณ์ (MTTR), และเปอร์เซ็นต์การเรียกข้อมูลที่สำเร็จโดยผ่านการตรวจสิทธิอย่างถูกต้อง และรายงานต่อหน่วยงานกำกับดูแลเมื่อเกิดเหตุร้ายแรงตาม PDPA

สรุปคือ การให้ LLM เข้าถึง OpenGov‑Vector อย่างปลอดภัยต้องอาศัยการผสมผสานของมาตรการทางเทคนิค นโยบายการปฏิบัติ และการกำกับดูแลที่โปร่งใส การประเมินความเสี่ยงเชิงสถาปัตยกรรมอย่างต่อเนื่อง ร่วมกับการตรวจสอบจากภายนอกและการรายงานตามกฎหมาย จะช่วยลดความคลาดเคลื่อนของข้อมูลภาครัฐ พร้อมปกป้องสิทธิส่วนบุคคลของประชาชนและความลับของหน่วยงานรัฐ

ผลกระทบ เชิงนโยบาย ความท้าทาย และแผนการขยายผล

ผลกระทบเชิงนโยบายและผลประโยชน์ต่อบริการพลเมือง

การเปิด OpenGov‑Vector เป็น API เวกเตอร์ข้อมูลภาครัฐที่ให้ LLM ดึงข้อมูลเชิงบริบทแบบเรียลไทม์พร้อมแท็กแหล่งที่มา จะส่งผลเชิงบวกต่อความน่าเชื่อถือของข้อมูลภาครัฐและประสิทธิภาพการให้บริการสาธารณะอย่างมีนัยสำคัญ โดยเฉพาะในมิติของ ความโปร่งใส และ การตอบสนองแบบเรียลไทม์ ตัวอย่างเช่น หากระบบสามารถแนบ metadata ของแหล่งข้อมูลและเวลาที่อัปเดตได้ การตอบคำถามจากแชตบอตของหน่วยงานจะมีความแม่นยำขึ้นและลดความคลาดเคลื่อน (hallucination) ของโมเดลได้อย่างมีนัยสำคัญ — การประเมินเชิงต้นแบบคาดว่าอัตราความคลาดเคลื่อนอาจลดลงได้ในช่วง 30–50% ในบริบทของการให้ข้อมูลประชาชนเรื่องนโยบายหรือบริการพื้นฐาน

ในเชิงเศรษฐศาสตร์การใช้ API เวกเตอร์สามารถช่วยลดต้นทุนการให้บริการดิจิทัล ผ่านการรวมข้อมูลแบบ reuse (ลดการดึงข้อมูลซ้ำซ้อน) และการเพิ่มความสามารถในการอัตโนมัติของงานตอบคำถามและการช่วยเหลือประชาชน โดยเฉพาะหน่วยงานที่มีการตอบคำถามเชิงข้อมูลซ้ำมาก จะเห็นการลดเวลาเฉลี่ยต่อเคสและค่าใช้จ่ายบุคลากร ตัวชี้วัดที่ควรติดตามได้แก่ เวลาตอบกลับเฉลี่ย (mean response time), อัตราการแก้ปัญหาได้ตั้งแต่ครั้งแรก (first-contact resolution) และดัชนีความพึงพอใจของผู้ใช้

ความเสี่ยงเชิงนโยบายและทางเทคนิคที่ต้องจัดการ

แม้จะมีประโยชน์มากมาย แต่ OpenGov‑Vector ก็นำมาซึ่งความเสี่ยงทั้งเชิงนโยบายและเชิงเทคนิคที่ต้องมีมาตรการควบคุม ได้แก่:

- ความเป็นกลางและอคติของข้อมูล — ข้อมูลภาครัฐอาจสะท้อนนโยบายหรือมุมมองเชิงสถาบัน หากไม่มีมาตรการตรวจสอบอาจทำให้โมเดลแสดงคำตอบที่ไม่เป็นกลางได้ จำเป็นต้องมีกระบวนการตรวจสอบเนื้อหาและการบันทึก provenance อย่างชัดเจน

- ความเป็นส่วนบุคคลและความปลอดภัย — เวกเตอร์ที่สร้างจากข้อมูลเชิงละเอียดอาจเปิดเผยข้อมูลส่วนบุคคลหรือข้อมูลที่เป็นความลับ จำเป็นต้องออกแบบนโยบายการเข้าถึง (access control), การเข้ารหัส, และเทคนิคเช่น differential privacy

- การบูรณาการข้อมูลและการควบคุมคุณภาพ — ข้อมูลจากหลายหน่วยงานมีรูปแบบและมาตรฐานต่างกัน การทำ normalization, metadata harmonization และการจัดการเวอร์ชันเป็นสิ่งจำเป็น มิฉะนั้นคุณภาพของเวกเตอร์จะลดลงและนำไปสู่การตีความผิดพลาด

- ความเสี่ยงจากการถูกโจมตีหรือใช้ในทางที่ผิด — API สาธารณะอาจถูกโจมตีด้วยการขอข้อมูลมวลหรือใช้เพื่อฝังข้อมูลบิดเบือน จึงควรกำหนด SLA, rate limiting, และระบบตรวจจับพฤติกรรมผิดปกติ

- ค่าใช้จ่ายในการดูแลรักษาและความยั่งยืน — การคงสถานะการอัปเดตแบบเรียลไทม์และการเก็บเวกเตอร์ในสเกลประเทศมีค่าใช้จ่ายสูง ต้องวางแผนงบประมาณระยะยาวและโมเดลการร่วมทุน เช่น เปิดให้บริการแบบ tiered API หรือตั้งกองทุนบำรุงรักษา

แผนการขยายผล (Roadmap): pilot → ขยาย → มาตรฐานเปิด และ community engagement

เพื่อให้โครงการมีความยืนยาวและลดความเสี่ยง ควรดำเนินการตามเฟสต่อไปนี้อย่างเป็นระบบ:

- เฟสทดลอง (Pilot, 6–12 เดือน) — ระบุโดเมนจำเพาะ (เช่น ข้อมูลสาธารณสุข การขนส่งสาธารณะ หรือบริการภาษี) เลือกหน่วยงานนำร่อง 2–4 แห่ง ตั้ง KPI เช่น อัตราความแม่นยำการอ้างอิงแหล่งที่มา, ลดเวลาให้บริการ 20% ทดลองกลไกการพิสูจน์แหล่งที่มาและระบบการยืนยันสิทธิ์

- เฟสขยาย (Scale-up, 12–24 เดือน) — ขยายการเชื่อมต่อไปยังหน่วยงานมากขึ้น ปรับโครงสร้างพื้นฐานรองรับปริมาณคำขอที่เพิ่มขึ้น และพัฒนาชุดเครื่องมือ (SDK/API clients) สำหรับการรวมเข้ากับระบบเดิม จัดทำคู่มือปฏิบัติ (playbook) สำหรับการประเมินความเสี่ยงและการกำกับดูแลข้อมูล

- เฟสมาตรฐานเปิด (Standardization, 18–36 เดือน) — ร่วมกับภาคอุตสาหกรรม สถาบันวิชาการ และหน่วยงานระหว่างประเทศ กำหนดมาตรฐานเปิดสำหรับรูปแบบเวกเตอร์, metadata provenance, schema ของแท็กแหล่งที่มา และหลักปฏิบัติด้านความปลอดภัย เช่น การยึดหลัก interoperability และ machine-readable provenance ตามมาตรฐานสากล

- เฟสการมีส่วนร่วมของชุมชน (Community Engagement) — เปิดโค้ดตัวอย่าง, จัด hackathon และสนับสนุนชุมชนนักพัฒนา/นักวิจัยให้ทดสอบและตรวจสอบ (crowd-audit) ระบบ สร้างช่องทางรับฟังความคิดเห็นจากภาคประชาสังคมและผู้ใช้จริงเพื่อปรับปรุงความเป็นกลางและความโปร่งใส

แต่ละเฟสควรมีกลไกการประเมินความเสี่ยงและการรายงานผลต่อสาธารณะ (transparency report) โดยกำหนดตัวชี้วัดเชิงผลลัพธ์ เช่น อัตราการอ้างอิงแหล่งที่มาถูกต้อง, การลดคำร้องเรียนเกี่ยวกับข้อมูลผิดพลาด และดัชนีความเชื่อมั่นของประชาชน เป้าหมายเชิงนโยบายคือการสร้างสมดุลระหว่าง การเปิดใช้งานนวัตกรรม กับ การคุ้มครองสิทธิและความปลอดภัยสาธารณะ

สรุปแล้ว OpenGov‑Vector มีศักยภาพสร้างประโยชน์เชิงสาธารณะอย่างเด่นชัด แต่ความสำเร็จขึ้นกับการออกแบบกรอบกำกับดูแลที่เข้มแข็ง การลงทุนในโครงสร้างพื้นฐานและทักษะ และการมีส่วนร่วมอย่างต่อเนื่องจากชุมชนผู้พัฒนาและผู้มีส่วนได้เสีย หากเดินตาม roadmap ที่เป็นขั้นตอนและโปร่งใส โครงการสามารถเป็นรากฐานสำคัญของบริการดิจิทัลภาครัฐที่เชื่อถือได้และยั่งยืน

บทสรุป

OpenGov‑Vector เป็น API เวกเตอร์ข้อมูลภาครัฐที่ออกแบบมาเพื่อเชื่อมต่อ LLM กับฐานข้อมูลของรัฐโดยตรง พร้อมการแท็กแหล่งที่มาและบริบทแบบเรียลไทม์ ทำให้การตอบคำถามจากโมเดลมีความชัดเจน ตรวจสอบย้อนกลับได้ และลดความคลาดเคลื่อนของข้อเท็จจริง (hallucination) ในการให้บริการสาธารณะ ตัวอย่างการใช้งาน ได้แก่ การให้ข้อมูลสิทธิสวัสดิการ สถานะใบอนุญาต หรือการตอบคำถามเชิงนโยบายโดยอ้างอิงเอกสารทางราชการโดยตรง ซึ่งโครงการนำร่องในหน่วยงานบางแห่งรายงานการลดข้อผิดพลาดเชิงข้อมูลอย่างมีนัยสำคัญ (ประมาณการลดข้อผิดพลาดในช่วงนำร่องหลายโครงการ) ทั้งนี้การระบุแหล่งที่มาแบบอัตโนมัติและการอัปเดตแบบเรียลไทม์เป็นปัจจัยสำคัญที่เพิ่มความโปร่งใสและสร้างความเชื่อมั่นต่อประชาชน

ความสำเร็จของ OpenGov‑Vector ขึ้นกับการบริหารจัดการข้อมูลที่เข้มแข็ง การคุ้มครองสิทธิส่วนบุคคล และกรอบการกำกับดูแลที่ชัดเจนควบคู่ไปกับการมีส่วนร่วมจากสาธารณะและชุมชนนักพัฒนา มาตรฐานการให้สิทธิ์เข้าถึง (access control) การตรวจสอบแหล่งที่มา (provenance auditing) และกระบวนการประเมินผลผลกระทบด้านความเป็นส่วนตัวเป็นสิ่งจำเป็นเพื่อหลีกเลี่ยงความเสี่ยงเช่นการรั่วไหลของข้อมูล ความลำเอียงของโมเดล หรือการนำข้อมูลที่ผิดพลาดมาใช้ในเชิงนโยบาย ในอนาคต หากสร้างระบบกำกับและช่องทางมีส่วนร่วมที่รัดกุม OpenGov‑Vector สามารถยกระดับการบริการสาธารณะ เพิ่มประสิทธิภาพการตอบข้อซักถามของประชาชน และเป็นพื้นฐานสำหรับนวัตกรรมเชิงข้อมูลภาครัฐที่เชื่อถือได้ แต่ความก้าวหน้าดังกล่าวต้องการการร่วมมือข้ามภาคส่วนอย่างต่อเนื่อง ทั้งจากหน่วยงานรัฐ นักพัฒนา นักวิชาการ และประชาชนเพื่อลดความเสี่ยงและเพิ่มผลประโยชน์สาธารณะอย่างยั่งยืน