ในยุคดิจิทัลที่ข้อมูลและอัลกอริทึมมีบทบาทสำคัญต่อการตัดสินใจขององค์กร Machine Learning (ML) กำลังเปลี่ยนโฉมหน้าการจ้างงานจากกระบวนการที่อาศัยมนุษย์เพียงอย่างเดียวไปสู่ระบบอัตโนมัติที่แม่นยำและปรับขนาดได้ โดยตั้งแต่การคัดกรองเรซูเม่ การจัดลำดับผู้สมัคร จนถึงการทำนายความสำเร็จของพนักงาน ML ช่วยให้องค์กรลดเวลาการจ้างและเพิ่มคุณภาพการคัดเลือกในหลายกรณี นอกจากนี้ ความสามารถในการวิเคราะห์ข้อมูลเชิงลึกยังเปิดโอกาสให้การวางแผนกำลังคนเป็นไปอย่างมีประสิทธิภาพมากขึ้นและเชื่อมโยงผลลัพธ์การจ้างงานเข้ากับตัวชี้วัดทางธุรกิจได้อย่างตรงจุด

บทความนี้จะวิเคราะห์การประยุกต์ใช้ Machine Learning ในการสรรหาและคัดเลือกบุคลากรอย่างรอบด้าน—ครอบคลุมข้อดีเชิงธุรกิจและตัวชี้วัดที่ควรติดตาม (เช่น time‑to‑hire, quality‑of‑hire, retention และ cost‑per‑hire) พร้อมสำรวจปัญหาเรื่องอคติของข้อมูล กรอบกฎหมายและความเป็นส่วนตัว ตัวอย่างกรณีศึกษาจากภาคอุตสาหกรรมต่างๆ รวมถึง roadmap ขั้นตอนปฏิบัติสำหรับองค์กรที่ต้องการนำ ML มาใช้อย่างรับผิดชอบและได้ผลจริง เพื่อให้ผู้อ่านสามารถประเมินศักยภาพและความเสี่ยงก่อนตัดสินใจนำเทคโนโลยีนี้มาใช้ในบริบทของตนเอง

บทนำ: ทำไม Machine Learning ถึงสำคัญต่อการจ้างงานในยุคดิจิทัล

บทนำ: ทำไม Machine Learning ถึงสำคัญต่อการจ้างงานในยุคดิจิทัล

การเปลี่ยนแปลงทางดิจิทัลได้ผลักดันให้ภาคทรัพยากรบุคคล (HR) หันมาใช้เทคโนโลยีเพื่อเพิ่มประสิทธิภาพและสร้างความได้เปรียบทางการแข่งขัน โดยเฉพาะอย่างยิ่ง Machine Learning (ML) ซึ่งทำหน้าที่เป็นเครื่องมือสำคัญในการประมวลผลข้อมูลขนาดใหญ่ วิเคราะห์รูปแบบพฤติกรรมผู้สมัคร และช่วยตัดสินใจเชิงสรรหาอย่างมีเหตุผลมากขึ้น ในระดับธุรกิจ การนำ ML มาใช้ในกระบวนการจ้างงานไม่ได้เป็นเพียงเทรนด์ทางเทคโนโลยีเท่านั้น แต่เป็นการตอบโจทย์ด้านต้นทุน เวลา และคุณภาพทรัพยากรบุคคลที่องค์กรยุคใหม่ต้องการ

จากการสำรวจระดับโลกและภูมิภาค พบแนวโน้มการนำ AI/ML เข้ามาใช้ใน HR อย่างต่อเนื่อง: โดยประมาณ 40–55% ขององค์กรในกลุ่มตัวอย่างระบุว่าได้ทดลองหรือเริ่มนำระบบที่ขับเคลื่อนด้วย AI/ML มาใช้ในกระบวนการสรรหาในช่วง 2–3 ปีที่ผ่านมา ส่วนในภูมิภาคเอเชียแปซิฟิก อัตราการยอมรับมีการเติบโตเร็วกว่าค่าเฉลี่ยโลก โดยองค์กรส่วนหนึ่งรายงานผลเบื้องต้นที่ชัดเจน ได้แก่ การลดเวลาในการจ้างงาน (time-to-hire) เฉลี่ยประมาณ 25–40% และการลดต้นทุนต่อการจ้างงาน (cost-per-hire) ประมาณ 15–30% เมื่อเทียบกับกระบวนการแบบดั้งเดิม

เหตุผลเชิงธุรกิจที่ทำให้ ML มีความสำคัญต่อการจ้างงานสามารถสรุปได้เป็นหัวข้อหลัก เช่น ความเร็วในการสรรหา ที่ระบบสามารถกรองเรซูเม่และจัดลำดับผู้สมัครได้อย่างอัตโนมัติ, คุณภาพการคัดเลือก ที่ช่วยจับคู่ทักษะและพฤติกรรมกับความต้องการงานได้แม่นยำขึ้น, และ การลดต้นทุน ทั้งด้านทรัพยากรบุคคลและเวลาในการสัมภาษณ์ นอกจากนี้ ML ยังสามารถปรับปรุงประสบการณ์ผู้สมัคร (candidate experience) โดยการสื่อสารอัตโนมัติและแนะนำขั้นตอนที่เหมาะสม ทำให้องค์กรสามารถรักษาภาพลักษณ์และอัตราการตอบรับตำแหน่งงานได้ดีขึ้น

บทความนี้จะครอบคลุมประเด็นสำคัญที่ผู้บริหารและผู้ปฏิบัติงาน HR ควรทราบ เพื่อพิจารณาและวางกลยุทธ์การนำ ML มาใช้ในการจ้างงาน ประเด็นที่จะนำเสนอได้แก่:

- เทคนิคและเครื่องมือ — โมเดล ML ที่นิยมในงานสรรหา การประมวลผลภาษาธรรมชาติ (NLP) สำหรับการวิเคราะห์เรซูเม่ และระบบคัดกรองอัตโนมัติ

- ผลลัพธ์เชิงปฏิบัติ — ตย. การใช้งานจริง ตัวชี้วัดประสิทธิภาพ และการวัดผลการลงทุน (ROI)

- จริยธรรมและความยุติธรรม — ความเสี่ยงเรื่องอคติ (bias) ในโมเดล การตรวจสอบความโปร่งใส และแนวทางลดความไม่เป็นธรรมในการคัดเลือก

- ข้อกฎหมายและการกำกับดูแล — ข้อกำหนดด้านความเป็นส่วนตัวของข้อมูล การปฏิบัติตามกฎหมายแรงงาน และการทำนโยบายภายในองค์กร

- แนวทางปฏิบัติที่ดีที่สุด — ขั้นตอนการออกแบบการนำไปใช้งาน การประเมินความเสี่ยง และกลยุทธ์การปรับใช้แบบยั่งยืน

โดยสรุป แม้ ML จะไม่ใช่คำตอบเดียวสำหรับทุกปัญหาด้านการจ้างงาน แต่เมื่อผสานกับกระบวนการบริหารทรัพยากรบุคคลอย่างรอบคอบ มันสามารถเป็นตัวเร่งให้การสรรหามีประสิทธิภาพมากขึ้น ลดต้นทุน และยกระดับคุณภาพของการตัดสินใจเชิงบุคลากร บทความต่อไปจะลงรายละเอียดทั้งในเชิงเทคนิค การนำไปใช้จริง รวมถึงข้อควรระวังด้านจริยธรรมและกฎหมาย เพื่อช่วยให้องค์กรตัดสินใจอย่างรอบคอบก่อนลงทุนด้านนี้

โครงสร้างทางเทคนิคของระบบ ML ในการสรรหา

ภาพรวมโครงสร้างทางเทคนิคของระบบ ML สำหรับการสรรหา

ระบบ Machine Learning (ML) ที่ใช้ในงานสรรหาบุคลากรมีความซับซ้อนและประกอบด้วยหลายชั้นงาน ตั้งแต่การรวบรวมข้อมูล (data ingestion) การประมวลผลและสร้างคุณลักษณะ (feature engineering) ไปจนถึงการฝึกและประเมินโมเดล รวมถึงการนำไปใช้งานจริงและการตรวจสอบผลลัพธ์อย่างต่อเนื่อง โดยเป้าหมายหลักคือการเพิ่มความแม่นยำของการคัดกรองผู้สมัคร ลดเวลาในการจ้างงาน และลดอคติที่ไม่พึงประสงค์ในกระบวนการตัดสินใจ

แหล่งข้อมูลและการเตรียมข้อมูล (Data Pipeline, ETL, Data Labeling)

ระบบสรรหาทั่วไปจะดึงข้อมูลจากหลายแหล่ง ได้แก่ เรซูเม่ (PDF/Word/text), โปรไฟล์บน LinkedIn หรือแพลตฟอร์มสมัครงาน, ผลการทดสอบทักษะ (coding tests, psychometric assessments), บันทึกการสัมภาษณ์ (audio/transcript), และข้อมูลเชิงพฤติกรรมจากระบบ ATS (Applicant Tracking System) ตัวอย่างข้อมูลและการเตรียมข้อมูลมีดังนี้:

- Data ingestion & ETL: การดึงข้อมูลแบบ batch หรือ streaming โดยใช้เครื่องมือเช่น Apache Kafka, Apache NiFi, Google Pub/Sub แล้วเก็บลงที่เก็บข้อมูล (S3, GCS, Snowflake, BigQuery) จากนั้นทำการแปลงข้อมูล (ETL) ด้วย Apache Spark, dbt หรือ Airflow เพื่อให้ได้ schema ที่สอดคล้อง

- การแปลงและทำความสะอาด: การดึง text จาก PDF/Word (pdfminer, Apache Tika), ลบข้อมูลส่วนบุคคลที่ไม่จำเป็น, กำจัดข้อมูลซ้ำ และการมาตรฐานฟอร์แมตวันที่/สกิล

- Data labeling: การติดป้ายกำกับ (label) สำหรับงาน supervised อาจใช้วิธี manual labeling ผ่านแพลตฟอร์มเช่น Labelbox หรือใช้วิธี weak supervision (Snorkel) และ active learning เพื่อลดต้นทุนการติดป้าย ตัวอย่างป้าย: ตอบรับ/ปฏิเสธ, ระดับความเหมาะสม (high/medium/low)

- ความเป็นส่วนตัวและการกำกับดูแลข้อมูล: การทำ PII masking, encryption, การจัดการสิทธิ์เข้าถึง และการรักษาความสอดคล้องกับกฎหมาย เช่น PDPA/GDPR

การสร้างคุณลักษณะ (Feature Engineering)

Feature engineering ในการสรรหาแบ่งเป็นข้อมูลเชิงโครงสร้าง (structured) และไม่โครงสร้าง (unstructured) ดังนี้:

- NLP สำหรับอ่านเรซูเม่และโปรไฟล์: การสกัดทักษะ (skill extraction), ตำแหน่งงาน, ระยะเวลาทำงาน, การใช้ Named Entity Recognition (spaCy, Hugging Face Transformers) และการสร้าง embeddings (SBERT, Universal Sentence Encoder) เพื่อจับความหมายของประโยค

- การวิเคราะห์เสียงและข้อความจากสัมภาษณ์: แปลงเสียงเป็นข้อความด้วย ASR เช่น Whisper, wav2vec2 หรือ Kaldi แล้วทำ sentiment analysis, prosody feature extraction (pitch, tempo) เพื่อวัดระดับความมั่นใจ/การสื่อสาร

- ฟีเจอร์จากการทดสอบ: คะแนนเชิงปริมาณจาก coding platform, เวลาใช้ในการทำโจทย์, สถิติการทำข้อผิดพลาด และฟีเจอร์พฤติกรรมจากระบบทดสอบ

- การสร้าง embedding และตัวแทนข้อมูล: การใช้ sentence/skill embeddings เพื่อค้นหา similarity ระหว่างตำแหน่งงานกับผู้สมัคร และการใช้ clustering เพื่อจัดกลุ่มผู้สมัคร

ประเภทโมเดลที่นิยมใช้

โมเดลที่ใช้ในระบบสรรหามักแบ่งตามวัตถุประสงค์ เช่น การจัดอันดับผู้สมัคร, การจำแนกผลลัพธ์ หรือการประมวลภาษา ดังนี้:

- NLP models: BERT, RoBERTa, DistilBERT, SBERT สำหรับการทำ resume parsing, semantic search, intent detection และ named entity recognition

- Embeddings & semantic search: Sentence Transformers, FAISS, ElasticSearch vector search สำหรับการค้นหาและการจับคู่ทักษะ

- Classification models: Logistic Regression, Random Forest, XGBoost, LightGBM, และ feed-forward neural networks สำหรับการคาดการณ์ว่าผู้สมัครจะถูกเสนอเข้าทำงานหรือไม่ (hire/no-hire)

- Ranking models: LambdaMART, RankNet, ListNet หรือ neural ranking models (DSSM, ColBERT) สำหรับการเรียงลำดับผู้สมัครที่เหมาะสมกับตำแหน่ง โดยใช้ loss แบบ pointwise/pairwise/listwise

กระบวนการฝึก ทดสอบ และการประเมินผล

การฝึกและประเมินโมเดลต้องคำนึงถึงความน่าเชื่อถือและความเป็นธรรมของโมเดล:

- การแบ่งชุดข้อมูล: ใช้ train/validation/test split, k-fold cross-validation (หรือ time-based split สำหรับข้อมูลที่มีลำดับเวลา) และ holdout set สำหรับประเมินสุดท้าย

- การปรับไฮเปอร์พารามิเตอร์: ใช้ grid search, random search หรือ Bayesian optimization (Optuna) เพื่อหาค่าที่เหมาะสม

- มาตรการประเมินผล:

- สำหรับ classification: precision, recall, F1-score, ROC AUC

- สำหรับ ranking: NDCG@k, MAP, MRR

- สำหรับ calibration: Brier score, calibration curve และการปรับด้วย Platt scaling หรือ isotonic regression เพื่อให้ความน่าเชื่อถือของคะแนนทำนายสอดคล้องกับความน่าจะเป็นจริง

- การทดสอบแบบ A/B และการทดสอบออนไลน์: ทดสอบโมเดลเวอร์ชันใหม่ในสภาพการใช้งานจริง (canary rollout, A/B test) วัดผล KPI เช่น time-to-hire, offer-acceptance rate เพื่อตัดสินใจนำขึ้น production

- การตรวจสอบและวางมาตรการป้องกัน bias: การรัน fairness metrics (demographic parity, equal opportunity) และใช้เทคนิค mitigation เช่น reweighing, adversarial debiasing หรือ post-processing เพื่อบรรเทาอคติที่พบ

ตัวอย่างเทคนิคและสแต็กเทคโนโลยีที่พบบ่อย

สแต็กเทคโนโลยีที่นำมาใช้ในระบบสรรหา ML มักเป็น combination ของเครื่องมือสำหรับ data engineering, model training, และ deployment ตัวอย่างเช่น:

- Data storage & processing: AWS S3/GCS, Snowflake, BigQuery, Apache Spark

- Data pipeline & orchestration: Apache Airflow, dbt, Kubeflow, TFX

- NLP & embeddings: Hugging Face Transformers, SentenceTransformers, spaCy, FAISS

- Model training frameworks: scikit-learn, XGBoost, LightGBM, PyTorch, TensorFlow

- Audio/ASR tools: Whisper, wav2vec2, Kaldi สำหรับ speech-to-text และ Librosa สำหรับการสกัด audio features

- Deployment & monitoring: Docker, Kubernetes, MLflow, Seldon Core, Prometheus, Grafana สำหรับการติดตาม performance และ drift detection

สรุปเชิงปฏิบัติ

โครงสร้างทางเทคนิคของระบบ ML ในการสรรหาประกอบด้วยการออกแบบ data pipeline ที่เข้มแข็ง การสร้าง features จากแหล่งข้อมูลหลากหลายทั้ง text, audio และ structured assessments การเลือกโมเดลที่เหมาะสมระหว่าง NLP, classification หรือ ranking พร้อมกระบวนการฝึก-ทดสอบที่รัดกุม (cross-validation, A/B testing) และการประเมินด้วย metrics ที่สอดคล้องทั้งด้านความแม่นยำและความเป็นธรรม (precision/recall/AUC, NDCG, calibration) การนำแนวปฏิบัติการตรวจสอบ bias และการใช้สแต็กเทคโนโลยีที่รองรับการสเกลและการตรวจสอบอย่างต่อเนื่องจะช่วยให้ระบบสรรหามีความน่าเชื่อถือ ปรับปรุงได้ และสอดคล้องกับข้อกำหนดด้านจริยธรรมและกฎหมาย

ข้อดีและผลลัพธ์ทางธุรกิจ: KPI, ROI และตัวอย่างกรณีศึกษา

ข้อดีเชิงธุรกิจ: ผลลัพธ์ที่คาดหวังจากการนำ Machine Learning มาใช้

การนำระบบ Machine Learning (ML) เข้ามาช่วยในกระบวนการสรรหาและคัดเลือกบุคลากรให้ผลเชิงธุรกิจที่ชัดเจน ทั้งในด้านเวลา ต้นทุน และคุณภาพของการจ้างงาน โดยองค์กรจำนวนมากรายงานผลลัพธ์เชิงปริมาณที่สามารถวัดได้ เช่น ลด time-to-hire ได้ระหว่าง 20–40% เมื่อเทียบกับกระบวนการเดิม และ ลด cost-per-hire ได้ 20–35% ในขณะเดียวกันยังเห็นการเพิ่มขึ้นของคุณภาพการจ้างงาน (quality-of-hire) และอัตราการคงอยู่ของพนักงาน (retention) ซึ่งมีผลโดยตรงต่อ productivity และค่าใช้จ่ายระยะยาวขององค์กร

ตัวชี้วัดสำคัญ (KPI) สำหรับวัดผล

- Time-to-hire: ระยะเวลาตั้งแต่เปิดรับสมัครจนถึงวันที่พนักงานเริ่มงาน (วัน)

- Cost-per-hire: ค่าใช้จ่ายรวมเฉลี่ยต่อการจ้างหนึ่งตำแหน่ง (รวมค่าโฆษณา ค่าบริการเอเจนซี่ ค่าทรัพยากรสรรหา)

- Quality-of-hire: คะแนนหรือการประเมินผลงานของผู้ถูกจ้างในช่วง 3–12 เดือนแรก (เช่น คะแนนประสิทธิภาพ, 360 feedback)

- Retention: อัตราการอยู่รอดของพนักงานที่ถูกจ้างภายในช่วงเวลาที่กำหนด (เช่น 6 เดือน, 12 เดือน)

การกำหนดเกณฑ์วัดควรชัดเจน เช่น quality-of-hire อาจนิยามเป็นคะแนนเฉลี่ยบนตัวชี้วัดการปฏิบัติงาน 1–100 หรือเป็นอัตราพนักงานที่ผ่าน probation ภายใน 90 วัน

ตัวอย่างผลลัพธ์เชิงตัวเลขและกรณีศึกษา (ประมาณการและตัวอย่างจริง)

จากการสำรวจและกรณีศึกษาขององค์กรในภาคเทคโนโลยีและภาคบริการ พบผลลัพธ์ทั่วไปดังนี้:

- บริษัทเทคโนโลยี (กลางขนาด) — นำระบบ ML มาใช้ในการกรองเรซูเม่และจัดลำดับผู้สมัครอัตโนมัติ: time-to-hire ลดจาก 60 วันเหลือ 39 วัน (-35%), cost-per-hire ลดจาก $7,000 เป็น $4,900 (-30%), quality-of-hire เพิ่มขึ้น 18% ตามคะแนนประเมิน 12 เดือน, และ retention 12 เดือนเพิ่มจาก 70% เป็น 82% (+12 percentage points).

- ธุรกิจให้บริการลูกค้า (call center) — ใช้ ML ในการค้นหาผู้สมัครเชิงรุกและวางตารางสัมภาษณ์อัตโนมัติ: time-to-hire ลด 30–35%, cost-per-hire ลด ~25%, และพบว่า CSAT ที่เกี่ยวข้องกับตัวชี้วัดการจ้างงานเพิ่มขึ้น 5–8% หลังจากปรับปรุงคุณภาพการจับคู่ผู้สมัครกับตำแหน่ง

ตัวอย่างการคำนวณเชิงธุรกิจ (สมมติ): องค์กรจ้าง 200 ตำแหน่งต่อปี หาก ML ลด cost-per-hire ลง $2,100 ต่อคน (จาก $7,000 → $4,900) จะประหยัดได้ $420,000 ต่อปี หากค่าใช้จ่ายระบบ ML รวม implementation และ subscription เท่ากับ $150,000 ต่อปี ROI = (420,000 − 150,000) / 150,000 = 1.8 หรือ 180%

การออกแบบการทดลอง (Pilot และ A/B Testing) เพื่อวัดผลและคำนวณ ROI

การพิสูจน์ผลและคำนวณ ROI ควรเริ่มจากการทำ pilot หรือ A/B testing โดยมีแนวทางสำคัญดังนี้:

- กำหนดเป้าหมายและตัวชี้วัดหลัก — เช่น ลด time-to-hire เป็นตัวชี้วัดหลัก และ cost-per-hire, quality-of-hire, retention เป็น secondary KPIs

- ออกแบบกลุ่มควบคุมและกลุ่มทดลอง — แบ่งผู้สมัครหรือกลุ่มตำแหน่งแบบสุ่ม ให้กลุ่มหนึ่งใช้กระบวนการปัจจุบัน (Control) อีกกลุ่มใช้ ML-enabled process (Treatment)

- ระยะเวลาและขนาดตัวอย่าง — กำหนดระยะเวลาทดสอบให้เพียงพอ (เช่น 3–6 เดือน) และคำนวณขนาดตัวอย่างที่ต้องการเพื่อให้ผลมีนัยสำคัญทางสถิติ (power analysis)

- วัดผลและวิเคราะห์ — เปรียบเทียบค่าเฉลี่ย time-to-hire, cost-per-hire และอัตราการผ่าน probation ระหว่างกลุ่ม โดยใช้ t-test หรือ chi-square test ตามชนิดข้อมูล

- ประเมินความเสี่ยงและความเอนเอียง — ตรวจสอบ bias ในโมเดล (เช่น ความเอนเอียงตามเพศ อายุ หรือวุฒิการศึกษา) และทำการแก้ไขก่อนขยายการใช้งาน

ตัวอย่างการคำนวณ ROI จากผลทดลอง: สมมติกลุ่มทดลองจ้าง 100 ตำแหน่ง ได้ประหยัด cost-per-hire เฉลี่ย $1,800 ต่อคน ผลรวมเป็น $180,000 หากค่าใช้จ่ายโครงการสำหรับช่วงทดสอบอยู่ที่ $50,000 ROI = (180,000 − 50,000) / 50,000 = 2.6 หรือ 260%. หากต้องการรวมผลประโยชน์ระยะยาว ให้คำนวณมูลค่าของการเพิ่ม retention และคุณภาพการจ้างงาน (เช่น ลด turnover ที่มีค่าใช้จ่ายการทดแทนสูง) เข้าไปด้วย

ข้อสรุปเชิงปฏิบัติ

การนำ ML มาช่วยสรรหาให้ผลเชิงบวกที่วัดได้ ทั้งในด้าน time-to-hire, cost-per-hire, quality-of-hire และ retention แต่เพื่อให้การลงทุนคุ้มค่า ควรออกแบบการทดลองอย่างรัดกุม วัด KPI อย่างเป็นระบบ และคำนวณ ROI โดยรวมทั้งประหยัดต้นทุนระยะสั้นและมูลค่าจากการปรับปรุงคุณภาพพนักงานในระยะยาว

ความเสี่ยงด้านความเป็นธรรมและอคติ (Bias) พร้อมกรณีศึกษา

การนำ Machine Learning (ML) มาใช้ในกระบวนการจ้างงานสามารถเพิ่มความเร็วและประสิทธิภาพได้อย่างมาก แต่หากไม่ออกแบบและตรวจสอบอย่างรอบคอบ จะเสี่ยงสร้างหรือขยายความไม่เป็นธรรมในระดับระบบได้ อคติสามารถเกิดได้จากข้อมูลฝึกสอน (training data), การเลือกคุณลักษณะ (feature selection), วิธีการออกแบบอัลกอริทึม และกระบวนการตัดสินใจเชิงมนุษย์ที่ยังแทรกแซงอยู่ ผลลัพธ์ที่ลำเอียงอาจนำไปสู่การปฏิเสธผู้สมัครจากกลุ่มเปราะบาง ลดความหลากหลายของแรงงาน และสร้างความเสี่ยงทางกฎหมายและชื่อเสียงต่อองค์กร

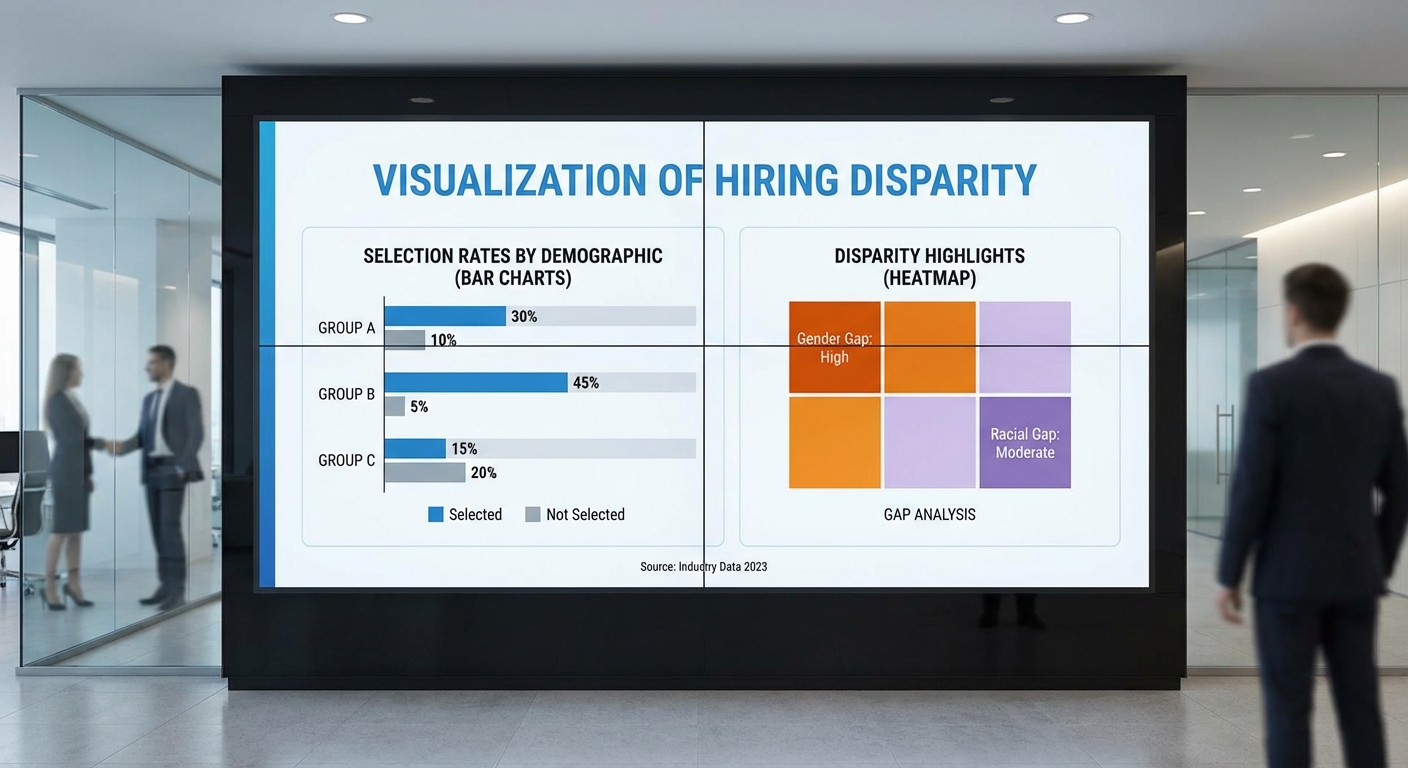

ชนิดของอคติที่พบบ่อยในการจ้างงานด้วย ML

- Disparate impact (ผลกระทบไม่เท่าเทียม) — ผลลัพธ์ของโมเดลส่งผลแตกต่างกันอย่างมีนัยสำคัญต่อกลุ่มที่คุ้มครอง เช่น เพศ เชื้อชาติ หรืออายุ แม้ไม่มีการใช้ข้อมูลส่วนบุคคลโดยตรง โมเดลอาจทำให้กลุ่มใดกลุ่มหนึ่งถูกคัดออกมากขึ้น

- Proxy bias — คุณลักษณะบางอย่างทำหน้าที่เป็นตัวแทนของข้อมูลเชิงความแตกต่าง เช่น รหัสไปรษณีย์ (ZIP code) หรือประวัติการศึกษา ที่อาจเชื่อมโยงกับเชื้อชาติหรือพื้นฐานทางสังคมเศรษฐกิจ ทำให้โมเดลแฝงอคติผ่านตัวแปรอื่น

- Selection bias — ข้อมูลฝึกสอนไม่เป็นตัวแทนของผู้สมัครจริง เช่น อิงจากประวัติการจ้างงานในอดีตที่มีการเลือกปฏิบัติ ทำให้โมเดลเรียนรู้พฤติกรรมที่เล็ดลอดมาและทำซ้ำความอยุติธรรม

- Measurement / Label bias — ป้ายกำกับ (labels) ในชุดข้อมูลอาจสะท้อนการตัดสินของมนุษย์ที่ลำเอียง เช่น การให้คะแนนพนักงานในอดีตที่มีความลำเอียงอยู่แล้ว นำไปสู่การเรียนรู้แบบผิดพลาด

- Representation bias — กลุ่มย่อยมีจำนวนตัวอย่างน้อยในข้อมูลฝึกสอน ทำให้โมเดลทำงานได้ไม่ดีสำหรับกลุ่มนั้น (underfitting) หรือตีความผิด

ผลกระทบทางสังคมและตัวอย่างกรณีศึกษาเชิงลบ

ผลกระทบจากอคติในระบบจ้างงานมีทั้งเชิงปัจเจกและเชิงสังคม ได้แก่ การสูญเสียโอกาสทางอาชีพของผู้สมัครที่เป็นกลุ่มเปราะบาง ค่าความหลากหลายขององค์กรลดลง ตลอดจนความเสี่ยงทางกฎหมายและความเชื่อมั่นของสาธารณะ

- กรณี Amazon (ประมาณปี 2014–2018) — มีรายงานว่า Amazon พัฒนาระบบคัดเลือกเรซูเม่ที่ให้คะแนนผู้สมัครตามรูปแบบของประวัติการจ้างงานก่อนหน้า แต่ระบบกลับให้คะแนนต่ำกับเรซูเม่ที่มีข้อความเชิงเพศ เช่น คำว่า "women's" หรือจากสถาบันหญิงล้วน ทำให้ระบบมีแนวโน้มเลือกผู้ชายสำหรับตำแหน่งด้านเทคนิค ได้แสดงให้เห็นว่าข้อมูลอดีตที่มีอคติสามารถทำให้โมเดลเรียนรู้และขยายอคตินั้นได้

- กรณีการศึกษา Bertrand & Mullainathan (2004) — งานวิจัยคลาสสิกด้านตลาดงานพบว่าเรซูเม่ที่มีชื่อเสียงแบบคนผิวขาวได้รับการตอบรับ (callback) สูงกว่าเรซูเม่ที่มีชื่อเสียงแบบคนผิวดำประมาณ 50% ซึ่งชี้ให้เห็นว่าการตั้งชื่อและตัวบ่งชี้เชิงวัฒนธรรมสามารถเป็นแหล่งของอคติได้อย่างชัดเจน

- การใช้วิดีโอ/วิเคราะห์ใบหน้า เช่น HireVue — เทคโนโลยีวิเคราะห์วิดีโอและการแสดงออกทางสีหน้าได้รับการวิจารณ์ว่ามีความเสี่ยงต่อการไม่เป็นธรรมต่อผู้ที่มีพื้นเพทางวัฒนธรรมหรือสำเนียงต่างกัน องค์กรตรวจสอบสิทธิกล่าวเตือนถึงความเสี่ยงด้านการเลือกปฏิบัติและบางบริษัทเริ่มยุติการใช้ส่วนประกอบการวิเคราะห์ใบหน้า

กรณีจริงเหล่านี้สะท้อนว่าแม้จุดประสงค์ในการใช้ ML จะเป็นการเพิ่มประสิทธิภาพ แต่หากละเลยการประเมินความเป็นธรรม ระบบสามารถขยายความเหลื่อมล้ำเดิมได้อย่างรวดเร็ว

เทคนิคและกระบวนการเพื่อลดและตรวจสอบอคติ

การจัดการอคติต้องทำทั้งในเชิงเทคนิคและเชิงองค์กร ต่อไปนี้เป็นแนวทางที่ปฏิบัติได้จริงและใช้กันอย่างแพร่หลาย:

- Auditing (การตรวจสอบอย่างเป็นระบบ) — ดำเนินการ audit ทั้งชุดข้อมูลและโมเดลอย่างสม่ำเสมอ รวมถึงการทดสอบแบบอิสระ (third-party audits), stress tests กับกลุ่มย่อย และการใช้ synthetic audits (สร้างตัวอย่างจำลองเพื่อทดสอบผลลัพธ์) เพื่อจับความลำเอียงที่ไม่ปรากฏชัด

- Fairness metrics — เลือกและติดตามตัวชี้วัดความเป็นธรรมที่เหมาะสมกับบริบท เช่น

- Demographic parity — อัตราการได้รับการคัดเลือกเท่าเทียมกันข้ามกลุ่มที่คุ้มครอง (P(ŷ=1|A=0)=P(ŷ=1|A=1)) เหมาะกับกรณีมองหาโอกาสเท่าเทียมโดยรวม

- Equal opportunity — เทียบอัตรา true positive ระหว่างกลุ่ม (TPR parity) เพื่อให้กลุ่มมีโอกาสถูกคัดเลือกเมื่อมีคุณสมบัติจริง

- Equalized odds และ Predictive parity — ใช้เมตริกอื่นๆ เพื่อจับความแตกต่างเชิงข้อผิดพลาดและความน่าเชื่อถือของการทำนาย

- Pre-processing — แก้ไขข้อมูลก่อนฝึก เช่น reweighing, oversampling กลุ่มส่วนน้อย, data augmentation หรือการสร้างตัวอย่างสังเคราะห์ เพื่อให้ชุดข้อมูลเป็นตัวแทนมากขึ้น

- In-processing — ใช้อัลกอริทึมที่คำนึงถึงความเป็นธรรม เช่น การเพิ่มข้อจำกัดด้าน fairness ในฟังก์ชัน loss, adversarial debiasing ที่ฝึกตัวจำแนกหลักร่วมกับ adversary ที่พยายามทำนายคุณลักษณะที่มีความเสี่ยง หาก adversaryไม่สามารถทำนายได้ แสดงว่าการเรียนรู้ได้ลดสัญญาณของคุณลักษณะนั้น

- Post-processing — ปรับผลลัพธ์หลังการทำนาย เช่น การปรับ threshold ข้ามกลุ่มหรือใช้ equalized odds post-processing เพื่อลดความแตกต่างของอัตราการผิดพลาด

- Blind trials และการทดสอบเชิงทดลอง — ใช้การทดสอบแบบ blind (ซ่อนชื่อ เพศ รูปภาพ) ในขั้นตอนคัดกรองเบื้องต้น และดำเนินการ A/B testing ที่วัดทั้งประสิทธิภาพและ fairness metric ก่อนนำระบบไปใช้งานจริง

- กระบวนการกำกับดูแลและการจัดการความเสี่ยง — จัดทำนโยบายการตรวจสอบ (model governance), จัดทำ Model Cards/Documentation, ทำการประเมินผลกระทบเชิงจริยธรรม (Ethical Impact Assessment), ตั้งทีมข้ามสายงาน (รวมถึงผู้เชี่ยวชาญด้านกฎหมาย จริยธรรม และตัวแทนจากกลุ่มที่ได้รับผลกระทบ) เพื่อตัดสินใจเชิงนโยบายและกระบวนการ

- การตรวจสอบต่อเนื่องและการตอบสนองเชิงปฏิบัติการ — ติดตาม metric ทางความเป็นธรรมแบบเรียลไทม์ ตั้งค่าแจ้งเตือนเมื่อมี divergence และมีแผน rollback หรือการปรับแต่งโมเดลอย่างรวดเร็วเมื่อพบปัญหา

แนวทางปฏิบัติที่แนะนำสำหรับองค์กร

องค์กรที่ต้องการนำ ML มาใช้ในกระบวนการจ้างงานควรผสมผสานมาตรการเชิงเทคนิคและการบริหาร ดังนี้:

- เริ่มจากการประเมินความเสี่ยงและตั้งเป้าหมายความเป็นธรรมให้ชัดเจนก่อนออกแบบระบบ

- ทำ data provenance และบันทึกแหล่งที่มา พร้อมตรวจสอบความเป็นตัวแทนของข้อมูล

- เลือก fairness metrics ที่สอดคล้องกับวัตถุประสงค์ทางธุรกิจและกฎหมาย

- ผสานการทดสอบแบบ blind trials และ auditing ก่อนใช้งานจริง และทำการทดสอบภายหลังการ deploy อย่างสม่ำเสมอ

- ใช้เทคนิคเช่น adversarial debiasing, reweighing, และ post-processing เมื่อจำเป็น แต่ต้องยอมรับ trade-off ระหว่างความเป็นธรรมและความแม่นยำและสื่อสารกับผู้มีส่วนได้ส่วนเสียอย่างโปร่งใส

สรุปแล้ว การจัดการอคติในระบบจ้างงานที่ใช้ ML ต้องเป็นกระบวนการต่อเนื่องที่ผสานทั้งการตรวจสอบข้อมูล การออกแบบโมเดลที่คำนึงถึงความเป็นธรรม และโครงสร้างกำกับดูแลขององค์กรเท่านั้นที่จะลดความเสี่ยงและรักษาความยุติธรรมในกระบวนการคัดเลือกพนักงานได้อย่างยั่งยืน

ประเด็นด้านกฎหมาย ข้อมูลส่วนบุคคล และความโปร่งใส

ประเด็นด้านกฎหมาย ข้อมูลส่วนบุคคล และความโปร่งใส

การนำ Machine Learning มาใช้ในการจ้างงานต้องสอดคล้องกับกรอบกฎหมายคุ้มครองข้อมูลและข้อกำหนดด้านความโปร่งใสทั้งในระดับสากลและระดับประเทศ ในบริบทสากล กฎหมายที่องค์กรควรพิจารณาเป็นหลักได้แก่ GDPR (EU General Data Protection Regulation) ซึ่งกำหนดหลักการสำคัญหลายประการ เช่น ฐานความชอบด้วยกฎหมาย (lawful basis) สำหรับการประมวลผลข้อมูลส่วนบุคคล, สิทธิของเจ้าของข้อมูล (data subject rights) เช่น สิทธิในการเข้าถึง แก้ไข ลบ และพกพาข้อมูล รวมถึงข้อกำหนดในการทำ Data Protection Impact Assessment (DPIA) สำหรับการประมวลผลที่มีความเสี่ยงสูง เช่น การคัดเลือกบุคคลโดยใช้ระบบอัตโนมัติ ในระดับไทย พระราชบัญญัติคุ้มครองข้อมูลส่วนบุคคล พ.ศ. 2562 (PDPA) และแนวปฏิบัติของคณะกรรมการคุ้มครองข้อมูลส่วนบุคคลเป็นกรอบที่ต้องปฏิบัติตาม ทั้งการหาเหตุเชื่อมโยงทางกฎหมาย การแจ้งวัตถุประสงค์ และการคุ้มครองสิทธิผู้สมัครงาน นอกจากนี้ องค์กรต้องติดตามแนวทางเฉพาะอุตสาหกรรม (เช่น แนวทางของหน่วยงานกำกับดูแลแรงงาน ธนาคาร หรือภาคสุขภาพ) และกฎหมายต่อต้านการเลือกปฏิบัติที่อาจห้ามการใช้ตัวชี้วัดที่ก่อให้เกิดการกีดกันกลุ่มใดกลุ่มหนึ่ง

ในเชิงปฏิบัติ มีหลักปฏิบัติด้านความเป็นส่วนบุคคลที่ต้องยึดถือ ได้แก่ การขอความยินยอม (consent), การลดข้อมูลให้จำเป็น (data minimization) และ การกำหนดระยะเวลาเก็บรักษา (retention) สำหรับการสรรหา ผู้พัฒนาระบบและหน่วยงาน HR มักอาศัยการยินยอมเป็นฐานทางกฎหมายสำหรับข้อมูลที่อ่อนไหวหรือเมื่อต้องใช้ข้อมูลเพื่อวัตถุประสงค์ที่เฉพาะเจาะจง แต่ต้องคำนึงว่า consent สามารถถอนคืนได้ จึงควรพิจารณาว่าพื้นฐานอื่นๆ เช่น ความจำเป็นตามสัญญาหรือผลประโยชน์ชอบด้วยกฎหมาย (legitimate interests) เหมาะสมหรือไม่ โดยต้องทำการประเมินความเสี่ยงและให้ข้อมูลที่ชัดเจนเกี่ยวกับผลที่เกิดขึ้นต่อผู้สมัคร การประยุกต์หลัก data minimization หมายถึงการเก็บเฉพาะข้อมูลที่จำเป็นตามวัตถุประสงค์การสรรหา และควรใช้มาตรการเช่นการ pseudonymization หรือการทำให้เป็นนิรนามเมื่อนำข้อมูลไปใช้เพื่อการวิเคราะห์หรือพัฒนาระบบ ส่วนการกำหนดระยะเวลาเก็บรักษาควรมีนโยบายที่ชัดเจน พร้อมตาราง retention และกระบวนการลบข้อมูลเมื่อจบวัตถุประสงค์หรือเมื่อผู้สมัครร้องขอ

ความโปร่งใส (explainability) เป็นข้อกำหนดเชิงกฎหมายและเชิงจริยธรรมที่สำคัญ โดยในกรอบ GDPR ผู้สมัครที่ได้รับผลการตัดสินจากระบบอัตโนมัติมีสิทธิได้รับ “ข้อมูลเชิงนัยเกี่ยวกับตรรกะ การมีนัยสำคัญ และผลลัพธ์ที่อาจเกิดขึ้น” (meaningful information about the logic, significance and envisaged consequences) ในทางปฏิบัติหมายถึงองค์กรต้องสามารถอธิบายได้ว่าโมเดลทำงานอย่างไร ใช้คุณลักษณะใดบ้าง และเหตุใดผู้สมัครจึงถูกคัดเลือกหรือปฏิเสธ การไม่สามารถอธิบายได้อาจนำไปสู่คำร้องเรียนหรือการลงโทษ นอกจาก GDPR แล้ว กฎระเบียบใหม่ๆ เช่น EU AI Act ยังกำหนดให้ระบบจัดประเภทว่าเป็น “ความเสี่ยงสูง” (high-risk) ในงานสรรหา ซึ่งจะนำมาซึ่งข้อกำหนดด้านความโปร่งใสและการตรวจสอบเพิ่มเติม

เพื่อสนับสนุนความโปร่งใสและการตรวจสอบ ต้องจัดทำเอกสารและบันทึกที่ครบถ้วนรวมถึงการเก็บรักษาบันทึกการประมวลผล (Records of Processing Activities, RoPA) ตามข้อกำหนดของ GDPR และแนวปฏิบัติของ PDPA คำแนะนำปฏิบัติการ ได้แก่

- Model cards และ Datasheets - บันทึกคุณลักษณะของโมเดล เช่น วัตถุประสงค์ ขอบเขตข้อมูลที่ใช้ ข้อจำกัด สมรรถนะตามกลุ่มประชากร และเมตริกความลำเอียง (bias metrics)

- Data provenance และ Training data records - แหล่งที่มาของข้อมูล การได้รับความยินยอม หรือสัญชาติฐานกฎหมายสำหรับแต่ละชุดข้อมูล และการทำความสะอาดข้อมูล (preprocessing) ที่กระทำ

- DPIA / Algorithmic Impact Assessment - การประเมินความเสี่ยงเชิงระบบ รวมถึงการประเมินผลกระทบด้านสิทธิพลเมือง ความเสี่ยงต่อการเลือกปฏิบัติ และมาตรการบรรเทาความเสี่ยง

- Logging และ Versioning - บันทึกการตัดสินใจของระบบ เวอร์ชันของโมเดล ข้อมูลนำเข้า/ผลลัพธ์ที่เกี่ยวข้อง และการเปลี่ยนแปลงที่สำคัญเพื่อการตรวจสอบย้อนหลัง

- นโยบายการเข้าถึงและการควบคุมภายใน - กำหนดผู้มีสิทธิ์เข้าถึงข้อมูลและโมเดล พร้อมการทบทวนสิทธิ์อย่างสม่ำเสมอ

- ช่องทางการร้องเรียนและการเยียวยา - ระบบให้ผู้สมัครสามารถขอคำชี้แจง แก้ไข หรอืยื่นคำร้องได้ รวมถึงกระบวนการ human-in-the-loop สำหรับการทบทวนการตัดสินใจที่สำคัญ

ท้ายสุด องค์กรควรบูรณาการกระบวนการด้านกฎหมายและการกำกับดูแลเข้าสู่วงจรพัฒนาระบบ (MLOps/Governance) ตั้งแต่การออกแบบจนถึงการดำเนินการจริง การฝึกอบรมบุคลากรด้าน HR และข้อมูล และการจัดเตรียมเอกสารเชิงเทคนิคและเชิงนโยบายอย่างเป็นระบบ จะช่วยลดความเสี่ยงทางกฎหมาย เพิ่มความเชื่อมั่นแก่ผู้สมัคร และทำให้การใช้ Machine Learning ในการสรรหาสอดคล้องกับหลักสิทธิมนุษยชนและมาตรฐานการคุ้มครองข้อมูลสมัยใหม่

แนวทางปฏิบัติและ roadmap สำหรับการนำ ML ไปใช้จริงในองค์กร

แนวทางปฏิบัติและ Roadmap สำหรับการนำ Machine Learning ไปใช้จริงในองค์กร

ภาพรวมเชิงยุทธศาสตร์: ขั้นตอนแบบ step-by-step

การนำ Machine Learning (ML) มาใช้ในกระบวนการจ้างงานต้องเป็นโครงการที่มีการวางแผนเป็นขั้นเป็นตอน เริ่มจากการประเมินความพร้อมแล้วค่อย ๆ ขยายผลตามหลัก assess → pilot → validate → deploy → monitor ดังนี้:

- Assess (ประเมิน readiness): ตรวจสอบความพร้อมของข้อมูล โครงสร้างพื้นฐาน ทักษะบุคลากร และความเสี่ยงด้านจริยธรรม/กฎหมาย เช่น ทำ Data Inventory สำรวจแหล่งข้อมูลเรซูเม่ ผลสัมภาษณ์ และการทดสอบทักษะ รวมถึงการประเมินความเสี่ยงเรื่อง bias และความเป็นส่วนตัว

- Pilot (ทดลองในวงแคบ): เลือก use case เดียวที่มีขอบเขตชัดเจน เช่น การคัดกรองใบสมัครเบื้องต้น ทดลองโมเดลในกลุ่มผู้สมัครจริงและผู้ว่าจ้างเพื่อเก็บข้อมูลการทำงานจริง (ground truth)

- Validate (การประเมินผล): วัดผลเชิงเทคนิค (accuracy, precision, recall, AUC), เชิงธุรกิจ (time-to-hire ลดลงเท่าใด, cost-per-hire), และเชิงจริยธรรม (disparate impact, fairness metrics) รวมทั้งการทดสอบ A/B กับกระบวนการเดิม

- Deploy (ขยายการใช้งาน): ขยายไปยังหน่วยงานอื่น ๆ หลังผ่านเกณฑ์ประสิทธิผลและความปลอดภัย วาง SOPs และจัดตั้ง governance เพื่อควบคุมการเปลี่ยนแปลง

- Monitor (ติดตามหลังการนำไปใช้): ตั้งกลไก continuous monitoring เพื่อตรวจจับ model drift, performance degradation และปัญหาความไม่เป็นกลางของโมเดล พร้อมกับแผนการ retraining ตามความถี่ที่กำหนด

การตั้ง Governance และนโยบายควบคุม

Governance เป็นหัวใจสำคัญของการนำ ML มาใช้ในงานบุคคล ควรกำหนดโครงสร้างและบทบาทอย่างชัดเจน ดังนี้:

- Governance Board: คณะกรรมการอิสระประกอบด้วยตัวแทนจาก HR, Data Science, Legal/Compliance, Privacy, และผู้บริหารระดับสูง ทำหน้าที่อนุมัติแนวทางนโยบาย ความเสี่ยง และการสื่อสารภายในองค์กร

- SOPs (Standard Operating Procedures): ระบุขั้นตอนชัดเจนตั้งแต่การเก็บข้อมูลจนถึงการตัดสินใจเกี่ยวกับผู้สมัคร รวมถึงแนวทางการบันทึกการตัดสินใจของโมเดล (model explainability logs)

- Audit Schedule: กำหนดการตรวจสอบประจำ (เช่น ไตรมาสละครั้ง) ซึ่งครอบคลุมการตรวจสอบข้อมูล แหล่งที่มา การประเมิน bias และการทบทวนการปฏิบัติตามกฎหมาย เช่น พรบ.คุ้มครองข้อมูลส่วนบุคคล

ทีมข้ามสายงานและบทบาทสำคัญ

การรวมทีมข้ามสายงานเป็นสิ่งจำเป็นเพื่อให้เทคโนโลยีสอดคล้องกับกระบวนการธุรกิจและข้อบังคับ ตัวอย่างโครงสร้างทีมที่แนะนำ:

- HR Lead: ให้บริบทเชิงธุรกิจ กำหนดเกณฑ์การคัดเลือก และดูแลการสื่อสารกับผู้สมัครและผู้ว่าจ้าง

- Data Scientists / ML Engineers: รับผิดชอบการสร้างโมเดล การประเมิน performance และการจัดการ lifecycle ของโมเดล

- Legal & Compliance: ตรวจสอบข้อกฎหมายด้านแรงงาน ความเท่าเทียม และการคุ้มครองข้อมูลส่วนบุคคล

- Privacy Officer / Data Engineer: ดูแล data pipelines, data anonymization และการควบคุมการเข้าถึงข้อมูล

- Change Management & Training: ออกแบบโปรแกรมฝึกอบรมสำหรับ HR และผู้ใช้ปลายทาง เพื่อสร้างความเข้าใจและการยอมรับ

การประเมินด้านจริยธรรมและกฎหมาย

ก่อนการนำไปใช้จริง ทุกองค์กรควรดำเนินการประเมินเชิงจริยธรรมและกฎหมายอย่างเป็นรูปธรรม รวมทั้ง:

- การวิเคราะห์ผลกระทบต่อความเป็นส่วนตัว (Data Protection Impact Assessment)

- การวิเคราะห์ความไม่เป็นกลาง (Bias & Fairness Assessment) โดยใช้ metrics เช่น disparate impact, equal opportunity difference

- การบันทึกการตัดสินใจและความสามารถในการอธิบายผลลัพธ์ของโมเดล (explainability) เพื่อให้สอดคล้องกับข้อกำหนดการตรวจสอบ

เช็คลิสต์ก่อนสเกลขึ้น (Pre-scale Checklist)

ก่อนขยายการใช้งานจาก pilot สู่ production ควรตรวจสอบรายการต่อไปนี้เป็นลำดับ:

- Data Readiness: มี Data Inventory ครบถ้วน แหล่งข้อมูลชัดเจน และมีการจัดการคุณภาพข้อมูล (data quality) อยู่ในระดับที่ยอมรับได้

- Performance Thresholds: โมเดลผ่านเกณฑ์ด้าน accuracy/precision/recall ที่กำหนด และผ่านการทดสอบ A/B อย่างมีนัยสำคัญ

- Bias & Fairness Clearance: รายงานการประเมิน bias ถูกอนุมัติโดย Governance Board พร้อมแผนลดผลกระทบ

- Legal & Privacy Compliance: ดำเนินการ DPIA, ระบุฐานทางกฎหมายในการประมวลผลข้อมูล และมีสัญญา/มาตรการคุ้มครองข้อมูลกับผู้ให้บริการภายนอก

- Operational SOPs: มีขั้นตอนการใช้งานชัดเจน การอ้างอิงการตัดสินใจของโมเดล และช่องทางการอุทธรณ์สำหรับผู้สมัคร

- Monitoring & Retraining Plan: กำหนด metrics ที่ต้องติดตาม ค่า baseline, เกณฑ์ trigger สำหรับ retraining และความถี่ในการทบทวน

- Stakeholder Buy-in & Training: มีแผนการฝึกอบรม HR และผู้ใช้ปลายทาง พร้อมสื่อสารเรื่องประโยชน์และความเสี่ยงอย่างโปร่งใส

การติดตามหลังการนำไปใช้: Continuous Monitoring และ Retraining

หลัง deployment ต้องมีระบบติดตามแบบต่อเนื่องซึ่งรวมถึง:

- การมอนิเตอร์เชิงเทคนิค: performance metrics (precision, recall, F1), latency และระบบ logging ที่สามารถวิเคราะห์สาเหตุของข้อผิดพลาด

- การมอนิเตอร์เชิงธุรกิจ: ผลต่อ time-to-hire, quality-of-hire, อัตราการยอมรับข้อเสนอ และ feedback จาก hiring managers

- การมอนิเตอร์เชิงจริยธรรม: การวิเคราะห์กลุ่มที่อาจได้รับผลกระทบไม่เป็นธรรม และการตรวจจับ model drift ที่อาจนำไปสู่ bias ใหม่

- แผนการ retraining: กำหนดเงื่อนไข trigger (เช่น performance ลดลงเกิน X% หรือผ่านเวลาครบ 6 เดือน) และกระบวนการทดสอบก่อน rollback

การเปลี่ยนแปลงองค์กรและการสื่อสาร

ความสำเร็จไม่ได้อยู่ที่เทคโนโลยีแต่เพียงอย่างเดียว แต่ขึ้นกับการยอมรับและการปรับตัวขององค์กร คำแนะนำเชิงปฏิบัติได้แก่:

- Training for HR: จัดหลักสูตรให้ HR เข้าใจหลักการทำงานของ ML, การอ่านผลลัพธ์, และการจัดการ bias

- Communication Plan: สื่อสารประโยชน์ ความเสี่ยง และช่องทางการร้องเรียนต่อผู้สมัครอย่างโปร่งใส เพื่อลดความกังวลและเพิ่มความเชื่อมั่น

- Stakeholder Buy-in: นำเสนอผลลัพธ์จาก pilot ด้วยข้อมูลเชิงตัวเลข (เช่น ลดเวลา shortlisting ลง X%, เพิ่มความแม่นยำของการคัดเลือก Y%) เพื่อให้ผู้บริหารและหัวหน้าหน่วยงานสนับสนุนการขยายผล

บทสรุปเชิงปฏิบัติ

การนำ ML มาใช้ในกระบวนการจ้างงานเป็นโอกาสในการเพิ่มประสิทธิภาพและความสอดคล้องของการคัดเลือกบุคลากร แต่ต้องทำอย่างมีระเบียบและรับผิดชอบ โดยยึดหลักการ start small, govern tightly, scale responsibly — เริ่มจากการประเมิน readiness, ทดลองในวงจำกัด, ตรวจสอบเชิงเทคนิค-จริยธรรม-กฎหมายอย่างเข้มงวด ก่อนขยายการใช้งานและติดตามอย่างต่อเนื่องเพื่อรักษาคุณภาพและความเป็นธรรมของกระบวนการ

แพลตฟอร์มและเครื่องมือที่เกี่ยวข้อง รวมถึงแนวโน้มในอนาคต

ภาพรวมสแต็กเทคโนโลยีและซัพพลายเออร์ที่เกี่ยวข้อง

การนำ Machine Learning (ML) มาใช้ในกระบวนการจ้างงานเกี่ยวข้องกับสแต็กเทคโนโลยีหลายชั้น ตั้งแต่ระบบจัดการผู้สมัคร (Applicant Tracking Systems - ATS) ไปจนถึงเฟรมเวิร์ก ML และแพลตฟอร์มวิเคราะห์ด้านทรัพยากรบุคคล (HR analytics). ATS ที่ผสาน ML เช่น Greenhouse, Lever, iCIMS, Workday Recruiting และ Oracle Taleo มักมีฟีเจอร์การจัดลำดับผู้สมัคร (ranking), การจับคู่ความสามารถ (skill matching) และการวิเคราะห์ประสิทธิภาพของช่องทางสรรหา โดยองค์กรขนาดใหญ่กว่า 80% รายใช้งาน ATS ในการจัดการการรับสมัครเพื่อความเป็นระบบและความเร็วในการสรรหา.

ในชั้นของ HR analytics และ people intelligence มีผู้ให้บริการอย่าง Visier, Eightfold.ai, Workday People Analytics และ SAP SuccessFactors ที่เน้นการวิเคราะห์เชิงลึก เช่น การคาดการณ์อัตราการลาออก (attrition), การวางแผนกำลังคน และการประเมินทักษะภายในองค์กร ส่วนโซลูชัน third-party เช่น HireVue (video assessments), Pymetrics (neuro-assessment), SeekOut/hireEZ (talent sourcing) จะเสริมความสามารถเฉพาะทาง เช่น การประเมินวิดีโอหรือการค้นหาแหล่งผู้สมัครเชิงรุก

ฝั่งเทคนิค ML มักอาศัย open-source libraries ที่เป็นมาตรฐาน เช่น scikit-learn สำหรับโมเดลพื้นฐาน, PyTorch และ TensorFlow สำหรับ deep learning, และชุดเครื่องมือ NLP จาก Hugging Face ที่รองรับ Transformer/LLM ซึ่งทำให้สามารถสร้างโมเดลการจับคู่เรซูเม่ การสกัดทักษะ (skill extraction) หรือการวิเคราะห์ภาษาธรรมชาติจากข้อความผู้สมัครได้อย่างยืดหยุ่น

ข้อพิจารณาสำคัญในการเลือกโซลูชัน

เมื่อตัดสินใจเลือกแพลตฟอร์มหรือเครื่องมือสำหรับ ML ในการจ้างงาน องค์กรควรพิจารณาปัจจัยต่อไปนี้อย่างรอบคอบ:

- On-premise vs Cloud: โซลูชันบนคลาวด์ให้อัปเดตฟีเจอร์รวดเร็ว สเกลง่าย และลดภาระการดูแลระบบ แต่มีข้อกังวลเรื่องความเป็นส่วนตัวของข้อมูลและข้อกำหนดด้านกฎระเบียบ ในขณะที่ on-premise ให้การควบคุมข้อมูลสูง เหมาะกับองค์กรที่มีข้อจำกัดด้านความปลอดภัยหรือกฎหมาย แต่ต้องการทรัพยากรด้านไอทีสูงกว่า

- ความสามารถในการปรับแต่ง (Customization): ระบบสำเร็จรูปมักใช้งานได้เร็ว แต่จำกัดการปรับพฤติกรรมโมเดลให้เข้ากับบริบทองค์กร ส่วนโซลูชันแบบเปิดหรือพัฒนาเองช่วยให้ปรับโมเดล การประเมิน และเมตริกต่าง ๆ ให้สอดคล้องกับ KPIs ขององค์กรได้ดีกว่า

- ความโปร่งใสของผู้ให้บริการ (Vendor Transparency): ควรประเมินว่าผู้ให้บริการเปิดเผยวิธีการฝึกโมเดล แหล่งข้อมูลที่ใช้ และมีเครื่องมือสำหรับอธิบายการตัดสินใจหรือไม่ (เช่น SHAP/LIME, model cards) เพราะความโปร่งใสเป็นปัจจัยสำคัญในการปฏิบัติตามกฎระเบียบและสร้างความเชื่อมั่น

- ความยุติธรรมและการตรวจสอบ (Fairness & Auditability): ตรวจสอบว่ามีการประเมิน bias ในโมเดลไหม มีการทดสอบด้วยกลุ่มตัวอย่างหลากหลาย และสามารถตรวจสอบผลการตัดสินใจย้อนหลังได้ (audit trail)

- การบูรณาการกับระบบภายใน (Integration): ความสามารถในการเชื่อมต่อกับ HRIS, LMS, calendaring และเครื่องมือสัมภาษณ์จะกำหนดประสิทธิผลของโซลูชัน เช่น การนำข้อมูลจาก HRIS มาปรับปรุงโมเดลพยากรณ์ความต้องการบุคลากร

ข้อดี-ข้อเสียของแต่ละแนวทางและตัวอย่างการใช้งาน

โซลูชันสำเร็จรูป (SaaS) — ข้อดีคือการติดตั้งรวดเร็ว อัปเดตต่อเนื่อง และมีฟีเจอร์ครบถ้วน แต่ข้อจำกัดคืออาจขาดความยืดหยุ่นในการปรับโมเดลหรือการเข้าถึงข้อมูลดิบ ขณะที่โซลูชันแบบกำหนดเอง (custom-built) จะให้การปรับแต่งสูงและควบคุมข้อมูลได้ดีกว่า แต่ต้องลงทุนในทีม ML และโครงสร้างพื้นฐานมากขึ้น

การเลือกใช้ open-source libraries ช่วยลดค่าใช้จ่ายและหลีกเลี่ยงการล็อกกับผู้จำหน่าย แต่ต้องแลกด้วยต้นทุนการพัฒนาภายในและการรับประกันคุณภาพ ส่วนบริการ third-party เช่น video assessment providers ช่วยเพิ่มพลังในการประเมินด้านพฤติกรรมและทักษะที่ยากจะวัดด้วยคำถามกระดาษ แต่มีความเสี่ยงด้านความเป็นส่วนตัวและอคติที่มาจากชุดข้อมูลที่ใช้ฝึก

แนวโน้มในอนาคต

ในระยะข้างหน้า เราคาดว่าจะเห็นการผสมผสานของเทคโนโลยีหลายด้านที่เปลี่ยนวิธีการสรรหาอย่างมีนัยสำคัญ:

- LLMs ในการประเมินและสัมภาษณ์อัตโนมัติ: โมเดลภาษาขนาดใหญ่ (Large Language Models) จะถูกนำมาใช้สร้างคำถามสัมภาษณ์เชิงบริบท วิเคราะห์คำตอบแบบเชิงลึก และให้ feedback ที่เป็นธรรมชาติ เช่น การสร้าง scenario-based assessments หรือการสังเคราะห์ feedback สำหรับผู้สมัคร แต่ต้องระวังภาวะ hallucination และควรมีมนุษย์ตรวจทานผลลัพธ์

- มาตรฐานและกรอบการประเมินความยุติธรรม: คาดว่าจะมีการพัฒนาแนวปฏิบัติและมาตรฐานสากล (เช่น model cards, fairness metrics, third-party audits) เพื่อให้การใช้ AI ในการจ้างงานเป็นไปอย่างยุติธรรมและปฏิบัติตามข้อกฎหมาย

- การใช้งานเชิงรุก (Proactive Sourcing): เทคโนโลยีจะเปลี่ยนจากการรอรับใบสมัครเป็นการค้นหาและนำเสนอผู้สมัครที่มีศักยภาพก่อน (proactive outreach) โดยใช้การวิเคราะห์เครือข่าย ทักษะ และพฤติกรรมออนไลน์ ทำให้เวลาในการเติมตำแหน่งสั้นลงและคุณภาพผู้สมัครเพิ่มขึ้น

- การรวม AI เข้ากับ Employee Experience: AI จะไม่หยุดที่การจ้างงาน แต่ขยายสู่การ onboarding, การวางแผนการพัฒนาอาชีพ (career pathing) และการประเมินผลการทำงานอย่างต่อเนื่อง ส่งผลให้ข้อมูลการสรรหาและข้อมูลพนักงานเชื่อมโยงกันอย่างเป็นระบบ

- กฎหมาย ความเป็นส่วนตัว และการกำกับดูแล: นโยบายคุ้มครองข้อมูลส่วนบุคคลและกฎระเบียบด้าน AI จะยิ่งเข้มงวดขึ้น ทำให้ความสามารถในการอธิบายการตัดสินใจของโมเดลและการรักษาความเป็นส่วนตัวเป็นเงื่อนไขสำคัญในการเลือกใช้เทคโนโลยี

สรุปแล้ว การเลือกแพลตฟอร์มและเครื่องมือสำหรับ ML ในการจ้างงานต้องประเมินทั้งด้านเทคนิค ธุรกิจ และจริยธรรมอย่างสมดุล องค์กรที่เตรียมการด้าน governance, ความโปร่งใส และการบูรณาการข้อมูลได้ดีกว่า จะสามารถใช้ประโยชน์จากแนวโน้ม LLMs และ proactive sourcing ได้อย่างปลอดภัยและยั่งยืน

บทสรุป

การนำ Machine Learning มาใช้ในการจ้างงานมีศักยภาพที่ชัดเจนในการเพิ่มประสิทธิภาพ ลดต้นทุน และปรับปรุงคุณภาพของการคัดเลือกบุคลากร เช่น การเร่งกระบวนการคัดกรองผู้สมัคร ลดภาระงานเชิงธุรกรรม และช่วยให้การจับคู่ทักษะกับตำแหน่งงานแม่นยำขึ้น แต่ผลลัพธ์เหล่านี้จะเกิดขึ้นได้ก็ต่อเมื่อองค์กรจัดการปัญหาเชิงจริยธรรมและความเสี่ยงควบคู่ไปด้วย โดยเฉพาะการควบคุมอคติ (bias) ในข้อมูลและแบบจำลอง การสร้างความโปร่งใส (transparency) ต่อผู้สมัคร และการปฏิบัติตามกฎหมายคุ้มครองข้อมูลส่วนบุคคลและข้อบังคับด้านแรงงาน เช่น การวัดผลด้วย KPI ที่เหมาะสม (ตัวอย่างเช่น time-to-hire, quality-of-hire, อัตราความผิดพลาดของการคัดกรอง) จะช่วยให้ประเมินประสิทธิผลอย่างชัดเจน

เพื่อความสำเร็จ องค์กรควรเริ่มจากโครงการนำร่องที่มี governance ชัดเจน ตั้งแนวปฏิบัติเรื่องความเป็นธรรมและความโปร่งใส กำหนด KPI ที่วัดผลได้จริง พร้อมติดตั้งกลไก monitoring และ auditing ระหว่างการทดลองใช้ก่อนขยายสู่ระดับองค์กร รวมทั้งรักษาหลักการ human-in-the-loop เพื่อให้การตัดสินใจสำคัญยังคงมีการทบทวนโดยมนุษย์ ในมุมมองอนาคต เทคโนโลยีจะพัฒนาไปสู่โมเดลที่อธิบายได้ดีขึ้นและการกำกับดูแลที่เข้มแข็งขึ้น ส่งผลให้องค์กรที่ลงทุนในโครงสร้างการกำกับดูแล การติดตามผล และการพัฒนาทักษะแรงงาน จะได้รับประโยชน์เชิงแข่งขันจากการจ้างงานที่มีประสิทธิภาพและเป็นธรรมมากขึ้นในระยะยาว

📰 แหล่งอ้างอิง: vocal.media