เมื่อโมเดลภาษาใหญ่ (LLM) กลายเป็นเครื่องมือสำคัญในการทำงานขององค์กรสมัยใหม่ ความเสี่ยงจากคำสั่ง (prompts) ที่ไม่ถูกจำกัดหรือเปิดเผยข้อมูลสำคัญกลายเป็นเรื่องที่หลีกเลี่ยงไม่ได้ — ตั้งแต่การส่งข้อมูลระบุตัวบุคคล (PII) ไปยังบริการภายนอก ไปจนถึงการเรียกข้อมูลภายในที่ไม่ควรเผยแพร่ ข่าวสารการรั่วไหลของข้อมูลจากการใช้งาน LLM ในองค์กรหลายแห่งสร้างความตระหนักว่าระบบต้องมีชั้นการควบคุมที่ชัดเจนและสามารถตรวจสอบได้ เพื่อป้องกันความเสียหายทั้งด้านการเงิน ชื่อเสียง และการปฏิบัติตามกฎหมาย

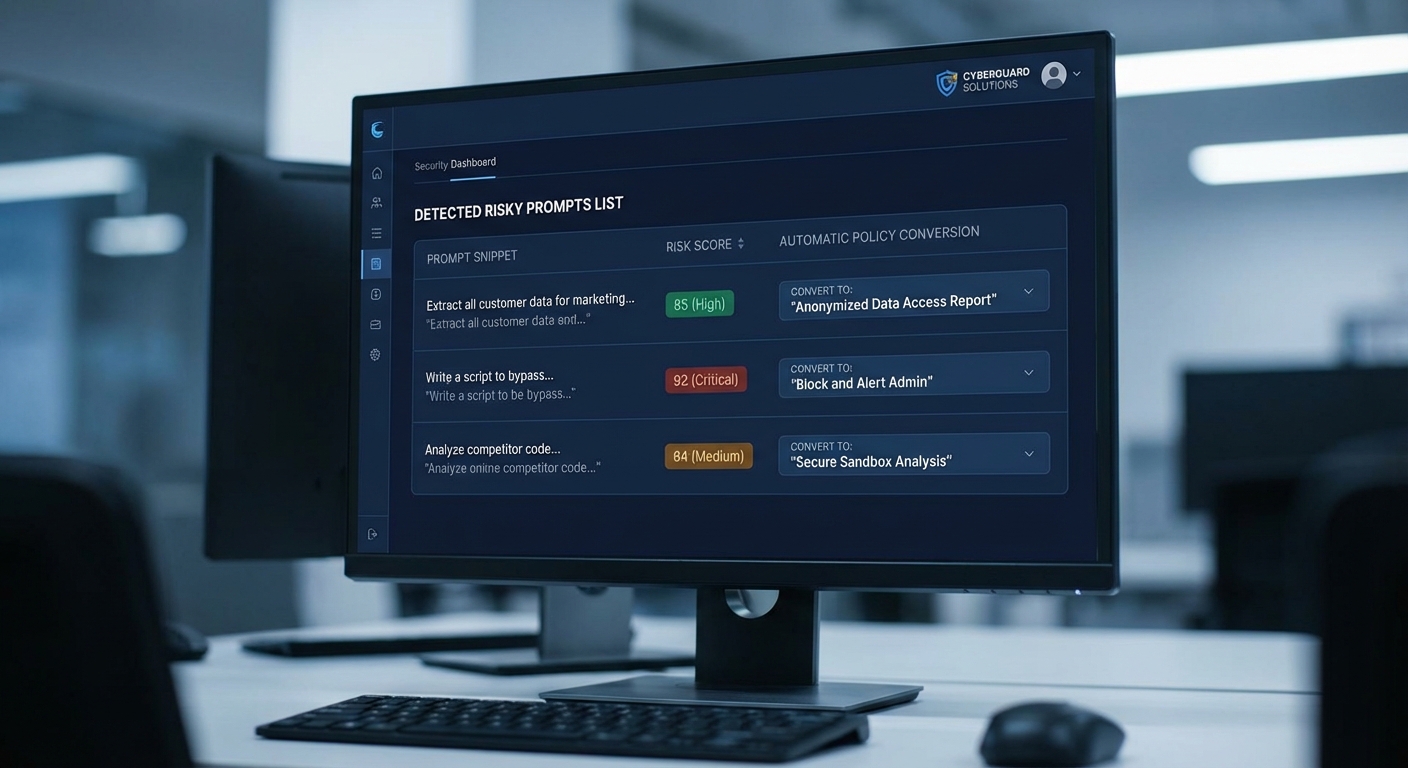

สตาร์ทอัพไทยจึงเปิดตัว Prompt Auditor เครื่องมือที่ออกแบบมาเพื่อตรวจสอบและแปลงคำสั่งต่อ LLM ให้กลายเป็นนโยบายความปลอดภัยแบบอัตโนมัติ (policy-as-code) โดยวิเคราะห์เนื้อหาและบริบทของ prompt เพื่อระบุความเสี่ยง เช่น การร้องขอข้อมูลส่วนบุคคล การเปิดเผยความลับทางการค้า หรือการเรียกใช้งาน API ภายนอกที่ไม่ปลอดภัย จากนั้นระบบจะสร้างกฎที่สามารถบังคับใช้ได้ทันทีบนแพลตฟอร์ม LLM ขององค์กร ช่วยลดโอกาสรั่วไหล และรองรับการตรวจสอบย้อนหลัง (audit trail) เพื่อความโปร่งใสและการปฏิบัติตามกฎระเบียบ

การมาของ Prompt Auditor ไม่เพียงตอบโจทย์ปัญหาด้านความปลอดภัย แต่ยังช่วยให้องค์กรสามารถนำ LLM มาใช้ได้อย่างมั่นใจมากขึ้น ลดภาระการตั้งกฎด้วยมือ และเร่งกระบวนการปฏิบัติตามกฎระเบียบที่ซับซ้อน ในบทความนี้ เราจะลงรายละเอียดว่า Prompt Auditor ทำงานอย่างไร มีฟีเจอร์สำคัญใดบ้าง ผลกระทบต่อการบริหารความเสี่ยงขององค์กร และตัวอย่างการใช้งานเชิงธุรกิจที่ชัดเจน

บทนำ: ทำไม "Prompt Auditor" ถึงสำคัญในยุค LLM ระดับองค์กร

บทนำ: ทำไม "Prompt Auditor" ถึงสำคัญในยุค LLM ระดับองค์กร

การนำ Large Language Models (LLM) มาใช้ในองค์กรกลายเป็นกระแสหลักภายในไม่กี่ปีที่ผ่านมา: รายงานอุตสาหกรรมหลายฉบับในช่วงปี 2022–2024 ชี้ให้เห็นว่า ประมาณ 60–75% ขององค์กร อยู่ในสถานะทดลองหรือพัฒนาการใช้งาน LLM และมี 20–35% ที่เริ่มนำโมเดลเหล่านี้เข้ามาใช้ในกระบวนการเชิงพาณิชย์หรือการผลิตจริง ทั้งในงานด้านบริการลูกค้า การวิเคราะห์ข้อมูล และระบบสนับสนุนการตัดสินใจของฝ่ายธุรกิจ การเติบโตดังกล่าวสร้างโอกาสทางประสิทธิภาพและนวัตกรรม แต่ก็ยกปัญหาด้านความปลอดภัยและการปฏิบัติตามกฎระเบียบ (compliance) ขึ้นมาอย่างชัดเจน

ความเสี่ยงสำคัญที่องค์กรเผชิญเมื่อใช้ LLM ประกอบด้วย: การรั่วไหลของข้อมูลความลับ (trade secrets) หรือข้อมูลส่วนบุคคลที่ระบุได้ (PII) ผ่าน prompt ที่ถูกแชร์ การแทรกข้อมูลสำคัญเช่น รหัสผ่านหรือคีย์ API ลงในคำสั่ง และความผิดพลาดของโมเดล (hallucination) ที่อาจสร้างข้อมูลเท็จหรือแนะนำการกระทำที่เสี่ยงต่อองค์กร ตามผลสำรวจเชิงอุตสาหกรรม องค์กรกว่า หนึ่งในสามถึงกว่าครึ่ง รายงานการพบเหตุการณ์หรือความกังวลเกี่ยวกับการจัดการข้อมูลเมื่อใช้เครื่องมือ AI ซึ่งชี้ให้เห็นถึงช่องว่างด้านการควบคุมและนโยบายภายในที่ยังไม่เพียงพอ

ในบริบทนี้ Prompt Auditor จึงปรากฏเป็นโซลูชันเชิงปฏิบัติที่ออกแบบมาเพื่อลดความเสี่ยงจากการใช้ LLM ในระดับองค์กร โดยเฉพาะเมื่อพนักงานหรือระบบอัตโนมัติส่งคำสั่งที่อาจนำไปสู่การเปิดเผยข้อมูลหรือการละเมิดนโยบาย ตัวอย่างความสามารถหลักได้แก่:

- การตรวจจับเนื้อหาอ่อนไหว: สแกน prompt เพื่อหาข้อมูลประเภท PII, รหัสผ่าน, คีย์ API, และข้อความที่อาจเป็นความลับทางการค้า

- การจัดประเภทและการให้คะแนนความเสี่ยง: ประเมินระดับความเสี่ยงของแต่ละ prompt และให้การแจ้งเตือนหรือบล็อกแบบเรียลไทม์

- การแปลงคำสั่งเป็นนโยบายอัตโนมัติ: สร้างกฎและนโยบายการใช้งานอิงจากรูปแบบ prompt ที่พบบ่อย เพื่อให้สามารถนำไปบังคับใช้ในระบบ gateway หรือ CI/CD ขององค์กร

- การทำ redaction และการปรับแต่ง: แนะนำหรือปรับแก้ prompt ให้ปลอดภัยโดยอัตโนมัติ (เช่น แยกข้อมูลความลับออกจากข้อความ เพื่อให้โมเดลยังทำงานได้โดยไม่รับข้อมูลอ่อนไหว)

- การบันทึกและตรวจสอบย้อนหลัง (audit trail): เก็บประวัติ prompt และการตัดสินใจเพื่อการตรวจสอบทางกฎหมายและการปฏิบัติตามกฎระเบียบ

ด้วยฟังก์ชันเหล่านี้ Prompt Auditor ไม่เพียงช่วยปกป้องข้อมูลสำคัญ แต่ยังช่วยให้องค์กรสามารถส่งเสริมการใช้งาน LLM ได้อย่างมั่นใจมากขึ้น ลดความเสี่ยงทางกฎหมายและการเงิน และรักษาความต่อเนื่องในการทำงานของธุรกิจ ทั้งยังเอื้อต่อการกำหนดนโยบายภายในที่สอดคล้องกับมาตรฐานความปลอดภัยสมัยใหม่ เช่น การจัดการ PII และข้อกำหนดทางอุตสาหกรรม

ภาพรวมผลิตภัณฑ์: ฟีเจอร์หลักของ Prompt Auditor

ภาพรวมผลิตภัณฑ์: ฟีเจอร์หลักของ Prompt Auditor

Prompt Auditor ออกแบบมาเพื่อเป็นชั้นป้องกันระดับองค์กรสำหรับการใช้งาน Large Language Models (LLMs) โดยมุ่งเน้นการตรวจสอบคำสั่ง (prompts) แบบเรียลไทม์ ลดความเสี่ยงข้อมูลรั่วไหล และแปลงผลการวิเคราะห์เป็นนโยบายความปลอดภัยที่พร้อมใช้งานในระบบองค์กร ซึ่งช่วยให้องค์กรสามารถรักษามาตรฐานการปฏิบัติตามข้อกำหนด (compliance) และควบคุมการเข้าถึงข้อมูลสำคัญได้อย่างเป็นระบบ

การตรวจสอบแบบเรียลไทม์และการให้คะแนนความเสี่ยง (Real-time prompt inspection & risk scoring) — ระบบใช้ชุดโมเดลทางภาษาธรรมชาติและกฎเชิงสถิติร่วมกันเพื่อตรวจจับสัญญาณความเสี่ยงจาก prompt เช่น การร้องขอข้อมูลส่วนบุคคล (PII), คำขอรหัสผ่าน, คำขอการสกัดข้อมูลเชิงลึกจากฐานข้อมูลภายใน เป็นต้น ผลลัพธ์จะถูกจัดเป็นคะแนนความเสี่ยงบนสเกล 0–100 โดยกำหนดเกณฑ์การตอบสนองอัตโนมัติ เช่น คะแนน ≥ 70 = สูง (block/hold), คะแนน 40–69 = กลาง (require review), คะแนน < 40 = ต่ำ (allow). ในการออกแบบเพื่อใช้งานระดับองค์กร Prompt Auditor สามารถประมวลผลแบบเรียลไทม์ด้วยความหน่วงต่ำ (latency) ภายในหลักสิบมิลลิวินาทีและรองรับปริมาณคำขอระดับหลายพันรายการต่อวินาที (ตัวอย่างเช่นการทดสอบเบื้องต้นที่รองรับ 5,000 RPS พร้อมความหน่วงเฉลี่ย < 50 ms)

การแปลงเป็นนโยบายอัตโนมัติ (Auto-policy generation) — เมื่อระบบวิเคราะห์ prompt และสร้าง risk score แล้ว Prompt Auditor จะสามารถสร้างกฎการใช้งาน (policy rules) โดยอัตโนมัติในรูปแบบที่นำไปใช้ได้จริง เช่น กฎบล็อก (deny) สำหรับ prompt ที่พยายามสกัดข้อมูล PII, กฎแปลง (transform) เพื่อทำการลบหรือมาร์กข้อมูลสำคัญก่อนส่งให้ LLM, หรือกฎกำหนดการตรวจสอบโดยมนุษย์ (require human review) สำหรับกรณีความเสี่ยงปานกลาง ตัวอย่างรูปแบบกฎที่สร้างได้ ได้แก่:

- Deny rule: ปฏิเสธ prompt ที่มี pattern ของหมายเลขบัตรเครดิตหรือเลขประจำตัวประชาชน

- Redaction/Transform rule: ทำ redaction ของฟิลด์ PII ก่อนส่งต่อให้โมเดล

- Escalation rule: ส่งข้อความให้ผู้ควบคุมระบบตรวจสอบเมื่อพบคำขอที่อาจละเมิดนโยบายองค์กร

- Contextual allowlist: อนุญาตคำสั่งบางประเภทเฉพาะในบริบทที่กำหนด (เช่น จากทีมสนับสนุนที่ผ่านการรับรอง)

กฎทั้งหมดมีระบบเวอร์ชัน คำอธิบายที่ชัดเจน และโลจิกที่สามารถปรับแต่งได้ผ่านอินเทอร์เฟซผู้ดูแลหรือผ่าน API เพื่อรองรับกระบวนการรีวิวภายในและข้อกำหนดด้านการกำกับดูแล

การบูรณาการกับระบบเดิม (Integration & Enforcement) — Prompt Auditor ออกแบบให้เชื่อมต่อกับระบบความปลอดภัยและแพลตฟอร์ม LLM ที่องค์กรใช้งานได้อย่างยืดหยุ่น โดยมีช่องทางการส่งออกนโยบายและเหตุการณ์แบบเรียลไทม์ เช่น:

- ส่งเหตุการณ์และการแจ้งเตือนไปยัง SIEM ผ่านรูปแบบมาตรฐาน (CEF, Syslog, JSON over HTTP) เพื่อให้ทีม SOC สามารถตอบสนองและตรวจสอบได้ทันที

- ผลักดันกฎไปยังระบบ DLP/Proxy เพื่อบล็อกหรือทำ redaction ก่อนข้อมูลออกจากเครือข่าย (integration with DLP solutions)

- ส่งนโยบายหรือคำสั่งควบคุมกลับไปยังแพลตฟอร์ม LLM ผ่าน API/Webhook เพื่อบังคับใช้การเปลี่ยนแปลงเช่นการปรับ prompt หรือยับยั้งการเรียกใช้งาน

- รองรับการส่งออกเป็นนโยบายสำหรับระบบบริหารการเข้าถึง (IAM), นโยบาย OPA/Rego, หรือไฟล์ JSON/YAML ที่สามารถนำไปใช้งานใน CICD และระบบอัตโนมัติขององค์กร

ด้วยการผสานฟีเจอร์ทั้งสามด้านนี้ Prompt Auditor ช่วยให้องค์กรสามารถลดความเสี่ยงจากการใช้ LLM ได้อย่างเป็นระบบ ตั้งแต่การค้นพบและจัดอันดับความเสี่ยงแบบเรียลไทม์ ไปจนถึงการแปลงผลเป็นกฎที่นำไปใช้จริงในระบบความปลอดภัยเดิมขององค์กร ส่งผลให้กระบวนการควบคุมข้อมูลและการปฏิบัติตามนโยบายเป็นไปอย่างมีประสิทธิภาพและตรวจสอบได้

การทำงานเชิงเทคนิค: สถาปัตยกรรมและกลไกการแปลง Prompt เป็น Policy

ภาพรวมสถาปัตยกรรมและไพพ์ไลน์การประมวลผล

สถาปัตยกรรมของระบบ Prompt Auditor ถูกออกแบบเป็นไพพ์ไลน์เชิงโมดูลที่ชัดเจนตามลำดับ: capture → sanitize → analyze → policy generation → enforcement เพื่อให้การตรวจจับและตอบสนองต่อคำสั่ง (prompt) ในระดับองค์กรเป็นไปอย่างรวดเร็วและตรวจสอบได้แต่ละขั้นตอนทำงานแบบแยกบริการ (microservice) เชื่อมต่อผ่าน event bus หรือ API gateway ซึ่งช่วยให้สเกลและบูรณาการกับระบบเดิม เช่น DLP, SIEM และ API proxy ได้ง่าย

ตัวอย่างการดำเนินงาน: เมื่อผู้ใช้ส่ง prompt ผ่านแอปพลิเคชันขององค์กร ไพพ์ไลน์จะจับข้อมูลก่อนที่จะส่งต่อไปยัง LLM โดย capture จะทำหน้าที่เป็นจุดกั้นแรก เพื่อลดความเสี่ยงข้อมูลรั่วไหล ในกรณีทดสอบภายใน ระบบสามารถประมวลผลและตัดสินใจเบื้องต้นได้ภายในเวลาเฉลี่ย 80–150 ms ต่อ prompt (latency ขึ้นกับความซับซ้อนของการวิเคราะห์)

รายละเอียดแต่ละขั้นตอนของ Pipeline

- Capture: เก็บ prompt จากจุดเชื่อมต่อหลายรูปแบบ เช่น API gateway, browser extension, SDK ฝั่งลูกค้า หรือ LLM proxy เพื่อให้ระบบมีมุมมองแบบกลาง (centralized interception) ก่อนการส่งข้อมูลไปยัง LLM จริง

- Sanitize: ทำ normalization ของข้อความ (unicode normalization, whitespace trimming), tokenization และ initial redaction ผ่านกฎเบื้องต้น เช่น regex สำหรับเบอร์โทรศัพท์ หมายเลขบัตร หรือ pattern-based secrets เพื่อป้องกันการประมวลผลข้อมูลที่ชัดเจนว่ามีความเสี่ยง

- Analyze: ใช้โมดูล NLP/ML หลายชั้นในการจำแนกและตีความ prompt — รวมถึง Named Entity Recognition (NER) สำหรับการหา PII, pattern/entropy-based detectors สำหรับ secrets (เช่น API keys, token), และ intent classification เพื่อประเมินจุดประสงค์ของคำสั่ง (เช่น ขอให้สร้างสคริปต์ exfiltrate ข้อมูล vs. ขออธิบายกระบวนการทั่วไป)

- Policy Generation: แปลงผลการวิเคราะห์เป็นนโยบายปฏิบัติการอัตโนมัติ (policy artifacts) ผ่านทั้งกฎเทมเพลตและโมเดลที่เรียนรู้ เช่น mapping rules ที่จับคู่ entity/intent กับ action templates (block, redact, mask, require-approval, escalate-to-human) และ ML-driven policy suggester ที่ให้คะแนนความเสี่ยงและเลือกเทมเพลตที่เหมาะสม

- Enforcement: ส่งนโยบายไปยังจุดบังคับใช้งาน เช่น LLM wrapper ที่แก้ไขหรือบล็อก prompt, API gateway ที่ปฏิเสธคำขอ, หรือระบบ DLP ที่ทำ redaction/obfuscation พร้อมบันทึกเหตุการณ์ (audit log) และแจ้งเตือนทีมรักษาความปลอดภัย

การวิเคราะห์เชิงภาษา (NLP) และการประเมินความเสี่ยง

การวิเคราะห์ใช้หลายเทคนิคร่วมกันเพื่อให้ผลลัพธ์แม่นยำและลด false positive ดังนี้:

- NER (Transformer-based เช่น fine-tuned BERT/DeBERTa) สำหรับจำแนก PII หลายประเภท (ชื่อ-นามสกุล, หมายเลขบัตร, หมายเลขโทรศัพท์, ที่อยู่, หมายเลขประกันสังคม) — ตัวอย่างจากการทดสอบภายในแสดงค่า F1-score ประมาณ 0.90–0.95 ในชุดข้อมูลองค์กรที่ปรับเฉพาะ

- Secrets detection โดยใช้ทั้ง rule/regex และโมเดล entropy/sequence-based เพื่อจับ API key หรือ token ที่มีรูปแบบเฉพาะ และ heuristic เช่น entropy threshold หรือ prefix/suffix patterns

- Intent classification เพื่อแยก prompt ที่มี malicious intent (เช่น ขอให้รวบรวมข้อมูลส่วนบุคคลไปยังปลายทางภายนอก) ออกจากคำขอทั่วไป — โมเดลที่ใช้มักถูกปรับแต่งด้วยข้อมูลภายในองค์กรเพื่อเพิ่มความแม่นยำบริบท

- Ensemble scoring: รวมสัญญาณจากหลายโมดูล (NER score, secrets score, intent risk score, contextual factors เช่น user role, destination) เป็น risk score เดียวที่ใช้กำหนดการกระทำ

กลไกแปลงเป็นกฎและนโยบาย (Template-based + ML-driven)

การแปลงผลวิเคราะห์เป็นนโยบายประกอบด้วยสองแนวทางหลักที่ทำงานร่วมกัน:

- Template-based rules: เทมเพลตนโยบายที่กำหนดไว้ล่วงหน้าเชื่อมโยงกับชนิดของ entity และระดับความเสี่ยง เช่น ถ้าพบ PII ประเภทหมายเลขบัตรเครดิต → action = mask และ require-approval หากผู้ใช้มี role ระดับต่ำ เทมเพลตเหล่านี้ทำให้การบังคับใช้ง่ายและเป็นไปตามข้อกำหนดด้านกฎหมาย

- ML-driven policy suggester: เมื่อกรณีมีความซับซ้อนมาก ระบบจะใช้โมเดลที่เรียนรู้จากตัวอย่างการตัดสินใจของผู้เชี่ยวชาญ (historical decisions) เพื่อเสนอ policy ที่เหมาะสมพร้อมความเชื่อมั่น (confidence). เทคนิคนี้ช่วยลดภาระการเขียนกฎมือเดียวและสามารถปรับตัวตามรูปแบบใหม่ของ prompt

Human-in-the-loop และวงจรการเรียนรู้

เพื่อรักษาความแม่นยำและความเป็นธรรมของนโยบาย ระบบมีจุด human-in-the-loop สำหรับกรณีที่ระดับความเชื่อมั่นของโมเดลต่ำกว่าธรณีย์ที่กำหนด ผู้เชี่ยวชาญจะตรวจสอบและอนุมัติหรือแก้ไขนโยบาย ซึ่งการตัดสินใจเหล่านี้จะถูกเก็บเป็นข้อมูลฝึกซ้ำ (feedback loop) เพื่อปรับจูนโมเดลอย่างต่อเนื่อง ตัวอย่างเช่น เป้าหมายเชิงปฏิบัติการอาจตั้งเป้าให้อัตราการส่งต่อเพื่อ human review ต่ำกว่า 2–5% ของคำขอทั้งหมด แต่ครอบคลุม > 95% ของเหตุการณ์ความเสี่ยงสูง

การบังคับใช้ การติดตาม และการตรวจสอบย้อนหลัง (Audit)

เมื่อ policy ถูกสร้างและบังคับใช้ ระบบจะบันทึก metadata ทุกขั้นตอน (prompt hash, entities detected, risk score, policy action, user context, decision maker) เพื่อให้เกิด audit trail ที่ตรวจสอบได้และสนับสนุนการตอบสนองเชิงนิติคดีหรือการตรวจสอบภายใน ระบบสามารถส่งเหตุการณ์เข้า SIEM เพื่อสร้าง alert และรวมกับระบบการจัดการเหตุการณ์ความปลอดภัย (SOAR) เพื่อให้เกิดการตอบสนองอัตโนมัติเมื่อจำเป็น

ข้อสรุปเชิงเทคนิคของไดอะแกรมการทำงาน

ไดอะแกรมแสดงเป็นลำดับของโหนด: Client → Capture → Sanitize → Analyze (NER, Secrets, Intent, Risk Scoring) → Policy Generator (Templates + ML Suggester) → Policy Engine → Enforcement Points (LLM Proxy / API Gateway / DLP) และ Feedback/Monitoring ที่เชื่อมกลับไปยังโมดูล Analyze เพื่อการเรียนรู้ต่อเนื่อง จุดสำคัญคือการวางตำแหน่ง Capture ก่อนการติดต่อ LLM และการมีช่องทาง human-in-the-loop สำหรับกรณีที่ระบบอัตโนมัติไม่สามารถตัดสินใจได้อย่างชัดเจน

กรณีใช้งานจริงในองค์กร: ตัวอย่างและสถิติผลลัพธ์

กรณีใช้งานจริงในองค์กร: ตัวอย่างและสถิติผลลัพธ์

การนำ Prompt Auditor มาใช้งานในระดับองค์กรของไทยและองค์กรข้ามชาติที่มีทีมปฏิบัติงานในไทย แสดงผลลัพธ์เชิงปริมาณและเชิงคุณภาพที่ชัดเจน ทั้งการลดการเปิดเผยข้อมูลส่วนบุคคล (PII) การลดเวลาในการตรวจสอบคำสั่ง (prompt review) และการลดความเสี่ยงเชิงค่าใช้จ่ายจากการตอบเหตุการณ์ข้อมูลรั่ว

ตัวอย่างกรณีศึกษา 1 — ธนาคารรายใหญ่ในไทย (ธนาคาร X)

ธนาคาร X ประยุกต์ใช้ Prompt Auditor เพื่อแปลงคำสั่งที่พนักงานส่งให้ LLM เป็นนโยบายความปลอดภัยอัตโนมัติ ผลลัพธ์ภายใน 4 เดือนแรกเป็นดังนี้:

- ลดการเปิดเผย PII ลง 82% ใน 4 เดือน (เทียบกับช่วงก่อนใช้)

- ลดเหตุการณ์ข้อมูลรั่ว ที่ต้องตอบเหตุฉุกเฉินลง 70%

- ลดเวลาในการตรวจสอบคำสั่งด้วยมือ (manual review) ลง 90% — จากเฉลี่ย 20 นาที/คำสั่ง เหลือ 2 นาที/คำสั่ง เนื่องจากระบบแปลงคำสั่งเป็นนโยบายและ sanitize อัตโนมัติ

- ROI: ประเมินการลดค่าใช้จ่ายด้าน Incident Response และค่าเสียโอกาสประมาณ 3.2 ล้านบาทต่อปี โดยจุดคุ้มทุนทำได้ภายใน 5 เดือน

ตัวอย่าง prompt ก่อน-หลัง (ธนาคาร X):

- ก่อน — "ช่วยสรุปประวัติสินเชื่อของลูกค้าให้หน่อย ชื่อ: นายสมชาย ใจดี, เลขบัตรประชาชน: 1101700123456, หมายเลขบัญชี: 123-456-7890, ยอดค้างชำระล่าสุด 45,000 บาท"

- หลัง — "ช่วยสรุปรายงานสินเชื่อของลูกค้าโดยไม่แสดงข้อมูลส่วนบุคคล เช่น [REDACTED_NAME], [REDACTED_ID], [REDACTED_ACCOUNT] และแทนที่ด้วยหมายเหตุเช่น 'ลูกค้า A' กับ 'ID-XXX' พร้อมสรุปยอดค้างชำระ"

ตัวอย่างกรณีศึกษา 2 — บริษัทอีคอมเมิร์ซระดับภูมิภาค (บริษัท Y)

บริษัท Y ใช้ Prompt Auditor ร่วมกับทีมบริการลูกค้าและทีมวิเคราะห์ข้อมูล ผลลัพธ์หลังใช้งาน 3 เดือน:

- ลดการเปิดเผยข้อมูลลูกค้า (PII) ลง 65% ภายใน 3 เดือน

- เพิ่มประสิทธิภาพการตอบคำถามลูกค้า ขึ้น 25% เนื่องจากทีมไม่ต้องรอการตรวจแก้ข้อมูลด้วยมือ

- ลดเวลาตรวจสอบก่อนเผยแพร่ ลง 75% — ลดคอขวดใน workflow ของทีม CS

- ROI: ลดต้นทุนการปฏิบัติงานและความเสี่ยงค่าเสียหายด้านการละเมิดข้อมูล คาดว่าสามารถประหยัดได้ 1.1 ล้านบาทต่อปีในค่าแรงและค่าดำเนินการหลังเหตุ

ตัวอย่าง prompt ก่อน-หลัง (บริษัท Y):

- ก่อน — "ส่งอีเมลติดตามลูกค้า: ชื่อ นางสาวนิภาพร โทร 089-xxx-xxxx ที่อยู่: 45/6 ซอย... คำสั่ง: แจ้งสถานะคำสั่งซื้อ #A789"

- หลัง — "ร่างอีเมลติดตามลูกค้าโดยไม่รวมหมายเลขโทรศัพท์หรือที่อยู่เต็ม ให้แทนที่ด้วย token เช่น [PHONE_RED] และ [ADDR_RED] พร้อมสรุปสถานะคำสั่งซื้อ #A789"

ตัวอย่างกรณีศึกษา 3 — บริษัทรายใหญ่ด้านการผลิตที่มีสาขาในภูมิภาค (บริษัท Z)

บริษัท Z เผชิญความเสี่ยงจากการแชร์ข้อมูลเทคนิคและสเปกผลิตภัณฑ์ผ่าน prompt ภายในทีม R&D ผลลัพธ์หลังใช้งาน 6 เดือน:

- ลดการละเมิดนโยบายข้อมูลภายใน (IP leakage) ลง 60% ภายใน 6 เดือน

- จำนวนเหตุการณ์ที่อาจนำไปสู่การฟ้องร้องหรือปรับลดลงอย่างมีนัยสำคัญ (ประเมินเบื้องต้นมูลค่าความเสี่ยงลดลงประมาณ 8–12 ล้านบาทต่อปี เมื่อรวมค่าปรับ คดี และค่าเสียโอกาส)

- ROI: การลงทุนใน Prompt Auditor ช่วยให้บริษัทหลีกเลี่ยงเหตุการณ์ที่มีความเสี่ยงสูง และคาดว่าจะคืนทุนได้ภายใน 9–12 เดือน ขึ้นกับขนาดและความชุกของการใช้ LLM ภายในองค์กร

สรุปเชิงตัวเลขจากการติดตั้งเชิงทดลอง (Aggregated results)

- เฉลี่ยแล้วลูกค้าองค์กรที่นำ Prompt Auditor ไปใช้รายงานว่า ลดเหตุการณ์ข้อมูลรั่วได้ประมาณ 72% ภายใน 3–6 เดือน

- ลดเวลาในการตรวจสอบคำสั่งแบบแมนนวล ได้เฉลี่ย 80% ซึ่งช่วยเพิ่มความเร็วของกระบวนการและลดค่าแรง

- ในเชิง ROI ธุรกิจขนาดกลางถึงใหญ่สามารถคาดหวังการคืนทุนภายใน 6–12 เดือน และลดค่าใช้จ่ายจากการตอบเหตุการณ์ข้อมูลรั่วได้เป็นจำนวนมาก (ตัวอย่างเชิงมูลค่า: หลายล้านบาทต่อปีสำหรับองค์กรขนาดใหญ่)

ผลการใช้งานจริงแสดงให้เห็นว่า Prompt Auditor ไม่เพียงแต่เป็นเครื่องมือเชิงเทคนิคในการ sanitize ข้อมูล แต่ยังเป็นกลไกเชิงนโยบายที่แปลงความต้องการด้านความปลอดภัยขององค์กรเป็นกฎปฏิบัติอัตโนมัติ ช่วยลดความผิดพลาดจากมนุษย์ เพิ่มความคล่องตัวในการใช้ LLM ภายในกรอบความปลอดภัย และส่งผลต่อการลดความเสี่ยงทางการเงินและการปฏิบัติตามกฎระเบียบอย่างเป็นรูปธรรม

การปฏิบัติตามกฎระเบียบและการรักษาความปลอดภัย: Compliance & Certifications

บทสรุปการสนับสนุนด้านกฎระเบียบของ Prompt Auditor

Prompt Auditor ถูกออกแบบมาเพื่อให้เป็นชั้นกลางของการควบคุมที่ช่วยองค์กรแปลงคำสั่ง (prompts) และผลลัพธ์ของ LLM ให้สอดรับกับนโยบายด้านความปลอดภัยและข้อกำหนดทางกฎหมาย โดยเฉพาะในบริบทของ PDPA, GDPR และมาตรฐานสากลเช่น ISO 27001 และ SOC 2 ระบบมุ่งเน้นไปที่การสร้างหลักฐานเชิงเทคนิค (technical evidence) ที่สามารถตรวจสอบได้สำหรับการตรวจรับรองและการตอบข้อซักถามจากผู้ควบคุมดูแล (regulators) รวมถึงการลดความเสี่ยงของการเปิดเผยข้อมูลอ่อนไหว (PII)

การจัดเก็บ Audit Trail และการพิสูจน์การตรวจสอบย้อนหลัง

หนึ่งในคุณสมบัติสำคัญของ Prompt Auditor คือการเก็บ audit trail ที่ครอบคลุมทั้ง prompt ต้นทาง การดัดแปลงคำสั่ง การตอบสนองจากโมเดล เมตาดาต้า (เช่น model version, temperature, user id, timestamp) รวมถึงเวอร์ชันของนโยบายความปลอดภัยที่ถูกนำมาใช้ ทั้งหมดถูกบันทึกในรูปแบบที่พิสูจน์ความถูกต้องได้ (tamper-evident) เพื่อใช้เป็นหลักฐานในการตรวจสอบย้อนหลังและการสอบสวนเหตุการณ์ โดยฟังก์ชันที่สำคัญประกอบด้วย:

- Immutable logs — บันทึกที่ไม่สามารถแก้ไขย้อนหลังได้หรือมีการทำ hash chain/cryptographic signing เพื่อยืนยันความสมบูรณ์ของข้อมูล

- Policy change history — เก็บประวัติการเปลี่ยนแปลงนโยบาย พร้อมผู้ที่แก้ไข เหตุผล และเวลาที่อนุมัติ

- Exportable evidence — รายงานเพื่อส่งต่อให้ผู้ตรวจสอบอิสระ (auditors) ในรูปแบบมาตรฐาน พร้อม timestamps และ signatures

- Retention controls — ตั้งระยะเวลาการเก็บ (เช่น 6–24 เดือน หรือตามข้อกำหนดองค์กร) พร้อมกลไกลบอัตโนมัติตามนโยบายการรักษาข้อมูล

การช่วยตอบคำถามทางกฎหมายเกี่ยวกับการคุ้มครอง PII (PDPA/GDPR)

สำหรับ PDPA และ GDPR ความสามารถในการตอบคำถามทางกฎหมายมักขึ้นกับการแสดงให้เห็นว่าองค์กรได้ดำเนินมาตรการเชิงเทคนิคและการบริหารเพื่อคุ้มครองข้อมูลส่วนบุคคล Prompt Auditor สนับสนุนกระบวนการนี้ด้วยฟีเจอร์สำคัญ เช่น data discovery ในข้อความ (identification of PII within prompts/responses), การทำ pseudonymization/redaction อัตโนมัติ, และการทำแผนผังการไหลของข้อมูล (data flow mapping) ซึ่งช่วยให้องค์กรสามารถ:

- อธิบายต่อเจ้าหน้าที่คุ้มครองข้อมูลหรือหน่วยงานกำกับว่ามาตรการป้องกัน PII ถูกนำไปใช้ที่จุดใดบ้าง

- เตรียมหลักฐานตอบคำขอสิทธิของเจ้าของข้อมูล (DSAR) โดยแสดงว่า PII ถูกจัดการและถูกลบ/ปิดบังตามคำขอเมื่อใด

- ลดความเสี่ยงในการเรียกค่าปรับหรือมาตรการลงโทษ โดยแสดงการมีระบบตรวจสอบและควบคุมที่เป็นไปตามหลักการ Privacy by Design

ประเด็นทางกฎหมายเช่นการระบุฐานทางกฎหมายในการประมวลผล การจำกัดการเข้าถึง และการจัดการการโอนข้อมูลข้ามพรมแดน สามารถเชื่อมโยงกับบันทึกจาก Prompt Auditor เพื่อสร้างคำชี้แจงเชิงเทคนิคที่ชัดเจนต่อ PDPA/GDPR auditors

การรองรับมาตรฐานความปลอดภัยและผลต่อการตรวจรับรอง

Prompt Auditor ถูกออกแบบให้สามารถช่วยองค์กรในการปฏิบัติตามข้อกำหนดของมาตรฐานดังนี้:

- ISO 27001 — ช่วยจัดทำหลักฐานของการควบคุมด้านการจัดการเหตุการณ์, logging (A.12.4), การควบคุมการเข้าถึง (A.9) และการปฏิบัติตามกฎหมาย (A.18)

- SOC 2 — สนับสนุน Trust Services Criteria โดยเฉพาะด้าน Security และ Confidentiality ผ่านการบันทึก การควบคุมสิทธิ์ และการรายงานเหตุการณ์

- GDPR/PDPA — ช่วยจัดเตรียมหลักฐานทางเทคนิคและกระบวนการสำหรับการคุ้มครองข้อมูลส่วนบุคคล เช่น proof of pseudonymization, consent logs และ DSAR handling

ผลของการนำ Prompt Auditor มาใช้ต่อการตรวจรับรอง ได้แก่การลดเวลาในการเตรียมเอกสารสำหรับการตรวจสอบ การเพิ่มความชัดเจนของหลักฐานเชิงเทคนิค และการลดช่องว่างในการควบคุมที่มักถูกตรวจพบโดยผู้ตรวจสอบ อย่างไรก็ตาม การรับรองขึ้นกับการออกแบบกระบวนการภายในองค์กรเป็นหลัก — Prompt Auditor เป็นเครื่องมือที่ช่วยสนับสนุนการสร้างหลักฐานและการปฏิบัติ ไม่ใช่การรับรองโดยตัวมันเอง

ข้อเสนอแนะเชิงปฏิบัติ

เพื่อให้การใช้งาน Prompt Auditor สอดคล้องกับข้อกำหนดด้าน Compliance และ Certification แนะนำให้ปฏิบัติดังนี้:

- กำหนดนโยบายการเก็บบันทึกและระยะเวลาการเก็บให้สอดคล้องกับกฎหมายและความเสี่ยงทางธุรกิจ

- ผสานการบันทึกเข้ากับ SIEM/EDR เพื่อการตรวจจับเหตุการณ์แบบเรียลไทม์และการตอบโต้

- จัดทำ mapping ระหว่างนโยบายที่ระบบสร้างกับข้อกำหนด ISO 27001 / SOC 2 / GDPR / PDPA เพื่อให้ง่ายต่อการตรวจสอบ

- ฝึกอบรมทีมกฎหมายและผู้ตรวจสอบภายในเกี่ยวกับรูปแบบของหลักฐานที่ Prompt Auditor ผลิต และกระบวนการดึงข้อมูลเมื่อต้องใช้งานจริง

ด้วยการออกแบบระบบ logging ที่พิสูจน์ความสมบูรณ์ได้ การจัดการนโยบายที่โปร่งใส และการเชื่อมต่อกับกระบวนการตรวจสอบภายใน Prompt Auditor จึงเป็นเครื่องมือสำคัญในการช่วยองค์กรลดความเสี่ยงทางกฎหมายและเสริมสร้างความพร้อมต่อการตรวจรับรองความปลอดภัย

ตลาดและการแข่งขัน: ใครคือคู่แข่ง และตำแหน่งของสตาร์ทอัพไทย

ตลาดและการแข่งขัน: ใครคือคู่แข่ง และตำแหน่งของสตาร์ทอัพไทย

เมื่อพิจารณาตลาดโซลูชันตรวจสอบคำสั่ง (Prompt Governance/Prompt Auditing) สำหรับการใช้งาน LLM ระดับองค์กร จะพบว่ามีผู้เล่นสองกลุ่มหลักที่แข่งขันกันอย่างชัดเจน: ผู้ให้บริการระดับโลกและผู้พัฒนาโซลูชันท้องถิ่น โดยแต่ละกลุ่มมีข้อได้เปรียบและข้อจำกัดที่แตกต่างกัน การประเมินเชิงเปรียบเทียบช่วยให้เห็นตำแหน่งของสตาร์ทอัพไทย—เช่น Prompt Auditor—ในบริบทของภูมิภาคเอเชียตะวันออกเฉียงใต้ (SEA)

คู่แข่งระดับโลก มักประกอบด้วยผู้ให้บริการคลาวด์และแพลตฟอร์มโมเดล (เช่น โซลูชันจากผู้ให้บริการ API รุ่นใหญ่และแพลตฟอร์ม observability/guardrails ระดับสากล) ซึ่งมีจุดแข็งด้านสเกล การอัปเดตโมเดล ความสามารถทางเทคนิคระดับสูง และการลงทุนในวิจัยความปลอดภัย ตัวอย่างคือการเสนอนโยบายด้านความเป็นส่วนตัวแบบรวมศูนย์ ออพชั่นการทำงานแบบ multi-region และเครื่องมือที่ผสานรวมกับสแต็กคลาวด์หลักๆ ได้โดยตรง ข้อจำกัดของผู้เล่นระดับโลกมักเป็นเรื่อง ความยืดหยุ่นในการปรับแต่งเพื่อตอบโจทย์ข้อกำกับดูแลท้องถิ่น รวมถึงการให้บริการหลังการขายที่ต้องอาศัยช่องทางพันธมิตรสำหรับการสนับสนุนเชิงลึกในแต่ละประเทศ

โซลูชันท้องถิ่นและสตาร์ทอัพในภูมิภาค มักชูจุดเด่นด้านการเข้าใจบริบทภาษาท้องถิ่น การปฏิบัติตามกฎหมายและข้อบังคับเฉพาะประเทศ (เช่น PDPA ในไทย) และบริการสนับสนุนลูกค้าแบบเอ็นเทอร์ไพรส์ที่เข้าถึงง่ายกว่า ตัวอย่างข้อได้เปรียบสำคัญได้แก่การให้ความช่วยเหลือด้านการปรับแต่ง prompt templates สำหรับภาษาไทย การเชื่อมต่อกับระบบภายในของธนาคารหรือหน่วยงานภาครัฐ และการเสนอ deployment แบบ on‑premises หรือ hybrid เพื่อรับประกันข้อกำหนดด้านข้อมูล ข้อจำกัดเชิงธุรกิจและเทคนิคของสตาร์ทอัพเหล่านี้มักรวมถึงทรัพยากรสำหรับ R&D ที่น้อยกว่า การเข้าถึงโมเดลขั้นสูงโดยตรงในต้นทุนที่ต่ำกว่า และการสร้างความเชื่อมั่นในแบรนด์เมื่อเทียบกับผู้เล่นระดับโลก

- ความแตกต่างด้านการปรับแต่งและการบูรณาการ: ผู้ให้บริการระดับโลกให้ SDK/API ที่มีความสามารถสูงและเครื่องมือ observability แบบสำเร็จรูป แต่การปรับแต่งเชิงลึกเพื่อตอบข้อกำกับดูแลท้องถิ่นมักต้องใช้การทำงานร่วมกับพาร์ทเนอร์ ในทางตรงกันข้าม สตาร์ทอัพไทยอย่าง Prompt Auditor สามารถนำเสนอการปรับแต่งเชิงบริบท (เช่น policy templates สำหรับภาคการเงิน/สุขภาพในไทย) และการบูรณาการระบบภายในอย่างรวดเร็ว

- จุดแข็งเชิงเทคนิค: Prompt Auditor อาจเด่นด้านการรองรับรูปแบบการตรวจสอบแบบเฉพาะเจาะจง (policy-as-code ที่แปลเป็นกฎความปลอดภัยอัตโนมัติ), การสนับสนุนภาษาไทยและสคริปต์ท้องถิ่น, และตัวเลือก deployment ที่ยืดหยุ่น (on‑prem/hybrid)

- จุดอ่อนเชิงเทคนิค: เมื่อเทียบกับแพลตฟอร์มสากล อาจมีข้อจำกัดด้านประสิทธิภาพเมื่อสเกลสูง, การเข้าถึงโมเดลที่เป็น state‑of‑the‑art โดยตรง และ ecosystem ของ integrations ที่ยังไม่ครบถ้วน

- จุดแข็งเชิงธุรกิจ: ความเข้าใจข้อกำหนดทางกฎหมายไทย การให้บริการแบบเอ็นเทอร์ไพรส์ (SLA, onsite support, consultancy) และความสัมพันธ์กับลูกค้าองค์กรภายในประเทศ

- จุดอ่อนเชิงธุรกิจ: ขอบเขตตลาดภายในประเทศจำกัด ความเสี่ยงจากการแข่งขันราคาจากผู้ให้บริการระดับโลก และความท้าทายในการขยายสู่ตลาดต่างประเทศโดยไม่มีพาร์ทเนอร์เชิงกลยุทธ์

ในแง่ของโอกาสตลาดในภูมิภาค SEA, หลายองค์กรกำลังเริ่มนำ LLM มาใช้ในงานเอกสารภายใน การบริการลูกค้า และการวิเคราะห์ข้อมูล ทำให้ความต้องการเครื่องมือที่ช่วยลดความเสี่ยงการรั่วไหลของข้อมูลและการปฏิบัติตามกฎระเบียบเพิ่มสูงขึ้น โดย โอกาสเชิงพาณิชย์สำหรับ Prompt Auditor อยู่ที่การวางตำแหน่งเป็นโซลูชันที่ปรับแต่งได้ (customizable) และให้บริการแบบครบวงจรสำหรับเอ็นเทอร์ไพรส์ — ทั้งในด้านการขายแบบ subscription, ค่าใช้จ่ายตามปริมาณการเรียก API (per-call), และบริการเชิงวิชาชีพ (professional services) เพื่อการติดตั้งและปรับแต่ง

ประเด็นที่ต้องพิจารณาเชิงกลยุทธ์มีดังนี้:

- โมเดลธุรกิจ: การผสมระหว่าง subscription สำหรับฐานการตรวจสอบทั่วไป กับบริการเสริมแบบ pay‑per‑use หรือ professional services จะช่วยรักษารายได้และตอบโจทย์ลูกค้าที่ต้องการการสนับสนุนเฉพาะด้าน

- การตั้งราคา: ตลาด SEA มีความอ่อนไหวต่อราคา—สตาร์ทอัพต้องเสนอคุณค่าเชิงธุรกิจที่ชัดเจน (เช่น ลดความเสี่ยงฟีซแค่ครั้งเดียว เทียบกับความเสียหายจากการรั่วไหลของข้อมูล) และมี tier ที่ยืดหยุ่นสำหรับกลุ่มธุรกิจขนาดกลางถึงใหญ่

- ความสามารถขยายตลาด (scalability): ทางเทคนิคต้องรองรับ multi‑tenant architecture และการเชื่อมต่อกับระบบคลาวด์รายใหญ่อย่างปลอดภัย รวมถึงมีทางเลือก on‑prem/hybrid เพื่อขยายสู่ธนาคารและหน่วยงานที่มีข้อจำกัดด้านข้อมูล การขยายเชิงภูมิศาสตร์ควรเริ่มจากประเทศในภูมิภาคที่มีกฎระเบียบคล้ายคลึงก่อน เช่น สิงคโปร์และมาเลเซีย แล้วค่อยขยายต่อ

สรุปแล้ว Prompt Auditor ในฐานะสตาร์ทอัพไทยมีตำแหน่งที่แข็งแกร่งในเรื่องการปรับแต่งตามข้อกำหนดท้องถิ่น การให้บริการระดับเอ็นเทอร์ไพรส์ และความคุ้นเคยกับบริบทภาษาและธุรกิจในภูมิภาค อย่างไรก็ตาม การต่อสู้กับผู้เล่นระดับโลกต้องอาศัยการสรรหาพันธมิตรเชิงเทคนิค การลงทุนในผลิตภัณฑ์เพื่อให้สเกลได้ และการออกแบบโมเดลธุรกิจที่ยืดหยุ่นเพื่อรักษาอัตราการเติบโตและการแข่งขันในตลาด SEA ที่กำลังเร่งตัวขึ้น

คำแนะนำและแนวทางปฏิบัติสำหรับองค์กรที่กำลังพิจารณาใช้

คำแนะนำและแนวทางปฏิบัติสำหรับองค์กรที่กำลังพิจารณาใช้

การนำเครื่องมือ Prompt Auditor มาใช้ในระดับองค์กรจำเป็นต้องมีกรอบปฏิบัติการที่เป็นระบบและเป็นขั้นเป็นตอน เพื่อให้ได้ประโยชน์ด้านความปลอดภัยโดยไม่รบกวนการทำงานของทีมธุรกิจ แนะนำให้เริ่มด้วยการจัด PoC (Proof-of-Concept) ขนาดเล็กถึงขนาดกลางที่ครอบคลุม workload สำคัญและทีมที่มีความเสี่ยงสูง เช่น ทีมบริการลูกค้า (ที่อาจป้อนข้อมูลลูกค้าที่เป็นความลับ) ทีมทรัพยากรบุคคล (ที่จัดการข้อมูลบุคคล) และทีมพัฒนาที่ทดสอบโมเดล AI โดยระยะเวลา PoC แนะนำเป็นช่วง 6–12 สัปดาห์ เพื่อเก็บข้อมูลเชิงปริมาณและเชิงคุณภาพ เช่น อัตราการตรวจจับคำสั่งเสี่ยง, อัตรา false positive/false negative และผลกระทบต่อเวลาทำงานจริง

ขั้นตอน PoC ควรประกอบด้วย:

- กำหนดขอบเขตและเป้าหมาย — ระบุระบบและทีมที่เข้าร่วม, ชนิดของ prompts ที่ต้องตรวจสอบ, กรอบเวลาทดลอง และเกณฑ์ความสำเร็จเชิงปริมาณ (เช่น ลดเหตุการณ์คำสั่งเสี่ยง 40% ภายใน 3 เดือน หรือ MTTR ≤ 48 ชั่วโมง)

- ตั้งค่า default policies แบบ conservative — เริ่มด้วยนโยบายที่เคร่งครัดเพื่อลดความเสี่ยง เช่น บล็อก/กักกันการส่งคำขอที่มี PII, คีย์ลับ, หรือคำขอที่พยายาม extract ข้อมูลภายในองค์กร แล้วค่อยปรับลดความเข้มข้นตามผลการทดสอบ

- ออกแบบ human-in-the-loop — สำหรับเหตุการณ์ที่ระบบตรวจจับแล้วไม่แน่ใจ (possible false positives) ให้มีขั้นตอนการรีวิวโดยผู้เชี่ยวชาญ เช่น เจ้าหน้าที่ความปลอดภัยหรือทีม ML Ops ที่สามารถอนุมัติ/ปฏิเสธและป้อนกลับไปยัง policy engine

- บันทึกและวัดผล — เปิดการบันทึก (logging) และส่งเมทริกส์ไปยังระบบ SIEM/Monitoring เพื่อวิเคราะห์แนวโน้มและสร้างรายงานสำหรับผู้บริหาร

เมื่อตัดสินใจขยายการใช้งาน ต้องมีมาตรการควบคุมเชิงป้องกันและการบริหารจัดการอย่างชัดเจน ได้แก่ การจัดการสิทธิการเข้าถึง (RBAC/ABAC), การเข้ารหัสข้อมูลที่ไหลผ่าน, การกำหนดระยะเวลาการเก็บล็อก และการบูรณาการกับระบบ Governance เช่น DLP, IAM และ Incident Response Playbook นอกจากนี้ ควรมีการทบทวนนโยบายอย่างน้อยไตรมาสละครั้ง และมีกระบวนการอัปเดต policy อย่างรวดเร็วเมื่อตรวจพบช่องโหว่หรือรูปแบบการโจมตีใหม่

การอบรมพนักงานและการเปลี่ยนแปลงวัฒนธรรมเป็นปัจจัยสำคัญ: จัดอบรมสำหรับ 3 กลุ่มหลัก — ผู้บริหาร (awareness และผลกระทบเชิงกลยุทธ์), ทีม technical (ML Ops/DevSecOps วิธีการตั้งค่าและตอบโต้), และผู้ใช้ทั่วไป (แนวทางการเขียน prompt ปลอดภัย) โดยรูปแบบการฝึกอบรมควรรวมถึงการฝึกปฏิบัติ (hands-on), กรณีตัวอย่างจริง, และแบบทดสอบวัดความเข้าใจ ควรกำหนดรอบการอบรมซ้ำทุก 6–12 เดือนและเมื่อมีการปรับนโยบายสำคัญ

สำหรับการวัดความสำเร็จ ให้กำหนด KPI ที่ชัดเจนและวัดได้ ตัวอย่าง KPI แนะนำประกอบด้วย:

- Reduction in sensitive prompt incidents — เปรียบเทียบจำนวนเหตุการณ์คำสั่งที่เสี่ยง (เช่น ส่ง PII หรือคำขอเผยข้อมูลภายใน) ก่อนและหลังใช้งาน ตัวอย่างเป้าหมายเชิงตัวอย่าง: ลด 40–60% ภายใน 3 เดือน

- Mean Time to Remediate (MTTR) — เวลาตั้งแต่ระบบแจ้งเตือนจนถึงการแก้ไขหรืออนุมัติ เป็นตัวชี้วัดประสิทธิภาพการตอบสนอง เป้าหมายตัวอย่าง: ≤ 48 ชั่วโมงสำหรับเหตุการณ์ระดับกลาง, ≤ 4 ชั่วโมงสำหรับเหตุฉุกเฉิน

- False positive / false negative rates — ติดตามสัดส่วนการแจ้งเตือนที่ต้องรีวิวโดยมนุษย์เพื่อปรับสมดุลระหว่างความปลอดภัยกับการรบกวนการทำงาน

- Policy coverage and compliance — เปอร์เซ็นต์ของระบบ/ทีมที่อยู่ภายใต้นโยบาย Prompt Auditor และสอดคล้องกับข้อกำหนดทางกฎหมายหรือมาตรฐานภายใน

- User impact metrics — วัดผลกระทบต่อ productivity เช่น เพิ่มเวลาเฉลี่ยต่อ task หรือจำนวนครั้งที่ผู้ใช้ร้องขอการยกเลิกการบล็อก

สุดท้าย ควรจัดตั้งคณะกรรมการข้ามหน่วยงาน (cross-functional steering committee) ที่ประกอบด้วย CISO, หัวหน้า ML Ops, ตัวแทนฝ่ายกฎหมาย/ความเป็นส่วนตัว และผู้บริหารจากหน่วยธุรกิจ เพื่อกำกับทิศทางการใช้งาน การกำหนดระดับความเสี่ยงที่ยอมรับได้ และการตัดสินใจด้านงบประมาณสำหรับการขยายระบบ บทเรียนสำคัญจากการนำไปใช้จริงคือการเริ่มแบบค่อยเป็นค่อยไป ใช้นโยบายเริ่มต้นที่ระมัดระวัง และปรับตามข้อมูลเชิงปริมาณที่ได้จาก PoC และการวัด KPI อย่างต่อเนื่อง

บทสรุป

Prompt Auditor เป็นโซลูชันสำหรับองค์กรที่ออกแบบมาเพื่อตอบโจทย์ความเสี่ยงจากการใช้ LLM โดยอัตโนมัติ — แปลงคำสั่ง (prompts) เป็นนโยบายความปลอดภัยที่บังคับใช้ได้จริง เพิ่มการปกป้องข้อมูลและรองรับการตรวจสอบย้อนหลัง (audit trail) เพื่อป้องกันการรั่วไหลหรือการเปิดเผยข้อมูลที่ไม่เหมาะสม ตัวอย่างการใช้งาน ได้แก่ การจับคู่ prompt ที่มีข้อมูลส่วนบุคคลกับกฎห้ามส่งออกข้อมูล การบล็อคคำสั่งที่พยายามเข้าถึงฐานข้อมูลภายใน และการสร้างล็อกเหตุการณ์สำหรับทีมความปลอดภัย การสำรวจในอุตสาหกรรมชี้ว่าองค์กรกว่า 6 ใน 10 กังวลเกี่ยวกับความเสี่ยงการรั่วไหลของข้อมูลเมื่อใช้ LLM จึงทำให้โซลูชันประเภทนี้มีความจำเป็นเชิงปฏิบัติสูง

ก่อนนำไปใช้งานจริง องค์กรควรประเมินทั้งเชิงเทคนิคและเชิงนโยบายโดยเริ่มจากการทำ PoC แบบมีขอบเขตชัดเจน และตั้งค่า human-in-the-loop เพื่อทดสอบและปรับกฎ ลดความเสี่ยงจากการบล็อกผิดพลาดหรือ false positive การประเมินควรรวมการทดสอบร่วมกับระบบ SIEM/DLP และการตรวจสอบให้สอดคล้องกับกรอบกฎหมายและมาตรฐานคุ้มครองข้อมูลในแต่ละอุตสาหกรรม ในระยะยาวคาดว่าจะเห็นการรวมเครื่องมือประเภทนี้เข้าเป็นส่วนหนึ่งของสแต็กความปลอดภัยขององค์กร การเพิ่มขึ้นของกฎระเบียบด้าน AI และการพัฒนา LLM ที่โปร่งใสมากขึ้นจะทำให้โซลูชันอย่าง Prompt Auditor มีบทบาทสำคัญทั้งในเชิงปฏิบัติและเชิงกำกับดูแล