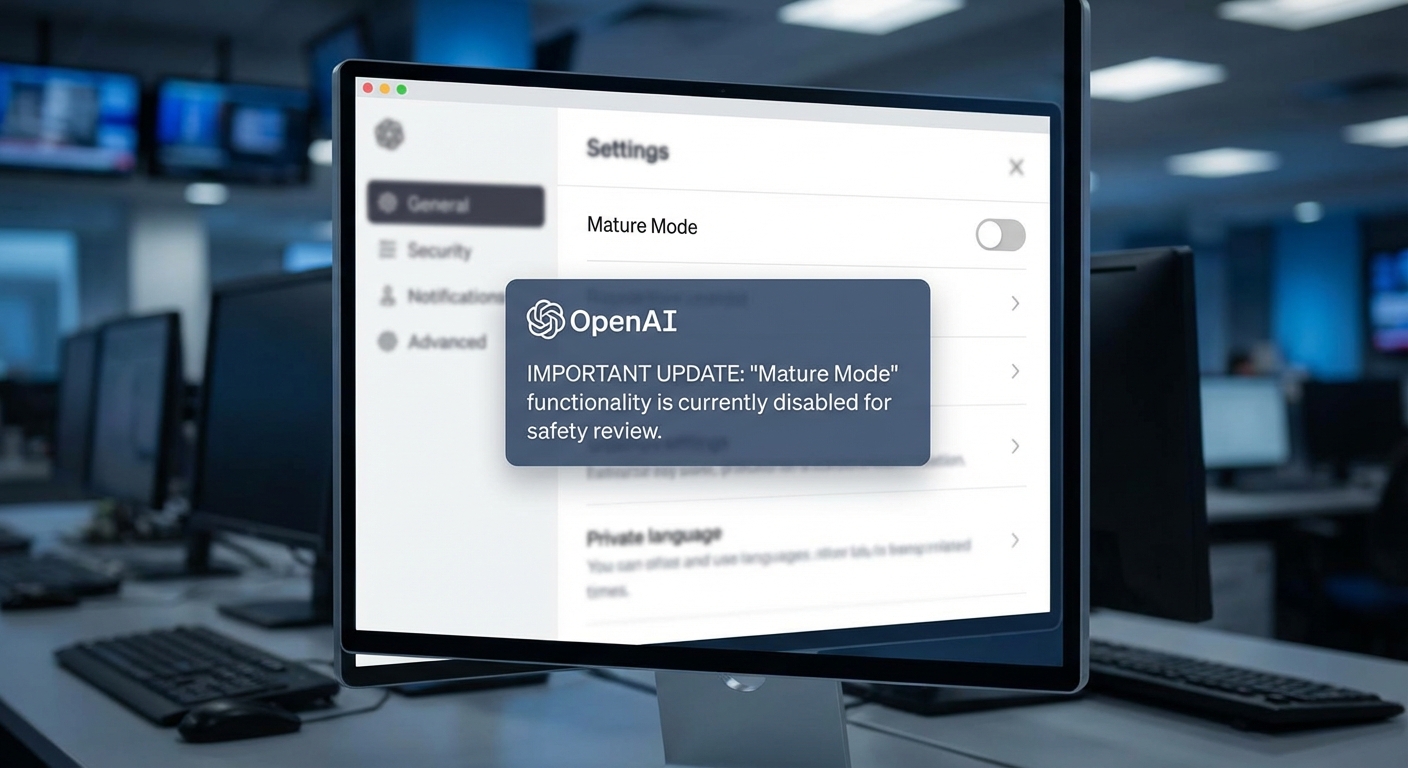

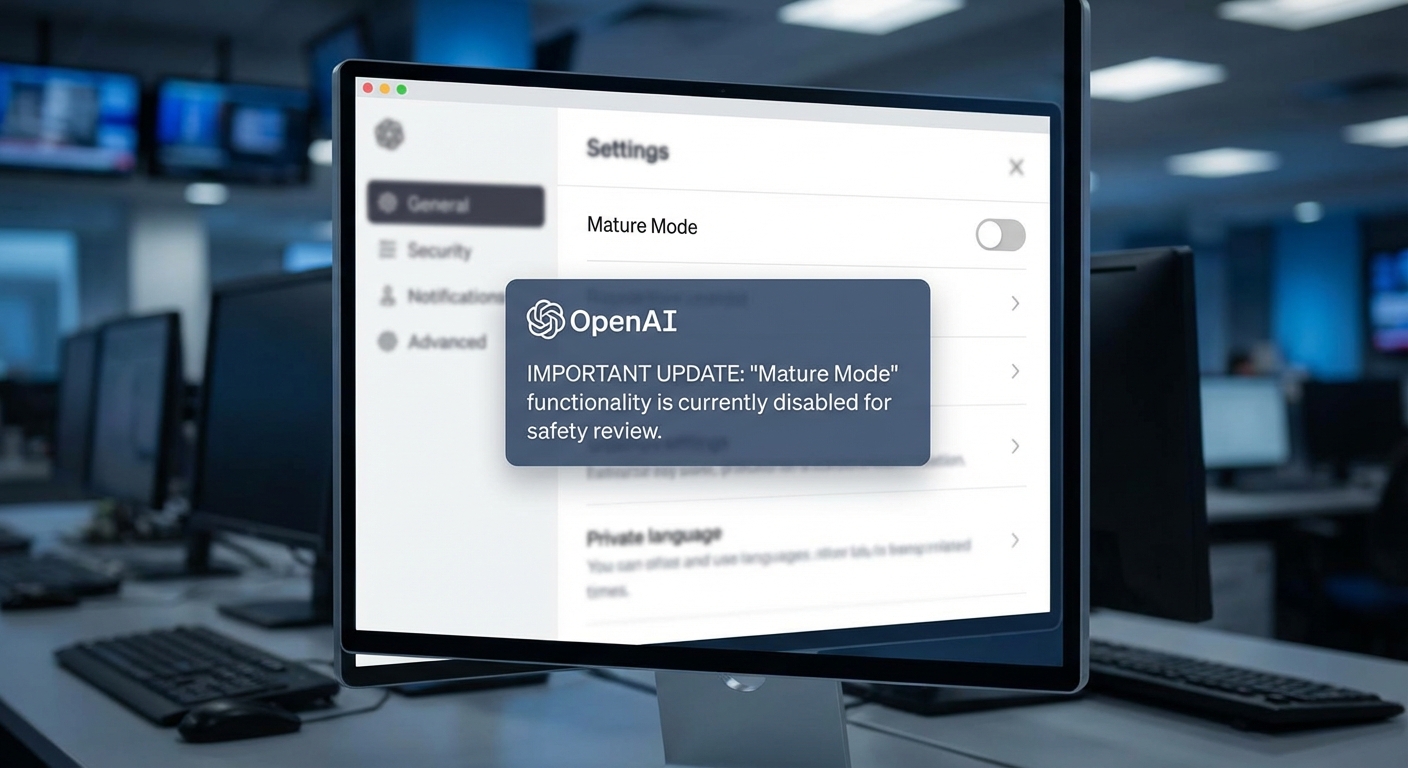

การประกาศล่าสุดจาก OpenAI ที่แจ้งว่าเลื่อนการเปิดใช้งานโหมด "ผู้ใหญ่" ใน ChatGPT ได้สร้างความสนใจและคำถามในวงการเทคโนโลยีอย่างกว้างขวาง โดยบริษัทระบุเหตุผลชัดเจนว่าต้องจัดลำดับความสำคัญของงานที่สำคัญกว่า ทั้งการรับประกันความปลอดภัย การปฏิบัติตามกฎระเบียบ และการลดความเสี่ยงทางจริยธรรม ก่อนนำฟีเจอร์ที่อ่อนไหวออกสู่ผู้ใช้ในวงกว้าง ขณะที่ผู้ใช้จำนวนหลายสิบล้านรายและนักพัฒนาที่เฝ้ารอการขยายความสามารถของโมเดลต้องติดตามผลกระทบจากการเลื่อนนี้อย่างใกล้ชิด

บทความฉบับนี้จะวิเคราะห์อย่างรอบด้านถึงความหมายของการตัดสินใจครั้งนี้ ตั้งแต่ผลกระทบต่อผู้พัฒนาแอปพลิเคชันและชุมชนนักวิจัย ไปจนถึงประสบการณ์ของผู้ใช้และทิศทางของอุตสาหกรรม AI โดยนำเสนอไทม์ไลน์ที่เกี่ยวข้อง ตัวอย่างกรณีศึกษา และมุมมองจากคู่แข่งที่อาจได้ประโยชน์หรือปรับตัวจากการชะลอนี้ เพื่อช่วยให้ผู้อ่านเข้าใจความสมดุลระหว่างนวัตกรรมกับความรับผิดชอบที่กำลังกำหนดทิศทางอนาคตของเทคโนโลยีปัญญาประดิษฐ์

สรุปข่าวทันที (Quick Summary)

สรุปข่าวทันที (Quick Summary)

OpenAI ประกาศเลื่อนการเปิดใช้งานฟีเจอร์ที่เรียกว่า "โหมดผู้ใหญ่" สำหรับ ChatGPT ออกไป โดยระบุว่าการเปิดตัวจะไม่เกิดขึ้นตามแผนที่เคยวางไว้และยังไม่มีการกำหนดวัน/เวลาที่ชัดเจนสำหรับการเปิดให้ใช้งานอีกครั้งในขณะนี้

ในคำชี้แจงอย่างเป็นทางการ บริษัทระบุว่าการตัดสินใจครั้งนี้มาจากการจัดลำดับความสำคัญของทรัพยากรในการพัฒนาผลิตภัณฑ์และความจำเป็นในการเสริมมาตรการด้านความปลอดภัย OpenAI เน้นว่าการปรับเลื่อนครั้งนี้เพื่อให้แน่ใจว่าฟีเจอร์ใหม่จะสอดคล้องกับนโยบายการใช้งานและมาตรฐานความปลอดภัยก่อนการเปิดให้สาธารณะ

ผลทันทีจากการประกาศคือ ฟีเจอร์ดังกล่าวยังไม่สามารถใช้งานได้ทั้งสำหรับผู้ใช้ทั่วไปและนักพัฒนา และจะถูกระงับจนกว่าจะมีประกาศอย่างเป็นทางการจาก OpenAI เกี่ยวกับวันเปิดตัวใหม่ โดยบริษัทสัญญาว่าจะสื่อสารความคืบหน้าเมื่อมีข้อมูลเพิ่มเติม

สำหรับผู้ที่ติดตามการพัฒนาเชิงธุรกิจและการนำไปใช้ในองค์กร ข้อความสำคัญคือการเลื่อนครั้งนี้อาจส่งผลต่อแผนการทดสอบหรือบูรณาการที่อาศัยฟีเจอร์ดังกล่าวในระยะสั้น แต่ OpenAI ระบุว่าได้ให้ความสำคัญกับการปรับปรุงความเสถียร ความปลอดภัย และฟีเจอร์หลักอื่นๆ ของแพลตฟอร์มก่อนที่จะนำฟีเจอร์นี้กลับมาพิจารณาอีกครั้ง

- เหตุการณ์: OpenAI ประกาศเลื่อนเปิดโหมด 'ผู้ใหญ่' สำหรับ ChatGPT

- คำชี้แจงจากบริษัท: สาเหตุหลักมาจากการจัดลำดับความสำคัญของทรัพยากรและความปลอดภัย

- ผลทันที: ฟีเจอร์ยังไม่ใช้งานสำหรับผู้ใช้และนักพัฒนจนกว่าจะมีประกาศใหม่

เบื้องหลังและไทม์ไลน์ของฟีเจอร์

เบื้องหลังของแนวคิดโหมด "ผู้ใหญ่" และการประกาศเริ่มต้น

แนวคิดฟีเจอร์โหมด "ผู้ใหญ่" เกิดขึ้นจากความต้องการของผู้ให้บริการแพลตฟอร์มในการจัดการเนื้อหาที่อาจไม่เหมาะสมสำหรับผู้เยาว์ และเพื่อให้ผู้ใช้ที่เป็นผู้ใหญ่สามารถเข้าถึงการสื่อสารหรือเนื้อหาบางประเภทได้อย่างมีความรับผิดชอบมากขึ้น โดยหลักการจะรวมการระบุอายุ (age gating) การติดป้ายประเภทเนื้อหา (content labeling) และการใช้ตัวกรองเชิงบริบทเพื่อควบคุมการแสดงผล OpenAI เปิดเผยแนวคิดและแผนการพัฒนาฟีเจอร์ในช่องทางสื่อสารสาธารณะของบริษัท เช่น บล็อกโพสต์และประกาศผ่านบัญชีโซเชียลมีเดีย เพื่อชี้แจงทิศทางการทำงานและความสำคัญด้านความปลอดภัยของผู้ใช้

คุณสมบัติที่คาดว่าจะรวมอยู่ในโหมดผู้ใหญ่

ตามการสื่อสารของฝั่งผู้พัฒนา ฟีเจอร์นี้ถูกออกแบบให้มีองค์ประกอบหลักหลายด้านเพื่อสร้างสมดุลระหว่างการเข้าถึงเนื้อหาของผู้ใหญ่และการคุ้มครองผู้ใช้อ่อนไหว ซึ่งรวมถึง:

- การยืนยันอายุ (Age verification) — กลไกที่ช่วยแยกผู้ใช้ที่เป็นผู้ใหญ่จากผู้ใช้ที่อายุต่ำกว่ากำหนด โดยอาจใช้การยืนยันผ่านบัญชีหรือขั้นตอนการตรวจสอบหลายชั้น

- การระบุประเภทเนื้อหา (Content labeling) — การติดป้ายหรือแท็กเนื้อหาเพื่อระบุว่าเป็นเนื้อหาสำหรับผู้ใหญ่ ซึ่งช่วยให้ระบบและผู้ใช้สามารถตัดสินใจแสดงหรือซ่อนเนื้อหาได้

- ตัวกรองเชิงบริบท (Contextual filters) — ฟิลเตอร์ที่พิจารณาบริบทของการสนทนา เพื่อลดโอกาสการบล็อคเนื้อหาที่ไม่เป็นอันตรายในทางเทคนิค แต่อาจถูกแท็กผิดพลาด

- การควบคุมโดยผู้ใช้ (User controls) — เมนูหรือการตั้งค่าที่ให้ผู้ใช้ปรับระดับการคัดกรองหรือเปิด/ปิดโหมดผู้ใหญ่ตามความเหมาะสม

กระบวนการทดสอบและความท้าทายเชิงเทคนิค

การพัฒนาและทดสอบโหมดผู้ใหญ่ต้องผ่านหลายขั้นตอน ตั้งแต่การทดสอบภายใน (internal alpha) ไปสู่การทดลองภายนอกแบบจำกัด (closed beta) และการทดสอบแบบเปิด (open beta) เพื่อรวบรวมฟีดแบ็กด้านประสิทธิภาพและผลกระทบต่อผู้ใช้ ในขั้นตอนเหล่านี้ ทีมพัฒนาต้องเผชิญกับความท้าทายสำคัญ เช่น การปรับแต่งโมเดลให้แยกแยะความแตกต่างระหว่างเนื้อหาด้านการศึกษา/การแพทย์กับเนื้อหาที่ไม่เหมาะสม, ปัญหา false positives/false negatives ในการตรวจจับเนื้อหา, และผลกระทบทางกฎหมายหรือจริยธรรมจากการยืนยันอายุ

ตัวอย่างที่เคยเกิดขึ้นในอุตสาหกรรม: แพลตฟอร์มต่าง ๆ รายงานว่าเมื่อนำตัวกรองมาใช้งานจริง อัตราการตรวจจับผิด (false positives) อาจอยู่ในระดับที่ส่งผลต่อประสบการณ์ผู้ใช้ ทำให้ทีมต้องปรับเกณฑ์และเพิ่มชุดข้อมูลการฝึก (training data) เพื่อปรับสมดุลระหว่างความปลอดภัยและความสามารถในการใช้งาน

ไทม์ไลน์การพัฒนาและการเลื่อนการเปิดใช้งาน

ไทม์ไลน์มาตรฐานของฟีเจอร์ประเภทนี้มักเป็นลำดับขั้นดังนี้: การออกแบบแนวคิด → พัฒนาเบื้องต้น → ทดสอบภายใน (alpha) → ทดสอบภายนอกแบบจำกัด (beta) → เปิดให้สาธารณะ ในกรณีโหมดผู้ใหญ่ของ ChatGPT ทาง OpenAI รายงานการเดินหน้าไปยังขั้นตอนทดสอบภายในและมีแผนที่จะเปิดให้กลุ่มผู้ใช้จำกัดทดลองใช้งานก่อนการเปิดตัวสู่สาธารณะ แต่ระหว่างทางมีการประเมินใหม่และตัดสินใจเลื่อนการเปิดตัวเพื่อให้ความสำคัญกับเรื่องความปลอดภัยและฟีเจอร์ที่มีผลกระทบเชิงธุรกิจมากกว่า

- ช่วงออกแบบเบื้องต้น — ระบุสเปกและข้อกำหนดด้านความปลอดภัย

- การทดสอบภายใน — ทดสอบการประเมินอายุ การติดป้าย และตัวกรองบริบท ปรับเกณฑ์ตามผลการทดลอง

- แผนเปิดตัวแบบจำกัด — เตรียมกลุ่มผู้ใช้เบต้าจำนวนจำกัดเพื่อเก็บฟีดแบ็กเชิงปฏิบัติการ

- การเลื่อนออกไป — ตัดสินใจชะลอการเปิดตัวหลังพบปัญหาด้านความแม่นยำ การยืนยันอายุ หรือเพื่อให้โฟกัสทรัพยากรไปยังฟีเจอร์ที่สำคัญกว่าในระยะสั้น

การเลื่อนดังกล่าวมีร่องรอยการสื่อสารผ่านช่องทางสาธารณะของ OpenAI เช่นการอัปเดตบล็อกโพสต์และข้อความในสื่อสังคมออนไลน์ที่ชี้แจงเหตุผลเชิงนโยบายและด้านเทคนิค ซึ่งบริษัทมักเน้นย้ำว่าการชะลอเป็นการดำเนินการเชิงรอบคอบเพื่อป้องกันผลกระทบเชิงลบต่อผู้ใช้และสังคมโดยรวม

บทสรุปเชิงเวลาและผลกระทบต่อแผนผลิตภัณฑ์

โดยสรุป การพัฒนาฟีเจอร์โหมดผู้ใหญ่เป็นกระบวนการที่ต้องใช้เวลาและการทดสอบเชิงลึก การประกาศและแผนเปิดตัวในขั้นแรกอาจถูกปรับเปลี่ยนหรือเลื่อนออกไปเมื่อตรวจพบช่องโหว่ด้านความปลอดภัยหรือปัญหาทางเทคนิค ในบริบทของแผนการพัฒนาผลิตภัณฑ์ของ OpenAI การตัดสินใจเลื่อนมักสะท้อนถึงการให้ความสำคัญกับการนำทรัพยากรไปสู่ฟีเจอร์ที่มีความจำเป็นเชิงธุรกิจหรือด้านความปลอดภัยมากกว่า ซึ่งส่งผลให้ไทม์ไลน์สาธารณะขยับและทำให้การสื่อสารกับผู้ใช้เป็นประเด็นที่ต้องจัดการอย่างโปร่งใสและต่อเนื่อง

เหตุผลที่ OpenAI เลือกเลื่อน — จัดลำดับความสำคัญงานสำคัญ

เหตุผลที่ OpenAI เลือกเลื่อน — จัดลำดับความสำคัญงานสำคัญ

การตัดสินใจเลื่อนการเปิดตัวโหมด 'ผู้ใหญ่' สำหรับ ChatGPT สะท้อนถึงการจัดลำดับความสำคัญเชิงยุทธศาสตร์ที่ชัดเจนของ OpenAI ในช่วงเวลาที่บริษัทต้องบริหารทรัพยากรทั้งด้านวิศวกรรม การปฏิบัติตามกฎระเบียบ และการสร้างรายได้อย่างยั่งยืน โดยเฉพาะเมื่อต้องชั่งน้ำหนักระหว่างการพัฒนา ฟีเจอร์ระดับองค์กร (enterprise features) ซึ่งมักมีมูลค่าทางธุรกิจสูงและต้องการมาตรฐานความน่าเชื่อถือ (SLA), กับฟีเจอร์เฉพาะกลุ่มที่มีความเสี่ยงด้านเนื้อหา การผลักดันทรัพยากรไปยังงานที่ให้ผลเชิงพาณิชย์และเชิงปฏิบัติการทันทีจึงเป็นทางเลือกที่สมเหตุสมผลในมุมมองธุรกิจ

ในมิติด้านความปลอดภัยและการควบคุมเนื้อหา การเปิดโหมดที่อนุญาตเนื้อหาสำหรับผู้ใหญ่จะต้องเผชิญกับความซับซ้อนด้านนโยบายและเทคนิคที่สูงขึ้น เช่น การนิยามขอบเขตของเนื้อหาที่ยอมรับได้ การจัดการกับกรณีที่เกี่ยวข้องกับการยินยอม การป้องกันการล่วงละเมิด และการบูรณาการระบบตรวจสอบอัตโนมัติร่วมกับการตรวจสอบโดยมนุษย์ การออกแบบตัวกรองที่มีความแม่นยำสูงเพื่อลดทั้งอัตรา false positive และ false negative จำเป็นต้องใช้การวิจัยและการทดสอบจำนวนมาก ซึ่งมีผลต่อเวลาเปิดตัวและต้นทุนการดำเนินการอย่างมีนัยสำคัญ นอกจากนี้ ภายใต้ภูมิทัศน์กฎระเบียบที่เข้มงวดในหลายภูมิภาค ผลิตภัณฑ์ที่เปิดช่องให้มีเนื้อหาสำหรับผู้ใหญ่ยังเพิ่มความเสี่ยงทางกฎหมายและความรับผิดชอบ (liability) ต่อผู้ให้บริการ

การทดสอบเพิ่มเติมเป็นปัจจัยสำคัญที่ทำให้การเปิดตัวถูกเลื่อนออกไป โดย OpenAI จำเป็นต้องดำเนินการทดสอบเชิงรุก (red teaming), การทดสอบภาคสนามในกลุ่มผู้ใช้จำกัด, และการประเมินผลระยะยาวเพื่อสังเกตผลกระทบต่อพฤติกรรมผู้ใช้และความเสี่ยงที่อาจเกิดขึ้น การทดสอบเหล่านี้ไม่ได้จำกัดเพียงการวัดความถูกต้องของโมเดลเท่านั้น แต่ยังรวมถึงการประเมินระบบการรายงานและการอุทธรณ์ การประเมินภาระงานของทีม moderator และการจำลองสถานการณ์ทางกฎหมาย การดำเนินการทดสอบอย่างรอบคอบช่วยลดโอกาสเกิดเหตุการณ์ที่อาจนำไปสู่การฟ้องร้อง การปรับชื่อเสียง หรือการแทรกแซงจากหน่วยงานกำกับดูแล ซึ่งต้นทุนของเหตุการณ์เชิงลบเหล่านี้มักสูงกว่าต้นทุนการเลื่อนการเปิดตัวในระยะสั้น

อีกปัจจัยที่มักได้รับการพิจารณาอย่างเข้มงวดคือ ความน่าเชื่อถือ (reliability) และต้นทุน (cost) ของการให้บริการในระดับสเกลเมื่อเพิ่มความซับซ้อนของนโยบายเนื้อหา ระบบกรองที่ซับซ้อนและทีมตรวจสอบที่ขยายตัวจะเพิ่มค่าใช้จ่ายต่อผู้ใช้และอาจส่งผลกระทบต่อ latency และอัตราการให้บริการที่เสถียร การให้ความสำคัญกับการปรับปรุงความเสถียรของระบบ การปรับปรุงประสิทธิภาพต้นทุน และการเปิดตัวฟีเจอร์ที่ตอบโจทย์ลูกค้าองค์กรจึงมักถูกวางไว้ก่อน เพื่อรักษาความเชื่อมั่นของลูกค้าองค์กรและรายได้ในระยะยาว

โดยสรุป การเลื่อนเปิดโหมด 'ผู้ใหญ่' เป็นการตัดสินใจเชิงยุทธศาสตร์ที่มาจากการประเมินสมดุลระหว่างผลประโยชน์เชิงธุรกิจ ความเสี่ยงด้านความปลอดภัยและกฎหมาย รวมถึงความจำเป็นในการทดสอบเชิงลึกเพื่อปกป้องทั้งผู้ใช้และองค์กร การเลื่อนเวลานี้จึงเป็นการเลือกจัดลำดับความสำคัญของงานที่สำคัญกว่าในบริบทปัจจุบัน ทั้งเพื่อความยั่งยืนของผลิตภัณฑ์และการลดความเสี่ยงเชิงระบบในระยะยาว

ผลกระทบต่อผู้ใช้ทั่วไป นักพัฒนา และธุรกิจ

ผลกระทบต่อผู้ใช้ทั่วไป นักพัฒนา และธุรกิจ

การเลื่อนเปิดใช้งานโหมด ผู้ใหญ่ ของ ChatGPT ส่งผลกระทบในระดับต่าง ๆ ขึ้นกับบทบาทและความคาดหวังของผู้ใช้งาน สำหรับผู้ใช้ทั่วไปที่รอใช้ฟีเจอร์นี้ การเลื่อนอาจสร้างความไม่สะดวกทั้งในแง่ของประสบการณ์การใช้งานและการวางแผนคอนเทนต์ โดยเฉพาะกลุ่มครีเอเตอร์ที่ผลิตเนื้อหาสำหรับผู้ใหญ่หรือเนื้อหาที่ต้องการการทดสอบความไวต่อบริบท (context-sensitive content) จะได้รับผลกระทบโดยตรง ตัวอย่างสมมติ: หากสมมติว่ามีผู้ใช้เฉพาะกลุ่มซึ่งต้องการฟีเจอร์นี้คิดเป็น 10–18% ของผู้ใช้ที่มีการตั้งค่าพิเศษ การเลื่อนอาจทำให้เกิดการชะลอการสร้างสรรค์ผลงาน ปฏิทินการปล่อยคอนเทนต์ล่าช้า และอาจนำไปสู่การมองหาทางเลือกอื่น (เช่นแพลตฟอร์มอื่นหรือซอฟต์แวร์ทดแทน)

สำหรับนักพัฒนา ผลกระทบเชิงปฏิบัติจะชัดเจนในด้านแผนงาน (roadmap) และการออกแบบผลิตภัณฑ์ที่ผสานฟีเจอร์นี้ไว้เป็นส่วนหนึ่งของบริการ รายละเอียดที่ควรพิจารณา ได้แก่:

- เลื่อนหรือปรับ roadmap: ฟีเจอร์ที่วางแผนจะเปิดตัวพร้อมโหมดผู้ใหญ่อาจต้องเลื่อนไป โดยนักพัฒนาควรประเมินผลกระทบด้านรายได้และเวลาพัฒนาใหม่

- ทางเลือกชั่วคราวผ่าน API: ใช้ชุดเครื่องมือจาก API ที่มี เพื่อสร้างฟีเจอร์จำลอง เช่นการกรองข้อความด้วยกฎที่เข้มงวดขึ้น หรือใช้โมเดลเฉพาะงาน (fine-tuned) ที่ควบคุมเนื้อหาได้เอง เป็นวิธีบรรเทาแต่ต้องคำนึงถึงต้นทุนและความเสี่ยงทางกฎหมาย

- แบ่งงานเป็นโมดูล: ทำ feature-flagging ให้สามารถเปิด–ปิดฟีเจอร์ที่เกี่ยวข้องได้ทันทีเมื่อตัวเลือกของ OpenAI พร้อมใช้งาน

ตัวอย่างสมมติกรณีศึกษา: แอปพลิเคชันที่วางแผนเปิดตัว Subscription Tier ใหม่ซึ่งอ้างอิงฟีเจอร์ผู้ใหญ่เพื่อเพิ่ม ARPU (Average Revenue Per User) หากเลื่อนการเปิดตัว 3 เดือน อาจทำให้รายได้คาดการณ์ลดลง 4–7% ในไตรมาสนั้น นักพัฒนาควรพิจารณาการชดเชยด้วยฟีเจอร์เสริมอื่น ๆ หรือโปรโมชั่นเพื่อรักษา churn ไว้

ในมุมมองธุรกิจ ผลกระทบขยายเป็นทั้งด้านการสื่อสารกับลูกค้า การปฏิบัติตามกฎระเบียบ และความเสี่ยงเชิงภาพลักษณ์ ธุรกิจที่พึ่งพา ChatGPT เพื่อให้บริการที่ต้องการการจำกัดอายุหรือจัดการเนื้อหาอ่อนไหวจำเป็นต้องดำเนินการดังนี้:

- สื่อสารกับลูกค้าอย่างโปร่งใส: ประกาศแผนการและกรอบเวลาอย่างชัดเจน แจ้งผลกระทบต่อฟีเจอร์และมาตรการชั่วคราวเพื่อลดความไม่พอใจ

- ทางเลือกด้านการปฏิบัติตามกฎระเบียบ: พิจารณาการใช้การตรวจสอบด้วยคน (human review), การจำกัดอายุแบบหลายชั้น, หรือตัวกรองเนื้อหาที่ผ่านการพิสูจน์แล้ว เพื่อให้สอดคล้องกับกฎหมายในแต่ละเขตอำนาจ

- แผนสำรองทางเทคนิคและธุรกิจ: สร้างช่องทางสำรอง เช่นการรวมบริการจากผู้ให้บริการรายอื่น หรือพัฒนาโมเดลภายใน (on-premise) สำหรับกรณีที่ต้องการการควบคุมมากขึ้น

ตัวอย่างสมมติ: บริษัทสื่อที่ใช้ ChatGPT ในการคัดกรองและปรับแต่งบทความสำหรับผู้อ่าน 18+ หากฟีเจอร์ถูกเลื่อนและไม่มีมาตรการชั่วคราว อาจเผชิญกับอัตราลดลงของผู้สมัครสมาชิกเฉพาะกลุ่มประมาณ 2–5% หากไม่ได้สื่อสารและชดเชยอย่างเหมาะสม

ข้อเสนอแนะเชิงปฏิบัติสำหรับทุกฝ่ายคือการเตรียมแผนรองรับ (contingency plan) ที่ชัดเจนและสามารถดำเนินการได้ทันที โดยให้ความสำคัญกับ KPI ที่จะวัดผลกระทบ เช่นอัตราการยกเลิกสมัครสมาชิก (churn rate), ความพึงพอใจของผู้ใช้ (NPS), และจำนวนเคสที่ต้องการการตรวจสอบด้วยคน นอกจากนี้ควรกำหนดกรอบเวลาในการทบทวนแผนและเตรียมช่องทางสื่อสารที่ต่อเนื่องกับลูกค้า เมื่อ OpenAI เปิดฟีเจอร์โหมดผู้ใหญ่กลับมา ธุรกิจและนักพัฒนาที่เตรียมตัวล่วงหน้าจะสามารถปรับใช้อย่างรวดเร็วและลดความเสี่ยงทางการเงินและกฎหมายได้อย่างมีประสิทธิภาพ

ความปลอดภัย นโยบายเนื้อหา และความเสี่ยงด้านกฎหมาย

ความปลอดภัย นโยบายเนื้อหา และความเสี่ยงด้านกฎหมาย

การเปิดใช้งานโหมดสำหรับผู้ใหญ่ (adult mode) ในระบบโต้ตอบด้วยภาษาแบบ ChatGPT ยกประเด็นด้านความปลอดภัยและนโยบายเนื้อหาอย่างเข้มข้น เนื่องจากต้องผสานข้อกำหนดทางเทคนิค นโยบายภายใน และกรอบกฎหมายที่ต่างกันไปในแต่ละประเทศ การจัดการเนื้อหาที่เป็นเรื่องเพศ ภาพเปลือย หรือเนื้อหาที่มีความละเอียดอ่อน ต้องมีมาตรการทั้งเชิงป้องกัน (preventive) และเชิงตอบโต้ (reactive) เพื่อป้องกันไม่ให้ผู้ใช้งานที่ยังไม่บรรลุนิติภาวะเข้าถึงเนื้อหาดังกล่าว รวมทั้งป้องกันการบิดเบือนการจำแนกประเภทของเนื้อหา (เช่น การตีความเนื้อหาสุขภาพเพศศึกษาเป็นเนื้อหาผู้ใหญ่) ที่อาจส่งผลต่อความน่าเชื่อถือและความเสี่ยงเชิงกฎหมายของผู้ให้บริการ

ด้านเทคนิคมีความท้าทายหลายประการ โดยเฉพาะเรื่องการตรวจจับอายุผู้ใช้งานและการจำแนกเนื้อหาอย่างแม่นยำ การประเมินอายุจากข้อความหรือภาพมักมีข้อจำกัด:งานวิจัยหลายฉบับชี้ว่าอัตราความผิดพลาดของโมเดลคาดอายุอาจอยู่ในระดับสองหลัก (เช่นประมาณ 10–30%) ขึ้นกับคุณภาพข้อมูลและบริบท การเกิด false positives (บล็อกเนื้อหาที่ควรอนุญาต) จะทำให้ผู้ใช้เป็นผู้ใหญ่ถูกปิดกั้นไม่ให้เข้าถึงบริการ ในขณะที่ false negatives (อนุญาตเนื้อหาที่ควรถูกจำกัด) อาจนำไปสู่การละเมิดกฎหมายคุ้มครองเด็กหรือกฎระเบียบอื่น ๆ นอกจากนี้ การตรวจจับเนื้อหามัลติโมดอล (ข้อความ รูปภาพ วิดีโอ เสียง) และเนื้อหาที่ถูกดัดแปลงด้วย deepfake ยังเพิ่มความซับซ้อน เพราะสัญญาณสำคัญอาจอยู่กระจัดกระจายและต้องการโมเดลหลายชนิดร่วมกันเพื่อให้การตัดสินใจมีความถูกต้องมากขึ้น

ในระดับกฎหมาย บริษัทที่พัฒนาหรือให้บริการต้องคำนึงถึงกรอบกฎหมายทั้งระดับสากลและระดับชาติ ตัวอย่างที่มีผลกระทบโดยตรง ได้แก่ กฎคุ้มครองข้อมูลส่วนบุคคล (เช่น GDPR) ที่กำหนดข้อบังคับเกี่ยวกับการจัดการข้อมูลอายุและการทำ Data Protection Impact Assessment (DPIA) สำหรับระบบที่เสี่ยงสูง นอกจากนี้ กฎหมายคุ้มครองเด็กในสหรัฐฯ เช่น COPPA (Children's Online Privacy Protection Act) หรือกฎหมาย/ข้อบังคับที่มุ่งเน้นการป้องกันการเผยแพร่เนื้อหาอันตรายต่อเด็กในหลายประเทศ ยังกำหนดข้อจำกัดที่เคร่งครัด ตัวอย่างเช่น การห้ามแจกจ่ายภาพอนาจารของผู้เยาว์ที่อาจเข้าข่ายเป็นความผิดอาญาในหลายเขตอำนาจ นอกจากนี้ EU AI Act ซึ่งจัดเป็นกรอบกฎระเบียบใหม่สำหรับระบบปัญญาประดิษฐ์ ยังกำหนดความรับผิดชอบเพิ่มเติมในเรื่องความโปร่งใส การประเมินความเสี่ยง และการทำ conformity assessment สำหรับระบบที่ถือเป็นความเสี่ยงสูง ซึ่งอาจบีบให้ผู้ให้บริการต้องชะลอหรือปรับเปลี่ยนการเปิดตัวฟีเจอร์จนกว่าจะปฏิบัติตามข้อกำหนดได้ครบถ้วน

ข้อกำหนดทางกฎหมายและบทลงโทษสามารถมีผลทางเศรษฐกิจและการดำเนินงานอย่างชัดเจน เช่น การปรับภายใต้ GDPR ที่อาจสูงถึงระดับหลายเปอร์เซ็นต์ของรายได้ทั่วโลก รวมถึงมาตรการทางแพ่งและอาญาในบางประเทศ ดังนั้นองค์กรจำเป็นต้องประเมินความเสี่ยงทางกฎหมายก่อนการเปิดตัวอย่างรอบคอบ รวมทั้งทำงานร่วมกับทนายความ ผู้เชี่ยวชาญด้านความปลอดภัยเด็ก และหน่วยงานกำกับดูแลเมื่อจำเป็น

แนวทางการทดสอบและมาตรการลดความเสี่ยง

- การทดสอบเชิงลึก (Red-teaming และ adversarial testing): จัดทีมภายใน/ภายนอกจำลองพฤติกรรมปฏิบัติการที่จะพยายามผ่านการตรวจจับเพื่อค้นหาช่องโหว่ ทั้งการใช้ข้อความหลอกลวง รูปภาพดัดแปลง หรือการเล่นบริบท เพื่อประเมิน false negative และช่องโหว่อื่น ๆ

- ระบบตรวจจับแบบหลายชั้น (multi-layered moderation): ใช้การประมวลผลเบื้องต้นด้วยกฎแบบ deterministic ร่วมกับโมเดล ML และมีมนุษย์ตรวจสอบสำหรับเคสที่ไม่แน่ใจ ระบบนี้ช่วยลดทั้ง false positives และ false negatives และเป็นมาตรการสำคัญเมื่อจัดการเนื้อหาที่อ่อนไหว

- การตรวจสอบอายุด้วยความเป็นส่วนตัว (privacy-preserving age verification): พิจารณาวิธีการตรวจสอบที่น่าเชื่อถือ เช่น การยืนยันเอกสารด้วยการเข้ารหัส การใช้ third-party age verification providers หรือเทคนิคเช่น zero-knowledge proofs เพื่อยืนยันอายุก่อนอนุญาต โดยคำนึงถึง GDPR และกฎหมายคุ้มครองข้อมูล

- การทดลองแบบค่อยเป็นค่อยไป (staged rollout และ geofencing): เปิดตัวฟีเจอร์ในกลุ่มผู้ใช้จำกัดหรือเขตอำนาจที่มีข้อกำหนดชัดเจนก่อนประเมินผล เพื่อลดความเสี่ยงเชิงกฎระเบียบและโอกาสเกิดเหตุไม่คาดฝันในวงกว้าง

- การติดตามและเมตริกสำคัญ (monitoring & KPIs): ตรวจวัดอัตรา false positives/negatives, เวลาที่ใช้ในการแก้ไขเคสโดยมนุษย์, จำนวนเหตุการณ์ที่เกี่ยวข้องกับผู้เยาว์ และรายงานเหตุการณ์ต่อหน่วยงานกำกับตามข้อกำหนด เพื่อให้สามารถตอบสนองและปรับนโยบายได้ทันที

- การทำ DPIA และเอกสารรองรับทางกฎหมาย: ดำเนินการประเมินผลกระทบต่อความเป็นส่วนตัวและความเสี่ยงด้านสิทธิมนุษยชนก่อนเปิดตัว จัดเก็บบันทึกการตัดสินใจและผลการทดสอบสำหรับการตรวจสอบจากหน่วยงานกำกับ

- ความร่วมมือกับผู้เชี่ยวชาญภายนอก: รับฟังคำแนะนำจากหน่วยงานคุ้มครองเด็ก องค์กรไม่แสวงหากำไร และผู้เชี่ยวชาญด้านจริยธรรม AI เพื่อปรับปรุงนโยบายและแนวปฏิบัติ

การเปิดตัวโหมดผู้ใหญ่จึงไม่ใช่เรื่องเทคโนโลยีเพียงอย่างเดียว แต่เป็นการผสานระหว่างการออกแบบเชิงนโยบาย การปฏิบัติตามกฎหมาย และการลงทุนในกระบวนการทดสอบและการตรวจสอบอย่างต่อเนื่อง บริษัทที่ชะลอการเปิดตัวเพื่อให้แน่ใจว่ามาตรการทั้งหมดครอบคลุมและสามารถพิสูจน์ได้จะมีความได้เปรียบทั้งในการลดความเสี่ยงทางกฎหมายและการรักษาความไว้วางใจจากผู้ใช้และหน่วยงานกำกับ

ปฏิกิริยาจากอุตสาหกรรม คู่แข่ง และกลุ่มผู้สนับสนุน

ปฏิกิริยาจากอุตสาหกรรม คู่แข่ง และกลุ่มผู้สนับสนุน

การประกาศเลื่อนเปิดโหมด 'ผู้ใหญ่' ของ OpenAI ถูกตอบรับด้วยความหลากหลายจากหลายฝ่ายในอุตสาหกรรม เทียบได้กับการตัดสินใจเชิงกลยุทธ์ที่มีผลทั้งด้านภาพลักษณ์และการดำเนินงาน คู่แข่งรายใหญ่และผู้ให้บริการด้านปัญญาประดิษฐ์รายอื่นๆ ยังจับตาดูความเคลื่อนไหวนี้อย่างใกล้ชิด โดยทั่วไปสะท้อนเป็นสองแนวทางหลัก: บางรายมองเห็นโอกาสทางการตลาด ขณะที่บางรายใช้สถานการณ์นี้เพื่อย้ำจุดขายด้านความปลอดภัยหรือการวิจัยเชิงลึก

ตัวอย่างเชิงคำพูดจากภาคธุรกิจมีทั้งแถลงการณ์และโพสต์สาธารณะ ตัวอย่างเช่น:

- Anthropic (ตัวอย่างแถลงการณ์แบบสรุป): "เรามองว่าการให้ความสำคัญกับงานที่สำคัญและความปลอดภัยเป็นสิ่งจำเป็น และยินดีที่จะร่วมสร้างมาตรฐานอุตสาหกรรมเพื่อการเปิดตัวฟีเจอร์ที่รับผิดชอบ"

- Google DeepMind (ตัวอย่างทวีตเชิงสรุป): "การออกแบบระบบต้องผสมผสานระหว่างความสามารถและการควบคุมเชิงนโยบาย — เราจะมุ่งเน้นการวิจัยที่สนับสนุนการใช้งานเชิงธุรกิจและความโปร่งใส"

- นักพัฒนาอิสระ (ตัวอย่างโพสต์จากฟอรัม): "ต้องการ roadmap ที่ชัดเจน ทั้ง API, การกำกับเนื้อหา และข้อกำหนดการใช้งาน ก่อนที่จะลงทุนพัฒนาแอปที่พึ่งพาโหมดนี้"

จากมุมมองเชิงกลยุทธ์ การเลื่อนเปิดโหมดดังกล่าวสร้างทั้ง โอกาส และ ความไม่แน่นอน สำหรับคู่แข่ง: โอกาสมาจากช่องว่างที่ OpenAI วางไว้—คู่แข่งสามารถเร่งเปิดหรือโปรโมตฟีเจอร์ที่คล้ายกันโดยเน้นความพร้อมด้านกฎระเบียบและความปลอดภัยเพื่อดึงผู้ใช้กลุ่มเฉพาะ ในทางกลับกัน ความไม่แน่นอนเกิดจากสัญญาณว่าบริษัทชั้นนำกำลังให้ความสำคัญกับงานเชิงพาณิชย์และการควบคุมความเสี่ยง ซึ่งอาจบีบให้คู่แข่งต้องปรับนโยบายหรือเร่งลงทุนในระบบการกำกับดูแลของตนเอง

เสียงจากชุมชนนักพัฒนาและผู้สร้างแอปพลิเคชันเน้นย้ำเรื่อง ความชัดเจนใน roadmap และการเข้าถึงเครื่องมือพัฒนา: ตามการสำรวจเชิงคุณภาพในชุมชนนักพัฒนา พบว่า ประมาณ 7 ใน 10 ระบุว่าการมีไทม์ไลน์ที่แน่นอนสำหรับ API และนโยบายการกำกับเนื้อหาเป็นปัจจัยสำคัญต่อการตัดสินใจลงทุนพัฒนา ข้อเรียกร้องหลักได้แก่การเปิดเผยเกณฑ์การตรวจสอบเนื้อหา, การรองรับโหมดสำหรับการทดสอบแบบจำกัดวง (sandbox), และชุดเครื่องมือสำหรับการควบคุมระดับองค์กร

กลุ่มนักวิจัยด้านนโยบายและองค์กรด้านสิทธิดิจิทัลตอบสนองด้วยความกังวลต่อ ความโปร่งใส และการกำกับดูแล หลายองค์กรตั้งคำถามว่าเหตุใดการเปิดตัวฟีเจอร์ที่เกี่ยวกับเนื้อหาเชิงผู้ใหญ่จึงต้องเลื่อน พร้อมเรียกร้องให้ OpenAI และผู้ให้บริการรายอื่นๆ เปิดเผยหลักเกณฑ์การตัดสินใจและผลกระทบด้านความเสี่ยง ตัวอย่างข้อเรียกร้องที่พบบ่อยคือการเผยแพร่รายงานการประเมินผลกระทบด้านสิทธิมนุษยชน (HRIA), การเปิดเผยเครื่องมือการควบคุมสำหรับผู้ดูแลระบบองค์กร และการมีช่องทางตรวจสอบการตัดสินใจอัตโนมัติ

สรุปเชิงการตลาด: ในระยะสั้น OpenAI อาจเผชิญกับแรงกดดันด้านภาพลักษณ์และการคาดหวังจากผู้ใช้ แต่การเลื่อนครั้งนี้ยังสามารถช่วยรักษาความน่าเชื่อถือในกลุ่มลูกค้าองค์กรและหน่วยงานกำกับดูแล หาก OpenAI ใช้เวลานี้ปรับปรุงมาตรการความปลอดภัยและเผยแพร่ roadmap อย่างชัดเจน บริษัทมีโอกาสยืนยันตำแหน่งเป็นผู้ให้บริการที่น่าเชื่อถือสำหรับการใช้งานเชิงพาณิชย์ อย่างไรก็ตาม หากการสื่อสารไม่เพียงพอ คู่แข่งที่เน้นความโปร่งใสหรือเปิดตัวฟีเจอร์ทดแทนอาจได้เปรียบในการดึงนักพัฒนาและลูกค้ากลุ่มเฉพาะ ซึ่งจะทำให้ตำแหน่งทางการตลาดของ OpenAI เปลี่ยนไปจากผู้นำด้านนวัตกรรมสู่ผู้ที่ต้องพิสูจน์ความน่าเชื่อถือในด้านการกำกับดูแล

มองไปข้างหน้า: สิ่งที่ควรเฝ้าติดตามและคำแนะนำสำหรับผู้ใช้

มองไปข้างหน้า: สิ่งที่ควรเฝ้าติดตามและคำแนะนำสำหรับผู้ใช้

หลังจากที่ OpenAI ตัดสินใจเลื่อนการเปิดใช้โหมด "ผู้ใหญ่" ของ ChatGPT เพื่อให้ความสำคัญกับประเด็นความปลอดภัยและนโยบายมากขึ้น ผู้ใช้งานและองค์กรควรเตรียมตัวเฝ้าติดตามสัญญาณที่ชัดเจนว่าจะมีการนำฟีเจอร์กลับมาใช้อีกครั้งอย่างเป็นทางการ ในภาพรวม ควรคาดการณ์ระยะเวลาที่เป็นไปได้ว่าอาจใช้ตั้งแต่ หลายสัปดาห์จนถึงหลายเดือนขึ้นอยู่กับผลการทดสอบภายใน การตรวจสอบจากภายนอก และการปรับปรุงระบบกรองเนื้อหาและการควบคุมการเข้าถึง

สัญญาณที่ควรเฝ้าติดตาม โดยสรุปมีดังนี้:

- ประกาศอย่างเป็นทางการจาก OpenAI — บล็อกโพสต์หรือโพสต์ในช่องทางสื่อสารหลักของบริษัทที่ระบุกรอบเวลา เงื่อนไขการทดสอบ หรือแผนการเปิดตัวแบบมีขั้นตอน

- ประกาศการทดสอบสาธารณะ (public beta / pilot) — หากมีการเปิดสมัครเข้าร่วมโปรแกรมทดสอบสาธารณะ นั่นเป็นสัญญาณใกล้เคียงว่าฟีเจอร์จะกลับมาในรูปแบบที่ควบคุมได้

- รายงานความปลอดภัยและการประเมินผล — เอกสารรายงานการทดสอบความปลอดภัย ประสิทธิผลของระบบกรองเนื้อหา หรือการตรวจสอบโดยภายนอก (third‑party audits) จะเป็นตัวชี้วัดสำคัญว่าความเสี่ยงได้รับการจัดการอย่างเพียงพอหรือไม่

- การอัปเดตด้านนโยบาย — การเปลี่ยนแปลงนโยบายการใช้งาน การจำกัดกลุ่มผู้ใช้ หรือมาตรการการยืนยันอายุ เป็นสัญญาณว่าฟีเจอร์ถูกออกแบบให้สอดคล้องกับกฎระเบียบและความรับผิดชอบ

- ผลการทดสอบเชิงปฏิบัติการ (metrics) — ตัวชี้วัดเช่นอัตราการปิดกั้นเนื้อหา (false positive/negative rates), เวลาตอบสนองของระบบกรอง, และสถิติการร้องเรียน/รายงานจากผู้ใช้ จะบ่งชี้ความพร้อมเชิงปฏิบัติ

คำแนะนำสำหรับนักพัฒนา — ในระหว่างรอการตัดสินใจของ OpenAI นักพัฒนาควรเตรียมแผนสำรองและมาตรการสื่อสารกับผู้ใช้อย่างรัดกุม ตัวอย่างแนวทางปฏิบัติที่แนะนำได้แก่:

- จัดทำ feature flags และแผนเวอร์ชัน (versioning) เพื่อเปิด/ปิดฟีเจอร์ได้ทันทีเมื่อมีการประกาศจากผู้ให้บริการ

- ออกแบบระบบ fallback โดยใช้โมดูลกรองเนื้อหาอิสระหรือบริการ third‑party เพื่อรองรับกรณีที่ฟีเจอร์หลักยังไม่พร้อม

- ทดสอบเชิงปริมาณและคุณภาพ (A/B testing, stress testing, security testing) เพื่อประเมินผลกระทบต่อ UX และมาตรฐานความปลอดภัย — ตั้งเป้าตัวชี้วัดเช่นอัตราความแม่นยำการกรอง >95% เป็นเกณฑ์อ้างอิงตัวอย่าง

- จัดเตรียมข้อความสื่อสารล่วงหน้าให้ชัดเจนกับผู้ใช้ (release notes, FAQ, notification) โดยอธิบายเหตุผลการเลื่อนเปิด ฟีเจอร์ที่ได้รับผลกระทบ และทางเลือกชั่วคราว

- ประสานงานกับฝ่ายกฎหมายและความเป็นส่วนตัว เพื่อประเมินผลกระทบจากการเปิดใช้งานฟีเจอร์ที่อาจเกี่ยวข้องกับข้อมูลอ่อนไหวหรือการยืนยันอายุ

คำแนะนำสำหรับผู้บริหารด้านเทคโนโลยี (CTO / Head of Product) — ควรประเมินความเสี่ยงเชิงกลยุทธ์และโอกาสทางธุรกิจ พร้อมเตรียมการเชิงนโยบายและทรัพยากร ดังนี้:

- ดำเนินการวิเคราะห์ความเสี่ยง (risk assessment) ที่รวมทั้งด้านกฎหมาย ชื่อเสียง และการปฏิบัติตามข้อกำหนด กำหนดระดับความเสี่ยงยอมรับได้และแผนบรรเทา

- ประเมินผลกระทบทางธุรกิจ (business impact) เช่น โอกาสรายได้จากการเปิดฟีเจอร์ การเปลี่ยนแปลงอัตราการใช้งาน และค่าใช้จ่ายด้านการควบคุมความเสี่ยง

- จัดสรรงบประมาณและทรัพยากรสำหรับการทดสอบความปลอดภัย การตรวจสอบภายนอก และการสนับสนุนลูกค้า หากมีการเปิดใช้งานในอนาคต

- วางแผนการสื่อสารเชิงกลยุทธ์กับผู้มีส่วนได้ส่วนเสีย (stakeholders) ทั้งภายในและภายนอก รวมถึงการเตรียมสคริปต์สำหรับการตอบคำถามสาธารณะในกรณีเกิดเหตุไม่คาดคิด

- กำหนดนโยบายการใช้ฟีเจอร์ภายในองค์กร เช่น การจำกัดการเข้าถึงแบบ role‑based หรือการขออนุญาตพิเศษสำหรับกรณีใช้งานเชิงธุรกิจที่มีความเสี่ยงสูง

สรุปแล้ว การเตรียมความพร้อมแบบรอบด้านทั้งในเชิงเทคนิค นโยบาย และการสื่อสารจะช่วยให้องค์กรสามารถตอบสนองได้อย่างรวดเร็วและมีประสิทธิภาพเมื่อ OpenAI ประกาศแผนการเปิดฟีเจอร์อีกครั้ง ผู้เกี่ยวข้องควรกำหนดรอบการตรวจสอบข่าวสารสำคัญ เช่น ติดตามบล็อกโพสต์ของ OpenAI อย่างน้อยสัปดาห์ละครั้ง ตรวจสอบรายงานความปลอดภัยเมื่อมีการเผยแพร่ และกำหนดเกณฑ์การตัดสินใจภายในเพื่อให้การดำเนินงานเป็นไปอย่างมีระบบและคุ้มค่าต่อผลประโยชน์ทางธุรกิจ

บทสรุป

การที่ OpenAI เลื่อนเปิดโหมด "ผู้ใหญ่" ของ ChatGPT สะท้อนให้เห็นถึงการจัดลำดับความสำคัญระหว่างการผลักดันนวัตกรรมและการให้ความสำคัญกับความปลอดภัยรวมถึงการปฏิบัติตามกฎระเบียบ การตัดสินใจนี้มีผลกระทบต่อหลายฝ่าย — ผู้ใช้ที่คาดหวังฟีเจอร์ใหม่ต้องรอความชัดเจนด้านนโยบายและการคุ้มครองข้อมูล, นักพัฒนาต้องปรับระบบกรองเนื้อหาและกระบวนการทดสอบเพิ่มเติม, และตลาด AI โดยรวมอาจเห็นการชะลอการเปิดตัวฟีเจอร์ที่มีความเสี่ยงสูงเพื่อหลีกเลี่ยงปัญหาด้านความเชื่อถือ ตัวอย่างผลกระทบเช่น บริษัทที่พัฒนาผลิตภัณฑ์ต่อยอดอาจต้องเลื่อนเวลาปล่อยฟีเจอร์ใหม่ ขณะที่ผู้กำกับดูแลด้านเนื้อหาและความเป็นส่วนตัวเพิ่มแรงกดดันให้มีมาตรการตรวจสอบที่เข้มงวดขึ้น

มุมมองในอนาคตชัดเจนว่า ผู้อ่านควรติดตามประกาศอย่างเป็นทางการของ OpenAI เพื่อรับข้อมูลเกี่ยวกับเวลาการเปิดตัวและเงื่อนไขการใช้งาน พร้อมทั้ง เตรียมแผนสำรองทั้งด้านเทคนิคและการสื่อสาร — เช่น การอัปเดตระบบกรองเนื้อหา การทดสอบความปลอดภัยเพิ่มเติม และแผนตอบคำถามสาธารณะ หากมีการเปลี่ยนทิศทางธุรกิจหรือข้อจำกัดทางกฎระเบียบ ผู้กำกับดูแลและคู่แข่งคาดว่าจะยืนหยัดกดดันให้รูปแบบการเปิดตัวมีความโปร่งใส ปลอดภัย และเป็นไปตามมาตรฐานสากล ผลลัพธ์ที่เป็นไปได้รวมถึงการเปิดตัวแบบค่อยเป็นค่อยไป (phased rollout) การเพิ่มเครื่องมือควบคุมสำหรับผู้ใช้ และกรอบกำกับดูแลใหม่ที่อาจกำหนดรูปแบบการพัฒนา AI ในระยะกลางถึงยาว

📰 แหล่งอ้างอิง: The Guardian