OpenAI ประกาศถอดฟีเจอร์ "โหมดผู้ใหญ่" (Adult Mode) ใน ChatGPT ออกไปเป็นการชั่วคราว ซึ่งข่าวนี้สร้างความตื่นตัวและคำถามมากมายในหมู่ผู้ใช้งาน นักพัฒนา และนักวิเคราะห์เทคโนโลยี ไม่ว่าจะเป็นข้อกังวลด้านความปลอดภัย ความเป็นส่วนตัว การปฏิบัติตามกฎระเบียบ หรือผลกระทบต่อประสบการณ์การใช้งานที่ผู้คนคาดหวังจากระบบปัญญาประดิษฐ์สมัยใหม่ เหตุการณ์ครั้งนี้จึงไม่ใช่เพียงการเปลี่ยนแปลงฟีเจอร์ แต่เป็นสัญญาณที่อาจชี้ทิศทางนโยบายและความสัมพันธ์ระหว่างผู้ให้บริการกับผู้ใช้อย่างกว้างขวาง

บทความนี้สรุปเหตุการณ์และไทม์ไลน์การถอดฟีเจอร์ สังเคราะห์ผลตอบรับจากผู้ใช้และชุมชน รวมถึงวิเคราะห์ความเสี่ยงทั้งเชิงเทคนิคและเชิงกฎหมายที่อาจเกิดขึ้น นอกจากนี้ยังพิจารณาผลกระทบทางธุรกิจต่อการยอมรับผลิตภัณฑ์และการสร้างรายได้ พร้อมข้อแนะนำเชิงปฏิบัติสำหรับผู้ใช้งานที่ต้องการความต่อเนื่องในการทำงานและนักพัฒนาที่ต้องการปรับกลยุทธ์การออกแบบฟีเจอร์อย่างปลอดภัยและยั่งยืน

สรุปเหตุการณ์: อะไรเกิดขึ้นเมื่อ OpenAI ถอดโหมดผู้ใหญ่ออกชั่วคราว

สรุปเหตุการณ์: อะไรเกิดขึ้นเมื่อ OpenAI ถอดโหมดผู้ใหญ่ออกชั่วคราว

OpenAI ประกาศถอดฟีเจอร์ 'โหมดผู้ใหญ่' ออกชั่วคราว ผ่านช่องทางสื่อสารอย่างเป็นทางการของบริษัท โดยระบุในคำแถลงว่าเป็นการปิดใช้งานชั่วคราวเพื่อตรวจสอบและปรับปรุงการควบคุมด้านความปลอดภัยและนโยบายการใช้งาน ผู้ใช้งานได้รับแจ้งผ่านช่องทางภายในแอปพลิเคชันและอีเมลที่เชื่อมโยงกับบัญชี ว่าฟีเจอร์ดังกล่าวจะไม่สามารถเข้าถึงได้ชั่วคราวในช่วงการทบทวน

ลักษณะการถอดฟีเจอร์ เป็นการหยุดให้บริการชั่วคราวบนแพลตฟอร์มสาธารณะ ทั้งผู้ใช้ทั่วไปและสมาชิกแบบชำระเงินที่เคยมีสิทธิ์เข้าถึงโหมดดังกล่าวจะถูกจำกัดการใช้งานชั่วคราว บริษัทระบุว่าเป็นมาตรการแบบชั่วคราว (temporary removal) เพื่อให้ทีมงานสามารถตรวจสอบประเด็นความปลอดภัยและการปฏิบัติตามนโยบายได้อย่างละเอียด ก่อนจะประกาศการคืนฟีเจอร์หรือการปรับเปลี่ยนเงื่อนไขการเข้าถึงต่อไป

ผลกระทบทันทีต่อผู้ใช้งานปรากฏชัดในประสบการณ์การใช้งานของผู้ใช้หลายกลุ่ม ผู้ใช้บางรายรายงานว่าพบ แบนเนอร์แจ้งเตือน ภายในหน้าแชท แจ้งว่าฟีเจอร์ถูกปิดชั่วคราวพร้อมลิงก์ไปยังคำชี้แจงอย่างเป็นทางการ ขณะที่ผู้ใช้บางกลุ่มที่พึ่งพาฟีเจอร์นี้ในการทดสอบเนื้อหาหรือพัฒนาแอปพลิเคชันเห็นการเรียกใช้งาน API หรือการตั้งค่าที่เกี่ยวข้องกลับมาเป็นค่าเริ่มต้นและไม่รองรับการส่งคำขอที่เฉพาะเจาะจงสำหรับเนื้อหาแบบผู้ใหญ่ชั่วคราว

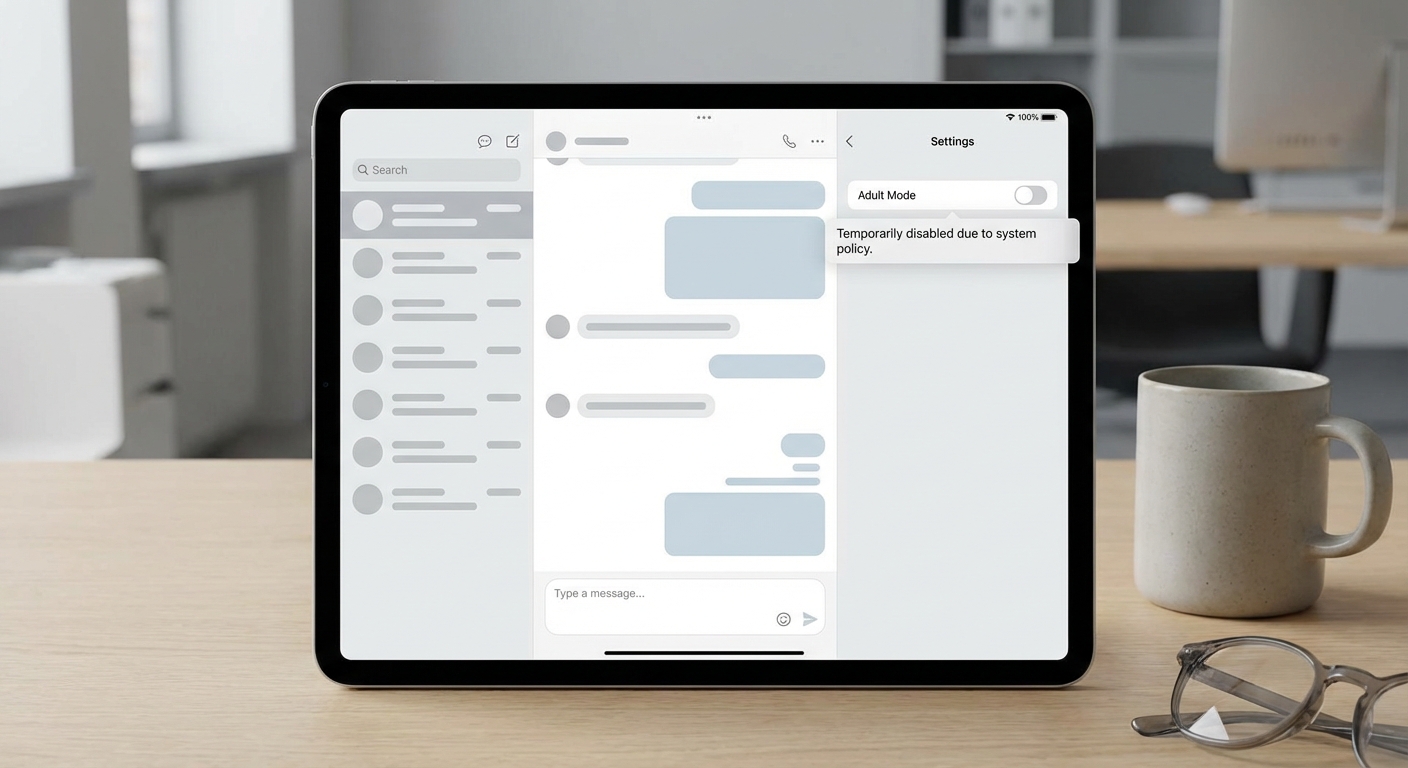

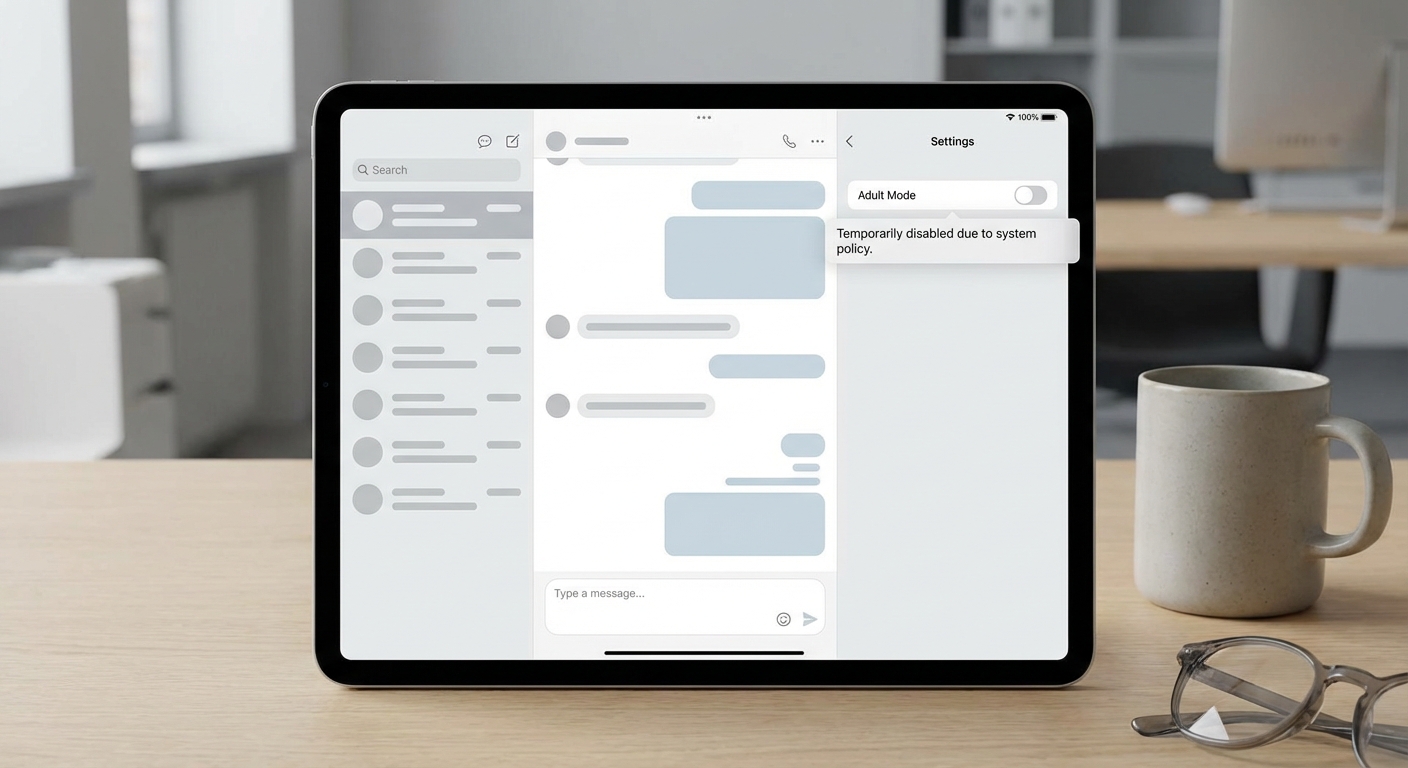

- การแจ้งเตือนในแอป: ผู้ใช้เห็นแบนเนอร์หรือป็อปอัพแจ้งว่าฟีเจอร์ถูกปิดชั่วคราว และมีลิงก์ไปยังคำอธิบายของ OpenAI

- การเข้าถึงถูกจำกัด: หน้าจอการตั้งค่าที่เกี่ยวข้องกับโหมดผู้ใหญ่ถูกซ่อนหรือปิดใช้งานชั่วคราว

- ผลต่อการทำงานของนักพัฒนา: แอปหรือสคริปต์ที่อิงฟังก์ชันโหมดผู้ใหญ่อาจได้รับข้อผิดพลาดหรือผลลัพธ์ที่แตกต่างไปจนกว่าจะมีการประกาศเปลี่ยนแปลง

โดยสรุป เหตุการณ์นี้เป็นการเคลื่อนไหวเชิงป้องกันจาก OpenAI ที่เกิดขึ้นอย่างฉับพลันและสื่อสารผ่านช่องทางอย่างเป็นทางการ ผู้ใช้งานจะเห็นการเปลี่ยนแปลงทันทีในระดับอินเทอร์เฟซและการเรียกใช้งานฟีเจอร์ ขณะที่บริษัทระบุว่าจะเร่งดำเนินการทบทวนเพื่อแจ้งกำหนดการคืนฟีเจอร์หรือการเปลี่ยนแปลงนโยบายต่อไป

บริบทของฟีเจอร์ 'โหมดผู้ใหญ่': ความตั้งใจและการใช้งานจริง

บริบทของฟีเจอร์ "โหมดผู้ใหญ่": ความตั้งใจและการใช้งานจริง

โหมดผู้ใหญ่ ถูกออกแบบมาเพื่อมอบทางเลือกให้ผู้ใช้ที่เป็นผู้ใหญ่ได้รับคำตอบหรือเนื้อหาที่มีความเฉพาะเจาะจงและมีบริบทเชิงผู้ใหญ่มากขึ้น โดยยังคงกรอบความรับผิดชอบด้านนโยบายของผู้พัฒนาไว้ โหมดนี้มีเป้าหมายหลักเพื่อให้ผู้ใช้ที่ต้องการคำอธิบายเชิงวิชาการ ข้อมูลด้านสุขภาพเพศ ความรู้ด้านกฎหมาย หรือการให้คำปรึกษาเชิงผู้ใหญ่ สามารถเข้าถึงคำตอบที่ตรงประเด็นกว่าโหมดปกติ ซึ่งในเชิงธุรกิจหมายถึงการลดเวลาที่ต้องใช้ในการปรับคำถามซ้ำและเพิ่มประสิทธิภาพการใช้งานในกลุ่มลูกค้าวัยผู้ใหญ่

ในการเปิดตัวช่วงเบต้า OpenAI ระบุว่าโหมดนี้ได้รับความสนใจจากกลุ่มผู้ใช้วัยผู้ใหญ่เป็นหลัก โดยข้อมูลเบื้องต้นจากการทดสอบบางชุดแสดงให้เห็นการเพิ่มขึ้นของการโต้ตอบเชิงลึก (long-form, context-rich queries) ประมาณราว ๆ สองถึงสามเท่า เมื่อเทียบกับการใช้งานในโหมดปกติ ซึ่งสะท้อนว่าผู้ใช้ต้องการคำตอบที่มีรายละเอียดและไม่ต้องผ่านการกรองเชิงภาษาที่เข้มงวดเท่ากับการตั้งค่าเริ่มต้น

รูปแบบการใช้งานของโหมดประกอบด้วยองค์ประกอบสำคัญดังนี้:

- การยืนยันอายุ: ก่อนเข้าใช้งานระบบโหมดผู้ใหญ่ ผู้ใช้ต้องผ่านกระบวนการยืนยันอายุที่เข้มงวด ซึ่งอาจรวมถึงการยืนยันผ่านเอกสารประจำตัวหรือบริการยืนยันบุคคลที่สาม (third-party verification) เพื่อให้มั่นใจว่าผู้ขอใช้บริการเป็นผู้ใหญ่ตามกฎหมายท้องถิ่น

- การตั้งค่าระดับเนื้อหา: ผู้ใช้จะสามารถปรับระดับความเข้มของเนื้อหา (เช่น ระดับมาตรฐานกับระดับผู้ใหญ่) เพื่อกำหนดขอบเขตของภาษาที่ยอมรับและรายละเอียดที่ต้องการ โดยการตั้งค่านี้ใช้เป็นสัญญาณนำทางให้โมเดลปรับน้ำเสียงและความละเอียดของคำตอบ

- ตัวอย่างการถาม-ตอบที่อนุญาต: คำถามเช่น "อธิบายปัญหาทางเพศหลังคลอดและแนวทางการเข้ารับคำปรึกษา" หรือ "อธิบายกฎหมายการเซ็นสัญญาทางธุรกิจที่มีเงื่อนไขเฉพาะสำหรับผู้ใหญ่" เป็นตัวอย่างของคำถามที่โหมดผู้ใหญ่จะให้คำตอบเชิงลึกได้มากขึ้น

เพื่อความชัดเจนในข้อจำกัดตามนโยบาย โหมดผู้ใหญ่ไม่ได้เป็นการยกเว้นกฎทั้งหมดของแพลตฟอร์ม โดยมีหลักการสำคัญที่ยังคงบังคับใช้ดังนี้:

- ข้อห้ามพื้นฐาน: ไม่อนุญาตเนื้อหาที่เกี่ยวข้องกับการล่วงละเมิดเด็ก/เยาวชน ความรุนแรงที่ส่งเสริม หรือการชักจูงให้กระทำความผิดทางกฎหมาย

- การจำกัดเรื่องภาพลามกและเนื้อหาทางเพศ: แม้โหมดผู้ใหญ่จะอนุญาตบทสนทนาเกี่ยวกับสุขภาพทางเพศหรือคำอธิบายเชิงการศึกษา แต่การสร้างเนื้อหาที่เป็นภาพลามกชัดแจ้ง (pornography) หรือการพรรณนาทางเพศที่มุ่งเน้นการกระตุ้นทางเพศอย่างชัดเจนยังคงถูกจำกัดตามนโยบาย

- การตรวจสอบแบบอัตโนมัติและการทบทวนโดยมนุษย์: กระบวนการคัดกรองประกอบด้วยชั้นการตรวจจับอัตโนมัติโดยอัลกอริธึม (content classifiers และ safety filters) ที่จะทำหน้าที่บล็อกหรือทำเครื่องหมายเนื้อหาที่ขัดนโยบาย หากเนื้อหาถูกทำเครื่องหมายว่าสุ่มเสี่ยง ระบบจะส่งต่อให้ทีมทบทวนโดยมนุษย์เพื่อตัดสินใจขั้นสุดท้าย โดยเฉพาะกรณีที่มีความกำกวมหรือมีผลทางกฎหมาย/จริยธรรมสูง

นอกจากนั้น โหมดนี้ยังมาพร้อมกับความโปร่งใสในการใช้งานและข้อจำกัดด้านความเป็นส่วนตัว เช่น การบันทึกเหตุการณ์การยืนยันอายุเพื่อการปฏิบัติตามกฎหมาย และการกำหนดเงื่อนไขว่าข้อมูลที่ใช้ในการยืนยันจะถูกจัดการอย่างไร ซึ่งเป็นส่วนหนึ่งของการสร้างสมดุลระหว่างการให้บริการเนื้อหาที่ลึกกว่าและการปกป้องผู้ใช้และชุมชนโดยรวม

ไทม์ไลน์การเปิดตัวและการถอด: ขั้นตอน สาเหตุที่ประกาศอย่างเป็นทางการ

ไทม์ไลน์การเปิดตัวและการถอด: ขั้นตอน สาเหตุที่ประกาศอย่างเป็นทางการ

OpenAI เปิดตัว โหมดผู้ใหญ่ (adult mode) ผ่านกระบวนการหลายระยะที่ออกแบบมาเพื่อลดความเสี่ยงและเก็บข้อมูลการทำงานจริงจากผู้ใช้ การดำเนินการแบ่งเป็นขั้นตอนหลักคือการประกาศเปิดตัวภายใน (internal alpha) → การทดสอบผู้ใช้ต้นแบบ (prototype testing) → การเปิดใช้งานแบบวงจำกัด (limited rollout) → การถอดออกชั่วคราวเพื่อตรวจสอบและแก้ไข (temporary removal)。แต่ละขั้นตอนมีการเก็บข้อมูลเชิงปริมาณและเชิงคุณภาพเพื่อประเมินความเสี่ยงก่อนขยายการให้บริการสู่ผู้ใช้วงกว้าง

ไทม์ไลน์เชิงเหตุการณ์โดยย่อ:

- ประกาศเปิดตัว (internal announcement) — เปิดโครงการภายในทีมงานเพื่อพัฒนาพฤติกรรมและนโยบายการตอบของโหมดผู้ใหญ่ โดยมีเป้าหมายให้ระบบสามารถจัดการคำขอเนื้อหาเชิงผู้ใหญ่ที่ถูกกฎหมายและปลอดภัยต่อการใช้งาน

- การทดสอบผู้ใช้ต้นแบบ (prototype testing) — ให้ผู้ทดสอบกลุ่มเล็ก (นักพัฒนา พนักงาน และผู้ร่วมทดสอบที่เลือกไว้) ลองใช้งานจริงเพื่อเก็บข้อมูลเช่น อัตราการตอบที่ไม่เหมาะสม ข้อร้องเรียนจากผู้ใช้ และกรณีที่ระบบกรองพลาด พบปัญหาที่รายงานจากผู้ทดสอบหลายกรณีทั้งการอนุญาตเนื้อหาที่ละเมิดนโยบายและการบล็อกเนื้อหาที่ควรอนุญาต

- การเปิดใช้งานแบบวงจำกัด (limited rollout) — ขยายไปยังผู้ใช้กลุ่มวงจำกัด (beta) เพื่อทดสอบสเกลจริงและพฤติกรรมการใช้งานภายนอก พบข้อมูลเชิงสถิติที่ใช้ในการประเมิน เช่น อัตราการรายงาน (user-reported incidents) และเมตริกการทำงานของระบบการจัดการเนื้อหา (content moderation metrics)

- การประกาศถอดออกชั่วคราว (temporary removal) — หลังการเปิดใช้งานแบบวงจำกัด OpenAI ตัดสินใจถอดโหมดออกชั่วคราวเพื่อตรวจสอบปัญหาที่พบจากทั้งการทดสอบภายในและฟีดแบ็กของผู้ใช้

ตามคำชี้แจงอย่างเป็นทางการของบริษัท สาเหตุหลักที่นำไปสู่การถอดออกชั่วคราวประกอบด้วย:

- ปัญหาการจัดการเนื้อหา — ระบบกรองไม่สามารถแยกแยะบริบทบางประเภทได้อย่างแม่นยำ ส่งผลให้มีกรณีการอนุญาตเนื้อหาที่ขัดกับนโยบายความปลอดภัย หรือในทางกลับกันมีการกรองเนื้อหาที่เป็นไปตามกฎหมายแต่ถูกบล็อกผิดพลาด

- บั๊กในระบบหรือการรวมโมดูล — พบความผิดปกติทางเทคนิคในกระบวนการผสานโมเดลการตอบกับระบบตรวจสอบ (moderation pipeline) ซึ่งทำให้ผลลัพธ์บางกรณีหลุดจากการตรวจสอบตามที่ตั้งใจไว้

- ผลการทดสอบภายในและข้อมูลผู้ใช้ — ดัชนีชี้วัดความเสี่ยง (เช่น อัตราการแจ้งเหตุที่สูงกว่าค่ามาตรฐาน) และตัวอย่างเหตุการณ์ที่ผู้ใช้รายงาน ทำให้บริษัทประเมินว่าจำเป็นต้องหยุดการให้บริการชั่วคราวเพื่อป้องกันความเสี่ยงขยายวง

OpenAI ระบุในเอกสารประกอบและประกาศสาธารณะ (blog post / safety update) ว่าการดำเนินการถัดไปจะประกอบด้วยการสืบสวนเชิงลึก (root-cause analysis), การปรับปรุงตัวกรองและโมเดลด้านความปลอดภัย, การเพิ่มขั้นตอนการทดสอบเชิงตรง (red-teaming) และการทบทวนโดยบุคคลภายนอกในบางกรณี บริษัทให้คำมั่นว่าจะทำการปรับปรุงแบบมีมาตรฐานและจะรายงานความคืบหน้าเป็นช่วง ๆ เพื่อให้ผู้ใช้และองค์กรคู่ค้าได้รับข้อมูลที่ชัดเจน

กรอบเวลาที่ระบุโดยประมาณจากคำชี้แจงคือการดำเนินการตรวจสอบและทดสอบซ้ำในช่วงหลายสัปดาห์ถึงไม่กี่เดือน ขึ้นกับความซับซ้อนของปัญหาและผลการตรวจสอบด้านความปลอดภัย ตัวอย่างของขั้นตอนเชิงปฏิบัติที่บริษัทระบุได้แก่:

- รอบการวิเคราะห์ข้อมูลและแก้ไขโค้ดภายใน 2–6 สัปดาห์

- การทดสอบภายในเพิ่มความเข้มข้นและการเปิดวงจำกัดแบบค่อยเป็นค่อยไปอีก 2–8 สัปดาห์หลังการแก้ไข

- การเปิดให้บริการในวงกว้างขึ้นจะพิจารณาเมื่อเมตริกความปลอดภัยและคุณภาพผ่านเกณฑ์ที่กำหนดไว้

สำหรับผู้ใช้งานและภาคธุรกิจ ควรคาดหวังการสื่อสารจาก OpenAI ผ่านช่องทางทางการทั้งบล็อกประกาศ การแจ้งในแดชบอร์ดผู้พัฒนา และเอกสารอัพเดตด้านความปลอดภัย เมื่อโหมดกลับมาให้บริการอีกครั้ง บริษัทระบุว่าจะเผยแพร่เอกสารประกอบการทดสอบ ผลการประเมินความเสี่ยง และแนวทางการใช้งานที่ปรับปรุงแล้วเพื่อสร้างความมั่นใจแก่ผู้ใช้งานและพันธมิตร

ปฏิกิริยาของผู้ใช้งานและชุมชน: เสียงสนับสนุนและเสียงวิจารณ์

ปฏิกิริยาของผู้ใช้งานและชุมชน: เสียงสนับสนุนและเสียงวิจารณ์

การถอดฟีเจอร์ โหมดผู้ใหญ่ ออกจาก ChatGPT ชั่วคราวสร้างปฏิกิริยาที่หลากหลายบนแพลตฟอร์มโซเชียลมีเดีย ฟอรั่ม และบล็อกโพสต์ โดยสามารถสรุปเป็นกลุ่มหลักๆ ได้แก่ ผู้สนับสนุน ผู้กังวล และผู้ไม่พอใจ แต่ละกลุ่มมีประเด็นที่แตกต่างกันทั้งเชิงจิตวิทยา ประเด็นด้านความปลอดภัย และผลกระทบต่อประสบการณ์ใช้งาน ตัวอย่างเชิงคุณภาพจากโพสต์สาธารณะบน X (เดิมชื่อ Twitter), Reddit และฟอรั่มเฉพาะทางแสดงให้เห็นภาพรวมของความเห็นเหล่านี้ ดังต่อไปนี้

- ผู้สนับสนุน — ผู้ใช้งานกลุ่มนี้เห็นด้วยกับการชะลอการให้บริการฟีเจอร์หรือการถอดออกชั่วคราว โดยเน้นความสำคัญของ ความปลอดภัย และการทดสอบที่รอบคอบ ตัวอย่างข้อความจากโพสต์สาธารณะที่สะท้อนมุมมองนี้ เช่น "การหยุดฟีเจอร์แบบชั่วคราวเป็นสิ่งที่ควรทำ ถ้ามันยังมีความเสี่ยงต่อการเผยแพร่ข้อมูลที่ไม่เหมาะสม" (โพสต์บนฟอรั่มเทคโนโลยี) และ "ขอให้ OpenAI แจ้งรายละเอียดการแก้ไขและระยะเวลาการทดสอบใหม่" (โพสต์บน X)

- ผู้กังวล — กลุ่มนี้ไม่ได้ต่อต้านการถอดฟีเจอร์ทั้งหมด แต่นำเสนอมุมมองที่เน้นความโปร่งใสและการสื่อสารที่ชัดเจน ผู้ใช้ในกลุ่มนี้เรียกร้องให้มีข้อมูลเกี่ยวกับผลกระทบด้านข้อมูลส่วนบุคคล การจัดเก็บคอนเทนต์ และกระบวนการทดสอบ ตัวอย่างความคิดเห็นเช่น "อยากให้ OpenAI เปิดเผยว่าเก็บข้อมูลอย่างไร และจะมีการแจ้งผู้ใช้เมื่อมีการทดสอบฟีเจอร์ที่เปลี่ยนแปลงการตอบสนอง" (คอมเมนต์ในกระทู้ Reddit)

- ผู้ไม่พอใจ — มีผู้ใช้จำนวนหนึ่งแสดงความไม่พอใจ โดยเฉพาะกลุ่มที่เคยใช้ฟีเจอร์นี้อย่างสม่ำเสมอหรือพึ่งพาฟังก์ชันดังกล่าวในการสร้างเนื้อหาเชิงสร้างสรรค์/เชิงงาน ตัวอย่างข้อความจากการตอบโต้บนโซเชียลมีเดีย ได้แก่ "การถอดฟีเจอร์ออกโดยไม่แจ้งล่วงหน้าเป็นเรื่องที่ทำให้เสียความเชื่อถือ" และ "ถ้าไม่มีคำอธิบายหรือทางเลือกที่ชัดเจน ผม/ฉันจะพิจารณาย้ายไปใช้บริการอื่น" (ความคิดเห็นสาธารณะบนบล็อกโพสต์และ X)

ทางด้านข้อมูลเชิงปริมาณ แม้จะยังไม่มีตัวเลขจาก OpenAI ที่เปิดเผยเป็นทางการ แต่โพลล์และการสำรวจชุมชนอิสระหลายแห่งสะท้อนแนวโน้มที่ชัดเจน ดังนี้: โพลล์ในฟอรั่มผู้ใช้ AI ขนาดเล็กรายงานช่วงของผู้ที่เคยเปิดใช้ โหมดผู้ใหญ่ อยู่ระหว่างประมาณ 5–20% ของกลุ่มตัวอย่าง ขณะที่รายงานปัญหา (เช่น การตอบสนองที่ไม่เหมาะสมหรือบั๊ก) ถูกแจ้งเป็นสัดส่วนเล็กน้อยแต่เด่นชัดในชุมชน—ประมาณ 2–8% ของการโต้ตอบที่เกี่ยวข้องกับฟีเจอร์ดังกล่าว นอกจากนี้ ผู้เผยแพร่ผลสำรวจอิสระบางรายบันทึกว่าอัตราการยกเลิกการสมัครสมาชิก (churn) เพิ่มขึ้นเล็กน้อยหลังประกาศการถอดฟีเจอร์ โดยระบุช่วงประมาณ 2–6% ในกลุ่มผู้ตอบที่ระบุว่าจะพิจารณาย้ายบริการหรือหยุดสมัครสมาชิก

แนวโน้มการตอบรับชี้ชัดว่าผู้ใช้ต้องการความโปร่งใสและการควบคุมที่มากขึ้นเมื่อบริษัททดสอบหรือเปิด/ปิดฟีเจอร์ที่มีความอ่อนไหว หลายเสียงเรียกร้องให้มีมาตรการดังต่อไปนี้: การแจ้งล่วงหน้า ก่อนการทดสอบ, ตัวเลือก opt-in/opt-out ที่ชัดเจน, รายงานผลการทดสอบสรุปเป็นสาธารณะ และการประเมินความเสี่ยงด้านนโยบายที่เข้าถึงได้ง่าย สำหรับองค์กรธุรกิจและผู้บริหารผลิตภัณฑ์ ข้อมูลเชิงคุณภาพและเชิงปริมาณเหล่านี้เป็นสัญญาณเตือนว่าการจัดการการสื่อสารกับชุมชนและการแสดงข้อมูลผลกระทบที่โปร่งใสจะมีความสำคัญต่อความไว้วางใจของผู้ใช้ในระยะยาว

ความเสี่ยงด้านความปลอดภัยและการปฏิบัติตามกฎระเบียบ

ความเสี่ยงด้านความปลอดภัยและการปฏิบัติตามกฎระเบียบ

การเปิดให้มีฟีเจอร์ประเภท "โหมดผู้ใหญ่" ในระบบสนทนาอัตโนมัติ เช่น ChatGPT เพิ่มความเสี่ยงด้านความปลอดภัยในหลายมิติ ทั้งด้านเนื้อหา การบริหารความรับผิดชอบของแพลตฟอร์ม และการปฏิบัติตามกฎระเบียบระหว่างประเทศ ในเชิงเนื้อหา โมเดลภาษายังมีช่องโหว่ที่ผู้โจมตีหรือผู้ใช้สามารถพยายามเลี่ยงกลไกการกรอง (so‑called "jailbreaks") ได้ การทดลองและงานวิจัยจำนวนมากชี้ให้เห็นว่าอัตราความสำเร็จของการเจลเบรคจะแตกต่างกันตามวิธีทดสอบ — ตั้งแต่หลักหน่วยจนถึงหลายสิบเปอร์เซ็นต์ในบริบทต่าง ๆ — ทำให้ระบบต้องเผชิญกับความเสี่ยงของการเผยแพร่เนื้อหาไม่เหมาะสมอย่างต่อเนื่อง

ความเสี่ยงด้านเนื้อหา แบ่งเป็นหัวข้อสำคัญได้แก่:

- การเลี่ยงการกรอง: เทคนิคการออกแบบคำถามและการสร้าง prompt ที่ซับซ้อนสามารถทำให้โมเดลให้คำตอบที่ขัดกับนโยบาย แม้จะมีการตั้งค่าป้องกันไว้ก็ตาม ซึ่งนำไปสู่การเผยแพร่คำแนะนำที่เป็นอันตรายหรือเนื้อหาหยาบคาย

- การตีความผิดของโมเดล: โมเดลอาจตีความบริบทผิด เช่น ระบุว่าคำขอเป็นการ "ศึกษา" หรือ "วิจัย" ทั้งที่มีเจตนาใช้ในทางที่ไม่เหมาะสม ส่งผลให้คำตอบคลุมเครือหรือให้ข้อมูลที่ไม่ควรเผยแพร่

- การแพร่หลายของเนื้อหาไม่เหมาะสม: เมื่อเนื้อหาหยาบคายหรือเป็นอันตรยแพร่สู่ผู้ใช้จำนวนมาก จะกระทบต่อความเชื่อมั่นของผู้ใช้และนำไปสู่ความเสี่ยงด้านภาพลักษณ์และกฎหมายสำหรับผู้ให้บริการ

ปัญหาด้านกฎหมายและการปฏิบัติตามกฎระเบียบ เป็นอีกมิติที่สำคัญ โดยเฉพาะเมื่อต้องให้บริการข้ามพรมแดน:

- การยืนยันอายุและสิทธิ์การเข้าถึง: กฎหมายหลายเขต เช่น GDPR ในสหภาพยุโรป, COPPA ในสหรัฐฯ (สำหรับข้อมูลเด็ก), และกฎหมายท้องถิ่นอื่นๆ กำหนดข้อจำกัดการให้บริการแก่ผู้เยาว์หรือการเก็บข้อมูลส่วนบุคคล การเปิดโหมดที่อนุญาตเนื้อหาผู้ใหญ่จำเป็นต้องมีระบบยืนยันอายุที่เชื่อถือได้ ซึ่งยังมีปัญหาเชิงเทคนิคและเชิงความเป็นส่วนตัว

- ความยินยอมและการเก็บข้อมูล: หากระบบต้องเก็บหลักฐานการยืนยันอายุหรือข้อมูลการยินยอม จะต้องปฏิบัติตามหลักการเก็บข้อมูลขั้นต่ำ (data minimization) และจัดการความเสี่ยงด้านการรั่วไหลของข้อมูล ตามข้อกำหนดของ GDPR/CCPA และข้อบังคับการคุ้มครองข้อมูลอื่นๆ

- ความหลากหลายของกฎระเบียบข้ามประเทศ: กฎหมายเกี่ยวกับเนื้อหาออนไลน์และความรับผิดชอบของแพลตฟอร์ม (เช่น EU AI Act ที่มีข้อกำหนดเฉพาะสำหรับระบบความเสี่ยงสูง หรือกฎหมายความปลอดภัยออนไลน์ของสหราชอาณาจักร) แตกต่างกันไปตามเขตอำนาจ ทำให้การออกแบบฟีเจอร์เดียวกันเพื่อให้สอดคล้องในทุกตลาดเป็นเรื่องท้าทาย ผู้ให้บริการต้องพิจารณา geofencing, localized compliance policies และการให้บริการแบบจำกัดฟังก์ชันตามประเทศ

มาตรการทางเทคนิคในการลดความเสี่ยง ควรเป็นส่วนประกอบของการออกแบบระบบอย่างเป็นระบบและมีหลายชั้น (defense‑in‑depth):

- การตรวจจับหลายชั้น (automated + human‑in‑the‑loop): ใช้ตัวกรองอัตโนมัติระดับหลายชั้น (rule‑based classifiers, supervised safety classifiers, semantic filters) ร่วมกับกระบวนการตรวจสอบโดยมนุษย์สำหรับกรณีที่ระบบอัตโนมัติให้ผลไม่แน่นอนหรือมีความเสี่ยงสูง เพื่อให้สามารถตัดสินใจเชิงบริบทได้แม่นยำขึ้น

- การเก็บบันทึกและการตรวจสอบย้อนหลัง: บันทึกเมตาดาต้า (เช่น prompt ที่เข้ามา เวอร์ชันโมเดล ผลการกรอง เวลา และตำแหน่งทางภูมิศาสตร์เท่าที่กฎหมายอนุญาต) ช่วยให้สามารถวิเคราะห์เหตุการณ์ความปลอดภัย การทบทวนกรณีข้อพิพาท และการส่งข้อมูลให้หน่วยงานกำกับดูแลเมื่อจำเป็น ควรกำหนดนโยบายการเก็บรักษาและการเข้ารหัสข้อมูลอย่างเข้มงวดเพื่อลดความเสี่ยงการละเมิดข้อมูล

- การทดสอบความปลอดภัยและ red‑teaming ต่อเนื่อง: ดำเนินการทดสอบแบบ adversarial และ red‑team อย่างสม่ำเสมอเพื่อค้นหาช่องโหว่ของ prompt, การเจลเบรค, และการแปลความหมายผิดของโมเดล ใช้เมตริกที่ชัดเจน เช่น precision/recall ของตัวกรอง ความถี่ของ false negatives ที่ยอมรับได้ และการประเมินผลกระทบ (impact assessment)

- เทคนิคเสริมความเป็นส่วนตัวและความปลอดภัยของข้อมูล: ใช้แนวทางเช่น data minimization, anonymization, differential privacy ในขั้นตอนการฝึกและการวิเคราะห์ เพื่อลดความเสี่ยงต่อการรั่วไหลของข้อมูลส่วนบุคคล ขณะเดียวกันสามารถพิจารณา watermarking หรือ metadata-based provenance สำหรับเนื้อหาที่สร้างโดย AI เพื่อลดความเสี่ยงการนำเนื้อหาไปใช้งานนอกบริบท

- ระบบควบคุมการเข้าถึงและนโยบายท้องถิ่น: ใช้การยืนยันอายุที่หลากหลาย (เช่น การตรวจสอบเอกสารในระดับที่เหมาะสม หรือการยืนยันผ่านผู้ให้บริการบุคคลที่สามที่เชื่อถือได้) พร้อมกับการจำกัดฟังก์ชันตามเขตอำนาจและการตั้งค่าเริ่มต้นที่ปลอดภัย (privacy‑by‑default)

โดยสรุป การเปิดฟีเจอร์ประเภทโหมดผู้ใหญ่ต้องการกรอบการจัดการความเสี่ยงที่ผสานระหว่างนโยบายองค์กร เทคโนโลยีการป้องกัน และการปฏิบัติตามกฎระเบียบอย่างเข้มงวด การลงทุนในระบบตรวจจับหลายชั้น การทดสอบเชิงรุก และกระบวนการยืนยันอายุที่เคารพความเป็นส่วนตัว จะเป็นหัวใจสำคัญในการลดความเสี่ยงทั้งเชิงเนื้อหาและเชิงกฎหมาย เพื่อให้บริการยังคงสอดคล้องกับความคาดหวังของผู้ใช้และข้อกำหนดทางกฎระเบียบในตลาดต่าง ๆ

ผลกระทบเชิงธุรกิจ: ต่อ OpenAI คู่แข่ง และตลาดผลิตภัณฑ์ AI

ผลกระทบเชิงธุรกิจ: ต่อ OpenAI คู่แข่ง และตลาดผลิตภัณฑ์ AI

การถอดฟีเจอร์ 'โหมดผู้ใหญ่' ออกชั่วคราวของ OpenAI ส่งสัญญาณเชิงธุรกิจที่มีทั้งผลกระทบระยะสั้นและระยะยาวต่อรายได้ ภาพลักษณ์ และการแข่งขันในตลาด AI ระดับผู้บริโภคและองค์กร ในระยะสั้น บริษัทอาจเผชิญความเสี่ยงต่อการสูญเสียผู้ใช้ (churn) โดยเฉพาะกลุ่มผู้ใช้ที่สมัครสมาชิกเพื่อเข้าถึงฟีเจอร์เฉพาะ โดยคาดว่าอัตราการยกเลิกการสมัครสมาชิกอาจเพิ่มขึ้นประมาณ 3–10% หากไม่สามารถสื่อสารเหตุผลและแผนการคืนฟีเจอร์ได้อย่างชัดเจน ขณะเดียวกันการได้มาซึ่งลูกค้าใหม่อาจชะลอตัวหรือลดลงชั่วคราว เนื่องจากความไม่แน่นอนด้านนโยบายการใช้งาน

สำหรับลูกค้าระดับองค์กร ความต้องการความโปร่งใส (transparency) และการรับประกันเชิงนโยบายจะเพิ่มขึ้นอย่างมีนัยสำคัญ องค์กรที่มีข้อกำหนดด้านความเป็นส่วนตัวและความรับผิดชอบทางกฎหมายอาจเรียกร้อง service-level agreements (SLAs) และข้อมูลการควบคุมเนื้อหาเชิงเทคนิคเพิ่มเติม หาก OpenAI ไม่สามารถตอบโจทย์นี้ได้ทันที โอกาสที่คู่แข่งจะเสนอแพ็กเกจที่เน้นความโปร่งใสและการปฏิบัติตามข้อกำหนดจะเพิ่มขึ้น ตัวอย่างเช่น ผู้ให้บริการรายอื่นอาจโปรโมตแดชบอร์ดความโปร่งใส การรายงานเหตุการณ์การกรองเนื้อหา หรือการรับรองด้านความปลอดภัยเพื่อดึงลูกค้าองค์กร

ด้านภาพลักษณ์และความเชื่อมั่น หากการสื่อสารจาก OpenAI ไม่ชัดเจนหรือไม่สอดคล้องระหว่างประกาศและการดำเนินงาน จะเกิดความเสี่ยงต่อการลดความไว้วางใจของผู้ใช้ทั่วไปและพันธมิตรทางธุรกิจ การสำรวจเชิงอุตสาหกรรมชี้ว่า การสื่อสารที่ชัดเจนและมีข้อมูลเชิงเทคนิคประกอบ ช่วยลดอัตราการยกเลิกบริการและเสริมความเชื่อมั่นของลูกค้าองค์กรได้อย่างมีนัยสำคัญ ดังนั้นการประกาศแผนการทดแทนฟีเจอร์ การเปิดเผยเกณฑ์การตัดสินใจ และตารางเวลาคืนฟีเจอร์ จะเป็นกลไกสำคัญในการจำกัดความเสียหายต่อแบรนด์

ในเชิงการแข่งขัน การระงับฟีเจอร์ดังกล่าวสร้างพื้นที่เชิงกลยุทธ์ให้กับคู่แข่งทั้งรายกลางและรายเล็ก คู่แข่งสามารถใช้กลยุทธ์ต่อไปนี้เพื่อดึงฐานผู้ใช้ของ OpenAI:

- เน้นฟีเจอร์ทางเลือก: เปิดตัวโหมดหรือการตั้งค่าความยืดหยุ่นในการจัดการเนื้อหาที่ชัดเจน เช่น การตั้งค่าความเคร่งครัดของการกรองเนื้อหา หรือฟีเจอร์ที่อนุญาตเฉพาะผู้ที่ยืนยันตัวตน

- สื่อสารเชิงนโยบายอย่างชัดเจน: โฆษณาแผนการกำกับดูแลและนโยบายความโปร่งใสเพื่อชิงความเชื่อมั่นจากลูกค้าองค์กรที่กังวล

- เสนอทางเลือกเชิงการค้าและเทคโนโลยี: แพ็กเกจสำหรับองค์กรที่รวมการรับรองด้านความปลอดภัย การบริหารจัดการความเสี่ยง และการปรับโมเดลให้สอดคล้องกับข้อกำหนดเชิงกฎหมาย

ในระยะยาว การตัดสินใจของ OpenAI อาจเปลี่ยนโครงสร้างตลาดได้ หากบริษัทเลือกใช้มาตรการชดเชยเช่นการยกระดับการสื่อสาร สร้างเครื่องมือความโปร่งใส หรือข้อเสนอพิเศษสำหรับผู้ใช้ที่ได้รับผลกระทบ จะช่วยฟื้นฟูรายได้และความเชื่อมั่น แต่หากการจัดการไม่ดีเพียงพอ อาจเกิดการย้ายฐานผู้ใช้ไปยังแพลตฟอร์มคู่แข่ง หรือกระตุ้นการเกิดขึ้นของตลาดเสริม (adjacent market) เช่น ผู้ให้บริการด้านการคัดกรองเนื้อหาแบบแยกเฉพาะทาง, โซลูชันการตรวจสอบความสอดคล้องของเนื้อหา (compliance-as-a-service) และบริการปรับแต่งโมเดลสำหรับลูกค้าองค์กร ซึ่งทั้งหมดนี้เป็นโอกาสทางธุรกิจใหม่ที่คู่แข่งและผู้ให้บริการรายที่สามสามารถเข้ามาเติมเต็มได้

สรุปคือ ผลกระทบเชิงธุรกิจจากการถอดฟีเจอร์ชั่วคราวมีทั้งความเสี่ยงและโอกาส OpenAI จำเป็นต้องจัดลำดับความสำคัญในการสื่อสารเชิงนโยบาย การให้ข้อมูลเชิงเทคนิคแก่ลูกค้าองค์กร และการออกแบบกลยุทธ์การคืนฟีเจอร์หรือทางเลือกทดแทนเพื่อรักษารายได้และความไว้วางใจ ขณะเดียวกันตลาดโดยรวมจะได้เห็นการขยับตัวของคู่แข่งและผู้ให้บริการใหม่ ๆ ที่มุ่งตอบโจทย์ด้านความโปร่งใส ความปลอดภัย และการควบคุมเนื้อหา

แนวทางสำหรับผู้ใช้งานและคำแนะนำจากผู้เชี่ยวชาญ

แนวทางสำหรับผู้ใช้งานและคำแนะนำจากผู้เชี่ยวชาญ

เมื่อ OpenAI ถอดฟีเจอร์ โหมดผู้ใหญ่ ออกชั่วคราว สิ่งสำคัญคือผู้ใช้งานและองค์กรต้องปรับแนวทางการใช้งานเพื่อปกป้องข้อมูลและลดความเสี่ยงในระยะสั้น โดยทั่วไปควรเริ่มต้นจากการตรวจสอบการตั้งค่าความเป็นส่วนตัวและการเข้าถึง (privacy & access settings) ของบัญชี ChatGPT ของตนอย่างสม่ำเสมอ ตัวอย่างการปฏิบัติที่แนะนำได้แก่ การเปิดใช้งาน การยืนยันตัวตนสองชั้น (MFA), การจำกัดสิทธิ์ผู้ใช้ในองค์กร, และการเปิดใช้งานบันทึกการใช้งาน (audit logs) เพื่อให้สามารถตรวจสอบย้อนหลังได้หากเกิดเหตุการณ์ผิดปกติ

สำหรับผู้ใช้ทั่วไป ควรปฏิบัติตามหลักง่ายๆ เพื่อป้องกันข้อมูลสำคัญ: หลีกเลี่ยงการนำข้อมูลระบุตัวตนส่วนบุคคล (PII) ข้อมูลทางการเงิน หรือเอกสารที่มีความลับไปวางในช่องสนทนา เช่น หมายเลขบัตรเครดิต ข้อมูลพนักงาน หรือรหัสผ่าน หากจำเป็นต้องใช้ให้พิจารณาใช้ข้อมูลตัวอย่าง (anonymized data) หรือ tokenization นอกจากนี้ ควรบันทึกการสื่อสารสำคัญเป็นสำเนา (export chat logs) และตั้งค่าการแจ้งเตือนการเปลี่ยนแปลงบัญชีเพื่อให้ทราบการเข้าถึงหรือการตั้งค่าที่แปลกปลอมได้ทันที

สำหรับองค์กร คำแนะนำเชิงปฏิบัติรวมถึงการทดสอบฟีเจอร์ใหม่ในสภาพแวดล้อมควบคุม (sandbox หรือ staging) ก่อนนำไปใช้ใน production อย่างเคร่งครัด ประเมินความเสี่ยงด้านความเป็นส่วนตัว ความปลอดภัย และการปฏิบัติตามกฎระเบียบ (compliance) โดยใช้กรอบการประเมินความเสี่ยง เช่นการทำ Data Protection Impact Assessment (DPIA) และการทดสอบ penetration testing ในบริบทของ AI นอกจากนี้ควรกำหนดนโยบายการใช้งานภายในที่ชัดเจน เช่น ข้อห้ามในการป้อนข้อมูลประเภทใดบ้าง การแต่งตั้งผู้ควบคุมการเข้าถึง (admins) และแนวทางการฝึกอบรมพนักงานเกี่ยวกับการใช้งานอย่างปลอดภัย

ตัวอย่างมาตรการเชิงเทคนิคและการบริหารที่องค์กรควรพิจารณา:

- ใช้ Identity & Access Management (IAM) ควบคุมการเข้าถึง API และบัญชีผู้ใช้

- เปิดใช้งาน DLP (Data Loss Prevention) เพื่อป้องกันการรั่วไหลของข้อมูลความลับ

- กำหนดกระบวนการทดสอบใน sandbox รวมถึงการประเมินผลกระทบทางธุรกิจก่อนปล่อยฟีเจอร์

- จัดทำ playbook สำหรับ incident response และฝึกซ้อมสถานการณ์จำลองเกี่ยวกับการรั่วไหลหรือการใช้งานผิดประเภท

- บันทึกและเก็บ audit logs อย่างน้อยตามระยะเวลาที่กฎหมายหรือข้อกำหนดขององค์กรกำหนด

ในระดับนโยบายและการกำกับดูแล ผู้บริหารด้านไอทีและฝ่ายกำกับดูแลควรเรียกร้องความโปร่งใสจากผู้พัฒนาแพลตฟอร์ม AI เช่น OpenAI ในประเด็นสำคัญ ได้แก่ รายงานผลการทดสอบความปลอดภัย การเปิดเผยกรอบการทดสอบทางจริยธรรม การชี้แจงเกณฑ์การตัดสินใจในการเปิด/ปิดฟีเจอร์ และระบุกรอบเวลาที่คาดว่าจะนำฟีเจอร์กลับมาใช้ได้อย่างชัดเจน ควรกำหนดเงื่อนไขการนำฟีเจอร์กลับมา เช่น ข้อกำหนดด้านการทดสอบภายนอก (independent audits), มาตรการป้องกันการละเมิดข้อมูล, และเกณฑ์การประเมินความเสี่ยงที่ผ่านการยอมรับจากคณะกรรมการกำกับขององค์กร

นอกจากนั้น ควรพิจารณานโยบายการสื่อสารกับผู้ใช้งานภายในและลูกค้าอย่างเป็นระบบ โดยกำหนดช่องทางรับข่าวสารที่เชื่อถือได้ (เช่น จดหมายข่าวของบริษัท, หน้า status ของผู้ให้บริการ, หรือช่องทางทางการของ OpenAI) และมีแผนการสื่อสารในกรณีที่ต้องเปลี่ยนแปลงการให้บริการหรือมีผลกระทบต่อการดำเนินงาน งานสำรวจด้านความมั่นคงไซเบอร์ในปีล่าสุดชี้ว่าองค์กรมากกว่า 60% ที่มีนโยบายชัดเจนและช่องทางสื่อสารตรงมีความพร้อมรับมือกับเหตุการณ์ AI-related ได้ดีกว่าองค์กรที่ไม่มีนโยบายเป็นลายลักษณ์อักษร

ท้ายที่สุด ผู้เชี่ยวชาญแนะนำให้ถือหลัก ป้องกันก่อนเกิดเหตุ และ ความโปร่งใสในการสื่อสาร เป็นหัวใจสำคัญ ทั้งสำหรับผู้ใช้ทั่วไปและองค์กร โดยการติดตามประกาศอย่างต่อเนื่อง การจัดกระบวนการทดสอบภายใน และการเรียกร้องมาตรฐานการเปิดเผยข้อมูลจากผู้ให้บริการ จะช่วยสร้างความเชื่อมั่นและลดความเสี่ยงเมื่อฟีเจอร์ถูกเปิดใช้งานกลับมาในอนาคต

บทสรุป

การที่ OpenAI ถอดฟีเจอร์ "โหมดผู้ใหญ่" ใน ChatGPT ออกชั่วคราวสะท้อนถึงการถ่วงดุลระหว่างนวัตกรรมกับความปลอดภัย—เป็นสัญญาณว่าผู้พัฒนาต้องปรับฟีเจอร์ให้สอดคล้องกับข้อกังวลด้านกฎหมาย จริยธรรม และความเสี่ยงในการใช้งานจริง การตัดสินใจชั่วคราวนี้ไม่เพียงแต่เป็นมาตรการเชิงเทคนิค แต่ยังสะท้อนบทบาทของการสื่อสารเชิงนโยบายในการสร้างความเชื่อมั่นแก่ผู้ใช้: การชี้แจงเหตุผล ระยะเวลา และเกณฑ์การประเมินความปลอดภัย มีผลโดยตรงต่อการยอมรับและความคาดหวังของผู้ใช้งาน

มุมมองเชิงอนาคต ผู้ใช้งานและองค์กรควรติดตามประกาศจากผู้ให้บริการอย่างใกล้ชิด ปรับนโยบายภายใน และเตรียมแผนรองรับการเปลี่ยนแปลงฟีเจอร์ที่อาจเกิดขึ้นเป็นระยะ เช่น การปรับแนวปฏิบัติการใช้งานภายใน อัปเดตการฝึกอบรมพนักงาน และตั้งกระบวนการทดสอบผลกระทบทางธุรกิจและความปลอดภัยที่ชัดเจน เหตุการณ์นี้เป็นการเตือนว่าการพัฒนา AI จะต้องเดินคู่กับการกำกับดูแลและการสื่อสารโปร่งใส เพื่อสร้างสมดุลระหว่างการนำเสนอฟีเจอร์ใหม่กับการคุ้มครองผู้ใช้อย่างยั่งยืน

📰 แหล่งอ้างอิง: Axios