การเคลื่อนไหวครั้งสำคัญในวงการปัญญาประดิษฐ์เกิดขึ้นเมื่อ Claude ของ Anthropic พุ่งขึ้นสู่ตำแหน่งแอปยอดนิยมบน App Store แซงหน้า ChatGPT ของ OpenAI ท่ามกลางความตึงเครียดทางความเชื่อมั่นของผู้ใช้ หลังมีข่าวว่าสัญญามูลค่า 200 ล้านดอลลาร์ระหว่าง OpenAI กับกระทรวงกลาโหมสหรัฐ (เพนตากอน) ถูกเปิดเผย การเปลี่ยนแปลงในอันดับแอปครั้งนี้ไม่เพียงสะท้อนความชอบของผู้บริโภคเท่านั้น แต่ยังเป็นสัญญาณของแรงกดดันเชิงสังคมและเชิงธุรกิจต่อบริษัทเทคโนโลยีที่ให้บริการโมเดลภาษาใหญ่

บทความนี้จะพาไปวิเคราะห์เหตุการณ์ตั้งแต่สถิติการดาวน์โหลดและการจัดอันดับใน App Store ไปจนถึงการตอบโต้อย่างเป็นทางการของผู้เล่นในอุตสาหกรรม รวมถึงผลกระทบที่อาจเกิดขึ้นต่อการแข่งขันในตลาด AI สาธารณะ ความเชื่อมั่นของผู้ใช้ และแนวทางกำกับดูแลที่อาจเข้มงวดขึ้น ข้อมูลเชิงตัวเลข ตัวอย่างการตอบสนองจากบริษัทต่าง ๆ และมุมมองจากนักวิเคราะห์จะถูกนำมาพิจารณาเพื่อให้ภาพรวมที่ครบถ้วนและมีน้ำหนักต่อสาธารณชน

บทนำ: เหตุการณ์สำคัญและภาพรวม

บทนำ: เหตุการณ์สำคัญและภาพรวม

ในช่วงต้นสัปดาห์ที่ผ่านมา Claude ระบบปัญญาประดิษฐ์จาก Anthropic ได้พุ่งขึ้นสู่ตำแหน่งแอปยอดนิยมอันดับหนึ่งใน App Store ของสหรัฐฯ (หมวดแอปฟรี) โดยการเปลี่ยนแปลงอันดับดังกล่าวเกิดขึ้นภายในช่วงวันที่ 2–3 มีนาคม 2026 ตามการติดตามอันดับของแพลตฟอร์มและข้อมูลเชิงวิเคราะห์จากบริษัทวิเคราะห์แอป เช่น Sensor Tower ที่ระบุว่า Claude มียอดดาวน์โหลดเพิ่มขึ้นอย่างมีนัยสำคัญภายใน 24–48 ชั่วโมงหลังมีการปรับปรุงเวอร์ชันมือถือและแคมเปญการตลาดเชิงรุก

พร้อมกันนั้น สื่อมวลชนหลักได้เผยแพร่รายงานเกี่ยวกับสัญญามูลค่า 200 ล้านดอลลาร์สหรัฐ ระหว่าง OpenAI กับกระทรวงกลาโหมสหรัฐ (Pentagon) — รายงานฉบับแรกปรากฏในช่วงกลางสัปดาห์เดียวกันโดยสำนักข่าวชั้นนำหลายแห่ง รวมถึงรายงานวิเคราะห์จาก The New York Times และ Reuters ซึ่งอธิบายรายละเอียดคร่าวๆ ของกรอบงาน ความเป็นไปได้ด้านการใช้งาน และวงเงินสัญญา สร้างกระแสตอบรับทางสังคมและเชิงธุรกิจต่อความสัมพันธ์ระหว่างผู้พัฒนา AI เชิงพาณิชย์กับสถาบันทางทหาร

เหตุการณ์สองด้านนี้ — การขึ้นสู่อันดับหนึ่งของ Claude และการเปิดเผยสัญญา 200 ล้านดอลลาร์ของ OpenAI — จึงไม่ใช่เพียงข่าวเทคโนโลยีแยกกันสองเรื่อง แต่กลายเป็นโครงเรื่องร่วมที่สะท้อนความเปลี่ยนแปลงในตลาดผู้ใช้ปลายทางและภูมิทัศน์เชิงนโยบาย การแข่งขันระหว่างผู้เล่นหลักในอุตสาหกรรม AI กำลังถูกขับเคลื่อนทั้งด้วยปัจจัยด้านผลิตภัณฑ์ (UX, ฟีเจอร์, ประสิทธิภาพ) และปัจจัยด้านความเชื่อมั่นของสาธารณะ (political ties, ความกังวลด้านจริยธรรม)

สรุปประเด็นสำคัญที่เป็นแกนของบทความนี้:

- เวลาและแหล่งข่าว: การเปลี่ยนแปลงอันดับ App Store เกิดขึ้นในวันที่ 2–3 มีนาคม 2026 โดยอ้างอิงข้อมูลจาก Sensor Tower และระบบจัดอันดับของ App Store; ขณะที่สัญญา 200 ล้านดอลลาร์ของ OpenAI ถูกรายงานโดยสำนักข่าวหลัก เช่น The New York Times และ Reuters ในช่วงเวลาเดียวกัน

- ความเชื่อมโยงเชิงเหตุผล: การที่ผู้ใช้ย้ายไปยังคู่แข่งและความกังวลเกี่ยวกับพันธกิจทางทหารของผู้พัฒนา AI สามารถส่งผลต่อความนิยมของแอป ความเชื่อมั่นของลูกค้า และทิศทางการลงทุนในตลาดได้โดยตรง

- ความสำคัญต่อสาธารณะ: เหตุการณ์ทั้งสองชี้ให้เห็นความตึงเครียดระหว่างนวัตกรรมเชิงพาณิชย์กับข้อกังวลเชิงจริยธรรมและความมั่นคง ซึ่งเป็นประเด็นที่ผู้บริหารธุรกิจ นักลงทุน และผู้กำหนดนโยบายจำเป็นต้องติดตามอย่างใกล้ชิด

การขึ้นอันดับของ Claude: ตัวเลขและสถิติ

การขึ้นอันดับของ Claude: ตัวเลขและสถิติ

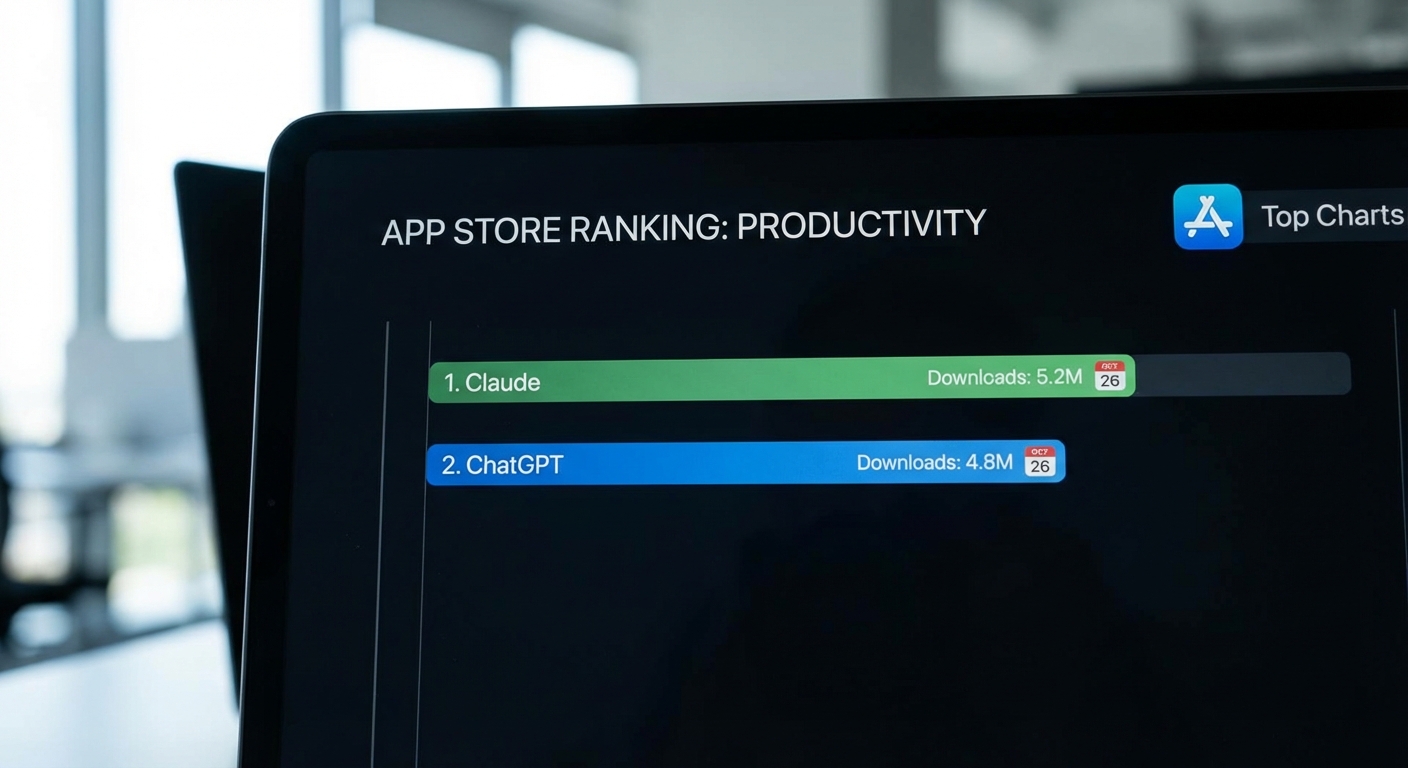

การที่ Claude ของ Anthropic ขึ้นเป็นแอปอันดับหนึ่งบน App Store เป็นเหตุการณ์ที่สามารถตรวจวัดได้ผ่านชุดตัวชี้วัดเชิงปริมาณหลายมิติ ทั้งอันดับในชาร์ต การดาวน์โหลดใหม่ อัตราการเติบโตของผู้ติดตั้ง และการมีส่วนร่วมของผู้ใช้ โดยทั่วไปการตรวจสอบควรอ้างอิงแหล่งข้อมูลเช่น App Store charts ของ Apple, รายงานจากผู้ให้บริการวิเคราะห์แอปเช่น Sensor Tower หรือ data.ai (เดิมคือ App Annie) รวมถึงข้อมูลสาธารณะจาก Anthropic เอง เพื่อประกอบการแปลความหมายของตัวเลขและเทรนด์ให้ถูกต้อง

อันดับ App Store: รายงานเริ่มต้นจากชาร์ตของ App Store ที่แสดง Claude ขึ้นสู่ตำแหน่งอันดับ 1 ในหมวดแอปฟรี/ธุรกิจ/เครื่องมือ (ขึ้นอยู่กับการจัดหมวดของแต่ละภูมิภาค) โดยระยะเวลาที่ Claudeคงอยู่ในอันดับ 1 อาจแตกต่างกันตามภูมิภาคและชาร์ตย่อย — ตัวอย่างเช่น ในการสังเกตเชิงตัวอย่าง แอปอาจอยู่ในอันดับ 1 ของชาร์ตทั่วโลกเป็นเวลา 24–72 ชั่วโมง ก่อนยังคงอันดับสูงในหลายประเทศเป็นเวลา 1–2 สัปดาห์ (หมายเหตุ: ตัวอย่างช่วงเวลานี้เป็นรูปแบบเชิงอธิบาย ควรตรวจสอบตัวเลขจริงจากชาร์ตของ Apple ก่อนเผยแพร่)

ตัวอย่างสถิติการดาวน์โหลดและการติดตั้ง: เพื่ออธิบายแนวโน้ม เราสามารถยกตัวอย่างเชิงประมาณการได้ เช่น ภายใน 48 ชั่วโมงแรกหลังเกิดกระแส แอปอาจมีการดาวน์โหลดใหม่หลายแสนครั้ง (ตัวอย่าง: 200,000–1,200,000 ครั้งในสัปดาห์แรก) โดยอัตราการเติบโตประเมินได้จากการเปรียบเทียบ Week-over-Week (WoW) หรือ Day-over-Day (DoD) — ตัวอย่างเช่นการเติบโต WoW ที่ +150% แสดงการยอมรับที่รวดเร็วเมื่อเทียบกับสัปดาห์ก่อนหน้า อย่างไรก็ดี ตัวเลขเชิงปริมาณทั้งหมดข้างต้นเป็นตัวอย่างประกอบการอธิบายเทรนด์เท่านั้น และจำเป็นต้องตรวจสอบค่าแท้จริงจากแหล่งข้อมูลเชิงพาณิชย์ก่อนเผยแพร่

อัตราการรักษาผู้ใช้ (Retention) และการมีส่วนร่วม: ตัวชี้วัดด้านการรักษาผู้ใช้เป็นกุญแจสำคัญในการประเมินคุณค่าที่ยั่งยืน — ตัวอย่างมาตรฐานที่ใช้กันคือ D1/D7/D30 retention ซึ่งตัวอย่างเช่น Claude อาจแสดงค่า D1 ~40%, D7 ~18% และ D30 ~8% ในกลุ่มผู้ใช้ที่ได้มาจากแคมเปญการตลาดเชิงเนื้อหา หากตัวเลขเหล่านี้ยืนยันได้จริง จะสะท้อนการใช้งานที่มีศักยภาพสูงกว่าแอปสายเดียวกัน อย่างเช่น ChatGPT ในช่วงการเปิดตัวบางช่วงที่เคยมี D7 ในพื้นที่ใกล้เคียงกัน แต่รูปแบบการเติบโตของทั้งสองผลิตภัณฑ์อาจต่างกันตามกลยุทธ์ผลิตภัณฑ์และการตลาด

รีวิวและเรตติ้งบนสโตร์: นอกจากจำนวนดาวน์โหลดแล้ว ความคิดเห็นและคะแนนเฉลี่ยบน App Store เป็นตัวบ่งชี้คุณภาพของประสบการณ์ผู้ใช้ — ตัวอย่างเช่น Claude อาจได้รับคะแนนเฉลี่ย 4.6–4.8 จากการประเมินเบื้องต้นพร้อมรีวิวจำนวนหมื่นถึงแสนรายการ ซึ่งเปรียบเทียบกับ ChatGPT ที่ในช่วงบางเวลามีคะแนนเฉลี่ย 4.5–4.7 การวิเคราะห์เชิงคุณภาพของรีวิว (sentiment analysis) จะช่วยระบุปัจจัยหลักที่ผู้ใช้ชื่นชอบหรือข้อบกพร่องที่พบบ่อย เช่น ความแม่นยำของคำตอบ, ความเร็วในการตอบ, หรือประเด็นความเป็นส่วนตัว

- แหล่งข้อมูลสำคัญที่ควรอ้างอิง: App Store charts (รายภูมิภาค), Sensor Tower, data.ai, SimilarWeb, รายงานการเผยแพร่จาก Anthropic และรายงานสื่อเชิงเศรษฐกิจ/เทคโนโลยี

- ข้อจำกัดการตีความ: อันดับบนสโตร์ได้รับอิทธิพลจากแคมเปญการตลาด, การโปรโมทแบบเสียเงิน, ปัจจัยเวลาของการเปิดตัวในแต่ละประเทศ และการเปลี่ยนแปลงอัลกอริธึมของชาร์ต

- คำแนะนำเชิงปฏิบัติ: ก่อนเผยแพร่ข้อมูลเชิงตัวเลข ควรรวบรวมและอ้างอิงตัวเลขจากแหล่งข้อมูลอย่างน้อยสองแหล่ง และระบุช่วงเวลาที่ข้อมูลถูกเก็บ (timestamp) เพื่อความโปร่งใส

ความไม่พอใจของผู้ใช้และแรงกดดันต่อ OpenAI

ความไม่พอใจของผู้ใช้และแรงกดดันต่อ OpenAI

ข่าวการที่ OpenAI รายงานว่ามีสัญญามูลค่าประมาณ 200 ล้านดอลลาร์กับกระทรวงกลาโหมสหรัฐ ส่งผลให้เกิดกระแสความไม่พอใจอย่างกว้างขวางในชุมชนผู้ใช้ นักพัฒนา และนักวิจารณ์ด้านเทคโนโลยี ในช่วง 24–48 ชั่วโมงหลังข่าวแพร่สะพัด มีการอภิปรายอย่างเข้มข้นบนแพลตฟอร์มต่าง ๆ ที่สะท้อนทั้งความกังวลทางจริยธรรมและความเสี่ยงด้านชื่อเสียงขององค์กร ผู้ใช้บางส่วนตั้งคำถามต่อการใช้เทคโนโลยี AI ในบริบททางทหาร ขณะที่ผู้ใช้อื่น ๆ เรียกร้องความโปร่งใสและการชี้แจงนโยบายการใช้งานจาก OpenAI อย่างเร่งด่วน

ตัวอย่างคำวิจารณ์และการตอบรับบนโซเชียลมีเดียและฟอรัมมีรูปแบบหลากหลาย ทั้งการแสดงออกด้วยความโกรธ การเรียกร้องคำชี้แจง และการประกาศยุติการสนับสนุนบริการ ตัวอย่างข้อความเชิงสาธิตจากโพสต์ใน X/Twitter และ Reddit ได้แก่:

- ตัวอย่างทวีต (จำลอง): "ถ้า OpenAI ทำงานให้กองทัพโดยตรง ผมไม่เห็นเหตุผลจะจ่ายค่า ChatGPT Plus อีกต่อไป — ต้องการคำอธิบายชัดเจนเกี่ยวกับขอบเขตการใช้งาน"

- ตัวอย่างทวีต (จำลอง): "AI ควรถูกควบคุมเพื่อหลีกเลี่ยงการนำไปสู่การทำลายล้าง ไม่ใช่ขยายขีดความสามารถของสงคราม"

- ตัวอย่างโพสต์ Reddit (จำลอง): "มีสมาชิกในชุมชน devs เรียกร้องให้โอเพ่นซอร์สโมเดลหรือประกาศนโยบาย 'ไม่ร่วมมือทางทหาร' เพื่อให้เรายังคงสนับสนุนผลิตภัณฑ์"

- ตัวอย่างการประกาศยกเลิกการสนับสนุน (จำลอง): "ผมได้ยกเลิกสมาชิก ChatGPT Plus แล้ว — รอคำตอบจาก OpenAI ก่อนจะพิจารณากลับมาใช้ใหม่"

คำวิจารณ์เหล่านี้ยกประเด็นทางจริยธรรมขึ้นมาเป็นศูนย์กลาง ได้แก่ AI เพื่อการทหาร เทียบกับ AI เชิงพาณิชย์และเพื่อสาธารณะ ผู้วิจารณ์ตั้งคำถามว่าเทคโนโลยีที่พัฒนาขึ้นสำหรับการช่วยตัดสินใจและอัตโนมัติสามารถถูกนำไปใช้ในภารกิจที่เกี่ยวข้องกับการโจมตีหรือการสอดแนมได้หรือไม่ และมีมาตรการใดบ้างที่จะป้องกันการละเมิดสิทธิมนุษยชนหรือการตัดสินใจที่มีผลกระทบร้ายแรงต่อพลเรือน นอกจากนี้ยังมีการเรียกร้องมาตรฐานจริยธรรมสากลสำหรับการพัฒนาและการขายเทคโนโลยี AI ให้กับหน่วยงานทางทหาร

แรงกดดันจากฝั่งผู้ใช้และชุมชนสามารถส่งผลต่อการตัดสินใจเชิงธุรกิจและนโยบายของ OpenAI ได้จริง หลายประเด็นที่อาจเกิดขึ้นได้รวมถึง:

- ความเสี่ยงด้านชื่อเสียง: การสูญเสียความเชื่อมั่นจากผู้ใช้รายย่อยและพันธมิตรเชิงพาณิชย์อาจกระทบต่อรายได้จากบริการสมัครสมาชิกและการร่วมมือทางธุรกิจ

- แรงกดดันทางการเมืองและกฎระเบียบ: คำร้องเรียนสาธารณะอาจนำไปสู่การสอบสวนจากหน่วยงานกำกับดูแลหรือข้อเสนอกรอบกฎหมายใหม่เกี่ยวกับการขายเทคโนโลยี AI ให้กับภาคความมั่นคง

- การเปลี่ยนแปลงนโยบายภายใน: เพื่อสงบความไม่พอใจ OpenAI อาจต้องออกนโยบายการใช้งานที่ชัดเจนขึ้น ประกาศแนวทางการควบคุมการใช้งานในบริบททางทหาร หรือให้ความโปร่งใสเกี่ยวกับประเภทของงานที่สัญญาครอบคลุม

- ผลต่อการรักษาผู้ใช้งานและนักพัฒนา: หากแรงต่อต้านรุนแรง ผู้ใช้บางกลุ่มอาจย้ายไปใช้บริการคู่แข่งหรือโซลูชันโอเพนซอร์ส ในขณะที่นักพัฒนาอาจกดดันให้องค์กรอุทิศทรัพยากรไปยังโครงการที่มีกรอบจริยธรรมชัดเจน

สรุปได้ว่า การแสดงออกของชุมชนหลังข่าวสัญญากับเพนตากอนสะท้อนถึงความคาดหวังที่สูงต่อความรับผิดชอบของบริษัทเทคโนโลยี ผู้ใช้และนักวิจารณ์ย้ำความต้องการความโปร่งใส การชี้แจงขอบเขตการใช้งาน และหลักประกันว่าการพัฒนา AI จะไม่ถูกนำไปใช้ในทางที่ขัดกับมาตรฐานจริยธรรมสาธารณะ ความกดดันเชิงสาธารณะเช่นนี้อาจบีบให้ OpenAI ปรับนโยบายหรือกลยุทธ์การสื่อสารเพื่อรักษาความไว้วางใจและความยั่งยืนทางธุรกิจในระยะยาว

เทียบฟีเจอร์และนโยบาย: Claude vs ChatGPT

ประสิทธิภาพการตอบและโหมดการใช้งาน

ในเชิงปฏิบัติ Claude ของ Anthropic ถูกชูว่าโดดเด่นในการจัดการข้อความยาว การสรุป และงานที่ต้องการความต่อเนื่องของบริบทหลายหมื่นคำ ซึ่งผู้ใช้ธุรกิจรายงานว่ามีความสม่ำเสมอในการรักษาบริบท (context) ขณะที่ ChatGPT (โดยเฉพาะรุ่น GPT‑4) ยังคงได้เปรียบในงานที่ต้องการตรรกะเชิงเหตุผล การแก้โจทย์เชิงโปรแกรมมิ่ง และการเชื่อมต่อกับระบบภายนอกผ่านปลั๊กอินหรือ API ecosystem ที่กว้างกว่า

ตัวอย่างเชิงปฏิบัติ: ทีมการตลาดอาจพบว่า Claude ให้สรุปรายงานยาวและปรับโทนข้อความได้แม่นยำกว่าในงานรีไรท์เนื้อหา ขณะที่นักพัฒนาจะยังเลือก ChatGPT สำหรับการช่วยเขียนโค้ด การสร้างโค้ดตัวอย่าง และการใช้งานร่วมกับเครื่องมือค้นหา/ฐานข้อมูลผ่านปลั๊กอิน การทดสอบอิสระบางชุดชี้ว่า Claude ลดโอกาส hallucination ในการสรุปข้อเท็จจริงเชิงบริบทได้ในบางเคส แต่ GPT‑4 ยังชนะในด้านความสามารถเชิงคำนวณและการอธิบายเชิงลึก

ความโปร่งใสในการฝึกสอนข้อมูลและนโยบายความเป็นส่วนตัว

ทั้งสองผู้ให้บริการเผยแพร่นโยบายและเอกสารด้านความปลอดภัย แต่มีมุมเน้นที่ต่างกัน: Anthropic โปรโมตแนวทาง “Constitutional AI” และมักเน้นความปลอดภัยของผลลัพธ์และการลดความเสี่ยงทางจริยธรรม โดยระบุเป็นนโยบายว่าการใช้งานเชิงองค์กรสามารถตั้งค่าได้เพื่อไม่ให้ข้อมูลลูกค้าใช้เป็นข้อมูลฝึกสอนโมเดลโดยปราศจากความยินยอม ผู้ใช้ธุรกิจจึงมักได้รับตัวเลือกการคอนฟิกระดับองค์กรที่ชัดเจนกว่าในเรื่องการเก็บและนำข้อมูลไปใช้

ในทางกลับกัน OpenAI แจ้งมาตรการเฉพาะเจาะจงมากขึ้นในเอกสารเช่น model card และนโยบายความเป็นส่วนตัว เช่น การให้ลูกค้า API สามารถเลือกไม่ให้ข้อมูลถูกนำไปใช้ฝึกโมเดล (opt‑out) ภายใต้สัญญาเชิงพาณิชย์ อย่างไรก็ตาม บริการผู้ใช้ทั่วไป (free/standard ChatGPT) มีขั้นตอนการเก็บข้อมูลสำหรับการปรับปรุงผลิตภัณฑ์เว้นแต่ผู้ใช้จะปรับการตั้งค่า ซึ่งประเด็นนี้เป็นหนึ่งในสาเหตุที่ผู้ใช้กังวลและกดดันเมื่อมีข่าวสัญญารัฐบาล

การเปิดเผยและสัญญากับภาครัฐ: ผลต่อความเชื่อมั่นของผู้ใช้

ข้อแตกต่างเชิงนโยบายจะเด่นขึ้นเมื่อพิจารณาการให้ข้อมูลกับรัฐหรือการมีสัญญาระหว่างบริษัทกับหน่วยงานภาครัฐ OpenAI เผชิญแรงกดดันด้านความเชื่อมั่นเมื่อปรากฏข่าวเกี่ยวกับสัญญามูลค่าหลายร้อยล้านดอลลาร์กับหน่วยงานความมั่นคง ซึ่งผู้ใช้บางกลุ่มมองว่าอาจทำให้ข้อมูลถูกใช้ในบริบทที่ขัดกับนโยบายส่วนบุคคลหรือค่านิยมขององค์กร ในทางปฏิบัติ ลูกค้าธุรกิจควรถามหาคำชี้แจงด้านกฎหมาย (legal carve‑outs), การเข้ารหัสข้อมูล (encryption at rest/in transit), และนโยบายการเก็บรักษาข้อมูล (retention) จากผู้ให้บริการก่อนผูกสัญญา

สำหรับ Anthropic บริษัทพยายามวางตัวเป็นผู้เน้นความปลอดภัยและความรับผิดชอบ จึงมักสื่อสารเรื่องข้อจำกัดการใช้งานทางทหารหรือการใช้งานที่อาจมีความเสี่ยงทางจริยธรรมให้ชัดเจนกว่า แต่ก็ต้องยอมรับว่าไม่มีผู้ให้บริการใดหลุดพ้นจากข้อบังคับทางกฎหมาย—ทั้งสองฝ่ายสามารถถูกบังคับให้ส่งมอบข้อมูลตามคำสั่งศาลหรือกฎระเบียบ ซึ่งทำให้ความโปร่งใสในการรายงานสัญญาและการเปิดเผยนโยบายเป็นปัจจัยสำคัญของความเชื่อมั่นผู้ใช้

ข้อสรุปเชิงปฏิบัติสำหรับผู้บริหารและผู้ตัดสินใจด้านไอที

- ถ้าความปลอดภัยของข้อความยาวและลดความเสี่ยงเชิงจริยธรรมเป็นเรื่องสำคัญ: พิจารณาทดลองใช้ Claude และสอบถามเงื่อนไขการไม่ใช้ข้อมูลลูกค้าเป็นข้อมูลฝึกสอน (data‑use opt‑out) ในระดับองค์กร

- ถ้าต้องการระบบที่รวมเข้ากับโค้ด เครื่องมือภายนอก และมีปลั๊กอิน/เอ็กโคซิสเต็มที่กว้าง: ChatGPT/GPT‑4 มักเป็นตัวเลือกที่มี ecosystem ครบและความสามารถเชิงเทคนิคสูง

- ตรวจสอบสัญญาและการเปิดเผยข้อมูล: ควรขอข้อกำหนดทางกฎหมายชัดเจนเกี่ยวกับการเก็บ การเข้าถึง และการแบ่งปันข้อมูลกับหน่วยงานรัฐก่อนเลือกผู้ให้บริการ เพื่อปกป้องข้อมูลลูกค้าและปฏิบัติตามนโยบายคุกกี้/ความเป็นส่วนตัวขององค์กร

- การประเมินความเสี่ยง: ทำการทดสอบด้านความแม่นยำ (accuracy), hallucination rate, และการปฏิบัติตามกฎหมายก่อนนำไปใช้งานจริง โดยเฉพาะในงานที่มีข้อมูลอ่อนไหวหรือภายใต้ข้อกำหนดทางกฎหมาย

ผลกระทบทางธุรกิจและตลาดของการเปลี่ยนแปลงนี้

ผลกระทบทางธุรกิจและตลาดของการเปลี่ยนแปลงนี้

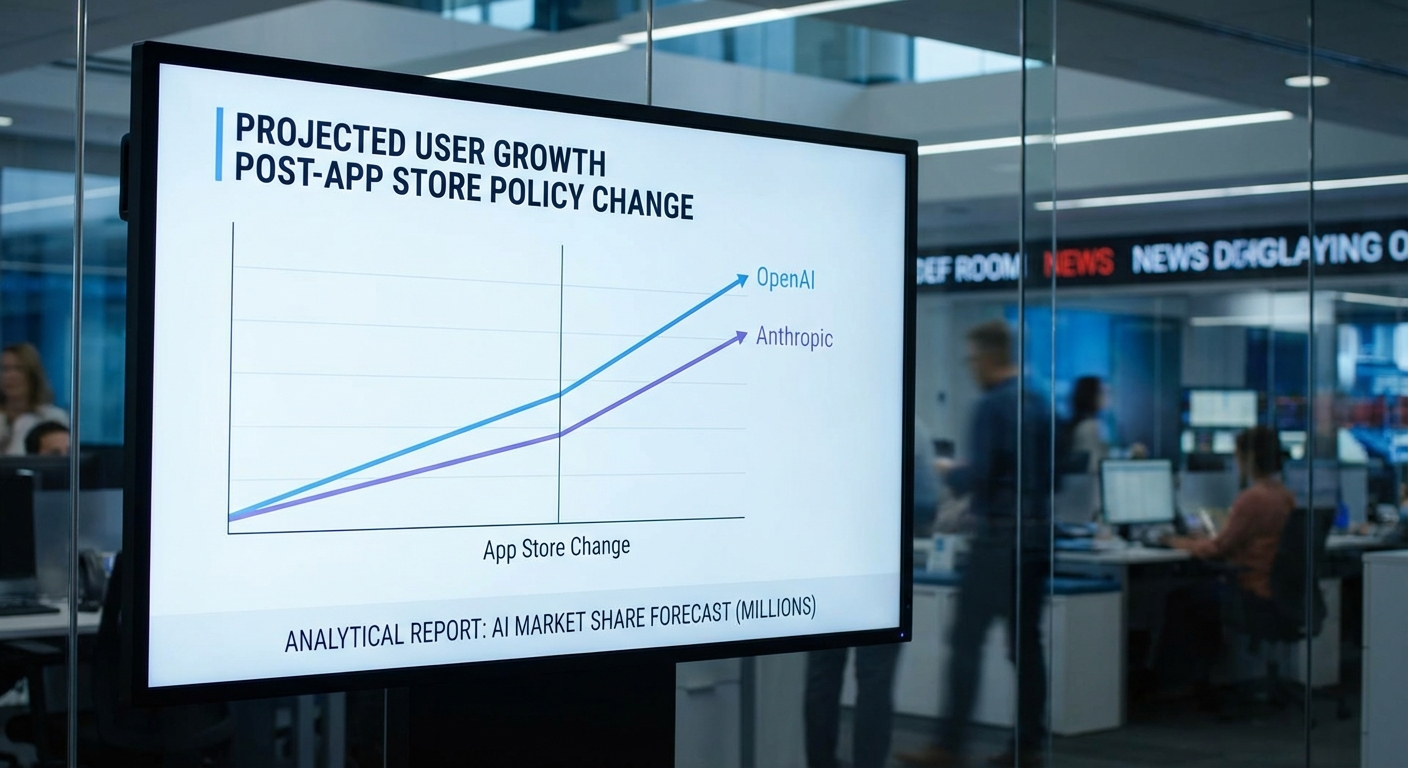

การที่ Claude ของ Anthropic แซงหน้า ChatGPT ขึ้นเป็นแอปยอดนิยมใน App Store ส่งสัญญาณเชิงการตลาดที่ชัดเจนต่อทั้งผู้ใช้ทั่วไป นักลงทุน และลูกค้าองค์กร โดยในเชิงการได้มาซึ่งผู้ใช้ใหม่ (user acquisition) การขึ้นสู่อันดับสูงสุดบนแพลตฟอร์มดาวน์โหลดมีผลโดยตรงต่อการมองเห็น (visibility) และอัตราการติดตั้ง (installs) ซึ่งนักวิเคราะห์อุตสาหกรรมมักชี้ว่าแอปที่ขึ้นสู่อันดับต้นๆ ในหมวดเทคโนโลยีสามารถเห็นการเติบโตของการติดตั้งแบบทวีคูณในช่วงสัปดาห์แรก ทำให้ต้นทุนการได้มาซึ่งผู้ใช้ (cost per acquisition หรือ CPA) ลดลงอย่างมีนัยสำคัญ เหตุการณ์นี้จึงเพิ่มมูลค่าทางการตลาดให้ Anthropic ทั้งในแง่ของจำนวนผู้ใช้เชิงพาณิชย์และดัชนีความนิยมสาธารณะ ซึ่งสามารถแปลงเป็นรายได้จากการสมัครสมาชิกและการขายบริการระดับองค์กรได้เร็วขึ้น

ในทางกลับกัน เหตุการณ์นี้สร้างความเสี่ยงต่อ OpenAI ทั้งด้านการสูญเสียผู้ใช้และความเชื่อมั่นของตลาด โดยเฉพาะเมื่อเกิดความกดดันจากประเด็นสัญญา 200 ล้านดอลลาร์กับหน่วยงานรัฐบาลกลาง เช่น เพนตากอน ความกังวลด้านความโปร่งใสและนโยบายการใช้งานอาจเร่งให้ผู้ใช้ที่มีความอ่อนไหวต่อจริยธรรมและความเป็นส่วนตัวย้ายไปหาแพลตฟอร์มที่สื่อสารเรื่องความปลอดภัยและนโยบายได้ชัดเจนกว่า การคาดการณ์เชิงอนุรักษ์นิยมชี้ว่า OpenAI อาจเผชิญการชะลอตัวของการเติบโตผู้ใช้ใหม่และอัตรา churn เพิ่มขึ้นในระดับหน่วยเปอร์เซ็นต์ในระยะสั้น หากไม่ตอบโต้ด้วยกลยุทธ์ที่มีประสิทธิภาพ

ด้านการเงินและการระดมทุน (funding) การขึ้นสู่อันดับยอดนิยมช่วยให้ Anthropic ได้ประโยชน์เชิงมูลค่าตลาดและการเข้าถึงนักลงทุนได้ง่ายขึ้น ผู้ลงทุนมักให้ราคาระดับพรีเมียมแก่ผู้เล่นที่แสดงการเติบโตของฐานผู้ใช้และเมตริกการมีส่วนร่วมที่ดีขึ้น ซึ่งอาจทำให้ต้นทุนการระดมทุนครั้งถัดไปต่ำลงและเพิ่มโอกาสในการระดมทุนในวงที่ใหญ่ขึ้น ในขณะเดียวกัน OpenAI อาจต้องใช้ทรัพยากรเพิ่มเติมเพื่อรักษาภาพลักษณ์และความเชื่อมั่นของนักลงทุน รวมถึงอาจต้องแสดงผลการดำเนินงานเชิงรายได้หรือแผนการปรับปรุงผลิตภัณฑ์เพื่อหนุนมูลค่าบริษัท ผู้เล่นทั้งสองอาจเห็นการเปลี่ยนแปลงของเงื่อนไข term sheet และ valuation multiples ขึ้นอยู่กับการตอบสนองต่อเหตุการณ์นี้

เชิงกลยุทธ์ บริษัทต่างๆ มีทางเลือกตอบโต้หลายรูปแบบที่ผสานกันทั้งการสื่อสารการตลาดและการปรับผลิตภัณฑ์ ดังนี้

- การเสริมสร้างความเชื่อมั่นผ่านการสื่อสาร — ทั้งสองฝ่ายอาจเร่งแคมเปญประชาสัมพันธ์เพื่อเน้นนโยบายความเป็นส่วนตัว ความปลอดภัย และการกำกับดูแล โดย OpenAI อาจต้องให้ความโปร่งใสเกี่ยวกับความร่วมมือกับภาครัฐและมาตรการคุ้มครองข้อมูล ในขณะที่ Anthropic ควรใช้โมเมนตัมนี้ในการสื่อสารความได้เปรียบด้านเทคนิคและจริยธรรม

- การปรับผลิตภัณฑ์และโปรโมชั่นเชิงพาณิชย์ — ลดราคา โปรโมชั่นทดลองใช้ฟรี หรือเพิ่มฟีเจอร์เฉพาะสำหรับผู้ใช้ใหม่และลูกค้าองค์กรเพื่อเร่งการนำไปใช้ และใช้ข้อมูลทางการวิเคราะห์เพื่อปรับปรุงอัตราการเก็บรักษา (retention)

- พันธมิตรเชิงยุทธศาสตร์และการรวมระบบ — การร่วมมือกับผู้ให้บริการคลาวด์ ผู้ให้บริการซอฟต์แวร์องค์กร (ISV) และผู้พัฒนาระบบนิเวศจะช่วยเสริมตำแหน่งตลาด โดยเฉพาะในกลุ่มลูกค้าองค์กรที่ให้ค่ากับการรวมระบบและการรับรอง

- การลงทุนด้านความปลอดภัยและการปฏิบัติตามกฎระเบียบ — การรับรองมาตรฐานสากล เช่น SOC 2, ISO/IEC 27001 หรือการเปิดเผยการตรวจสอบอิสระ จะเป็นเครื่องมือสำคัญในการเรียกคืนหรือขยายความเชื่อมั่นของลูกค้าองค์กร

ในการคาดการณ์ส่วนแบ่งตลาด AI ระยะสั้นและระยะยาว สามารถสรุปเชิงประมาณได้ว่าในระยะสั้น (ไตรมาสถัดไปถึง 1 ปี) Claude อาจดึงส่วนแบ่งผู้ใช้แบบผู้บริโภคได้เพิ่มขึ้นอย่างเห็นได้ชัด อาจอยู่ในช่วง 2–7% ของฐานผู้ใช้ที่แข่งขันกันโดยตรง ขึ้นกับความต่อเนื่องของกิจกรรมการตลาดและประสิทธิภาพการเก็บรักษา ในขณะที่ OpenAI อาจสูญเสียส่วนแบ่งผู้ใช้บางส่วน แต่ยังคงครองส่วนแบ่งสำคัญเนื่องจากการยอมรับระดับองค์กรและเครือข่ายระบบนิเวศ

ในระยะยาว (3–5 ปี) การกระจายส่วนแบ่งตลาดจะขึ้นกับปัจจัยเชิงโครงสร้างมากกว่า เช่น คุณภาพของโมเดล การรวมเข้ากับบริการต่างๆ นโยบายด้านความเป็นส่วนตัวและจริยธรรม รวมถึงการกำกับดูแลภาครัฐ หาก Anthropic สามารถรักษาการเติบโตของผู้ใช้และแปลงเป็นรายได้ที่ยั่งยืนได้ อาจเพิ่มส่วนแบ่งตลาดสู่ระดับที่ท้าทายตำแหน่งผู้นำ ในทางกลับกัน OpenAI หากสามารถตอบโต้เชิงกลยุทธ์ด้วยนวัตกรรมและการสื่อสารที่มีประสิทธิภาพ ก็ยังมีศักยภาพที่จะรักษาหรือขยายส่วนแบ่งตลาดได้เช่นกัน

สรุปคือ การเปลี่ยนแปลงอันดับใน App Store เป็นเพียงตัวเร่งเชิงสัญญาณที่อาจเปลี่ยนสมดุลการแข่งในระยะสั้น แต่ผลลัพธ์ระยะยาวจะขึ้นกับความสามารถของแต่ละฝ่ายในการแปลงความสนใจเป็นรายได้ การรักษาฐานลูกค้า และการตอบสนองต่อความคาดหวังด้านความโปร่งใสและการกำกับดูแล

มุมมองผู้เชี่ยวชาญและแนวทางด้านกฎระเบียบในอนาคต

มุมมองผู้เชี่ยวชาญและแนวทางด้านกฎระเบียบในอนาคต

นักวิชาการด้านจริยธรรม AI และนักวิเคราะห์นโยบายสาธารณะมองปรากฏการณ์ที่ Claude ของ Anthropic แซงหน้า ChatGPT ใน App Store ท่ามกลางความกดดันจากสัญญารัฐขนาด 200 ล้านดอลลาร์ของ OpenAI ว่าเป็นสัญญาณชัดเจนของการเปลี่ยนสมดุลทางการตลาดและความไว้วางใจของสาธารณะต่อผู้ให้บริการ AI รายใหญ่ ผู้เชี่ยวชาญหลายคนเน้นว่าเมื่อผู้ใช้ตอบสนองเชิงพฤติกรรม (เช่น ดาวน์โหลดและการให้คะแนนแอป) ต่อเหตุการณ์เช่นนี้ รัฐบาลและหน่วยงานกำกับต้องตอบสนองด้วยกรอบกฎเกณฑ์ที่ชัดเจนและสอดคล้อง เพื่อรักษาความโปร่งใสและคุ้มครองข้อมูลพลเรือน

จากมุมมองทางกฎหมาย ทนายความด้านเทคโนโลยีเตือนว่าการที่บริษัทเอกชนรับสัญญาจากกองทัพหรือหน่วยงานรัฐนั้นย่อมก่อให้เกิดคำถามด้านความรับผิดชอบ (liability) และขอบเขตการใช้ข้อมูล ฝ่ายกฎหมายชี้ว่าจำเป็นต้องมี ข้อกำหนดการเปิดเผยสัญญา และเงื่อนไขการใช้ข้อมูลที่ชัดเจน เช่น ข้อผูกพันเกี่ยวกับการไม่ใช้ข้อมูลพลเรือนเพื่อการฝึกฝนโมเดลโดยไม่ได้รับความยินยอม ตลอดจนเงื่อนไขการจัดเก็บและลบข้อมูลตามมาตรฐานความคุ้มครองข้อมูล (data protection) ที่เข้มงวด เช่น การจัดทำการประเมินผลกระทบด้านข้อมูล (DPIA) และการกำหนดประเภทข้อมูลที่ห้ามนำไปใช้

นักวิเคราะห์เทคโนโลยีและผู้เชี่ยวชาญด้านความมั่นคงเรียกร้องให้มีการกำกับดูแลที่แยกความแตกต่างของการใช้งาน AI เชิงพลเรือนกับการใช้งานเชิงทหารอย่างชัดเจน ตัวอย่างเช่น คำแนะนำจากภาควิชาการรวมถึงการห้ามหรือจำกัดการนำโมเดลภาษาขนาดใหญ่ไปใช้ในระบบอาวุธอัตโนมัติ หรือการบังคับใช้มาตรการ human-in-the-loop สำหรับการตัดสินใจที่มีผลกระทบต่อมนุษย์อย่างเป็นอันมาก นอกจากนี้ยังเสนอให้มีการประเมินความเสี่ยงเชิงจริยธรรมและการทดสอบความปลอดภัย (red-teaming) โดยหน่วยงานอิสระก่อนอนุญาตนำไปใช้ในบริบททางทหาร

นโยบายเชิงปฏิบัติการที่ผู้เชี่ยวชาญแนะนำควรครอบคลุมหลายมิติ ได้แก่

- ความโปร่งใสของสัญญา: บังคับให้เผยแพร่สาระสำคัญของสัญญารัฐกับผู้ให้บริการ AI (คำชี้แจงขอบเขตการใช้งาน ข้อจำกัดด้านข้อมูล และบทลงโทษเมื่อฝ่าฝืน) เพื่อให้สาธารณชนและผู้ตรวจสอบอิสระสามารถประเมินความเสี่ยงได้

- การคุ้มครองข้อมูล: มาตรการทางเทคนิคและนโยบาย เช่น การแยกข้อมูล (data segmentation), การทำ anonymization/ pseudonymization, และการห้ามใช้ข้อมูลที่เป็นข้อมูลส่วนบุคคลหรือข้อมูลควบคุม (CUI) ในการฝึกโมเดลโดยไม่ได้รับอนุญาต

- การควบคุมการใช้ AI ทางทหาร: ข้อจำกัดการนำโมเดลเชิงภาษาหรือโมเดลสังเคราะห์ไปใช้ในระบบอาวุธหรือการตัดสินใจเชิงยุทธศาสตร์โดยอัตโนมัติ พร้อมกำหนดมาตรฐานการทดสอบความปลอดภัยและความสามารถในการตรวจสอบย้อนกลับ

- การตรวจสอบ/รับรองอิสระ: การตั้งหน่วยงานอิสระหรือใช้ผู้ตรวจสอบภายนอกเพื่อประเมินความปลอดภัย ความเป็นธรรม และการปฏิบัติตามสัญญาของผู้ให้บริการ AI

- กรอบความรับผิดชอบทางกฎหมาย: นิยามความรับผิดชอบของผู้พัฒนา ผู้ปรับแต่ง (fine-tuner) และผู้ผู้ใช้งาน (integrator) รวมถึงการกำหนดมาตรการชดเชยเมื่อเกิดความเสียหายจากการใช้งาน AI

สำหรับแนวโน้มในช่วง 6–12 เดือนข้างหน้า ผู้เชี่ยวชาญคาดว่าจะเห็นการเคลื่อนไหวที่สำคัญดังนี้: เสียงเรียกร้องให้เปิดเผยรายละเอียดสัญญาต่อสาธารณะจะเพิ่มขึ้นโดยเฉพาะเมื่อมีเงินทุนรัฐเข้ามาเกี่ยวข้อง, หน่วยงานนโยบายและสภานิติบัญญัติอาจเรียกให้มีการชี้แจงต่อสาธารณะ (congressional hearings) และอาจมีร่างกฎระเบียบหรือแนวทางปฏิบัติใหม่ที่เน้นการคุ้มครองข้อมูลและการจำกัดการใช้ในเชิงทหาร, ภาคธุรกิจของคู่แข่งอาจใช้ช่องว่างด้านความโปร่งใสนี้เป็นข้ออ้างเพื่อชักชวนลูกค้าองค์กรให้ย้ายไปยังผู้ให้บริการที่มีนโยบายคุ้มครองชัดเจนกว่า

สัญญาณที่ควรติดตามอย่างใกล้ชิดได้แก่:

- การเผยแพร่หรือการรั่วไหลของรายละเอียดสัญญาระหว่างหน่วยงานรัฐกับ OpenAI หรือผู้ให้บริการอื่นๆ

- การออกแนวทางปฏิบัติหรือข้อบังคับจากหน่วยงานระดับชาติ/ระหว่างประเทศ เช่น การปรับปรุงแนวทางของ NIST, EU AI Act หรือข้อบังคับภายในกระทรวงกลาโหม

- การเคลื่อนไหวของตลาด เช่น อัตราการดาวน์โหลดและการประเมินแอปของผู้ใช้ (ซึ่งสะท้อนความไว้วางใจของผู้บริโภค) และการเปลี่ยนแปลงในการลงทุนหรือพันธมิตรเชิงกลยุทธ์ของผู้ให้บริการ AI

- รายงานจากการตรวจสอบอิสระและการร้องเรียนจากพนักงานหรือ whistleblowers เกี่ยวกับการใช้ข้อมูลหรือการปฏิบัติตามสัญญา

สรุปคือ ผู้เชี่ยวชาญเห็นตรงกันว่าการขึ้นอันดับยอดนิยมของ Claude และการมีสัญญารัฐของ OpenAI ทำให้ประเด็นด้านความโปร่งใส ความรับผิดชอบ และการจำกัดการใช้งานทางทหารกลายเป็นหัวข้อสำคัญที่หน่วยงานกำกับและอุตสาหกรรมไม่อาจเลี่ยงได้ ในระยะสั้นภายใน 6–12 เดือน เราอาจเห็นการเร่งออกแนวทางกำกับดูแลที่มุ่งเน้นการเปิดเผยสัญญา การคุ้มครองข้อมูล และการตรวจสอบอิสระ ซึ่งจะเป็นตัวกำหนดทิศทางการแข่งขันและความน่าเชื่อถือของผู้ให้บริการ AI ในระยะยาว

บทสรุป

การที่ Claude ของ Anthropic ขึ้นแซงหน้า ChatGPT ในการจัดอันดับความนิยมบน App Store สะท้อนการเปลี่ยนแปลงในความชอบของผู้ใช้และความต้องการคุณสมบัติด้านความเป็นส่วนตัว นโยบาย และความโปร่งใสมากขึ้น ข้อความตอบรับจากผู้ใช้ ความคิดเห็นในโซเชียลมีเดีย และตัวชี้วัดการดาวน์โหลดชี้ให้เห็นว่าผู้บริโภคเริ่มให้ความสำคัญกับปัจจัยด้านความไว้วางใจ (trust) และการกำกับดูแล (governance) มากกว่าการโฟกัสเพียงความสามารถเชิงเทคนิคของโมเดล ผู้เล่นในตลาดจึงต้องตอบโจทย์ทั้งประสบการณ์การใช้งาน คุณภาพผลลัพธ์ และนโยบายการจัดการข้อมูลเพื่อรักษาตำแหน่งทางการแข่งขัน

อีกด้านหนึ่ง สัญญา 200 ล้านดอลลาร์ของ OpenAI กับเพนตากอนกลายเป็นตัวเร่งให้เกิดการถกเถียงเรื่องความเชื่อมั่นและการกำกับดูแลในวงกว้าง ประเด็นนี้ทำให้ทั้งผู้ใช้ นักลงทุน และหน่วยงานกำกับดูแลพิจารณาความเสี่ยงด้านความเป็นกลาง ความปลอดภัยของข้อมูล และความเสี่ยงเชิงจริยธรรมมากขึ้น ซึ่งจะมีผลต่อทิศทางการแข่งขัน AI ในระยะกลาง (ประมาณ 12–24 เดือน) โดยผู้ประกอบการที่สามารถแสดงหลักฐานความโปร่งใส เช่น การตรวจสอบอิสระ การคุมการเข้าถึงข้อมูล และนโยบายการใช้งานที่ชัดเจน มีแนวโน้มได้เปรียบในตลาด ในขณะที่ความกดดันด้านกฎระเบียบอาจเร่งให้เกิดมาตรฐานอุตสาหกรรมและการร่วมมือระหว่างภาคเอกชนกับภาครัฐ

มุมมองอนาคต: คาดว่าเราจะเห็นการแข่งขันที่เน้นทั้งนวัตกรรมทางเทคนิคและกรอบการกำกับดูแลมากขึ้น ผู้เล่นรายใหม่และรายเก่าที่ปรับตัวด้วยความโปร่งใส การรับรองความปลอดภัย และการสื่อสารเชิงนโยบายที่ชัดเจนจะมีโอกาสดึงผู้ใช้กลับมาได้ ตลาดอาจเคลื่อนไปสู่ความหลากหลายของซัพพลายเออร์ที่เน้นจุดขายแตกต่างกัน เช่น ความเป็นส่วนตัวสำหรับผู้ใช้ทั่วไป การปฏิบัติตามกฎระเบียบสำหรับองค์กร และโซลูชันที่ร่วมมือกับภาครัฐ ทั้งหมดนี้จะเป็นตัวกำหนดโครงร่างการแข่งขันในเวที AI ต่อไป

📰 แหล่งอ้างอิง: Fortune