คลิปวิดีโอปลอมที่ใช้เทคโนโลยีปัญญาประดิษฐ์สังเคราะห์ฉากต่อสู้ระหว่าง Tom Cruise และ Brad Pitt กลายเป็นไวรัลในชั่วข้ามคืน — ภาพสมจริงจนแยกไม่ออกจากฉบับจริง ทำให้ผู้ชมตั้งคำถามทันทีว่าข้อมูลภาพและเสียงที่เห็นยังเชื่อถือได้แค่ไหน โลกบันเทิงที่ขึ้นชื่อเรื่องการสร้างภาพลวงตากลับต้องเผชิญกับภาพลวงตาที่สร้างขึ้นด้วยรหัสและอัลกอริทึม ขณะเดียวกันเหตุการณ์นี้ยังสะท้อนปัญหาทางกฎหมาย จริยธรรม และความปลอดภัยที่ทวีความซับซ้อนขึ้นเมื่อเครื่องมือสร้างสื่อเทียมแพร่หลายและเข้าถึงได้ง่าย

บทความนี้จะพาผู้อ่านเจาะทุกมิติของเหตุการณ์ ตั้งแต่เทคนิคเบื้องหลังการสังเคราะห์วิดีโอ (โมเดลการเรียนรู้เชิงลึก การฝึกข้อมูล และเทคนิคโบกัสใบหน้า) ผลกระทบต่อนักแสดงและสตูดิโอ (สิทธิ์ภาพลักษณ์ ค่าเสียหายทางการเงิน และชื่อเสียง) ไปจนถึงคำถามเชิงนโยบายและแนวทางรับมือที่เป็นไปได้ ทั้งมาตรการตรวจจับ การออกกฎหมายคุ้มครอง และแนวปฏิบัติของอุตสาหกรรมเพื่อป้องกันการละเมิดและลดความเสี่ยงเมื่อโลกภาพยนตร์ต้องเผชิญกับยุคของเนื้อหาเทียม

บทนำ: เหตุการณ์และผลกระทบทันที

บทนำ: เหตุการณ์และผลกระทบทันที

ในช่วงเวลากลางคืนของวันศุกร์ที่ผ่านมา มีการเผยแพร่คลิปวิดีโอความยาวประมาณ 90 วินาทีบนแพลตฟอร์มวิดีโอสั้นและเครือข่ายสังคมออนไลน์หลายแห่ง ซึ่งแสดงฉากการต่อสู้ที่เหมือนจริงระหว่าง Tom Cruise และ Brad Pitt โดยภายในไม่กี่ชั่วโมงคลิปดังกล่าวกลายเป็นไวรัล ถูกโพสต์ซ้ำบน TikTok, X (เดิมคือ Twitter), และ YouTube Shorts รวมถึงแชร์ต่อบนกลุ่มและช่องทางส่วนตัวอื่นๆ ทำให้ยอดเข้าชมรวมทะลุหลักหลายล้านครั้งภายใน 24 ชั่วโมงแรก

ปฏิกิริยาตอบรับในชั่วโมงและวันแรกออกมาอย่างหลากหลาย — ผู้ชมจำนวนมากแสดงความตื่นเต้นและแชร์คลิปในเชิงบันเทิง แต่ขณะเดียวกันก็มีเสียงเตือนเกี่ยวกับความถูกต้องของภาพ โดยแฮชแท็กที่เกี่ยวข้องขึ้นเทรนด์บนหลายแพลตฟอร์ม และสำนักข่าวเทคโนโลยีหลายแห่งรายงานว่าการค้นหาชื่อทั้งสองนักแสดงบนเครื่องมือค้นหาเพิ่มขึ้นอย่างรวดเร็ว ตัวเลขเบื้องต้นจากเครื่องมือวิเคราะห์สื่อสังคมระบุว่าอัตราการแชร์และการกล่าวถึงเพิ่มขึ้นหลายพันเปอร์เซ็นต์ในช่วง 12–24 ชั่วโมงแรก

คำถามเร่งด่วนที่เกิดขึ้นทันทีคือ ใครเป็นผู้รับผิดชอบต่อการสร้างและเผยแพร่คลิปดังกล่าว และ ใครได้รับผลกระทบ มากที่สุด — ประเด็นที่ถูกหยิบยกได้แก่ ภาระความรับผิดชอบของผู้สร้างเนื้อหาเทียม เจ้าของแพลตฟอร์มที่เผยแพร่ และผู้พัฒนาเครื่องมือ AI ที่ใช้ในการสังเคราะห์ภาพ/เสียง อีกทั้งยังมีความกังวลเรื่องความเสียหายต่อชื่อเสียงของนักแสดง การละเมิดสิทธิ์ภาพลักษณ์ และการใช้คลิปเพื่อจุดประสงค์ที่เป็นอันตราย เช่น การบิดเบือนข้อมูลหรือการชักนำมุมมองทางการเมือง

- แพลตฟอร์มที่เผยแพร่และช่วงเวลา: โพสต์ต้นทางปรากฏบน TikTok/X/YouTube Shorts ในช่วงกลางคืนและเริ่มถูกแชร์อย่างรวดเร็วภายในชั่วโมงแรก

- การแพร่กระจาย: ยอดเข้าชมและการกล่าวถึงเพิ่มขึ้นเป็นหลักหลายล้านครั้งภายใน 24 ชั่วโมง (ตัวเลขเบื้องต้นจากการวิเคราะห์โซเชียล)

- ปฏิกิริยาเบื้องต้น: มีทั้งการยืนยันว่าเป็นความบันเทิง การตั้งคำถามเกี่ยวกับความถูกต้อง และการเรียกร้องให้แพลตฟอร์มลบหรือจำกัดการเข้าถึง

- ข้อเท็จจริงสำคัญที่ต้องรู้ก่อนวิเคราะห์เชิงลึก: คลิปถูกสร้างด้วยเทคโนโลยีสังเคราะห์ภาพ/เสียง (deepfake/AI-generated), ยังไม่มีการยืนยันจากตัวแทนนักแสดงหรือสตูดิโอเกี่ยวกับความเกี่ยวข้องใดๆ, และยังไม่มีคำตัดสินทางกฎหมายหรือการดำเนินการของแพลตฟอร์มในระยะยาว

ข้อมูลเบื้องต้นเหล่านี้เป็นกรอบสำคัญก่อนเข้าสู่การวิเคราะห์เชิงลึกที่จะพิจารณาเรื่องจริยธรรม กฎหมาย ความรับผิดชอบของแพลตฟอร์ม และผลกระทบต่ออุตสาหกรรมฮอลลีวูดในระยะยาว ทั้งต่อสัญญาการงาน การคุ้มครองสิทธิของศิลปิน และการกำกับดูแลเทคโนโลยี AI ที่สามารถสร้างเนื้อหาจำลองได้อย่างสมจริง

พื้นหลังเทคโนโลยี: ทำไม AI สามารถสร้างคลิปแบบนี้ได้

พื้นหลังเทคโนโลยี: ทำไม AI สามารถสร้างคลิปแบบนี้ได้

ในช่วงไม่กี่ปีที่ผ่านมา เทคโนโลยีการสร้างเนื้อหาเชิงสังเคราะห์ (generative AI) เข้าสู่จุดที่สามารถสร้างภาพและวิดีโอที่มีความสมจริงในระดับสูงได้อย่างรวดเร็ว การเปลี่ยนแปลงนี้มาจากการผสานกันของหลายปัจจัย ได้แก่ การพัฒนาแบบจำลองเชิงลึก (deep learning) ที่มีประสิทธิภาพมากขึ้น การเปิดเผยโมเดลและโค้ดแบบเปิด (open-source) การเข้าถึงฮาร์ดแวร์ประมวลผลที่ทรงพลังในราคาถูกลง และเครื่องมือที่เป็นมิตรกับผู้ใช้ทั่วไป ผลลัพธ์คือการลดความยากและต้นทุนในการสร้างคลิปปลอมลงอย่างมาก ทำให้บุคคลทั่วไปหรือกลุ่มที่มีทักษะปานกลางก็สามารถผลิตเนื้อหาเทียมที่ดูเป็นมืออาชีพได้

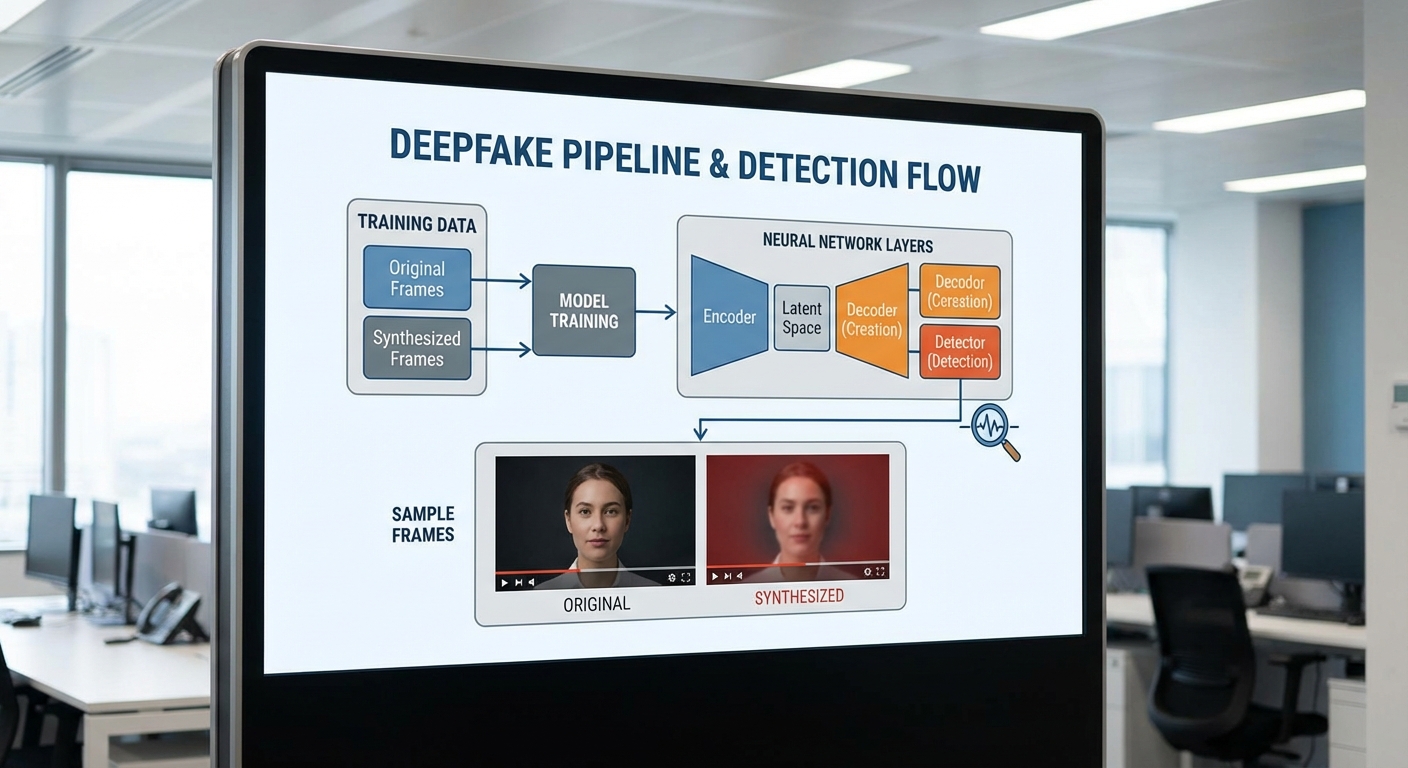

เทคโนโลยีแกนกลาง ที่อยู่เบื้องหลังคลิปปลอมหลัก ๆ ได้แก่ GANs, diffusion models และโมเดลสังเคราะห์วิดีโอ โดยแต่ละแบบมีลักษณะและบทบาทเฉพาะตัว:

- GANs (Generative Adversarial Networks) — เป็นสถาปัตยกรรมที่ถูกเสนอครั้งแรกโดย Ian Goodfellow ในปี 2014 โดยวางเครือข่ายสร้างภาพ (generator) แข่งกับเครือข่ายแยกแยะ (discriminator) ทำให้ generator พัฒนาคุณภาพจนสร้างภาพที่ดูสมจริงขึ้น เหมาะกับการสลับใบหน้า (face-swap) และการปรับปรุงคุณภาพภาพ

- Diffusion models — กลุ่มโมเดลที่เรียนรู้การแปลงสัญญาณจาก 'เสียงรบกวน' กลับเป็นข้อมูลเชิงภาพทีละขั้นตอน (denoising) ซึ่งเริ่มเป็นที่นิยมตั้งแต่ช่วงปี 2020 เป็นต้นมา ด้วยคุณภาพภาพที่สูงและความเสถียร ทำให้โมเดลประเภทนี้เป็นรากฐานของระบบสร้างภาพสมัยใหม่ (เช่น Stable Diffusion, DALL·E 2 ในแง่ของแนวคิด) และต่อมาถูกต่อยอดเป็นโมเดลวิดีโอ

- โมเดลวิดีโอสังเคราะห์ — การสร้างวิดีโอมีความท้าทายเพิ่มขึ้นเนื่องจากต้องรักษาความสม่ำเสมอของเคลื่อนไหวและลักษณะเฉพาะของใบหน้าในหลายเฟรม แนวทางปัจจุบันใช้การผสมผสานระหว่าง latent diffusion, temporal modeling และการคอนดิชันด้วยข้อความ/ภาพต้นทาง ผลลัพธ์เช่น Make‑A‑Video, Imagen Video หรือ Runway Gen‑2 แสดงให้เห็นว่าการสร้างคลิปสั้นที่มีการเคลื่อนไหวและสภาพแสงสมจริงเป็นไปได้ในเชิงปฏิบัติ

- สังเคราะห์เสียงและการโคลนเสียง — ระบบ text‑to‑speech และ neural vocoders เช่น WaveNet, Tacotron และรุ่นต่อมา สามารถจำลองน้ำเสียง จังหวะ และลักษณะเฉพาะของผู้พูดได้ใกล้เคียงจริง ซึ่งเมื่อรวมกับการสลับหน้า (face‑sync) จะทำให้วิดีโอปลอมสมจริงยิ่งขึ้น

การพัฒนาที่สำคัญในช่วงไม่กี่ปีมานี้คือการย้ายจากการวิจัยในห้องทดลองสู่การใช้งานจริง: โมเดลหลายตัวถูกปล่อยเป็นโอเพนซอร์สหรือมี API ให้ใช้งาน ทำให้ชุมชนนักพัฒนาและนักสร้างคอนเทนต์นำไปต่อยอดได้รวดเร็ว นอกจากนี้ ความก้าวหน้าทางฮาร์ดแวร์ (เช่น GPU และ TPU ที่เข้าถึงได้ผ่านคลาวด์) ช่วยลดค่าใช้จ่ายด้านการฝึกสอนและการสังเคราะห์จนผู้ใช้ทั่วไปสามารถสร้างคลิปสั้น ๆ ด้วยคุณภาพสูงได้ในเวลาไม่นาน

ตัวอย่างเหตุการณ์จริงและแนวโน้มเชิงสถิติ

มีตัวอย่างที่เป็นที่รู้จักและสะท้อนความเสี่ยงของเทคโนโลยีนี้หลายกรณี เช่น วิดีโอของอดีตประธานาธิบดีสหรัฐที่ Jordan Peele ทำร่วมกับเทคนิค deepfake เพื่อเตือนภัยในปี 2018, คลิปที่ถูกปรับความเร็วทำให้ Nancy Pelosi ดูพูดจาสับสนซึ่งแพร่หลายในปี 2019, กรณีการโจรกรรมทางการเงินที่อ้างว่าใช้การโคลนเสียงเพื่อหลอกให้ผู้บริหารโอนเงิน (มีการรายงานเหตุการณ์ในปี 2019 ที่บริษัทหนึ่งสูญเงินหลายแสนยูโร) และกรณีคลิป Tom Cruise บน TikTok ที่ปรากฏในช่วงปี 2021–2022 ซึ่งสร้างความสับสนและมียอดดูรวมเป็นหลักหลายสิบล้านครั้งก่อนที่บางส่วนจะถูกเผยว่าเป็นงานสังเคราะห์

เชิงสถิติและแนวโน้ม หลายรายงานชี้ว่าจำนวนเนื้อหา deepfake เพิ่มขึ้นอย่างทวีคูณในช่วงหลายปีที่ผ่านมา ตัวอย่างเช่น รายงานจาก Sensity (เดิมคือ Deeptrace) ระบุว่าเนื้อหา deepfake มีการเติบโตอย่างรวดเร็วและมีสัดส่วนของเนื้อหาที่เป็นสื่อเชิงลามกสูง — รายงานฉบับปี 2019 ระบุว่าเกือบทั้งหมดของวิดีโอ deepfake ที่ตรวจพบเป็นเนื้อหาทางเพศ ซึ่งชี้ให้เห็นถึงการใช้งานที่ไม่ชอบธรรมอย่างแพร่หลาย ขณะเดียวกันองค์กรวิจัยและบริษัทตรวจจับก็รายงานการพบคลิปปลอมในระดับที่เพิ่มขึ้นทุกปี

สาเหตุที่ทำให้ปัญหานี้ทวีความรุนแรงคือการผสานกันของปัจจัยหลายด้าน: คุณภาพของโมเดลที่สูงขึ้นควบคู่กับ การเข้าถึงเครื่องมือและข้อมูลฝึกสอนที่ง่ายขึ้น, การเผยแพร่โมเดลโอเพนซอร์ส (เช่น Stable Diffusion ในด้านภาพ) ที่นำไปสู่การดัดแปลงเป็นโมเดลวิดีโอแบบสาธารณะ, และการเติบโตของแพลตฟอร์มโซเชียลที่ช่วยให้คลิปแพร่กระจายได้อย่างรวดเร็ว เมื่อรวมกับเทคนิคการปรับแต่งเสียงและการตัดต่ออัตโนมัติ ผลลัพธ์คือคลิปปลอมที่แทบจะแยกจากของจริงไม่ได้ด้วยตาเปล่า

ด้วยเหตุนี้ ภาคอุตสาหกรรมบันเทิงและหน่วยงานกำกับดูแลจึงต้องตั้งคำถามใหม่เกี่ยวกับสิทธิ์ของบุคคล การปกป้องภาพลักษณ์ การพิสูจน์ความเป็นของจริง (authenticity) และแนวทางการตรวจจับ/ป้องกันที่ทันต่อการเปลี่ยนแปลงของเทคโนโลยี หากไม่ได้รับการจัดการอย่างมีประสิทธิภาพ เทคโนโลยีสังเคราะห์จะสามารถเปลี่ยนแปลงภูมิทัศน์การสื่อสารสาธารณะและอุตสาหกรรมบันเทิงได้อย่างรวดเร็วและกว้างขวาง

ชำแหละคลิป: รายละเอียดของวิดีโอ AI ที่ถูกแชร์

ชำแหละคลิป: รายละเอียดของวิดีโอ AI ที่ถูกแชร์

คลิปวิดีโอดังกล่าวมีความยาวโดยรวมประมาณ 52–68 วินาที แบ่งเป็นฉากย่อย 6–8 ช็อตสั้นที่เชื่อมต่อด้วยการตัดต่อรวดเร็ว (quick cuts) เพื่อสร้างจังหวะการต่อสู้ที่เข้มข้น ฉากเริ่มต้นเป็นการเปิดแผนภาพกว้าง (wide establishing shot) ของสตูดิโอหรือถนนกลางเมือง ก่อนจะตัดเข้าสู่ช็อตกลางและช็อตใกล้ (medium/close-up) ขณะที่ตัวละครทั้งสองแลกหมัด โดยมีการใช้กล้องที่เคลื่อนไหวแบบ handheld และ occasional whip pan เพื่อสร้างความรู้สึกสมจริงและไดนามิกของภาพยนตร์แอ็กชันระดับฮอลลีวูด

เชิงเสียงคลิปมีการผสมผสานระหว่างสัญญาณเสียงสภาพแวดล้อม (ambient noise), เอฟเฟกต์เสียงต่อสู้ (impact hits, cloth rustle, footstep thuds) และมิกซ์ดนตรีประกอบสั้น ๆ ที่เพิ่มความตื่นเต้น ซาวด์ดีไซน์แยกชั้นอย่างชัดเจน เช่น การเพิ่ม reverb เล็กน้อยเมื่อตัวละครถูกผลัก และการคอมเพรสเสียงเพื่อให้คำพูดของทั้งสองโดดเด่นเหนือเอฟเฟกต์ นอกจากนี้ยังมีการใช้การซิงค์ปาก (lip-sync) ที่ละเอียดพอสมควร โดยเสียงพูดที่ได้ยินเป็นเสียงที่ผ่านการโคลนเสียง (voice cloning) หรือ TTS ปรับโทน ให้เข้ากับบุคลิกของบุคคลในคลิป

ลักษณะเชิงภาพที่ทำให้คลิปดูสมจริงมีหลายประการที่ควรสังเกต: การไล่โทนสี (color grading) แบบภาพยนตร์ ทำให้ผิวและเงาดูสอดคล้องในทุกช็อต; การใส่ grain เล็กน้อยและ motion blur ตรงช่วงเคลื่อนไหวเร็วเพื่อปกปิดขอบการสว็อปของใบหน้า; การใช้ depth of field ที่จำกัดเพื่อเบลอพื้นหลังและลดความผิดปกติของคอมโพสิต; รวมทั้งการใส่แสงเงาแบบ local specular highlights ที่ช่วยให้ refraction ของใบหน้าและแววตาดูมีมิติ อย่างไรก็ตาม สัญญาณบ่งชี้ว่าภาพถูกสังเคราะห์ยังคงปรากฏ เช่น ขอบรอบหูและเส้นผมที่มีการฉายซ้อนผิดปกติ (haloing), การสะดุดของ micro-expressions, และการสั่นเล็ก ๆ ในเฟรมบางช่วงจากการรวมชิ้นส่วนภาพ (temporal inconsistency)

ตัวอย่างเฟรมสำคัญที่ผู้เชี่ยวชาญมักชี้ให้สังเกตเพื่อประเมินความสมจริงของคลิป ได้แก่ (1) เฟรมที่แสดงการปะทะแบบใกล้ชิด—สังเกตการสะท้อนในดวงตา (eye highlights) และเส้นเลือดบนใบหน้า; (2) เฟรม slow-motion ของหมัดที่พุ่งมา—เพื่อดูการเบลอของใบหน้าและขอบพื้นหลัง; (3) เฟรมที่มีการพูดประโยคสั้น ๆ—เพื่อเปรียบเทียบการซิงค์ปากกับคลื่นเสียงที่บันทึกไว้ ผู้ตรวจสอบมักจับภาพสกรีนช็อตจากเฟรมเหล่านี้แล้วเปรียบเทียบกับภาพของนักแสดงจริงเพื่อค้นหาร่องรอยการสังเคราะห์

ด้านการเผยแพร่ คลิปถูกปล่อยครั้งแรกบนแพลตฟอร์มโซเชียลมีเดียแบบสาธารณะผ่านบัญชีที่ไม่มีการยืนยันตัวตน ซึ่งโพสต์พร้อมคำบรรยายสั้น ๆ เพื่อกระตุ้นให้เกิดการแชร์ ภายใน 24–48 ชั่วโมงแรก คลิปถูกรีแชร์โดยบัญชีแฟนคลับและบัญชีมุกทวิตเตอร์ขนาดกลางหลายสิบบัญชี ก่อนจะมีผู้ใช้ที่มีผู้ติดตามมากรีทวีตและแสดงความคิดเห็นจากบุคคลสาธารณะ ทำให้แฮชแท็กเกี่ยวกับวิดีโอขึ้นเทรนด์ชั่วคราว กระบวนการ viral มักเกิดจากการผสมกันของ (a) คลิปต้นทางที่โพสต์ในช่วงเวลาที่มีการติดตามสูง (b) คำบรรยายที่ชวนตั้งคำถามหรือเผ็ดร้อน และ (c) การมีคอมเมนต์จากผู้มีอิทธิพลหรือคนดัง ซึ่งช่วยเพิ่ม reach และความน่าเชื่อถือที่ผิดพลาด

หลักฐานเชื่อมโยงไปยังเครื่องมือและเทคนิคที่ใช้ในการสร้างคลิปสามารถสังเกตได้จากร่องรอยทางเทคนิคและเมตาดาต้า เช่น ไฟล์วิดีโอที่ถูก encode ด้วยค่าบิตเรตและ profile ที่ไม่สอดคล้องกับไฟล์ต้นฉบับของผู้ใช้งานทั่วไป, การมี metadata หายไปหรือมีข้อมูลบ่งชี้การเรนเดอร์จากซอฟต์แวร์กราฟิก, หรือการพบ pattern ของอาร์ติแฟกต์ที่เป็นลักษณะเฉพาะของโมเดล deepfake เช่น banding รอบขอบปาก, ฟัลส์คอนทราสต์ที่เกิดจากการรวมชั้น (compositing seams), และการ flicker ในระดับความสว่างระหว่างเฟรม เทคนิคนิยมที่ตรวจพบได้บ่อยคือ face swapping ด้วย Generative Adversarial Networks (GAN), motion transfer (เช่น First Order Motion Model), neural rendering ร่วมกับการเพิ่มรายละเอียดด้วย super-resolution models และการโคลนเสียงโดยใช้ VST-based voice cloning หรือ neural TTS ที่ฝึกด้วยตัวอย่างสั้นของเสียงต้นฉบับ

สรุปคือ แม้ว่าคลิปดังกล่าวจะมีการปรับแต่งเชิงศิลป์จนดูเหมือนงานภาพยนตร์ แต่การตรวจสอบเชิงเทคนิคอย่างละเอียด—รวมถึงการวิเคราะห์เฟรม key, การตรวจสอบเมตาดาต้า และการใช้เครื่องมือ forensic เพื่อตรวจหาแทรซของการเรนเดอร์—สามารถชี้เบาะแสที่เชื่อมโยงไปยัง pipeline ของ deepfake และเครื่องมือสังเคราะห์เสียงที่เป็นไปได้

มุมกฎหมายและสิทธิส่วนบุคคล: ใครมีสิทธิ์พูดอะไรได้บ้าง

มุมกฎหมายและสิทธิส่วนบุคคล: ใครมีสิทธิ์พูดอะไรได้บ้าง

เมื่อ AI สร้างวิดีโอสังเคราะห์ที่ทำให้ดูเหมือนคนดัง เช่น Tom Cruise และ Brad Pitt ต่อสู้กัน ปัญหาทางกฎหมายจะทับซ้อนทั้งสิทธิส่วนบุคคล สิทธิเชิงพาณิชย์ และข้อกำหนดด้านเนื้อหาออนไลน์ ในเชิงกฎหมายประเด็นสำคัญที่ต้องพิจารณาได้แก่ right of publicity (สิทธิในการควบคุมการใช้ภาพลักษณ์และความสัมพันธ์เชิงพาณิชย์ของบุคคล), ลิขสิทธิ์, และ การหมิ่นประมาท

Right of publicity ในหลายเขตอำนาจ (โดยเฉพาะสหรัฐฯ) ถือเป็นสิทธิพลเมือง/พาณิชย์ที่บุคคลสามารถควบคุมการใช้ชื่อ รูปลักษณ์ หรือบุคลิกภาพของตนเพื่อผลประโยชน์ทางการค้าได้ แต่กฎหมายนี้ต่างกันตามรัฐ — บางรัฐมีกฎหมายเฉพาะ บางรัฐพัฒนาจากคำพิพากษา ตัวอย่างคดีเก่าๆ ที่ส่งผลต่อแนวคิดนี้ได้แก่ คดีที่ศิลปินชนะคดีการใช้เสียงหรือภาพลักษณ์โดยไม่ได้รับอนุญาต (เช่น คดีที่พิพาทการใช้เสียงล้อเลียน/ใกล้เคียงจนศิลปินได้รับความเสียหาย) ซึ่งชี้ให้เห็นว่าแม้การสร้างสรรค์เชิงศิลป์จะได้รับการคุ้มครองบางส่วน แต่การใช้ภาพลักษณ์เพื่อประโยชน์ทางการค้าโดยไม่ขออนุญาตยังมีความเสี่ยงทางกฎหมาย ด้าน ลิขสิทธิ์ ปัญหาแบ่งเป็นสองชั้น: หากวิดีโอสังเคราะห์นำสื่อที่มีลิขสิทธิ์ (คลิปต้นฉบับ รูปภาพ หรือเสียงที่เป็นของผู้อื่น) มาใช้โดยไม่มีสิทธิ อาจเข้าข่ายละเมิดลิขสิทธิ์และถูกเรียกร้องค่าชดเชยตามกฎหมายลิขสิทธิ์หรือ DMCA สำหรับเนื้อหาใหม่ที่สร้างขึ้นทั้งหมดโดย AI ปัญหาจะซับซ้อนกว่า เพราะคำถามว่าใครเป็นผู้สร้างงาน (และมีสิทธิใดบ้าง) ยังเป็นหัวข้อถกเถียงในหลายเขต การอ้างสิทธิ์ว่าเป็นงาน “สร้างสรรค์” หรือเป็น “พารอดี้” อาจเป็นเครื่องมือปกป้อง แต่ไม่รับประกันว่าจะชนะในชั้นศาล การหมิ่นประมาท เข้ามาเมื่อวิดีโอสังเคราะห์แสดงพฤติกรรมเท็จหรือกล่าวหาเท็จที่ทำให้ชื่อเสียงของบุคคลเสื่อมเสีย ในทางกฎหมายโจทก์ต้องพิสูจน์ว่าข้อความเป็นเท็จ พูดถึงบุคคลจริง และก่อให้เกิดความเสียหาย แต่การพิสูจน์ประเภทนี้เมื่อเป็นสื่อสังเคราะห์มีความท้าทายใหม่ ๆ เช่น ผู้ชมอาจตีความวิดีโอว่าเป็นงานสมมติหรือพารอดี้ ขณะเดียวกันต้องถ่วงน้ำหนักกับสิทธิเสรีภาพในการแสดงความเห็นและการสร้างสรรค์ ปัญหาสำคัญอีกประการคือ ช่องว่างทางกฎหมายและการบังคับใช้ เมื่อเทียบกับเทคโนโลยีที่พัฒนาเร็วขึ้น นักกฎหมายและผู้บังคับใช้กฎหมายต้องเผชิญข้อจำกัดหลายด้าน: การฟ้องร้องในยุคสื่อสังคมยังเผชิญ ความท้าทายเชิงปฏิบัติ เช่น ความเร็วในการแพร่กระจายของสื่อ การเก็บหลักฐานก่อนจะถูกลบ หรือการพิสูจน์ความเสียหายเชิงเศรษฐกิจสำหรับคนดัง นอกจากนี้ การบังคับใช้คำสั่งศาลเช่นการสั่งลบเนื้อหาจากแพลตฟอร์มข้ามชาติยังสะท้อนความล่าช้าและต้นทุนสูง ซึ่งทำให้ผู้ได้รับความเสียหายมักเลือกวิธีเจรจาหรือขอคำสั่งฉุกเฉินแทนการพิจารณาคดีแบบเต็มรูปแบบ ตัวอย่างกรณีศึกษาในระดับโลกชี้ชัดว่าศาลและนโยบายอยู่ระหว่างการปรับตัว: คดีโบราณอย่างคดีที่นักแสดงชนะคดีการใช้เสียง/ภาพลักษณ์โดยไม่ได้รับอนุญาต ได้วางกรอบเบื้องต้น แต่กรณี deepfake สมัยใหม่ยังต้องการคำตัดสินใหม่เพื่อระบุขอบเขตสิทธิ์ ในทางปฏิบัติ ผู้เชี่ยวชาญมักแนะนำให้ภาคธุรกิจและคนดังผสานมาตรการทางกฎหมาย (สัญญา สิทธิทางการค้า) กับมาตรการเชิงเทคนิค เช่น การติดตามแหล่งที่มาของสื่อ การใช้ลายน้ำเชิงดิจิทัล และการร่วมมือกับแพลตฟอร์มเพื่อระบบแจ้งเตือนและการเอาออกอย่างรวดเร็ว สรุปแล้ว ปมข้อกฎหมายที่เกิดจากวิดีโอสังเคราะห์ของคนดังเช่น Tom Cruise กับ Brad Pitt เป็นตัวเร่งให้เห็นความจำเป็นในการปรับกรอบกฎหมายและนโยบายระหว่างประเทศ: ต้องสมดุลระหว่างการคุ้มครองสิทธิส่วนบุคคลและการส่งเสริมนวัตกรรม พร้อมทั้งสร้างมาตรการเชิงเทคนิคและกฎระเบียบที่ชัดเจนขึ้นเพื่อให้การบังคับใช้เป็นไปได้จริงในยุคสื่อสังคมที่แพร่หลายและข้ามพรมแดน เหตุการณ์ที่มีคลิปวิดีโอเทียมแสดงการต่อสู้ระหว่างบุคคลสาธารณะ เช่น กรณีตัวอย่างระหว่าง Tom Cruise และ Brad Pitt ได้กระตุ้นให้สตูดิโอใหญ่และตัวแทนแรงงานต้องออกมาชี้แจงอย่างรวดเร็วและชัดเจน ในระดับองค์กร สตูดิโอภาพยนตร์และบริษัทผู้ผลิตจำนวนมากได้ออกแถลงการณ์อย่างไม่เป็นทางการและเป็นทางการ ว่าจะไม่ยอมรับการใช้ภาพลักษณ์หรือผลงานของนักแสดงในรูปแบบสังเคราะห์โดยไม่ได้รับอนุญาตชัดเจนจากผู้เกี่ยวข้อง โดยเน้นการใช้มาตรการทางกฎหมาย เช่น คำสั่งขอให้ลบ (takedown notices) และการแจ้งสิทธิ์ (copyright / right of publicity) ต่อแพลตฟอร์มที่เผยแพร่ ทางสหภาพนักแสดงหลักอย่าง SAG‑AFTRA ได้ออกแถลงการณ์เน้นความเป็นเจ้าของภาพลักษณ์และสิทธิ์ส่วนบุคคลของสมาชิก พร้อมเรียกร้องมาตรการคุ้มครองทั้งในเชิงสัญญาและเชิงปฏิบัติการ เช่น การห้ามใช้ลักษณะเสียงหรือภาพลักษณ์สังเคราะห์ในงานที่ไม่ได้รับอนุญาต, การจ่ายค่าตอบแทนสำหรับการใช้งานเสมือนจริง, และสิทธิ์ในการตรวจสอบกระบวนการฝึกโมเดล AI ที่ใช้ข้อมูลของนักแสดง การเคลื่อนไหวของสหภาพในครั้งนี้ยังสะท้อนข้อเรียกร้องในการเจรจาสัญญาแรงงานครั้งถัดไปเพื่อให้มีข้อกำหนดเกี่ยวกับ AI เป็นมาตรฐาน แพลตฟอร์มหลักอย่าง YouTube, Meta (Facebook/Instagram), TikTok และ X ได้เพิ่มหรือตรวจสอบนโยบายเกี่ยวกับสื่อสังเคราะห์ (synthetic media / deepfakes) อย่างต่อเนื่อง หลังจากเหตุการณ์คลิป AI แพร่ระบาด แพลตฟอร์มเหล่านี้กำลังปรับแนวทางเพื่อลดความเสียหายจากการบิดเบือนข้อมูลและการละเมิดสิทธิ์ส่วนบุคคล ตัวอย่างมาตรการที่เริ่มนำมาใช้ได้แก่ การติดป้ายประกาศว่าเป็นเนื้อหาเทียม, การจัดลำดับความสำคัญของการตรวจสอบแบบอัตโนมัติร่วมกับการรายงานจากผู้ใช้, และการเพิ่มช่องทางสำหรับการยื่นคำขอลบเนื้อหาด้วยหลักฐานสิทธิ์ การบังคับใชิบางแห่งมีความเข้มงวดขึ้น — รายงานจากวงในระบุว่าหลังเหตุการณ์หลักมีการแจ้งลบเนื้อหาเป็นจำนวนมากในช่วงสัปดาห์แรก และแพลตฟอร์มบางรายเริ่มทดสอบการติด watermark แบบอัตโนมัติในวิดีโอที่มาจากเครื่องมือสร้างสื่อสังเคราะห์เพื่อความโปร่งใส อย่างไรก็ตาม ยังมีคำวิจารณ์เรื่องประสิทธิภาพของการตรวจจับและความล่าช้าในการดำเนินการ ซึ่งทำให้สตูดิโอและสหภาพยังคงใช้ช่องทางทางกฎหมายควบคู่ไปด้วย ผลจากเหตุการณ์และการตอบสนองอย่างว่องไว ส่งผลชัดเจนต่อการเจรจาสัญญาในอุตสาหกรรมบันเทิง ผู้ผลิตเริ่มรวมข้อกำหนดเฉพาะเกี่ยวกับ AI และการใช้ข้อมูลส่วนตัวเข้าเป็นองค์ประกอบมาตรฐานของสัญญา เช่น ข้อกำหนดเรื่องการยินยอมเป็นลายลักษณ์อักษร การกำหนดค่าตอบแทนสำหรับการใช้งานลักษณะเสมือนจริง และเงื่อนไขการถอนความยินยอม นอกจากนี้ บริษัทประกันภัยบางรายเริ่มพิจารณาเพิ่มเบี้ยประกันหรือยกเว้นความคุ้มครองสำหรับความเสียหายที่เกิดจากเนื้อหาเทียม ในระดับปฏิบัติการ ผลกระทบต่อการผลิตรวมถึงการชะลอการเปิดกล้อง การเพิ่มขั้นตอนตรวจสอบหลังการถ่ายทำ (vetting) และการว่าจ้างผู้เชี่ยวชาญด้านการตรวจสอบสื่อดิจิทัล รายงานจากผู้ผลิตบางรายระบุว่า ต้นทุนการตรวจสอบและการป้องกันเพิ่มขึ้นเป็นตัวเลขสองหลักเป็นเปอร์เซ็นต์ของงบประมาณการผลิต ซึ่งมีผลต่อความพร้อมใจของสตูดิโอในการลงทุนโปรเจกต์ที่มีความเสี่ยงสูง สรุปได้ว่า เหตุการณ์คลิปวิดีโอ AI ระหว่างบุคคลสาธารณะเป็นตัวเร่งให้ฮอลลีวูดและแพลตฟอร์มโซเชียลต้องเร่งกำหนดมาตรการทั้งทางกฎหมาย นโยบาย และเชิงปฏิบัติการ เพื่อปกป้องสิทธิ์ของนักแสดง ขณะเดียวกันก็สร้างแรงกดดันให้มีการกำหนดมาตรฐานสัญญาและกรอบการทำงานร่วมกับเทคโนโลยี AI อย่างเป็นรูปธรรมมากขึ้นในระยะสั้นและระยะยาว ภาพรวมกระบวนการสร้างวิดีโอปลอม (deepfake) — การสร้างคลิปที่ดูเหมือน Tom Cruise และ Brad Pitt ต่อสู้กันในฉากเดียวต้องผ่านขั้นตอนทางเทคนิคหลายชั้น ตั้งแต่การเก็บข้อมูลภาพและเสียง การเทรนโมเดลเชิงลึก ไปจนถึงการเรนเดอร์และปรับแต่งหลังการผลิตเพื่อให้เกิดความสมจริงสูงสุด แต่ละขั้นตอนมีเทคนิคเฉพาะและจุดอ่อนที่ต่างกัน: ตัวอย่างเชิงตัวเลขและคุณภาพ — โมเดลสมัยใหม่สามารถลด Fréchet Inception Distance (FID) ได้มาก ทำให้ภาพสร้างมีความใกล้เคียงกับภาพจริงในระดับมองด้วยตา ความแตกต่างเชิงสถิติระหว่างงานวิจัยชี้ว่า deepfake คุณภาพสูงจากโมเดลฝึกดีสามารถหลอกตัวตรวจจับบางชนิดได้มากกว่า 60–80% ขึ้นอยู่กับเงื่อนไขการบีบอัดและการปรับแต่งหลังการผลิต การตรวจจับ deepfake ใช้หลายชั้นของการตรวจสอบ ตั้งแต่การวิเคราะห์ metadata ไปจนถึงการตรวจสอบสัญญาณเล็กๆ ในเฟรมภาพ แต่ทั้งหมดมีข้อจำกัดเมื่อเจอกับวิดีโอคุณภาพสูงที่ผ่านการปรับแต่งอย่างละเอียด: ข้อจำกัดเชิงปฏิบัติ — งานวิจัยหลายชิ้นชี้ว่า detector แบบเดียวไม่สามารถ generalize เมื่อเผชิญ deepfake ที่มาจาก distribution ใหม่ (unseen methods) หรือเมื่อผู้โจมตีใช้เทคนิค adversarial training เพื่อบิดเบือนสัญญาณตรวจจับ ตัวอย่างเช่น benchmark หลายรายการพบว่า accuracy ของตัวตรวจจับจะลดลงอย่างมีนัยสำคัญเมื่อได้รับการทดสอบกับ deepfakes ที่ผ่านการ post-processing ขั้นสูงหรือ generated โดยสถาปัตยกรรมใหม่ เพื่อต่อสู้กับ deepfake ระยะยาว นักวิจัยและองค์กรต่าง ๆ กำลังผลักดันทั้งมาตรการเชิงเทคนิคและนโยบาย: สรุปเชิงธุรกิจ — สำหรับผู้บริหารในฮอลลีวูดและองค์กรสื่อ ควรตระหนักว่าเทคโนโลยีสร้างภาพกำลังพัฒนาเร็วและการตรวจจับยังมีช่องโหว่ การลงทุนในระบบ provenance, นโยบายการตรวจสอบเนื้อหา, และความร่วมมือกับผู้ให้บริการ cloud/แพลตฟอร์มเพื่อนำ watermarking และ metadata-signing มาใช้ จะเป็นแนวทางที่ป้องกันความเสี่ยงได้ดีที่สุดในระยะยาว มาตรการเชิงเทคนิคและมาตรฐานอุตสาหกรรม — ภาคอุตสาหกรรมต้องเร่งนำระบบ digital provenance และการฝังเครื่องหมายดิจิทัล (watermarking) มาเป็นมาตรฐานร่วม การกำหนดเมตาดาต้าเชิงมาตรฐาน (เช่น C2PA / Content Credentials ที่ได้รับการพัฒนาในแนวร่วมของผู้พัฒนาและผู้เผยแพร่) ทำให้สามารถระบุแหล่งที่มา เวลา สร้าง และเครื่องมือที่ใช้ผลิตสื่อได้อย่างชัดเจนในชั้นของไฟล์เอง นอกจากนี้ ควรส่งเสริมการวิจัยและใช้ watermarking แบบทนนิ่งต่อการบีบอัดและแก้ไข (robust invisible watermark) สำหรับวิดีโอ เพื่อให้ระบบค้นหาและแพลตฟอร์มสามารถตรวจจับและติดป้ายสื่อสังเคราะห์โดยอัตโนมัติ ตัวอย่างการใช้งานเชิงพาณิชย์ที่เริ่มเห็นแล้วได้แก่ การทดลองของผู้พัฒนาเครื่องมือสร้างภาพและวิดีโอหลายราย รวมทั้งการนำแนวคิด Content Credentials ของผู้ผลิตซอฟต์แวร์มาใช้ทดสอบในสภาพแวดล้อมของสำนักข่าวและสตูดิโอบางแห่ง ข้อเสนอเชิงกฎหมายและกรอบบังคับใช้ข้ามพรมแดน — กฎหมายควรปรับขอบเขตของ right of publicity ให้ครอบคลุมการสร้างและการใช้ภาพลักษณ์สังเคราะห์ของบุคคลจริง ทั้งในเชิงพาณิชย์และเชิงสื่อสารมวลชน โดยกำหนดให้ต้องได้รับความยินยอมเป็นลายลักษณ์อักษรและระบุขอบเขตการใช้ชัดเจน กรอบกฎหมายควรกำหนดบทลงโทษเชิงบังคับ เช่น ค่าสินไหมทดแทนตามมาตรฐานและคำสั่งให้เพิกถอนเนื้อหาพร้อมคำสั่งเผยแพร่คำชี้แจง ในระดับระหว่างประเทศ ควรผลักดันข้อตกลงมาตรฐานสำหรับการบังคับใช้ข้ามพรมแดนและความร่วมมือด้านการแจ้งเตือน (mutual legal assistance) โดยอ้างอิงรูปแบบการคุ้มครองทรัพย์สินทางปัญญาและสิทธิส่วนบุคคลที่มีอยู่แล้ว ตัวอย่างเชิงนโยบายที่เป็นต้นแบบคือกฎเกณฑ์การบังคับให้ติดป้ายสื่อสังเคราะห์ซึ่งบางประเทศได้ทดลองใช้จริง ขณะที่สหภาพยุโรปกำหนดกรอบ AI Act ที่เน้นความโปร่งใสและความรับผิดชอบของผู้พัฒนา/ผู้ให้บริการเป็นต้นแบบสำหรับการกำกับดูแล AI ระดับภูมิภาค มาตรการคุ้มครองสิทธิและการบังคับใช้ของแพลตฟอร์ม — แพลตฟอร์มผู้เผยแพร่และเครือข่ายสังคมออนไลน์ควรถูกชักจูงหรือกำหนดให้นำระบบตรวจสอบ provenance มาปรับใช้เป็นเงื่อนไขของการได้รับความคุ้มครองตาม safe-harbor โดยต้องมีกระบวนการแจ้งเตือนและ take-down ที่รวดเร็ว ควบคู่กับมาตรการป้องกันเชิงรุก เช่น การสแกนหา watermark, การจัดอันดับความเสี่ยงของคลิป และการติดป้ายข้อมูล (labeling) เมื่อพบสื่อสังเคราะห์ นโยบายของแพลตฟอร์มควรชัดเจนว่าการอนุญาตใช้ likeness ของบุคคลสาธารณะต้องมีหลักฐานยินยอมและ metadata ที่รับรองได้ แนวทางปฏิบัติสำหรับสตูดิโอและนักแสดง — สตูดิโอควรปรับสัญญาจ้างและสัญญาสำหรับลิขสิทธิ์ภาพลักษณ์ให้รวมข้อกำหนดด้านสื่อดิจิทัล เช่น สิทธิ์ในการสร้างสื่อสังเคราะห์ (digital replicas), ระยะเวลา, ขอบเขตการใช้งาน และค่าตอบแทนเพิ่มเติมสำหรับการใช้ likeness ในงานที่สร้างด้วย AI นอกจากนี้ควรรวมข้อกำหนดด้าน provenance และ watermarking เป็นข้อบังคับสำหรับผู้รับจ้างภายนอก รวมทั้งจัดตั้งระบบตรวจสอบและเฝ้าระวัง (monitoring) เพื่อค้นหาและดำเนินการทางกฎหมายเมื่อพบการละเมิด นักแสดงและตัวแทนควรพิจารณาประกันความเสียหายจากการล่วงละเมิดลักษณะภาพลักษณ์ และสร้างบันทึกการยินยอมล่วงหน้า (consent registry) สำหรับการใช้ตัวแบบดิจิทัลของตน เมื่อพิจารณารวมกัน แนวทางที่มีประสิทธิผลจะต้องเป็นชุดมาตรการผสมผสานทั้งเทคโนโลยี นโยบาย และกรอบกฎหมาย — ตั้งแต่การฝังข้อมูลที่ตรวจสอบได้ในระดับไฟล์ การกำหนดมาตรฐานอุตสาหกรรม ไปจนถึงการปรับสิทธิส่วนบุคคลและสิทธิทางการค้า เพื่อให้ Hollywood และภาคคอนเทนต์สามารถปกป้องภาพลักษณ์และความน่าเชื่อถือของผลงานได้อย่างยั่งยืนในยุคที่การสร้างเนื้อหาโดย AI กลายเป็นเรื่องปกติ กรณีวิดีโอ AI ที่สร้างการต่อสู้ระหว่าง Tom Cruise และ Brad Pitt เป็นสัญญาณเตือนชัดเจนว่าความสามารถด้านการสังเคราะห์คอนเทนต์พัฒนาไปไกล โดยไม่เพียงแต่ทำให้ผู้ชมสับสน แต่ยังมีผลกระทบทางเศรษฐกิจ (เช่น การบิดเบือนรายได้และมูลค่าลิขสิทธิ์ของบุคคลสาธารณะ), ด้านกฎหมาย (สิทธิ์ภาพเหมือน สิทธิ์ส่วนบุคคล และความรับผิดชอบของผู้เผยแพร่) และด้านความน่าเชื่อถือของสื่อโดยรวม หากไม่มีกลไกตอบโต้ที่ชัดเจนและมีประสิทธิภาพ ตัวอย่างเช่น คลิปปลอมของ Tom Cruise ที่แพร่บนแพลตฟอร์มโซเชียลตั้งแต่ปี 2021 แสดงให้เห็นถึงศักยภาพของ deepfake ที่สามารถหลอกผู้ชมได้แม้ด้วยเทคโนโลยีที่เปิดเผยแล้ว อีกทั้งงานวิจัยและรายงานต่างๆ ชี้ว่าความแม่นยำและความสะดวกในการสร้างคอนเทนต์สังเคราะห์เพิ่มขึ้นอย่างรวดเร็วในช่วง 2–3 ปีที่ผ่านมา ซึ่งนำมาซึ่งความเสี่ยงเชิงโครงสร้างต่ออุตสาหกรรมบันเทิงและระบบข้อมูลข่าวสาร อนาคตต้องการการร่วมมือเชิงรุกระหว่างฮอลลีวูด ภาคเทคโนโลยี ผู้กำหนดนโยบาย และแพลตฟอร์มโซเชียล เพื่อพัฒนามาตรการป้องกันและตรวจจับ เช่น การติดตราแหล่งที่มา (provenance), การฝังลายน้ำดิจิทัล, ระบบตรวจจับ deepfake ที่ทันสมัย และกรอบกฎหมายที่สมดุลระหว่างการส่งเสริมนวัตกรรมกับการคุ้มครองสิทธิ์ส่วนบุคคล นอกจากนี้ควรมีมาตรการทางเศรษฐกิจและการคุ้มครองแรงงานในวงการบันเทิง รวมถึงนโยบายการรับมือภัยสารสนเทศเพื่อรักษาความน่าเชื่อถือของสื่อโดยรวม หากมีการร่วมมือและลงทุนในเครื่องมือทางเทคโนโลยี กฎหมายเชิงป้องกัน และการสร้างความรู้แก่สาธารณะอย่างทันท่วงที ก็ยังมีโอกาสที่จะนำเทคโนโลยีสังเคราะห์มาใช้สร้างมูลค่าใหม่ให้วงการบันเทิงโดยไม่สูญเสียสิทธิ์และความเชื่อมั่นของผู้ชม

📰 แหล่งอ้างอิง:

The New York Times

ปฏิกิริยาของฮอลลีวูด: สตูดิโอ สหภาพ และนักแสดงตอบสนองอย่างไร

ปฏิกิริยาของฮอลลีวูด: สตูดิโอ สหภาพ และนักแสดงตอบสนองอย่างไร

การเปลี่ยนแปลงนโยบายแพลตฟอร์มโซเชียลและการบังคับใช้

ผลกระทบต่อสัญญา งานสร้าง และความเชื่อมั่นของนักแสดง

วิเคราะห์เชิงเทคนิค: กระบวนการสร้างและเทคนิคการตรวจจับ

วิเคราะห์เชิงเทคนิค: กระบวนการสร้างและเทคนิคการตรวจจับ

เทคนิคการตรวจจับที่มีอยู่ และข้อจำกัดเมื่อเผชิญวิดีโอคุณภาพสูง

แนวทางวิจัยและมาตรการป้องกันที่กำลังพัฒนา

แนวทางรับมือและนโยบายอนาคตที่เป็นไปได้

แนวทางรับมือและนโยบายอนาคตที่เป็นไปได้

บทสรุป