ในงานประชุมด้านสุขภาพและเทคโนโลยีล่าสุด ซีอีโอของฟิลิปส์ออกมาแถลงชัดเจนว่า "ปัญญาประดิษฐ์ (AI) ถูกออกแบบมาเพื่อเสริมความเชี่ยวชาญทางคลินิก ไม่ใช่เพื่อทดแทนผู้เชี่ยวชาญ" คำยืนยันนี้ตั้งอยู่ท่ามกลางความกังวลของทั้งบุคลากรทางการแพทย์และผู้บริโภค ที่กลัวว่าการมาของ AI จะนำไปสู่การสูญเสียงานหรือการตัดสินรักษาที่ปราศจากมนุษย์ ความจริงคือเทคโนโลยีเช่นการวิเคราะห์ภาพทางการแพทย์ ระบบสนับสนุนการตัดสินใจทางคลินิก และการติดตามผู้ป่วยระยะไกล กำลังเพิ่มความแม่นยำและลดภาระงานซ้ำซ้อน แต่ยังคงต้องพึ่งพาความรู้และการตัดสินใจเชิงคลินิกของมนุษย์อย่างใกล้ชิด

บทนำนี้จะพาไปดูภาพรวมบริบทของการยืนยันจากฟิลิปส์ พร้อมยกตัวอย่างเทคโนโลยีที่นำมาใช้จริง สถิติการยอมรับของบุคลากรในระบบสุขภาพ (การสำรวจชี้ว่าประมาณ 60–75% ของผู้ปฏิบัติงานมองว่า AI จะเป็นเครื่องมือช่วยงานมากกว่าจะเป็นคู่แข่ง) และข้อพิจารณาด้านกฎหมาย เช่น ความเป็นส่วนตัวของข้อมูล ผู้รับผิดชอบทางคลินิก และการรับรองทางกฎหมาย ที่ผู้บริหารและหน่วยงานสาธารณสุขต้องพิจารณาเมื่อนำ AI เข้ามาใช้ในโรงพยาบาลหรือคลินิก เพื่อให้การปรับใช้เป็นไปอย่างปลอดภัย มีประสิทธิภาพ และเคารพบทบาทของผู้เชี่ยวชาญทางการแพทย์

สรุปข่าว: คำยืนยันจากซีอีโอฟิลิปส์

สรุปข่าว: คำยืนยันจากซีอีโอฟิลิปส์

ในการแถลงข่าวต่อสื่อมวลชนระหว่างการประชุมผู้ถือหุ้นประจำปีของฟิลิปส์ เมื่อวันที่ 17 กุมภาพันธ์ 2026 เวลา 10:30 น. ซีอีโอของบริษัทได้ยืนยันชัดเจนว่าการนำระบบปัญญาประดิษฐ์ (AI) มาใช้ในผลิตภัณฑ์และบริการของฟิลิปส์มีเป้าหมายเพื่อ เสริมความเชี่ยวชาญทางคลินิก ไม่ใช่เพื่อทดแทนบุคลากรทางการแพทย์ โดยกล่าวว่า: "AI ของเราถูกออกแบบมาเพื่อเป็นผู้ช่วยที่เพิ่มความแม่นยำ ลดภาระงานซ้ำซ้อน และส่งเสริมการตัดสินใจทางคลินิก — ไม่ใช่เพื่อแทนที่บทบาทของแพทย์หรือพยาบาล" คำยืนยันนี้ถูกนำเสนออย่างชัดเจนเพื่อสร้างความมั่นใจทั้งต่อนักลงทุนและผู้ปฏิบัติงานด้านสาธารณสุข

แหล่งที่มาของคำพูดนี้มาจากการแถลงข่าวอย่างเป็นทางการของบริษัทซึ่งจัดขึ้นควบคู่กับการประชุมผู้ถือหุ้นประจำปี และยังถูกบันทึกไว้ในรายงานสรุปเหตุการณ์ (press release) ของฟิลิปส์ด้วย ผู้บริหารเน้นถึงกรอบการทำงานของบริษัทที่รวมการพัฒนาเทคโนโลยี AI เข้ากับกระบวนการทางคลินิกแบบมีมนุษย์ควบคุม (human-in-the-loop) เพื่อให้เกิดการตรวจสอบและยืนยันผลสุดท้ายโดยผู้เชี่ยวชาญทางการแพทย์

ซีอีโอชี้ให้เห็นข้อมูลเชิงปฏิบัติว่าโครงการนำร่องภายในและความร่วมมือกับโรงพยาบาลหลายแห่งแสดงผลในเชิงบวก ทั้งในด้านความแม่นยำและประสิทธิภาพ เช่น รายงานเบื้องต้นระบุว่าเทคโนโลยีตรวจวินิจฉัยภาพบางประเภทช่วยเพิ่มความถูกต้องในการอ่านภาพได้เฉลี่ย ประมาณ 10–15% และสามารถลดเวลาการตรวจซ้ำหรือการประมวลผลเอกสารซ้ำซ้อนลงได้ถึง 20–30% ตัวเลขเหล่านี้ถูกนำมาเป็นตัวอย่างประกอบเพื่อสนับสนุนข้อเรียกร้องว่า AI เป็นเครื่องมือเสริม ไม่ใช่ผู้ทดแทน

สรุปประเด็นสำคัญที่ซีอีโอแถลงในงานมีดังนี้

- ยืนยันจุดยืน: ฟิลิปส์มุ่งใช้ AI เพื่อเสริมความเชี่ยวชาญทางคลินิก ไม่ใช่แทนที่บุคลากร

- แหล่งที่มาของคำพูด: แถลงข่าวระหว่างการประชุมผู้ถือหุ้นประจำปี (17 กุมภาพันธ์ 2026, 10:30 น.) และเอกสารสรุปรายงานการประชุม

- ประเด็นที่สื่อถึง: การเสริมแกร่งของการตัดสินใจทางการแพทย์ การเพิ่มความถูกต้องของการวินิจฉัย และการลดภาระงานที่เป็นกิจวัตรซ้ำซ้อนสำหรับทีมคลินิก

- ผลเชิงตัวเลข (ตัวอย่าง): โครงการนำร่องแสดงการเพิ่มความแม่นยำประมาณ 10–15% และลดเวลาการทำงานซ้ำ 20–30%

ท้ายที่สุด ซีอีโอย้ำว่าแนวทางของฟิลิปส์คือการพัฒนาเทคโนโลยีที่ช่วยให้บุคลากรทางการแพทย์ทำงานได้มีประสิทธิภาพมากขึ้น ปลอดภัยขึ้น และมีเวลามากขึ้นในการมุ่งเน้นการดูแลผู้ป่วยเชิงซับซ้อน การยืนยันครั้งนี้จึงมีนัยสำคัญทั้งต่อการสื่อสารเชิงการตลาด ต่อความเชื่อมั่นของผู้ถือหุ้น และต่อการยอมรับเทคโนโลยี AI ในระบบบริการสุขภาพโดยรวม

ภาพรวม AI ในการแพทย์: เทรนด์และสถิติสำคัญ

ภาพรวม AI ในการแพทย์: เทรนด์และสถิติสำคัญ

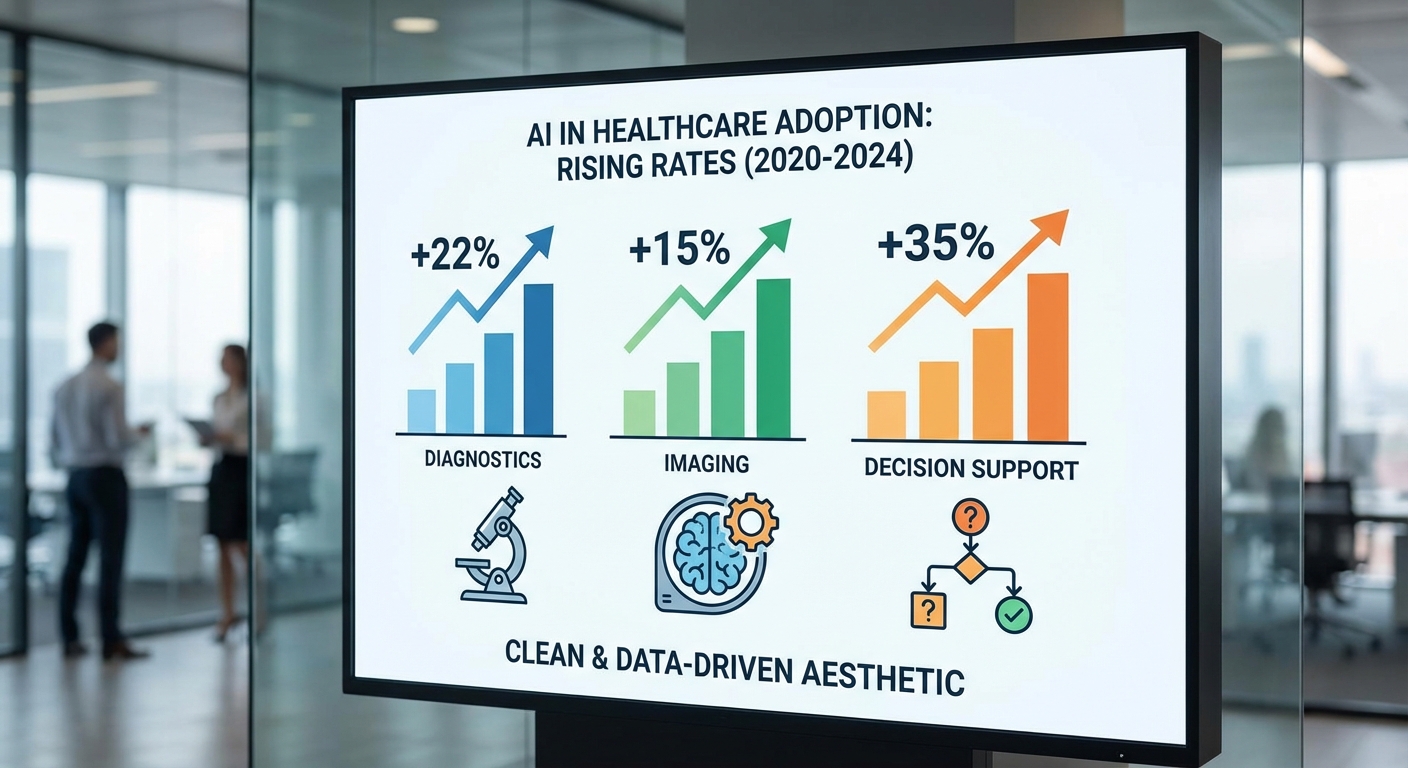

ในช่วง 3–5 ปีที่ผ่านมา การนำเทคโนโลยีปัญญาประดิษฐ์ (AI) มาใช้ในระบบสาธารณสุขและสถานพยาบาลมีการเติบโตอย่างชัดเจนทั้งในระดับโลกและภูมิภาค องค์กรวิจัยและที่ปรึกษาชั้นนำรายงานแนวโน้มการยอมรับที่เพิ่มขึ้นอย่างต่อเนื่อง—จากการทดลองเชิงนำร่อง (pilot) ไปสู่การใช้งานในกระบวนการคลินิกจริง (production). ตัวอย่างข้อมูลเชิงตัวเลขจากรายงานหลายฉบับชี้ให้เห็นว่าอัตราการนำ AI ไปใช้ในโรงพยาบาลและคลินิกเพิ่มขึ้นจากระดับหลักสิบเปอร์เซ็นต์เมื่อ 3–5 ปีก่อน มาสู่ระดับประมาณครึ่งหนึ่งหรือมากกว่าในภูมิภาคที่มีทรัพยากรสูง (อ้างอิงรายงานเช่น McKinsey, HIMSS, Deloitte) โดย HIMSS และ Deloitte ระบุว่าในปี 2021–2023 มีสัดส่วนขององค์กรที่มีโครงการ AI อย่างน้อยหนึ่งโครงการอยู่ในระดับหลายสิบเปอร์เซ็นต์ และมีอีกสัดส่วนหนึ่งที่กำลังขยายการใช้งานจาก pilot สู่ระบบการปฏิบัติการจริง

เทคโนโลยีที่ได้รับการนำไปใช้อย่างแพร่หลายมีสามกลุ่มหลัก ได้แก่:

- AI ในการวินิจฉัยภาพ (Imaging AI) — การประมวลผลภาพทางการแพทย์ด้วย deep learning ถูกนำมาใช้ในรังสีวิทยา ทางเดินปัสสาวะ และโรคผิวหนัง เพื่อช่วยตรวจพบความผิดปกติอย่างเช่นมะเร็งหรือภาวะเลือดออกผิดปกติ รายงานจาก McKinsey และสถาบันวิจัยหลายแห่งชี้ว่า imaging AI เป็นหนึ่งในแอพพลิเคชันที่เกิดเร็วที่สุดในเชิงการพาณิชย์

- การวิเคราะห์ข้อมูลทางห้องปฏิบัติการและข้อมูลโมเลกุล — การใช้ AI วิเคราะห์ผลตรวจห้องปฏิบัติการ ปริมาณสารชีวเคมี หรือข้อมูลจีโนม เพื่อเพิ่มความแม่นยำ ลดเวลา และจัดลำดับความสำคัญผู้ป่วย (triage)

- ระบบช่วยตัดสินใจทางคลินิก (Clinical Decision Support Systems — CDSS) — ระบบที่ผสานข้อมูลผู้ป่วย การวิเคราะห์ประวัติ และแนวทางปฏิบัติทางคลินิก เพื่อให้คำแนะนำแก่แพทย์ในเวลาจริง รายงานจาก WHO และ Deloitte ระบุว่า CDSS เป็นตัวขับเคลื่อนสำคัญสำหรับการปรับปรุงผลลัพธ์ผู้ป่วยและการลดข้อผิดพลาดทางการแพทย์

ในด้านการลงทุน แนวโน้มชี้ชัดว่ามีกระแสเงินทุนไหลเข้าสู่สตาร์ทอัพและโครงการ AI ทางการแพทย์อย่างต่อเนื่องช่วงไม่กี่ปีที่ผ่านมา โดยรายงานระดับอุตสาหกรรมระบุว่ามูลค่าการลงทุนรวมในดิจิทัลเฮลธ์และ AI ด้านสุขภาพแตะระดับพันล้านถึงหมื่นล้านดอลลาร์ต่อปี ขึ้นกับช่วงเวลาและภูมิภาค (อ้างอิง McKinsey, Deloitte และรายงานการเงินของอุตสาหกรรม) นักลงทุนให้ความสนใจในแอพพลิเคชันที่มีแนวทางสู่รายได้ที่ชัดเจน เช่น ระบบช่วยตัดสินใจที่ฝังเข้ากับ workflow ของโรงพยาบาล และการวินิจฉัยภาพที่ช่วยลดระยะเวลาอ่านผล การลงทุนเหล่านี้สะท้อนด้วยการเพิ่มขึ้นของการนำไปใช้จริงและการทดลองทางคลินิกที่มุ่งวัดผลตอบแทนทางธุรกิจ (ROI)

ผลตอบแทนเชิงธุรกิจจากการนำ AI มาใช้ในสถานพยาบาลแสดงสัญญาณเชิงบวกในหลายมิติ รวมถึงการลดเวลารอคอย การเพิ่มความแม่นยำของการวินิจฉัย และการลดต้นทุนการดำเนินงาน ตัวอย่างรายงานจาก McKinsey และ Deloitte ระบุว่าการปรับใช้ AI ในกระบวนการวินิจฉัยและการจัดการผู้ป่วยเชิงรุกสามารถชนะการลดต้นทุนและปรับปรุงประสิทธิภาพได้ในระดับหลายเปอร์เซ็นต์ถึงสองหลักในกรณีที่มีการผสานเทคโนโลยีกับการเปลี่ยนแปลงกระบวนการอย่างเป็นระบบ อย่างไรก็ดี ผลลัพธ์เชิงเศรษฐศาสตร์มีความผันแปรตามขนาดขององค์กร คุณภาพข้อมูล และความสามารถในการผสานระบบเข้ากับ workflow ของทีมคลินิก

ข้อเสนอแนะเชิงปฏิบัติ: เพื่อสื่อสารภาพรวมนี้ต่อผู้อ่านและผู้บริหาร ควรแนบกราฟ/อินโฟกราฟิกที่แสดง (1) อัตราการนำ AI ในโรงพยาบาลตามช่วงปี (3–5 ปีล่าสุด) (2) สัดส่วนการใช้งานตามประเภทเทคโนโลยี (Imaging, Lab analytics, CDSS) และ (3) แนวโน้มการลงทุนรวมต่อปีจากแหล่งข้อมูลหลายแห่ง (เช่น McKinsey, HIMSS, Deloitte, WHO) เพื่อช่วยให้เห็นภาพเชิงปริมาณและสนับสนุนการตัดสินใจเชิงนโยบายและธุรกิจ

ฟิลิปส์กับกลยุทธ์ AI: ผลิตภัณฑ์และกรณีตัวอย่าง

ฟิลิปส์กับกลยุทธ์ AI: ผลิตภัณฑ์และกรณีตัวอย่าง

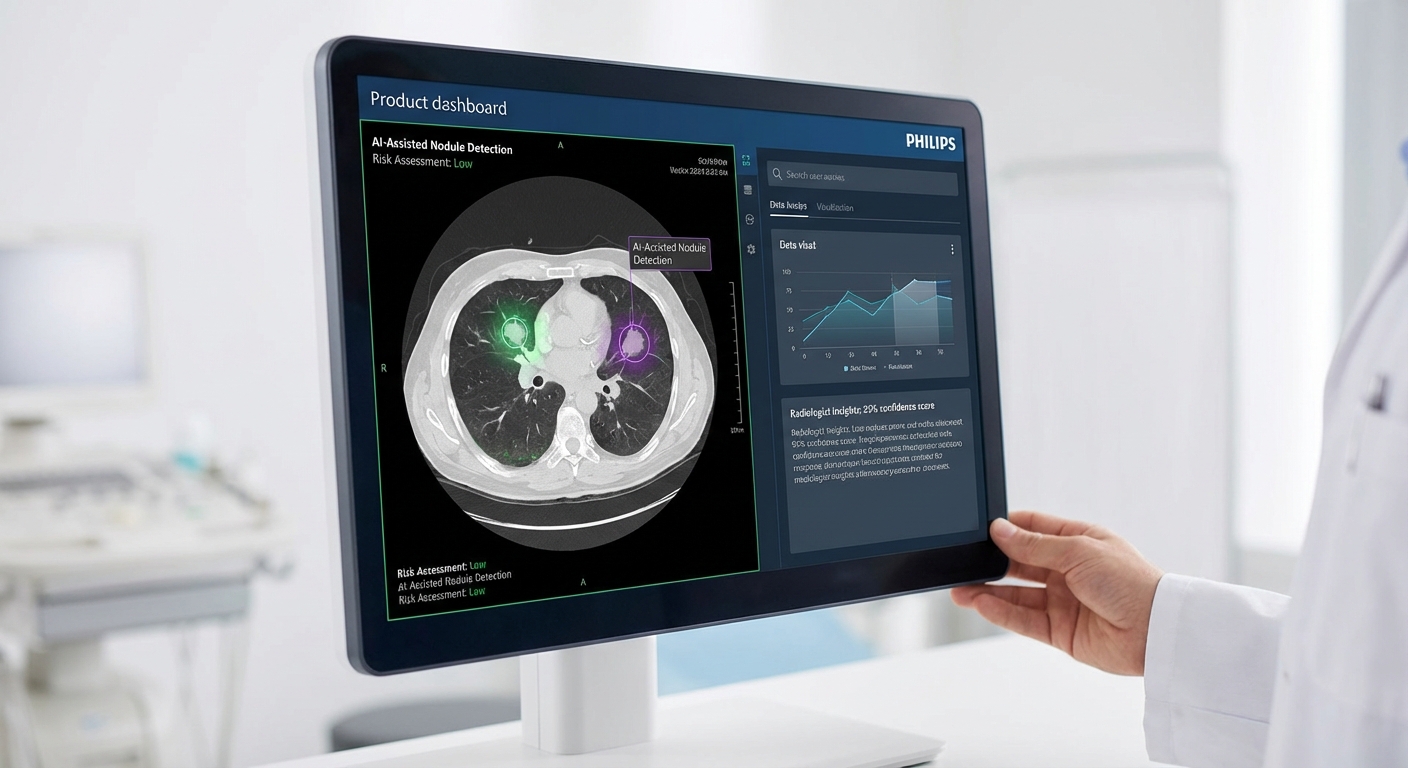

ฟิลิปส์วางตำแหน่งตนเองในฐานะผู้ให้บริการโซลูชันด้านการดูแลสุขภาพที่ผสานเทคโนโลยี AI เข้ากับเวิร์กโฟลว์ทางคลินิกเพื่อเสริมความเชี่ยวชาญของบุคลากรการแพทย์ ไม่ใช่เพื่อแทนที่ การลงทุนของฟิลิปส์เน้นไปที่การพัฒนาแพลตฟอร์มข้อมูลผู้ป่วย ระบบวิเคราะห์ภาพทางการแพทย์ และโมดูลสนับสนุนการตัดสินใจทางคลินิกที่สามารถเชื่อมต่อกับระบบ EHR และอุปกรณ์ทางการแพทย์หลากหลายประเภท โดยมีหลักการสำคัญคือความโปร่งใสของอัลกอริทึม การตรวจสอบผลลัพธ์จากคลินิกจริง และการปฏิบัติตามมาตรฐานความปลอดภัยของข้อมูลผู้ป่วย

ผลิตภัณฑ์และโซลูชันเด่น

- IntelliSpace Portal — แพลตฟอร์มการวิเคราะห์ภาพรวมศูนย์ (advanced visualization) ที่รวมโมดูล AI สำหรับการแยกแยะโครงสร้างอวัยวะ การวัดเชิงปริมาณ และการเปรียบเทียบผลภาพแบบติดตามระยะยาว ช่วยลดเวลาการอ่านภาพและเพิ่มความสม่ำเสมอของรายงาน

- IntelliSpace Cardiovascular — ผสานข้อมูลภาพและข้อมูลคลินิกเพื่อสนับสนุนเวิร์กโฟลว์โรคหัวใจ ทั้งการจัดการเคสและการรายงานเชิงปริมาณ

- EPIQ และ HeartModel A.I. — โซลูชันอัลตร้าซาวด์ที่มีโมดูล AI สำหรับการวัดและจำแนกโครงสร้างหัวใจแบบอัตโนมัติ เพื่อลดเวลาในการวิเคราะห์คลิปและลดความแปรปรวนระหว่างผู้ตรวจ

- IntelliSite Pathology — ระบบดิจิทัลพาธวิชันที่รองรับงานสแกนสไลด์และการใช้ AI ช่วยตรวจจุดผิดปกติ เพิ่มประสิทธิภาพการทำงานของห้องปฏิบัติการ

- SmartCT / Image-guided Therapy (Azurion) — โมดูลช่วยในการวางแผนและประเมินการทำหัตถการด้วยภาพแบบเรียลไทม์ สนับสนุนการลดรังสีและการใช้สารทึบรังสี

- HealthSuite Digital Platform — แพลตฟอร์ดคลาวด์สำหรับรวบรวมข้อมูลผู้ป่วย เชื่อมต่ออุปกรณ์ และรันโมเดล AI เพื่อสนับสนุนการตัดสินใจทางคลินิกในระดับซีซเต็ม

กรณีตัวอย่างการใช้งานจริงและผลลัพธ์เชิงปริมาณ

ฟิลิปส์ได้เผยแพร่กรณีศึกษาจากโรงพยาบาลหลายแห่งที่นำโซลูชัน AI ไปใช้จริง โดยผลลัพธ์ที่วัดได้มักสะท้อนการปรับปรุงทั้งด้านเวลา ความแม่นยำ และประสิทธิภาพของเวิร์กโฟลว์ตัวอย่างได้แก่:

- การอ่านภาพ CT/MR ด้วย IntelliSpace Portal — โรงพยาบาลในยุโรปรายหนึ่งรายงานว่าโมดูลช่วยคัดกรองและวัดปริมาณรอยโรคช่วยลดเวลาเฉลี่ยในการอ่านภาพต่อเคสลงประมาณ 30–50% และเพิ่มอัตราการตรวจพบความผิดปกติเล็กน้อยที่อาจถูกมองข้ามได้ ทำให้การตัดสินใจทางคลินิกรวดเร็วขึ้น

- งานอัลตร้าซาวด์หัวใจด้วย HeartModel A.I. — ศูนย์หัวใจแห่งหนึ่งระบุว่าเวลาที่แพทย์ต้องใช้ในการประมวลผลและสร้างรายงานจากภาพ 3D ลดลงถึง 60–75% ขณะที่ความแปรปรวนระหว่างผู้สแกนน้อยลง ส่งผลให้ปริมาณเคสที่วิเคราะห์ได้ต่อวันเพิ่มขึ้น 20–35%

- ห้องปฏิบัติการพยาธิวิทยาด้วย IntelliSite — ตัวอย่างจากคลินิกพยาธิวิทยาขนาดใหญ่ระบุว่าเวลาการส่งผลตรวจ (turnaround time) ลดลงประมาณ 20–40% เมื่อผสานการสแกนดิจิทัลและการใช้ AI ในการคัดกรองชิ้นงาน ทำให้การรักษาเริ่มได้เร็วขึ้น

- ห้องผ่าตัด/ห้องตรวจแทรกแซงด้วย SmartCT และ Azurion — ในการทำหัตถการอินเตอร์เวนชัน ตัวอย่างเผยว่าเวิร์กโฟลว์ที่ใช้ภาพนำทางและการประมวลผลแบบเรียลไทม์ ช่วยลดปริมาณสารทึบรังสีและระยะเวลาหัตถการโดยประมาณ 15–25% ลดอัตรา rework/การต้องทำซ้ำขั้นตอนได้ด้วย

ความคิดเห็นจากลูกค้าในกรณีศึกษา

รายงานกรณีศึกษามักสรุปคำชมจากแพทย์และผู้บริหารโรงพยาบาลว่าโซลูชัน AI ของฟิลิปส์ช่วยให้การทำงานมีความต่อเนื่องและมีข้อมูลประกอบการตัดสินใจที่ชัดเจนขึ้น ตัวอย่างความเห็นเช่น “ระบบช่วยลดภาระงานเชิงซ้อนได้จริง ทำให้แพทย์มีเวลาตรวจรักษาผู้ป่วยเชิงคุณภาพมากขึ้น” และ “ผลการวิเคราะห์ที่ได้มีความสม่ำเสมอ ช่วยลดความเสี่ยงจากข้อผิดพลาดมนุษย์ในกระบวนการรายงาน” (สรุปจากบทวิจารณ์กรณีศึกษาในภาคสนาม)

ความร่วมมือกับโรงพยาบาลและพันธมิตรทางเทคโนโลยี

ฟิลิปส์ดำเนินโครงการนำร่องร่วมกับโรงพยาบาลระดับมหาวิทยาลัยและศูนย์การแพทย์หลายแห่งเพื่อทดสอบและปรับแต่งโมเดล AI ให้สอดคล้องกับบริบทคลินิกจริง นอกจากนี้ ฟิลิปส์ยังร่วมมือกับพันธมิตรด้านคลาวด์และซอฟต์แวร์เพื่อให้การประมวลผลข้อมูลเป็นไปอย่างปลอดภัยและสามารถเชื่อมต่อกับระบบ EHR ชั้นนำได้ ผลลัพธ์จากความร่วมมือประเภทนี้ไม่เพียงเพิ่มความเร็วการใช้งาน แต่ยังช่วยสร้างหลักฐานเชิงคลินิก (real-world evidence) ที่นำไปสู่การปรับปรุงโมเดลและการยอมรับจากผู้ใช้งาน

สรุป — กลยุทธ์ AI ของฟิลิปส์มุ่งเน้นการเติมเต็มและยกระดับศักยภาพทางคลินิกผ่านชุดผลิตภัณฑ์ที่ครอบคลุม ตั้งแต่การวิเคราะห์ภาพจนถึงการจัดการข้อมูลผู้ป่วย ผลลัพธ์จากกรณีศึกษาแสดงให้เห็นการปรับปรุงทั้งด้านเวลา ความแม่นยำ และประสิทธิภาพการทำงาน ขณะที่ความคิดเห็นจากลูกค้าชี้ว่าการนำ AI มาใช้อย่างเป็นระบบช่วยให้ทีมคลินิกมีสมาธิและทรัพยากรสำหรับการดูแลผู้ป่วยที่ซับซ้อนมากขึ้น

มุมมองจากคลินิก: แพทย์และบุคลากรทางการแพทย์ตอบอย่างไร

มุมมองจากคลินิก: แพทย์และบุคลากรทางการแพทย์ตอบอย่างไร

ในสภาพแวดล้อมการรักษาจริง แพทย์และบุคลากรทางการแพทย์โดยรวมยอมรับศักยภาพของ AI ในการเสริมกระบวนการทางคลินิก โดยเฉพาะด้านการคัดกรองเคสและการเพิ่มความเร็วในการวินิจฉัยตัวอย่างหนึ่งที่มักถูกยกขึ้นคือการอ่านภาพรังสีที่ใช้เวลาน้อยลง ทำให้แพทย์สามารถจัดลำดับผู้ป่วยฉุกเฉินได้เร็วขึ้น จากการสำรวจภายในโรงพยาบาลหลายแห่งประมาณร้อยละ 65–75 ของแพทย์ส่งเสียงเห็นด้วยว่าเครื่องมือ AI ช่วยลดเวลารอผลและเพิ่มความแม่นยำในภารกิจบางประเภท เช่น การคัดกรองภาพซีทีสแกนหรือการอ่านสไลด์ทางพยาธิวิทยา

แม้จะให้ผลดีในด้านความเร็วและการคัดกรอง แพทย์ยังระบุข้อจำกัดเชิงปฏิบัติที่สำคัญ ได้แก่ความยากในการตีความผลลัพธ์จากโมเดล (interpretability) ความเสี่ยงของผลบวกลวง/ผลลบลวง และความเข้ากันได้กับ workflow รายวัน ตัวอย่างเช่น ระบบ AI ที่ให้ค่า probability หรือ heatmap บนภาพรังสี หากไม่เชื่อมต่อกับระบบบันทึกผู้ป่วย (EHR) อย่างราบรื่น จะกลายเป็นภาระงานเพิ่มขึ้น เพราะบุคลากรต้องสลับหน้าจอและยืนยันผลด้วยตนเอง นอกจากนี้ ผู้ปฏิบัติงานยังเตือนเรื่องคุณภาพข้อมูลฝึกสอน: โมเดลที่ฝึกจากฐานข้อมูลกลุ่มประชากรหนึ่ง อาจมีประสิทธิภาพลดลงเมื่อนำไปใช้กับประชากรที่ต่างกัน

เพื่อสะท้อนมุมมองจากสนามจริง เรารวบรวมตัวอย่างสัมภาษณ์สั้น ๆ กับผู้ปฏิบัติงาน:

น.พ.จิตติพงศ์ (อายุรแพทย์ฉุกเฉิน): "AI ช่วยให้เราเห็นความเสี่ยงของผู้ป่วยได้เร็วขึ้น ทำให้ตัดสินใจส่งต่อหรือให้การรักษาได้ทันท่วงที แต่ท้ายที่สุดต้องอาศัยการยืนยันจากคลินิก"

พยาบาลหัวหน้า แผนกฉุกเฉิน: "ระบบช่วยคัดกรองผู้ป่วยที่น่าจะรุนแรง แต่ถ้าอินเทอร์เฟซไม่ดีจะเพิ่มงานเอกสารและทำให้เวลาเฉลี่ยต่อเคสเพิ่มขึ้น"

รังสีแพทย์ (คลินิกภาพรังสี): "โมเดลที่ให้ heatmap มาเป็นตัวช่วยดี แต่ผมต้องการตัวเลขความเชื่อมั่นและบริบททางคลินิก ไม่ใช่แค่สัญญาณเตือนเดียว"

ผู้จัดการระบบสารสนเทศทางการแพทย์: "การนำ AI เข้าระบบต้องมีการทดสอบกับ workflow จริง ปรับ API ให้เข้ากับ EHR และมีระบบตรวจสอบประสิทธิภาพอย่างต่อเนื่อง"

จากความคิดเห็นข้างต้น บุคลากรทางการแพทย์เสนอข้อแนะนำเชิงปฏิบัติที่ชัดเจนสำหรับการนำ AI ไปใช้งานในโรงพยาบาล:

- การนำเข้าทีละขั้น (phased roll-out): เริ่มจากงานที่มีความเสี่ยงต่ำและมีประโยชน์ชัดเจน เช่น การคัดกรองเบื้องต้น ก่อนขยายสู่การตัดสินใจทางการรักษาที่มีความเสี่ยงสูง

- คนร่วมในวงจร (human-in-the-loop): กำหนดให้ผลจาก AI เป็นคำแนะนำที่ต้องได้รับการตรวจสอบโดยผู้เชี่ยวชาญ เพื่อรักษามาตรฐานความรับผิดชอบทางคลินิก

- การผสานกับ workflow และ EHR: ออกแบบอินเทอร์เฟซให้ลดการสลับหน้าจอ เชื่อมโยงผล AI กับบันทึกผู้ป่วย เพิ่มฟังก์ชันการแจ้งเตือนที่มีบริบท

- มาตรฐานการประเมินและการตรวจสอบ (audit): ตั้งตัวชี้วัดความแม่นยำ การเกิด false alert และผลกระทบต่อเวลาเฉลี่ยในการรักษา พร้อมกระบวนการปรับปรุงโมเดลเมื่อพบปัญหา

- การฝึกอบรมและการยอมรับ: ให้การฝึกทั้งด้านการตีความผล AI และการจัดการกรณีผิดพลาด เพื่อเพิ่มความเชื่อมั่นของแพทย์และพยาบาล

- การกำกับดูแลทางกฎหมายและจริยธรรม: กำหนดขอบเขตความรับผิดชอบ ตรวจสอบ bias ในข้อมูล และชัดเจนเรื่องการเก็บรักษาและการใช้งานข้อมูลผู้ป่วย

สรุปได้ว่าเสียงจากคลินิกสะท้อนแนวโน้มชัดเจน: ผู้ปฏิบัติงานยินดีรับ AI เป็นเครื่องมือเสริมที่ช่วยเพิ่มประสิทธิภาพการทำงาน แต่ต้องมีการออกแบบที่คำนึงถึงการใช้งานจริง การอธิบายผล การยืนยันโดยมนุษย์ และกรอบกำกับดูแลที่ชัดเจน เพื่อให้ AI เป็นผู้ช่วยที่เชื่อถือได้ ไม่ใช่สิ่งที่มาแทนบทบาทของผู้เชี่ยวชาญทางการแพทย์

ข้อมูลเชิงสถิติและงานวิจัยที่สนับสนุน/ท้าทาย

ข้อมูลเชิงสถิติและงานวิจัยที่สนับสนุน/ท้าทาย

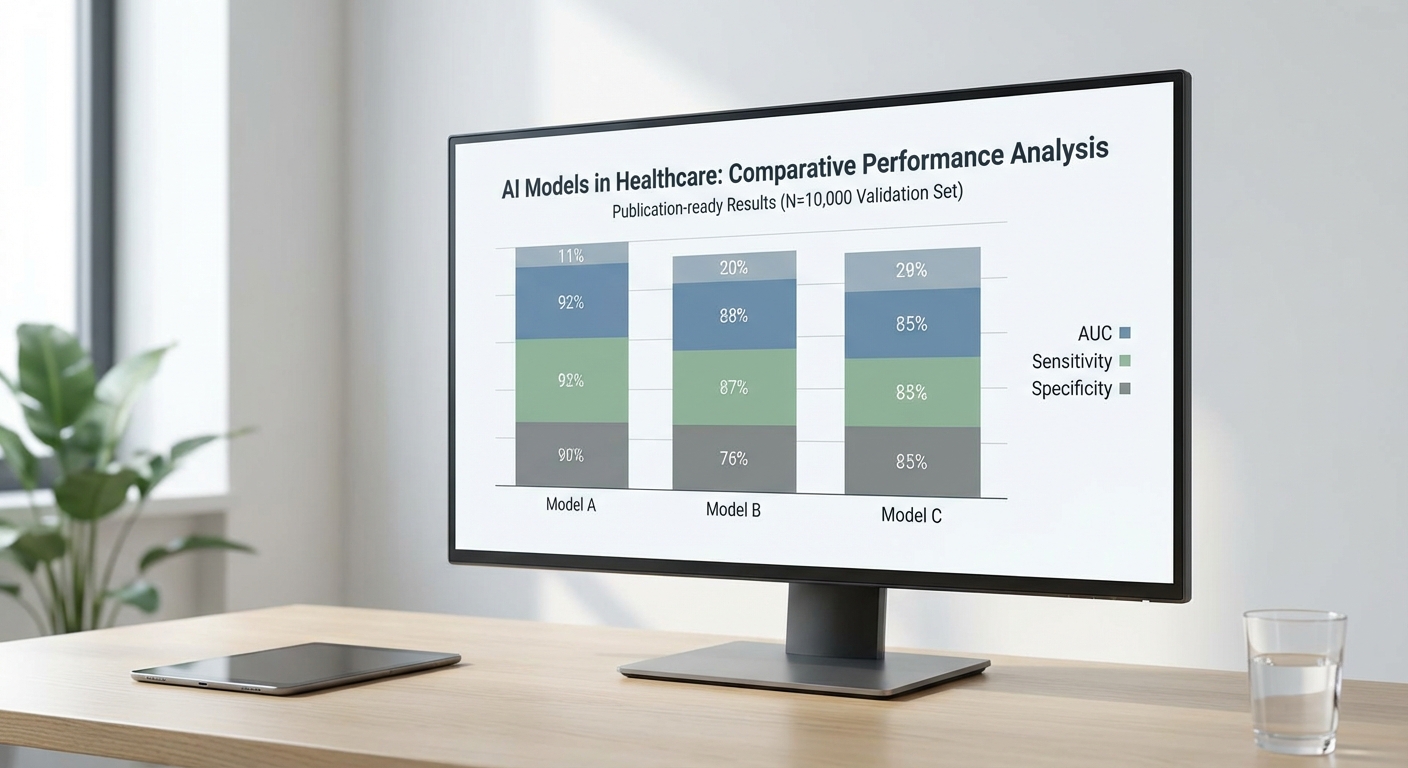

งานวิจัยเชิงทดลองและบทวิจารณ์เชิงระบบในช่วงไม่กี่ปีที่ผ่านมาให้ภาพที่หลากหลายเกี่ยวกับบทบาทของ AI ทางการแพทย์ ข้อมูลที่สนับสนุนความสามารถของโมเดลมักรายงานตัวชี้วัดประสิทธิภาพเช่น sensitivity, specificity, และ AUC (area under the ROC curve) ในหลายกรณี AI ทำได้ในระดับเทียบเท่าหรือเหนือกว่าผู้เชี่ยวชาญมนุษย์ ตัวอย่างเช่น งานของ Gulshan et al. (JAMA, 2016) เกี่ยวกับการตรวจคัดกรองโรคเบาหวานจอประสาทตาโดยใช้ deep learning รายงานจุดปฏิบัติการที่มี sensitivity ≈ 97.5% และ specificity ≈ 93.4% ในชุดทดสอบที่แยกไว้ งานของ Esteva et al. (Nature, 2017) ด้านการจำแนกมะเร็งผิวหนังยังรายงานค่า AUC สูงถึง ~0.96 ในชุดข้อมูลเฉพาะกรณี ทำให้เกิดความหวังว่า AI สามารถเสริมการตัดสินใจทางคลินิกได้อย่างมีนัยสำคัญเมื่อใช้ในบริบทที่เหมาะสม

อย่างไรก็ตาม งานวิจัยอีกกลุ่มหนึ่งเตือนถึงข้อจำกัดเชิงสถิติและปัญหาเชิงระบบที่อาจจำกัดการนำ AI ไปใช้จริงในคลินิก รายงานเชิงระบบหลายชิ้น (เช่นการทบทวนโมเดลคาดการณ์โรคระบาดและภาวะฉุกเฉิน) ชี้ให้เห็นว่าแม้บางโมเดลจะแสดงค่า AUC สูงในชุดข้อมูลฝึก แต่มีความเสี่ยงสูงต่อ overfitting และขาดความสามารถในการ generalize เมื่อเจอประชากรใหม่ ตัวอย่างเช่นการทบทวนโมเดลทำนาย COVID‑19 (Wynants et al., BMJ, 2020) พบว่าโมเดลส่วนใหญ่มีความเสี่ยงต่อ bias และรายงานไม่ครบถ้วน ทำให้ไม่สามารถนำไปใช้ได้โดยตรงในบริบททางคลินิก

ประเด็นปัญหาเกี่ยวกับ bias และความไม่เป็นธรรม (fairness) มีหลักฐานชัดเจนจากหลายงานศึกษา ตัวอย่างเด่นคือการศึกษาโดย Buolamwini & Gebru (2018) ซึ่งตรวจสอบระบบจดจำใบหน้าเชิงพาณิชย์และพบอัตราข้อผิดพลาดสูงกว่าสำหรับผู้หญิงผิวเข้มเมื่อเทียบกับผู้ชายผิวสว่าง (รายงานข้อผิดพลาดต่างกันอย่างมาก — ตัวอย่างเช่นข้อผิดพลาดสำหรับกลุ่มบางกลุ่มสูงถึงหลายสิบเปอร์เซ็นต์ ในขณะที่กลุ่มที่มีผลดีที่สุดมีข้อผิดพลาดต่ำกว่า 1%) นอกจากนี้งานของ Obermeyer et al. ได้ชี้ให้เห็นว่าการใช้ตัวแปรแทน (proxy) ที่ไม่สอดคล้องกับความต้องการทางคลินิก (เช่นการใช้ค่าใช้จ่ายการรักษาเป็นตัวแทนของความต้องการด้านสุขภาพ) สามารถทำให้โมเดลประเมินความเสี่ยงของกลุ่มคนผิวดำต่ำกว่าความจริง ส่งผลต่อการเข้าถึงการดูแลที่เหมาะสม งานวิจัยเหล่านี้สะท้อนว่าการวัดเพียง AUC หรือความแม่นยำรวม (overall accuracy) ไม่เพียงพอ — ต้องวิเคราะห์ผลลัพธ์แยกตามกลุ่มประชากร ย่านที่ตั้ง และสภาวะพื้นฐาน

เพื่อลดความเสี่ยงและยืนยันความน่าเชื่อถือก่อนนำระบบ AI ไปใช้เชิงคลินิก ผู้เชี่ยวชาญแนะนำแนวทางประเมินที่เป็นระบบ ดังนี้

- การตรวจสอบเชิงภายนอก (External validation) — ทดสอบโมเดลกับข้อมูลจากศูนย์อื่น (multi‑center) และประชากรที่แตกต่าง เพื่อตรวจสอบความสามารถในการ generalize และรายงานค่าสถิติพร้อมช่วงความเชื่อมั่น (CI) สำหรับ sensitivity, specificity, AUC

- การวิเคราะห์ความเท่าเทียม (Subgroup analysis & fairness metrics) — ประเมินผลลัพธ์แยกตามอายุ เพศ เชื้อชาติ/ชาติพันธุ์ ระดับสังคมเศรษฐกิจ และความชุกของโรค เพื่อหาจุดที่ประสิทธิภาพลดลงหรือเกิด bias

- การวัดการปรับเทียบ (Calibration) — ตรวจสอบว่า probabilistic output ของโมเดลสอดคล้องกับเหตุการณ์จริง (เช่น calibration plots, Brier score) เพื่อให้แน่ใจว่าความเสี่ยงที่รายงานมีความหมายเชิงคลินิก

- การประเมินทางคลินิกแบบก้าวหน้า (Prospective trials & impact studies) — ดำเนินการศึกษาควบคุมแบบสุ่ม (RCT) หรือการศึกษาเชิงสังเกตเชิงปฏิบัติการเพื่อตรวจสอบผลต่อการตัดสินใจของคลินิกและผลลัพธ์ของผู้ป่วย

- การตรวจสอบชุดข้อมูลและการเก็บข้อมูล (Data provenance) — ตรวจสอบที่มาของข้อมูล การประมวลผลล่วงหน้า (preprocessing) และการทำให้สมดุลของคลาส เพื่อป้องกันการรั่วไหลของข้อมูล (data leakage) และแหล่งที่มาของ bias

- การทดสอบความทนทานและการตรวจจับการเปลี่ยนแปลง (Robustness & drift detection) — ทำ stress tests, adversarial tests และตั้งระบบตรวจจับเมื่อข้อมูลเชิงป้อนเข้ามีการเปลี่ยนแปลง (data shift) หลังการใช้งานจริง

- การตรวจสอบความสามารถอธิบายได้และการออกแบบ human‑in‑the‑loop — ใช้เทคนิคอธิบายผล (explainability) ที่เหมาะสมและกำหนดบทบาทของบุคลากรทางการแพทย์เพื่อเป็นผู้กำกับการตัดสินใจสุดท้าย

- การปฏิบัติตามแนวทางมาตรฐานและกฎระเบียบ — ปฏิบัติตามคำแนะนำประชาสังคมวิชาชีพ เช่น TRIPOD, CONSORT‑AI/SPIRIT‑AI สำหรับการรายงาน และระเบียบของหน่วยงานกำกับดูแล (เช่น FDA, European CE) เมื่อเกี่ยวข้อง

สรุปคือ หลักฐานเชิงสถิติหลายชิ้นยืนยันว่า AI สามารถเสริมศักยภาพเชิงคลินิกได้จริงในกรอบงานที่ควบคุมได้ แต่ก็มีงานวิจัยที่เตือนถึง bias, ข้อจำกัดด้านความทั่วไป และปัญหาการทดสอบบนประชากรจริง ซึ่งหากไม่ได้รับการจัดการอย่างเป็นระบบอาจนำไปสู่ผลลัพธ์ที่ไม่เป็นธรรมและลดคุณค่าทางคลินิก ก่อนการนำไปใช้เชิงพาณิชย์หรือในโรงพยาบาล จึงควรยืนยันการตรวจสอบทั้งเชิงสถิติ การทดลองเชิงปฏิบัติการ และการตรวจสอบด้านจริยธรรมและกฎระเบียบอย่างครบถ้วน

ข้อกังวลด้านกฎหมาย จริยธรรม และความเป็นส่วนตัว

ข้อกังวลด้านกฎหมาย จริยธรรม และความเป็นส่วนตัว

การนำปัญญาประดิษฐ์ (AI) เข้ามาช่วยเสริมการดูแลทางคลินิกสร้างประโยชน์อย่างชัดเจน แต่ก็ยกประเด็นทางกฎหมาย จริยธรรม และความเป็นส่วนตัวที่ต้องได้รับการจัดการอย่างเป็นระบบ โดยเฉพาะเมื่อระบบ AI ถูกใช้เพื่อสนับสนุนการวินิจฉัย แนวทางรักษา หรือการคาดการณ์ความเสี่ยงของผู้ป่วย หัวใจของประเด็นเหล่านี้คือการกำหนดขอบเขตความรับผิดชอบและการปฏิบัติตามข้อกำกับดูแลที่เกี่ยวข้อง เช่น กฎหมายคุ้มครองข้อมูลส่วนบุคคล (เช่น PDPA ในประเทศไทย และ GDPR ในสหภาพยุโรป ซึ่งมีบทลงโทษทางการเงินสูงสุดถึง €20 ล้านหรือร้อยละ 4 ของรายได้รวมทั่วโลก) และข้อบังคับทางการแพทย์ที่อาจกำหนดให้ AI ที่มีวัตถุประสงค์ในการวินิจฉัยหรือรักษาต้องขึ้นทะเบียนเป็นเครื่องมือแพทย์ภายใต้กรอบเช่น EU MDR หรือข้อกำหนดการขึ้นทะเบียน/รับรองของ FDA ในสหรัฐอเมริกา

ในด้านความรับผิดชอบทางการแพทย์ ต้องชี้ชัดว่า AI เป็นเครื่องมือสนับสนุน ไม่ใช่ผู้ตัดสินใจสุดท้าย แต่ในทางปฏิบัติความเสี่ยงทางกฎหมายยังคงเกิดขึ้นได้ทั้งกับผู้พัฒนาระบบ (developer/vendor) ผู้ให้บริการระบบ (provider) และบุคลากรทางการแพทย์ที่นำระบบไปใช้ เรื่องสำคัญได้แก่การพิสูจน์มาตรฐานความปลอดภัยและประสิทธิผลผ่านการทดสอบทางคลินิก การเก็บบันทึก (audit trail) ของการตัดสินใจที่มีการใช้ AI และการกำหนดนโยบายความรับผิดชอบร่วมกันในสัญญา (contractual allocation of liability) เพื่อให้เกิดความชัดเจนเมื่อเกิดเหตุผิดพลาดหรือความเสียหาย

ด้านจริยธรรม ประเด็นที่ถูกหยิบยกบ่อยได้แก่ ความโปร่งใสของโมเดล (explainability) การป้องกัน อคติเชิงอัลกอริทึม (algorithmic bias) และการหลีกเลี่ยงการตัดสินใจเชิงอัตโนมัติที่ละเมิดสิทธิของผู้ป่วย ตัวอย่างเช่น ระบบคัดกรองที่ฝึกด้วยข้อมูลจากประชากรกลุ่มหนึ่งอาจให้ผลไม่เท่าเทียมกับกลุ่มอื่น ก่อให้เกิดความเสี่ยงด้านความยุติธรรมในการเข้าถึงการรักษา จึงจำเป็นต้องมีมาตรการประเมินความเป็นธรรม (fairness testing) และการอธิบายการตัดสินใจที่เพียงพอแก่ผู้ป่วยและแพทย์ เพื่อให้เกิดการยินยอมที่มีข้อมูลครบถ้วน (informed consent) และลดผลกระทบจาก "automation bias" ที่บุคลากรอาจยอมรับผลจาก AI โดยไม่ตั้งคำถาม

เพื่อบริหารความเสี่ยงอย่างเป็นรูปธรรม องค์กรสุขภาพและผู้พัฒนาควรนำแนวทางปฏิบัติ (best practices) มาประยุกต์ใช้ ดังนี้

- การตรวจสอบก่อนใช้งาน (pre-deployment validation) — รวมถึงการประเมินทางคลินิกแบบอิสระ (external validation), การทดสอบกับกลุ่มประชากรหลากหลาย และการประเมินความเสี่ยงด้านความเป็นส่วนตัว (Data Protection Impact Assessment) ก่อนนำระบบขึ้นใช้งานจริง

- การติดตามหลังใช้งาน (post-market surveillance) — ระบบต้องถูกติดตามผลแบบเรียลไทม์หรือเป็นระยะเพื่อจับสัญญาณการลดลงของประสิทธิภาพ (model drift), รายงานเหตุการณ์ไม่พึงประสงค์ และมีช่องทางแจ้งเตือนสำหรับผู้ป่วยและบุคลากร

- การมีมนุษย์เป็นผู้ตัดสินใจสุดท้าย (human-in-the-loop) — กระบวนการดูแลทางคลินิกควรกำหนดให้แพทย์หรือบุคลากรที่มีอำนาจตัดสินใจเป็นผู้ยืนยันผลการวินิจฉัย/การรักษา โดย AI ทำหน้าที่เป็นเครื่องมือช่วยวิเคราะห์และให้ข้อมูลสนับสนุน

- ความโปร่งใสและการสื่อสาร — แสดงขอบเขตของการใช้งาน AI ให้ผู้ป่วยทราบ ทั้งข้อจำกัดของระบบ แหล่งที่มาของข้อมูลที่ใช้ฝึก และระดับความเชื่อมั่นของคำแนะนำ เพื่อให้ผู้ป่วยสามารถตัดสินใจร่วมได้อย่างมีข้อมูล

- การมีส่วนร่วมกับหน่วยงานกำกับดูแล — การประสานงานกับหน่วยงานกำกับดูแลก่อนและระหว่างการนำระบบขึ้นใช้ เช่น การใช้ sandbox ทางกฎระเบียบ (regulatory sandboxes), การยื่นขอขึ้นทะเบียน/รับรองตามมาตรฐานที่เกี่ยวข้อง และการปฏิบัติตามแนวทางใหม่ที่ออกโดยหน่วยงานกำกับดูแลเพื่อเทคโนโลยี AI ในการแพทย์

โดยสรุป การนำ AI เข้ามาช่วยเสริมความเชี่ยวชาญทางคลินิกต้องเดินไปควบคู่กับกรอบการกำกับดูแลที่ชัดเจนและแนวปฏิบัติด้านจริยธรรมและความเป็นส่วนตัวที่เข้มแข็ง องค์กรที่ประสบความสำเร็จจะเป็นองค์กรที่สามารถพิสูจน์ความปลอดภัยและความเที่ยงตรงของระบบ จัดระบบการกำกับดูแลภายใน และสร้างความเชื่อมั่นให้ผู้ป่วยและผู้มีส่วนได้เสียผ่านการสื่อสารที่โปร่งใสและการมีมนุษย์เป็นผู้ตัดสินใจสุดท้ายเสมอ

ผลกระทบทางธุรกิจและแนวโน้มในอนาคต

ผลกระทบทางธุรกิจและแนวโน้มในอนาคต

โอกาสทางตลาดและโมเดลรายได้ — การยืนยันของซีอีโอว่าปัญญาประดิษฐ์ (AI) จะเสริมความเชี่ยวชาญทางคลินิกมากกว่าจะทดแทนนั้นสะท้อนกลยุทธ์เชิงพาณิชย์ที่เปลี่ยนจากการขายฮาร์ดแวร์เป็นการมอบบริการเชิงข้อมูลและซอฟต์แวร์อย่างต่อเนื่อง (recurring revenue) มากขึ้น ผู้ประกอบการอย่างฟิลิปส์สามารถขยายโมเดลรายได้ผ่าน: subscription สำหรับซอฟต์แวร์วินิจฉัยและแพลตฟอร์มการติดตามผู้ป่วยแบบเรียลไทม์, การคิดค่าบริการตามผลลัพธ์ (value-based care) ในโปรแกรมผู้ป่วยเรื้อรัง และการให้บริการวิเคราะห์ข้อมูลเชิงลึกเป็นบริการ (analytics-as-a-service) ตัวอย่างเช่น การให้สิทธิใช้งานซอฟต์แวร์ช่วยอ่านภาพทางรังสีแบบรายเดือนหรือการคิดค่าธรรมเนียมตามจำนวนผู้ป่วยที่ดีขึ้นหลังการแทรกแซงทางคลินิก สามารถเปลี่ยนโครงสร้างรายได้ให้มีความต่อเนื่องและคาดการณ์ได้มากขึ้น

จากมุมมองเชิงตัวเลข ภายในระยะเวลา 3–5 ปีข้างหน้า ผู้เล่นที่ลงทุนในบริการดิจิทัลและโมเดล subscription/ value-based ที่มีการพิสูจน์ผลลัพธ์ทางคลินิกได้ดี มีโอกาสเห็นสัดส่วนรายได้ซ้ำเพิ่มขึ้นอย่างมีนัยสำคัญ — ประเมินได้ว่าเป็นการยืดอายุวงจรรายได้และเพิ่มมาร์จิ้นเทียบกับธุรกิจฮาร์ดแวร์แบบเดิม นอกจากนี้การเชื่อมต่อข้อมูลจากอุปกรณ์ทางการแพทย์กับระบบ AI ยังเปิดช่องทางสำหรับการสร้างบริการเสริม (upsell) เช่น ระบบแจ้งเตือนผู้ป่วยเสี่ยงสูง และโปรแกรมการจัดการภาวะเรื้อรังที่คิดค่าบริการตามผลลัพธ์

ผลต่อบุคลากร: การเปลี่ยนบทบาทและทักษะที่ต้องการ — การนำ AI มาใช้จริงในสถานพยาบาลจะเปลี่ยนบทบาทของผู้เชี่ยวชาญหลายกลุ่ม จากงานที่เน้นการวิเคราะห์ข้อมูลขั้นต้นหรือการอ่านภาพซ้ำซ้อน จะกลายเป็นงานที่เน้นการตัดสินใจเชิงคลินิกที่มีความซับซ้อนสูงขึ้น งานที่เกี่ยวกับการตั้งค่าระบบ การตรวจสอบผลลัพธ์ของโมเดล และการสื่อสารผลการวินิจฉัยกับทีมผู้ป่วยจะมีความสำคัญมากขึ้น ซึ่งส่งผลให้ความต้องการทักษะใหม่เกิดขึ้น เช่น:

- Clinical informatics — ความสามารถเชื่อมโยงการใช้ AI กับแนวปฏิบัติทางคลินิก

- Data literacy — การตีความผลการวิเคราะห์และข้อจำกัดของโมเดล

- AI governance & compliance — ความเข้าใจด้านจริยธรรม ความโปร่งใส และข้อกำหนดด้านกฎระเบียบ

- Change management — ทักษะการบริหารการเปลี่ยนแปลงเพื่อให้การนำเทคโนโลยีใหม่เข้าสู่การปฏิบัติงานเป็นไปอย่างราบรื่น

การคาดการณ์เชิงปฏิบัติได้แก่ การเกิดบทบาทใหม่ เช่น “AI clinical supervisor”, “digital health coach” และ “device-data curator” โดยองค์กรที่เตรียมแผน reskilling และ upskilling อย่างเป็นระบบจะได้เปรียบเชิงการแข่งขัน และสามารถลดความเสี่ยงจากการต่อต้านเทคโนโลยีภายในองค์กร

แนวโน้มเทคโนโลยีใน 3–5 ปีข้างหน้า — ทิศทางที่คาดว่าจะชัดเจนรวมถึงการขยายตัวของ AI แบบ edge สำหรับการตรวจวินิจฉัยทันทีที่ขอบเครือข่าย, การใช้ federated learning เพื่อรักษาความเป็นส่วนตัวของข้อมูลผู้ป่วย, การพัฒนาโมเดลที่อธิบายผลได้ (explainable AI) เพื่อสร้างความเชื่อมั่นกับคลินิกและหน่วยงานกำกับดูแล รวมถึงการบูรณาการ AI เข้ากับการดูแลระยะไกล (telehealth) และระบบการชำระเงินแบบ value-based ซึ่งจะเป็นแรงขับให้เกิดการวัดผลลัพธ์จริงและการชำระค่าบริการตามผลลัพธ์

คำแนะนำเชิงกลยุทธ์สำหรับผู้บริหารองค์กรด้านสุขภาพ — เพื่อเตรียมตัวรับการเปลี่ยนผ่าน ควรพิจารณากลยุทธ์ดังต่อไปนี้:

- ลงทุนในข้อมูลและการกำกับดูแลข้อมูล (data governance) — สร้างมาตรฐานการจัดเก็บและการเชื่อมโยงข้อมูลผู้ป่วยเพื่อให้โมเดล AI ทำงานได้อย่างน่าเชื่อถือและเป็นไปตามกฎระเบียบ

- เริ่มจากกรณีใช้งานที่สร้างมูลค่าได้ชัดเจน — ทำโปรเจ็กต์นำร่องที่วัดผลตอบแทนการลงทุน (ROI) ได้ เช่น ลดเวลาอ่านภาพ ลดอัตรา re-admission หรือปรับปรุงผลลัพธ์ผู้ป่วยเรื้อรัง

- ออกแบบโมเดลรายได้แบบผสม — ผสาน subscription, fee-for-service และ value-based contracting เพื่อกระจายความเสี่ยงและสร้างรายได้ซ้ำ

- วางแผนการพัฒนาทรัพยากรบุคคล — ลงทุนในโปรแกรม reskilling/ upskilling ร่วมกับพันธมิตรการศึกษา และกำหนดเส้นทางอาชีพใหม่สำหรับบทบาทที่เกี่ยวกับ AI

- สร้างพันธมิตรทางนวัตกรรม — ร่วมมือกับสตาร์ทอัพ, สถาบันวิจัย และผู้ให้บริการคลาวด์เพื่อลดเวลาในการนำผลิตภัณฑ์สู่ตลาดและแบ่งปันความเสี่ยงด้านการพัฒนา

- ให้ความสำคัญกับความโปร่งใสและจริยธรรม — พัฒนานโยบายการใช้งาน AI ที่ชัดเจน เพื่อสร้างความเชื่อมั่นต่อแพทย์ ผู้ป่วย และหน่วยงานกำกับดูแล

สรุปได้ว่า การมองว่า AI เป็นการเสริมความเชี่ยวชาญทางคลินิกเปิดโอกาสทางธุรกิจใหม่ ๆ ทั้งในแง่รายได้และประสิทธิภาพการรักษา แต่ความสำเร็จเชิงพาณิชย์จำเป็นต้องมีการลงทุนในการจัดการข้อมูล การพัฒนาทรัพยากรบุคคล และการออกแบบโมเดลธุรกิจที่สามารถวัดผลลัพธ์เชิงคลินิกได้จริงในช่วง 3–5 ปีข้างหน้า

บทสรุป

ซีอีโอของฟิลิปส์ยืนยันว่าเทคโนโลยีปัญญาประดิษฐ์ (AI) ที่บริษัทพัฒนาขึ้นถูกนำเสนอในฐานะ เครื่องมือเสริมศักยภาพทางคลินิก มากกว่าจะมาแทนที่บุคลากรทางการแพทย์ โดยต้องมีการควบคุมและตรวจสอบอย่างต่อเนื่องก่อนและหลังการนำไปใช้จริง ได้แก่ การประเมินเชิงเทคนิค (validation และ performance testing), การตรวจสอบความโปร่งใสและการอธิบายผล (explainability), นโยบายคุ้มครองข้อมูลผู้ป่วย และการปฏิบัติตามข้อกำหนดทางกฎหมายและกฎระเบียบด้านการแพทย์ ตัวอย่างการใช้งานที่ชัดเจนคือการช่วยวิเคราะห์ภาพรังสี การจัดลำดับความเร่งด่วนของผู้ป่วย และการสนับสนุนการตัดสินใจในการวินิจฉัย ซึ่งบริษัทระบุว่าการนำ AI มาใช้ควบคู่กับการตัดสินใจของแพทย์สามารถปรับปรุงประสิทธิภาพการทำงานและคุณภาพการดูแลผู้ป่วยได้ (รายงานการประเมินภายในและงานศึกษาบางชิ้นชี้ว่าผลประโยชน์เชิงประสิทธิภาพมักอยู่ในระดับสองหลักของการปรับปรุง เช่น ลดเวลารอหรือเพิ่มความไวของการตรวจ) แต่ผลลัพธ์เหล่านี้ขึ้นกับการออกแบบงาน การฝึกอบรมผู้ใช้งาน และกระบวนการกำกับดูแลที่เหมาะสม.

เพื่อให้การนำ AI ไปใช้เชิงกว้างเกิดผลลัพธ์ที่ปลอดภัยและคุ้มค่า ฟิลิปส์เน้นว่าต้องพิจารณาองค์ประกอบทั้งด้านเทคนิค กฎหมาย จริยธรรม และการพัฒนาทักษะของบุคลากรอย่างรอบด้าน — รวมถึงการออกแบบโปรแกรมอบรม (re‑skilling/up‑skilling), การจัดการความเสี่ยง, การสร้างกระบวนการตรวจสอบหลังการใช้งาน (post‑market surveillance) และการร่วมมือกับหน่วยงานกำกับดูแลและผู้ใช้ในภาคสนาม มุมมองอนาคตที่บริษัทนำเสนอคือการปรับใช้อย่างเป็นขั้นตอน (phased deployment) โดยให้มนุษย์ยังคงเป็นผู้ตัดสินใจขั้นสุดท้าย ขณะเดียวกันก็พัฒนากลไกการตรวจสอบและมาตรฐานร่วมกับภาคส่วนต่าง ๆ เพื่อขยายการใช้งานอย่างยั่งยืน หากดำเนินการตามหลักการเหล่านี้ AI สามารถเป็นแรงขับเคลื่อนสำคัญในการเพิ่มคุณภาพการรักษาและลดต้นทุนระบบสาธารณสุขในระยะกลางถึงยาว.

📰 แหล่งอ้างอิง: Hindustan Times